Neueste Artikel aus der Welt der Künstlichen Intelligenz

27 April 2026

Caveman: Warum es sich lohnt, wenn die KI wie ein Höhlenmensch spricht

Yabba-Dabba-Doo! Erinnern Sie sich an Fred Feuerstein? Er wohnte in Steintal, fuhr ein Auto, das mit bloßen Füßen angetrieben wurde, hatte einen Dinosaurier als Kran und einen Flugsaurier als Plattenspieler. Und doch besaß diese Steinzeit-Zivilisation bei genauerem Hinsehen bereits alles, was für ein komfortables modernes Leben nötig war: funktionierende Geräte, effiziente Technologie, praktische Lösungen. Es fehlte nur der glänzende Anstrich des Fortschritts. Vielleicht hätten wir schon damals verstehen sollen, dass das Wesentliche ausreicht und dass zunehmende Komplexität nicht unbedingt einen Mehrwert bedeutet.

24 April 2026

Das lernende Gedächtnis: Karpathy fordert RAG mit einer evolutionären Knowledge Base heraus

Es gibt einen Moment, den jeder kennt, der intensiv mit einem Sprachmodell gearbeitet hat: den Reset. Man baut etwas Komplexes auf, vielleicht eine ausgefeilte Softwarearchitektur oder eine Recherche, die Dutzende von Quellen verflicht, und das Modell hat alles verstanden, hält den Faden, antwortet mit chirurgischer Präzision. Dann endet die Sitzung, oder man erreicht das Kontextlimit, und die KI vergisst alles. Sie fängt bei Null an. Man muss ihr erneut erklären, wer man ist, was man tut, welche Entscheidungen man gemeinsam getroffen hat. Es ist wie in Christopher Nolans Film „Memento“, in dem der Protagonist sich Informationen auf den Körper tätowieren muss, weil das Kurzzeitgedächtnis nicht funktioniert: brutal, redundant und zutiefst frustrierend.

20 April 2026

Der Code, der nicht geschrieben wird: CodeSpeak und die Revolution der Spezifikationen

Es gibt Namen, die in der Welt der Programmierung ein besonderes Gewicht haben. Andrey Breslav ist einer von ihnen. Wenn heute Millionen von Android-Entwicklern Code in Kotlin statt in Java schreiben, ist das zu einem großen Teil sein Verdienst: Breslav ist der Hauptentwickler der Sprache, die JetBrains 2011 auf den Markt brachte und die Google 2017 während der Google I/O, die das mobile Ökosystem für immer veränderte, offiziell als bevorzugte Sprache für Android einführte. Er ist kein Akademiker, der von einem Lehrstuhl aus theoretisiert: Er gehört zu denen, die Werkzeuge gebaut haben, die täglich von Hunderttausenden von Menschen in der realen Welt benutzt werden – mit all den Kompromissen, Produktionsfehlern und dem Druck, den dies mit sich bringt.

20 April 2026

Gemma 4 lokal: 26 Milliarden auf meinem PC

Es bereitet eine besondere Genugtuung, etwas laufen zu lassen, von dessen Download eigentlich abgeraten würde. Nicht die Genugtuung des Hackers, der ein System knackt – das ist etwas anderes –, sondern jene ruhigere, handwerkliche Freude dessen, der die Schrauben ein wenig über das empfohlene Drehmoment hinaus anzieht und feststellt, dass die Struktur trotzdem hält. Es ist die Art von Genugtuung, die ich diese Woche empfunden habe, als Gemma 4 26B auf meinem Consumer-PC mit einer Flüssigkeit lief, die ich nicht erwartet hatte.

15 April 2026

10 Regeln für den Einsatz von KI im Unternehmen

Beginnen wir mit einer Zahl, die uns den Spiegel vorhält. Laut dem McKinsey State of AI Report vom November 2025 nutzen bereits 88 % der Organisationen KI in mindestens einer Geschäftsfunktion. Doch im selben Zeitraum schätzten das Weltwirtschaftsforum und Accenture, dass weniger als 1 % dieser Unternehmen einen verantwortungsvollen KI-Ansatz vollständig operativ umgesetzt haben, während 81 % in den embryonalsten Phasen der Governance-Reife verharren. Das Paradoxon ist perfekt: Fast alle nutzen KI, fast niemand steuert sie wirklich.

15 April 2026

Project Glasswing: Claude Mythos und das mysteriöse Modell

Anthropic stellt eine Sicherheitsinitiative vor, um kritische Software im Zeitalter der künstlichen Intelligenz zu verteidigen. Im Zentrum steht Claude Mythos Preview, das leistungsstärkste Modell, das das Unternehmen je entwickelt hat. Es ist in der Lage, Schwachstellen aufzuspüren, die Menschen in dreißig Jahren nicht gefunden haben. Das Paradoxon ist: Du wirst es nicht benutzen können.

13 April 2026

TurboQuant: Ein Bit zur Neudefinition der Grenzen der künstlichen Intelligenz

Ende April 2025 veröffentlichten vier Forscher von Google Research und der New York University auf arXiv ein Paper mit dem nüchternen Titel: *TurboQuant: Online Vector Quantization with Near-optimal Distortion Rate. Monatelang sprach außerhalb akademischer Kreise fast niemand darüber. Dann, im März 2026, veröffentlichte Google einen Post auf dem offiziellen Blog, in dem TurboQuant als Durchbruch bei der Effizienz von Sprachmodellen angekündigt wurde – verbunden mit der Annahme zur ICLR 2026. Innerhalb von achtundvierzig Stunden erschien das Paper in jedem Tech-Feed. Ankündigungen von Kompressionen, die mehr als fünfmal höher sind, ohne Qualitätsverlust, überall enthusiastische Schlagzeilen. Ein Jahr Verzögerung, eine Welle des Hypes.*

10 April 2026

MIT und die „bescheidene“ KI: Wie man Modellen beibringt, „ich weiß es nicht“ zu sagen

Es gibt ein Gedankenexperiment, das Forscher am MIT verwenden, um das Problem im Herzen ihrer Forschung zu erklären. Stellen Sie sich einen Intensivmediziner um drei Uhr morgens vor, nach einer zwölfstündigen Schicht. Auf dem Monitor erscheint eine von der KI generierte Diagnose: bakterielle Pneumonie, Wahrscheinlichkeit 94 %. Der Arzt hat Zweifel, ein ungutes Gefühl, dass etwas nicht stimmt. Aber die Zahl ist da, präzise, autoritär. Und der Arzt gibt nach.

08 April 2026

Leonardo-Stiftung: Italien in der Ära der KI – Teil 2

In der ersten Folge haben wir das System Italien im Bereich der künstlichen Intelligenz kartiert: ein stark wachsender 1,2-Milliarden-Markt, der jedoch zwischen Großunternehmen und KMU gespalten ist, zwei Supercomputer unter den Top fünf in Europa, auf dem Kontinent einzigartige souveräne Sprachmodelle und ein KI-Gesetz, das Italien zum ersten EU-Land mit einer solchen Regelung macht. Reale Spitzenleistungen mit einem Paradoxon im Zentrum: Hardware und Cloud bleiben vom Ausland abhängig, und der regulatorische Vorteil gilt nur, wenn die Durchführungsverordnungen kommen. In dieser zweiten Folge tauchen wir in das konkretere Gefüge ein: die Unternehmen, die öffentliche Verwaltung, die flüchtenden Talente und die Roadmap für 2030.

06 April 2026

Leonardo-Stiftung: Italien in der Ära der KI – Teil 1

Am 19. März 2026 wird im Sala della Regina der Abgeordnetenkammer ein Dokument vorgestellt, das sich deutlich von der Kategorie institutioneller Berichte abhebt, die dazu bestimmt sind, auf irgendeinem ministeriellen Regal zu verstauben. "Italien in der Ära der KI. Wachstum, Herausforderungen und Perspektiven einer laufenden Revolution" entstand mit einem erklärten Ehrgeiz: keine spekulative Übung, kein optimistisches Manifest, sondern eine operative Landkarte des Standes der künstlichen Intelligenz in Italien, mit Empfehlungen, die durch messbare Indikatoren, präzise institutionelle Verantwortlichkeiten und eine Analyse der Implementierungsbarrieren ergänzt werden. Es ist im wörtlichen Sinne das, was der Titel verspricht: ein Kompass.

03 April 2026

MiniMax M2.7: Die KI, die (fast) von selbst lernt

Ein Monat. Das ist die Zeit, die M2.5 von M2.7 trennt, der neuen Version des MiniMax-Modells, die am 18. März 2026 veröffentlicht wurde. In einem Sektor, in dem Entwicklungszyklen früher in Jahren und dann in Monaten gemessen wurden, sind ein paar Wochen zum neuen normalen Intervall geworden. Aber diesmal ist der zeitliche Abstand nur das am wenigsten interessante Detail.

01 April 2026

Das MIT erfüllt das Versprechen der Röntgenbrille

Wer zwischen Ende der 70er und Anfang der 80er Jahre jung war, erinnert sich gut an jenes Gefühl, das beim Durchblättern der letzten Seiten von *L'Intrepido oder Lanciostory aufkam: Inmitten von Anzeigen für Kugelschreiber und Zeichenfernkurse prangte eine Reklame, die das Unmögliche versprach. Röntgenbrillen. Echte. Für ein paar Lire, inklusive Versand. Das Versprechen war glasklar: Setzen Sie sie auf und Sie werden durch alles hindurchsehen. Wände, Schachteln, Kleidung. Die Realität, wie jeder Junge, der der Versuchung erlag, bitterlich feststellen musste, war weitaus prosaischer: ein Stück Pappe mit einem kuriosen optischen Effekt, der auf Lichtbeugung basierte und höchstens in der Lage war, die eigene Hand transparent erscheinen zu lassen. Ein Betrug à la Totò, eine billige Illusion.*

30 März 2026

Ihr Modell, Ihre Regeln: Mistral Forge und die proprietäre KI

Es gibt ein subtiles Missverständnis im Kern dessen, wie die meisten Unternehmen heute künstliche Intelligenz einsetzen. Sie senden Prompts an Modelle, die auf Milliarden von Internetseiten, Büchern, Artikeln, Foren und öffentlichem Code auf GitHub trainiert wurden, und erwarten Antworten, die auf ihre interne Realität kalibriert sind. Aber diese interne Realität – die Betriebsabläufe eines Pharmaunternehmens, die Wartungshandbücher einer Turbine, die Standardverträge einer Mailänder Anwaltskanzlei, die Compliance-Richtlinien einer Bank – ist nie in einen Trainingsdatensatz eingegangen. Es ist, als würde man jemanden, der die gesamte Treccani-Enzyklopädie gelesen hat, bitten zu erklären, wie der interne Genehmigungsprozess für einen Urlaubsantrag in Ihrem Unternehmen funktioniert. Die Antwort wird allgemein, höflich und nutzlos sein.

27 März 2026

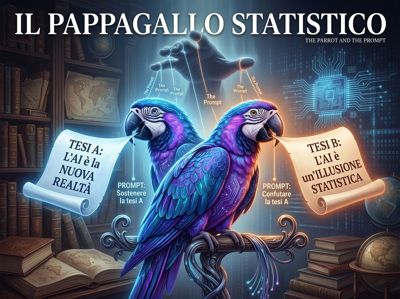

Wie ein LLM immer die Wahrheit sagt, die Sie hören wollen

An angelsächsischen Universitäten gibt es eine Disziplin namens Competitive Debate, die in Italien nie den Raum gefunden hat, den sie verdient. Die Regeln sind einfach und brutal: Man weist Ihnen eine These zu, irgendeine These, und Sie müssen sie mit allem verteidigen, was Sie haben. Dann weist man Ihnen die gegenteilige These zu, und Sie tun dasselbe. Das Ziel ist nicht, die Wahrheit zu finden, sondern zu verstehen, wie Argumentation funktioniert, ihre Muskeln, ihre blinden Flecken, ihre rhetorischen Tricks. Professionelle Debattierer tun dies seit Jahrhunderten. Jetzt tun es auch Maschinen. Und viel besser als wir.

25 März 2026

Jenseits des Polarkreises: Eine aus einer Masterarbeit hervorgegangene KI schreibt den europäischen Fußball neu

Wenn Sie Inter-Fan sind, weiß ich bereits, wie es Ihnen geht. Jener Abend des 24. Februar 2026 klebt an Ihnen wie ein nasses Trikot nach der Verlängerung. Nehmen Sie es nicht persönlich, so ist der Fußball. Aber wenn Sie es schaffen, sich für einen Moment von Ihrem Schal zu lösen und zu schauen, was an jenem Abend im San Siro wirklich passiert ist, werden Sie etwas viel Interessanteres als eine Niederlage entdecken. Sie werden entdecken, dass Bodø/Glimt Sie nicht zufällig geschlagen hat und dass hinter jenen zwei Toren von Hauge und Evjen – jenen, die das Doppelduell mit einem Gesamtergebnis von 5:2 besiegelten und den Finalisten der Champions League der Vorsaison ausschalteten – eine Geschichte steckt, die die Zukunft des europäischen Fußballs betrifft. Vielmehr die Zukunft des Fußballs schlechthin.