Ultimi Articoli dal mondo dell'Intelligenza Artificiale

29 aprile 2026

AI Index Report 2026 di Stanford: l'AI accelera, la governance frena

Cinquantatré percento di adozione globale in tre anni, più rapido di internet e del personal computer. Ottantotto percento delle organizzazioni che dichiara di usare l'AI. Un benchmark di programmazione, SWE-bench Verified, passato dal 60% a quasi il 100% in dodici mesi. Investimenti privati negli USA a 285,9 miliardi di dollari, ventitré volte quelli cinesi. Un divario di cinquanta punti percentuali tra cosa si aspettano dall'AI gli esperti e cosa ne pensa il pubblico. Questi cinque numeri inquadrano il perimetro del 2026 AI Index Report di Stanford HAI: nona edizione di un documento che funziona da specchio impietoso di un settore che accelera molto più in fretta di chiunque riesca a misurarla, regolarla o assorbirla socialmente.

27 aprile 2026

Caveman: l'AI che parla come un cavernicolo conviene

Yabba-dabba-doo! Ricordate Fred Flintstone? Abitava a Bedrock, guidava un'auto spinta a piedi nudi, aveva un dinosauro come gru e uno pterodattilo come giradischi. Eppure, a guardarla bene, quella civiltà dell'età della pietra era già in possesso di tutto il necessario per una vita moderna confortevole, congegni funzionanti, tecnologia efficiente, soluzioni pratiche. Mancava solo la patina luccicante del progresso. Forse avremmo dovuto capire già allora che l'essenziale basta, e che aggiungere complessità non significa necessariamente aggiungere valore.

24 aprile 2026

La memoria che impara: Karpathy sfida il RAG con una knowledge base evolutiva

C'è un momento che chiunque abbia lavorato intensamente con un modello linguistico conosce bene: il reset. Stai costruendo qualcosa di complesso, magari un'architettura software elaborata o una ricerca che intreccia dozzine di fonti, e il modello ha capito tutto, tiene il filo, risponde con precisione chirurgica. Poi la sessione finisce, oppure arrivi al limite di contesto, e l'AI dimentica tutto. Ricomincia da zero. Tu devi rispiegarle chi sei, cosa stai facendo, quali decisioni avete preso insieme. È come il film "Memento" di Christopher Nolan, dove il protagonista deve tatuarsi le informazioni sul corpo perché la memoria a breve termine non funziona: brutale, ridondante, e profondamente frustrante.

22 aprile 2026

Il codice che non si scrive: CodeSpeak e la rivoluzione delle specifiche

Ci sono nomi che nel mondo della programmazione portano un peso specifico. Andrey Breslav è uno di questi. Se oggi milioni di sviluppatori Android scrivono codice in Kotlin anziché in Java, è in buona parte merito suo: Breslav è il progettista principale del linguaggio che JetBrains lanciò nel 2011 e che Google adottò ufficialmente come linguaggio preferito per Android nel 2017, durante il Google I/O che cambiò l'ecosistema mobile per sempre. Non è un accademico che teorizza da una cattedra: è uno di quelli che hanno costruito strumenti usati ogni giorno da centinaia di migliaia di persone nel mondo reale, con tutti i compromessi, i bug di produzione e le pressioni che questo comporta.

20 aprile 2026

Gemma 4 in locale: 26 miliardi sul mio PC

C'è una soddisfazione particolare nel fare girare qualcosa che sarebbe sconsigliato scaricare. Non la soddisfazione dell'hacker che forca un sistema, quella è roba diversa, ma quella più tranquilla e artigianale di chi stringe le viti un po' oltre il serraggio raccomandato e scopre che la struttura regge lo stesso. È il tipo di soddisfazione che ho trovato questa settimana, mentre Gemma 4 26B girava sul mio PC consumer con una fluidità che non mi aspettavo.

17 aprile 2026

10 regole per usare l'AI in azienda

Partiamo da un dato che vale come specchio. Secondo il rapporto McKinsey State of AI del novembre 2025, l'88% delle organizzazioni usa già l'AI in almeno una funzione di business. Eppure, nello stesso periodo, il World Economic Forum e Accenture hanno stimato che meno dell'1% di queste ha pienamente reso operativo un approccio di AI responsabile, mentre l'81% rimane nelle fasi più embrionali di maturità governance. Il paradosso è servito: quasi tutti usano l'AI, quasi nessuno la governa davvero.

15 aprile 2026

Project Glasswing: Claude Mythos e il modello misterioso

Anthropic presenta un'iniziativa di sicurezza per difendere il software critico nell'era dell'intelligenza artificiale. Al centro c'è Claude Mythos Preview, il modello più potente mai sviluppato dall'azienda, capace di scovare vulnerabilità che gli esseri umani non hanno trovato in trent'anni. Il paradosso è che non potrai usarlo.

13 aprile 2026

TurboQuant: un bit per ridefinire i limiti dell'intelligenza artificiale

Alla fine di aprile 2025, quattro ricercatori di Google Research e della New York University pubblicavano su arXiv un paper dal titolo sobrio: *TurboQuant: Online Vector Quantization with Near-optimal Distortion Rate. Per mesi, quasi nessuno ne ha parlato al di fuori dei circoli accademici. Poi, a marzo 2026, Google pubblica un post sul blog ufficiale che annuncia TurboQuant come una svolta nell'efficienza dei modelli linguistici, con l'accettazione all'ICLR 2026, e nel giro di quarantotto ore il paper compare su ogni feed tech. Annunci di compressioni oltre cinque volte superiori senza perdita di qualità, titoli entusiastici ovunque. Un anno di ritardo, un'ondata di clamore.*

10 aprile 2026

MIT e l’AI “umile”: come insegnare ai modelli a dire “non lo so”

C'è un esperimento mentale che i ricercatori del MIT usano per spiegare il problema al cuore della loro ricerca. Immaginate un medico di terapia intensiva alle tre di notte, dopo dodici ore di turno. Sul monitor compare una diagnosi generata dall'AI: polmonite batterica, probabilità 94%. Il medico ha un dubbio, una sensazione viscerale che qualcosa non torni. Ma il numero è lì, preciso, autorevole. E il medico cede.

08 aprile 2026

Fondazione Leonardo: L'Italia nell'era dell'IA - Parte 2

Nella prima puntata abbiamo mappato il sistema Italia nell'intelligenza artificiale: un mercato da 1,2 miliardi in forte crescita ma spaccato tra grandi imprese e PMI, due supercomputer tra i primi cinque in Europa, modelli linguistici sovrani unici nel continente e una legge sull'IA che fa dell'Italia il primo Paese UE ad averla. Eccellenze reali, con un paradosso al centro: hardware e cloud restano dipendenti dall'estero, e il vantaggio normativo vale solo se i decreti attuativi arrivano. In questa seconda puntata entriamo nel tessuto più concreto: le aziende, la pubblica amministrazione, i talenti che fuggono e la roadmap per il 2030.

06 aprile 2026

Fondazione Leonardo: L'Italia nell'era dell'IA - Parte 1

Il 19 marzo 2026, nella Sala della Regina della Camera dei Deputati, viene presentato un documento che si distingue nettamente dalla categoria dei rapporti istituzionali destinati a prendere polvere su qualche scaffale ministeriale. "L'Italia nell'era dell'IA. Crescita, sfide e prospettive di una rivoluzione in corso" nasce con un'ambizione dichiarata: non un esercizio speculativo, non un manifesto ottimista, ma una mappa operativa dello stato dell'intelligenza artificiale in Italia, con raccomandazioni corredate di indicatori misurabili, responsabilità istituzionali precise e analisi delle barriere all'implementazione. È, in senso letterale, quello che il titolo promette: una bussola.

03 aprile 2026

MiniMax M2.7: l'AI che impara da sé stessa (quasi)

Un mese. È il tempo che separa M2.5 da M2.7, la nuova versione del modello di MiniMax rilasciata il 18 marzo 2026. In un settore dove i cicli di sviluppo si misuravano in anni e poi in mesi, poche settimane sono diventate il nuovo intervallo normale. Ma questa volta la distanza temporale è solo il dettaglio meno interessante.

01 aprile 2026

Il MIT realizza la promessa degli occhiali a raggi X

Chi era ragazzo tra la fine dei '70 e i primi degli '80 ricorda bene quella sensazione che arrivava sfogliando le ultime pagine de *L'Intrepido o di Lanciostory: in mezzo alle pubblicità di penne a sfera e corsi di disegno per corrispondenza, campeggiava una réclame che prometteva l'impossibile. Occhiali a raggi X. Veri. Per poche lire, spedizione compresa. La promessa era cristallina: indossali e vedrai attraverso qualsiasi cosa. Muri, scatole, vestiti. La realtà, come scopriva amaramente ogni ragazzo che cedeva alla tentazione, era molto più prosaica: un cartoncino con un curioso effetto ottico basato sulla diffrazione della luce, capace al massimo di far sembrare trasparente la propria mano. Una truffa alla Totò, un illusione a buon mercato.*

30 marzo 2026

Il tuo modello, le tue regole: Mistral Forge e l'AI proprietaria

C'è un equivoco sottile al cuore di come la maggior parte delle aziende usa l'intelligenza artificiale oggi. Mandano prompt a modelli addestrati su miliardi di pagine internet, su libri, articoli, forum, codice pubblico su GitHub, e si aspettano risposte calibrate sulla loro realtà interna. Ma quella realtà interna, le procedure operative di un'azienda farmaceutica, i manuali di manutenzione di una turbina, i contratti tipo di uno studio legale milanese, le policy di compliance di una banca, non è mai entrata in nessun dataset di addestramento. È come chiedere a qualcuno che ha letto tutta la Treccani di spiegare come funziona il processo di approvazione interna di una richiesta di ferie nella vostra azienda. La risposta sarà generica, educata, inutile.

27 marzo 2026

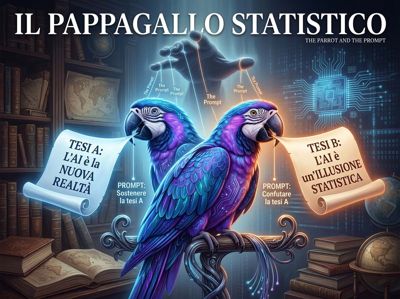

Come un LLM dice sempre la verità che vuoi sentire

Nelle università anglosassoni esiste una disciplina che si chiama *competitive debate, e che in Italia non ha mai trovato lo spazio che merita. Le regole sono semplici e brutali: ti assegnano una tesi, qualsiasi tesi, e devi difenderla con tutto ciò che hai. Poi ti assegnano la tesi opposta, e fai lo stesso. L'obiettivo non è trovare la verità, è capire come funziona l'argomentazione, i suoi muscoli, i suoi punti ciechi, i suoi trucchi retorici. I debater professionisti lo fanno da secoli. Ora lo fanno anche le macchine. E molto meglio di noi.*