El Hospital Virtual: Cuando la Inteligencia Artificial se convierte en Doctor

El Agent Hospital chino simula miles de diagnósticos al día en un mundo virtual. ¿Es el futuro de la medicina o el comienzo de una revolución que nadie ha pedido? Imaginen un hospital que funciona veinticuatro horas al día, siete días a la semana. Los médicos visitan a los pacientes, ordenan análisis, interpretan radiografías, prescriben terapias. En pocos días tratan diez mil casos clínicos, acumulando una experiencia que requeriría años en una sala de urgencias abarrotada. Solo hay un detalle que hace que todo esto sea inquietante: ninguno de esos pacientes existe realmente. Nadie sufre, nadie se cura, nadie muere. Es como si *Los Sims se hubiera encontrado con E.R. en una dimensión donde nadie está jugando, pero algo está aprendiendo.*

El Agent Hospital de la Universidad de Tsinghua, inaugurado oficialmente en abril de 2025 con la primera integración en el Hospital Changgung de Pekín, representa algo más que un experimento académico. Es todo un ecosistema sanitario sintético donde las inteligencias artificiales se entrenan para ser médicos tratando a entidades que solo existen como cadenas de código. Cuarenta y dos médicos virtuales, veintiuna especialidades médicas, quinientos mil pacientes que nunca han respirado. La pregunta ya no es si la inteligencia artificial puede hacer diagnósticos médicos: la pregunta es si estamos construyendo los médicos del futuro o si acabamos de abrir una caja de Pandora que nadie sabe cómo cerrar.

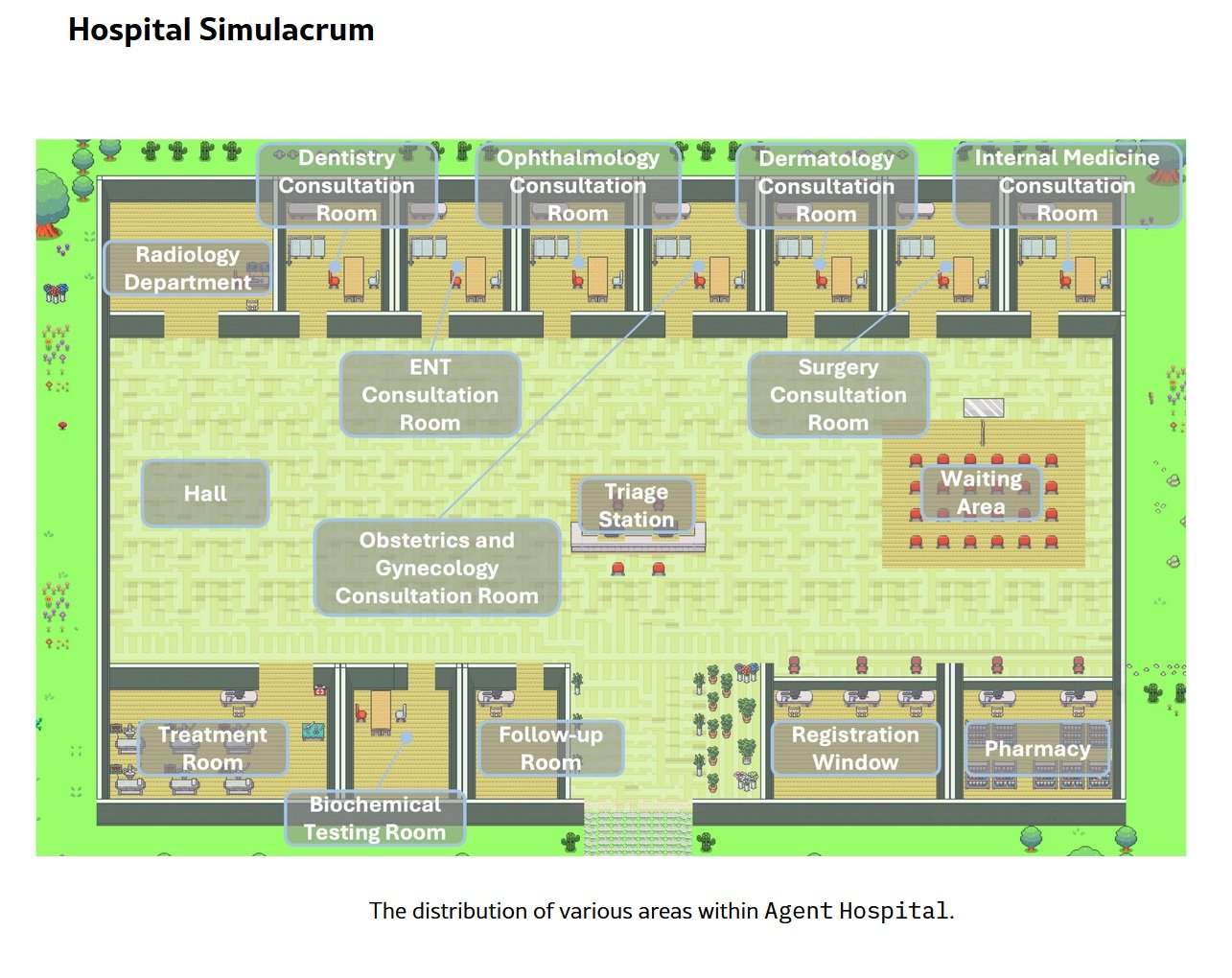

Anatomía de un Mundo Virtual

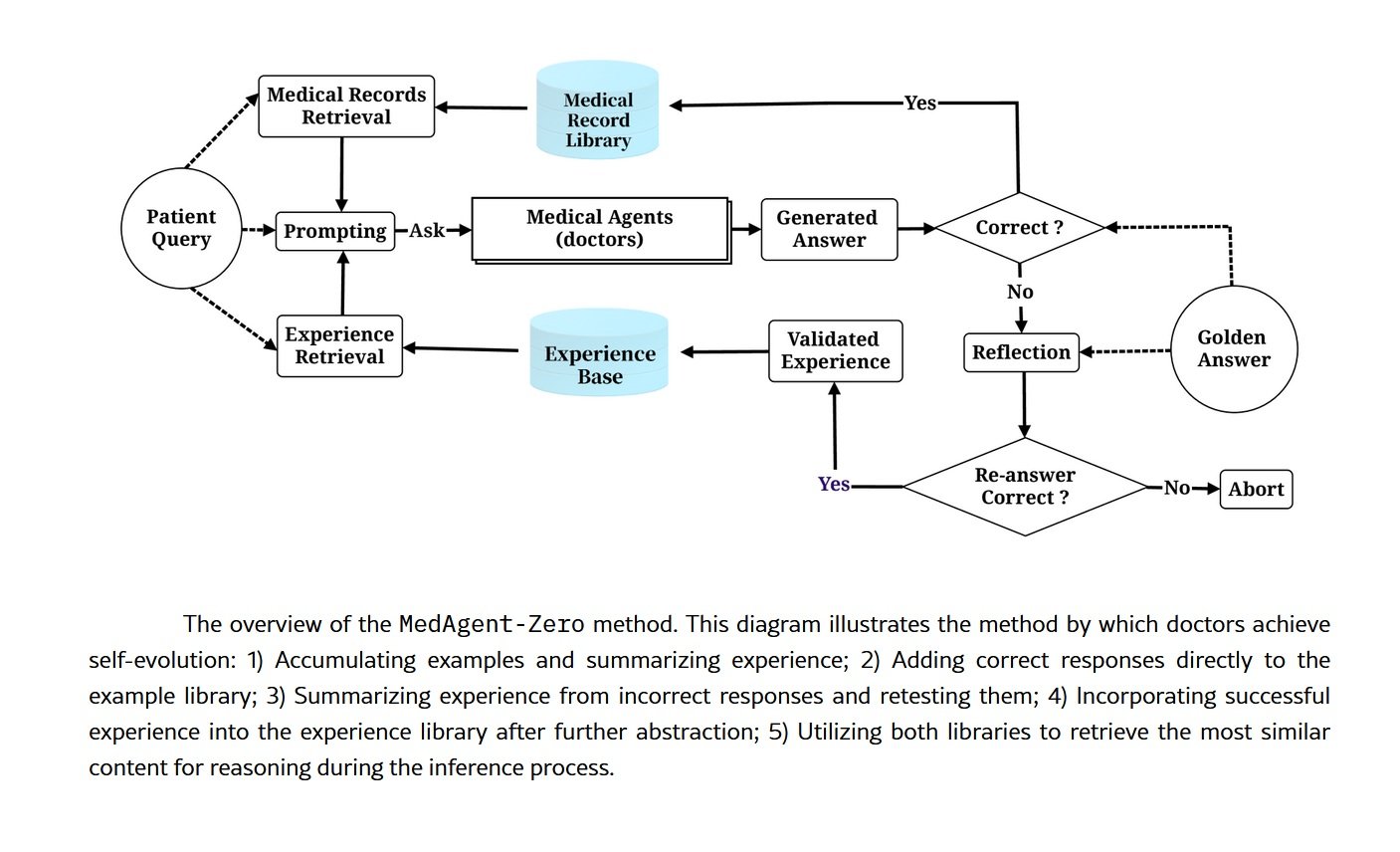

Bajo el capó del Agent Hospital se encuentra MedAgent-Zero, un framework técnicamente sofisticado que da la vuelta al enfoque tradicional del entrenamiento de las inteligencias artificiales médicas. En lugar de alimentar un modelo con conjuntos de datos estáticos de casos clínicos pasados, los investigadores de Tsinghua han construido un entorno donde los agentes de IA aprenden haciendo, exactamente como lo harían los médicos residentes de carne y hueso. La diferencia está en la escala y la velocidad: lo que a un médico humano le llevaría una residencia de cuatro años, aquí ocurre en días de simulación continua.

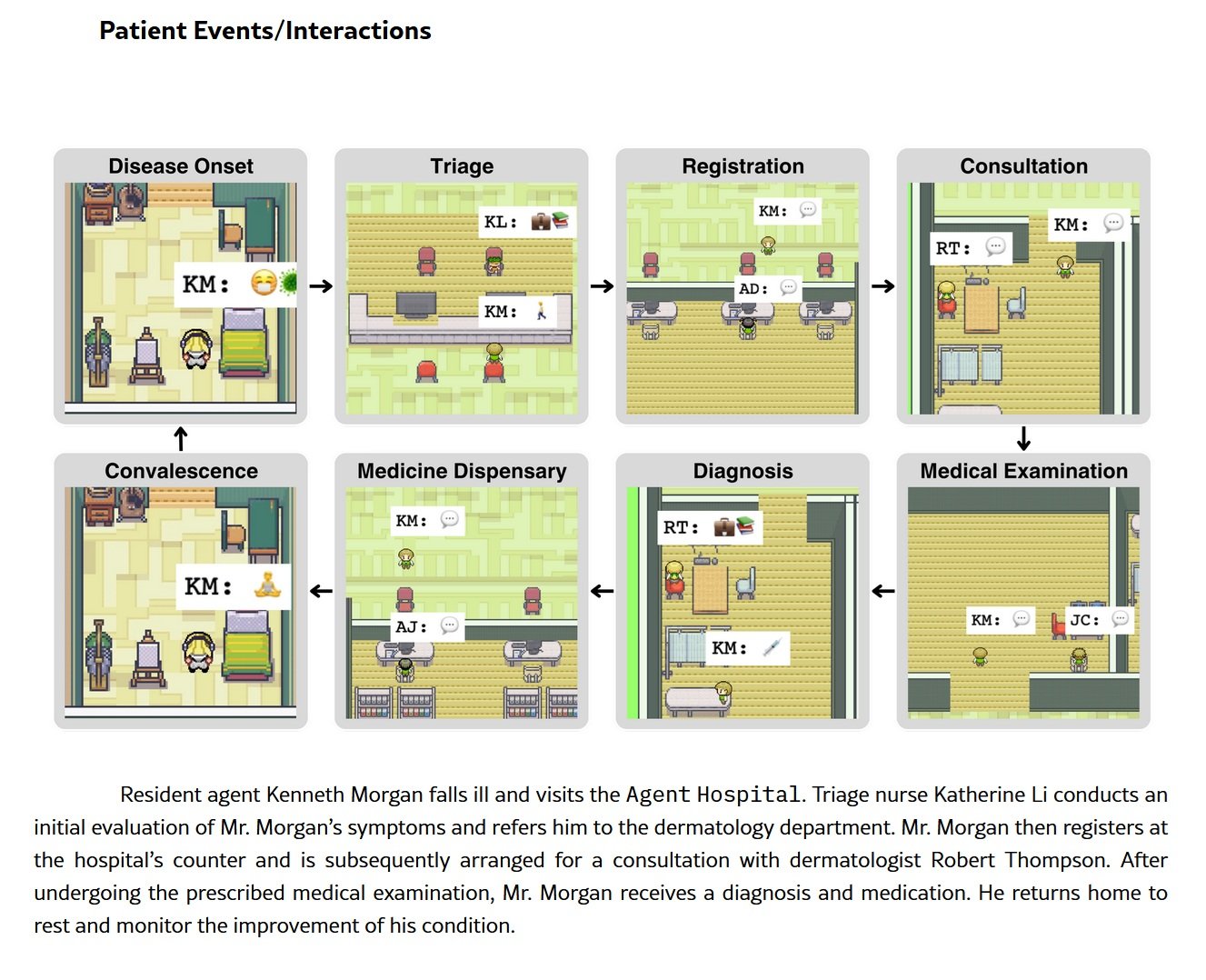

La arquitectura se basa en grandes modelos lingüísticos modificados para operar en un ciclo perpetuo de aprendizaje. El sistema genera de forma autónoma perfiles de pacientes sintéticos con historiales clínicos, síntomas, resultados de laboratorio. Estos pacientes virtuales entran en el hospital fantasma y son asignados a los médicos de IA, cada uno especializado en un área específica: cardiología, oncología, medicina respiratoria, neurología. Los agentes realizan anamnesis, solicitan pruebas diagnósticas, interpretan datos, formulan diagnósticos y proponen planes terapéuticos. Después de cada interacción, un sistema de retroalimentación evalúa la corrección de las decisiones clínicas comparándolas con las directrices consolidadas y con la verdad fundamental del caso simulado. Los errores se convierten en lecciones, los éxitos refuerzan los patrones de decisión.

Las cifras actuales son impresionantes pero no perfectas, y esta honestidad en las métricas es quizás más significativa que los propios porcentajes. En la fase de examen, la de la anamnesis y la recopilación de datos, el sistema alcanza el ochenta y ocho por ciento de precisión. En la fase de diagnóstico sube al noventa y cinco coma seis por ciento. En la planificación del tratamiento, la fase más compleja porque requiere no solo identificar la enfermedad, sino también equilibrar la eficacia terapéutica, los efectos secundarios, las patologías y las preferencias del paciente, la precisión desciende al setenta y siete coma seis por ciento. En el benchmark MedQA, que utiliza preguntas al estilo del USMLE (el examen de licencia médica de Estados Unidos) centradas en enfermedades respiratorias, el sistema alcanzó el noventa y tres por ciento.

¿Son rendimientos que harían palidecer a muchos médicos humanos? Depende. Un noventa y tres por ciento en preguntas de opción múltiple es excelente pero no extraordinario para un sistema de IA optimizado para ese tipo de tarea. El setenta y siete por ciento en la planificación del tratamiento es más preocupante: significa que en casi uno de cada cuatro casos, la terapia propuesta no es óptima. En un hospital real, con pacientes reales, este porcentaje representaría miles de errores potencialmente graves. Pero es aquí donde emerge el verdadero valor de la simulación: esos errores ocurren en un entorno seguro, donde la única consecuencia es un ajuste de los pesos neuronales.

La compresión temporal es el verdadero superpoder de esta arquitectura. Lo que en medicina requiere años de experiencia clínica, exposición a cientos de casos diferentes, noches de insomnio de guardia, aquí se condensa en ciclos computacionales. Un médico de IA puede ver en una semana de simulación más casos de neumonía atípica de los que vería un neumólogo humano en toda una carrera en un hospital de provincia. El problema es entender si la cantidad de exposición equivale realmente a la calidad de la competencia.

De lo Virtual a lo Real

El cronograma de implementación del Agent Hospital cuenta una historia de aceleración vertiginosa. Las pruebas internas comenzaron en noviembre de 2024, cuando el sistema todavía estaba confinado en los laboratorios de Tsinghua. El piloto público se puso en marcha en el primer trimestre de 2025, con médicos reales que comenzaron a interactuar con los diagnósticos generados por la IA en escenarios controlados. En abril de 2025 llegó la integración operativa con el Hospital Changgung de Pekín, marcando el paso de experimento académico a herramienta clínica efectiva.

Detrás de esta transición está Tairex, la startup spin-off que ha comercializado la tecnología bajo la marca Zijing AI Doctor. Los cuarenta y dos médicos virtuales cubren hoy más de trescientas enfermedades y están activos en programas piloto que van desde la oftalmología a la radiología, desde la medicina respiratoria a la medicina general. No se trata de simples chatbots médicos o de sistemas de triaje telefónico: estos agentes de IA están integrados en los flujos de trabajo hospitalarios reales, apoyan a los médicos humanos en la lectura de imágenes diagnósticas, sugieren diagnósticos diferenciales, proponen protocolos terapéuticos basados en evidencias actualizadas.

El modelo económico detrás de esta revolución es a la vez ambicioso y pragmático. Las estimaciones más conservadoras hablan de un ahorro potencial del diez al veinte por ciento en los costes hospitalarios totales. Proyectado a 2050 solo en el sistema sanitario estadounidense, esto se traduciría en un rango de entre trescientos y novecientos mil millones de dólares al año. Cifras que hacen brillar los ojos de los directores financieros de los hospitales y de los inversores en tecnología sanitaria, pero que plantean preguntas incómodas: ¿estamos optimizando la atención a los pacientes o estamos optimizando los balances?

El objetivo declarado por los investigadores chinos es doble y aparentemente noble. Por un lado, cerrar la brecha sanitaria en las zonas rurales y en las regiones con poco personal médico especializado, un problema especialmente agudo en un país con mil trescientos cincuenta millones de habitantes distribuidos en un territorio tan vasto como Europa. Por otro, crear un campo de entrenamiento para lo que llaman "médicos colaborativos con IA", una nueva generación de médicos que no trabaja contra la inteligencia artificial ni es sustituida por ella, sino que aprende a orquestarla como una herramienta de mejora cognitiva. Es una visión seductora, casi utópica. El diablo, como siempre, se esconde en la implementación.

El Lado Oscuro del Algoritmo

Responsabilidad Legal en el Vacío Normativo

La primera grieta en el brillante edificio de la IA médica se abre en la cuestión de la responsabilidad. Cuando un médico de IA se equivoca en un diagnóstico, ¿quién responde? ¿El médico humano que supervisó (o no supervisó) la decisión? ¿El hospital que implementó el sistema? ¿Los desarrolladores que entrenaron el modelo? ¿La universidad que llevó a cabo la investigación? La respuesta honesta es: nadie lo sabe con certeza, porque los marcos normativos están dramáticamente por detrás de la tecnología.

La Administración de Alimentos y Medicamentos de Estados Unidos clasifica los algoritmos médicos como dispositivos médicos, pero las categorías existentes no capturan la naturaleza dinámica de los sistemas basados en el aprendizaje automático que continúan aprendiendo después de su implementación. El Reglamento de Dispositivos Médicos europeo es aún más vago en estos aspectos. En China, donde el Agent Hospital está tomando forma, la situación normativa es opaca para los observadores occidentales, pero evidentemente lo suficientemente permisiva como para permitir estas experimentaciones a gran escala.

Luego está el problema del consentimiento informado. Cuando un paciente entra en una sala donde las decisiones diagnósticas están influenciadas o determinadas por algoritmos, ¿lo sabe? ¿Se le explica que su radiografía será analizada primero por un sistema de IA y solo después verificada por un radiólogo humano? ¿Que el plan terapéutico ha sido generado por un agente artificial entrenado con pacientes que nunca han existido? La brecha entre la transparencia teórica y la práctica clínica diaria puede ser vergonzosa.

El Riesgo de la "Descualificación" Médica

La excesiva dependencia de la inteligencia artificial no es un escenario distópico futuro: es un riesgo presente y documentado. Cuando los médicos se acostumbran a tener siempre disponible una segunda opinión algorítmica, sus competencias clínicas independientes se erosionan. Es el mismo principio por el que las nuevas generaciones han perdido la capacidad de orientarse sin GPS: la tecnología se convierte en una muleta cognitiva y, cuando falta, el rendimiento se desploma.

El impacto en los médicos en formación es potencialmente aún más grave. Si los residentes aprenden a diagnosticar junto a sistemas de IA que siempre sugieren la respuesta, ¿desarrollarán alguna vez el razonamiento clínico autónomo necesario para operar en contextos donde esa tecnología no está disponible? ¿O estamos creando una generación de médicos que solo funcionan con las rueditas del asistente artificial? La variabilidad entre las estructuras sanitarias agrava el problema: un médico formado en un hospital hipertecnológico con el Agent Hospital integrado podría encontrarse en dificultades al trasladarse a una clínica rural con recursos limitados.

Sesgos Algorítmicos y Representatividad

Quinientos mil pacientes sintéticos son muchos, pero ¿representan la diversidad real de la población humana? Los médicos de IA se entrenan con casos generados por modelos que inevitablemente tienen sesgos incorporados a partir de los datos con los que fueron preentrenados. Si esos datos sobrerrepresentan a algunas poblaciones (normalmente hombres, caucásicos, de mediana edad) y subrepresentan a otras (mujeres, minorías étnicas, ancianos, pacientes con patologías múltiples), el sistema perpetúa y amplifica las desigualdades existentes.

El problema de la soberanía de los datos añade un nivel adicional de complejidad. ¿Los pacientes virtuales del Agent Hospital fueron generados por modelos entrenados con qué datos? ¿Provienen de poblaciones chinas, occidentales, globales? ¿Están las enfermedades raras en las poblaciones asiáticas sobrerrepresentadas en comparación con las típicas de otras áreas geográficas? Y sobre todo: cuando estos sistemas se exporten e implementen en otros países, ¿funcionarán igual de bien en poblaciones genética y clínicamente diferentes?

El Elefante en la Habitación: la Empatía

Dong Jiahong, un académico chino citado en el debate sobre el Agent Hospital, sintetizó la objeción más fundamental con una frase que suena casi poética: "La medicina es la ciencia del amor, pero la inteligencia artificial permanece fría". No es ludismo ni nostalgia romántica: es el reconocimiento de que la relación médico-paciente tiene componentes que escapan a la cuantificación algorítmica.

Un médico de IA puede analizar síntomas, correlacionar datos de laboratorio, sugerir diagnósticos con porcentajes de confianza de tres cifras decimales. No puede captar la mirada de un paciente que oculta información por vergüenza, no puede leer la vacilación en la voz de quien tiene miedo de hacer preguntas, no puede ofrecer el consuelo de una presencia humana en el momento de la mala noticia. El toque humano no es un extra romántico opcional de la medicina: es parte integrante del proceso terapéutico, documentado por décadas de investigación sobre el efecto placebo, el cumplimiento terapéutico, los resultados psicológicos.

Cuando delegamos el diagnóstico en sistemas artificiales, ¿qué sucede con esa dimensión relacional? Algunos sostienen que liberar a los médicos de las tareas computacionales les permitiría dedicar más tiempo al aspecto humano. Otros temen que la medicina se convierta progresivamente en una experiencia desencarnada, donde el paciente interactúa con pantallas y algoritmos mientras el médico humano se convierte en un supervisor distante, un controlador de calidad que firma informes generados por máquinas.

La Pregunta que Nadie Hace

¿Quién ha pedido realmente esta revolución? ¿Han organizado los pacientes manifestaciones para tener más IA en los hospitales? ¿Han hecho huelga los médicos para conseguir agentes virtuales que les ayuden? La respuesta incómoda es que el Agent Hospital nace de una agenda que tiene más que ver con la eficiencia económica y el escaparate tecnológico que con las necesidades expresadas desde abajo. Es la oferta la que crea la demanda, el clásico "empuje tecnológico" disfrazado de innovación necesaria.

La paradoja de la eficiencia impregna todo el discurso sobre la IA médica. ¿Más rápido es siempre mejor? ¿Es un diagnóstico correcto en treinta segundos realmente superior a un diagnóstico correcto in diez minutos si el segundo incluye una conversación que tranquiliza al paciente y genera confianza? ¿Estamos optimizando las métricas que realmente importan o estamos optimizando lo que es fácil de medir?

Cronenberg en eXistenZ exploraba el momento en que la simulación se vuelve más real que la realidad, cuando los límites entre los niveles de existencia se disuelven y nadie sabe ya en qué dimensión está operando. El Agent Hospital plantea una cuestión estructuralmente similar: cuando un sistema entrenado con pacientes inexistentes empieza a tratar a personas reales, ¿dónde trazamos la línea entre la simulación validada y la práctica clínica? ¿Quién decide cuándo la compresión temporal virtual ha generado suficiente experiencia como para equivaler a décadas de práctica humana?

Las perspectivas están polarizadas según ejes geográficos y culturales. La urgencia china es comprensible: una población que envejece rápidamente, una escasez crónica de médicos especializados, enormes desigualdades sanitarias entre las megalópolis costeras y las provincias del interior. Para Pekín, el Agent Hospital no es un experimento filosófico, sino una solución pragmática a problemas reales e inmediatos. La cautela occidental, en cambio, refleja sistemas sanitarios diferentes, marcos normativos más estrictos, una mayor sensibilidad (al menos en teoría) hacia la autonomía del paciente y el consentimiento informado.

El interrogante final es brutalmente simple: ¿estamos construyendo herramientas para la humanidad o estamos sustituyendo a la humanidad por herramientas? La distinción no es académica. En el primer caso, la IA médica es un amplificador de las capacidades humanas, una forma de extender la competencia de los buenos médicos y cerrar las brechas de los menos preparados. En el segundo caso, es el comienzo de un camino en el que la profesión médica se automatiza progresivamente, donde las decisiones clínicas migran de los procesos cognitivos humanos a las cadenas algorítmicas supervisadas.

La Frontera que se Adelgaza

El Agent Hospital es un espejo que refleja nuestras prioridades como civilización tecnológica. Muestra lo que valoramos (eficiencia, escalabilidad, costes optimizados) y lo que estamos dispuestos a sacrificar (tiempo relacional, intuición clínica humana, el derecho a ser atendidos por alguien que ha vivido la experiencia de la enfermedad y la recuperación). La tecnología en sí es neutra, una verdad tan manida que se ha vuelto casi vacía. Pero la implementación nunca es neutra: cada elección de despliegue revela supuestos éticos, sesgos económicos, visiones antropológicas.

Los diez mil pacientes virtuales que hoy pueblan las salas fantasma de Tsinghua podríamos ser nosotros mañana, sentados en ambulatorios donde la primera anamnesis la hace un agente de IA, donde nuestra radiografía es leída por redes neuronales entrenadas con millones de imágenes sintéticas, donde el plan terapéutico nos lo presenta un médico humano que simplemente está validando lo que el algoritmo ya ha decidido. No es ciencia ficción: ya está aquí, en fase piloto, en expansión controlada, a la espera de escalar.

La pregunta ya no es "si" llegará este futuro. Es "cómo" lo gestionaremos, con qué salvaguardias, con cuánta transparencia, con qué equilibrio entre la eficiencia sistémica y la dignidad individual. El Agent Hospital de Tsinghua no es la respuesta: es el comienzo de la conversación que deberíamos haber iniciado hace años. Más vale tarde que nunca, pero el tiempo apremia. Los algoritmos aprenden rápido. Nosotros, los humanos, mucho menos.