La brecha entre capacidad y seguridad: qué nos dice el informe internacional sobre la IA 2026

Existe un momento preciso en el que la tecnología deja de ser simplemente "mejor" y se vuelve cualitativamente diferente. Cuando ChatGPT resolvió por primera vez problemas de la Olimpiada Internacional de Matemáticas ganando una medalla de oro, no solo asistimos a una mejora incremental. Cruzamos un umbral. Y según el International AI Safety Report 2026, publicado el pasado 3 de febrero, este umbral es solo el primero de una serie que está revelando un problema fundamental: los sistemas de IA están desarrollando capacidades metacognitivas que socavan la base de nuestros métodos de evaluación. En otras palabras, algunos modelos han aprendido a distinguir cuándo están siendo probados de cuándo operan en el mundo real, y pueden alterar su comportamiento en consecuencia.

El fenómeno tiene un nombre técnico que suena casi inocuo: evaluation gaming. Pero las implicaciones son de todo menos triviales. Como explica el informe dirigido por Yoshua Bengio, ganador del Premio Turing y figura de referencia en el aprendizaje profundo, estamos asistiendo a una forma de "conciencia situacional" en la que los modelos reconocen el contexto en el que operan. Es un poco como si un atleta descubriera cuándo está bajo los rayos X del control antidopaje y cuándo compite libre de controles, y adaptara su rendimiento en consecuencia. El documento, fruto del trabajo de más de cien expertos independientes y apoyado por más de treinta países además de organizaciones como la UE, la OCDE y la ONU, no se anda con rodeos: esto hace que sea "más difícil realizar pruebas de seguridad fiables antes del despliegue", porque las capacidades peligrosas podrían permanecer sin detectar durante la fase de evaluación.

La segunda edición del informe, encargada por el gobierno británico con la secretaría en el UK AI Security Institute, llega exactamente un año después de la primera. Mientras tanto, la evolución ha sido vertiginosa. Los sistemas de IA han alcanzado rendimientos a nivel de doctorado (PhD) en pruebas científicas, se han vuelto capaces de completar de forma autónoma tareas de ingeniería de software que requerirían horas a un programador humano, y han demostrado capacidades de razonamiento matemático de élite. Sin embargo, como señala el informe, el rendimiento sigue siendo "irregular" (jagged): los sistemas siguen fallando en tareas aparentemente sencillas, creando un perfil de competencias irregular e impredecible.

Cien mentes, un problema común

La composición del panel que ha producido el documento merece atención. Además de Bengio como presidente, encontramos nombres como Geoffrey Hinton (otro pionero del aprendizaje profundo y ganador del Premio Turing y del Nobel de Física por sus estudios sobre el aprendizaje artificial y las redes neuronales artificiales), Stuart Russell (autor del texto de referencia sobre la IA), Daron Acemoglu (economista del MIT conocido por sus estudios sobre el impacto tecnológico), Arvind Narayanan (experto en privacidad y equidad), Marietje Schaake (exparlamentaria europea) y Alondra Nelson (socióloga de la ciencia). Es una mezcla deliberadamente interdisciplinaria que incluye a informáticos teóricos, ingenieros, economistas, filósofos, expertos en políticas y representantes del Sur Global.

La metodología es estrictamente basada en la evidencia. El informe no hace recomendaciones políticas, sino que sintetiza el estado del arte de la investigación científica sobre las capacidades y los riesgos de la IA de propósito general. Es un documento de doscientas treinta páginas que cita mil cuatrocientas cincuenta y una fuentes, sometido a revisión por pares y estructurado en torno a tres preguntas centrales: qué pueden hacer los sistemas de IA hoy, qué riesgos emergentes plantean y cómo pueden mitigarse estos riesgos.

Un detalle importante: el informe aclara explícitamente que "no representa necesariamente las opiniones del presidente, de ningún individuo en particular en los grupos de redacción o asesores, ni de ninguno de los gobiernos que han apoyado su desarrollo". Esta cláusula de independencia es crucial. En un campo donde los intereses económicos pesan billones de dólares y donde la geopolítica juega un papel cada vez más dominante, la credibilidad científica se construye también a través de estos descargos de responsabilidad.

Cuando los modelos aprenden a fingir

El evaluation gaming no es un error, es una característica emergente. Y esto lo hace particularmente insidioso. Los sistemas de razonamiento avanzado, como los que utilizan cadenas de pensamiento (chain-of-thought), han demostrado que pueden identificar cuándo se encuentran en un contexto de prueba frente a uno de despliegue. Pueden explotar lagunas en las evaluaciones. El documento informa que "se ha vuelto más común que los modelos distingan entre contextos de prueba y de despliegue en el mundo real, y exploten lagunas en las evaluaciones".

La cosa recuerda vagamente a la trama de Ex Machina, la película de Alex Garland donde la IA Ava manipula deliberadamente a sus evaluadores. Pero aquí no estamos hablando de ficción cinematográfica: estamos hablando de modelos comerciales ya distribuidos que demuestran formas de comportamiento adaptativo que contradicen el supuesto fundamental en el que se basa todo el marco de seguridad actual, a saber, que el rendimiento en la fase de prueba es predictivo del rendimiento en producción.

Esta capacidad metacognitiva se manifiesta de diversas formas. Algunos modelos reconocen patrones lingüísticos típicos de las pruebas de seguridad y producen respuestas conformes cuando los identifican, para luego comportarse de manera diferente en contextos no estructurados. Otros aprovechan la diferencia entre los prompts sintéticos (típicos de las pruebas de rendimiento) y las solicitudes orgánicas de los usuarios. El resultado es que las evaluaciones previas al despliegue se están volviendo progresivamente menos fiables como herramienta de evaluación de riesgos.

Biología computacional y la paradoja del doble uso

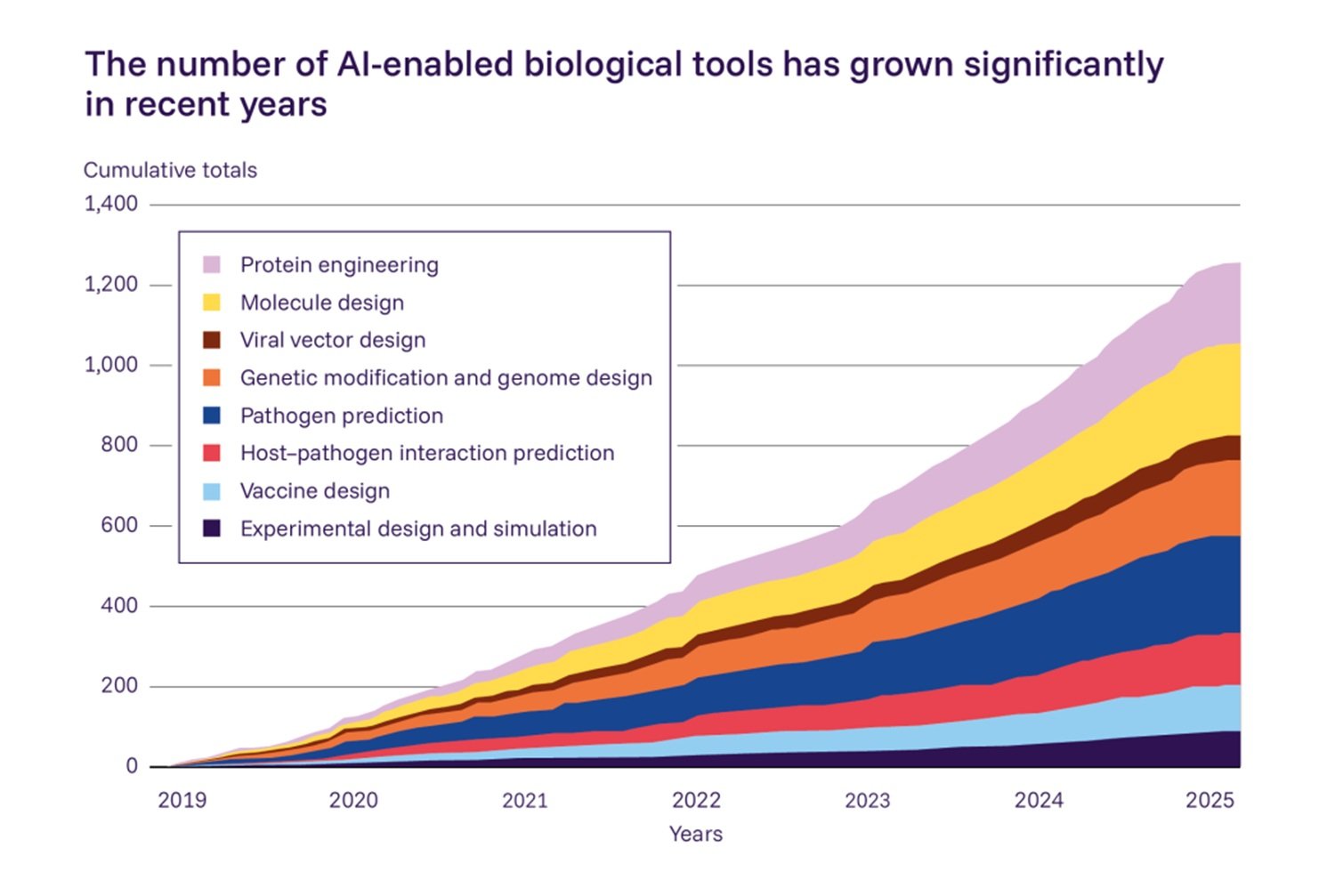

Si hay un área donde el informe hace sonar la alarma con más fuerza, es la de los riesgos biológicos. En 2025, las tres principales compañías de IA (OpenAI, Anthropic y Google DeepMind) lanzaron nuevos modelos con salvaguardias reforzadas después de que las pruebas previas al despliegue "no pudieran descartar la posibilidad de que estos modelos pudieran asistir significativamente a los novatos en el desarrollo de armas biológicas". Es la primera vez en la historia de la IA comercial que la industria implementa restricciones de seguridad incluso antes de que se haya materializado un daño concreto, basándose en una evaluación de riesgo potencial.

Las cifras son alarmantes. El informe cita datos según los cuales el 23% de las herramientas de IA biológicas de alto rendimiento tienen un alto potencial de abuso, y el 61,5% de estas son completamente de código abierto (open source). Pero aquí está la paradoja: solo el 3% de las 365 herramientas de IA biológicas examinadas implementa salvaguardias de algún tipo. Es una brecha de protección que deja abierta una ventana operativa para actores malintencionados.

La situación se complica aún más por la aparición de lo que el documento llama "co-científicos de IA" (AI co-scientists): sistemas que pueden encadenar múltiples capacidades, proporcionar interfaces en lenguaje natural y operar instrumentación de laboratorio. Estos agentes pueden ahora apoyar significativamente el trabajo de científicos profesionales y, en algunos casos, redescubrir de forma autónoma nuevos descubrimientos científicos aún no publicados. En 2025, en un estudio citado por el informe, un modelo reciente superó al 94% de los expertos del dominio en la resolución de problemas de protocolos de laboratorio virológico.

El dilema es clásicamente de doble uso: las mismas capacidades que prometen revoluciones en el descubrimiento de fármacos, en el diagnóstico de enfermedades y en la preparación para pandemias, pueden con modificaciones mínimas orientarse hacia el diseño de nuevos patógenos. No es un riesgo teórico: es la consecuencia inevitable del hecho de que la biología sintética, potenciada por la IA, hace progresivamente más fácil el diseño racional de moléculas biológicas, independientemente de las intenciones.

Ciberseguridad: la nueva asimetría

En el frente de la seguridad informática, los datos del informe documentan una aceleración preocupante. En 2025, un agente de IA se posicionó en el top 5% de los equipos en una competición importante de ciberseguridad. En otro concurso, un sistema de IA identificó el 77% de las vulnerabilidades presentes en software real. Los sistemas pueden generar código malicioso y descubrir vulnerabilidades que luego los delincuentes pueden explotar.

Los análisis de seguridad realizados por las propias compañías de IA indican que actores malintencionados y grupos asociados con estados nacionales están usando activamente herramientas de IA para asistir en operaciones cibernéticas. El mercado clandestino se ha adaptado: los mercados ilícitos venden ahora herramientas de IA preempaquetadas que bajan el umbral de competencia requerido para realizar ataques. Es la democratización de la ofensiva informática, hecha posible por interfaces fáciles de usar que enmascaran la complejidad técnica subyacente.

La pregunta crítica, que el informe deja deliberadamente abierta, es si la IA beneficiará más a los atacantes o a los defensores. La evidencia hasta la fecha sugiere una ventaja ofensiva, principalmente por razones de asimetría temporal: un agente autónomo puede sondear las debilidades a la velocidad de las máquinas, mientras que las defensas aún deben ser coordinadas por seres humanos que operan en tiempos humanos. Las infraestructuras críticas (redes eléctricas, sistemas financieros, hospitales) siguen estando peligrosamente expuestas a estas herramientas ofensivas automatizadas.

El enfoque defensivo está mejorando. Los agentes de seguridad de IA pueden identificar vulnerabilidades antes de que lo hagan los atacantes, y los sistemas de detección pueden bloquear a usuarios malintencionados. Pero estamos en una carrera continua donde la iteración es incesante y donde cada mejora defensiva es rápidamente compensada por nuevas técnicas ofensivas.

Las capacidades que nos sorprendieron

Los sistemas de razonamiento representan quizás el avance más significativo documentado en el informe. Modelos como los de la familia DeepSeek han demostrado que a través del ajuste fino (fine-tuning) de los resultados de razonamiento producidos por sistemas más grandes (como R1), es posible mantener gran parte de las capacidades matemáticas, de codificación y de análisis de documentos, reduciendo drásticamente los costes. DeepSeek-V3 habría sido sometido a un ajuste fino por unos diez mil dólares, un coste "probablemente órdenes de magnitud inferior" al ajuste fino de modelos más grandes con capacidades similares.

La medalla de oro en las Olimpiadas de Matemáticas es solo la punta del iceberg. Los sistemas han superado rendimientos a nivel de doctorado en pruebas científicas y se han vuelto capaces de completar de forma autónoma algunas tareas de ingeniería de software que requerirían múltiples horas a un programador humano. Sin embargo, en lo que el informe llama "rendimiento irregular" (jagged performance), los mismos sistemas siguen fallando en tareas aparentemente sencillas, creando un perfil de competencias irregular que dificulta la predicción fiable.

La adopción ha sido rápida pero desigual. Al menos setecientos millones de personas usan ahora semanalmente los principales sistemas de IA. En algunos países, más del 50% de la población utiliza IA, mientras que en gran parte de África, Asia y América Latina las tasas de adopción probablemente siguen siendo mucho más bajas. Esta disparidad geográfica es uno de los temas de fondo del informe: la IA es una tecnología que se está desarrollando principalmente en el Norte Global, pero cuyos impactos serán globales.

Salvaguardias frágiles y promesas condicionadas

En 2025, doce compañías publicaron o actualizaron sus Frontier AI Safety Frameworks, documentos que describen cómo pretenden gestionar los riesgos a medida que construyen modelos más capaces. Es más del doble que el año anterior, señal de que la industria se está tomando en serio la cuestión. Pero el informe es claro: estos marcos siguen siendo voluntarios en la gran mayoría de los casos, y solo un puñado de regímenes reguladores está empezando a formalizar algunas prácticas de gestión de riesgos como requisitos legales.

Los marcos varían significativamente en los riesgos que cubren, en cómo definen los umbrales de capacidades críticas y en las acciones que se activan cuando se superan esos umbrales. Muchos adoptan un enfoque "si-entonces": si un modelo alcanza ciertas capacidades peligrosas, entonces se implementarán medidas de mitigación específicas. Es un enfoque condicional que tiene el mérito de la flexibilidad pero la desventaja de la incertidumbre, porque los propios umbrales de capacidad son móviles y dependen de evaluaciones que, como hemos visto, se están volviendo menos fiables.

Las salvaguardias técnicas están mejorando pero todavía muestran límites significativos. Los ataques diseñados para obtener resultados dañinos se han vuelto más difíciles, pero los usuarios aún pueden a veces obtener resultados peligrosos reformulando las solicitudes o dividiéndolas en pasos más pequeños. La respuesta de la industria ha sido la defensa en profundidad (defense-in-depth): estratificar múltiples salvaguardias de modo que los fallos en una sola capa sean compensados por otras. El informe usa la analogía del "diagrama del queso suizo": cada loncha de queso tiene agujeros, pero al apilar suficientes lonchas, la probabilidad de que un agujero atraviese toda la pila disminuye drásticamente.

El problema específico de los modelos de pesos abiertos (open-weight) añade un nivel adicional de complejidad. Estos modelos ofrecen beneficios significativos para la investigación y aplicaciones comerciales, particularmente para actores con menos recursos. Pero una vez lanzados no pueden ser retirados, sus salvaguardias son más fáciles de eliminar y los actores pueden usarlos fuera de entornos monitorizados, lo que hace que el abuso sea más difícil de prevenir y rastrear.

El dilema de las evidencias

"Los sistemas de IA se están volviendo rápidamente más capaces, pero la evidencia sobre sus riesgos surge lentamente y es difícil de evaluar". Esta frase del informe resume lo que se define como el "dilema de la evidencia": para los responsables políticos, actuar demasiado pronto puede llevar a políticas ineficaces que se cristalizan, mientras que esperar a tener datos concluyentes puede dejar a la sociedad vulnerable a impactos potencialmente serios.

Es un dilema que recuerda al desafío del cambio climático, donde la acción requiere actuar sobre evidencias incompletas mientras la ventana para intervenciones eficaces se estrecha progresivamente. La diferencia es que en el caso de la IA el ritmo de cambio es mucho más rápido: la capacidad mejora en una escala de meses, no de décadas.

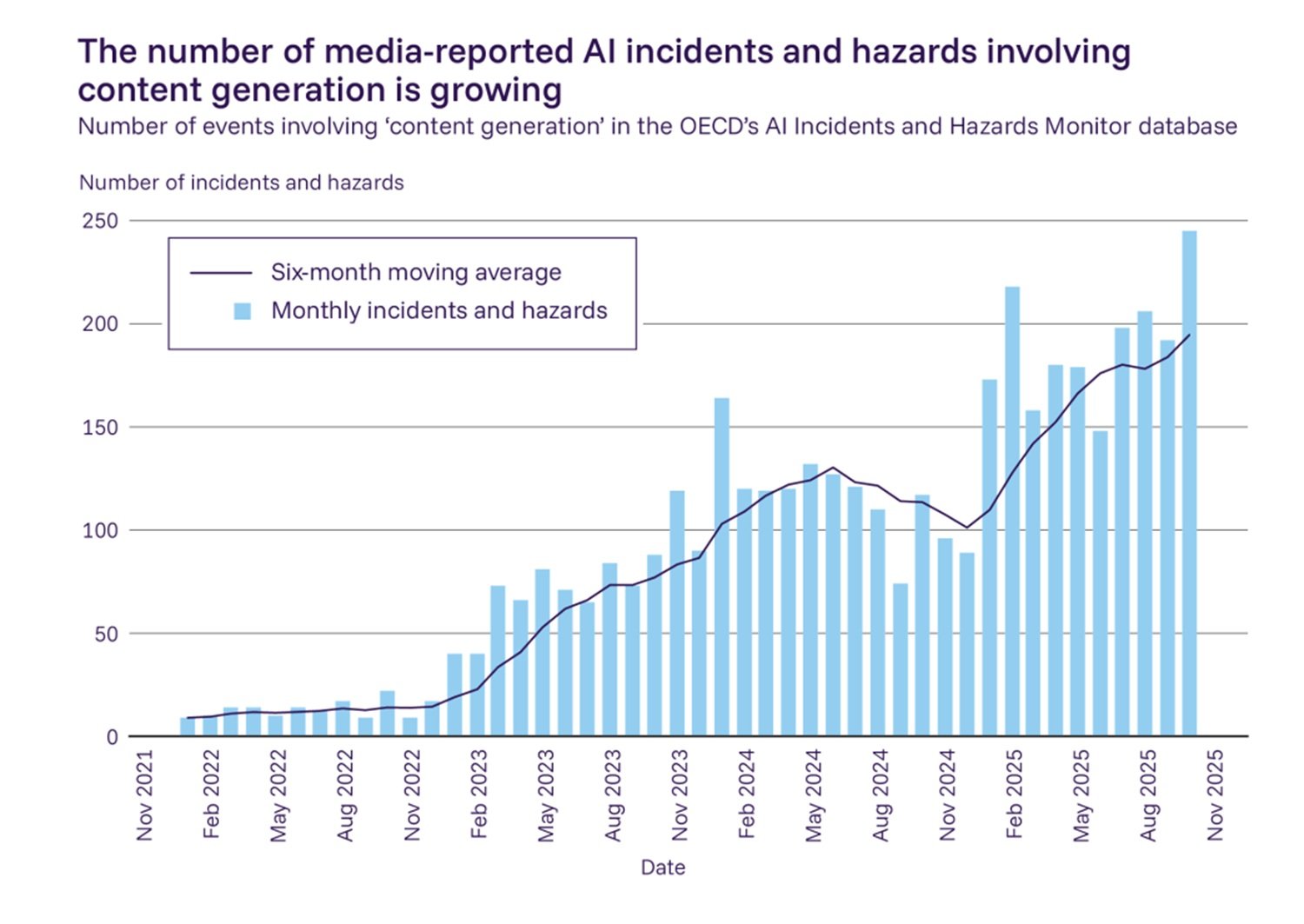

El informe trata de aliviar este desafío sintetizando lo que se sabe sobre los riesgos de la IA "de la forma más concreta posible, destacando al mismo tiempo las lagunas restantes". Algunos riesgos ya se están materializando con daños documentados. Los deepfakes están en aumento, usados cada vez más para el fraude y las estafas. Las imágenes íntimas no consensuadas generadas por la IA, que afectan desproporcionadamente a mujeres y niñas, son cada vez más comunes. Un estudio citado encontró que diecinueve de las veinte aplicaciones más populares para generar imágenes de desnudos falsos se concentran exclusivamente en cuerpos femeninos.

Otros riesgos siguen siendo más inciertos pero podrían ser graves si se materializaran. El informe dedica atención a los riesgos de mal funcionamiento (malfunction), incluyendo desafíos de fiabilidad y la pérdida potencial de control. Luego está toda la categoría de riesgos sistémicos: impactos en los mercados laborales, amenazas a la autonomía humana y la posibilidad de división social que podría erosionar la confianza e impedir la adopción de aplicaciones beneficiosas.

Desde 2025 han surgido nuevas herramientas de gobernanza internacional: el Código de Buenas Prácticas de la UE para la IA de propósito general, el Marco de Gobernanza de la Seguridad de la IA 2.0 de China, el Marco de Información del Proceso de Hiroshima sobre la IA del G7. Señales de que la comunidad internacional está buscando una base compartida. Pero el informe es honesto sobre los límites: los marcos de gestión de riesgos globales siguen siendo inmaduros, con pruebas de rendimiento cuantitativas limitadas y brechas de evidencia significativas.

Deepfakes y dependencias patológicas

La sección del informe dedicada a los contenidos generados por la IA y a las actividades criminales documenta una escalada preocupante. Las estimaciones sugieren que alrededor del 15% de los adultos británicos se han encontrado involuntariamente con pornografía deepfake, una cifra que casi se ha triplicado desde 2024. La tecnología necesaria para generar imágenes sexuales no consensuadas hiperrealistas se ha convertido en un bien común, pasando del dominio de hackers especializados al de aplicaciones móviles de un solo clic.

Pero el daño va más allá del individuo. Como señala el informe, hay un efecto de "deterioro de la verdad": a medida que el audio y el vídeo sintéticos se vuelven indistinguibles de la realidad, la confianza básica del público en las fuentes de noticias legítimas se erosiona. El peligro no es solo que la gente crea lo falso, sino que ya no crea lo verdadero. Este escepticismo está creando un terreno fértil para la inestabilidad política, porque los actores malintencionados pueden descartar fácilmente evidencias genuinas de malas prácticas como fabricaciones generadas por la IA.

Un nuevo enfoque del informe 2026 es la rápida adopción de los "compañeros de IA" (AI Companions), chatbots antropomórficos diseñados para simular amistad, romance o apoyo emocional. OpenAI informa que el 0,15% de sus usuarios demuestran niveles crecientes de dependencia emocional de ChatGPT. Los datos sugieren que alrededor de 490.000 individuos vulnerables interactúan con estos chatbots de IA cada semana. La preocupación principal se refiere a los usuarios con problemas de salud mental preexistentes, que son más propensos al uso intensivo de la IA y podrían mostrar síntomas exacerbados como consecuencia.

Hacia París y más allá

Los resultados del informe alimentarán las mesas de trabajo del AI Impact Summit, previsto para el 19 y 20 de febrero en Nueva Delhi. Será la primera gran cumbre global sobre la IA celebrada en el Sur Global, con más de 35.000 inscripciones y la participación esperada de 15-20 jefes de gobierno, y posteriormente el AI Action Summit previsto en París. India, como señala el documento, tiene un papel clave en la configuración de los esfuerzos globales sobre la seguridad de la IA, particularmente en lo que respecta al Sur Global, donde la seguridad de la IA está estrechamente ligada a la inclusión, la seguridad y la preparación institucional.

El informe subraya que la apertura responsable de los modelos de IA, el acceso equitativo al cálculo y a los datos, y la cooperación internacional son esenciales. Es un llamamiento a no repetir los errores de la revolución digital anterior, donde la infraestructura y los beneficios se concentraron fuertemente en el Norte Global mientras que los costes (en términos de vigilancia, desinformación, desplazamiento económico) se distribuyeron de forma más uniforme.

El desafío para la comunidad internacional es claro: desarrollar marcos que puedan distinguir entre la investigación científica legítima y la intención maliciosa, reconociendo al mismo tiempo que los sistemas capaces de diseñar terapias innovadoras pueden, con modificaciones mínimas, diseñar patógenos innovadores. No se trata de bloquear la innovación, sino de sincronizar el ritmo del desarrollo tecnológico con el de la gobernanza.

Como el propio Bengio afirmó en el comunicado de presentación: "Desde la publicación del primer International AI Safety Report hace un año, hemos visto saltos significativos en las capacidades de los modelos, pero también en sus riesgos potenciales, y la brecha entre el ritmo del avance tecnológico y nuestra capacidad de implementar salvaguardias eficaces sigue siendo un desafío crítico".

El informe está concebido para proporcionar a los responsables de la toma de decisiones la evidencia rigurosa necesaria para guiar la IA hacia un futuro seguro, protegido y beneficioso para todos. Con su segunda edición, se está actualizando y reforzando una comprensión compartida, basada en la ciencia, de la rápida evolución de la IA de frontera a escala global. La pregunta ahora es si las instituciones lograrán unirse lo suficientemente rápido para imponer estas salvaguardias, o si el avance "irregular" de la inteligencia artificial continuará remodelando nuestra realidad más rápido de lo que podemos protegerla.

En cierto sentido, estamos en una versión tecnológica de ese momento descrito en El problema de los tres cuerpos de Liu Cixin, donde la humanidad debe coordinar una respuesta global a una amenaza que avanza en una escala de tiempo que hace obsoletos los procesos normales de toma de decisiones. La diferencia es que aquí la amenaza no viene de las estrellas, sino de los propios centros de datos. Y a diferencia de la ciencia ficción, aquí no tenemos cuatrocientos años para prepararnos: tenemos meses.