Qwen3-Max-Preview: El coloso de 1 billón de parámetros

El 5 de septiembre de 2025 marca una fecha decisiva en la evolución de la inteligencia artificial global. Alibaba ha presentado oficialmente Qwen3-Max-Preview, el primer modelo de la familia Qwen en superar el umbral psicológico del billón de parámetros. Un hito que no es solo numérico, sino que representa la entrada de China en el selecto club de las potencias tecnológicas capaces de competir al más alto nivel en la arena de la IA generativa.

Como Akira despertando del crioestasis en la obra maestra de Otomo, este coloso computacional emerge en un momento en que la industria parecía orientada hacia modelos más compactos y eficientes. La elección de Alibaba de apuntar alto, muy alto, representa una declaración de intenciones que da un vuelco a las expectativas del mercado y reaviva la carrera hacia las dimensiones extremas.

Un billón de razones para asombrarse

Las cifras de Qwen3-Max-Preview son impresionantes incluso para los estándares actuales. Con más de 1 billón de parámetros, el modelo maneja una ventana de contexto de 262.144 tokens, divididos en 258.048 tokens de entrada y 32.768 de salida. Para poner estas cifras en perspectiva, significa poder procesar simultáneamente el equivalente a unas 500 páginas de texto, una capacidad que abre escenarios de aplicación hasta ayer impensables.

La arquitectura también integra funcionalidades de context caching, una solución de ingeniería que acelera significativamente las sesiones de varios turnos al reducir la latencia en conversaciones prolongadas. Es como tener un asistente que no solo recuerda todo lo que le has dicho, sino que lo mantiene siempre a mano sin tener que empezar de cero cada vez.

Binyuan Hui, Científico de Investigación del Equipo Qwen, confirmó que "Qwen-Max ha escalado con éxito a 1T de parámetros y el desarrollo sigue avanzando", dando a entender que esta versión Preview podría ser solo el aperitivo de algo aún más ambicioso.

Cuando Saitama entra en la arena

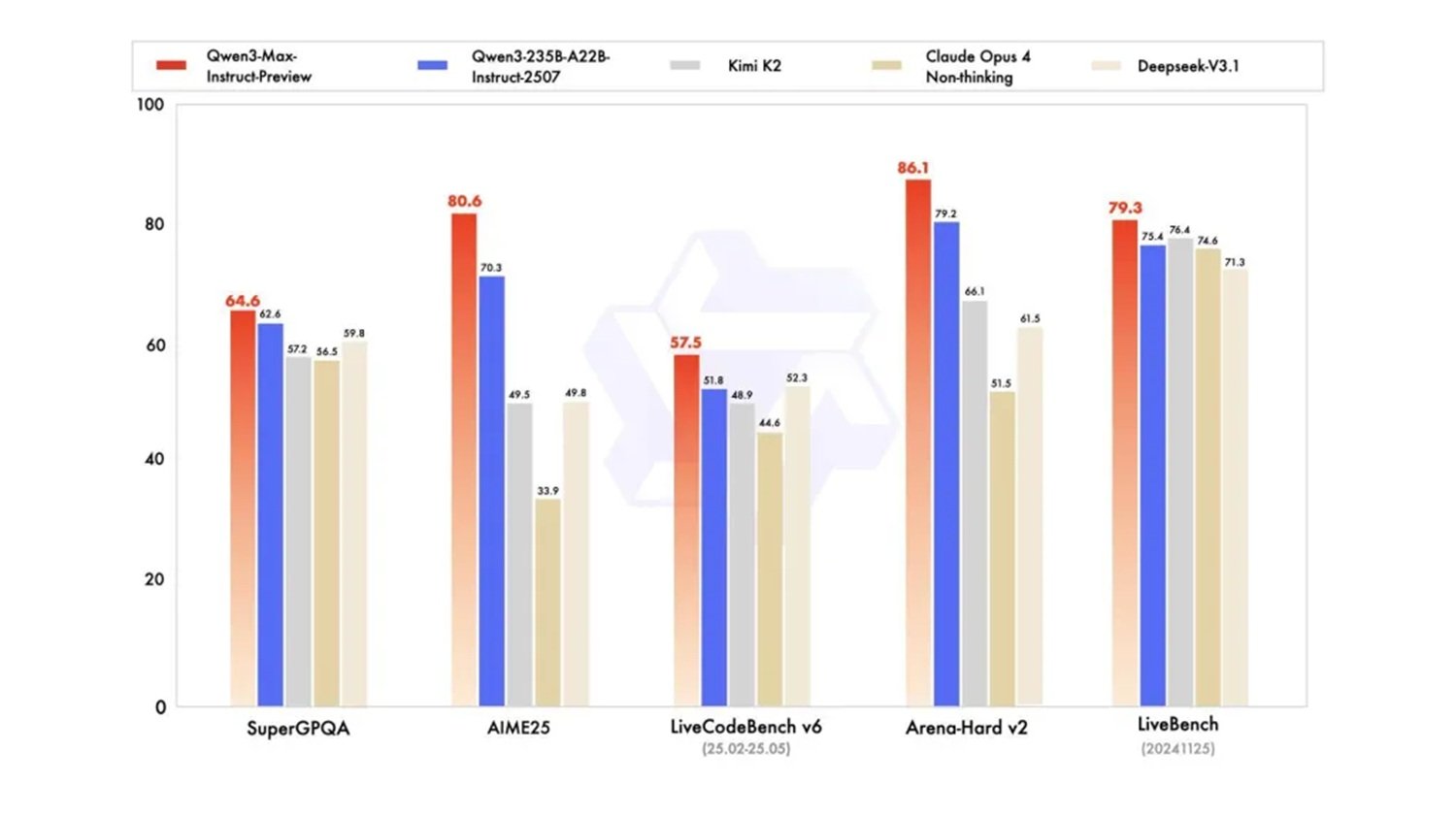

Los benchmarks hablan por sí solos y certifican el rendimiento de este gigante chino. Qwen3-Max-Preview supera al anterior modelo insignia de la compañía, Qwen3-235B-A22B-2507, y compite directamente con los mejores modelos occidentales en pruebas estandarizadas como SuperGPQA, AIME25, LiveCodeBench v6, Arena-Hard v2 y LiveBench.

Particularmente significativa es la comparación con Claude Opus 4, GPT-4 y otros modelos de primer nivel, donde Qwen3-Max-Preview demuestra un rendimiento competitivo, si no superior, en varias categorías. Como Saitama en One Punch Man, este modelo chino ha llegado casi de la nada para competir con los campeones consolidados, aportando una potencia computacional que redefine los equilibrios del sector.

Los primeros probadores informan de velocidades de respuesta sorprendentes, a veces superiores a las de ChatGPT, y de comportamientos de razonamiento emergentes que no habían sido programados específicamente. Ahsen Khaliq de Hugging Face documentó la capacidad creativa del modelo generando un jardín de vóxeles pixelado con un solo prompt, demostrando una versatilidad que va mucho más allá de los benchmarks tradicionales.

La gran traición del código abierto

Pero aquí es donde la historia da un giro inesperado. A diferencia de las versiones anteriores de Qwen, este modelo no estará disponible en versión de código abierto. El acceso se limita exclusivamente a las API de Alibaba Cloud, Qwen Chat, OpenRouter y como herramienta predeterminada en AnyCoder de Hugging Face.

Este giro representa una ruptura paradigmática para Alibaba, que en el pasado había construido su reputación en IA precisamente sobre la filosofía del acceso abierto. Los modelos Qwen anteriores habían desafiado a los laboratorios occidentales precisamente gracias a la disponibilidad inmediata de los pesos del modelo, permitiendo a investigadores y desarrolladores de todo el mundo experimentar y contribuir a la mejora del rendimiento.

La elección del código cerrado plantea profundas interrogantes sobre el futuro de la innovación distribuida en la IA. Si bien es comprensible el deseo de monetizar inversiones tan imponentes, por otro lado, se abre un precedente preocupante para el ecosistema de investigación global. Es como si la Biblioteca de Alejandría decidiera de repente cerrar sus puertas al público, manteniendo el acceso solo para los clientes de pago.

El factor tiempo en la era de la IA

El momento del lanzamiento de Qwen3-Max-Preview no es casual y revela una sofisticada estrategia temporal que merece un análisis en profundidad. Mientras la industria occidental se concentraba en modelos más eficientes y compactos siguiendo la filosofía del "menos es más", Alibaba apostó por una dirección opuesta, invirtiendo masivamente en una escala computacional que hoy se revela ganadora. Es una jugada que recuerda la estrategia de Kamoshida en Persona 5: mientras todos los demás jugadores seguían las reglas convencionales, alguien decidió cambiar por completo las cartas sobre la mesa.

El anuncio de actualizaciones "ya la próxima semana" por parte del equipo de investigación sugiere un ciclo de desarrollo increíblemente acelerado, posible solo gracias a recursos computacionales y humanos a escala industrial. Este ritmo de innovación plantea a los competidores occidentales un desafío inédito: competir no solo en la calidad del modelo individual, sino en la velocidad de iteración y mejora continua.

La integración estratégica con plataformas ya consolidadas como OpenRouter y AnyCoder de Hugging Face demuestra una comprensión madura del ecosistema global de desarrolladores. Alibaba no solo está lanzando un producto, está construyendo un puente hacia la comunidad internacional manteniendo, sin embargo, el control total sobre la tecnología base. Es una estrategia que combina una aparente apertura con un control sustancial, permitiendo la adopción generalizada sin renunciar a las ventajas competitivas del código cerrado.

Rendimiento de superdeportivo, precio de utilitario

El modelo de precios de Qwen3-Max-Preview sigue una estructura de niveles basada en los tokens utilizados. Los costes parten de 0,861 $ por millón de tokens de entrada en el rango de 0-32K, hasta llegar a 2,151 $ por millón en el rango más alto de 128K-252K tokens. Los tokens de salida siguen una progresión similar pero con costes mayores, llegando hasta 8,602 $ por millón en el rango más alto.

Esta estructura de precios revela una sofisticada estrategia comercial: hacer que el modelo sea económicamente accesible para tareas simples y cortas, pero escalar significativamente los costes para usos intensivos de largo contexto. Es una jugada que democratiza el acceso a las capacidades básicas manteniendo márgenes interesantes en los casos de uso empresariales más complejos.

La relación calidad-precio, especialmente en los niveles de uso más bajos, parece competitiva en comparación con los modelos occidentales equivalentes, lo que podría abrir nuevos mercados de desarrolladores y pequeñas empresas que hasta ahora estaban excluidos del ecosistema de la IA de frontera.

Más allá de los benchmarks: la IA que simula la vida

Pero donde Qwen3-Max-Preview muestra su verdadero potencial es en los usos prácticos que van más allá de las pruebas estandarizadas. El modelo demuestra capacidades emergentes en el razonamiento estructurado, la generación de código complejo, la gestión de datos estructurados y en comportamientos agénticos avanzados.

Particularmente interesantes son las demos que muestran simulaciones de poblaciones y sistemas complejos, aplicaciones que requieren no solo potencia computacional sino también una comprensión sofisticada de las dinámicas sistémicas. Es como ver Ghost in the Shell y darse cuenta de que las simulaciones sociales de la película podrían ya no ser ciencia ficción.

La ventana de contexto ampliada permite aplicaciones hasta ahora impensables: análisis de novelas enteras, procesamiento de bases de datos complejas, sesiones de codificación que mantienen el contexto durante miles de líneas de código. Son escenarios de uso que transforman la IA de un asistente puntual a un socio de trabajo persistente.

Hacia los modelos post-billón

Sin embargo, superar el umbral del billón de parámetros nos obliga, en nuestra opinión, a una reflexión crítica: la carrera por la pura fuerza computacional, aunque ha producido resultados extraordinarios, está mostrando su flanco a costes insostenibles en todos los frentes. No solo económicos (el entrenamiento de estos gigantes requiere inversiones de decenas, si no cientos, de millones de dólares), sino sobre todo medioambientales, por el monstruoso consumo de energía, y estratégicos, por la dependencia de chips y recursos cada vez más escasos.

El futuro, como también se aborda en el análisis de nuestro último artículo sobre la técnica "Deep Think with Confidence", no puede ser una nueva escalada dimensional. El verdadero progreso residirá en un enfoque más "inteligente" y menos ávido de recursos: arquitecturas híbridas que combinen modelos fundacionales más pequeños pero especializados, técnicas de razonamiento estructurado para reducir los cálculos superfluos y un enfoque en la eficiencia pura a través de la fusión y destilación de modelos. El verdadero desafío de ingeniería no es entrenar un modelo de 2T de parámetros, sino obtener el mismo (o mejor) rendimiento con una décima parte de los recursos.

El próximo hito no será un número más grande, sino un algoritmo mejor. La próxima versión "sorprendente" del equipo de Qwen podría, al menos eso esperamos, ser precisamente un paso en esta dirección: demostrar que la inteligencia artificial puede evolucionar sin devorar el mundo.

El nuevo equilibrio de fuerzas

La llegada de Qwen3-Max-Preview redibuja el mapa geopolítico de la inteligencia artificial. Por primera vez, un modelo chino compite directamente con los buques insignia estadounidenses no solo en términos de rendimiento, sino también de accesibilidad comercial y velocidad de despliegue.

La elección estratégica de Alibaba de concentrarse en un modelo de un billón de parámetros mientras los competidores occidentales exploraban la eficiencia con parámetros reducidos se revela hoy como una apuesta ganadora. Es la demostración de que en el mundo de la IA, como en el ajedrez de Kaspárov contra Deep Blue, una estrategia a contracorriente puede dar un vuelco completo a las expectativas.

El impacto en el mercado empresarial será probablemente significativo, especialmente en Asia, donde Alibaba Cloud ya tiene una presencia consolidada. La combinación de alto rendimiento, precios competitivos e integración nativa con el ecosistema de la nube china crea una oferta difícil de ignorar para las empresas de la región.

El paso al código cerrado, aunque controvertido, podría señalar una maduración del sector hacia modelos de negocio más sostenibles. Si bien esto limita la innovación de código abierto, por otro lado, garantiza los recursos necesarios para sostener la investigación a largo plazo en escalas computacionales cada vez más imponentes.

Qwen3-Max-Preview no es solo un nuevo modelo de IA: es el manifiesto de una nueva era en la que la supremacía tecnológica ya no es prerrogativa exclusiva de Silicon Valley. El dragón se ha despertado y el mundo de la inteligencia artificial ya no será el mismo.