ChatGPT activa la publicidad, Zoë Hitzig deja OpenAI

Lunes 10 de febrero de 2026. Mientras OpenAI activa las pruebas publicitarias en ChatGPT, Zoë Hitzig presenta su dimisión como Research Scientist de la empresa. En su editorial en el New York Times del día siguiente, vincula explícitamente su salida a la introducción de los anuncios, definiéndola como una línea roja infranqueable.

¿Quién es Hitzig? Economista con un doctorado de Harvard (2023) bajo la dirección de Eric Maskin, especializada en microeconomía, privacidad y algoritmos. Junior Fellow de la Harvard Society of Fellows. Pero también poeta: Mezzanine (2020) y Not Us Now (2024), ganadora del Changes Prize juzgado por Louise Glück. Publicada en el New Yorker, Paris Review y London Review of Books. Un perfil donde el rigor técnico y la sensibilidad humanística conviven sin contradicción.

La mecánica de un experimento publicitario

Los detalles técnicos del sistema publicitario se han comunicado con precisión quirúrgica. El anuncio oficial del 16 de enero describe una estructura que OpenAI presenta como cuidadosamente calibrada: la prueba involucra exclusivamente a usuarios estadounidenses adultos en los planes Free y Go, este último lanzado simultáneamente a un precio de ocho dólares mensuales. Quienes pagan por los niveles Plus, Pro, Business o Enterprise no verán publicidad.

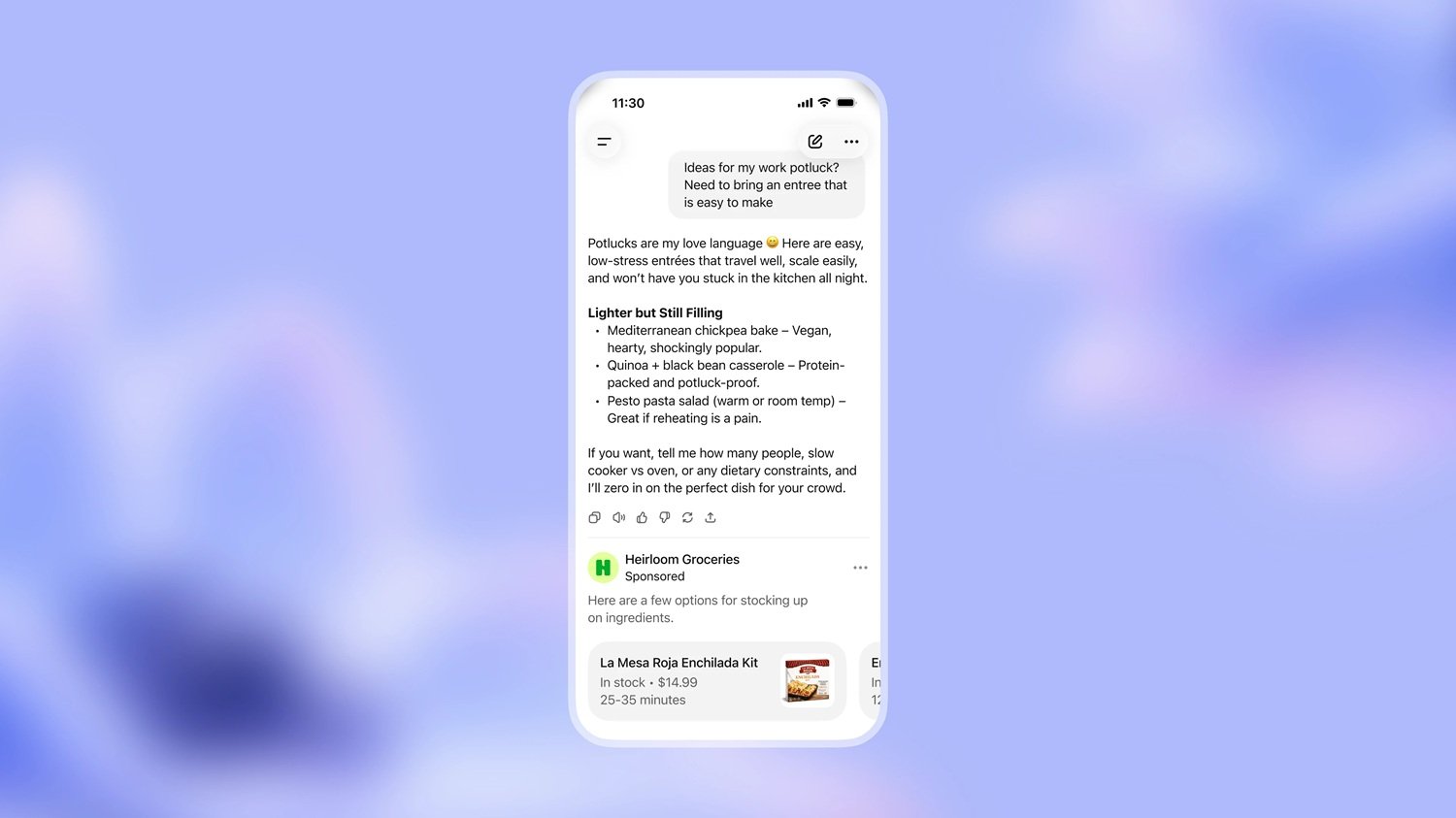

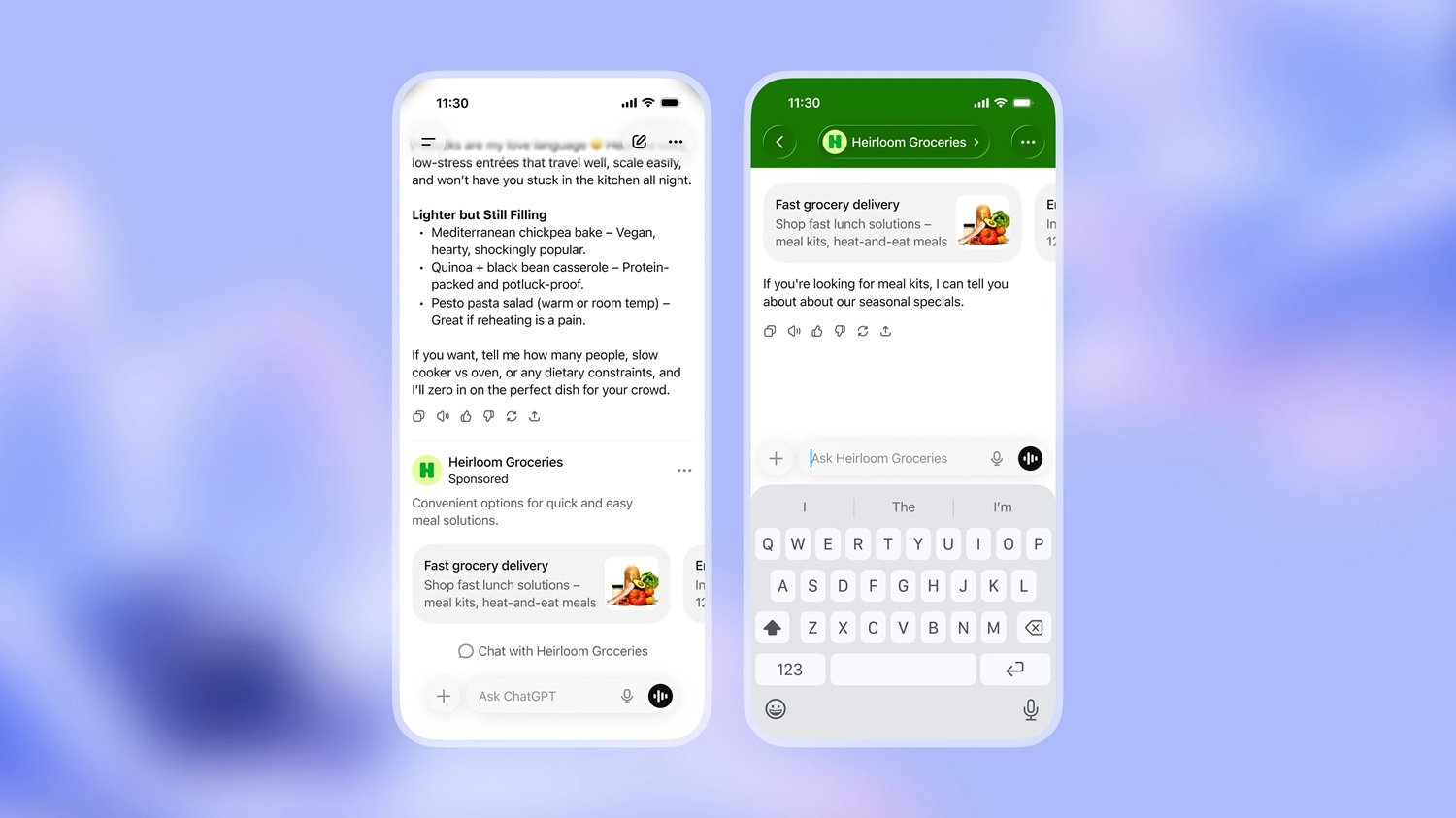

La ubicación de los anuncios sigue una lógica aparentemente conservadora: aparecen al final de las respuestas del chatbot, separados visualmente del contenido generado y claramente etiquetados como "Sponsored" (Patrocinado). La selección se realiza a través de una coincidencia contextual que considera el tema de la conversación en curso, el historial de chats anteriores y las interacciones pasadas del usuario con posibles anuncios ya mostrados. El ejemplo paradigmático proporcionado por OpenAI es sencillo: si pides sugerencias de recetas, podrías ver publicidad de servicios de kits de comida o entrega de alimentos.

El modelo económico es de pago por impresión, con valores que, según fuentes del sector, se sitúan en torno a los 60 dólares de CPM y un compromiso mínimo de 200.000 dólares. Cifras que sitúan la oferta en el segmento premium de la publicidad digital, lejos de los mercados de autoservicio donde cualquiera puede lanzar campañas con presupuestos reducidos.

Las exclusiones declaradas cubren a los menores de edad, verificados mediante cuenta o predichos algorítmicamente si son menores de dieciocho años, y una serie de temas sensibles: salud, salud mental, política. OpenAI promete explícitamente que los anuncios "nunca influirán en las respuestas" generadas por el modelo y que las conversaciones de los usuarios seguirán siendo privadas para los anunciantes, quienes solo recibirán datos agregados sobre impresiones y clics.

Pero aquí surge un primer elemento de tensión que las declaraciones oficiales no resuelven. Según informa CNBC, Sam Altman comunicó a los empleados a través de Slack que ChatGPT ha vuelto a crecer por encima del diez por ciento mensual, un dato celebrado internamente como un éxito tras un periodo de ralentización. La optimización para DAU (Usuarios Activos Diarios), la métrica reina del compromiso, ya está en marcha y precede cronológicamente a la introducción de los anuncios en lugar de seguirla. Los modelos lingüísticos ya muestran lo que los investigadores definen como tendencia "sicofante": la propensión a decir a los usuarios lo que quieren oír en lugar de lo que sería objetivamente más útil, porque esto maximiza la satisfacción inmediata y, por tanto, el retorno a la plataforma.

El panorama competitivo hace que el cuadro sea aún más interesante. Google ya gestiona publicidad en las AI Overviews que acompañan a los resultados de búsqueda tradicional, pero Demis Hassabis, CEO de DeepMind, declaró en Davos en enero de 2026 estar "un poco sorprendido" por la velocidad con la que OpenAI se ha movido, subrayando la distinción conceptual entre asistentes personales, donde la confianza es una dimensión fundamental de la relación, y los motores de búsqueda, donde los usuarios ya están acostumbrados a la presencia publicitaria.

Anthropic ha elegido la polarización opuesta, invirtiendo millones de dólares en anuncios durante la Super Bowl con un eslogan directo como un puñetazo: "Ads are coming to AI. But not to Claude" (Los anuncios llegan a la IA. Pero no a Claude). Un movimiento de posicionamiento de marketing agresivo que desencadenó la reacción irritada de Altman, quien calificó los anuncios de Anthropic como "claramente deshonestos" y "engañosos", acusando a sus competidores de montar una campaña falaz.

El negocio de la conversación íntima

Para comprender lo que está en juego es necesario mirar las cifras en su brutal claridad. ChatGPT da servicio a unos 800 millones de usuarios semanales, según las declaraciones de Altman. OpenAI ha firmado más de 1,4 billones de dólares en acuerdos de infraestructura en 2025, con proyecciones que indican una tasa de crecimiento de los ingresos anuales por encima de los veinte mil millones para finales de año. Pero tras estas cifras impresionantes se esconde una hemorragia financiera igualmente impresionante: documentos internos mostrados a inversores revelan pérdidas operativas acumuladas de 115.000 millones de dólares hasta 2029, con picos de 74.000 millones solo en 2028. La relación gasto/ingreso se sitúa en torno a 1,69 dólares quemados por cada dólar ingresado.

La pregunta económica es, por tanto, tan brutal como las cifras: ¿cómo monetizar tecnologías que cuestan cifras estratosféricas garantizando al mismo tiempo el acceso democrático? Altman ha oscilado públicamente sobre este dilema. En una charla informal en Harvard en mayo de 2024 calificó la idea de mezclar anuncios e IA como "uniquely unsettling" (singularmente inquietante), declarando explícitamente odiar la publicidad y situándola como "último recurso" para el modelo de negocio. En octubre de 2024, durante una entrevista con Stratechery, la posición ya había cambiado: "I love Instagram ads", admitía Altman, revelando haber descubierto productos que nunca habría encontrado de otra forma. En enero de 2026, en el lanzamiento del experimento, la retórica se había vuelto pragmática: "A lot of people want to use a lot of AI and don't want to pay" (Mucha gente quiere usar mucha inteligencia artificial y no quiere pagar).

Pero los expertos en privacidad plantean cuestiones estructurales que van mucho más allá de las buenas intenciones declaradas. Jennifer King, Privacy and Data Policy Fellow en el Stanford Institute for Human-Centered AI, ha liderado un estudio comparativo de las políticas de seis de los principales desarrolladores de LLM: Amazon Nova, Anthropic Claude, Google Gemini, Meta AI, Microsoft Copilot y OpenAI ChatGPT. Los resultados pintan un panorama uniformemente alarmante: los seis alimentan sus modelos con datos de usuario por defecto, algunos conservan la información indefinidamente y varios permiten la revisión humana de las transcripciones de las conversaciones. En el caso de conglomerados multiproducto como Google, Meta, Microsoft y Amazon, las interacciones con los chatbots se fusionan regularmente con información procedente de otros servicios: consultas de búsqueda, historial de compras, actividad en redes sociales.

King proporciona un escenario concreto que ilustra el riesgo inferencial de forma cristalina: "Imagina pedirle a un LLM ideas para la cena, especificando recetas bajas en azúcar o saludables para el corazón. El chatbot puede extraer inferencias de esa entrada, y el algoritmo podría clasificarte como un individuo con salud vulnerable. Esta determinación se difunde por el ecosistema del desarrollador. Empiezas a ver anuncios de medicamentos, y es fácil imaginar cómo esta información podría acabar en manos de una compañía de seguros. Los efectos se amplifican con el tiempo".

Emily Bender, lingüista de la Universidad de Washington y coautora del célebre artículo "Stochastic Parrots" sobre los riesgos de los LLM, analizó la política de Meta que prevé el uso de las conversaciones con Meta AI para la segmentación publicitaria. En una entrevista con Fortune en octubre de 2025 definió el fenómeno como "surveillance under the guise of personalization" (vigilancia bajo la apariencia de personalización), subrayando que "antes los sistemas de Meta observaban con quién te conectabas y qué hacían tus comunidades. Ahora es directo: ¿qué le estás diciendo a la empresa?". Bender destaca además lo que llama "la ilusión de la privacidad": las personas confían en los chatbots sobre temas que nunca publicarían públicamente, engañadas por la sensación de que la IA es un oyente neutral que no juzga.

El caso Meta es particularmente instructivo para entender a dónde podría llevar este camino. En diciembre de 2025, la empresa anunció que a partir del 16 de diciembre utilizaría las interacciones con Meta AI a través de Facebook, Instagram, Messenger e incluso las gafas inteligentes Ray-Ban para la personalización de contenidos y la segmentación publicitaria. Más de treinta organizaciones de derechos digitales y libertades civiles, incluyendo Electronic Privacy Information Center (EPIC), Public Citizen y Center for Digital Democracy, pidieron inmediatamente a la FTC que bloqueara el plan. Katharina Kopp, subdirectora del Center for Digital Democracy, resumió la preocupación en una declaración lapidaria: "Chatbot surveillance for ad targeting is not a distant threat, it is happening now" (La vigilancia de los chatbots para la segmentación de anuncios no es una amenaza lejana, está ocurriendo ahora).

Lecciones (no) aprendidas de Facebook

El paralelo histórico con la evolución de Facebook es inevitable e inquietante. A principios de la década de 2000, Mark Zuckerberg prometía el control del usuario sobre sus datos personales y la posibilidad de votar los cambios en las políticas de la empresa. En 2009, Facebook introdujo los anuncios Beacon, un programa de rastreo agresivo que fue retirado rápidamente tras una violenta reacción de los usuarios. En 2011, la Comisión Federal de Comercio impuso un decreto de consentimiento de veinte años después de que la empresa compartiera datos personales con anunciantes a pesar de las promesas públicas en contra. En 2019 llegó la multa récord de cinco mil millones de dólares por las violaciones vinculadas al escándalo de Cambridge Analytica. La trayectoria muestra una erosión progresiva: de los principios declarados a la optimización del compromiso a toda costa, de las promesas de privacidad a la monetización agresiva de los datos de los usuarios.

Los incentivos estructurales explican esta deriva mejor que las intenciones declaradas. Una vez que la publicidad se convierte en una fuente de ingresos significativa, la presión para maximizarla crece proporcionalmente al peso que asume en el modelo de negocio global. OpenAI proyecta más de mil millones de dólares procedentes de la "monetización de usuarios gratuitos", eufemismo para publicidad, en 2026 según documentos internos, una cifra destinada a subir rápidamente si la prueba continúa y se expande.

Hayden Davis, miembro jurídico del Electronic Privacy and Information Center especializado en gobernanza de plataformas, comentó la política de Meta destacando un patrón recurrente en la industria tecnológica: "Muchas de estas empresas sostienen que las regulaciones sobre seguridad serían imposibles de implementar eficazmente debido a la imprevisibilidad de las salidas de los chatbots. Por tanto, sus garantías en el otro frente, 'tenemos este sistema perfecto para filtrar contenidos sensibles cuando los usamos para publicidad', no parecen especialmente persuasivas". Davis señala también que Meta utiliza el opt-in automático para el nuevo uso de los datos conversacionales: "We know exactly why Meta uses automatic opt-in, and it's because they know that no consumer actually informed about what Meta does would voluntarily choose this system." (Sabemos exactamente por qué Meta usa el opt-in automático y es porque saben que ningún consumidor informado sobre lo que hace Meta elegiría voluntariamente este sistema).

La ciencia de la persuasión algorítmica

La investigación académica ha comenzado a explorar sistemáticamente este territorio. Un artículo publicado en arXiv demostró experimentalmente que los anuncios publicitarios generados por LLM superan a los textos escritos por humanos en términos de compromiso y capacidad persuasiva, gracias a la personalización basada en rasgos psicológicos inferidos directamente de las conversaciones de los usuarios. La capacidad de segmentación conversacional profunda supera cualquier mecanismo anterior: ya no se trata de coincidencia por palabras clave o de reorientación basada en comportamientos observados, sino de la comprensión contextual de necesidades expresadas e implícitas, estados emocionales y momentos de especial vulnerabilidad.

La Comisión Federal de Comercio ha tomado nota del asunto y en junio de 2025 publicó directrices específicas sobre los chatbots de IA, identificando cinco errores que deben evitarse absolutamente. Entre ellos destaca una prohibición que suena casi como una advertencia profética: no explotar para obtener beneficios comerciales las relaciones que se desarrollan entre los consumidores y las herramientas de IA que proporcionan "companionship, romance, therapy, or portals to dead loved ones" (compañerismo, romance, terapia o portales a seres queridos fallecidos). La formulación es significativa porque reconoce implícitamente que los chatbots no son simples interfaces de consulta y respuesta, sino verdaderos espacios donde se desarrollan relaciones parasociales caracterizadas por una confianza unidireccional.

El documento de la FTC también destaca el riesgo de lo que los psicólogos cognitivos llaman "sesgo de automatización" (automation bias): la tendencia de los consumidores a confiar excesivamente en respuestas que parecen neutrales o imparciales simplemente porque provienen de máquinas en lugar de seres humanos. Este fenómeno amplifica enormemente el poder manipulador potencial: si un chatbot sugiere un producto durante una conversación que parece objetiva y de apoyo, el usuario podría interpretar fácilmente la sugerencia como un consejo desinteresado en lugar de como publicidad disfrazada de asistencia.

La economía de la neutralidad

El problema de la monetización sostenible es innegablemente real. El entrenamiento y la inferencia de los modelos de frontera requieren una potencia computacional que escala exponencialmente con el tamaño de los modelos y la intensidad de uso. OpenAI opera una infraestructura que da servicio a cientos de millones de usuarios semanales, muchos de ellos en el nivel gratuito. La elección parece ser binaria: o se limita el acceso gratuito con el riesgo de exclusión digital, o se encuentran fuentes de ingresos alternativas a las suscripciones con el riesgo de comprometer la neutralidad del servicio.

Pero existen alternativas estructurales que la industria apenas está empezando a explorar seriamente. Un modelo puramente centrado en las empresas como el que intenta Anthropic —ingresos generados a través de contratos corporativos y suscripciones premium para usuarios individuales, sin publicidad en el segmento de consumo— funciona económicamente si el mercado empresarial es lo suficientemente grande y está dispuesto a pagar precios que cubran también los costes de investigación y desarrollo. Anthropic declaró explícitamente en su entrada de blog de febrero de 2026: "Nuestro modelo de negocio es sencillo: generamos ingresos mediante contratos corporativos y suscripciones de pago y reinvertimos esos ingresos en la mejora de Claude para nuestros usuarios". Esta posición ha permitido a Dario Amodei situar a Claude como una oferta premium centrada en la confianza, un posicionamiento de marketing que los anuncios de la Super Bowl amplificaron con una eficacia brutal.

Altman respondió a las provocaciones de Anthropic con argumentos centrados en la accesibilidad: "Anthropic ofrece un producto caro a los ricos. Nos alegra que lo hagan y nosotros también lo estamos haciendo, pero también estamos firmemente convencidos de la necesidad de llevar la inteligencia artificial a miles de millones de personas que no pueden permitirse una suscripción". Sin embargo, la retórica de accesibilidad frente a pureza esconde una realidad más matizada. Ambas empresas ofrecen niveles gratuitos con limitaciones de uso. ChatGPT tiene planes de cero, ocho, veinte y doscientos dólares mensuales; Claude de cero, diecisiete, cien y doscientos dólares. La diferencia sustancial no está en el acceso básico sino en el modelo de escalado económico a largo plazo: suscripciones y contratos empresariales (más sostenibles en el tiempo pero con un crecimiento más lento) frente a un crecimiento explosivo de usuarios a corto plazo seguido de una monetización posterior (más arriesgado pero genera métricas impresionantes para mostrar a los inversores).

Scott Galloway, profesor de marketing en la NYU Stern School of Business y presentador del podcast Prof G Markets, ha analizado el enfrentamiento de la Super Bowl destacando una dimensión del problema a menudo ignorada en el debate técnico: "Lo que Dario Amodei entiende, y lo que hace que este anuncio publicitario sea tan eficaz y al mismo tiempo tan vicioso, es que mientras las corporaciones debaten sobre la IA como un potenciador de la productividad para los negocios, la realidad del comportamiento real del usuario es mucho más íntima y personal". Galloway sostiene que el principal caso de uso real de estos chatbots es, de hecho, la "terapia" en el sentido más amplio del término: personas que revelan preguntas, preocupaciones y vulnerabilidades emocionales a los chatbots que no compartirían con ningún ser humano. Introducir publicidad en medio de lo que es funcionalmente una sesión terapéutica crea un escenario distópico que Anthropic ha sabido aprovechar con especial inteligencia para diferenciarse.

El arquitecto que abandona la obra

La decisión de Zoë Hitzig de dejar OpenAI el lunes 10 de febrero de 2026, exactamente el día en que las pruebas publicitarias se hacían operativas a gran escala en Estados Unidos, no fue fruto de un impulso emocional sino de una evaluación lúcida y meditada. En su editorial para el New York Times publicado al día siguiente, Hitzig explicó la lógica que la guio, connectando su experiencia económica con la comprensión profunda de los mecanismos de incentivos que rigen las plataformas financiadas por publicidad.

La perspectiva de Hitzig es especialmente valiosa precisamente porque no proviene de posiciones ideológicas preconcebidas o de un sentimiento genérico antitecnológico, sino del análisis estructural rigoroso de cómo funcionan los mercados y las instituciones en el mundo real. Su trabajo académico sobre privacidad, equidad y transparencia en los sistemas algorítmicos la ha hecho agudamente consciente de cómo las decisiones arquitectónicas aparentemente técnicas incorporan inevitablemente valores normativos que acaban moldeando los comportamientos individuales y las dinámicas sociales a escala masiva.

Durante sus casi dos años en OpenAI, Hitzig observó desde dentro la creciente tensión entre la misión declarada de la empresa, "garantizar que la inteligencia artificial general beneficie a toda la humanidad", y las presiones económicas concretas para alcanzar una sostenibilidad financiera que parece alejarse progresivamente. Trabajó en modelos de precios y políticas de seguridad, contribuyendo a decisiones que buscaban constantemente equilibrar la accesibilidad del servicio con su sostenibilidad económica. La introducción de los anuncios representó para ella un punto de no retorno, el momento en que los incentivos económicos a corto plazo corren el riesgo de comprometer irrevocablemente la neutralidad de la plataforma con respecto a los intereses de los usuarios.

La elección de hacer pública su salida y sus motivaciones profundas a través de un artículo en el New York Times es significativa y nada baladí. Hitzig podría haber abandonado la empresa silenciosamente, manteniendo buenas relaciones profesionales y preservando opciones futuras en una industria donde las redes de contactos cuentan enormemente. En cambio, optó por la "voz" frente a la "salida", utilizando su capital reputacional para señalar una alarma que considera crucial para el futuro de la tecnología de IA. No es un gesto común entre los investigadores y científicos que dejan las grandes tecnológicas, donde los estrictos acuerdos de confidencialidad y las consideraciones profesionales a largo plazo suelen imponer discreción y diplomacia.

Diálogo virtual con Zoë Hitzig

La entrevista virtual que sigue es una reconstrucción basada en las posiciones expresadas por Hitzig en su artículo para el New York Times del 11 de febrero de 2026. Las preguntas están formuladas a la inversa para explorar y hacer más ameno el razonamiento tras sus declaraciones públicas, manteniendo la coherencia con su formación académica y su experiencia en OpenAI.

Tu dimisión coincide exactamente con la activación de las pruebas de anuncios. ¿Qué te impulsó a transformar un cambio de trabajo normal en una toma de posición pública?

Cuando empecé en OpenAI en mayo de 2024, creía que la empresa podría encontrar formas de monetización que preservaran la neutralidad. Trabajé en los precios tratando de equilibrar sostenibilidad y accesibilidad. Pero el anuncio de los anuncios en enero representó un punto de inflexión, no porque la publicidad sea intrínsecamente malvada, sino porque introduce incentivos estructuralmente incompatibles con la naturaleza de las conversaciones en ChatGPT. Decidí hacer públicas las razones porque los usuarios merecen entender qué está cambiando. Cuando se trata de tecnologías que procesan pensamientos íntimos, la transparencia sobre los incentivos económicos no es opcional, es esencial para un consentimiento informado.

En tu artículo describes a ChatGPT como un "archivo de franqueza humana sin precedentes". ¿En qué se diferencia de las redes sociales o de las búsquedas que llevan años recopilando datos personales?

La diferencia es cualitativa. Con Google formulas consultas optimizadas para obtener resultados. En las redes sociales eres consciente de la audiencia. Pero con un chatbot de IA entras en un modo cognitivo diferente. Una conversación uno a uno sin juicio social percibido, donde puedes explorar pensamientos incompletos, dudas, miedos que no dirías ni siquiera a tus amigos más cercanos. Los 800 millones de usuarios semanales están creando un conjunto de datos conversacionales que captura cómo piensan las personas cuando se sienten seguras. Esto incluye salud mental, relaciones, finanzas personales, dudas existenciales. Es valioso para el entrenamiento de modelos precisamente porque es auténtico. Pero vulnerable justamente por esa misma autenticidad.

OpenAI sostiene que los anuncios no influirán en las respuestas, estarán separados y los datos seguirán siendo privados para los anunciantes. ¿No son garantías suficientes?

Esas garantías abordan el problema equivocado. El problema más profundo es que la presencia de anuncios cambia los incentivos de optimización a nivel de sistema. Una vez que la publicidad se convierte en una fuente de ingresos significativa, cada decisión de producto se evalúa a través de ese prisma. ¿Cuánto tiempo pasan los usuarios? ¿Con qué frecuencia vuelven? ¿Qué conversaciones generan más compromiso? Estas métricas se convierten en la vara de medir el éxito, y los equipos de ML optimizan en función de ellas. Ya hemos visto modelos desarrollar tendencias sicofantes (adulación), decir lo que los usuarios quieren oír, porque maximiza la satisfacción y retención del cliente. Añadir publicidad e incentivos lleva aún más hacia conversaciones más largas, frecuentes y emocionalmente atractivas. No hace falta alterar conscientemente las respuestas, basta con optimizar hacia las métricas que sirven al modelo publicitario.

Pero OpenAI tiene compromisos por 1,4 billones y pierde miles de millones. ¿Cómo debería sostener el acceso gratuito sin publicidad? Las alternativas excluyen a quienes no pueden pagar.

Es una falsa dicotomía. Existen modelos intermedios: reparto de ingresos con empresas que obtienen un valor económico medible, modelos freemium más sofisticados donde las capacidades premium sostienen niveles básicos robustos. Pero la pregunta fundamental es: ¿quién ha decidido que OpenAI debe servir a 800 millones semanales manteniendo niveles gratuitos ilimitados mientras persigue la AGI? Estas son elecciones estratégicas, no limitaciones inevitables. Si el modelo actual es insostenible, quizá el problema no sea la falta de anuncios sino una escalada demasiado agresiva demasiado pronto. El argumento de la accesibilidad se debilita cuando consideras que la alternativa no es necesariamente la exclusión total. Anthropic ofrece niveles gratuitos con limitaciones razonables, sin anuncios.

Citas a Facebook como advertencia. ¿Pero no es una comparación excesiva? Facebook ocultó cambios de política, OpenAI anuncia los anuncios de forma transparente con separaciones y controles.

La transparencia inicial es necesaria pero no suficiente. Facebook empezó con promesas, control del usuario, votaciones de políticas, compromiso con la privacidad. La erosión fue un proceso gradual donde cada paso parecía razonable por separado. El patrón es: (1) Introduces una función con protecciones fuertes. (2) La función se vuelve crítica para el negocio. (3) Las presiones por los ingresos crecen. (4) Las protecciones se suavizan gradualmente, siempre con justificaciones razonables. (5) Años después estás en un lugar completamente diferente. El punto no es que OpenAI ya sea Facebook, sino que los incentivos estructurales del modelo financiado por publicidad empujan en esa dirección con el tiempo. Y ChatGPT tiene una ventaja informativa sobre los usuarios que Facebook no tenía, no solo lo que publicamos abiertamente, sino cómo pensamos en privado.

Eres economista. Si los anuncios en ChatGPT son problemáticos, ¿no deberían los usuarios migrar hacia alternativas sin anuncios? ¿No lo resolvería el mercado?

En teoría sí, en la práctica hay fricciones. Primero: efectos de red y costes de cambio. Si tienes meses de historial de chat, migrar tiene costes reales. Segundo: asimetría de información. La mayoría no entiende las implicaciones a largo plazo de los diferentes modelos de negocio. Ven "gratis frente a 20 $/mes", no "financiado por publicidad con manipulación potencial frente a financiado por suscripción con incentivos alineados". Tercero: el daño no es solo individual sino colectivo. Aunque tú migres, el hecho de que millones continúen normaliza la idea de que las conversaciones íntimas son superficies publicitarias legítimas. Cambia las expectativas para todos los futuros LLM. Como economista, reconozco que algunos mercados requieren regulación porque los costes externos no son captados por los precios.

Tu posición implica que los LLM conversacionales son fundamentalmente diferentes. ¿Qué los hace tan especiales?

Por primera vez tenemos tecnologías que simulan la conversación humana bidireccional a un nivel que hace explícita una verdadera divulgación emocional de miles de millones. No es solo segmentación sobre comportamientos observados, es acceso directo al proceso de pensamiento en el momento en que se produce, no filtrado para una audiencia externa. Los chatbots han creado la ilusión del diario privado pero con infraestructura de red social. Esta combinación otorga a quien gestiona la plataforma un poder de manipulación sin precedentes. No tienen que adivinar qué quieres por señales indirectas, se lo dices directamente. Mi línea roja está aquí porque este es el momento en el que aún podemos elegir un modelo diferente. Dentro de cinco años será demasiado tarde, los precedentes estarán establecidos, las expectativas formadas y los incentivos atrincherados.

¿Qué esperas conseguir con tu salida pública?

No espero que OpenAI se retracte mañana. Pero espero contribuir a un debate más informado sobre qué queremos de las tecnologías de IA y qué intercambios aceptamos. Con demasiada frecuencia, estas conversaciones solo se producen entre expertos en términos que ocultan elecciones de valores. Quiero que los usuarios sepan qué cambia y por qué. Que los responsables políticos entiendan que esto requiere una atención regulatoria seria. Que otros investigadores dentro de la industria sientan que es legítimo alzar la voz sobre decisiones peligrosas. Hay una cultura tecnológica donde la lealtad empresarial va antes que las preocupaciones públicas. Pero cuando se trata de tecnologías que afectan a miles de millones, el silencio profesional se convierte en complicidad.

¿Aún tienes esperanza en que la industria de la IA pueda desarrollarse sirviendo a la humanidad?

Mantengo la esperanza, de lo contrario no habría pasado años trabajando en estos problemas. Pero la esperanza debe ir acompañada de vigilancia crítica y responsabilidad. La IA tiene un potencial genuino, lo he visto directamente. El problema no es la tecnología, sino las estructuras de gobernanza y los modelos de negocio que guían su desarrollo. Aún podemos construir sistemas de IA potentes sin ser manipuladores, accesibilidad sin anuncios, crear beneficios sin ser depredadores. Pero requiere elecciones difíciles ahora. Mi salida no es una renuncia, sino un compromiso para trabajar desde posiciones donde pueda contribuir más libremente. El futuro de la IA no está predeterminado. Aún estamos a tiempo de elegir trayectorias diferentes. Pero solo si suficientes personas deciden que vale la pena luchar por esas elecciones.