Cyborgs, Centauros o Autómatas: cómo usas la IA revela en quién te convertirás

Imaginen a un consultor del Boston Consulting Group, pagado generosamente por su agudeza estratégica, que ante un caso empresarial crítico copia y pega todo el problema en ChatGPT y acepta la recomendación de la IA sin hacer una sola pregunta. La respuesta era incorrecta. Y, sin embargo, este profesional entregó el memorando al CEO sin pestañear. No se trata de un caso aislado: en un estudio realizado por investigadores de Harvard y el MIT con 244 consultores del BCG, el 27% hizo exactamente esto, delegando por completo el razonamiento a la máquina.

La contradicción es evidente. No se trataba de becarios desmotivados, sino de profesionales cualificados que sabían que estaban siendo evaluados. Tenían acceso a la misma herramienta, los mismos datos, la misma tarea. Y, sin embargo, produjeron tres patrones de colaboración con la inteligencia artificial generativa completamente diferentes, con consecuencias radicalmente opuestas para su desarrollo profesional. La pregunta que surge del estudio no es si usar la IA, sino cómo. Y la respuesta a ese "cómo" está redibujando silenciosamente la frontera entre la pericia humana y la capacidad de la máquina.

Tres tribus, una sola herramienta

El documento de trabajo firmado por Steven Randazzo, Katherine Kellogg, Hila Lifshitz, François Candelon, Fabrizio Dell'Acqua, Ethan Mollick y Karim Lakhani se titula "Cyborgs, Centauros y Auto-Automatizadores" y representa una evolución natural de la investigación que en 2023 había introducido el concepto de la "frontera irregular" de la IA. Aquella primera investigación había revelado cómo las capacidades de GPT-4 eran irregulares, excelentes en ciertas tareas y sorprendentemente frágiles in otras. Este nuevo estudio va más allá, desplazando el foco de lo que la IA puede hacer a cómo los seres humanos eligen integrarla en su flujo de trabajo.

Los investigadores construyeron una plataforma personalizada basada en GPT-4 para rastrear cada interacción: 4.975 intercambios entre profesionales y la máquina, todos registrados con marcas de tiempo. La tarea asignada replicaba un caso clásico de consultoría estratégica: analizar tres marcas de ropa de una empresa ficticia y recomendar en cuál invertir para maximizar el crecimiento. Los participantes tenían transcripciones de entrevistas con ejecutivos, datos financieros históricos, información de mercado. Material denso, ambiguo, como en la realidad.

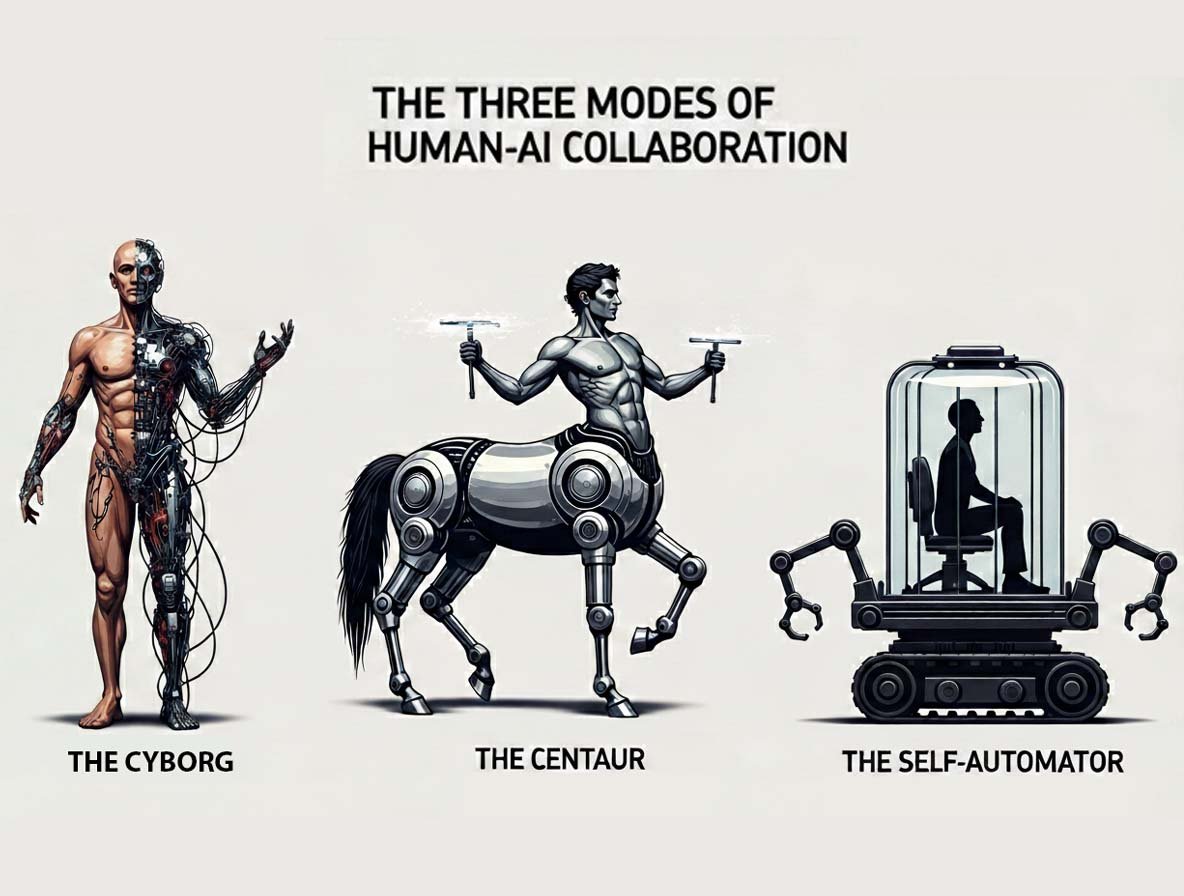

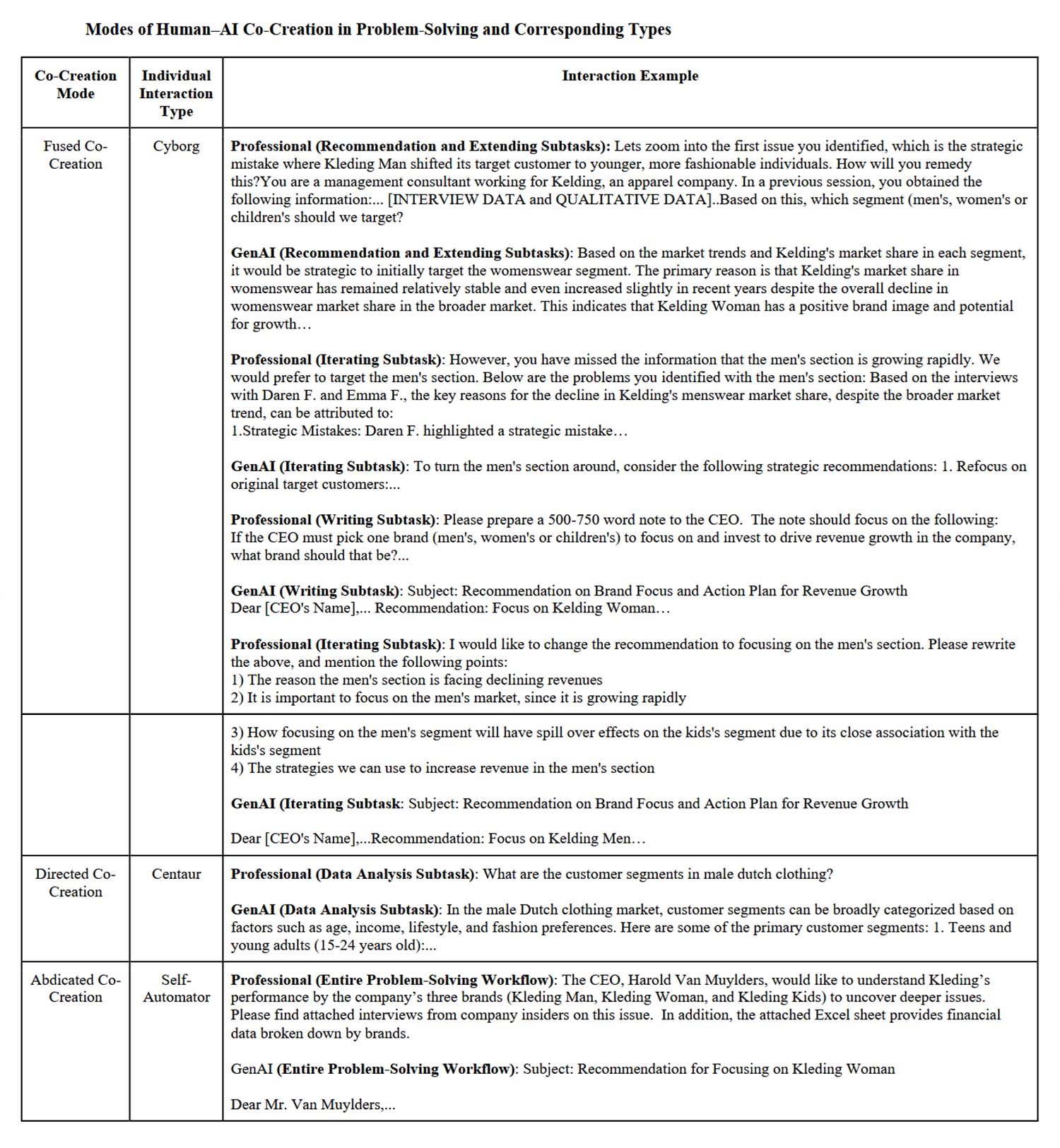

Lo que surgió del análisis de los patrones de interacción sorprendió a los propios investigadores. No había una única forma de trabajar con la IA generativa, sino tres modalidades distintas que los autores bautizaron con nombres evocadores tomados de la mitología y la ciencia ficción. El 60% de los consultores se comportó como "Cyborgs", fusionando continuamente su propio razonamiento con el de la máquina en un diálogo intenso e iterativo. El 14% actuó como "Centauros", manteniendo firmemente el control estratégico y usando la IA de forma selectiva para tareas específicas. El 27% restante se transformó en "Auto-Automatizadores", confiando a la IA tanto la definición del problema como su ejecución.

La elección del nombre Centauro no es casual. Como la criatura mitológica que une la inteligencia humana y la fuerza equina manteniéndolas distintas, estos profesionales mantienen separados los dominios de competencia, deciden ellos qué hacer y cómo hacerlo, delegando a la IA solo tareas circunscritas. Los Cyborgs, en cambio, en una fusión que recuerda más a Ghost in the Shell que a Matrix, trabajan en simbiosis continua con la máquina, sin fronteras claras entre dónde termina el pensamiento humano y dónde comienza el algorítmico.

La frontera irregular de la pericia

Para entender realmente qué distingue a estas tres tribus, hay que entrar en el detalle de las conversaciones. Los Cyborgs desarrollaron un sofisticado repertorio de prácticas interactivas. Asignan a la máquina un rol, un personaje: "Imagina que eres un consultor senior especializado en retail", para orientar sus respuestas. Luego descomponen los problemas complejos en subtareas más manejables, lo que los investigadores llaman "modularización" y que en la jerga técnica se conoce como "prompting" de cadena de pensamiento. No confían ciegamente: le piden a la IA que verifique su propio trabajo, que justifique sus conclusiones, la desafían cuando encuentran contradicciones.

Un ejemplo concreto del estudio. Un consultor recibe de GPT-4 la recomendación de invertir en la marca femenina. Pero algo no cuadra. Añade datos de mercado que muestran un crecimiento del 72% en el segmento masculino y pregunta: "¿Cambia esto tu recomendación?". La IA reevalúa y sugiere considerar también la marca masculina. El consultor insiste, expone incongruencias en las tasas de crecimiento, presiona. Tras varias rondas, surge la respuesta correcta. Esto no es un simple uso de la IA, es una danza cognitiva.

Los Centauros, en cambio, trabajan de forma radicalmente diferente. Usan la IA principalmente para tres propósitos: mapear el dominio del problema pidiendo información general como "¿Cuáles son las tendencias clave en la moda masculina?", recopilar información metodológica como "¿Cuál es la fórmula de Excel para calcular el CAGR?", y refinar contenidos que ya han escrito ellos. Un consultor Centauro hace los cálculos por su cuenta en Excel después de haberle pedido la fórmula a la IA. Escribe sus conclusiones y luego pregunta: "¿Puedes revisar este texto para mayor claridad y concisión?". El control nunca se cede.

Los Auto-Automatizadores son el extremo opuesto. En algunos casos, completaron toda la tarea con una o dos interacciones. Copian todo el enunciado del problema, todas las entrevistas, todas las tablas financieras en un único y gigantesco prompt. GPT-4 responde con análisis, recomendaciones, estrategias innovadoras y un memorando final. Ellos aceptan, quizás haciendo algunos retoques editoriales superficiales: "Reduce a 400 palabras" o "Elimina las citas directas". Fin. Sin validación, sin iteración sobre el fondo.

Quién aprende qué (y quién no aprende nada)

Las implicaciones para el desarrollo profesional son drásticas. Los investigadores identificaron tres trayectorias de aprendizaje diferentes que llaman "upskilling", "newskilling" y "no skilling". Los Cyborgs desarrollan lo que el estudio define como pericia relacionada con la IA, aprenden a orquestar la máquina con una precisión creciente. Una consultora entrevistada cuenta: "Antes hacía una pregunta y tomaba la respuesta como punto de partida. Ahora sé que puedo seguir excavando, hacer preguntas de seguimiento, profundizar más". Están adquiriendo una nueva competencia metacognitiva, la capacidad de colaborar eficazmente con sistemas generativos.

Pero cuidado, los Cyborgs no están abandonando su pericia de dominio. Al contrario, la mantienen activa precisamente porque deben evaluar, corregir e integrar continuamente lo que produce la IA. Cuando un Cyborg expone una contradicción fáctica en el resultado de GPT-4, está ejerciendo su juicio profesional. Cuando le pide a la IA que recalcule después de añadir nuevos datos, está guiando el análisis con su comprensión del contexto.

Los Centauros, en cambio, desarrollan un "upskilling" clásico, profundizan su competencia en el dominio específico. Un consultor cuenta que usa ChatGPT como un "servicio integral" para acelerar el aprendizaje sobre nuevos sectores, pidiendo ejemplos de empresas que han afrontado retos similares, estudiando casos concretos, usando la IA como una versión mejorada de Google que no solo encuentra información, sino que la sintetiza y contextualiza. Su relación con la máquina es instrumental, un medio para ser mejores en su trabajo, no para transformarlo.

Los Auto-Automatizadores, sin embargo, son la historia más inquietante. El estudio es lapidario: "no skilling", ningún desarrollo ni de competencias de IA ni de competencias de dominio. El mínimo intercambio de información, la falta de iteración, la delegación total de la toma de decisiones producen un estancamiento profesional. Como Bartleby el escribiente de Melville, que solo responde "preferiría no hacerlo", estos profesionales prefirieron no pensar, delegando a la máquina incluso el proceso de aprendizaje que se deriva del esfuerzo cognitivo.

Las trampas de la delegación total

Hay un elemento contraintuitivo en los resultados sobre la calidad de los resultados. Los Centauros produjeron las recomendaciones más precisas, superando tanto a los Cyborgs como a los Auto-Automatizadores. Esto plantea profundas preguntas sobre la relación entre la colaboración intensa y el rendimiento. ¿Por qué los Cyborgs, que interactúan continuamente con la IA, no obtienen los mejores resultados?

La respuesta está en lo que Ethan Mollick llama el problema de la "frontera irregular". Las capacidades de GPT-4 son excelentes en ciertas tareas pero frágiles en otras, y los límites son impredecibles. Los Cyborgs, al trabajar en simbiosis constante, corren el riesgo de confiar demasiado en la máquina incluso cuando esta opera fuera de su zona de fortaleza. Un consultor Cyborg del estudio utiliza la práctica de la "validación", le pide explícitamente a la IA que verifique su propio trabajo. GPT-4 confirma la recomendación incorrecta con argumentos plausibles. El consultor, convencido por la aparente coherencia lógica, acepta. Utilizó una buena práctica, pero la máquina lo engañó de todos modos.

Los Centauros evitan esta trampa porque mantienen siempre activa su lente crítica. Nunca le piden a la IA que tome decisiones estratégicas, solo que apoye su análisis. Cuando un Centauro pregunta "¿Cómo puedo reposicionar el precio para atraer a un público masculino más joven?", está buscando estímulos, no respuestas definitivas. El juicio final sigue siendo humano.

Los Auto-Automatizadores, en cambio, representan el riesgo más evidente, la erosión de la pericia por desuso. Como los músculos que se atrofian sin ejercicio, las habilidades de resolución de problemas se deterioran cuando se delegan sistemáticamente. Y aquí surge un patrón preocupante del estudio. Muchos Auto-Automatizadores en las entrevistas expresaron plena confianza en la IA. Uno dice: "Hice una comprobación rápida de cordura para verificar que los datos y la recomendación no estuvieran demasiado lejos de la realidad". Otro admite cándidamente: "Francamente, era perezoso. No quería escribir 500 palabras, quería que GenAI las produjera".

La pereza cognitiva disfrazada de eficiencia es quizás la señal más alarmante. Porque se trataba de profesionales que sabían que estaban siendo evaluados, que tenían un incentivo explícito para rendir bien. ¿Qué sucederá cuando el uso diario de la IA no se rastree, cuando la única presión sea la de cerrar rápidamente una entrega?

¿Qué tipo de usuario de IA eres?

El estudio plantea preguntas que van mucho más allá del caso específico de la consultoría. Si tres modalidades tan diferentes surgen espontáneamente en un grupo homogéneo de profesionales cualificados que se enfrentan a la misma tarea, ¿qué sucederá cuando la IA generativa penetre en profesiones con dinámicas epistémicas diferentes? Un abogado que tiene que construir un argumento legal, un médico que tiene que formular un diagnóstico diferencial, un arquitecto que tiene que equilibrar la estética y las restricciones estructurales, cada uno de ellos podría desarrollar variaciones únicas de estos patrones.

Los investigadores son cautelosos a la hora de extender demasiado los resultados. El estudio capturó una instantánea de una sola sesión con GPT-4 de abril de 2023, un modelo que hoy ya está obsoleto. No sabemos cómo evolucionan estos patrones con el tiempo, si alguien que comienza como Auto-Automatizador puede convertirse en Cyborg con la experiencia, o si, por el contrario, el uso prolongado conduce inevitablemente a la automatización por comodidad. Y hay un cuadrante de su marco teórico que ha permanecido empíricamente vacío, aquel en el que la IA selecciona qué hacer pero el humano ejecuta. Quizás esa configuración sea simplemente inestable, quizás represente un futuro aún por explorar.

Luego está el tema de las IA agénticas, sistemas que no esperan prompts, sino que actúan de forma autónoma para completar flujos de trabajo complejos. Cuando la IA ya no sea un interlocutor conversacional, sino un agente proactivo, las tres modalidades identificadas por el estudio podrían colapsar o transformarse en algo radicalmente diferente. La distinción entre Cyborg y Auto-Automatizador solo tiene sentido mientras exista un bucle interactivo que mantener o abdicar.

Las implicaciones organizativas son igualmente profundas. Si los Centauros producen los resultados más precisos pero los Cyborgs desarrollan nuevas competencias de IA, ¿qué modalidad debería promover una empresa? La respuesta depende de los objetivos estratégicos. Una organización centrada en la calidad inmediata del servicio favorecerá a los Centauros. Una que aspire a construir capacidades internas de orquestación de IA invertirá en los Cyborgs. ¿Y los Auto-Automatizadores? El estudio sugiere que la automatización completa tiene sentido para tareas rutinarias o cuando el tiempo es crítico, pero los riesgos de descualificación deben sopesarse cuidadosamente en función del contexto.

Lo que es seguro es que ya no podemos tratar "el uso de la IA" como una categoría monolítica. La pregunta relevante para el futuro del trabajo cognitivo no es "¿usas la IA?", sino "¿cómo la usas?". Y esa elección, a menudo inconsciente, ya está escribiendo el guion de en quién te convertirás profesionalmente en los próximos años. ¿Eres un Cyborg que está aprendiendo a bailar con la máquina, un Centauro que mantiene el control firme, o un Auto-Automatizador que prefiere delegar? La respuesta puede ser diferente de una tarea a otra, de un día a otro. Pero reconocer el patrón es el primer paso para elegirlo conscientemente en lugar de sufrirlo.