GLM-5: el modelo entrenado con chips chinos

Un modelo de 744 mil millones de parámetros, entrenado íntegramente con chips domésticos Huawei, que alcanza el rendimiento de los mejores modelos propietarios estadounidenses en algunas de las pruebas más relevantes. Todo ello sin un solo procesador NVIDIA. La carrera por la autonomía tecnológica china ya no es una promesa futura: ya ha ocurrido, y GLM-5 es la prueba más elocuente de ello hasta la fecha.

Quienes siguen este portal desde hace tiempo saben que estamos observando algo más grande que una serie de lanzamientos de modelos. Con Kimi K2.5, con DeepSeek MHC, con Kimi K2 Thinking hemos ido narrando las piezas de un mosaico que ahora, con la llegada de GLM-5, muestra con mayor nitidez su forma global. No se trata de modelos excepcionales aislados. Se trata de un movimiento sistemático y coordinado que en pocos meses ha llevado a la inteligencia artificial china de código abierto de la persecución a la paridad, y en algunos casos al adelantamiento, de los laboratorios estadounidenses más laureados.

GLM-5 fue presentado el 11 de febrero de 2026 por Z.ai, el nombre internacional con el que desde 2025 se presenta Zhipu AI, empresa fundada en 2019 como spin-off de la Universidad de Tsinghua en Pekín. El lanzamiento no pudo ser más simbólico: víspera del Año Nuevo Lunar, en lo que algunos analistas ya llaman la "ofensiva del Festival de Primavera" de la IA china. ¿Una coincidencia? Difícil de creer.

Bajo el capó: ingeniería a escala

Para entender qué representa GLM-5 desde el punto de vista técnico, es útil partir de una analogía. Imaginad un gran estudio de grabación. Los modelos antiguos eran como orquestas de tamaño estándar, donde todos los músicos tocan al mismo tiempo. Los modelos de "mezcla de expertos" (MoE, Mixture of Experts), como GLM-5, funcionan en cambio como una orquesta enorme en la que, para cada pieza, solo se convoca al escenario a los músicos más adecuados. El resultado final es más rico, pero el coste de ejecución es muy inferior a lo que cabría esperar por el tamaño total del conjunto.

En términos concretos: GLM-5 tiene 744 mil millones de parámetros totales (el equivalente a los "conocimientos" almacenados en la red neuronal), pero para procesar cada solicitud individual solo activa 40 mil millones. En comparación con su predecesor GLM-4.5, que se quedaba en 355 mil millones de parámetros totales con 32 mil millones activos, se trata de un salto considerable, tanto en términos de capacidad como de eficiencia en la gestión de la carga computacional.

A esto se suma otra decisión técnica relevante: la integración del mecanismo de atención dispersa desarrollado por DeepSeek, conocido como DeepSeek Sparse Attention. Sin entrar en detalles matemáticos, esta técnica permite al modelo manejar textos muy largos, hasta 200.000 "tokens" de texto (equivalentes a unas 150.000 palabras), sin que los costes computacionales se disparen proporcionalmente a la longitud. Es la misma lógica que permitió a DeepSeek reducir los costes operativos de sus modelos: no desperdiciar recursos en cada palabra del contexto, sino centrarse en las más relevantes.

Los datos de entrenamiento han crecido de 23 a 28,5 billones de tokens, con los que el modelo fue "entrenado" antes de recibir refinamientos adicionales mediante aprendizaje por refuerzo, una técnica que, simplificando, premia al modelo cuando produce mejores respuestas y lo corrige cuando se equivoca, de forma similar a como se entrena un atleta con un entrenador exigente. Para gestionar este proceso a una escala tan grande, el equipo de Zhipu desarrolló una infraestructura de entrenamiento llamada Slime, que optimiza el flujo de cálculo de forma asíncrona, reduciendo los tiempos muertos entre un ciclo de entrenamiento y otro.

Una nota práctica para quienes piensen en la instalación autónoma: el modelo en su versión original de máxima precisión requiere unos 1.490 gigabytes de memoria, más de un terabyte y medio. Cifras de centro de datos, no de estación de trabajo doméstica. Existe, sin embargo, una versión de precisión reducida (FP8) que reduce este requisito a la mitad, haciendo que el modelo sea accesible para infraestructuras más comunes, aunque sigan siendo significativas.

Dónde gana, dónde flaquea: los números sin filtros

El análisis del rendimiento es donde la retórica de los comunicados de prensa se encuentra con la realidad de las pruebas. Y aquí GLM-5 reserva algunas sorpresas, en ambos sentidos.

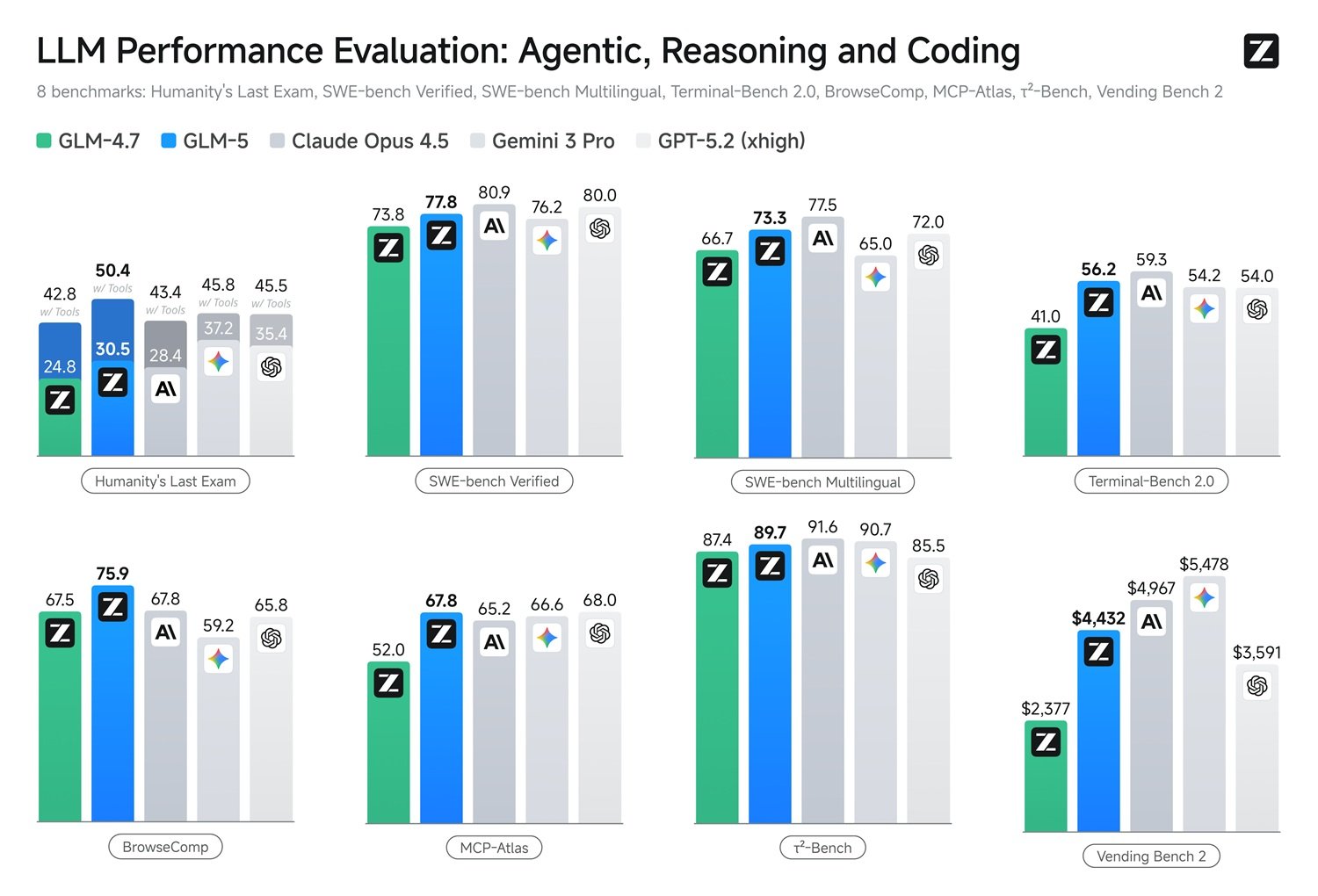

En el frente de las capacidades agénticas (la capacidad del modelo para realizar tareas complejas de forma autónoma, no solo responder a preguntas individuales), GLM-5 alcanza resultados que hasta hace pocos meses parecían prerrogativa exclusiva de los modelos propietarios de pago. Según las mediciones de Artificial Analysis, que utiliza un índice compuesto llamado GDPval-AA para medir la utilidad práctica en tareas laborales reales, GLM-5 obtiene una puntuación ELO de 1412, lo que lo sitúa en el tercer puesto absoluto de la clasificación mundial, justo después de Claude Opus 4.6 de Anthropic y GPT-5.2 de OpenAI. Es el primero entre todos los modelos de código abierto, con un margen significativo sobre competidores de su misma categoría como Kimi K2.5 y DeepSeek V3.2.

Aún más significativo es el salto adelante respecto a su predecesor directo: GLM-4.7 obtenía una puntuación de 42 en el índice de inteligencia de Artificial Analysis; GLM-5 llega a 50, siendo el primer modelo de código abierto que alcanza y supera ese umbral en la versión 4.0 del índice. No es un número arbitrario: marca el momento en que la distancia entre los modelos abiertos y los propietarios de gama alta se ha reducido a algo realmente medible.

En el ámbito de la programación, GLM-5 alcanza un 77,8% en el benchmark SWE-bench Verified, que mide la capacidad para resolver problemas reales en repositorios de código existentes, una prueba mucho más cercana al trabajo diario de un desarrollador que las pruebas teóricas. Claude Opus 4.5 se queda en el 80,9%, GPT-5.2 en el 80,0%: la distancia existe, pero es del orden de unos pocos puntos porcentuales, no un abismo.

Quizás el resultado más sorprendente sea el relativo a las alucinaciones, ese fenómeno por el cual los modelos lingüísticos "inventan" información con la misma seguridad con la que relatan hechos reales, uno de los problemas más difíciles de la inteligencia artificial generativa. GLM-5 reduce su tasa de alucinaciones en un 56% respecto a GLM-4.7, alcanzando el nivel más bajo entre todos los modelos probados por Artificial Analysis. El mecanismo utilizado es sencillamente la honestidad: cuando el modelo no sabe algo, se abstiene de responder en lugar de inventar. Una elección que penaliza ligeramente la exhaustividad de las respuestas, pero mejora radicalmente la fiabilidad de las que ofrece.

Sin embargo, existen límites concretos que no deben subestimarse. GLM-5 es, de momento, un modelo exclusivamente textual: no analiza imágenes ni produce contenidos multimedia, mientras que competidores como Kimi K2.5 ya admiten entrada visual. La velocidad de inferencia, unos 17-19 tokens por segundo, es sensiblemente inferior a la de los modelos entrenados con hardware NVIDIA de última generación, que alcanzan los 25 tokens o más. Y la ventana de contexto máxima de 200.000 tokens, aunque amplia, se mantiene por debajo del millón alcanzado por Claude Opus 4.6. No son defectos despreciables, sino elementos que deben sopesarse en relación con el coste y la disponibilidad.

La jugada de Huawei: mucho más que un detalle técnico

Es aquí donde el análisis técnico deja paso a algo más grande. GLM-5 ha sido entrenado íntegramente con chips Huawei Ascend, sin un solo procesador NVIDIA. Pero para entender el peso de esta afirmación, hace falta dar un paso atrás de unos meses.

El 14 de enero de 2026, Zhipu AI ya había anunciado un resultado que fue noticia de forma discreta: GLM-Image, su modelo generativo de imágenes, se había convertido en el primer modelo multimodal de gama alta del mundo en completar todo el ciclo de entrenamiento con hardware chino, concretamente en servidores Huawei Ascend Atlas 800T A2. Ya era un hito. Con GLM-5, Zhipu ha replicado y ampliado esa experiencia a una escala mucho mayor, extendiéndola a su modelo lingüístico de referencia.

El contexto geopolítico es imprescindible. El Departamento de Comercio de Estados Unidos incluyó a Zhipu AI en su lista de entidades que actúan contra los intereses de seguridad nacional de EE. UU., citando supuestos vínculos con estructuras militares chinas. La consecuencia práctica fue el bloqueo del acceso a los procesadores NVIDIA H100 y A100, las tarjetas gráficas convertidas en el estándar de facto para el entrenamiento de los modelos lingüísticos más avanzados. La respuesta de Zhipu no fue buscar atajos o hardware occidental alternativo: fue acelerar la colaboración con Huawei y demostrar que se puede hacer el mismo trabajo con herramientas chinas.

Los procesadores Ascend 910B y 910C de Huawei ofrecen individualmente alrededor del 60-80% de la potencia de cálculo de un H100 de NVIDIA. Una brecha no despreciable, que Zhipu cerró mediante dos estrategias paralelas: una optimización profunda del software a través del framework MindSpore de Huawei, y escalabilidad horizontal (más máquinas trabajando en paralelo para compensar la menor potencia individual de cada una). El sistema CloudMatrix 384 de Huawei, que agrupa casi 400 chips Ascend en una sola unidad lógica, alcanza los 300 petaflops de potencia de cálculo total, una cifra impresionante obtenida con un enfoque que requiere más hardware pero demuestra la viabilidad de la alternativa "doméstica".

Vale la pena ser precisos en un punto: GLM-5 no es el primero de los grandes modelos lingüísticos chinos entrenado con chips que no son de NVIDIA. Pero es el primero de esta generación (la de los modelos de cientos de miles de millones de parámetros que compiten con los mejores laboratorios estadounidenses) en hacerlo a una escala de este tipo, con hardware íntegramente chino, y en obtener resultados que resisten la comparación con los modelos punteros mundiales. La distinción es técnica, pero el alcance estratégico es enorme.

Es significativo notar que Zhipu no se limitó a los chips Ascend. La documentación oficial en GitHub enumera el soporte para Moore Threads, Cambricon, Kunlun Chip, MetaX, Enflame e Hygon, prácticamente todo el ecosistema de chips de IA chinos alternativos a NVIDIA. Una señal de que la dirección no es simplemente "usamos Huawei porque estamos obligados", sino "construimos un ecosistema que no dependa de ningún proveedor extranjero".

El código abierto como arma estratégica

GLM-5 se distribuye bajo la licencia MIT, la más permisiva de las licencias de código abierto, que permite el uso comercial, la modificación y la redistribución sin restricciones significativas. Los pesos del modelo pueden descargarse libremente en Hugging Face y ModelScope. La API es accesible a través de la plataforma Z.ai a precios netamente inferiores a los de los competidores propietarios: alrededor de 1 dólar por millón de tokens de entrada y 3,2 por millón de salida, frente a los 15 o más de los modelos de OpenAI y Anthropic de nivel equivalente.

Hay algo peculiar, y deliberado, en esta apuesta por la apertura radical. Zhipu AI es una empresa que cotiza en la Bolsa de Hong Kong (HKEX: 2513), con una salida a bolsa completada el 8 de enero de 2026 que recaudó unos 558 millones de dólares. No es un proyecto académico sin ánimo de lucro: tiene inversores, accionistas y expectativas de rentabilidad. Y, sin embargo, distribuye gratuitamente y con una licencia liberalísima el que considera su modelo más avanzado.

La lógica, que ya hemos visto con DeepSeek y Kimi, es la del ecosistema: cuantos más desarrolladores de todo el mundo construyan sobre GLM-5, más crece la adopción de la plataforma Z.ai, de los servicios de API y de la marca. Es un modelo de negocio en el que la apertura del modelo es el producto de marketing más eficaz y, al mismo tiempo, en el contexto geopolítico actual, una herramienta de influencia blanda sobre el ecosistema global de la inteligencia artificial.

Sin embargo, hay que plantear una pregunta que a menudo queda en segundo plano cuando se habla de modelos chinos de código abierto: las implicaciones en términos de seguridad y cumplimiento normativo. Zhipu AI opera bajo la jurisdicción china, con todas las obligaciones que ello conlleva en materia de seguridad nacional y acceso a datos. El modelo en sí, una vez descargado, es independiente de la empresa que lo creó, pero quienes utilizan la API de Z.ai confían en una infraestructura sujeta a las leyes chinas. Para muchas empresas occidentales, especialmente en sectores regulados, este no es un detalle menor. Para desarrolladores individuales o empresas en contextos menos sensibles, la licencia MIT garantiza una vía de escape: descargar los pesos y ejecutar el modelo de forma autónoma, sin dependencias externas.

El tema del sesgo en los datos de entrenamiento, inevitable en cualquier modelo entrenado con corpus de texto humanos, sigue siendo una cuestión abierta. Zhipu aún no ha publicado un informe técnico detallado (el equipo ha anunciado que está "en camino"), lo que dificulta la evaluación independiente de las decisiones tomadas en la selección de datos y en la fase de alineación de valores. Una omisión que no es un detalle marginal: precisamente en este punto laboratorios estadounidenses como Anthropic y OpenAI han cimentado una parte importante de su reputación, con una amplia documentación pública y políticas explícitas.

El panorama que se perfila

Mirando los artículos publicados en este portal en las últimas semanas, el patrón es inequívoco. En un lapso de tiempo comprimido, DeepSeek, Moonshot (con Kimi) y Zhipu (con GLM) han lanzado modelos que no se limitan a "casi" alcanzar a los mejores laboratorios estadounidenses: en bancos de pruebas y casos de uso específicos los superan, a menudo por una fracción del coste. No es una coincidencia temporal: es la señal de un sector que ha alcanzado una masa crítica de competencias, capital y, lo que es más significativo, una capacidad de desarrollo sobre hardware doméstico que las sanciones estadounidenses no han logrado detener, sino que, en todo caso, han acelerado.

La respuesta de los mercados a los modelos chinos no es una novedad de febrero de 2026. El precedente más clamoroso se remonta al 27 de enero de 2025, cuando el anuncio de DeepSeek R1 borró en un solo día casi 600.000 millones de dólares de capitalización de Nvidia, el desplome más rápido de la historia del mercado bursátil estadounidense. GLM-5 se inscribe en esa estela: no ha provocado un shock comparable, pero consolida la narrativa que el mercado ya ha metabolizado: la de un ecosistema chino que no necesita frenar.

Para el sector en su conjunto, la lección de GLM-5, como la de DeepSeek y Kimi antes que él, es que la carrera por la inteligencia artificial ya no es una competición de solo dos equipos. Quienes diseñan infraestructuras, quienes evalúan proveedores y quienes toman decisiones de inversión en el sector tecnológico deben lidiar con un ecosistema genuinamente multipolar, en el que las variables geopolíticas, las decisiones de licencia y las dependencias de hardware se han convertido en parte integrante del análisis técnico.

GLM-5 está disponible libremente en Hugging Face, puede probarse vía API en Z.ai y consultarse en detalle técnico en el repositorio GitHub oficial. Quien quiera tener una opinión informada dispone de todo el material necesario para formársela.