MiniMax M2.7: la IA que aprende de sí misma (casi)

Un mes. Es el tiempo que separa al M2.5 del M2.7, la nueva versión del modelo de MiniMax lanzada el 18 de marzo de 2026. En un sector donde los ciclos de desarrollo se medían en años y luego en meses, unas pocas semanas se han convertido en el nuevo intervalo normal. Pero esta vez, la distancia temporal es solo el detalle menos interesante.

Hace apenas un mes, en la revista Codemotion, analicé MiniMax M2.5: un modelo con arquitectura de expertos mixtos de 230 mil millones de parámetros totales, capaz de activar solo 10 mil millones por consulta, con un rendimiento en SWE-Bench Verified (80,2%) prácticamente idéntico al de Claude Opus 4.6 (80,8%) a una vigésima parte del precio. La propuesta era tan sencilla como inquietante: calidad de frontera a costes asequibles, con una "mentalidad de arquitecto" que surgía espontáneamente durante el entrenamiento en más de 200.000 entornos reales. MiniMax, una startup de Shanghái que cotiza en Hong Kong con una capitalización post-salida a bolsa de unos 13.000 millones de dólares, ya había rediseñado la relación calidad-precio en la IA para código.

M2.7 no es una respuesta a una debilidad de M2.5. Es algo diferente: un intento declarado de cambiar la forma en que se desarrolla un modelo, no solo lo que produce. La palabra clave que MiniMax ha elegido para comunicarlo es self-evolution, autoevolución. Es una palabra fascinante, evocadora y potencialmente engañosa. Vale la pena entender exactamente qué significa y, sobre todo, qué no significa.

El modelo que ayuda a construir el siguiente modelo

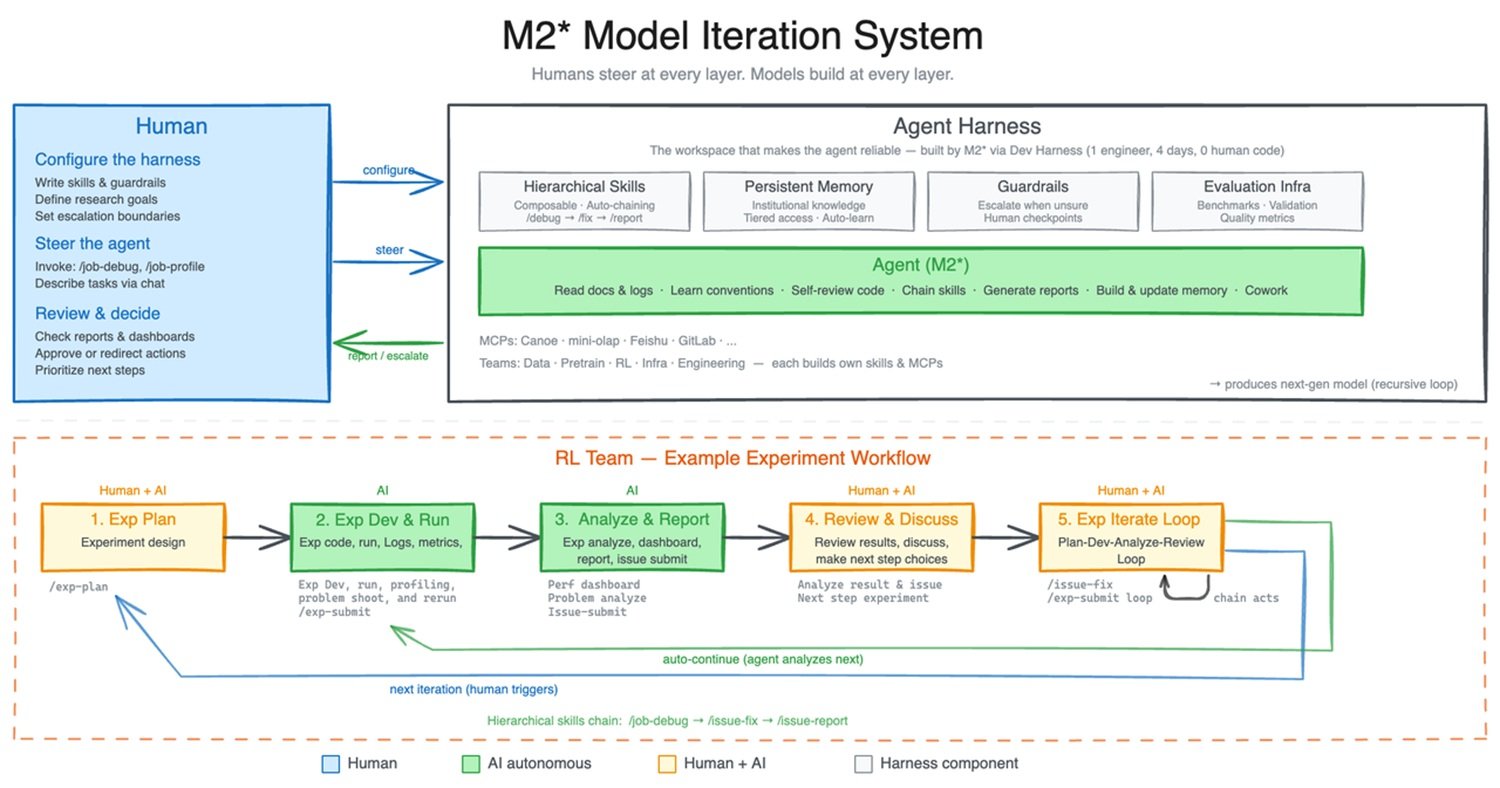

Para entender qué ha pasado realmente con el M2.7, hay que partir de una imagen concreta. En el equipo de investigación de MiniMax, los investigadores que trabajan en el aprendizaje por refuerzo (entrenamiento mediante recompensas y penalizaciones) gestionan ciclos experimentales largos y complejos: ideas que probar, datos que preparar, experimentos que lanzar, resultados que analizar, código que corregir, nuevos experimentos que configurar. Es un trabajo que normalmente requiere la colaboración de varias personas de distintos equipos.

Según la documentación oficial de MiniMax, se puso a trabajar una versión interna del M2.7 precisamente en este ciclo: el modelo ayudaba en la revisión de la literatura, preparaba canalizaciones de datos, lanzaba experimentos, supervisaba los registros, depuraba errores, analizaba métricas, abría solicitudes de combinación (merge requests) y realizaba pruebas de humo. Los investigadores humanos intervenían solo para las decisiones críticas y las discusiones estratégicas. En este contexto, MiniMax calcula que el M2.7 consiguió gestionar de forma autónoma entre el 30 y el 50 % del flujo de trabajo del equipo de aprendizaje por refuerzo (RL).

Pero hay un segundo nivel, más radical. MiniMax pidió al M2.7 que optimizara de forma autónoma el rendimiento de un modelo sobre un andamiaje (scaffold) interno de programación. El proceso estaba totalmente automatizado: el sistema ejecutaba un ciclo iterativo de análisis de trayectorias de fallo, planificación de cambios, alteración del código del andamiaje, ejecución de evaluaciones, comparación de resultados y decisión de mantener o anular los cambios. Este ciclo se repitió durante más de 100 iteraciones consecutivas. El resultado declarado por MiniMax es una mejora del 30 % en el rendimiento en los conjuntos de evaluación internos. Las optimizaciones encontradas de forma autónoma por el modelo incluyeron la búsqueda sistemática de la combinación óptima de parámetros de muestreo como la temperatura, la penalización por frecuencia y la penalización por presencia; el diseño de directrices de flujo de trabajo más específicas (por ejemplo, buscar automáticamente patrones de errores similares en otros archivos después de una corrección); y la adición de mecanismos de detección de bucles dentro del ciclo agéntico.

Este es el núcleo técnico de la autoevolución del M2.7. No es un modelo que se reescribe a sí mismo desde cero, no es conciencia artificial, no es una entidad que decide autónomamente dónde mejorar. Es un agente que optimiza una función objetivo predefinida, en un entorno controlado, sobre un problema específico, con reglas establecidas por ingenieros humanos. La diferencia con respecto al pasado es la velocidad y la escala de esta optimización: cientos de ciclos en pocas horas, cuando un equipo humano habría tardado semanas.

También vale la pena dar un paso atrás y observar que MiniMax no es la primera organización que explora este territorio. En mayo de 2025, Google DeepMind presentó AlphaEvolve, un agente evolutivo basado en Gemini que utilizaba un ciclo automatizado de generación, evaluación y selección de algoritmos. AlphaEvolve había mejorado la eficiencia de los centros de datos de Google (recuperando de media el 0,7 % de los recursos computacionales globales), acelerado el entrenamiento del propio Gemini en un 23 % en un núcleo crítico e incluso resuelto un problema abierto en el algoritmo de multiplicación de matrices que permanecía invariable desde la era de Strassen en 1969. Sin embargo, el enfoque era fundamentalmente distinto: AlphaEvolve se centraba en la optimización de algoritmos específicos, evaluables con métricas objetivas. El M2.7 intenta algo más amplio, aplicando la lógica de la automejora a todo un ciclo de investigación en ML (aprendizaje automático), con herramientas, memoria persistente y colaboración entre agentes. Las familias de enfoques están emparentadas, pero no son idénticas.

Autoevolución: ¿cuánto hay de cierto?

La narrativa pública en torno al M2.7 gravitó rápidamente hacia el marco de la "IA que evoluciona por sí sola", con vídeos que acumulan millones de visualizaciones y publicaciones que pintan escenarios de ciencia ficción. Es el momento adecuado para poner los pies en la tierra.

El porcentaje de autooptimización que cita MiniMax, ese 30-50 % del flujo de trabajo gestionado de forma autónoma en el contexto del equipo de RL, se refiere a un contexto específico y controlado: un equipo interno, con herramientas predefinidas, objetivos claros e infraestructuras diseñadas específicamente. No es una cifra que se traslade automáticamente a otros contextos. El 50-70 % restante del trabajo seguía en manos de los investigadores humanos, que tomaban las decisiones estratégicas, evaluaban la dirección de los experimentos y, sobre todo, definían qué significaba "mejora".

Un punto crítico que la comunicación de MiniMax deja deliberadamente en la penumbra es la arquitectura de control. ¿Qué acciones puede ejecutar el agente de forma autónoma? ¿Puede modificar el código de producción sin aprobación humana? ¿Puede lanzar experimentos con costes computacionales arbitrarios? ¿Cómo se previenen los bucles dañinos, las regresiones silenciosas o los comportamientos emergentes no deseados? El comunicado oficial menciona que el agente "decide mantener o anular los cambios" en función de los resultados de los conjuntos de evaluación, pero no describe las barandillas (guardrails) que impiden que el sistema converja hacia óptimos falsos o que optimice indicadores (proxies) que no correspondan a los objetivos reales.

La ausencia de un informe técnico al estilo arXiv, con detalles sobre la arquitectura, el tamaño del modelo, la mezcla de datos y las estrategias de entrenamiento, es un límite objetivo para cualquiera que quiera hacer un análisis independiente. MiniMax ha publicado documentación técnica y el repositorio del proyecto agéntico OpenRoom, pero los detalles sobre la canalización de autoevolución siguen siendo propietarios. En un sector donde la verificabilidad es la base de la confianza científica, esta opacidad es una elección con consecuencias precisas: hace que sea imposible distinguir, desde fuera, las afirmaciones verificables de las que permanecen en el dominio del marketing.

Benchmark: qué dicen los números (y qué no dicen)

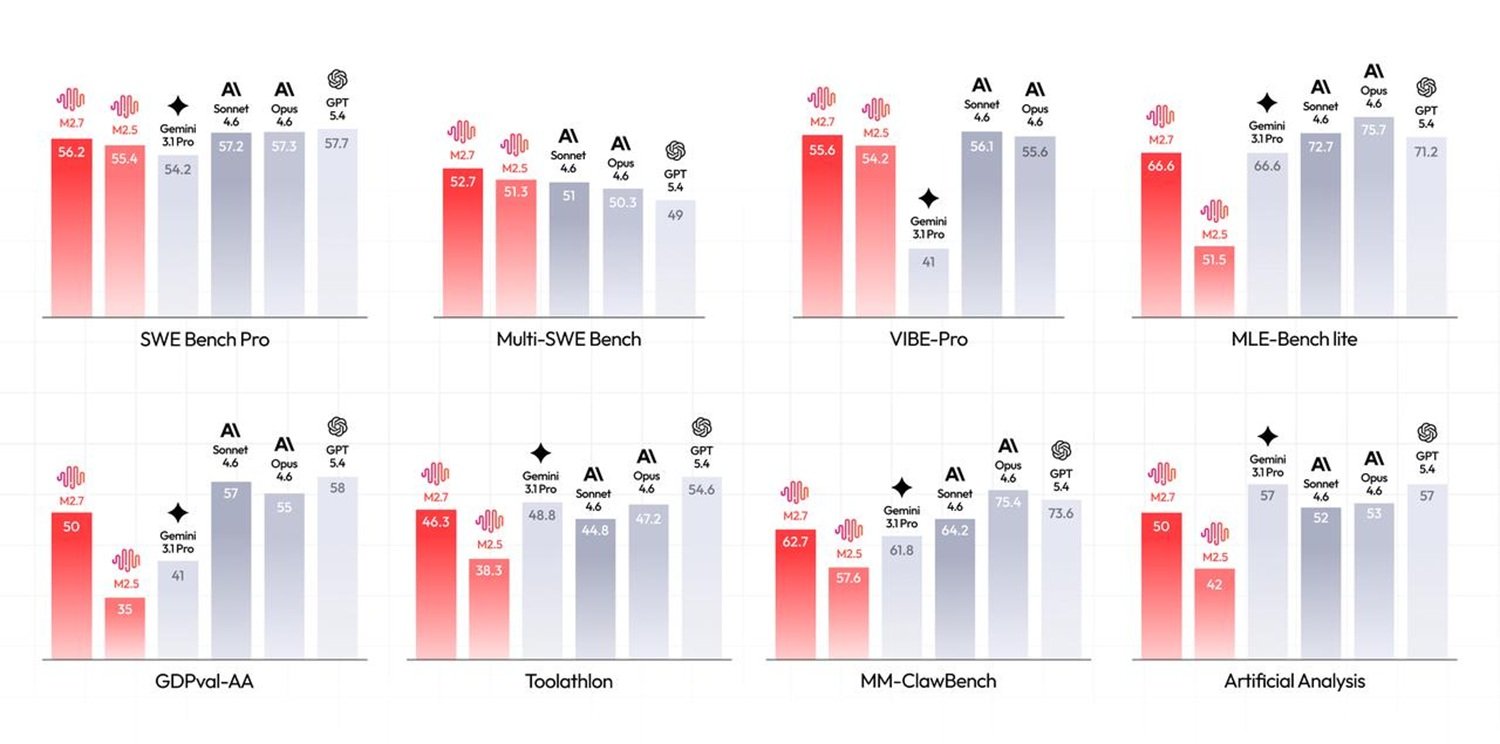

Sobre los puntos de referencia (benchmarks) declarados por MiniMax, los datos merecen una lectura atenta. En SWE-Pro, que evalúa las capacidades de ingeniería de software en problemas reales multilingües, el M2.7 alcanza el 56,22 %, acercándose al nivel del Opus 4.6. En VIBE-Pro, un benchmark para la entrega de proyectos completos de principio a fin (web, Android, iOS, simulaciones), la puntuación es del 55,6 %. En Terminal Bench 2, que mide la comprensión profunda de sistemas de ingeniería complejos, el M2.7 llega al 57,0 %. En GDPval-AA, la evaluación de la capacidad de entrega de tareas profesionales en dominios como las finanzas, el derecho y el trabajo de oficina, el M2.7 obtiene un ELO de 1495, el más alto entre los modelos de código abierto, superado solo por el Opus 4.6, el Sonnet 4.6 y el GPT-5.4 entre todos los modelos probados.

Donde los datos independientes se vuelven más interesantes es en el informe de Kilo, una plataforma de codificación agéntica que ha probado el M2.7 en dos benchmarks propios. En PinchBench, el benchmark para tareas estándar de agentes OpenClaw, el M2.7 obtiene un 86,2 %, situándose en el 5º puesto de 50 modelos probados, a menos de 1,2 puntos del Claude Opus 4.6 (87,4 %). El salto con respecto al M2.5 (82,5 %) es de 3,7 puntos, lo suficiente para desplazarlo de la franja media a la franja alta de la clasificación. En Kilo Bench, 89 tareas de codificación autónoma en todo el espectro, desde operaciones git hasta criptoanálisis diferencial, desde emulación MIPS hasta automatización QEMU, el M2.7 ha superado el 47 % de las tareas, segundo solo por detrás del Qwen3.5-plus (49 %).

Sin embargo, el dato más interesante surgido de Kilo Bench no es la tasa de éxito bruta, sino el perfil de comportamiento. El M2.7 tiende a leer extensamente el código circundante antes de escribir: analiza dependencias, rastrea cadenas de llamadas y recopila contexto de archivos relacionados. Este enfoque de "investigador" da sus frutos en tareas que requieren una comprensión sistémica profunda; Kilo cita como ejemplo una tarea SPARQL donde el modelo identificó correctamente que un filtro sobre los países de la UE era un criterio de elegibilidad, no un filtro sobre la salida, una distinción de razonamiento sutil que los otros modelos probados pasaron por alto. Pero esa misma tendencia a la sobreexploración causa tiempos de espera (timeouts) en tareas donde la velocidad cuenta más que la profundidad: la duración media de una tarea para el M2.7 es de 355 segundos, superior a la de sus predecesores. El coste en tokens es proporcionalmente más alto: unos 2,8 millones de tokens de entrada por prueba en Kilo Bench, el valor más alto entre los modelos probados.

Las voces de la experiencia práctica añaden otra dimensión. En los comentarios al informe de Kilo, un usuario describe experiencias muy decepcionantes con el M2.7 en tareas de migración, quejándose de que el modelo tendía a crear componentes de interfaz de usuario ficticios en lugar de migrar elementos existentes, a insertar comentarios TODO ignorándolos después por completo, y a negarse a continuar las migraciones a mitad del proceso. El mismo usuario informa de resultados claramente superiores con GPT-5.3-Codex, Claude 4.6 y GLM-5 en las mismas tareas. No es una muestra estadísticamente representativa, pero es una señal de que el perfil de comportamiento del M2.7 —fuerte en comprensión sistémica y razonamiento contextual, potencialmente frágil en ejecución disciplinada de planes estructurados— no se adapta igual de bien a todos los escenarios de desarrollo.

Desarrolladores y trabajadores del conocimiento: quién sale ganando

La promesa operativa más concreta del M2.7 se encuentra en el diagnóstico de producción. El comunicado oficial describe escenarios de depuración en entornos en vivo donde el modelo correlacionaba métricas de monitorización con líneas de tiempo de despliegue, realizaba análisis estadísticos sobre el muestreo de trazas, se conectaba de forma autónoma a las bases de datos para verificar hipótesis, identificaba archivos de migración de índices faltantes en el repositorio y proponía soluciones no bloqueantes. MiniMax declara haber reducido en varias ocasiones el tiempo de recuperación de incidentes en producción a menos de tres minutos, en comparación con los procesos manuales tradicionales.

Es una afirmación potente, y nada inverosímil para quien conoce el diagnóstico de sistemas distribuidos: gran parte del tiempo en un incidente de producción se gasta en correlacionar información que ya existe, en diferentes cuadros de mando (dashboards), diferentes registros y diferentes repositorios. Un agente que puede navegar por estos espacios de forma autónoma y construir hipótesis causales coherentes es genuinamente útil. El riesgo especular es el "sesgo de automatización": la tendencia a confiar excesivamente en los diagnósticos generados por el agente incluso cuando son erróneos, especialmente en situaciones de alta presión donde el tiempo para verificar es limitado. Un sistema que encuentra la causa correcta el 90 % de las veces y se equivoca el 10 % de forma silenciosa es más peligroso que uno que se equivoca visiblemente.

Para los trabajadores del conocimiento en finanzas y otros dominios profesionales, el M2.7 introduce capacidades que merecen una atención crítica. El caso demostrativo mostrado por MiniMax se refiere a un análisis de TSMC: partiendo de informes anuales y actas de conferencias de resultados (earnings calls), el modelo construye de forma autónoma un modelo de previsión de ingresos, diseña los supuestos, produce una presentación de PowerPoint basada en plantillas y redacta un informe de análisis de renta variable (equity research) en Word. MiniMax informa de que los profesionales del sector evaluaron el resultado como utilizable como un primer borrador para introducir directamente en los flujos de trabajo posteriores.

Este tipo de aplicación —un agente que produce análisis financieros de forma casi autónoma— abre cuestiones regulatorias nada triviales. La normativa MiFID II exige que los servicios de asesoramiento financiero sean prestados por entidades autorizadas. Un análisis producido por un agente de IA y presentado a un cliente sin la supervisión y divulgación adecuadas puede constituir infracciones normativas. ¿Quién responde por los errores en un modelo financiero generado autónomamente? La respuesta correcta sigue siendo "el humano que decidió usarlo y presentarlo", pero la cadena de responsabilidad se vuelve más sutil a medida que el proceso se automatiza.

El precio sigue siendo el argumento más fuerte

Más allá de todos los discursos sobre la autoevolución, el dato que posiciona más concretamente al M2.7 en el mercado es el coste. El acceso a la API está disponible a 0,30 dólares por millón de tokens de entrada y 1,20 dólares por millón de tokens de salida para la versión estándar, con una versión M2.7-highspeed que ofrece una velocidad superior al mismo precio gracias al almacenamiento en caché automático. El Claude Opus 4.6 cuesta 15 dólares por millón de tokens de entrada y 75 dólares por millón de tokens de salida. La relación es, respectivamente, de 1:50 en la entrada y de 1:62,5 en la salida. Para aplicaciones agénticas que consumen decenas de millones de tokens por ciclo, la diferencia es la que separa un experimento factible de uno económicamente prohibitivo.

Kilo sintetiza bien el posicionamiento práctico: el M2.7 es una opción sólida cuando se trabaja en tareas que premian la recopilación profunda de contexto, refactorizaciones complejas, cambios que afectan a toda la base de código y análisis sistémicos. Para tareas sensibles al tiempo y bien delimitadas, modelos más rápidos y menos intensivos en tokens pueden dar mejores resultados a costes inferiores. No es un sustituto universal, es una herramienta con un perfil preciso.

OpenRoom y la nueva interfaz del agente

Entre las novedades que acompañan al M2.7 se encuentra OpenRoom, un sistema de interacción basado en agentes que MiniMax ha convertido en código abierto. OpenRoom libera la interacción del flujo de texto puro y la sitúa en un espacio de interfaz gráfica de usuario (GUI) web interactiva: los personajes no son prompts estáticos, sino entidades con configuraciones persistentes que interactúan activamente con el entorno, generando retroalimentación visual en tiempo real. La mayor parte del código ha sido escrita por la IA, precisan las notas para desarrolladores del repositorio.

La dirección está clara: MiniMax imagina agentes que habitan espacios, no que solo responden a prompts. Es una visión que tiene implicaciones interesantes para el gaming, la economía de los creadores y, en un plano más delicado, para la dinámica psicológica de la interacción prolongada con entidades artificiales con personalidades persistentes. El riesgo de antropomorfización y apego emocional hacia estos sistemas está documentado por la literatura académica al menos desde el trabajo de Clifford Nass y Byron Reeves en los años noventa sobre la "ecuación de los medios". No es ciencia ficción, es psicología del desarrollo aplicada a sistemas interactivos.

El nudo sin resolver: opacidad, gobernanza y narrativa cultural

Existe una tensión estructural en la forma en que el M2.7 ha sido presentado al mundo, una tensión que vale la pena nombrar explícitamente. MiniMax ha construido una narrativa potente y memorable en torno a la "IA que evoluciona por sí sola", pero ha proporcionado muy pocos detalles técnicos verificables sobre cómo se gobierna esa evolución. No hay un informe técnico público. No hay una divulgación sobre los mecanismos de seguridad del agente autooptimizador. No hay una explicación de cómo se previenen los bucles de optimización que convergen hacia indicadores erróneos o comportamientos emergentes no deseados.

Esto no es necesariamente mala fe: es la norma en el sector. OpenAI, Anthropic y Google no publican informes técnicos exhaustivos sobre todos sus sistemas internos. Pero cuando se afirma explícitamente que un modelo "participa en su propia evolución" y gestiona de forma autónoma ciclos de investigación en ML, el nivel de detalle esperado por la comunidad debería ser proporcionalmente más alto. La diferencia entre un ciclo de optimización controlado y un sistema que escapa de los objetivos definidos por sus creadores es exactamente el tipo de detalle que un informe técnico debería aclarar.

En el frente de la narrativa cultural, vale la pena señalar cómo la prensa tecnológica ha amplificado el aspecto de la autoevolución mucho más allá de lo que los datos justifican. El marco de la "IA que mejora por sí sola" es narrativamente potente porque evoca arquetipos profundos, desde la criatura de Frankenstein al Golem de la tradición judía, pasando por el HAL 9000 de Kubrick, pero las descripciones precisas del fenómeno son mucho más prosaicas: un agente bien diseñado que optimiza una función en una tarea específica en un entorno controlado. La diferencia entre las dos descripciones es la diferencia entre la literatura y la ingeniería. Ambas son útiles, pero no son lo mismo.

La cuestión regulatoria permanece en segundo plano pero no desaparece. La Ley de IA europea (AI Act), en su marco actual, clasifica los sistemas de IA de alto riesgo en función de su dominio de aplicación y su impacto potencial. Un modelo agéntico que participa de forma autónoma en canalizaciones de entrenamiento de otros modelos de IA, o que produce análisis financieros con una supervisión humana reducida, se acerca a categorías que la Ley de IA tiende a mirar con especial atención. Cómo encaja el M2.7 en este marco es una pregunta a la que nadie ha dado todavía una respuesta precisa, ni MiniMax ni los reguladores europeos.

El M2.7 es un modelo genuinamente capaz, con benchmarks independientes que confirman su posición en el grupo de cabeza del panorama actual, un precio que lo hace accesible para proyectos que los modelos de frontera occidentales harían prohibitivos, y un enfoque de la autooptimización que es técnicamente real, aunque menos espectacular de lo que sugiere la narrativa pública. El 30 % de autonomía en el flujo de trabajo de RL interno es un resultado de ingeniería sólido. No es el nacimiento de la IA consciente. Es algo más modesto y más interesante: una señal de que el ciclo de desarrollo de los propios modelos está empezando a incluir a los modelos como participantes activos, con todo lo que ello conlleva en términos de velocidad, escala y necesidad de nuevas herramientas de gobernanza.

La pregunta más relevante que deja abierta el M2.7 no es "¿hasta dónde puede llegar la autoevolución?", sino "¿quién decide qué significa mejorar, y con qué transparencia?". Mientras esa pregunta permanezca sin una respuesta pública y verificable, cada afirmación sobre la IA que aprende de sí misma deberá leerse con curiosidad, rigor y una sana dosis de escepticismo metodológico.