Mistral Devstral 2 y el sueño soberanista de Europa en la IA

El nueve de diciembre de 2025, mientras el mundo de la inteligencia artificial observaba el desafío entre Estados Unidos y China, Mistral AI jugó su carta: Devstral 2, un modelo de 123 mil millones de parámetros pensado para la codificación empresarial. No es solo un lanzamiento más de un gran modelo de lenguaje, sino el intento más ambicioso de Europa por demostrar que la partida global de la IA aún no está cerrada. Mientras Washington pone sobre la mesa los gigantescos presupuestos de OpenAI y Mountain View, y mientras Pekín responde con la ofensiva de Kimi K2 y DeepSeek, la startup francesa fundada por ex investigadores de Google DeepMind y Meta intenta construir una tercera vía: modelos potentes pero compactos, de peso abierto pero comercialmente sostenibles, europeos por ADN pero globales en sus ambiciones.

La pregunta es si este enfoque puede realmente funcionar o si representa un deseo piadoso más de un continente que corre el riesgo de quedarse como espectador en la revolución tecnológica más importante del siglo. Devstral 2 llega en un momento particular: Europa tiene reglas claras con la Ley de IA, tiene financiación considerable a través de Horizonte Europa y French Tech, y tiene talento técnico de primer nivel. Pero sigue dependiendo estructuralmente del hardware de NVIDIA para el entrenamiento y la inferencia, ve a sus mejores cerebros emigrar a Silicon Valley y lucha por crear campeones que puedan competir con los presupuestos multimillonarios de los gigantes estadounidenses. Mistral, valorada en 11.700 millones de euros tras la ronda de Serie C liderada por ASML, se ha convertido en el símbolo de esta contradicción: técnicamente brillante, financieramente sólida para los estándares europeos, pero microscópica si se la compara con sus adversarios de ultramar.

Números de susurrador de código

Empecemos por los datos técnicos, porque es a partir de ahí donde se miden las ambiciones. Devstral 2 es un transformador denso de 123 mil millones de parámetros con una ventana de contexto de 256 mil tokens, un tamaño que permite procesar bases de código enteras sin perder el hilo. La arquitectura densa, a diferencia de las mezclas de expertos que dividen la carga computacional entre subredes especializadas, activa todos los parámetros para cada solicitud. Una elección que sacrifica la eficiencia computacional para maximizar la coherencia en las respuestas, especialmente crítica cuando se trabaja en proyectos de software complejos donde cada pieza de código debe dialogar con el resto.

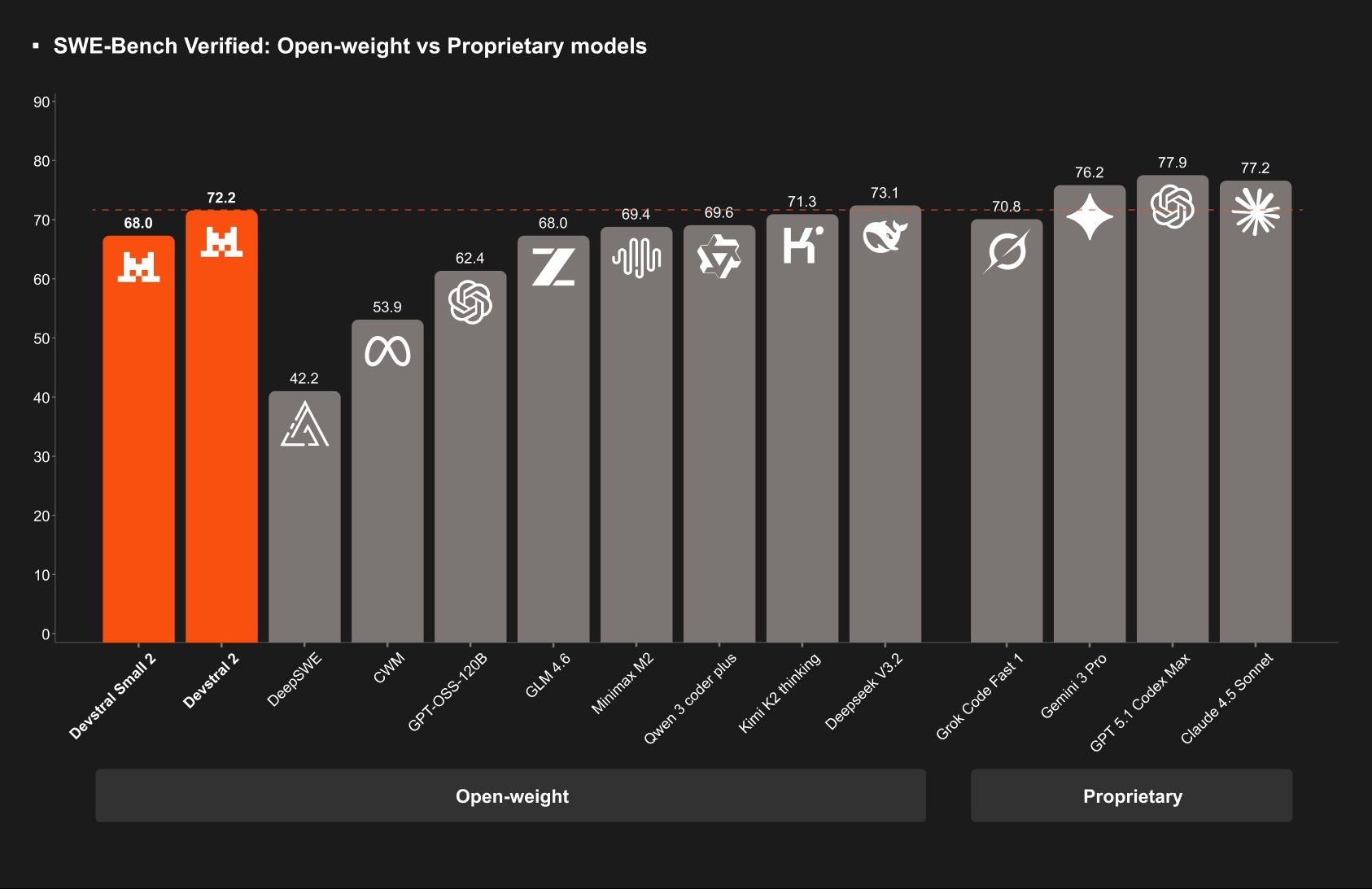

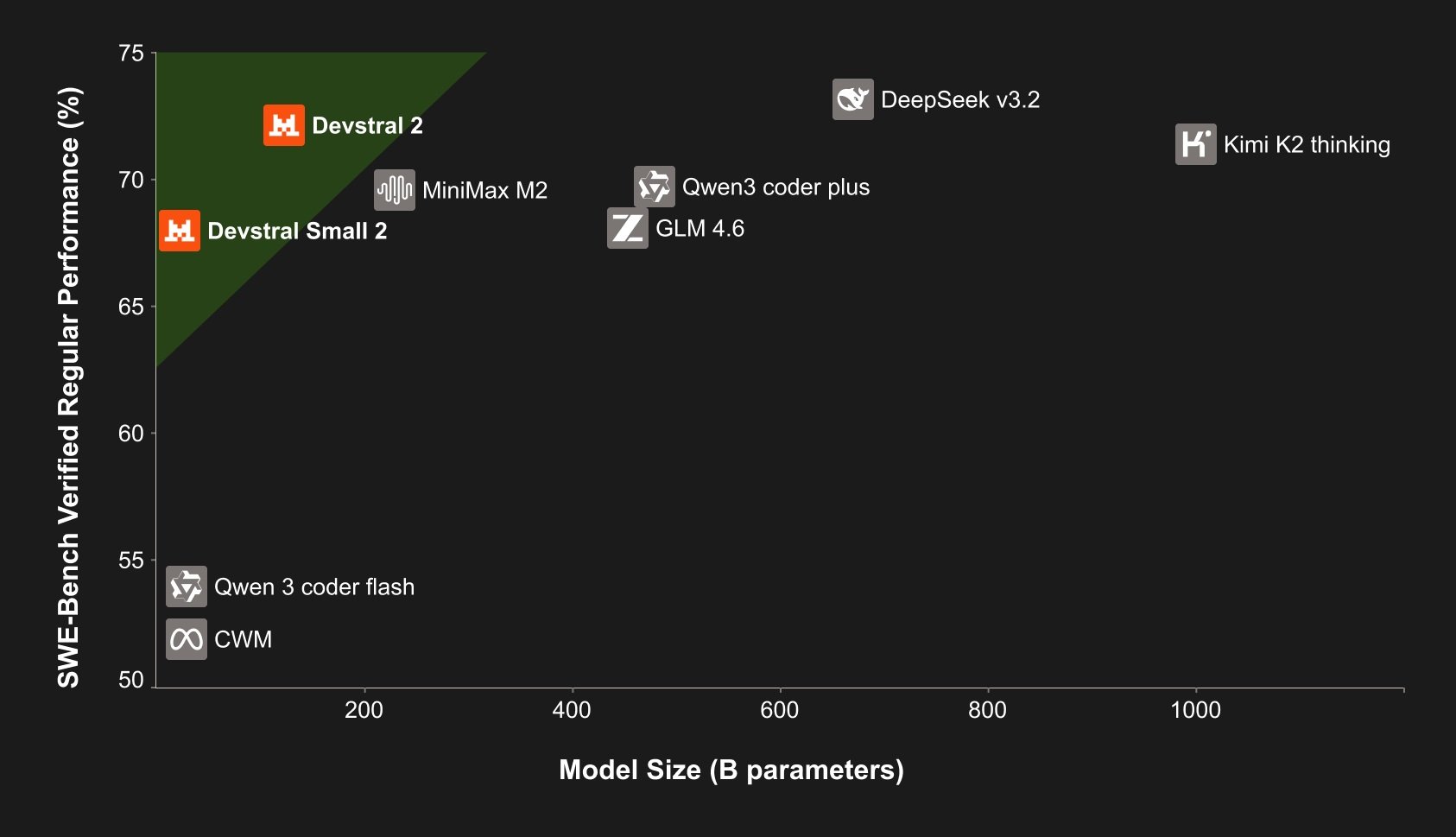

El punto de referencia clave para los modelos de codificación es SWE-bench Verified, una prueba que mide la capacidad de resolver problemas reales extraídos de repositorios de GitHub. Devstral 2 alcanza el 72,2%, un resultado que lo posiciona como el mejor modelo de peso abierto disponible. Para contextualizar: DeepSeek V3.2, el campeón chino de 671 mil millones de parámetros, alcanza el 73,1%, mientras que Kimi K2 Thinking, con sus 1000 mil millones de parámetros distribuidos en una arquitectura de mezcla de expertos, llega al 71,3%. Devstral 2 es cinco veces más pequeño que DeepSeek y ocho veces más compacto que Kimi K2, y sin embargo los sigue de cerca o incluso los supera. Es como ver a un Lotus Elise mantener el ritmo de un Ferrari Enzo en las curvas: lo que cuenta es la relación peso-potencia, no solo los caballos bajo el capó.

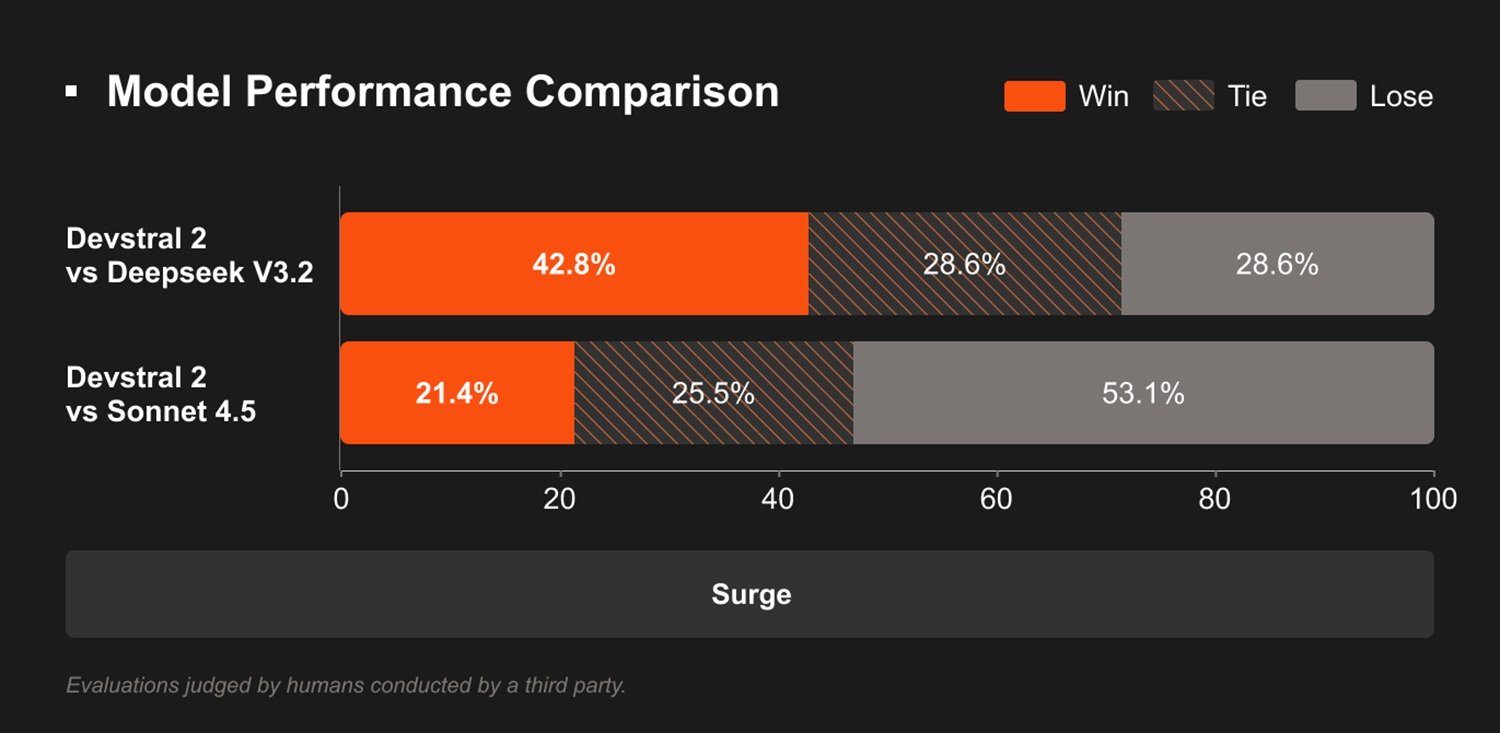

Pero hay una brecha que hay que reconocer honestamente: Claude Sonnet 4.5 de Anthropic alcanza el 77,2% en SWE-bench Verified, mientras que los sistemas más avanzados de OpenAI (GPT 5.1 Codex Max) alcanzan el 77,9%. La distancia entre Devstral 2 y los campeones propietarios estadounidenses existe y no es marginal. La propia Mistral lo admite en las evaluaciones humanas comparativas realizadas a través de Cline, donde Devstral 2 supera a DeepSeek V3.2 con un 42,8% de preferencia frente al 28,6%, pero pierde claramente contra Claude Sonnet 4.5. Europa puede producir modelos competitivos, pero la frontera absoluta sigue siendo, por ahora, prerrogativa de los modelos de código cerrado estadounidenses.

Junto al buque insignia, Mistral también lanza Devstral Small 2, un modelo de 24 mil millones de parámetros que alcanza el 68% en SWE-bench Verified. El interés aquí no está tanto en el rendimiento absoluto, como en la capacidad de despliegue: Small 2 funciona en una sola GPU de consumo de gama alta, lo que hace que la codificación con IA sea accesible incluso para desarrolladores y pequeñas empresas que no pueden permitirse clústeres de H100. Es el mismo principio que hizo de Linux un éxito: llevar las capacidades empresariales al hardware de consumo. En puntos de referencia más estándar como HumanEval y LiveCodeBench, Devstral 2 se comporta en línea con competidores de tamaño similar, lo que confirma que la verdadera innovación no está en inventar nuevas arquitecturas milagrosas, sino en optimizar el entrenamiento para extraer el máximo de modelos más compactos.

Completa el ecosistema Mistral Vibe CLI, un agente de línea de comandos que transforma a Devstral en un asistente de codificación interactivo. Vibe puede explorar bases de código, modificar múltiples archivos, ejecutar comandos de shell y gestionar Git, todo orquestado a través de conversaciones en lenguaje natural. No es la primera CLI de agente del mundo —ya existían herramientas como Cline, Cursor y Kilo Code—, pero es la primera construida específicamente para un modelo de peso abierto europeo, con especial atención a la privacidad y la posibilidad de despliegue on-premise (en las instalaciones). En un continente obsesionado con el RGPD, poder ejecutar un asistente de codificación en sus propios servidores sin enviar una línea de código a las nubes estadounidenses tiene un valor que va más allá de las métricas técnicas.

Abierto pero no demasiado

En cuanto a las licencias, Mistral juega una partida híbrida que revela mucho de su estrategia. Devstral Small 2 se publica bajo la licencia Apache 2.0, el estándar de facto del código abierto empresarial: permite cualquier uso, incluso comercial, solo pide mantener las atribuciones. Es la misma licencia de React, Kubernetes, TensorFlow. Devstral 2, en cambio, utiliza una licencia MIT modificada con un límite de ingresos: si su empresa factura más de 20 millones de dólares al mes, debe negociar una licencia comercial con Mistral. Es una medida que busca equilibrar la accesibilidad para startups e investigadores con la necesidad de monetizar los despliegues empresariales.

Los precios a través de la API siguen una lógica similar: gratis inicialmente, luego 0,40 dólares por millón de tokens de entrada y 2 dólares de salida para Devstral 2, bajando a 0,10 y 0,30 dólares para Small 2. Comparado con Claude Sonnet 4.5 (3 y 15 dólares respectivamente), Mistral cuesta aproximadamente una séptima parte. La empresa francesa declara que Devstral 2 es "hasta 7 veces más rentable que Claude Sonnet para tareas reales", un eslogan que tiene sentido considerando no solo el precio por token, sino también la compacidad del modelo, que requiere menos pasos para completar operaciones complejas.

Esta estrategia híbrida —algunos modelos Apache 2.0, otros con restricciones comerciales, precios agresivos pero no gratis para siempre— recuerda el enfoque de empresas como Red Hat en los años 2000: código abierto donde sea posible, monetización en el soporte empresarial y las funciones avanzadas. Es un modelo que ha funcionado en el software tradicional, pero en la IA la partida es más compleja: los costes de entrenamiento son órdenes de magnitud superiores a los del desarrollo de software, y los competidores propietarios pueden permitirse vender con pérdidas durante años gracias a los botines de guerra de las grandes tecnológicas.

La accesibilidad de los pesos del modelo en Hugging Face y la compatibilidad con marcos estándar como vLLM y Transformers democratizan el acceso, pero también plantean preguntas sobre la sostenibilidad: si cualquiera puede descargar los pesos y hacer inferencia localmente, ¿cómo se financian los ciclos de entrenamiento posteriores? Mistral cuenta con que la mayoría de las empresas preferirán pagar por API gestionadas en lugar de gestionar la infraestructura internamente, siguiendo la misma lógica por la que muchas empresas utilizan AWS en lugar de construir sus propios centros de datos. Pero es una apuesta, no una certeza.

La vía europea según Floridi

Para entender dónde se sitúa Mistral en el debate más amplio sobre la soberanía tecnológica europea, vale la pena volver a las reflexiones de Luciano Floridi, filósofo de la información que enseña entre Yale, Bolonia y Oxford, donde dirigió durante años el Laboratorio de Ética Digital. Floridi, que contribuyó a las directrices éticas de la Comisión Europea para la IA y hoy preside la Fundación Leonardo, ha elaborado en los últimos años una visión particular del papel que Europa podría desempeñar en la carrera por la inteligencia artificial.

Su tesis parte de una constatación incómoda: Europa está sufriendo el reparto del mercado de la IA entre Estados Unidos y China, reduciéndose a espectadora de una partida que se juega en otro lugar. Pero según Floridi, existe una alternativa concreta, que pasa por el código abierto combinado con la fuerza normativa europea. El continente podría transformar lo que se percibe como un obstáculo, la estricta regulación encarnada en la Ley de IA, en un valor diferenciador en el mercado global. Un sello europeo de seguridad normativa, cumplimiento de la protección de datos, transparencia sobre los derechos de autor, todo esto no como una reacción defensiva, sino como una promoción activa del "made in Europe" tecnológico.

La visión de Floridi contempla una dimensión de código abierto europea que podría configurarse como un cuarto polo global, distinto de Estados Unidos, China y el resto del mundo. No se trata de competir frontalmente con los presupuestos estadounidenses o con la escala industrial china, sino de ofrecer algo que ni Washington ni Pekín pueden replicar fácilmente: sistemas de IA abiertos, garantizados por un sólido marco legislativo, con costes competitivos precisamente porque son de código abierto. Es mejor que los chinos porque incorpora reglas éticas y de seguridad por diseño, mejor que los estadounidenses porque es de código abierto en lugar de cerrado y propietario.

La idea es que existe un universo de países y empresas que podrían preferir un sistema de código abierto europeo, garantizado por la legislación de la UE, a un sistema cerrado estadounidense que cuesta cifras prohibitivas y plantea interrogantes sobre la gestión de los datos. Floridi sugiere transformar el momento normativo de un posible freno a un valor añadido: si quien compra inteligencia artificial europea sabe que está construida en un contexto que ofrece garantías adicionales además de un producto a costes súper competitivos, entonces la regulación se convierte en un activo competitivo en lugar de una desventaja.

Esta visión, por muy fascinante que sea intelectualmente, choca con algunas duras realidades. La primera: el hardware. Todos los modelos de Mistral, incluido Devstral 2, se entrenan con GPU de NVIDIA, probablemente H100 o A100, todas diseñadas en California y fabricadas (en el mejor de los casos) en Taiwán. Europa no tiene un equivalente de NVIDIA, y los intentos de crear chips de IA soberanos, como el proyecto respaldado por ASML de la propia Mistral, todavía están en sus fases iniciales. Sin control de la pila de hardware, la soberanía tecnológica sigue siendo parcial.

La segunda realidad: el talento. Mistral fue fundada por investigadores que se formaron y trabajaron en empresas estadounidenses (DeepMind, Meta). El flujo de cerebros sigue siendo predominantemente hacia el oeste, con salarios y oportunidades que Europa lucha por replicar. La tercera: la escala. Incluso considerando la brillante ronda de Serie C de 1.700 millones de euros liderada por ASML, Mistral ha recaudado unos 2.800 millones en total desde su fundación. OpenAI ha recaudado más de 14.000 millones, Anthropic unos 10.000 millones. La disparidad de recursos se traduce en una disparidad en la capacidad de entrenamiento, que a la larga pesa más que el ingenio algorítmico.

Y sin embargo, el enfoque de Mistral tiene méritos innegables. La empresa ha demostrado que es posible construir modelos competitivos con una fracción de los recursos de sus competidores estadounidenses, aprovechando arquitecturas más eficientes y conjuntos de datos más curados. Ha demostrado que el peso abierto no es incompatible con un modelo de negocio sostenible, al menos en teoría. Y ha creado un ecosistema de desarrolladores que no depende de plataformas estadounidenses: Vibe CLI, los pesos en Hugging Face, la integración con vLLM, todo esto crea alternativas concretas a los flujos de trabajo dominados por GitHub Copilot, ChatGPT o Claude.

El punto crucial planteado por Floridi se refiere precisamente a esta posibilidad de construir una alianza entre la regulación inteligente y la innovación de código abierto. Si la Ley de IA se implementara no como una lista de prohibiciones, sino como un marco que certifica la bondad de los sistemas de IA —transparencia, equidad, privacidad por diseño—, entonces las empresas europeas tendrían una ventaja competitiva frente a todos aquellos mercados que miran con recelo a los sistemas estadounidenses (por cuestiones de privacidad y monopolio) o chinos (por cuestiones geopolíticas). Sudamérica, África, parte de Asia, incluso segmentos del mercado estadounidense más sensibles a la privacidad podrían preferir una alternativa europea certificada.

Mistral está intentando exactamente esto: construir sistemas de IA técnicamente competitivos, abiertos donde sea posible, alineados con las normativas europeas por diseño. Devstral 2 no recopila datos de entrenamiento sin consentimiento, no se distribuye para usos militares según sus licencias y respeta los principios de transparencia de la Ley de IA. Son restricciones que otros no tienen o no respetan, pero que podrían convertirse en argumentos de venta en un mercado cada vez más atento a las cuestiones éticas.

La paradoja del campeón local

Sin embargo, hay una paradoja de fondo que ninguna narrativa entusiasta puede ocultar por completo. Mistral AI, con su valoración de 11.700 millones de euros y sus aproximadamente 500 empleados, es el mayor unicornio de IA de Europa. Pero en el contexto global, sigue siendo una startup de tamaño mediano. OpenAI está valorada en más de 150.000 millones de dólares y emplea a miles de personas. Anthropic ronda los 18.000 millones de valoración. Google DeepMind tiene recursos esencialmente ilimitados. Incluso los competidores chinos como DeepSeek operan con el respaldo implícito o explícito del estado chino, que considera la IA una cuestión de seguridad nacional.

La geografía del talento de la IA cuenta una historia similar. Los tres fundadores de Mistral, Arthur Mensch, Guillaume Lample y Timothée Lacroix, se formaron y adquirieron una experiencia crítica en Google DeepMind y Meta AI Research, respectivamente. El modelo es similar al de Anthropic, fundada por ex empleados de OpenAI, o al de Cohere, fundada por ex empleados de Google Brain. Los mejores laboratorios de investigación siguen concentrados en California, e incluso cuando surgen excelencias europeas como DeepMind (británica) o Mistral (francesa), acaban siendo adquiridas (DeepMind por Google) o fuertemente influenciadas por inversores estadounidenses (Mistral tiene entre sus inversores a Andreessen Horowitz, General Catalyst, Lightspeed, NVIDIA).

En cuanto a los clientes empresariales, Mistral ha obtenido contratos significativos: el Ministerio de Defensa francés, BNP Paribas, Orange, CMA-CGM por 100 millones de euros en cinco años. Son victorias importantes que demuestran el atractivo del producto. Pero si se mira la escala, Microsoft y OpenAI tienen acuerdos con prácticamente todas las empresas de Fortune 500, Google Cloud integra sus propios modelos en decenas de miles de empresas, y AWS ofrece Bedrock con modelos de Anthropic. El mercado empresarial global ya está en gran parte dominado por los gigantes estadounidenses, y desbancarlos requiere no solo mejores productos, sino ecosistemas completos: herramientas de desarrollo, integraciones, soporte, un ecosistema de socios.

La dependencia de NVIDIA es quizás el aspecto más llamativo. La ronda de Serie C liderada por ASML, el fabricante holandés de máquinas de litografía EUV (ultravioleta extremo) esenciales para fabricar chips avanzados, señala la voluntad de construir una cadena de suministro más europea. Pero la propia ASML depende de componentes estadounidenses y japoneses, y en cualquier caso, el camino para producir GPU de IA competitivas con las de NVIDIA requiere años, si no décadas. Mientras tanto, cada modelo de Mistral se entrena con silicio estadounidense, creando una dependencia estructural que ninguna narrativa soberanista puede realmente eludir.

Luego está la cuestión de los conjuntos de datos. Los modelos de IA se alimentan de datos, y la mayoría de los datos de calidad —código de código abierto en GitHub, contenido web, conversaciones— se produce en ecosistemas dominados por plataformas estadounidenses. GitHub pertenece a Microsoft, Reddit tiene acuerdos de licencia con OpenAI, Stack Overflow ha vendido los datos de su comunidad. Europa produce contenido de calidad, pero no controla las plataformas donde este contenido se agrega y estructura. También aquí, la soberanía tecnológica resulta ser parcial.

Y sin embargo, a pesar de todas estas paradojas y limitaciones estructurales, el experimento de Mistral sigue siendo significativo. Demuestra que es posible construir tecnología de IA de frontera fuera de Silicon Valley, que el código abierto puede coexistir con modelos de negocio sostenibles, y que existen talentos y capitales europeos dispuestos a apostar por este desafío. Devstral 2, con su rendimiento competitivo y sus 123 mil millones de parámetros concentrados en un paquete eficiente, es la prueba más tangible de que Europa puede jugar esta partida.

La pregunta abierta es si puede ganarla. O si, de forma más realista, puede hacerse con un espacio lo suficientemente grande como para garantizar que el futuro de la IA no sea un duopolio entre Estados Unidos y China. La vía europea imaginada por Floridi —la regulación como activo, el código abierto como diferenciador— es una apuesta intelectualmente coherente. Pero las apuestas, por definición, se pueden ganar o perder. Y en este momento, con los recursos desplegados sobre la mesa, la propia mesa sigue dominada por jugadores que hablan inglés y mandarín.

Mientras tanto, para los desarrolladores europeos y para las empresas que quieren alternativas a los sistemas propietarios estadounidenses, Devstral 2 representa una opción concreta. Un modelo de peso abierto que puedes ejecutar en tus propios servidores, inspeccionar, modificar, integrar en tus flujos de trabajo sin depender de API controladas por otras empresas. No es la solución definitiva al problema de la soberanía tecnológica, pero es un paso en la dirección correcta. En un sector que corre a la velocidad de la luz, incluso un paso puede marcar la diferencia entre seguir en la carrera o quedarse definitivamente descolgado del grupo de cabeza.

El desafío para Mistral en los próximos años será doble: seguir produciendo modelos que sigan el ritmo de los avances de OpenAI, Anthropic y DeepSeek, y al mismo tiempo construir un ecosistema europeo lo suficientemente fuerte como para no ser absorbido o marginado por los gigantes globales. Devstral 2 es un buen comienzo, pero es solo el principio. El resto de la historia lo escribirán los próximos lanzamientos, las próximas asociaciones y, sobre todo, la capacidad de Europa para transformar la visión de Floridi —regulación ilustrada más innovación de código abierto— de un concepto filosófico a una realidad industrial. En una partida donde cada movimiento cuenta, y donde el tiempo disponible podría ser menor de lo que pensamos.