Vuestro modelo, vuestras reglas: Mistral Forge y la IA propietaria

Hay un equívoco sutil en el corazón de cómo la mayoría de las empresas usan la inteligencia artificial hoy en día. Envían prompts a modelos entrenados en miles de millones de páginas de internet, libros, artículos, foros y código público en GitHub, y esperan respuestas calibradas según su realidad interna. Pero esa realidad interna —los procedimientos operativos de una empresa farmacéutica, los manuales de mantenimiento de una turbina, los contratos tipo de un bufete de abogados milanés, las políticas de cumplimiento de un banco— nunca ha entrado en ningún conjunto de datos de entrenamiento. Es como pedirle a alguien que ha leído toda la enciclopedia Treccani que explique cómo funciona el proceso de aprobación interna de una solicitud de vacaciones en vuestra empresa. La respuesta será genérica, educada e inútil.

Mistral AI eligió el escenario del Nvidia GTC 2026, la conferencia anual de Jensen Huang donde este año se ha hablado casi exclusivamente de IA agentiva para la empresa, para anunciar Forge: un sistema que permite a las organizaciones entrenar modelos de lenguaje directamente sobre su propio conocimiento institucional. No se trata de un nuevo chatbot, ni de una herramienta para optimizar los prompts. Es algo estructuralmente diferente, y merece la pena entender exactamente qué, porque las implicaciones técnicas, económicas y geopolíticas son de todo menos triviales.

Qué hace Forge, en concreto

Para entender Forge, primero hay que entender qué lo distingue de las herramientas de personalización de la IA ya existentes. La gran mayoría de las soluciones empresariales hoy en día trabajan de dos maneras: la Generación Aumentada por Recuperación (RAG), donde el modelo no se toca pero se le "informa" en el momento de la respuesta recuperando documentos relevantes de una base de datos, o el ajuste fino (fine-tuning) superficial, donde se reentrena el modelo en un pequeño conjunto de datos específico para adaptar ligeramente su comportamiento. Ambos enfoques dejan el modelo base inalterado. Es como alquilar un apartamento y traer vuestros propios muebles: el edificio no cambia, solo cambia la decoración.

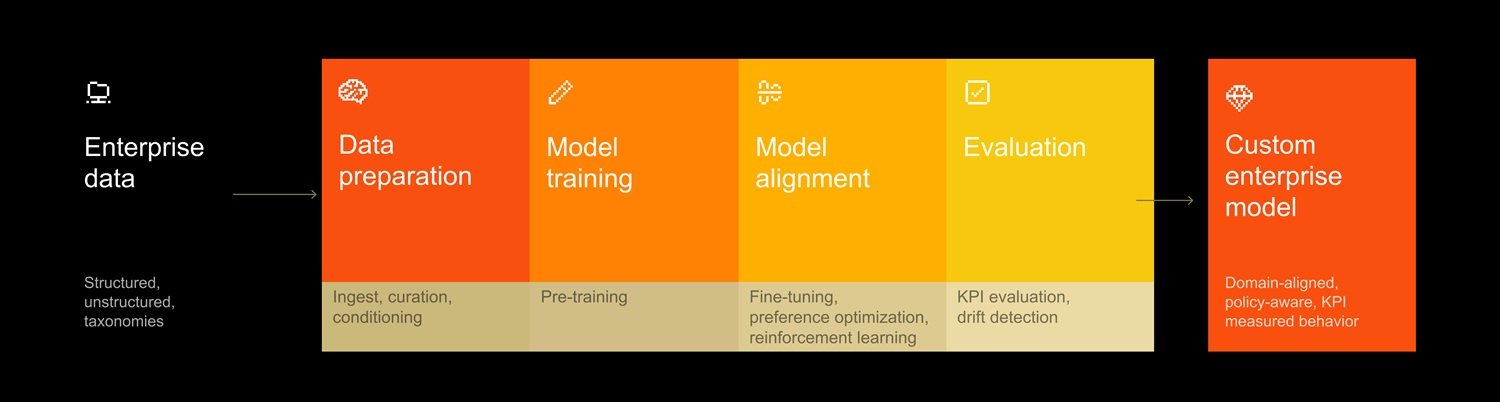

Forge propone algo radicalmente diferente: construir el edificio desde cero, siguiendo vuestras propias especificaciones. La página del producto describe un proceso articulado en varias fases del ciclo de vida del modelo. El preentrenamiento, la fase más profunda, permite entrenar el modelo sobre grandes volúmenes de documentación interna no estructurada, bases de código empresariales, datos operativos y archivos históricos, de modo que el modelo no se limite a consultar ese conocimiento, sino que lo interiorice en su funcionamiento básico. Es la diferencia entre un médico que lee una historia clínica antes de una visita y un médico que ha pasado diez años trabajando en ese departamento específico.

Junto al preentrenamiento, Forge ofrece herramientas de post-entrenamiento para refinar el comportamiento en tareas específicas, el Ajuste Fino Supervisado (SFT) y la Optimización de Preferencias Directas (DPO) para codificar preferencias y estándares internos, y la Adaptación de Bajo Rango (LoRA) para adaptaciones más ligeras sin reentrenar todo el modelo. El tercer pilar del sistema es el Aprendizaje por Refuerzo: a través de flujos de RLHF, las organizaciones pueden alinear el comportamiento del modelo con sus propias políticas operativas y criterios de evaluación, y mejorar el rendimiento de los agentes en entornos complejos, desde la orquestación de flujos de trabajo hasta el uso de herramientas y la toma de decisiones. Todo esto se completa con herramientas de generación de datos sintéticos, fundamentales para cubrir esos casos límite que rara vez surgen en los datos reales pero que marcan la diferencia en producción, y con marcos de evaluación vinculados a los KPI internos de la empresa, no a los benchmarks genéricos con los que se miden los modelos en el mundo académico.

Un detalle técnico que cuenta para las elecciones arquitectónicas es el soporte tanto para modelos densos como para arquitecturas de Mezcla de Expertos (MoE). Como ya se analizó al hablar de Devstral 2, las arquitecturas MoE activan solo un subconjunto de "subredes especializadas" para cada petición, logrando capacidades comparables a modelos mucho más grandes con latencia y costes computacionales inferiores. Para una empresa que debe decidir si invertir en un modelo denso de alta calidad o en un MoE más eficiente, esta flexibilidad no es un detalle cosmético. Forge también admite entradas multimodales —texto, imágenes, audio— cuando el caso de uso lo requiere.

En el frente de la agentividad, Forge ha sido diseñado para funcionar con Mistral Vibe, el agente autónomo de Mistral que puede usar la plataforma para realizar ajustes finos, encontrar hiperparámetros óptimos, programar tareas y generar datos sintéticos de forma autónoma. El sistema monitoriza las métricas para evitar regresiones en los benchmarks relevantes, y toda la interfaz está diseñada para ser accionable en lenguaje natural, incluso por parte de agentes no humanos.

Mistral ya ha puesto Forge a disposición de un grupo de socios seleccionados: ASML (el fabricante neerlandés de máquinas de litografía EUV, que lideró la ronda Series C de Mistral), Ericsson, la Agencia Espacial Europea, DSO National Laboratories, HTX Singapur y Reply, la consultora tecnológica italiana. Son nombres que cubren sectores muy diferentes: telecomunicaciones, defensa y seguridad, aeroespacial, fabricación de precisión y consultoría tecnológica. El abanico no es casual: Mistral quiere demostrar que Forge responde a necesidades industriales concretas, no a casos de uso de laboratorio.

La comparativa: dónde termina el fine-tuning y dónde empieza Forge

Para entender dónde se posiciona Forge respecto al ecosistema existente, conviene hacer un ejercicio comparativo honesto, empezando por los competidores más relevantes.

OpenAI ofrece ajustes finos en GPT-4o y otros modelos de la familia, pero se trata de una adaptación del modelo base de OpenAI, no de un entrenamiento desde cero sobre una arquitectura a elección del cliente. Es una opción más accesible, rápida y con barreras de entrada mucho más bajas, pero estructuralmente limitada: se trabaja siempre dentro de los límites del modelo base, que sigue siendo propiedad de OpenAI y puede ser descatalogado, modificado o su precio puede cambiar sin que el cliente tenga voz ni voto. La distancia conceptual con Forge es la que hay entre personalizar un software SaaS y desarrollar vuestra propia aplicación.

Anthropic con Claude no ofrece el reentrenamiento del modelo base: el paradigma es el de las "skills" y la integración contextual mediante system prompts y RAG. Es un enfoque más ágil y accesible, pero diseñado explícitamente para adaptar el comportamiento en tiempo de ejecución, no para modificar el conocimiento fundamental del modelo. Google con Vertex AI ofrece capacidades de entrenamiento personalizado, incluso partiendo de cero sobre arquitecturas propias, pero la plataforma está históricamente orientada al aprendizaje automático tradicional más que a los grandes modelos de lenguaje agentivos, y la integración con herramientas agent-first es menos madura de lo que Forge declara.

La otra alternativa significativa es la del entrenamiento local sobre modelos open-weight, que da el máximo control sobre toda la cadena, desde el hardware hasta el modelo y los datos. Pero la diferencia con Forge reside en la escala y la experiencia requerida. El preentrenamiento de un modelo de dimensiones empresariales requiere clústeres de GPU de cientos de unidades, conjuntos de datos curados en el orden de los terabytes y competencias específicas que muy pocas empresas pueden permitirse construir internamente. Como se documentó en el análisis sobre los SLM, incluso un ajuste fino en un modelo de 7 mil millones requiere equipos y competencias no triviales: escalar a un preentrenamiento completo es un salto de órdenes de magnitud. Forge se posiciona como el servicio gestionado que elimina esta barrera, delegando la infraestructura y el conocimiento técnico en Mistral mientras la empresa aporta el conocimiento de dominio y los datos.

Sobre este punto, Timothée Lacroix, cofundador y director tecnológico de Mistral, fue explícito con TechCrunch: el cliente decide el modelo y la infraestructura, pero Mistral asesora y acompaña. Y para los equipos que necesitan más que una consultoría, Forge se proporciona con ingenieros "forward-deployed", una figura que Mistral ha tomado prestada explícitamente de los manuales de Palantir e IBM: profesionales técnicos que se integran directamente en los equipos del cliente para supervisar la construcción de los flujos de datos, la definición de las evaluaciones y la calibración del proceso de entrenamiento. Es un modelo de entrega que admite implícitamente que la tecnología por sí sola no basta.

Ventajas reales, criticidades reales

Una vez descritas las herramientas, conviene analizar con honestidad qué promete Forge y dónde surgen las preguntas que siguen abiertas.

La ventaja más estructural es el control de la propiedad intelectual. Un modelo entrenado sobre los datos internos de una empresa codifica de forma permanente ese conocimiento en su arquitectura, no como una referencia externa consultable, sino como parte integrante del razonamiento. Esto cambia profundamente la naturaleza de los agentes de IA que se construyen sobre ese modelo: en lugar de agentes que recuperan información de bases de datos y la incorporan en las respuestas, se obtienen agentes que razonan usando el vocabulario, los patrones de decisión y las restricciones operativas de la organización como punto de partida natural. Para flujos de trabajo críticos, el comportamiento resultante es más predecible, más fiel a los procedimientos internos y menos propenso a las alucinaciones que surgen cuando un modelo generalista intenta aplicar razonamientos genéricos a contextos altamente específicos.

Para sectores donde el idioma no es el inglés, o donde se opera con terminologías especializadas que no existen en los corpus públicos de entrenamiento, la ventaja del preentrenamiento sobre datos propietarios es aún más marcada. Un modelo entrenado sobre años de normativa regulatoria italiana comprende los matices del derecho administrativo italiano no porque alguien se los haya explicado en tiempo de ejecución, sino porque los ha "leído" durante el entrenamiento con la misma profundidad con la que ha leído cualquier otro texto.

Las criticidades, sin embargo, merecen la misma atención. La primera se refiere a los datos mismos. Forge requiere grandes volúmenes de documentación interna estructurada y de calidad para producir resultados significativos. En la práctica, muchas organizaciones se encuentran con archivos históricos desiguales, documentos en formatos heterogéneos, datos no normalizados y versiones contradictorias de las mismas políticas. El "garbage in, garbage out" se aplica con más fuerza aún al entrenamiento que al RAG: un modelo preentrenado sobre datos de mala calidad no los recupera en tiempo de ejecución, los interioriza. El riesgo de sobreajuste (overfitting) sobre un corpus demasiado restringido o sobre políticas obsoletas es real, y el proceso de limpieza y curación del conjunto de datos suele ser tan costoso como el entrenamiento mismo.

La segunda criticidad se refiere a los costes y las competencias. El preentrenamiento de modelos de dimensiones empresariales en clústeres de GPU de gama alta tiene costes que difícilmente se justifican para entidades medianas. Mistral aún no ha publicado una estructura de precios detallada para Forge, el servicio está actualmente disponible bajo petición directa, y esto dificulta una evaluación concreta de los retornos de la inversión para un CFO que debe aprobar el presupuesto. Los FDE incluidos en el servicio resuelven parte del problema de las competencias internas, pero introducen una dependencia humana y organizativa que tiene sus propios costes de gestión.

La tercera cuestión, probablemente la más delicada para quienes deben tomar decisiones a nivel directivo, se refiere a la infraestructura. La página del producto Forge habla de "infrastructure flexibility" y promete despliegues sin "cloud lock-in". Pero leyendo atentamente la documentación disponible, la distinción que surge es entre la flexibilidad en la inferencia, donde el modelo resultante puede efectivamente desplegarse en una nube privada, on-premise, o en la infraestructura de Mistral Compute a elección del cliente, y la fase de entrenamiento, sobre la que Mistral no hace explícitas públicamente las opciones de despliegue. Considerando que el preentrenamiento de un modelo de dimensiones significativas requiere clústeres de cientos de GPU H100 o equivalentes, y es altamente improbable que incluso los socios más grandes como ASML o Ericsson tengan esta infraestructura in-house para un proyecto de este tipo, es razonable hipotetizar que al menos la fase de entrenamiento ocurra en la infraestructura de Mistral. Pero, es importante precisarlo, se trata de una evaluación basada en consideraciones técnicas y en lo que Mistral no dice, no en declaraciones explícitas. Mistral ni confirma ni desmiente esta lectura en la documentación pública disponible. Quien evalúe Forge para datos particularmente sensibles haría bien en aclarar este punto contractualmente antes de proceder.

Europa en el ojo del huracán de la IA

Forge no ha sido anunciado en el vacío. El momento elegido en el Nvidia GTC 2026 es un posicionamiento explícito: Mistral se presenta en el escenario de la conferencia más influyente del sector, ante los principales actores del ecosistema de IA global, con un producto que compite directamente con las ofertas empresariales de OpenAI y Google Cloud. Es un acto de desafío lúcido, no de improvisación.

Como se analizó en mi artículo anterior a propósito de Devstral 2, Mistral se encuentra en una posición estructuralmente paradójica: es la demostración más convincente de que Europa puede producir IA de frontera, y es al mismo tiempo una empresa de tamaño medio que opera con recursos incomparables respecto a sus rivales estadounidenses. La valoración de 11.700 millones de euros alcanzada con la ronda Series C liderada por ASML es un hito notable para los estándares europeos y microscópica respecto a la valoración de OpenAI, que supera los 150.000 millones de dólares. La proyección de superar los mil millones de dólares de ARR (Ingresos Anuales Recurrentes) en 2026, de la que ha informado el Financial Times, señala una tracción comercial real, pero no resuelve la asimetría de escala.

En este contexto, Forge tiene una lectura geopolítica que va más allá del producto mismo. Para una empresa europea que entrena a sus clientes para construir modelos propietarios, la cuestión de la soberanía sobre los datos es tanto un argumento de venta como un compromiso político. El GDPR garantiza un marco normativo que los proveedores estadounidenses deben respetar pero que no han ayudado a construir. Mistral, como entidad francesa sujeta al derecho europeo, ofrece garantías estructurales diferentes sobre cómo se tratan los datos durante el entrenamiento, aunque, como hemos visto, los detalles técnicos de la infraestructura en la que ocurre ese entrenamiento sigan siendo parcialmente opacos.

El punto que conviene no romantizar es que la dependencia del hardware de NVIDIA sigue intacta. Cada modelo de Mistral, incluido Forge, se entrena en GPU diseñadas en California, lo que significa que la "soberanía tecnológica europea" es inevitablemente parcial mientras Europa no tenga un equivalente de la cadena productiva de chips de IA. ASML, que fabrica las máquinas de litografía EUV sin las cuales no se puede fabricar ningún chip avanzado, es una pieza fundamental, pero el camino desde ASML hasta una GPU de IA europea competitiva es todavía largo.

Las preguntas que quedan abiertas

Forge es un producto interesante y técnicamente ambicioso. Pero algunas preguntas se quedan sin respuesta, y son preguntas que quienes deben tomar decisiones concretas harían bien en tener presentes.

La más urgente se refiere a la transparencia de la infraestructura de entrenamiento: ¿dónde ocurre físicamente el entrenamiento del modelo? ¿Qué garantías contractuales existen sobre el aislamiento de los datos durante el entrenamiento? ¿Qué certificaciones de seguridad cubren los datos durante ese proceso? Al no existir todavía una documentación pública detallada sobre estos aspectos, la respuesta hoy es: hay que preguntárselo directamente a Mistral y ponerlo por escrito.

La segunda pregunta se refiere a la sostenibilidad económica del modelo para organizaciones de tamaño medio. Forge parece hoy optimizado para grandes entidades con presupuestos, conjuntos de datos y una complejidad operativa que justifican una inversión de esta envergadura. ¿Qué pasará cuando, o si, Mistral decidiera extender Forge hacia el mercado de las medianas empresas? El precio y las modalidades de acceso podrían cambiar significativamente respecto al enfoque consultivo actual.

La tercera pregunta es sobre el ciclo de vida del modelo a lo largo del tiempo. Un modelo entrenado hoy sobre los datos de una organización empieza a divergir de la realidad operativa desde el mismo momento del despliegue, porque las organizaciones cambian, las normativas se actualizan y los procesos evolucionan. Forge incluye herramientas de detección de desviación (drift detection) y flujos de mejora continua mediante RL, pero ¿qué tan sostenible es efectivamente mantener un modelo propietario actualizado frente a un modelo externo que otro actualiza continuamente? Es un coste oculto que no aparece en los comunicados de prensa.

La cuarta, y quizás más fundamental, es la pregunta sobre el lock-in. Construir un modelo profundamente integrado con el conocimiento institucional de una organización es, por definición, una inversión de la que es difícil dar marcha atrás. Si Mistral cambiara de estrategia, fuera adquirida o simplemente decidiera modificar las condiciones del servicio, ¿qué tan difícil sería extraer y reutilizar ese conocimiento codificado? Es la versión de IA de una pregunta que las empresas ya se han planteado con las bases de datos propietarias, los CRM y los software ERP: cada herramienta que se convierte en infraestructura crítica se convierte también en un riesgo de dependencia.

En resumen, Forge es una respuesta seria a un problema serio. La idea de que los modelos de IA deben aprender a razonar con el conocimiento específico de quien los usa, y no simplemente a consultarlo, es conceptualmente sólida y probablemente representa una dirección importante para la adopción empresarial de la IA en los próximos años. Las preguntas abiertas no niegan esto, lo hacen más necesario.