100 millones de tókenes: ¿memoria o espejismo?

Intentemos razonar mediante imágenes. Cien millones de tókenes no es un número che el cerebro humano logre visualizar espontáneamente, así que necesitamos un ancla. Un tóken, en el lenguaje de los modelos lingüísticos, corresponde aproximadamente a tres cuartas partes de una palabra inglesa. Diez mil tókenes son más o menos setenta y cinco páginas de texto. Un millón de tókenes representa la *Recherche completa de Proust, esa obra en siete volúmenes que casi todo el mundo finge haber leído. Diez millones de tókenes cubren toda la obra de Shakespeare más la Biblia más alguna enciclopedia de tamaño medio. Cien millones de tókenes son algo del orden de una pequeña biblioteca universitaria, digamos sesenta mil novelas de longitud media cargadas en un único contexto activo, disponibles simultáneamente para un modelo lingüístico que responde a preguntas.*

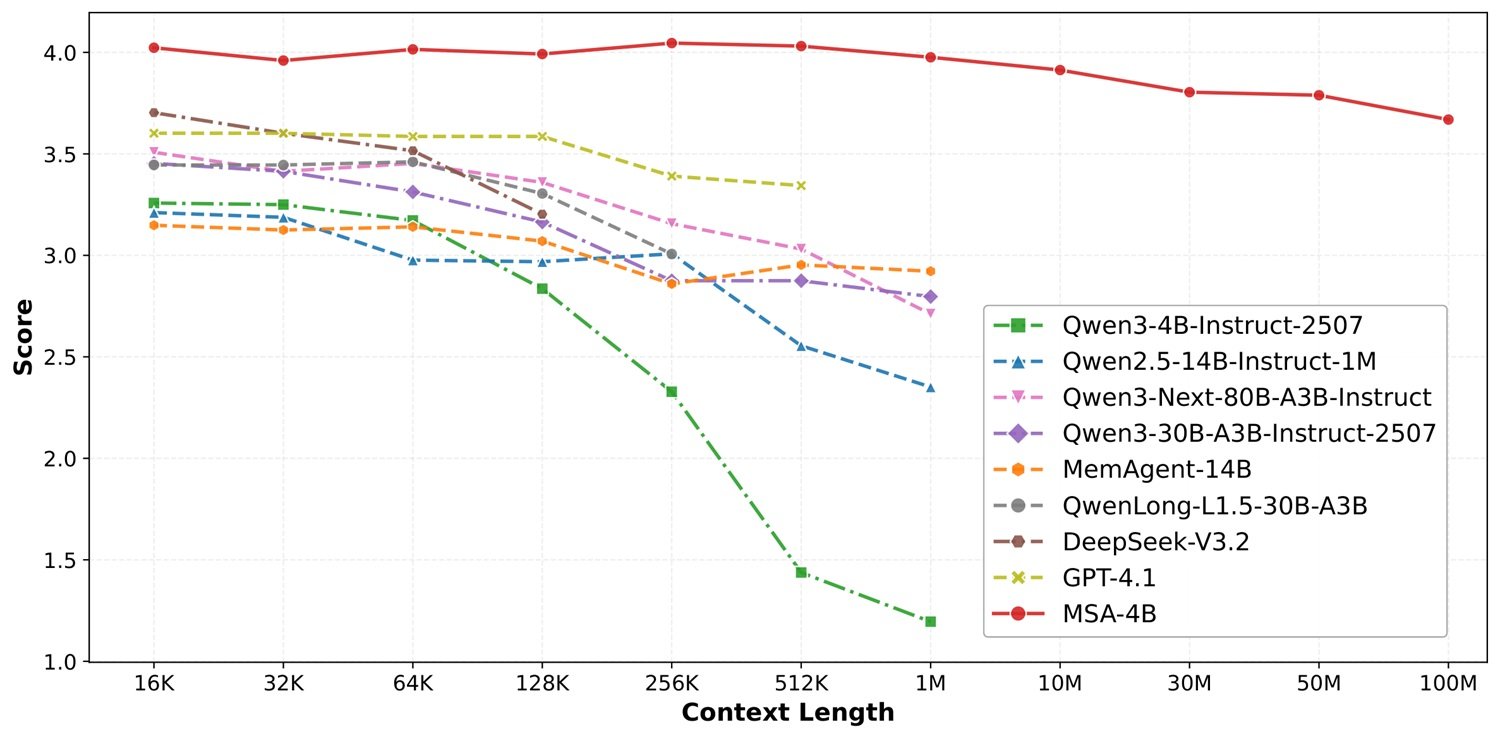

Esta es la afirmación central del proyecto Memory Sparse Attention (MSA), publicado por el equipo de EverMind en marzo de 2026 en Zenodo y acompañado de un repositorio GitHub que actualmente cuenta con más de 3000 estrellas. La declaración es clara: una arquitectura capaz de escalar la memoria contextual hasta los 100 millones de tókenes manteniendo menos del 9% de degradación del rendimiento respecto al punto de partida. Para quienes trabajáis con modelos lingüísticos en 2026, donde el límite práctico de la atención plena se sitúa todavía entre los 128.000 y el millón de tókenes antes de que las cosas empiecen a deteriorarse seriamente, esta es una cifra que merece atención. También merece algunas preguntas.

El cuello de botella que lo frena todo

Para entender qué propone MSA, primero debéis entender por qué existe el problema. Los Transformers, la arquitectura en la que se asientan prácticamente todos los grandes modelos lingüísticos contemporáneos, tienen un defecto estructural conocido: la atención de densidad completa escala de forma cuadrática respecto a la longitud del contexto. En términos prácticos, esto significa que duplicar el contexto no duplica el coste computacional, lo cuadriplica. A los 128.000 tókenes la situación ya es exigente; al millón se vuelve prohibitiva; a los cien millones es simplemente imposible con la arquitectura estándar, independientemente de la cantidad de GPU que pongáis en juego.

Las soluciones existentes se dividen a grandes rasgos en tres familias, ninguna de las cuales es satisfactoria. La primera es la compresión de los estados latentes, como en las arquitecturas lineales o híbridas (Mamba, Jamba y similares), que reducen la complejidad computacional pero tienden a perder información progresivamente, como una fotocopia de una fotocopia de una fotocopia. La segunda es la memoria externa mediante RAG (Retrieval-Augmented Generation): se mantiene fuera del contexto activo un corpus de documentos y se recuperan las piezas relevantes en el momento de la consulta. Funciona, ya está en producción en todas partes, pero introduce una discontinuidad estructural: la recuperación y la generación son dos sistemas separados, entrenados por separado, optimizados por separado, y esta separación tiene un coste en términos de coherencia y razonamiento multi-hop. La tercera familia es la extensión bruta del contexto, que sufre todos los problemas cuadráticos mencionados anteriormente.

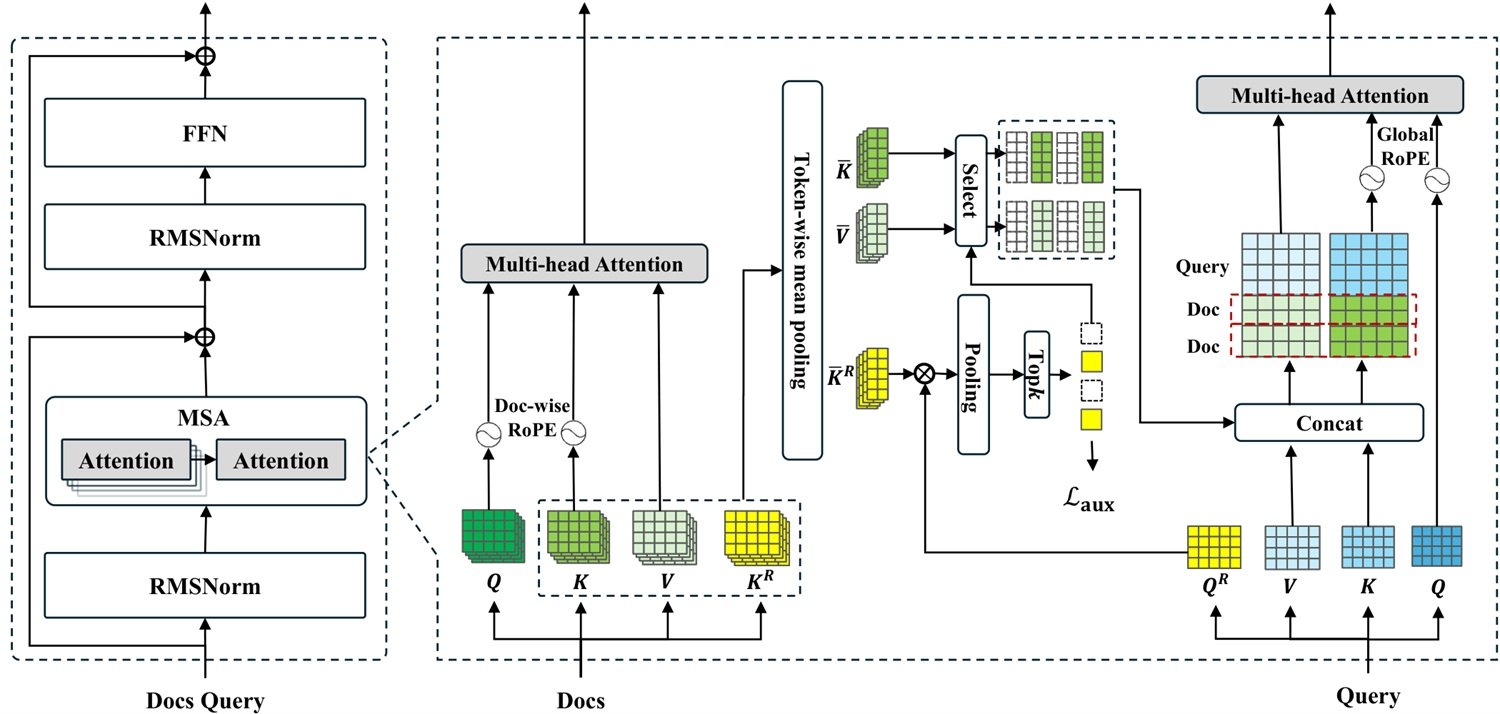

MSA se propone ocupar un cuarto espacio, hasta ahora poco explorado: un mecanismo de atención dispersa entrenado end-to-end, que integra la recuperación (retrieval) directamente en la arquitectura del Transformer sin romper la cadena diferenciable. La intuición es brillante. La ejecución requiere examen.

El cerebro a dos velocidades

La arquitectura MSA se inspira, al menos metafóricamente, en algo similar a la distinción neuropsicológica entre memoria de trabajo y memoria a largo plazo. No es una novedad conceptual absoluta, pero la forma en que se implementa tiene algunas características originales.

El punto de partida es la separación física de la memoria. Cuando MSA procesa un documento, el modelo produce tres tipos de representaciones comprimidas: las routing keys (Kᵣ), las content keys (K̄) y los content values (V̄). Las routing keys son vectores muy comprimidos, ligeros, pensados para hacer una sola cosa: responder rápidamente a la pregunta "¿es este documento relevante para la consulta actual?". Su lugar está en la VRAM de la GPU, donde la latencia de acceso es del orden de los microsegundos. El contenido completo, llaves y valores K̄/V̄, se traslada en cambio a la RAM de sistema de la CPU, mucho más abundante y mucho menos costosa, pero más lenta. Cuando el router decide que un documento es relevante, solo entonces ese contenido se transfiere de la RAM a la VRAM para participar en el cálculo de la atención.

Este esquema, que el equipo llama Memory Parallel, permite distribuir la fase de routing en varias GPU en paralelo: cada una gestiona una porción de las routing keys, las consultas se transmiten en broadcast, se agregan las puntuaciones de relevancia y solo se cargan efectivamente los documentos top-k seleccionados. Todo ello, sostienen los autores, en una configuración de solo dos GPU NVIDIA A800.

El segundo elemento arquitectónico relevante es la document-wise RoPE, una variante de las embeddings de posición rotacionales (RoPE) utilizadas en los Transformers modernos. El problema con la RoPE estándar en contextos larguísimos es que el modelo, entrenado en secuencias cortas, "no sabe" cómo interpretar las posiciones muy altas que aparecen durante la inferencia en contextos largos, con la consiguiente degradación del rendimiento. La solución propuesta por MSA es simple: el contador de posición se pone a cero al principio de cada documento. Cada texto comienza siempre desde la posición cero, independientemente de cuántos documentos lo precedan en la memoria. Esto permite que un modelo entrenado en secuencias de 64.000 tókenes extrapole hasta 100 millones sin ver nunca posiciones fuera de distribución.

La elección es inteligente, pero introduce una consecuencia que vale la pena notar: los documentos en la memoria se vuelven, desde el punto de vista posicional, indistinguibles entre sí en orden. El modelo sabe qué hay dentro de cada documento, pero no tiene una señal posicional que indique qué documento es "más reciente" o "más antiguo" en la secuencia temporal absoluta. Para aplicaciones donde el orden cronológico importa, este es un límite real que el artículo reconoce solo implícitamente.

Memory Interleave: ¿razonamiento o recuperación inteligente?

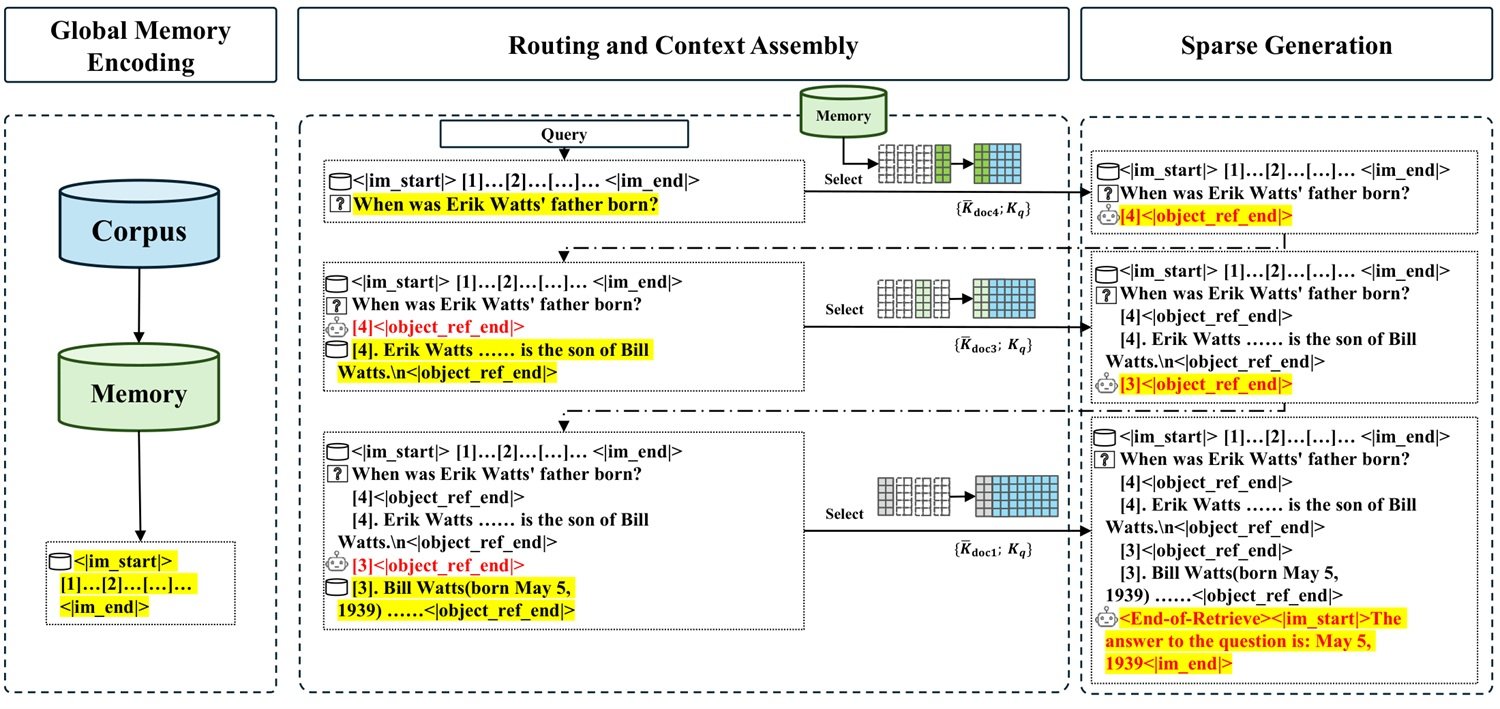

El tercer pilar de la arquitectura es probablemente el más interesante desde el punto de vista del razonamiento, y también el que plantea las preguntas más difíciles. Se llama Memory Interleave y aborda un problema que los sistemas RAG tradicionales gestionan mal: las preguntas multi-hop.

Una pregunta multi-hop es una pregunta cuya respuesta requiere conectar información dispersa en diferentes documentos, donde la información del documento B es necesaria para entender qué parte del documento C buscar. "¿Quién fue el director de la película favorita del escritor que ganó el premio Booker en 1981?" es un ejemplo trivial: se necesitan al menos tres pasos, y cada paso depende del resultado del anterior. Un sistema RAG que recupera documentos una sola vez, antes de generar, tiene dificultades estructurales con este tipo de razonamiento. Puede recuperar cinco documentos, con la esperanza de que contengan todo lo necesario, pero es una apuesta a ciegas.

Memory Interleave propone, en cambio, un ciclo iterativo: el modelo alterna fases de "generative retrieval" (produce los identificadores de los documentos que quiere leer), fases de recuperación efectiva de esos documentos y fases de generación parcial, hasta que tiene suficiente evidencia para responder. El número de documentos recuperados para cada ronda lo determina dinámicamente el propio modelo, no un hiperparámetro fijo. Los experimentos de ablación en el artículo muestran que eliminar Memory Interleave provoca una caída media de 5,3 puntos porcentuales en los benchmarks QA, y di 19,2 puntos solo en HotpotQA, un conjunto de datos específicamente diseñado para el razonamiento de dos saltos.

Estas cifras son convincentes, pero aquí surge una pregunta periodísticamente relevante que el artículo no resuelve explícitamente: ¿Memory Interleave mejora el razonamiento del modelo o mejora simplemente el retrieval? La distinción no es académica. Si el efecto es principalmente que el modelo recupera información más útil gracias a las iteraciones, entonces la capacidad de razonamiento subyacente sigue siendo la del backbone Qwen3-4B, y las mejoras en HotpotQA reflejan un retrieval más inteligente, no una capacidad inferencial superior. Si, por el contrario, el mecanismo iterativo permite al modelo construir cadenas de razonamiento más complejas que las que podría construir con toda la información ya presente en el contexto, entonces estamos ante algo estructuralmente nuevo.

El artículo no proporciona experimentos que distingan entre estos dos escenarios de forma clara, y el hecho de que MuSiQue —el conjunto de datos de razonamiento multi-hop de tres o más pasos— muestre la puntuación absoluta más baja de toda la tabla (2,211 sobre 5) sugiere que, a medida que aumenta la complejidad inferencial, las ganancias se reducen. Esto no es una crítica, es un área abierta que la investigación posterior deberá explorar.

Los números bajo la lupa

Pasemos a los benchmarks, que merecen atención aparte y un ojo crítico. La configuración experimental descrita en el repositorio GitHub utiliza nueve conjuntos de datos de question answering (MS MARCO, Natural Questions, DuReader, TriviaQA, NarrativeQA, PopQA, 2WikiMultiHopQA, HotpotQA, MuSiQue) con bancos de memoria que van de los 277.000 a los 10 millones de tókenes, más las pruebas NIAH (Needle-in-a-Haystack, en la versión RULER) hasta el millón de tókenes. El backbone (modelo base) es Qwen3-4B-Instruct, un modelo de cuatro mil millones de parámetros de 2025.

Los resultados en la comparación con RAG sobre el mismo backbone son genuinamente impresionantes: MSA obtiene una puntuación media de 3,760 sobre 5 frente al 3,242 del mejor RAG con reranker, una mejora relativa del 11,5%. En MS MARCO, el conjunto de datos con el banco de memoria más grande (7,34 millones de tókenes), la brecha se amplía notablemente: 4,141 frente a 3,032, aproximadamente un 37% de ventaja. En HotpotQA, MSA supera al RAG+reranker en cerca del 4%. En NarrativeQA, sin embargo, pierde: el RAG con reranker obtiene 3,638 frente al 3,395 de MSA, el único conjunto de datos de cada nueve donde MSA no es el mejor en la comparación a igualdad de backbone.

La comparación con sistemas RAG sobre backbones mucho más grandes (KaLMv2 con Qwen3-235B y con Llama-3.3-70B) es más matizada. MSA de 4B de parámetros obtiene la mejor media absoluta (3,760) pero pierde en cuatro conjuntos de datos de cada nueve respecto a las configuraciones más fuertes, y la ventaja media sobre Qwen3-235B con reranker es del 5%. En la práctica, un modelo sesenta veces más pequeño mantiene el ritmo de un gigante de 235 mil millones de parámetros cuando la ventaja arquitectónica en la gestión de la memoria es lo suficientemente grande como para compensar la diferencia de escala. Es un resultado notable, pero debe leerse sin hipérboles.

Sin embargo, hay dos aspectos de la configuración experimental que merecen ser declarados explícitamente, porque condicionan cómo leer los números. Primero: la métrica de evaluación para los benchmarks QA es un juez LLM que asigna puntuaciones de 0 a 5. Este tipo de evaluación, aunque se ha convertido en un estándar en el campo, conlleva una variabilidad intrínseca, y el hecho de que el modelo juez no se especifique en el README añade una opacidad que en un artículo revisado por pares no sería aceptable. Segundo: el benchmark de escalabilidad principal, la curva de tókenes 16K→100M con menos del 9% de degradación, se mide en MS MARCO, un solo conjunto de datos. La generalización de esa curva a otros tipos de contenido, distribuciones de preguntas o idiomas distintos del inglés está por demostrar.

En el frente NIAH, los resultados son más claros y fáciles de evaluar: MSA mantiene el 94,84% de precisión al millón de tókenes, mientras que el backbone no modificado se desploma al 24,69%. Los modelos de atención lineal híbrida (la competencia más directa) muestran una degradación apreciable ya a partir de los 128.000-256.000 tókenes. Este es el resultado más sólido del artículo, porque el benchmark NIAH está estandarizado, se usa ampliamente en la comunidad y no deja mucho margen a la ambigüedad interpretativa.

En el momento de escribir este artículo, el código está disponible públicamente en el repositorio GitHub, con instrucciones de instalación, el modelo MSA-4B descargable directamente desde Hugging Face y los benchmarks replicables mediante scripts. Esta es una señal de madurez no trivial: significa que los resultados son, en principio, verificables por cualquiera que tenga el hardware adecuado, y que la comunidad puede empezar a probar el sistema en sus propios casos de uso.

100 millones de tókenes en 2×A800: ¿a qué precio?

"Complejidad casi lineal" es una de las frases más abusadas en el vocabulario de la investigación sobre Transformers y requiere casi siempre una traducción. En el caso de MSA, la complejidad formal de O(L) se refiere a la fase de routing y atención dispersa, pero esconde una serie de costes concretos que un artículo serio no puede ignorar.

El primer coste es la latencia de obtención (fetch) de la memoria CPU. Cuando el router decide qué documentos cargar, esos datos deben transferirse de la RAM del sistema a la VRAM de la GPU a través del bus PCIe, que tiene un ancho de banda típico de 16-32 GB/s. Para cien millones de tókenes, incluso con una compresión agresiva de la caché KV, el tamaño de los datos a transferir por consulta puede ser del orden de gigabytes. El artículo no informa de números explícitos de latencia end-to-end para una sola consulta, y esta es una omisión relevante para cualquiera que quiera evaluar la viabilidad en producción.

El segundo coste es la fase de codificación (encoding) offline. Antes de que MSA pueda responder a cualquier pregunta sobre un corpus, debe procesar todos los documentos de ese corpus para producir las representaciones K̄, V̄ y Kᵣ. Este es un coste único para corpus estáticos, pero se convierte en un problema recurrente para corpus que se actualizan frecuentemente, como los historiales de conversación en una aplicación de agente o los feeds de datos empresariales en tiempo real. El artículo describe esto como codificación offline, lo que sugiere que la arquitectura está pensada principalmente para corpus relativamente estables.

El tercer coste es el de memoria persistente. Un corpus de 100 millones de tókenes, incluso con una compresión agresiva, requiere cantidades significativas de RAM de sistema. Sin cifras específicas en el artículo sobre los ratios de compresión reales y el tamaño resultante de la caché KV comprimida, es difícil estimar los costes de infraestructura precisos, pero para un despliegue empresarial en corpora reales probablemente estemos hablando del orden de cientos de gigabytes de RAM. No es imposible, pero tampoco trivial.

Esto nos lleva a la pregunta central, que vale la pena formular explícitamente: ¿MSA resuelve el cuello de botella de la memoria o traslada la complejidad al almacenamiento, la recuperación y la orquestación? La respuesta honesta es que ambas cosas son ciertas al mismo tiempo. MSA alivia genuinamente el problema de la complejidad cuadrática de la atención, integrando la recuperación de forma diferenciable y obteniendo mejores resultados que el RAG en prácticamente todos los benchmarks probados. Pero no elimina la complejidad infraestructural: la distribuye en componentes diferentes, algunos de los cuales (la transferencia CPU-GPU, la gestión de la RAM, la codificación offline) aún no están bien documentados en el material público disponible. Para un equipo de investigación, es un progreso real. Para un equipo de ingeniería que debe llevarlo a producción, quedan preguntas abiertas.

EverMind: memoria como servicio

Vale la pena entender quién está detrás de MSA, porque la lectura del proyecto cambia sensiblemente según el contexto. EverMind es una startup con sede en Singapur, fundada con el objetivo declarado de construir infraestructura de memoria a largo plazo para agentes de IA. Su producto principal es EverOS, un sistema de gestión de memoria para agentes que integra diversas técnicas, incluida MSA, en una plataforma más amplia. El equipo publicó a finales de marzo de 2026 resultados en cuatro benchmarks de memoria (LoCoMo, LongMemEval, PersonaMem y un marco de evaluación propio) reivindicando un rendimiento al nivel del estado del arte.

La trayectoria es la de una startup que construye lo que en la jerga del sector se llama "Memory-as-a-Service": una capa de abstracción que se inserta entre los modelos lingüísticos base y las aplicaciones, gestionando la persistencia, la recuperación y la organización de los recuerdos del agente a lo largo del tiempo. Es un posicionamiento industrial coherente, y MSA es su base técnica.

El hecho de que el artículo haya sido publicado en arXiv, y no en una sede menor, y que el código ya esté disponible públicamente en GitHub, con el modelo MSA-4B descargable directamente desde Hugging Face y los benchmarks ejecutables mediante scripts, es una señal de madurez no trivial. Los resultados son, en principio, verificables por cualquiera que tenga el hardware adecuado, y la comunidad puede empezar a probar el sistema en sus propios casos de uso. La investigación se comunica públicamente y los activos técnicos están abiertos: para una startup en fase temprana no es lo habitual, y es un elemento que pesa positivamente en la valoración global del proyecto.

Los trece autores del artículo (entre ellos Chen Yu, Chen Runkai, Yi Sheng y otros, con Lidong Bing y Tianqiao Chen como figuras senior) representan un equipo de tamaño y perfil creíbles para el tipo de trabajo descrito. No hay, por el momento, evaluaciones independientes de los resultados por parte de grupos de investigación terceros, lo cual es normal para un artículo de hace pocos meses, pero es un elemento a tener en cuenta al leer los porcentajes de mejora.

¿Prueba de concepto elegante o sistema listo?

Es la pregunta que todo artículo honesto sobre este tipo de investigación debe hacerse, y la respuesta aquí tiene matices. MSA es, en su estado actual, un sistema descrito de forma convincente, con resultados de benchmarks creíbles en un conjunto de pruebas lo suficientemente amplio como para no poder ser descartado como cherry picking (selección interesada), y con una arquitectura que tiene una lógica interna coherente y bien motivada. No es una promesa vacía.

Al mismo tiempo, probablemente no sea todavía un sistema listo para la producción en el sentido ingenieril del término. Los benchmarks de escalabilidad a 100 millones de tókenes se demuestran en un solo conjunto de datos (MS MARCO), y se desconoce la degradación real en otros tipos de contenido a esa escala. El rendimiento en NarrativeQA, el conjunto de datos con las historias más largas y la comprensión más contextual, es el único caso en el que MSA pierde contra el RAG con reranker, lo que sugiere que los contenidos narrativos densos podrían ser un punto débil. La latencia de consulta end-to-end, el coste de codificación del corpus y los requisitos de RAM del sistema no se comunican con la precisión necesaria para una evaluación de ingeniería.

También hay una pregunta más sutil sobre la portabilidad. Todos los resultados se obtienen sobre Qwen3-4B, un backbone específico con características específicas. MSA requiere entrenar el router y el mecanismo de atención dispersa end-to-end: no es algo que se acople a cualquier modelo preentrenado como un plugin. El artículo describe un entrenamiento sobre 158,95 mil millones de tókenes con una pérdida auxiliar de routing, seguido de dos fases de ajuste fino (fine-tuning) supervisado con un currículo de 8.000 a 64.000 tókenes. Replicar este proceso en un backbone diferente (Llama, Mistral, Gemma) requeriría recursos y tiempo considerables, y no está garantizado que los resultados se transfieran de forma idéntica.

Disco Elysium, el juego de rol narrativo de ZA/UM, construye su sistema de memoria sobre fragmentos, susurros, recuerdos que el protagonista recupera de forma iterativa y a menudo poco fiable para reconstruir una historia más grande. MSA, de alguna manera, hace algo parecido: recupera fragmentos dispersos de una biblioteca enorme, los ensambla iterativamente, intenta construir un razonamiento coherente. La diferencia es que en el juego el fallo de la recuperación forma parte del relato; en un sistema de producción, è un error. Con qué frecuencia falla MSA al recuperar los fragmentos adecuados, y con qué consecuencias, es exactamente el tipo de pregunta a la que solo el código público y la experimentación independiente pueden responder.

MSA merece atención, estudio y experimentación directa. La pregunta de si resuelve realmente el cuello de botella de la memoria o simplemente lo traslada a la infraestructura, el almacenamiento y la orquestación no tiene todavía una respuesta definitiva, y probablemente no la tendrá hasta que alguien fuera de EverMind haya podido desmontarlo y volverlo a montar en un caso de uso real. Mientras tanto, es una de las arquitecturas más interesantes aparecidas este año en el espacio de la memoria para modelos lingüísticos, y ya vale la pena seguir de cerca el repositorio GitHub.