Pentágono: Anthropic rechaza, OpenAI acepta, quién descarga y quién desinstala, ¿y después?

Hay semanas que parecen décadas, y la última de febrero de 2026 fue una de ellas. En cuestión de noventa y seis horas, Anthropic rechazó las condiciones del Departamento de Defensa estadounidense, rebautizado como "Department of War" por la administración Trump, fue declarada riesgo para la cadena de suministro nacional, acabó en el punto de mira de un decreto presidencial, vio a su chatbot escalar a la cima de la App Store estadounidense y anunció que recurriría ante los tribunales. OpenAI, mientras tanto, firmó un acuerdo con el mismo Pentágono en un tiempo tan breve que su propio consejero delegado lo calificó públicamente de "precipitado". Los usuarios respondieron a su manera: desinstalando. La respuesta a la pregunta de qué ocurrirá realmente es, sinceramente, una sola: veremos.

La frontera que nadie quería trazar

Para entender qué ha pasado, hay que partir de lo que el Pentágono quería y de lo que Anthropic se negó a conceder. El núcleo de la disputa se refiere a dos líneas rojas precisas: el uso de la inteligencia artificial para la vigilancia masiva de los ciudadanos estadounidenses, y el empleo de sistemas de armas completamente autónomos, capaces de seleccionar y eliminar objetivos sin intervención humana. Dario Amodei mantuvo su posición incluso cuando el secretario de Defensa, Pete Hegseth, fijó un ultimátum, las 17:01 del viernes, amenazando con declarar a la empresa un "riesgo para la cadena de suministro".

La posición del Pentágono, en su formulación oficial, no era la de pedir explícitamente drones asesinos. El portavoz Sean Parnell declaró en X que el departamento no tiene ningún interés en la vigilancia doméstica masiva ni en las armas autónomas, sino que la petición era más sencilla: permitir al Pentágono usar los modelos de Anthropic para "todos los usos lícitos". El punto de fricción está precisamente ahí. ¿Quién decide qué es lícito? La respuesta de Hegseth fue tajante: desde luego no el proveedor.

El contexto normativo no ayuda a tranquilizar. Según una directiva del Departamento de Defensa de 2023, los sistemas de inteligencia artificial pueden seleccionar y atacar objetivos sin intervención humana, siempre que superen determinados estándares y sean aprobados por funcionarios de alto nivel. No existe una prohibición categórica sobre las armas autónomas en el aparato militar estadounidense. Anthropic, conociendo este marco, no quería que sus modelos entraran en un sistema en el que el "uso lícito" pudiera incluir, en el futuro, decisiones letales automatizadas. La preocupación no es infundada: un sistema de IA posicionado en contextos de altísimo riesgo puede cometer errores irreversibles con la velocidad de un procesador. La diferencia entre un modelo que aconseja y uno que actúa es, en ciertos escenarios, la diferencia entre un error corregible y una catástrofe.

Hegseth respondió con el hacha. Trump emitió un decreto que ordena a todas las agencias federales cesar el uso de las tecnologías Anthropic en un plazo de seis meses. Anthropic ha anunciado que impugnará la decisión ante los tribunales.

Los números que hacen ruido

Mientras circulaban los comunicados oficiales, la respuesta más inmediata llegó de las tiendas de aplicaciones, y los datos están lo suficientemente verificados como para merecer una atención puntual.

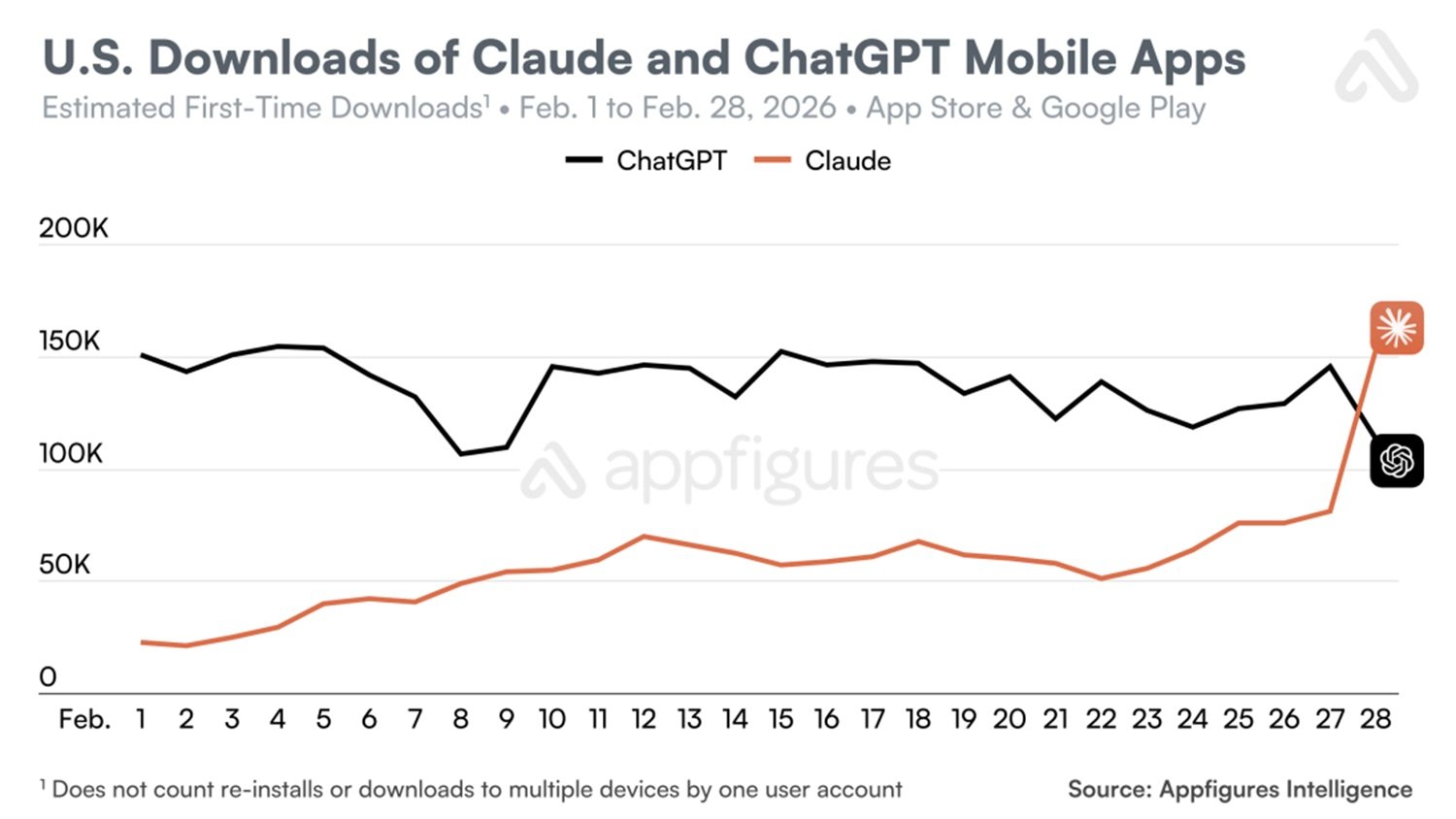

Según Sensor Tower, las desinstalaciones estadounidenses de ChatGPT aumentaron un 295% diario el 28 de febrero. Para contextualizar: la tasa típica de desinstalación diaria de ChatGPT, medida en las treinta semanas anteriores, era del 9%. No es una oscilación, es un salto. Las descargas de ChatGPT cayeron un 13% el sábado y un 5% adicional el domingo. En el frente opuesto, Claude vio cómo sus descargas estadounidenses crecían un 37% el viernes 27, el día del rechazo de Amodei, y un 51% adicional el sábado 28. La consecuencia es que Claude alcanzó la primera posición en la clasificación de la App Store estadounidense, un salto de más de veinte posiciones respecto al 22 de febrero.

Appfigures, segundo proveedor de datos independiente, certifica que las descargas diarias de Claude en EE. UU. superaron a las de ChatGPT por primera vez en la historia en la jornada del sábado, con estimaciones de crecimiento aún más altas: +88% diario. Appfigures señala también que Claude figuraba primero entre las aplicaciones gratuitas para iPhone en seis países: Bélgica, Canadá, Alemania, Luxemburgo, Noruega, Suiza y Estados Unidos. Sensor Tower añade un dato de sentimiento particularmente elocuente: las reseñas de una estrella en ChatGPT crecieron un 775% el sábado 28, con una nueva duplicación el domingo. Las reseñas de cinco estrellas cayeron un 50% en el mismo periodo.

Cabe decir con honestidad metodológica que Similarweb observó que las descargas de Claude en la última semana fueron unas veinte veces superiores a los niveles de enero, pero también precisó que el aumento podría tener causas distintas a la cuestión política. Atribuirlo todo a la elección ética de Anthropic sería una simplificación. La coincidencia temporal, sin embargo, es difícil de ignorar.

OpenAI, el acuerdo apresurado y los guardrails en discusión

Sam Altman lo admitió en X sin rodeos: el acuerdo con el Departamento de Guerra había sido "decididamente precipitado" y "las perspectivas no parecen buenas". Es una concesión rara, la de un consejero delegado que critica públicamente una decisión estratégica propia mientras aún la defiende.

La cronología es esta: el viernes por la noche las negociaciones entre Anthropic y el Pentágono colapsan definitivamente; el sábado OpenAI anuncia su propio acuerdo para el despliegue de modelos en entornos clasificados. La rapidez generó preguntas inmediatas: ¿tenía OpenAI realmente las mismas líneas rojas que Anthropic? Si es así, ¿cómo había logrado firmar donde Anthropic había fallado?

OpenAI respondió con una entrada en su blog, enumerando tres áreas excluidas del acuerdo: vigilancia doméstica masiva, sistemas de armas autónomos y decisiones automatizadas de alto riesgo. La empresa sostuvo que, a diferencia de otros operadores que habrían "reducido o eliminado sus guardrails de seguridad" en las implementaciones militares, su enfoque es multicapa: control completo sobre el stack de seguridad, despliegue exclusivo vía nube, personal de OpenAI con autorización de seguridad involucrado en el proceso y protecciones contractuales "robustas". Katrina Mulligan, responsable de asociaciones para la seguridad nacional, argumentó en LinkedIn que limitar el despliegue a la API en la nube impide físicamente la integración de los modelos en sistemas de armas: un modelo accesible solo vía nube tiene una distancia arquitectónica de los sistemas de control que un modelo instalado localmente no tiene. Es un argumento técnico no exento de lógica.

Sin embargo, Mike Masnick de Techdirt planteó una objeción concreta: el texto del acuerdo, al conformarse a la Orden Ejecutiva 12333, podría abrir la puerta a la vigilancia de ciudadanos estadounidenses. Esa orden ejecutiva, que se remonta a la era Reagan, permite la captura de comunicaciones de personas estadounidenses cuando transitan por canales internacionales. Si el acuerdo de OpenAI hace referencia a esa orden como estándar de cumplimiento, la palabra "protección" adquiere contornos más difusos de lo que sugiere el comunicado de prensa. La respuesta de OpenAI es que la arquitectura de despliegue, exclusivamente en la nube, sin integración directa en hardware operativo, vale más que el lenguaje contractual. El debate, técnicamente, no está cerrado.

Altman explicó su lógica de una manera que vale la pena citar: OpenAI esperaba que el acuerdo bajara la tensión entre el Departamento de Guerra y la industria de la IA en su conjunto. Si funcionaba, la empresa aparecería como la que había asumido el coste de un movimiento difícil en interés del sector. En caso contrario, seguiría pareciendo precipitada. Altman reconoció ambas posibilidades.

La trampa del profeta desarmado

Hay una voz en este asunto que vale la pena escuchar con atención precisamente porque no es tierna con nadie. Max Tegmark, físico del MIT y fundador del Future of Life Institute, concedió a TechCrunch una entrevista en la tarde del mismo viernes en que Trump firmaba el decreto, y su análisis es un acta de acusación estructural.

El argumento es este: las empresas de inteligencia artificial, incluida Anthropic, han resistido durante años a la regulación vinculante, sustituyéndola por compromisos voluntarios de autogobierno. El resultado es que hoy no existe un marco normativo que las proteja cuando el gobierno decide exigir usos que ellas mismas consideran peligrosos. No existe actualmente en Estados Unidos una ley que prohíba construir sistemas de IA para matar estadounidenses: el gobierno puede simplemente pedirlo, y las empresas no tienen herramientas legales para oponerse más allá de las contractuales, que el Pentágono considera no vinculantes por una cuestión de principio.

A esto se añade una circunstancia que Tegmark subraya sin reservas: la misma semana del enfrentamiento con el Pentágono, Anthropic modificó su compromiso de seguridad más importante, la promesa de no lanzar sistemas de IA cada vez más potentes hasta que la empresa estuviera razonablemente segura de que no causarían daños. Quitarla justo en este momento es, al menos, una coincidencia incómoda. Tegmark extiende la crítica a todo el sector: Google ha abandonado su compromiso histórico contra el uso de la IA para la vigilancia y las armas; OpenAI ha eliminado la palabra "seguridad" de su misión; xAI ha cerrado su equipo de seguridad. Los compromisos voluntarios, observa, tienden a durar hasta que se vuelven costosos.

Veremos: las preguntas abiertas

Estamos en la posición de quien observa un partido aún en curso sabiendo que tiene los datos de los primerísimos minutos. La honestidad intelectual impone no hacer pronósticos como si fueran certezas.

¿Durará el efecto ético? Los picos de descargas y las desinstalaciones registradas por Sensor Tower y Appfigures son reales, pero los comportamientos de los usuarios en las apps tienen una volatilidad que cualquiera que trabaje en el sector conoce bien. Quien usa ChatGPT integrado en sus flujos de trabajo corporativos no se muda en una semana. La pregunta no es si el 28 de febrero marcó un momento, lo hizo, es si ese momento será recordado en seis meses o olvidado en seis semanas.

¿Tendrán las amenazas de Trump consecuencias concretas y duraderas? El decreto existe, la designación como "riesgo para la cadena de suministro" existe, el recurso ante los tribunales de Anthropic está anunciado. El VC Sachin Seth de Trousdale Ventures dijo a TechCrunch que perder a Anthropic podría crear un vacío en el sistema de defensa estadounidense que requeriría de seis a doce meses para ser llenado por otros proveedores. Esta dependencia mutua es, paradójicamente, una de las pocas protecciones concretas de las que dispone Anthropic ahora: es difícil expulsar a un proveedor cuando eres tú el cliente que más lo necesita.

¿Qué pasará en julio de 2026, cuando expire el contrato entre OpenAI y el Departamento de Defensa? Es una ventana temporal lo suficientemente cercana como para estar ya en el calendario de cualquiera que esté razonando estratégicamente en el sector. xAI ya ha señalado su disposición a operar en entornos clasificados sin las restricciones que caracterizan a Anthropic y, en menor medida, a OpenAI. La competencia por el contrato militar estadounidense no está cerrada, y el hecho de que Elon Musk sea al mismo tiempo consejero de la administración Trump y propietario de uno de los principales competidores de Anthropic y OpenAI no es un detalle despreciable en el cálculo de probabilidades futuras.

Hay además una dimensión geopolítica que este asunto pone en primer plano y que el ángulo estadounidense corre el riesgo de oscurecer. Europa está observando. La AI Act europea, el primer marco normativo vinculante sobre inteligencia artificial en el mundo, que ha entrado progresivamente en vigor, clasifica los sistemas de IA usados en contextos militares de forma separada a la aplicación civil, dejando de hecho a los estados miembros individuales la gestión de esos usos. Pero la presión política que se ejerce sobre empresas como Anthropic, que tiene equipos relevantes en Europa y sirve a usuarios en todo el mundo, no es indiferente al debate regulatorio europeo. Si la administración Trump logra doblegar las políticas de seguridad de una empresa estadounidense, ¿qué garantiza que las mismas presiones no se ejerzan, por vías distintas, sobre empresas europeas o sobre filiales europeas de empresas estadounidenses? Es una pregunta que en Bruselas ya se están haciendo, aunque de forma más discreta de lo que la situación merecería.

La analogía con la Guerra Fría que Tegmark propone merece una breve nota final. Como en la carrera de armamentos nucleares, hay un punto en el que la lógica del "debemos hacerlo nosotros antes de que lo hagan los chinos" choca con la matemática elemental del riesgo mutuo. China, observa, está trabajando para limitar algunas formas de IA antropomórfica, no para complacer a Occidente, sino porque las considera desestabilizadoras para su propia sociedad. Quienes sostienen que Pekín nunca pondrá límites al desarrollo de la IA ignoran los movimientos regulatorios que el gobierno chino ya ha iniciado en la dirección opuesta a la desregulación total. No es un argumento para la inacción, pero es un antídoto útil a las narrativas demasiado simplistas.

Permanece, en el centro de todo, la pregunta que ningún comunicado de prensa puede resolver: ¿quién tiene la última palabra cuando un sistema de inteligencia artificial está posicionado lo suficientemente cerca de una decisión letal como para que la distinción entre "aconsejar" y "decidir" sea una cuestión de arquitectura de software? No es retórica. Es la pregunta que hizo saltar las negociaciones entre Amodei y Hegseth, que empujó a Altman a firmar a toda prisa, y que los jueces estadounidenses pronto se encontrarán afrontando en formas que los códigos actuales no contemplan.

Dario Amodei mantuvo su posición. Sam Altman firmó. Los usuarios, por ahora, han premiado a quien dijo no. El Pentágono tiene sus propios planes, Trump ha firmado el decreto, los jueces recibirán la memoria de Anthropic y el contrato de OpenAI expira en julio.

¿Qué pasará? Veremos.