Robótica: el estado del arte 2025. Separemos el Hype de la Realidad

En octubre de 2024, Tesla presenta "Nosotros, Robot" en los estudios Warner Bros. Optimus distribuye bebidas, juega a "piedra, papel o tijera", entretiene a los invitados con movimientos fluidos. Los vídeos se vuelven virales en pocas horas. Pocos días después, Fortune Italia y otros medios revelan que los humanoides eran teleoperados por técnicos humanos. Adam Jonas de Morgan Stanley confirma el uso de la teleoperación, como admitieron algunos de los propios robots que declararon "hoy estoy siendo asistido por un humano". ¿La voz sintética? Un operador humano con auriculares. Estos "detalles" ocultan el problema central de la robótica humanoide en 2025: la brecha abismal entre las demostraciones controladas y el despliegue autónomo.

No es la primera vez. En 2021, el primer Optimus era un bailarín disfrazado. En 2022, el prototipo caminaba pero se tambaleaba. En 2023, las manos adquirieron una destreza manipuladora limitada. Hoy, en noviembre de 2025, Tesla afirma que veinte unidades trabajan en sus fábricas en tareas repetitivas. Verificar estas afirmaciones desde fuera es imposible: ningún periodista independiente ha filmado a Optimus operando de forma autónoma durante turnos completos. Este patrón se repite en la industria: vídeos impresionantes, afirmaciones audaces, verificaciones independientes que revelan teleoperación o escenarios ultracontrolados.

Bienvenidos al estado del arte de la robótica unida a la inteligencia artificial: un territorio donde la ingeniería extraordinaria convive con el marketing agresivo, donde los progresos reales se ven inflados por expectativas poco realistas, donde separar lo que funciona de lo que está "casi listo" requiere un ojo clínico. Como en Planetes, el anime de Makoto Yukimura donde los desechos espaciales son recogidos por operadores humanos porque la automatización completa sigue siendo demasiado cara e inestable, también en la robótica terrestre de 2025 el último metro hacia la verdadera autonomía resulta ser el más largo.

Atlas: El Punto de Referencia Técnico

Si existe un estándar de oro técnico en la robótica humanoide, es Atlas de Boston Dynamics. No por las aplicaciones comerciales, casi ausentes, sino por las capacidades demostradas de forma verificable. En agosto de 2024, la empresa presentó la versión eléctrica del robot, abandonando la hidráulica que había caracterizado a los modelos anteriores. El nuevo Atlas pesa 89 kg, mide 150 cm e integra 28 grados de libertad con actuadores eléctricos personalizados que Boston Dynamics no vende por separado. La peculiaridad: articulaciones que giran más allá de los límites anatómicos humanos, permitiendo rotaciones completas del torso y movimientos "imposibles" para un cuerpo biológico.

En octubre de 2024, Boston Dynamics publicó vídeos de Atlas manipulando componentes de automoción en un escenario industrial semiestructurado. El robot reconoce objetos variables, adapta el agarre y corrige errores. Nada de teleoperación, sino Grandes Modelos de Comportamiento (Large Behavior Models) entrenados con miles de horas de simulaciones y datos reales. Cuando se equivoca, lo vuelve a intentar con una estrategia diferente. Cuando el entorno cambia, recalcula la ruta. ¿Es autonomía real? Sí, pero en un escenario restringido: componentes conocidos, espacio mapeado, tarea repetitiva con variaciones limitadas.

El verdadero salto se produjo en octubre de 2024 con la asociación entre Boston Dynamics y el Toyota Research Institute. El objetivo: combinar la plataforma de hardware de Atlas con los Grandes Modelos de Comportamiento desarrollados por TRI, entrenados con miles de millones de interacciones simuladas. Toyota aporta experiencia en la fabricación en el mundo real, Boston Dynamics la robótica de frontera. Juntos aspiran a crear humanoides capaces de aprender nuevas tareas en horas en lugar de meses, generalizando a partir de unos pocos ejemplos como lo hacen los modelos lingüísticos con el texto.

Pero Atlas sigue siendo un proyecto de investigación. Coste estimado por unidad, no declarado pero estimado, en cientos de miles de dólares. Autonomía operativa: unas 4 horas antes de recargar. Mantenimiento: técnicos especializados. Despliegue comercial: cero. Boston Dynamics no vende Atlas, lo utiliza como plataforma de I+D para perfeccionar tecnologías que luego acaban en productos como Spot, el perro robótico que ha encontrado nichos en inspecciones industriales y obras. Atlas demuestra lo que es técnicamente posible, no lo que es económicamente escalable.

Tesla Optimus: ¿Visión o Vaporware?

Elon Musk tiene una teoría: la robótica humanoide será más grande que la automoción, más grande que la energía. Prevén un mercado de 25 billones de dólares, con Optimus costando entre 20.000 y 30.000 dólares y "revolucionando la economía". Tesla emplea a más de 200 ingenieros en el proyecto, ha construido infraestructuras de entrenamiento de IA dedicadas e invierte miles de millones. La ambición es real. Los resultados verificables, mucho menos.

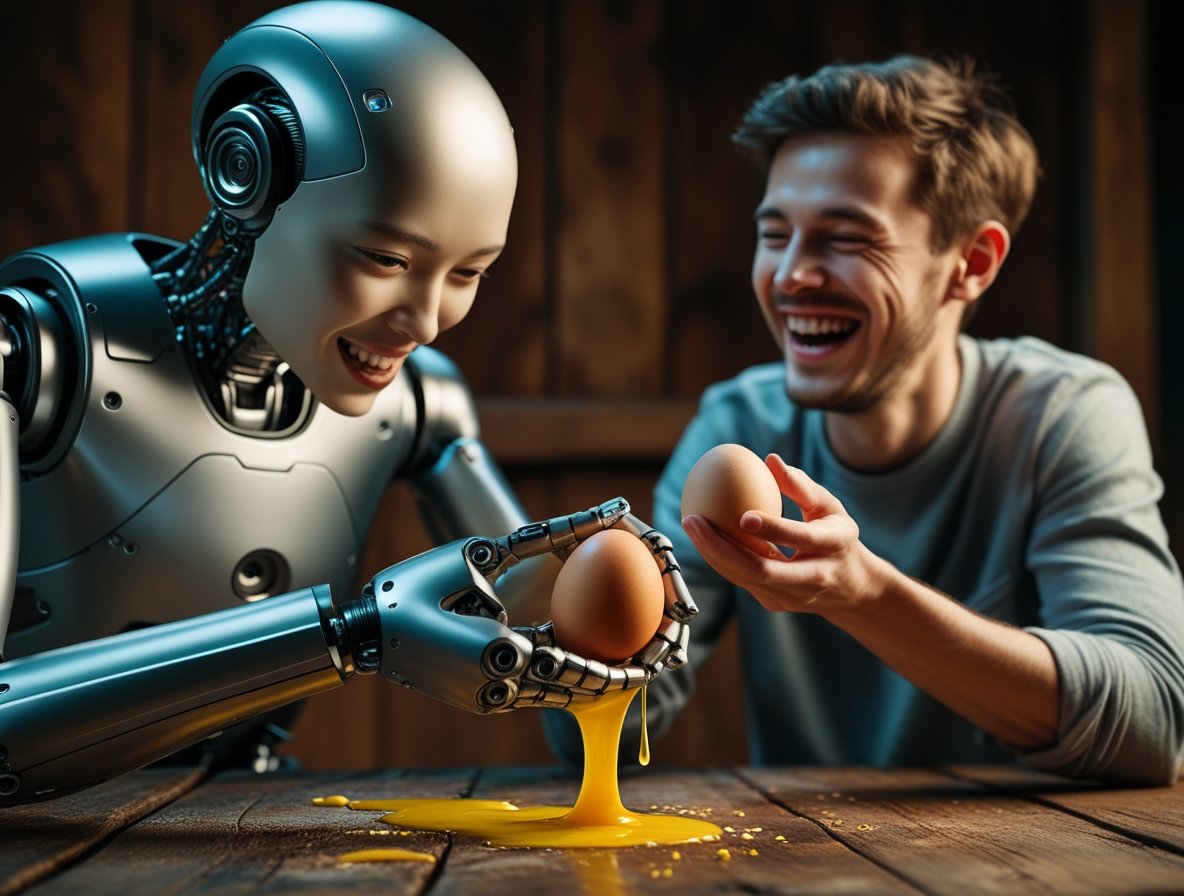

La última actualización pública data de octubre de 2024: Optimus Gen 2 camina más rápido, las manos tienen 11 grados de libertad, puede coger un huevo sin romperlo. En los vídeos oficiales, dobla ropa, ordena objetos, transporta componentes en la fábrica. Pero como hemos visto, muchas demostraciones eran teleoperación enmascarada. Tesla sostiene que en noviembre de 2025 veinte unidades trabajan de forma autónoma en sus fábricas de Texas. Verificarlo es imposible: ningún acceso externo, ninguna confirmación de fuentes de terceros.

El problema central es económico. Los analistas de la industria estiman que producir un humanoide mínimamente capaz cuesta hoy entre 120.000 y 150.000 dólares: actuadores de alto par, múltiples sensores LIDAR y de visión, baterías de 2-3 kWh, un potente ordenador de a bordo. Bajar a 20.000-30.000 dólares requeriría economías de escala masivas (cientos de miles de unidades) y avances tecnológicos en baterías y actuadores. Tesla tiene experiencia en la fabricación a gran escala de automóviles, pero un coche tiene unos 30.000 componentes; un humanoide capaz tendría otros tantos, con tolerancias mecánicas más estrictas.

Luego está la paradoja de la utilidad. ¿Para qué tarea un humanoide de propósito general de 30.000 dólares supera a un robot especializado de 5.000? En los almacenes, los robots móviles autónomos de Amazon cuestan una fracción y mueven más mercancías. En casa, los robots aspiradores cuestan 500 euros y funcionan. Un humanoide doméstico tendría que cocinar, limpiar, planchar, hacer reparaciones: tareas que por separado tienen soluciones automatizadas más económicas, mientras que integrarlas en un cuerpo antropomorfo multiplica la complejidad y los costes.

Musk tiene razón en una cosa: si alguien resuelve el problema, tendrá un mercado enorme. Pero "si" y "cuándo" son preguntas a las que ningún ingeniero serio responde con certezas. Tesla tiene recursos, talento y visión. Pero después de tres años de anuncios, todavía faltan despliegues verificables a gran escala.

Figure AI: Un Robot en BMW (Solo Uno)

En enero de 2024, Figure AI anuncia una asociación con BMW para integrar el robot Figure 02 en la planta de Spartanburg, Carolina del Sur. Los comunicados de prensa hablan de "revolucionar la fabricación de automóviles". Los vídeos muestran a Figure 02 insertando componentes en una carrocería con precisión milimétrica. Inversores como OpenAI, Nvidia, Microsoft e Intel inyectan 675 millones de dólares en la ronda de Serie B. Valoración: 2.600 millones. El hype está por las nubes.

Diez meses después, en octubre de 2024, Figure AI publica una actualización sustancial: un robot Figure 02 ha trabajado durante cinco meses consecutivos, diez horas al día, en una sección controlada de la planta. La tarea: instalar componentes específicos en un único modelo de vehículo. Ya no es una prueba piloto de días o semanas, sino un despliegue prolongado con datos operativos reales. La empresa informa de un tiempo de actividad superior al 70%, con mejoras progresivas gracias a los datos recogidos sobre el terreno. El robot aprende de errores reales, no simulados, adaptando estrategias de agarre y corrigiendo desviaciones.

Pero las limitaciones siguen siendo evidentes: un único robot, una única tarea, un entorno ultracontrolado. Tiempo de entrenamiento para esa operación específica: seis meses. BMW confirma que el objetivo no es sustituir a los trabajadores, sino automatizar tareas ergonómicamente pesadas o peligrosas. Para finales de 2025, el objetivo es llegar a diez unidades operativas en tareas diferentes. A largo plazo, cientos.

El punto crítico sigue siendo el ROI. Un operador humano en BMW cuesta unos 70.000 dólares anuales entre salario y beneficios. Se estima que Figure 02 cuesta 150.000 dólares, más el mantenimiento (20.000-30.000 anuales), más el entrenamiento especializado para cada nueva tarea. El punto de equilibrio se alcanza en tres o cuatro años, suponiendo que el robot trabaje de forma estable sin degradación del rendimiento. Para BMW, que produce 1,5 millones de vehículos al año en 31 plantas, pasar de uno a mil robots requiere no solo capital, sino también infraestructuras de software (gestión de flotas, monitorización, actualizaciones OTA) que hoy solo existen en forma embrionaria.

Figure AI está construyendo esas infraestructuras, pero el paso de un único despliegue a una flota de cientos de unidades es donde muchas startups de robótica han naufragado. Rethink Robotics, pionera de los cobots, cerró en 2018 a pesar de una tecnología sólida y grandes clientes: los costes de soporte y personalización erosionaron los márgenes. Figure AI tiene más capital y mejores socios, pero la física económica no cambia: cada robot adicional cuesta casi tanto como el primero hasta que se alcanza una escala masiva. Cinco meses de operatividad continuada son un hito significativo, pero la distancia entre un robot y mil sigue siendo inmensa.

Clone Alpha: Biomimética Fascinante, Pruebas Ausentes

Clone Robotics, una startup con sede en Varsovia, persigue un enfoque radicalmente diferente: no motores eléctricos, sino "músculos" sintéticos alimentados por un sistema vascular hidráulico. Clone Alpha, presentado en 2024, tiene antebrazos y manos con miofibras que se contraen como tejido biológico, dedos con 26 grados de libertad, movimientos fluidos y precisos. Estéticamente impresionante: la piel sintética translúcida deja entrever tendones y actuadores, como una ilustración anatómica de Andreas Vesalius llevada a las tres dimensiones.

El problema: no existen vídeos de Clone Alpha realizando tareas complejas de forma autónoma. Los vídeos oficiales muestran movimientos individuales de agarre, rotaciones de muñeca, flexiones de los dedos. Todo en un entorno controlado, con el torso ausente. Clone Robotics promete que el sistema musculoesquelético permite movimientos más naturales y adaptables que los motorizados, con retroalimentación táctil intrínseca. Pero hasta que no veamos al robot completo operar durante minutos, no horas, en escenarios semiestructurados, siguen siendo afirmaciones teóricas.

La ventaja biomimética es real en teoría: los músculos biológicos tienen una relación potencia-peso superior a los motores eléctricos, amortiguan de forma natural los choques mecánicos, se adaptan a superficies irregulares. Pero la hidráulica introduce complejidad: bombas, válvulas, sensores de presión, riesgos de fugas, mantenimiento intensivo. En los robots industriales, la hidráulica ha sido abandonada en gran medida por la eléctrica en los últimos veinte años precisamente por la fiabilidad y los costes operativos.

Clone Robotics afirma haber resuelto estos problemas con materiales innovadores y un diseño compacto. Han recaudado varios millones en financiación inicial, colaboran con universidades europeas, presentan artículos revisados por pares sobre el diseño de los actuadores. Pero el salto de un subsistema que funciona a un robot integrado es enorme. A Boston Dynamics le llevó quince años con recursos masivos. Clone es una pequeña startup en un mercado dominado por gigantes con presupuestos de miles de millones.

La sensación es la de estar viendo un coche conceptual extraordinario: diseño audaz, tecnologías fascinantes, pero sin la certeza de que llegue a producirse. En la robótica humanoide, la ingeniería supera regularmente a la ciencia ficción en los artículos, pero se estrella contra la economía y la física cuando tiene que escalar.

Cirugía Robótica: La Excelencia Consolidada

Si quiere ver robótica avanzada que funciona de verdad, entre en un quirófano. Intuitive Surgical, con la plataforma da Vinci, domina la cirugía robótica desde hace más de veinte años. El sistema da Vinci 5, introducido en 2024, integra más de 150 sensores de fuerza que transmiten retroalimentación táctil al cirujano, permitiéndole "sentir" los tejidos a través de los instrumentos. Resolución 3D de 10 megapíxeles, latencia inferior a 50 milisegundos, estabilización de temblores, escalado de movimientos 1:3 para una precisión submilimétrica.

Las cifras son impresionantes: más de 8.500 sistemas instalados en todo el mundo, más de 15 millones de procedimientos robóticos realizados acumulativamente, 12.000 procedimientos solo en los primeros seis meses de 2024. En cirugía prostática, torácica y ginecológica, el da Vinci es el estándar en muchos centros de excelencia. ¿Por qué funciona donde los humanoides tienen dificultades? Tres razones: tarea específica y bien definida, entorno ultracontrolado, cirujano humano en el bucle.

El da Vinci no es autónomo: amplifica las capacidades humanas, no las sustituye. El cirujano controla cada movimiento a través de una consola; el robot traduce las entradas humanas en acciones precisas, filtrando temblores y escalando movimientos. Es teleoperación muy avanzada, pero sigue siendo teleoperación. La IA entra en las fases de diagnóstico: análisis preoperatorio de las imágenes, sugerencias sobre los márgenes de resección, identificación de estructuras críticas. Pero la decisión sigue siendo humana.

Los límites son económicos y logísticos: un sistema da Vinci 5 cuesta entre 2 y 3 millones de dólares, los instrumentos desechables entre 2.000 y 3.000 dólares por procedimiento, los contratos de mantenimiento entre 150.000 y 200.000 anuales. Solo los hospitales grandes y especializados pueden permitírselo. Además, la curva de aprendizaje es pronunciada: un cirujano necesita entre 100 y 150 procedimientos para alcanzar la competencia. Esto crea disparidades: la excelencia robótica se concentra en unos pocos centros, mientras que el resto del mundo opera de forma tradicional.

Está surgiendo competencia: Medtronic con Hugo, Johnson & Johnson con Ottava, CMR Surgical con Versius. Todos aspiran a costes más bajos y una mayor modularidad. Pero el da Vinci mantiene la ventaja del primer jugador: treinta años de datos operativos, un ecosistema de formación consolidado, una enorme base instalada. En la cirugía robótica, la tecnología ha superado la fase de demostración y se ha convertido en un estándar clínico. En los humanoides de propósito general, todavía estamos en las demostraciones.

Cobots: La Revolución Silenciosa

Mientras los humanoides acaparan los titulares, los robots colaborativos (cobots) transforman silenciosamente la fabricación mundial. Universal Robots, ABB, FANUC, KUKA venden decenas de miles de unidades al año. El mercado tiene un valor de 1.900 millones en 2024, y las proyecciones de IDTechEx lo sitúan en 11.800 millones para 2030. ¿Por qué funcionan? Porque no pretenden ser humanos.

Un cobot como el UR10e de Universal Robots: brazo de seis ejes, carga útil de 10 kg, precisión de ±0,03 mm, coste de 35.000-45.000 dólares. Se programa con una interfaz gráfica de arrastrar y soltar: sin código, un técnico medio lo entrena en días. Los sensores de par en cada articulación detectan colisiones y detienen el movimiento en 0,4 segundos, lo que hace que sea seguro trabajar a su lado sin jaulas de protección. Consume 500 vatios, se alimenta de la red estándar y ocupa medio metro cuadrado.

Las tareas: coger y colocar, atornillar, ensamblar, inspección de calidad, empaquetar. Tareas repetitivas, ergonómicamente pesadas para los humanos, que los cobots realizan 24 horas al día, 7 días a la semana, con una calidad constante. En las líneas de automoción, electrónica, procesamiento de alimentos y farmacéutica, los cobots trabajan junto a los operadores humanos en células colaborativas: el robot se encarga de lo repetitivo, el humano supervisa y gestiona las excepciones. Es la aplicación práctica de la Paradoja de Moravec: lo difícil para los humanos (repetición hiperprecisa) es fácil para los robots, lo fácil para los humanos (adaptación a las variaciones) es difícil para los robots.

Los límites son claros: carga útil limitada (10-20 kg), velocidad inferior a la de los robots industriales tradicionales, imposibilidad de gestionar una gran variabilidad. Pero para las tareas estructuradas, el ROI está documentado: los estudios de McKinsey muestran una amortización en 12-24 meses, con un aumento de la productividad del 20-40% y una reducción de los defectos del 15-30%. Las pequeñas y medianas empresas que no podían permitirse la automatización tradicional ahora integran cobots.

La dirección futura: cobots con visión de IA que reconocen objetos variables, aprenden por demostración en lugar de por programación, se reconfiguran de forma autónoma para nuevas tareas. Proyectos como el Robotics Hub financiados por la UE están estandarizando las interfaces de software para que los cobots sean más intercambiables y menos dependientes de un único proveedor. Es una automatización pragmática, no visionaria, pero funciona y es rentable hoy, no mañana.

Los Tres Muros Técnicos

Detrás de cada humanoide que camina tambaleándose o manipula objetos torpemente hay límites físicos brutales. Tres de ellos definen la brecha entre el prototipo y el producto.

Baterías: un humanoide que trabaja consume entre 200 y 500 vatios de forma continua. Con las baterías de iones de litio actuales, con una densidad energética de unos 250 Wh/kg, para 4 horas de autonomía se necesitan 2-3 kWh, es decir, entre 8 y 12 kg de baterías. Esto, en un robot que ya pesa entre 50 y 80 kg, reduce drásticamente la carga útil y la agilidad. El Tesla Optimus tiene una batería de 2,3 kWh para una autonomía declarada de "varias horas" (no especificadas). El Atlas eléctrico utiliza una batería personalizada no revelada, con una autonomía estimada de 3-4 horas. Cualquier avance en la densidad energética ayudaría, pero las baterías mejoran entre un 5% y un 7% anual, no un 50%. Se necesitan años para duplicar la autonomía sin aumentar el peso.

Actuadores: los motores eléctricos se enfrentan al trilema de fuerza, velocidad y eficiencia. Un actuador de alto par es pesado y lento, uno rápido tiene poca fuerza, uno eficiente tiene ambas limitadas. Las articulaciones humanas soportan cargas enormes con un consumo bajísimo: un cuádriceps levanta 100 kg consumiendo unos pocos vatios en reposo. Los actuadores robóticos consumen incluso parados para mantener las posiciones. Las tecnologías emergentes (actuadores de serie elástica, motores de imanes permanentes de alta densidad) mejoran, pero cuestan miles de dólares por articulación. Un humanoide con 25-30 actuadores avanzados tiene costes de hardware prohibitivos.

Destreza: la mano humana tiene 27 huesos, 34 músculos, miles de receptores táctiles, más de 26 grados de libertad. Las manos robóticas más avanzadas tienen entre 10 y 16, con sensores táctiles rudimentarios. Agarrar un objeto rígido es manejable; manipular tejidos blandos, objetos frágiles, superficies resbaladizas sigue siendo muy difícil. La retroalimentación táctil de alta resolución requeriría miles de sensores por cm², electrónica compleja, procesamiento en tiempo real. Hoy en día, los robots "sienten" a través de sensores de par en los motores: indirectos e imprecisos. La investigación sobre piel electrónica y sensores táctiles flexibles avanza, pero integrar miles de puntos de detección en una mano funcional es ingeniería extrema.

Estos límites no son errores que se puedan resolver con software: son restricciones físicas. La IA puede mejorar el control y la planificación, pero no puede crear energía de la nada ni aumentar el par de un motor más allá de sus especificaciones. Cada progresión requiere avances en los materiales o diseños radicalmente nuevos. No es cuestión de "si", sino de "cuándo", y el "cuándo" está mucho más lejos de lo que sugieren los comunicados de prensa.

Geografía de las Inversiones

La robótica humanoide es un campo dominado por unos pocos actores concentrados en EE. UU. y China. En 2024, las startups estadounidenses (Figure AI, Apptronik, Agility Robotics) y chinas (UBTech, Fourier Intelligence, Unitree) recaudan en conjunto más de 700 millones de dólares. Los principales inversores: Nvidia, OpenAI, Microsoft, Amazon, fondos soberanos. La concentración es extrema: el 70% del capital fluye hacia cinco empresas.

Nvidia desempeña el papel de "hacedor de reyes" con el Proyecto GR00T, una plataforma de IA para robots humanoides basada en la transferencia de simulación a realidad. Proporciona una pila de software (percepción, planificación, control) y acceso a las GPU H100/H200 necesarias para entrenar modelos de comportamiento. A cambio, las startups integran el hardware de Nvidia y comparten los datos operativos. Es el equivalente robótico del ecosistema CUDA: Nvidia controla la infraestructura computacional, los demás compiten en hardware y aplicaciones.

China persigue una estrategia diferente: inversiones estatales masivas combinadas con capital privado. UBTech tiene robots Walker S operativos en escenarios de hostelería y fabricación; Unitree vende cuadrúpedos de consumo por 1.600 dólares; Fourier Intelligence exporta exoesqueletos de rehabilitación. El enfoque es pragmático: productos más sencillos y menos costosos, escalado rápido, subsidio gubernamental para el despliegue doméstico. Mientras que EE. UU. aspira al humanoide de propósito general de 20.000 dólares en diez años, China vende hoy robots especializados de 5.000 dólares.

Europa está a la zaga. Proyectos como ARISE, financiados por Horizonte Europa con presupuestos totales inferiores a 50 millones, realizan una investigación excelente pero no escalan hacia productos. Las startups europeas (Clone Robotics, Reachy de Pollen Robotics) siguen siendo pequeñas por falta de capital riesgo dispuesto a arriesgar miles de millones. La UE invierte más en regulación (Ley de IA, normas de seguridad) que en despliegue. Resultado: investigación publicada en Nature, productos vendidos por otros.

Esta concentración crea riesgos: pocas empresas controlan los datos, los algoritmos, la cadena de suministro. Si se produce un avance, será propietario y su licencia será costosa. La alternativa de código abierto existe (ROS, sistema operativo para robots), pero tiene una tracción limitada en el ámbito comercial por falta de soporte empresarial. El riesgo no es solo económico, sino geopolítico: la robótica avanzada se convierte en una palanca estratégica como los semiconductores y la IA, con las mismas dinámicas de dependencia tecnológica.

Las Preguntas Incómodas

Impacto en el empleo: El IFR estima que a finales de 2024 habrá 4,2 millones de robots industriales operativos en todo el mundo, un 7% más que el año anterior. Cada robot sustituye de media a entre 1,5 y 3 trabajadores en tareas repetitivas. Pero también crea demanda de técnicos, programadores, personal de mantenimiento. El Informe sobre el Futuro de los Empleos 2023 del Foro Económico Mundial prevé que la automatización eliminará 83 millones de puestos de trabajo para 2027, pero creará 69 millones de nuevos. La transición neta negativa de 14 millones esconde, sin embargo, enormes disparidades: los puestos que se pierden son operativos, los que se crean requieren habilidades técnicas avanzadas. Quien hoy ensambla componentes manualmente no se convierte mañana en programador de ROS sin una recualificación masiva que la mayoría de los países no está financiando adecuadamente.

Costes ocultos: cada robot en producción tiene costes operativos que a menudo se ignoran en los casos de negocio. Gestión de flotas, monitorización 24/7, actualizaciones de software, sustitución de piezas, tiempo de inactividad imprevisto. McKinsey documenta que el TCO (coste total de propiedad) de la robótica suele ser 2-3 veces el precio de compra a lo largo de cinco años. Para los despliegues masivos también se necesita infraestructura física: suelos ultraplanos, iluminación controlada, áreas segregadas para la carga y el mantenimiento. Estos costes hacen que la automatización solo sea rentable por encima de ciertas escalas de producción, excluyendo a las pequeñas y medianas empresas.

Ética sanitaria: los robots asistenciales en el cuidado de ancianos plantean cuestiones no resueltas. Pueden monitorizar los parámetros vitales, recordar las terapias, reducir las caídas. Pero, ¿un anciano que interactúa principalmente con una máquina experimenta un mayor aislamiento social? Estudios en Japón, donde se han probado robots como Pepper en residencias de ancianos, muestran resultados mixtos: beneficios funcionales (recordatorios, monitorización) pero una reducción significativa de la interacción humana. El riesgo es que la automatización se convierta en una excusa para reducir el personal sanitario, con robots que "llenan el vacío" creado por las decisiones económicas. El problema no es la tecnología, sino cómo se aplica y para qué fines.

Plazos realistas: pregunte a diez expertos cuándo tendremos robots domésticos de propósito general asequibles y obtendrá diez respuestas diferentes. Rodney Brooks, fundador de iRobot y Rethink Robotics, es escéptico: "No antes de 2040, quizás nunca". Demis Hassabis, de Google DeepMind, es optimista: "A mediados de la década de 2030 para aplicaciones limitadas". Los analistas de Goldman Sachs prevén un mercado de masas después de 2035. El consenso tácito es que los escenarios restringidos (logística, fabricación, hostelería) verán escalar los robots especializados en los próximos 5-7 años, mientras que el humanoide doméstico que cocina y limpia de forma autónoma sigue siendo ciencia ficción durante al menos la próxima década.

2025: ¿Año Cero o Ciclo de Hype?

¿Dónde estamos realmente? La respuesta depende de la robótica que observemos. Cirugía: madura, fiable, en expansión. Cobots industriales: despliegue masivo en curso, ROI probado. Logística especializada: robots móviles autónomos en los almacenes de Amazon, DHL, escalan rápidamente. Estos funcionan porque la tarea es específica, el entorno está controlado y hay un respaldo humano disponible.

Humanoides de propósito general: máximo hype, mínimo despliegue. Los prototipos impresionan, las demostraciones son espectaculares, las inversiones multimillonarias. Pero todavía falta el salto de "funciona en el laboratorio con supervisión" a "funciona de forma autónoma durante turnos de ocho horas en escenarios impredecibles". Ese salto no requiere un avance, sino docenas: baterías, actuadores, sensores, materiales, algoritmos, costes.

La paradoja de Moravec, formulada en los años 80, afirmaba que las tareas cognitivas complejas (ajedrez, cálculo) son fáciles para los ordenadores, mientras que las tareas sensoriomotoras simples (caminar, manipular) son muy difíciles. La IA ha superado la parte cognitiva: GPT-4 supera a los seres humanos en muchas tareas lingüísticas. Pero la encarnación física sigue siendo un cuello de botella. Que un robot te haga una tortilla sigue siendo más difícil que que te escriba una novela.

Como en la película Her de Spike Jonze, donde la IA Samantha está íntimamente presente pero físicamente ausente, podríamos descubrir que la inteligencia artificial transforma radicalmente nuestras vidas a través de interfaces de software mucho antes que a través de cuerpos robóticos. Cuando la inteligencia está en todas partes pero no tiene manos, la pregunta es: ¿necesitamos realmente robots humanoides o intentamos replicarnos a nosotros mismos por narcisismo antropocéntrico?

La respuesta no vendrá de los laboratorios de Boston o Palo Alto, sino de las fábricas, los hospitales y los almacenes donde los robots especializados ya trabajan en silencio, resolviendo problemas reales sin parecer humanos. El hype cuenta una historia. La ingeniería escribe otra, más lenta y menos glamurosa, pero real. Y en 2025, lo que funciona de verdad casi nunca se parece a la ciencia ficción que hemos imaginado.