Informe AI Index 2026 de Stanford: la IA acelera, la gobernanza frena

Un cincuenta y tres por ciento de adopción global en tres años, más rápido que Internet y el ordenador personal. Un ochenta y ocho por ciento de las organizaciones que declara usar la IA. Un benchmark de programación, SWE-bench Verified, que ha pasado del 60% a casi el 100% en doce meses. Inversiones privadas en EE. UU. de 285.900 millones de dólares, veintitrés veces las de China. Una brecha de cincuenta puntos porcentuales entre lo que los expertos esperan de la IA y lo que piensa el público. Estos cinco números encuadran el perímetro del 2026 AI Index Report de Stanford HAI: novena edición de un documento que funciona como espejo despiadado de un sector que acelera mucho más rápido de lo que nadie logra medir, regular o absorber socialmente.

Estructurado en ocho capítulos (investigación y desarrollo, rendimiento técnico, IA responsable, economía, ciencia, medicina, educación, gobernanza y opinión pública) y alimentado por datos de Epoch AI, LinkedIn, GitHub, McKinsey y la OCDE, el informe abre con una premisa que es casi una confesión: "Los datos no apuntan en una única dirección. Revelan un campo que escala más rápido que los sistemas que lo rodean". No es retórica. Es el hilo que recorre todo el documento.

Los números que no mienten

Antes de entrar en detalles, vale la pena detenerse en lo que el informe comunica con más fuerza. La IA generativa ha alcanzado el 53% de adopción a nivel de población en menos de tres años: para hacer lo mismo, el ordenador personal empleó más de una década. El 91,6% de los modelos "notables" en 2025 es producido por la industria privada, frente a un solo modelo académico identificado en todo el año. La universidad, que construyó los cimientos de este campo, es hoy casi irrelevante en la producción de los sistemas en la frontera del conocimiento. El valor económico de las herramientas de IA generativa solo para los consumidores estadounidenses alcanzó los 172.000 millones de dólares anuales, con el valor medio por usuario triplicado en un año, y casi todo accesible de forma gratuita: una de las transferencias de valor tecnológico más asimétricas de la historia reciente.

La frontera dentada: donde los modelos sobresalen y donde todavía fallan

Hay una imagen en el informe que vale más que mil gráficos. Gemini Deep Think de Google ganó una medalla de oro en la Olimpiada Matemática Internacional 2025, compitiendo contra los mejores estudiantes de secundaria matemáticos del planeta. El mismo modelo, o modelos del mismo nivel, lee correctamente un reloj analógico solo el 50,1% de las veces. En la práctica, poco mejor que lanzar una moneda al aire.

Este es el concepto de jagged frontier (frontera dentada), que el informe usa como clave interpretativa del momento actual. Los sistemas de IA no son ni omnipotentes ni triviales: son extraordinariamente capaces en ciertos dominios y sorprendentemente frágiles en otros, a menudo sin que haya una lógica intuitiva que guíe la distinción. La matemática olímpica es una tarea estructurada, simbólica, con reglas precisas y verificables. Leer un reloj requiere percepción espacial y mapeo visual-semántico, algo que para los modelos actuales sigue siendo difícil.

¿Dónde han sido más evidentes los progresos en el último año? En el código: el benchmark SWE-bench Verified, que mide la capacidad de resolver incidencias reales en repositorios de GitHub, pasó del 60% a casi el 100% respecto a la línea de base humana en un solo año. En los agentes autónomos: en OSWorld, pruebas sobre tareas reales que simulan el uso de un ordenador con sistema operativo, la tasa de éxito saltó del 12% a aproximadamente el 66%. En los benchmarks científicos: varios modelos de frontera ahora igualan o superan la línea de base humana en preguntas de nivel de doctorado en física, química y matemáticas.

¿Dónde, en cambio, los límites siguen siendo profundos? En la robótica física: los robots solo logran el 12% de las tareas domésticas, a pesar de alcanzar el 89,4% en simulaciones en entornos controlados. La brecha entre el laboratorio y una cocina real es todavía un abismo. Y en los razonamientos que requieren juicio contextual, sentido común o comprensión de los subtextos comunicativos: aquí los modelos muestran las grietas más evidentes, aquellas que menos se prestan a ser medidas por un benchmark.

La comparación con 2025 es iluminadora. El año pasado el informe documentaba la llegada de la IA como fuerza mainstream. Este año documenta lo que sucede después de la llegada: saturación de los benchmarks (cada vez más modelos los superan, haciéndolos menos informativos), creciente opacidad de los laboratorios (menos transparencia sobre parámetros, conjuntos de datos, computación) y una divergencia entre las capacidades declaradas por los desarrolladores y las verificadas por pruebas independientes. Es la diferencia entre un estreno cinematográfico y la secuela: más grande, más cara, pero con menos sorpresas.

EE. UU. vs. China: el sorpasso que no existe (todavía)

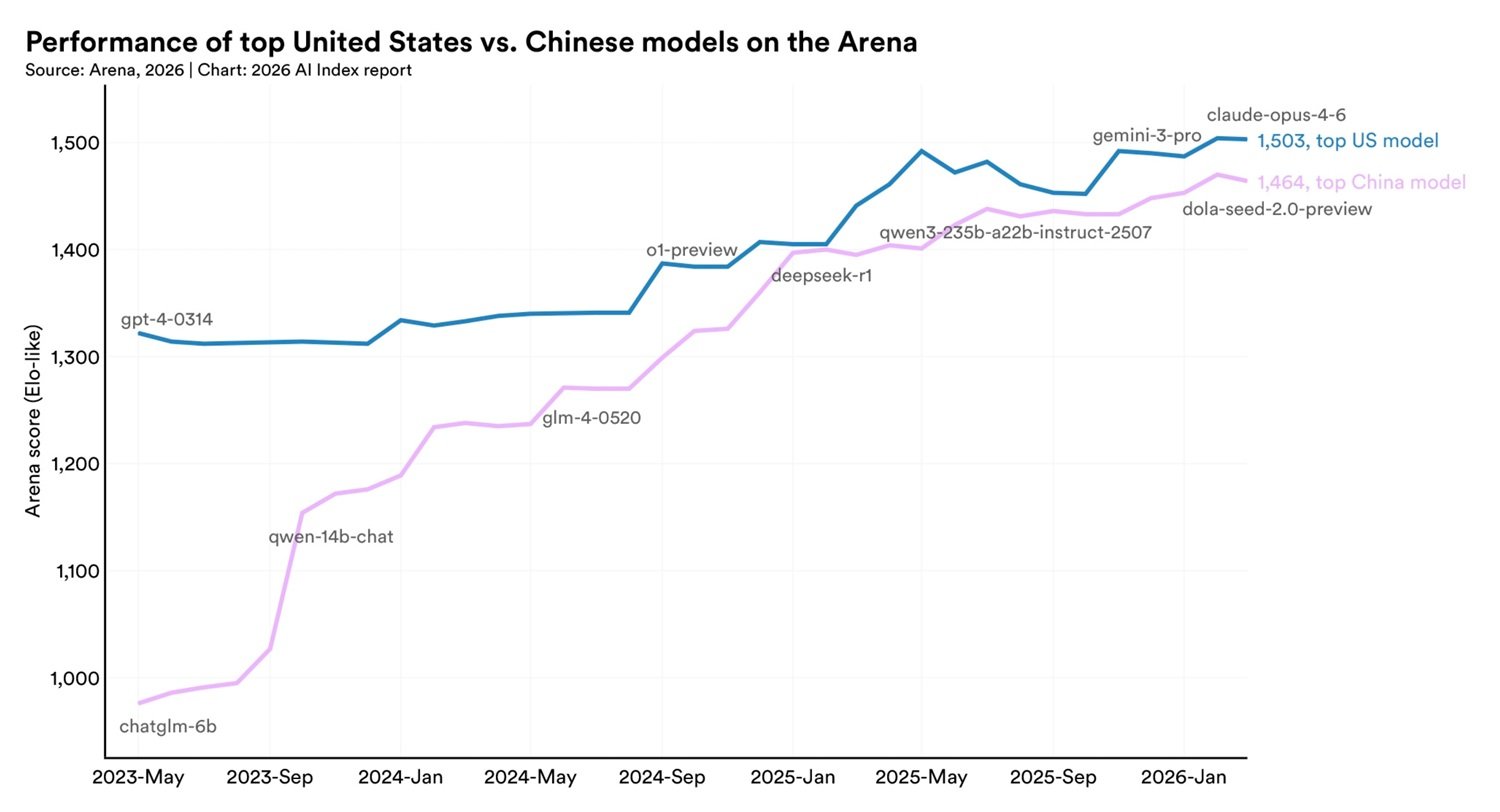

El capítulo geopolítico del informe es probablemente el más seguido por los responsables políticos e industriales. Y los datos de 2026 confirman una tendencia que quienes siguen este sector ya habían intuido: la ventaja estadounidense en los modelos de frontera se ha reducido a una distancia casi simbólica.

En febrero de 2025, DeepSeek-R1 igualó brevemente al mejor modelo estadounidense disponible. En marzo de 2026, el modelo estrella de Anthropic lidera la clasificación con un margen del 2,7% sobre el mejor modelo chino. En un campo donde los benchmarks se actualizan cada semana, 2,7 puntos porcentuales no es una ventaja estratégica: es ruido estadístico. Los modelos de los dos países se han intercambiado la cabeza de la clasificación varias veces a lo largo del último año.

Este dato debe leerse junto con la estructura más amplia de la competición. Estados Unidos sigue por delante en la producción de modelos notables (50 en 2025 frente a 30 de China) y en patentes de alto impacto. China lidera, en cambio, en el volumen de publicaciones científicas, en las citas, en la producción de patentes total y en las instalaciones de robots industriales. Pekín aumentó su cuota de los 100 artículos de IA más citados del mundo de 33 en 2021 a 41 en 2024. Corea del Sur emerge como un caso atípico de densidad innovadora: primera del mundo en patentes de IA per cápita.

El cuadro es el de una competición tecnológica transformada en paridad armada más que en predominio unilateral. Quien lea estos datos a la luz de los bloqueos a las exportaciones de chips y de la guerra de los semiconductores no puede evitar preguntarse si esas medidas han obtenido el resultado esperado. La respuesta que surge de Stanford es incómoda: probablemente no.

En AITalk hemos seguido esta trayectoria de cerca. El año pasado documentábamos las capacidades de GLM-5 de Zhipu AI, un modelo chino que ya entonces mostraba un rendimiento competitivo en benchmarks multimodales. En el análisis sobre la guerra de la IA entre EE. UU. y China habíamos destacado cómo las restricciones estadounidenses estaban, paradójicamente, acelerando la autonomía tecnológica china en el campo de los chips y los modelos. Kimi K2 de Moonshot AI y, sobre todo, DeepSeek, con su capacidad para producir modelos competitivos a costes drásticamente inferiores, han hecho realidad esa previsión. El informe de Stanford no hace más que añadir el sello cuantitativo a una historia que ya se estaba escribiendo.

Un elemento que el informe añade a este escenario es la fuga de talentos estadounidense, que representa quizás la grieta más subestimada en la primacía de EE. UU. El número de investigadores y desarrolladores de IA que se trasladan a Estados Unidos se ha desplomado un 89% respecto a 2017, con una caída del 80% en el último año. Estados Unidos sigue siendo el país con el mayor stock de talentos de IA, pero atrae nuevos cerebros al ritmo más bajo de los últimos diez años. Es el tipo de indicador que no impacta en los benchmarks de hoy pero que define la trayectoria de los próximos cinco años.

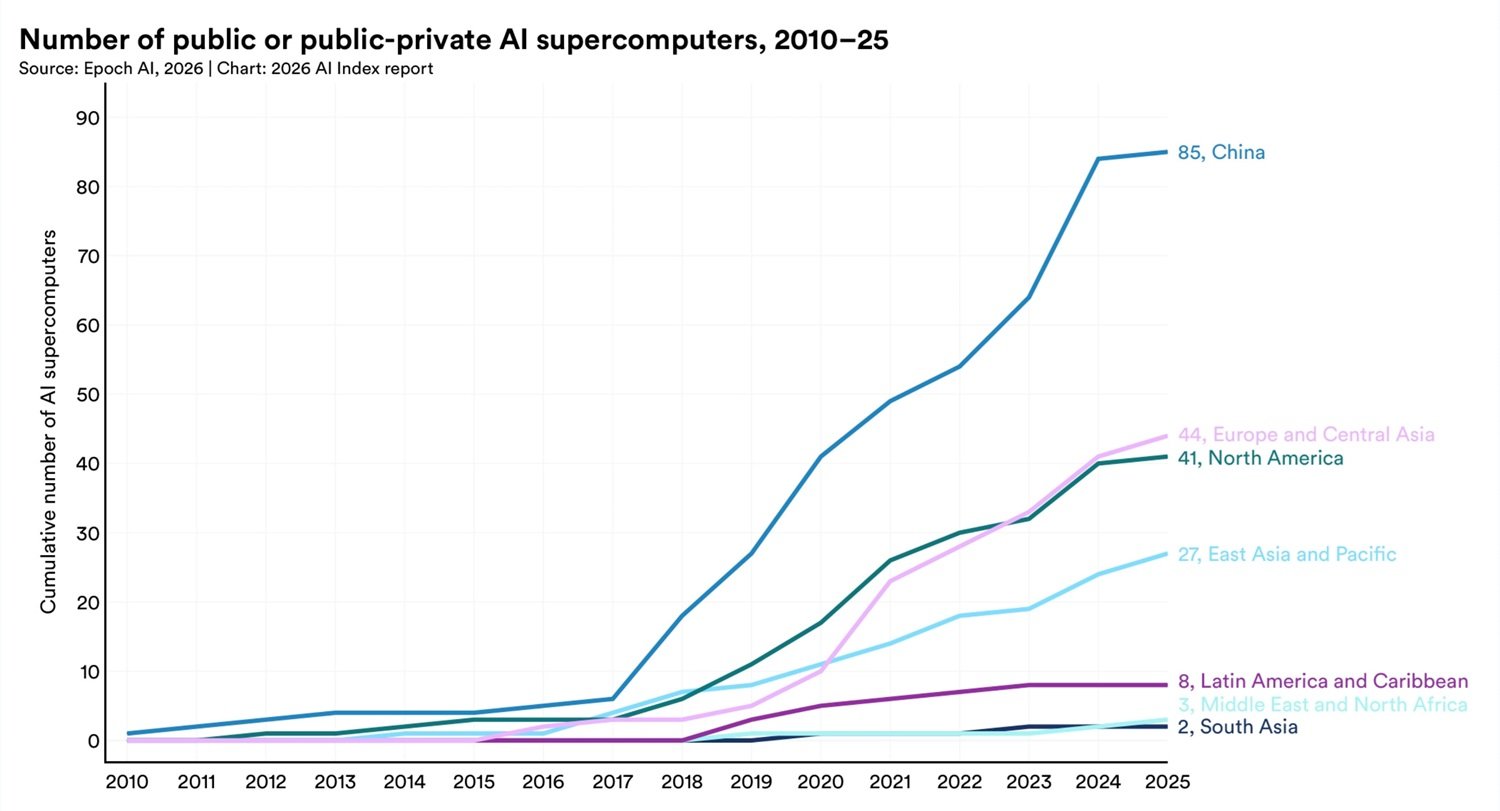

La infraestructura frágil del mundo

Detrás de cada respuesta generada por un modelo de IA hay una cadena de suministro material de proporciones enormes y fragilidad estructural subestimada. Estados Unidos alberga 5.427 centros de datos de IA, más de diez veces que cualquier otro país, y consume más energía que cualquier otra región para este fin. La capacidad de procesamiento global para la IA ha crecido 3,3 veces al año desde 2022, alcanzando el equivalente a 17,1 millones de tarjetas Nvidia H100. Nvidia controla más del 60% de este cómputo.

El dato más relevante geopolíticamente es, sin embargo, otro. Casi todos los chips que alimentan esta infraestructura son producidos por una única empresa: TSMC, con sede en Taiwán. El informe lo afirma sin perifrasis: la cadena de suministro de hardware global de la IA depende de una única fundición en una isla en disputa. Hay pocas comparaciones para esta concentración de riesgo sistémico, quizás la dependencia energética europea del gas ruso antes de 2022, pero con una diferencia crucial: no existe, para los chips de IA, un proveedor alternativo ya preparado. TSMC inició una primera expansión en Arizona en 2025, pero la capacidad estadounidense sigue siendo una fracción de la taiwanesa.

El impacto ambiental completa el cuadro. El entrenamiento de Grok 4 produjo aproximadamente 72.816 toneladas de CO₂ equivalente. La capacidad de alimentación de los centros de datos de IA alcanzó los 29,6 gigavatios, comparable al pico de consumo de todo el estado de Nueva York. Las estimaciones sobre el consumo de agua de la inferencia de GPT-4o indican un uso anual que podría superar las necesidades de 12 millones de personas. La IA no es una industria virtual: tiene un cuerpo físico, y ese cuerpo crece más rápido que nuestras infraestructuras energéticas.

Trabajo, adopción y valor: quién gana, quién pierde

El capítulo de economía del informe es el más esperado por los no técnicos, y este año aporta datos más granulares de lo habitual. La productividad en sectores como la atención al cliente y el desarrollo de software ha aumentado entre un 14% y un 26% en contextos donde la IA se ha introducido de forma estructurada. Los efectos, sin embargo, no son uniformes: las ganancias son más fuertes en las tareas rutinarias y más débiles, o incluso negativas, en las tareas que requieren un juicio complejo.

El dato más discutido se refiere a los jóvenes desarrolladores estadounidenses. En la franja de 22 a 25 años, el empleo en el sector del software cayó casi un 20% en 2024, mientras que el número de desarrolladores sénior sigue creciendo. El informe evita convertir la correlación en causalidad, pero la asociación es difícil de ignorar: las ganancias de productividad de la IA se concentran exactamente en las tareas típicamente asignadas a perfiles junior, y el impacto en el empleo se materializa exactamente en esa franja. Es como si la IA estuviera comprimiendo el nivel de entrada de la profesión, borrando el camino de aprendizaje que durante décadas transformó a los graduados en desarrolladores expertos.

El modelo de adopción tiene características geográficas sorprendentes. Singapur está al 61%, los Emiratos Árabes Unidos al 54%, ambos por encima de las expectativas respecto al PIB per cápita. Estados Unidos, sede de los principales desarrolladores de IA, se sitúa en el puesto 24 con el 28,3%: la proximidad a la industria no basta para generar una adopción generalizada.

Gobernanza, seguridad, transparencia: el retraso sistémico

El capítulo más preocupante del informe no es el de las capacidades técnicas, sino el de la IA responsable. Casi todos los laboratorios principales publican resultados en benchmarks de capacidad. Pero la cobertura de los benchmarks de seguridad, imparcialidad (fairness) y gobernanza sigue siendo esporádica y heterogénea, lo que imposibilita cualquier comparación sistemática. Los incidentes documentados relacionados con la IA aumentaron a 362 en 2025, desde los 233 de 2024. Y el informe señala un problema técnico insidioso: mejorar una dimensión de la IA responsable, por ejemplo la seguridad, puede degradar otra, como la precisión.

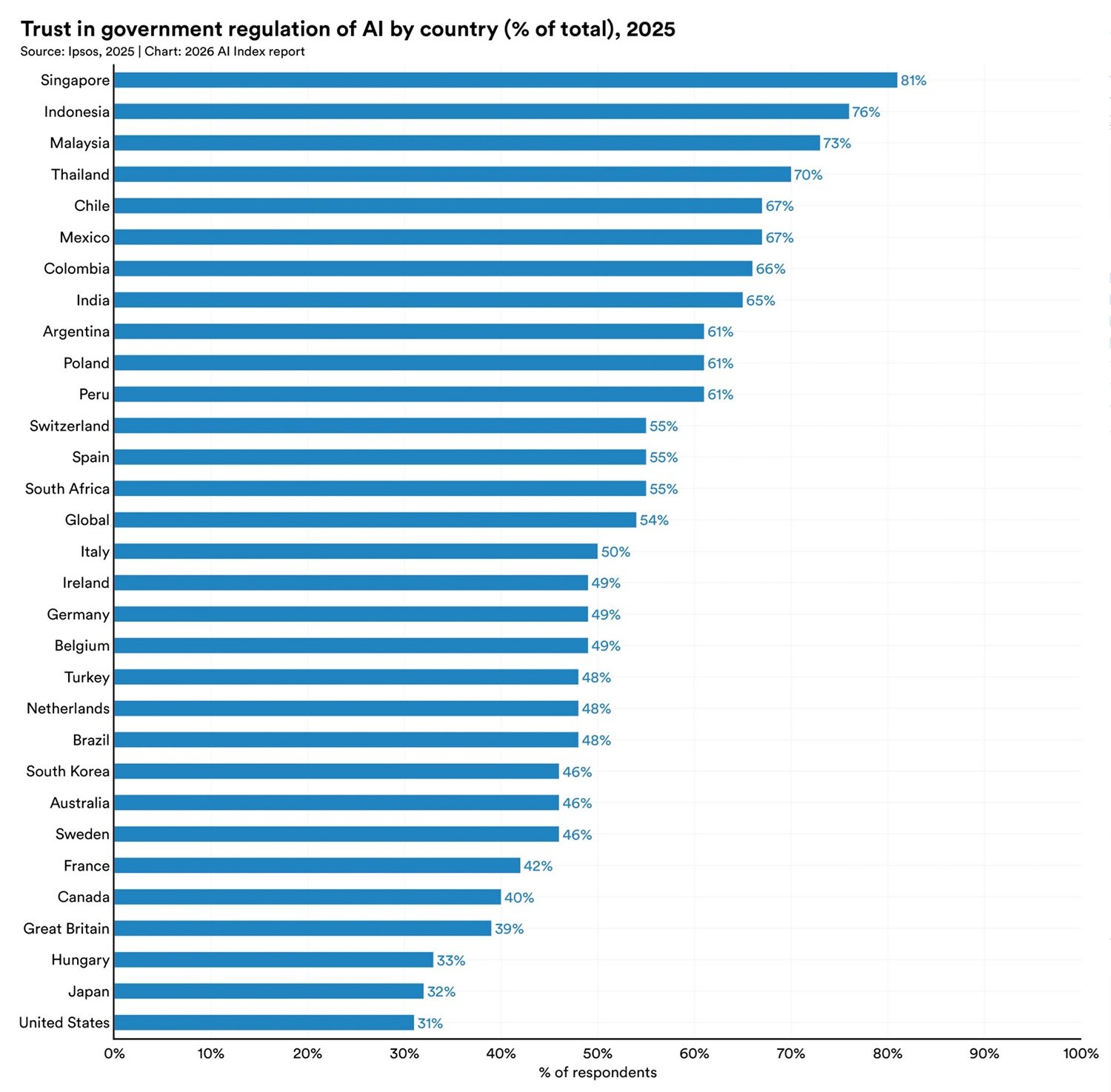

En el plano de la gobernanza, 2025 ha visto movimientos en direcciones opuestas. La Ley de IA de la UE hizo entrar en vigor las primeras prohibiciones. Estados Unidos viró hacia la desregulación. Japón, Corea del Sur e Italia aprobaron leyes nacionales. Más de la mitad de las nuevas estrategias nacionales adoptadas en 2025 proviene de países en desarrollo que entran por primera vez en el debate normativo. La soberanía de la IA (la capacidad de controlar de forma autónoma la propia infraestructura y los propios modelos) se ha convertido en el principio organizativo central de muchas de estas estrategias.

El dato sobre la confianza pública es el más desconcertante de todo el informe. Entre los países incluidos en la encuesta, Estados Unidos muestra el nivel más bajo de confianza en su propio gobierno para la regulación de la IA: un 31%. La Unión Europea es considerada más fiable que Estados Unidos o China. Para el país que alberga a OpenAI, Google DeepMind, Anthropic y xAI, es un veredicto que dice mucho sobre el divorcio entre la capacidad industrial y la legitimidad regulatoria. La brecha de perspectiva entre expertos y público sintetiza todo esto: el 73% de los expertos espera un impacto positivo de la IA en su trabajo, frente a solo el 23% del público. Cincuenta puntos porcentuales de distancia en una de las cuestiones centrales de nuestro tiempo.

IA en la ciencia, la medicina y la educación

El informe 2026 introduce por primera vez dos capítulos independientes sobre ciencia y medicina. En el ámbito científico, los modelos de frontera superan de media a los químicos humanos en el benchmark ChemBench, y un modelo genómico de 200 millones de parámetros batió a sistemas casi doscientas veces más grandes. La ley de "cuanto más grande mejor" se resquebraja en los dominios especializados. Pero los mismos modelos obtienen puntuaciones inferiores al 20% en la replicación de experimentos astrofísicos: la frontera dentada también se aplica en el laboratorio.

En medicina, las herramientas de documentación automática, que generan la nota clínica a partir de la entrevista paciente-médico, vieron una adopción significativa en 2025, con médicos que informan de hasta un 83% de ahorro de tiempo en la redacción. El problema es la evidencia: una revisión de más de 500 estudios clínicos reveló que casi la mitad usaba preguntas de examen en lugar de datos reales sobre los pacientes, y solo el 5% se basaba en datos clínicos auténticos. La brecha entre promesa y prueba es todavía amplia.

En educación, más del 80% de los estudiantes usa la IA para las tareas escolares, pero solo la mitad de las escuelas tiene políticas en vigor y apenas el 6% de los profesores las considera claras. Los nuevos doctorados en IA en EE. UU. y Canadá crecieron un 22% entre 2022 y 2024, pero ese incremento se dirigió íntegramente hacia el mundo académico, no hacia la industria. Más formación de alto nivel, menos transferencia directa al sector productivo: una paradoja que el informe registra sin resolverla.

Las preguntas abiertas: quién controla, quién se beneficia, quién paga

El informe de Stanford no concluye con respuestas. Concluye con preguntas, y esta es su cualidad más valiosa en un sector donde las certezas se venden a precios de mercado.

Sobre el control: la producción de modelos sigue concentrada en muy pocas organizaciones privadas, y los mejores sistemas del mundo son cada vez menos trasparentes (80 de los 95 modelos notables de 2025 se lanzaron sin código de entrenamiento). Quien no sea Google, OpenAI, Anthropic, Alibaba o DeepSeek opera en un ecosistema que depende de decisiones que no controla. Sobre el valor: la IA genera riqueza medible, pero su distribución es fuertemente asimétrica (unos pocos operadores recogen los ingresos, los trabajadores junior empiezan a pagar el precio de la automatización, los consumidores reciben herramientas gratuitas con dependencias y riesgos todavía poco comprendidos). Sobre los costes: la huella ambiental crece sin que se le ponga precio, los roles junior desaparecen junto con el camino de formación que produce a los expertos del mañana, y los costes de gobernanza se acumulan silenciosamente mientras los benchmarks de capacidad suben.

Cada tecnología trasformativa rediseña las infraestructuras, el trabajo y el poder. El informe de Stanford 2026 documenta, con los datos en la mano, que la IA está haciendo exactamente esto, más rápido de lo que nuestros sistemas de medición, regulación y adaptación logran seguir. La noticia no es que la IA mejore. Es que la brecha entre su velocidad y nuestra capacidad para gestionarla se agranda con cada edición del informe. Y esta, por ahora, es la frontera más dentada de todas.