El MIT cumple la promesa de las gafas de rayos X

Quien fuera joven entre finales de los 70 y principios de los 80 recordará bien esa sensación que llegaba al hojear las últimas páginas de *L'Intrepido o de Lanciostory: en medio de los anuncios de bolígrafos y cursos de dibujo por correspondencia, destacaba una publicidad que prometía lo imposible. Gafas de rayos X. Reales. Por unas pocas liras, envío incluido. La promesa era cristalina: póntelas y verás a través de cualquier cosa. Muros, cajas, ropa. La realidad, como descubría amargamente cada chico que cedía a la tentación, era mucho más prosaica: un cartoncillo con un curioso efecto óptico basado en la difracción de la luz, capaz como mucho de hacer que la propia mano pareciera transparente. Una estafa digna de Totò, una ilusión barata.*

Ese sueño, sin embargo, nunca desapareció del todo. Solo se trasladó a los laboratorios de investigación, donde durante décadas ingenieros y físicos han buscado formas concretas de ver lo que los ojos humanos no pueden alcanzar. Y el 19 de marzo de 2026, el MIT publicó los resultados de una investigación que, sin exagerar, representa el paso más convincente hacia aquella promesa engañosa de los años ochenta: un sistema capaz de reconstruir objetos ocultos y entornos enteros utilizando señales de radio reflejadas, guiado por modelos de inteligencia artificial generativa. Nada de gafas de cartón esta vez. Dos artículos aceptados en la conferencia IEEE CVPR, uno de los foros más autorizados del mundo en el campo de la visión artificial, y un laboratorio que desde hace más de una década acumula resultados considerados imposibles.

El problema físico que mantuvo todo en espera durante veinte años

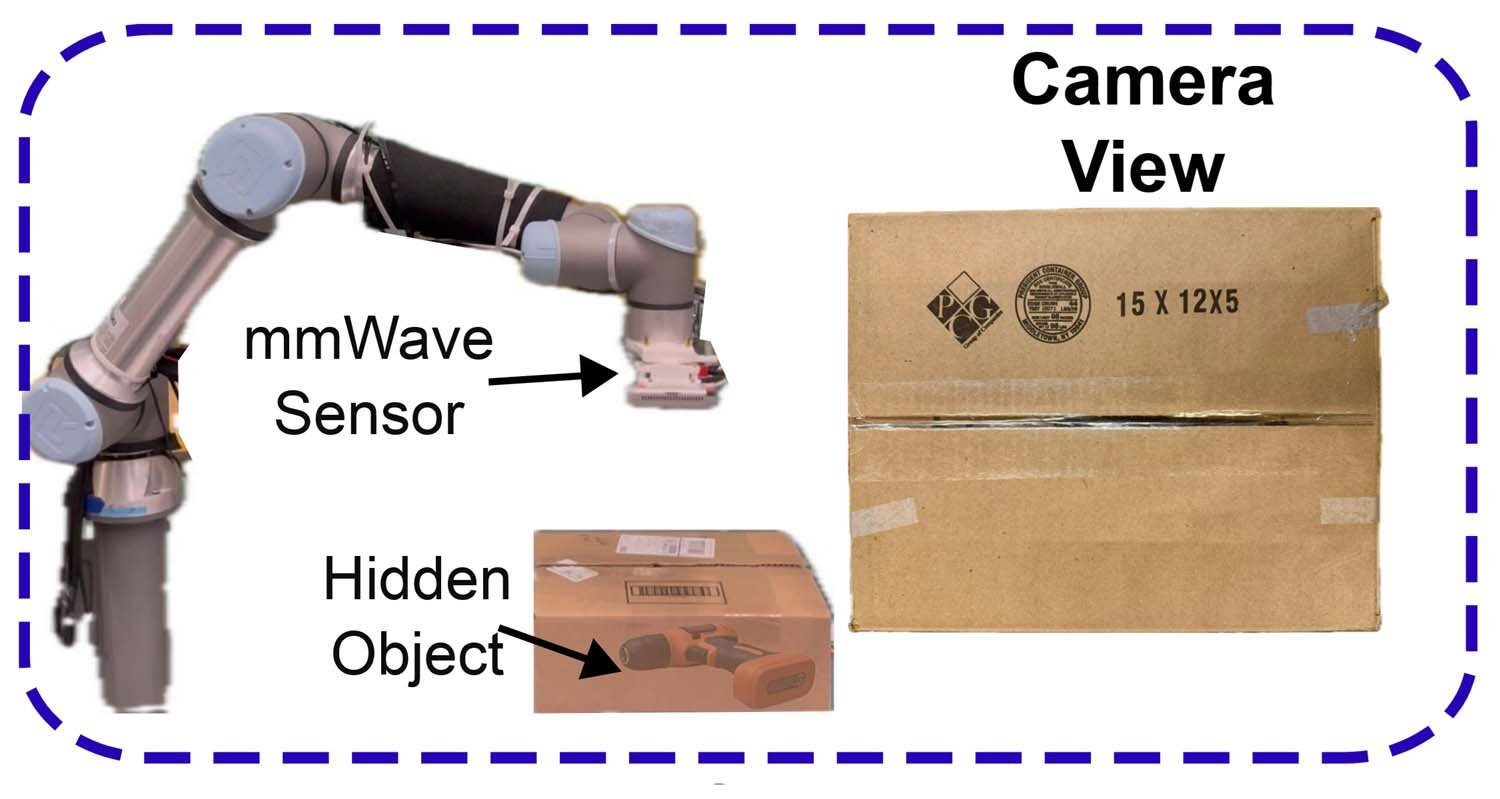

Para entender por qué esta investigación es relevante, hay que dar un paso atrás y afrontar una cuestión de física honesta. Las ondas milimétricas, o mmWave, son señales de radio de muy alta frecuencia, las mismas que se utilizan en las redes Wi-Fi de última generación y en los radares de los automóviles. Tienen una propiedad muy útil: atraviesan con relativa facilidad materiales comunes como el cartón, el plástico, la madera y el yeso. Esto las hace, en teoría, perfectas para "ver" lo que se encuentra al otro lado de una pared o escondido bajo una pila de objetos.

El problema es otro y tiene un nombre técnico preciso: specularity, o reflexión especular. Cuando una onda milimétrica golpea una superficie, tiende a rebotar en una sola dirección, como la luz en un espejo. Esto significa que el sensor solo logra capturar una porción limitada de la superficie del objeto oculto: típicamente la parte más alta, la que refleja la señal directamente hacia el receptor. El lado inferior, los flancos, las superficies inclinadas: todo invisible. Como intentar reconstruir la forma de una escultura tocándola con un solo dedo, siempre desde el mismo ángulo.

Los investigadores del grupo Signal Kinetics del MIT Media Lab ya habían obtenido resultados significativos en este campo. En el verano de 2025 habían presentado mmNorm, un sistema capaz de estimar las normales de superficie de los objetos ocultos, ganando el Best Paper Runner-up y el Best Poster Award en ACM MobiSys. Pero el problema de la specularity seguía siendo un techo de cristal: las reconstrucciones eran parciales, precisas donde llegaba la señal, ciegas en el resto. Hacía falta algo cualitativamente distinto para el siguiente salto.

Wave-Former: cuando la IA aprende a imaginar lo que no ve

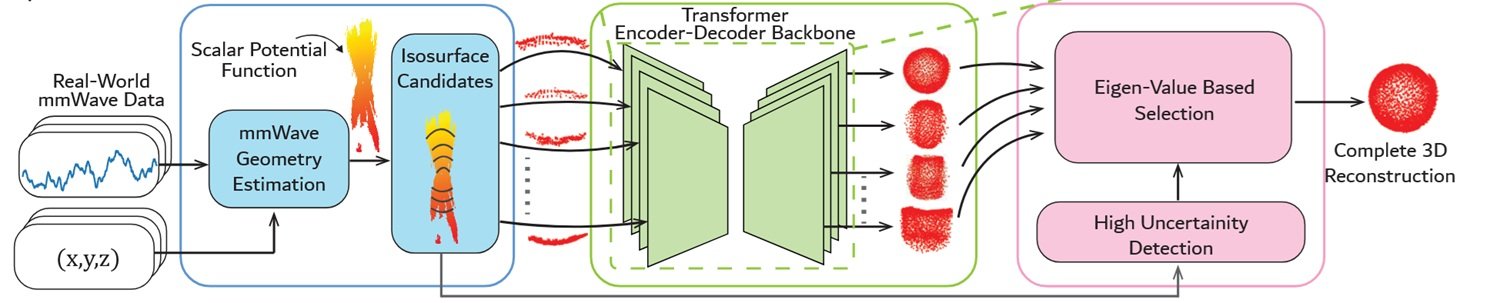

La solución que el equipo ha encontrado es, bien pensado, elegante en su lógica: si el sensor físico no puede recoger suficientes datos para reconstruir toda la forma de un objeto, se entrena un modelo de inteligencia artificial generativa para imaginar las partes que faltan. No una invención arbitraria, sino una inferencia guiada por la física: el sistema sabe cómo se comportan las ondas milimétricas, conoce las propiedades de la reflexión especular y aprende a completar la forma plausible de un objeto partiendo de una reconstrucción parcial.

El sistema se llama Wave-Former y funciona en tres fases. Primero, construye una reconstrucción parcial del objeto oculto a partir de las señales mmWave reflejadas. Luego, pasa esta reconstrucción incompleta a un modelo generativo, que propone cómo podría ser la forma completa. Finalmente, refina iterativamente las superficies hasta obtener una reconstrucción final coherente.

El nudo más interesante, desde el punto de vista técnico, es cómo el equipo ha resuelto el problema del entrenamiento. Los modelos de inteligencia artificial generativa funcionan bien cuando tienen a su disposición grandes cantidades de datos de entrenamiento. GPT, Claude, Llama: todos se basan en conjuntos de datos de dimensiones astronómicas. Pero no existe un conjunto de datos lo suficientemente grande de escaneos mmWave de objetos ocultos, y construir uno de cero habría requerido, como explica Maisy Lam, una de las investigadoras implicadas, literalmente años de recopilación de datos. Por ello, el equipo adoptó una estrategia indirecta: tomó los grandes conjuntos de datos existentes de visión artificial, aquellos con millones de imágenes 3D de objetos comunes, y los transformó para simular las propiedades físicas de la reflexión mmWave, incluyendo la specularity y el ruido característico de estas señales. Un conjunto de datos sintético pero físicamente preciso, construido con un proceso que incorpora directamente la física de las ondas en las imágenes de entrenamiento.

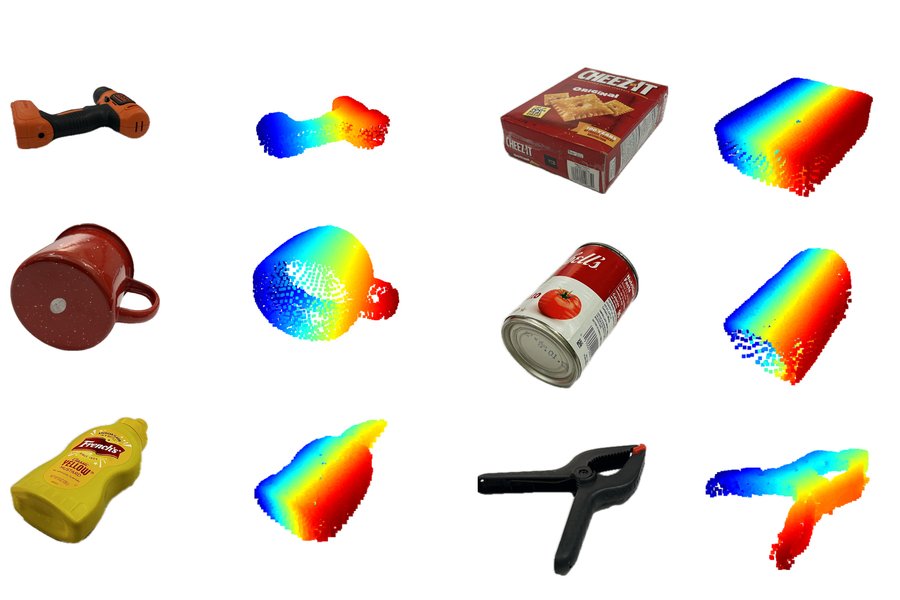

Los resultados son sólidos. Wave-Former ha sido probado en unos 70 objetos de uso cotidiano, latas, cajas, cubiertos, fruta, escondidos detrás o debajo de diferentes materiales: cartón, madera, yeso, plástico, tela. En comparación con los métodos anteriores considerados el estado del arte, el sistema obtuvo una mejora de casi el 20% en la precisión de la reconstrucción, medida con la métrica Chamfer error, que cuantifica cuánto se desvía la forma reconstruida de la real.

RISE: los fantasmas que dibujan las habitaciones

El segundo sistema presentado en los artículos se llama RISE, y lleva el concepto aún más lejos. En lugar de reconstruir objetos ocultos individuales, RISE reconstruye habitaciones enteras, incluyendo todos los muebles presentes, utilizando un único radar fijo y sin que ningún sensor se mueva por el entorno.

El mecanismo que aprovecha es contraintuitivo. Cuando una persona se mueve en una habitación, las ondas mmWave emitidas por el radar no rebotan solo en la persona: algunas ondas reflejadas por la figura humana rebotan luego en una pared o en un mueble, y solo después llegan al sensor. Estas reflexiones secundarias, llamadas señales "fantasma" porque aparecen como copias desplazadas de la fuente original, suelen ignorarse o filtrarse como ruido. Contienen, sin embargo, información valiosa: dado que su posición cambia mientras la persona se mueve, y dado que su trayectoria depende de la geometría de la habitación, analizando cómo varían en el tiempo es posible inferir dónde se encuentran las paredes y los muebles.

El problema es que esta inferencia directa produce reconstrucciones muy toscas e imprecisas. Aquí es donde interviene el modelo generativo: al igual que en el caso de Wave-Former, el sistema utiliza la IA para tomar un mapa tosco del entorno y refinarlo hasta obtener una representación creíble de la habitación. RISE ha sido validado en más de 100 trayectorias humanas registradas en entornos reales, con un único radar estático. La mejora respecto a los métodos anteriores es aún más marcada: las reconstrucciones resultan de media dos veces más precisas que las obtenibles con las técnicas preexistentes.

El laboratorio de lo imposible y su fundador

Detrás de estos resultados se encuentra el Signal Kinetics Group, que Fadel Adib dirige en el MIT Media Lab. Adib es un investigador libanés-estadounidense, graduado en la Universidad Americana de Beirut con el GPA más alto en la historia registrada digitalmente de la institución, y posteriormente máster y doctorado en el MIT. Su tesis doctoral, que le valió el ACM SIGMOBILE Dissertation Award, ya trataba sobre ver a través de las paredes utilizando el Wi-Fi. De aquel trabajo nació Emerald Innovations, una startup cuyos dispositivos se utilizan hoy para el seguimiento remoto de la salud de miles de pacientes.

El currículum de Adib es el tipo de lista que resulta casi molesta por su densidad: entre Forbes 30 Under 30, Technology Review's 35 Innovators Under 35, Sloan Research Fellowship, ACM SIGMOBILE Rockstar Award, ACM MobiCom Best Paper Award, ONR Young Investigator Award y NSF CAREER Award, también tuvo el privilegio bastante raro de presentar su investigación al presidente Obama durante el primer White House Demo Day en 2015. El grupo que dirige ha producido, a lo largo de los años, tecnologías que van desde la navegación submarina sin baterías hasta auriculares de realidad aumentada con visión de rayos X, pasando por la detección de latidos cardíacos a través de las paredes.

Los dos artículos presentados esta semana tienen como coautora principal a Laura Dodds, MIT Presidential Fellow y ganadora del premio a la mejor tesis MEng en EECS en el MIT. El grupo de trabajo también incluye a Maisy Lam, NSF GRFP Fellow, Waleed Akbar, Yibo Cheng y al ex postdoc Kaichen Zhou, ahora autor principal del artículo sobre RISE. La financiación proviene de la NSF, el MIT Media Lab y Amazon.

Del almacén al quirófano: las aplicaciones concretas

El salto de las reconstrucciones en el laboratorio a las aplicaciones del mundo real es más corto de lo que se podría imaginar. Los propios investigadores citan dos escenarios prioritarios, y en ambos casos la lógica es apremiante.

En el contexto de la logística y los almacenes automatizados, la capacidad de verificar el contenido de una caja cerrada sin abrirla tiene un valor económico directo y medible. Hoy en día, una parte significativa de las devoluciones en el comercio electrónico se genera por errores de embalaje: producto equivocado, producto faltante, producto dañado no visible desde el exterior. Un robot equipado con un sistema como Wave-Former podría verificar el contenido de cada caja antes del envío, reduciendo drásticamente estos errores. Amazon, entre los financiadores de la investigación, tiene evidentemente interés en esta dirección.

En el contexto doméstico y de la robótica de servicios, RISE abre otra posibilidad: un robot que "sabe" dónde están los muebles y dónde está la persona en la habitación, sin necesidad de cámaras. La ventaja para la privacidad respecto a los sistemas basados en videocámaras es cualquier cosa menos trivial: las señales mmWave no capturan imágenes visuales de las personas, sino solo su posición aproximada y el perfil del entorno. Un sistema de asistencia domiciliaria para ancianos que funcione sin grabar vídeo es un producto comercial y éticamente mucho más aceptable que uno que instale cámaras en cada habitación.

En el ámbito médico, las perspectivas son aún más ambiciosas pero también más lejanas de la aplicación inmediata. La posibilidad de obtener imágenes a través de superficies opacas con hardware relativamente económico podría algún día complementar o apoyar técnicas de imagen como la ecografía en contextos donde el acceso a maquinaria sofisticada es limitado.

La otra cara de la moneda: vigilancia, privacidad y quién se queda atrás

Hasta aquí, la historia del progreso técnico en su versión optimista. Pero sería deshonesto detenerse aquí, porque una tecnología capaz de reconstruir entornos y objetos a través de las paredes conlleva preguntas incómodas que no se resuelven con la buena voluntad de los investigadores.

La distinción entre "detectar la posición de una persona" y "vigilar a una persona" es mucho más sutil de lo que parece. El sistema RISE, en su forma actual, necesita a un ser humano en movimiento en la habitación para funcionar como mapeador ambiental. Pero el hecho de que la posición de la persona se utilice como "sonda" para el entorno no significa que esa posición no se registre. Un sistema que sabe dónde estáis en vuestra casa, incluso sin cámaras, ya es un sistema de vigilancia en la medida en que alguien tenga acceso a esos datos.

La confrontación con el RGPD y la Ley de IA europea es inevitable, y los contornos aún no están definidos. La normativa europea sobre privacidad se construye en torno al concepto de "dato personal", que incluye explícitamente la información relativa a la posición de una persona identificable. Una señal de radio que localiza a alguien en su propia vivienda entra con toda probabilidad en esta categoría, lo que significa que cualquier producto comercial basado en estos principios deberá obtener un consentimiento informado explícito y documentado. La Ley de IA, aprobada en 2024, introduce restricciones adicionales sobre los sistemas de "identificación biométrica remota", categoría en la que estos sistemas podrían entrar si se utilizan para identificar y rastrear a personas en espacios públicos.

El riesgo más concreto a corto plazo no es el gobierno espiando a los ciudadanos a través de los muros de sus casas, escenario de régimen distópico que requiere recursos y motivaciones extraordinarios. El riesgo más inmediato es el del uso no autorizado a pequeña escala: un propietario de una vivienda que instala un sensor para vigilar a los inquilinos, un empleador que rastrea los movimientos de los empleados en las oficinas, una pareja violenta que quiere saber dónde se encuentra la otra persona en todo momento. La historia de la tecnología de vigilancia enseña que los usos más peligrosos nunca son los imaginados por los investigadores en la fase de desarrollo.

Hay además una cuestión de distribución del poder tecnológico que merece atención. Las tecnologías de detección avanzada tienden a difundirse primero entre quienes ya tienen recursos: fuerzas del orden, grandes empresas, estados con alta capacidad tecnológica. Si la regulación no sigue el ritmo de la difusión, se crea un periodo de asimetría informativa potencialmente muy problemático, en el que algunos actores pueden "ver" sin ser vistos. La brecha entre países con fuerte capacidad regulatoria, como la Unión Europea, y países donde estas protecciones están ausentes corre el riesgo de traducirse en una disparidad concreta en las protecciones que los ciudadanos pueden esperar.

Hacia el "modelo fundacional" del wireless

Los investigadores del MIT no se detienen en los resultados actuales. Adib ha declarado explícitamente que el objetivo a largo plazo es construir modelos fundacionales para las señales inalámbricas, es decir, lo que GPT, Claude y Gemini representan para el lenguaje y las imágenes. Un modelo entrenado en una variedad enorme de señales de radio, capaz de comprender e interpretar reflexiones de entornos, objetos y cuerpos humanos con una generalidad y flexibilidad que los sistemas actuales no tienen.

Esta perspectiva es al mismo tiempo fascinante y vertiginosa. Los modelos fundacionales para el lenguaje han demostrado capacidades emergentes, es decir, comportamientos que no estaban explícitamente programados sino que surgieron de la escala y la diversidad del entrenamiento. Un modelo análogo para el dominio inalámbrico podría desarrollar capacidades de percepción ambiental que hoy ni siquiera sabemos imaginar. También podría, como los modelos de lenguaje, resultar difícil de interpretar, de controlar y de limitar a usos específicos.

El contexto competitivo en el que se mueve esta investigación es vibrante. Existen enfoques alternativos basados en Wi-Fi CSI (Channel State Information), que utiliza las variaciones en las características del canal Wi-Fi para inferir la presencia y el movimiento de personas, y radares a través de la pared de tipo militar, sistemas mucho más caros e invasivos utilizados por fuerzas especiales en contextos operativos. La investigación del grupo de Adib destaca por su enfoque en hardware relativamente económico, señales ya presentes en el entorno y técnicas de procesamiento cada vez más sofisticadas. La startup Cartesian Systems, cofundada por Adib, parece orientada a llevar estas tecnologías hacia aplicaciones comerciales, aunque los detalles específicos sobre el producto aún no son públicos.

Gafas de rayos X, por fin

Hay algo circular, y vagamente conmovedor, en el hecho de que la tecnología haya tardado cincuenta años en cumplir una promesa hecha en papel satinado a un chico con 7.200 liras en el bolsillo. Las gafas de L'Intrepido eran una estafa, pero también eran un síntoma: la percepción aumentada, el ver más allá de lo visible, es un deseo tan arraigado en el imaginario humano que resiste a cualquier desilusión.

Wave-Former y RISE no son productos comerciales, no están listos para el mercado y no están exentos de límites técnicos e implicaciones éticas no resueltas. Son, sin embargo, algo más sólido que una promesa: son resultados replicables, medibles, presentados ante la comunidad científica internacional. El salto cualitativo introducido por la inteligencia artificial generativa, la capacidad de completar lo que la física por sí sola no logra ver, es genuino.

La pregunta que queda abierta no es técnica. Es la pregunta que acompaña a cada tecnología de percepción desde que existe la vigilancia: ¿quién tiene el derecho de ver, qué, y con qué autorización? El MIT ha construido una herramienta extraordinaria. Corresponde a legisladores, empresas y ciudadanos decidir en qué mundo usarla. Porque esta vez, a diferencia de las gafitas de cartón, funciona de verdad.