Les agents IA travaillent. Et les comptes sont bons

De l'enthousiasme à la production

Il y a une donnée, dans le nouveau rapport de DigitalOcean publié en février 2026, qui semble se contredire d'elle-même. Le pourcentage d'entreprises déclarant utiliser l'intelligence artificielle a légèrement *baissé, passant de 79 % en 2024 à 77 %, pourtant, sur la même période, la part de celles qui l'implémentent réellement dans leurs processus a presque doublé, passant de 13 % à 25 %. Un paradoxe seulement en apparence. Ces 2 % en moins ne sont pas une défection : c'est un nettoyage. Une fois terminée la saison du tourisme technologique, où tout le monde expérimentait mais peu construisaient, le terrain est resté à ceux qui font les choses sérieusement.*

Le rapport, intitulé Currents, est une recherche périodique que DigitalOcean mène sur l'état de l'intelligence artificielle dans les entreprises technologiques en croissance. L'édition de février 2026 est basée sur plus de 1 100 réponses recueillies entre octobre et novembre 2025 auprès de développeurs, de directeurs techniques et de fondateurs répartis dans 102 pays. Les plus représentés sont les États-Unis avec 28 %, suivis du Royaume-Uni avec 7 %, du Canada avec 6 %, de l'Inde avec 4 %, de l'Allemagne et des Pays-Bas avec 3 % chacun, et de l'Italie avec 2 %. Un échantillon large, varié et suffisamment mondial pour offrir un aperçu crédible de l'état de l'art.

Le message central est sans équivoque : nous sommes entrés dans une nouvelle phase. 52 % des entreprises interrogées se trouvent aujourd'hui dans l'une des trois phases les plus avancées du parcours avec l'intelligence artificielle : implémentation active, optimisation des performances, ou adoption comme élément central de leur stratégie. En 2024, ce même pourcentage s'arrêtait à 35 %. Dix-sept points de pourcentage en douze mois, ce n'est pas une évolution graduelle.

On ne construit pas de modèles, on les utilise

L'un des points les plus débattus dans le récit public sur l'intelligence artificielle concerne un dilemme auquel chaque entreprise est confrontée tôt ou tard : construire ses propres modèles, en gardant le plein contrôle sur les données et l'infrastructure, ou s'appuyer sur des fournisseurs externes, en acceptant les risques de dépendance, de souveraineté des données et de confidentialité que cela comporte. Les données du rapport ne résolvent pas le dilemme, mais indiquent clairement quel choix l'emporte dans la pratique.

Seuls 15 % des personnes interrogées s'occupent principalement d'entraîner des modèles à partir de zéro. Pour tous les autres, le travail est ailleurs : 64 % intègrent les interfaces de programmation de fournisseurs tiers dans leurs applications, et 61 % utilisent une combinaison d'outils différents plutôt qu'une solution intégrée unique. L'intelligence artificielle, pour la grande majorité de ceux qui l'utilisent réellement, est devenue un service à connecter, et non une technologie à construire.

Ce déplacement porte un nom précis : l'inférence. Si l'entraînement est la phase où un modèle apprend — coûteuse, longue, réservée à quelques laboratoires —, l'inférence est la phase où ce modèle est utilisé pour générer des réponses, analyser des documents, écrire du code, répondre aux clients. C'est ici que se concentre désormais le gros des investissements : 44 % des personnes interrogées consacrent entre 76 % et 100 % de leur budget consacré à l'intelligence artificielle précisément à l'inférence. La comparaison avec la transition vers le cloud d'il y a une décennie est inévitable : à l'époque aussi, la majorité a cessé de s'occuper du matériel pour apprendre à travailler avec des services distants. L'intelligence artificielle traverse la même phase.

Le coût caché de l'intelligence

S'il est un obstacle qui ressort avec force du rapport, c'est le coût de l'inférence à grande échelle. 49 % des personnes interrogées l'identifient comme la principale limite à la croissance de leur utilisation de l'intelligence artificielle. Non pas la complexité technique, ni les risques juridiques : le coût.

Lorsqu'on met en production un système basé sur des modèles linguistiques, lorsqu'il doit répondre à des milliers ou des millions de requêtes par jour, la facture augmente de manière pas toujours prévisible. Et la prévisibilité, selon les données, est l'une des préoccupations les plus vives. Pour ceux qui utilisent plusieurs outils et fournisseurs différents, les problèmes se multiplient : 50 % des personnes interrogées opérant avec des infrastructures multiples signalent la nécessité de gérer des interfaces séparées, 49 % peinent à prévoir les coûts, et 48 % rencontrent des difficultés à orchestrer et déployer les systèmes.

Seulement 23 % des répondants travaillent avec un fournisseur unique qui intègre modèles, données et infrastructure. Tous les autres doivent composer avec une chaîne d'approvisionnement fragmentée, où chaque pièce nécessite des compétences, des contrats et une attention spécifiques. L'intelligence artificielle, du moins dans sa phase actuelle, n'est pas un produit clé en main : c'est un chantier permanent, avec tout ce que cela comporte en termes de complexité de gestion.

Qui commande parmi les modèles

Le rapport offre une photographie nette du paysage des modèles linguistiques les plus utilisés, et les chiffres confirment certaines intuitions tout en réservant quelques surprises.

OpenAI maintient une position dominante : 72 % des personnes interrogées utilisent ses modèles. L'avantage du premier arrivé se traduit encore par des parts de marché significatives. Mais la marge se réduit : Google est à 50 %, Anthropic à 47 %. Tous deux ont rattrapé leur retard rapidement, et la différence avec le leader n'est plus abyssale.

La vraie surprise vient du monde des modèles ouverts. Meta avec Llama et DeepSeek atteignent tous deux 21 %. DeepSeek est particulièrement digne de mention : il est entré sur le marché seulement fin 2024 et a déjà atteint le même niveau d'adoption que Llama, qui bénéficie de plusieurs années d'avance. Les modèles en code ouvert offrent des avantages concrets : flexibilité dans l'adaptation, absence de dépendance envers un fournisseur unique, possibilité de tourner sur ses propres infrastructures sans envoyer de données à des tiers. Pour de nombreuses entreprises, en particulier dans des contextes où la confidentialité est cruciale, ce n'est pas un choix par défaut mais une stratégie consciente. Le marché des modèles n'est ni un monopole ni une tour de Babel : c'est un oligopole en évolution rapide, où ceux qui parient sur un fournisseur unique assument un risque stratégique que beaucoup préfèrent éviter.

Les agents : ce qu'ils sont, ce qu'ils font, comment ils fonctionnent

Le mot « agent » est peut-être le plus galvaudé du vocabulaire technologique de ces douze derniers mois. Il convient de le définir avec précision.

Un agent d'intelligence artificielle est un système capable d'accomplir des tâches de manière autonome, en prenant des décisions et en menant des actions — chercher des informations, écrire du code, envoyer des messages, mettre à jour des archives — sans que chaque étape nécessite une intervention humaine. La différence par rapport à un simple assistant conversationnel est substantielle : un assistant répond à des questions, un agent fait des choses. C'est la distance entre un GPS qui indique où tourner et une voiture qui se conduit toute seule.

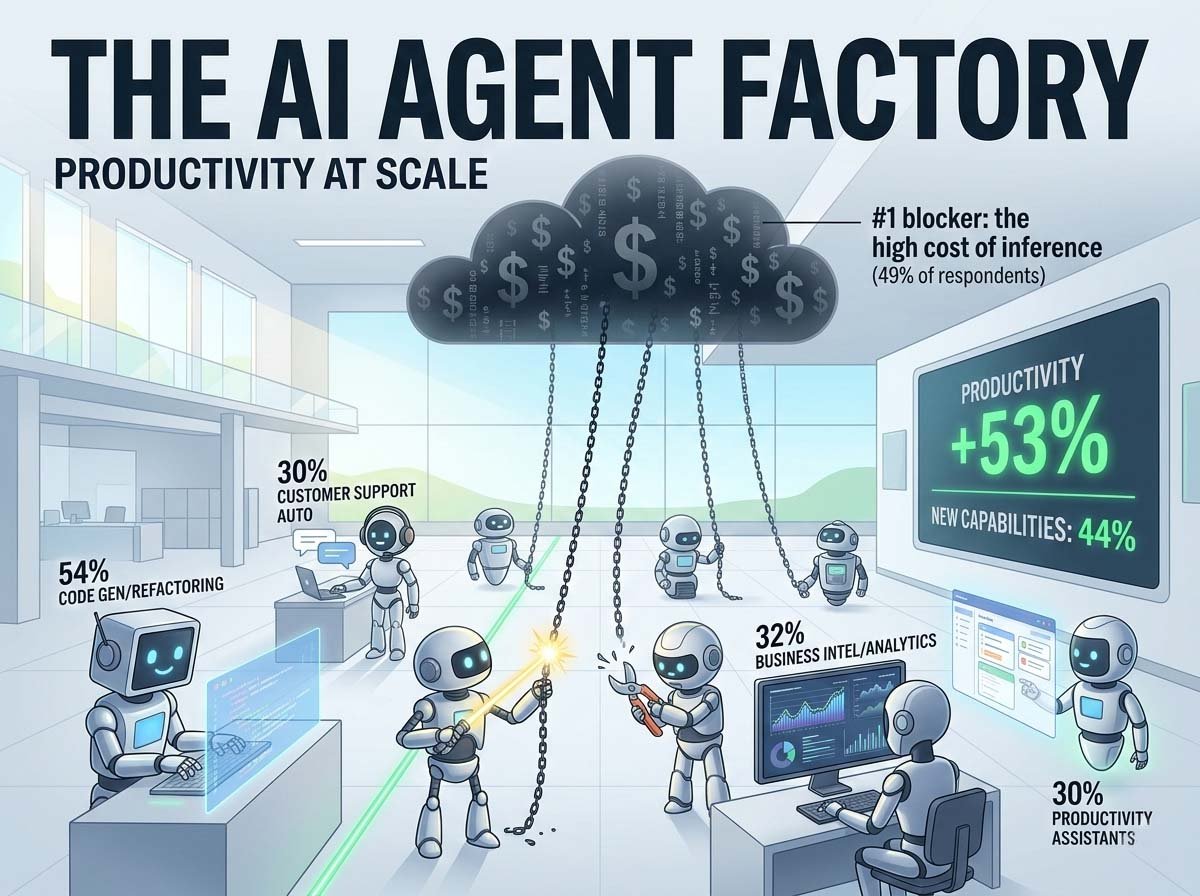

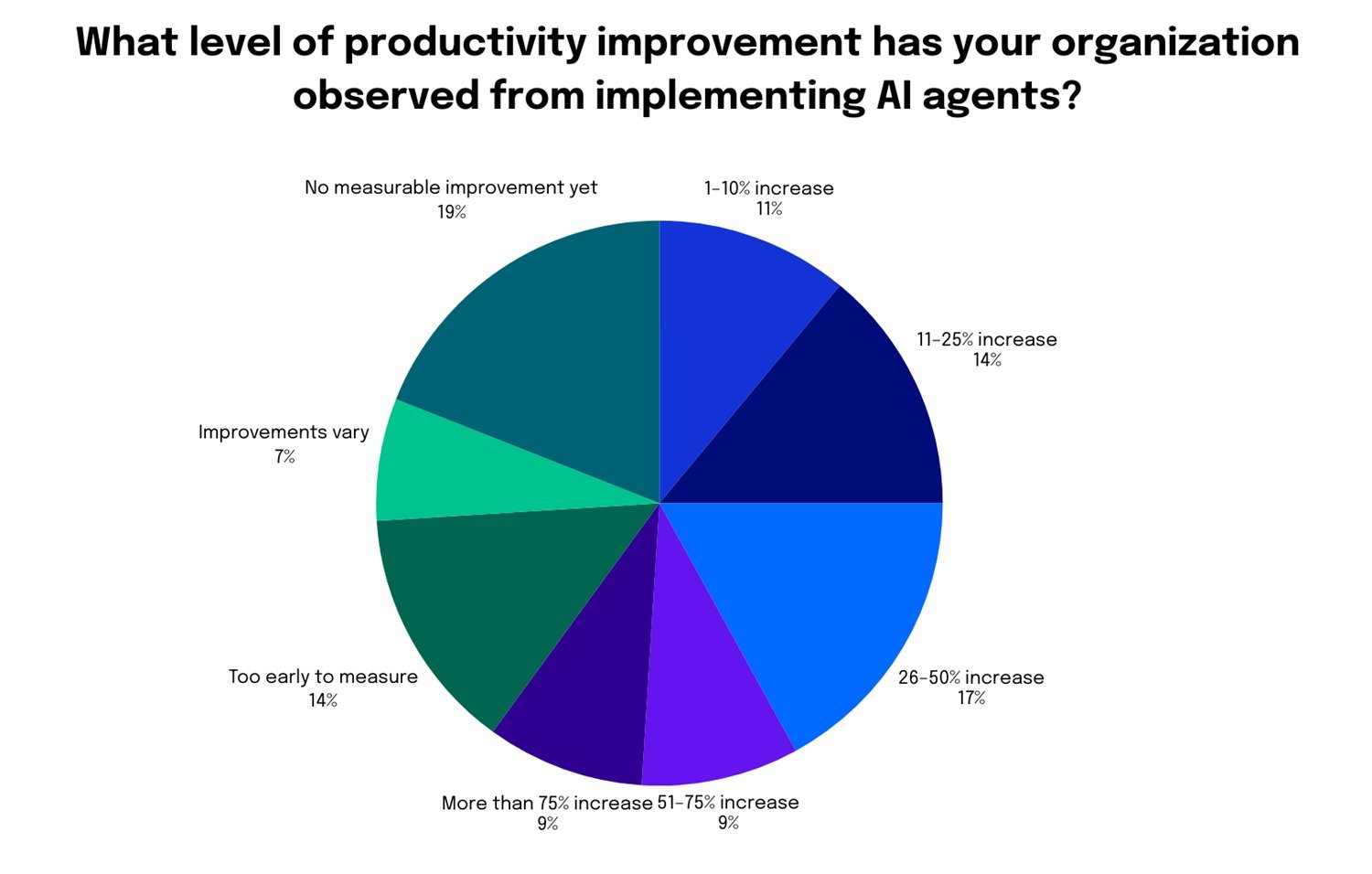

Les données montrent que cette technologie a cessé d'être seulement une promesse. 53 % des entreprises utilisant des agents ont observé des gains de temps et des augmentations de productivité. 44 % ont enregistré la création de nouvelles capacités opérationnelles qu'elles n'étaient pas en mesure d'offrir auparavant. 32 % ont réduit leurs besoins en nouveaux recrutements. Globalement, 67 % de ceux qui ont adopté des agents ont constaté une forme d'amélioration de la productivité : 25 % de l'ordre de 1 à 25 %, 17 % entre 26 % et 50 %, 9 % entre 51 % et 75 %, et 9 % supplémentaires avec des gains supérieurs à 75 %.

Ce sont des pourcentages qui parlent, mais ils doivent être lus avec la prudence nécessaire. 14 % n'ont pas encore vu de bénéfices concrets. Et surtout, le niveau d'autonomie effectivement accordé aux agents reste, dans la plupart des cas, plutôt limité. Seuls 10 % des répondants disposent d'agents complètement autonomes en production. 40 % font encore réviser toutes les sorties par un être humain. 58 % utilisent des points d'approbation humaine comme principale mesure de contrôle. Les agents travaillent, mais sous surveillance.

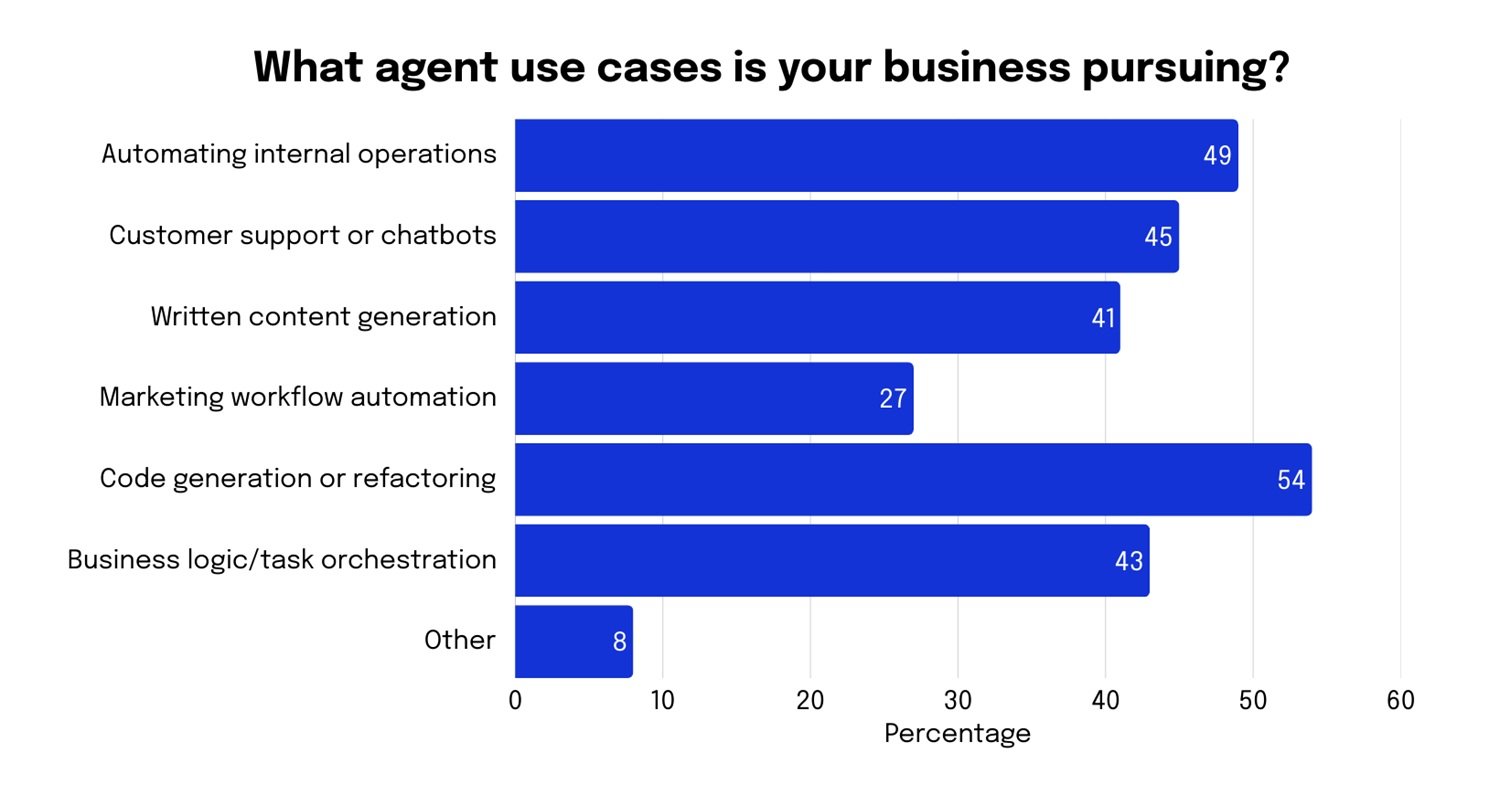

Le type d'agent le plus répandu est celui spécialisé dans une seule tâche (44 %), suivi par ceux capables de gérer des tâches multiples (29 %) et par des systèmes dans lesquels plusieurs agents collaborent entre eux (17 %). Le cas d'utilisation le plus populaire, déclaré par 54 % des répondants, est la génération et la réécriture de code : rien de surprenant, étant donné que l'échantillon est principalement composé de développeurs. Viennent ensuite l'analyse de données (41 %), l'automatisation du support client (40 %), la recherche et le résumé d'informations (39 %) et la gestion des flux de travail internes (38 %).

Il existe pourtant une donnée qui va au-delà des cas d'utilisation individuels et raconte quelque chose de plus structurel : 60 % des personnes interrogées identifient les applications et les agents comme le niveau de la pile technologique ayant la plus grande valeur à long terme. Non pas l'infrastructure, citée seulement par 19 %, ni les plateformes de développement, à 17 %. C'est un signal clair sur l'endroit où le marché pense que se joue la vraie partie : non pas dans la possession de la puissance de calcul ou des modèles sous-jacents, mais dans la construction des systèmes qui les mettent au travail de manière utile et mesurable. C'est la différence entre posséder une centrale électrique et savoir construire les appareils électroménagers que les gens veulent vraiment utiliser.

L'écart se creuse : ceux qui partent maintenant risquent de courir après les autres

L'un des messages les plus explicites du rapport concerne la distance croissante entre ceux qui ont déjà intégré l'intelligence artificielle dans leurs processus et ceux qui sont encore sur la touche. 50 % des personnes interrogées déclarent expérimenter ou déployer des agents. Mais parmi elles, seulement 10 % les ont intégrés de manière systématique. 33 % en sont à la phase des petites expérimentations, 28 % explorent encore les concepts de base, et 23 % ont lancé les premières charges de travail réelles.

Parmi ceux qui n'utilisent pas encore d'agents, les perspectives pour 2026 sont inquiétantes. 44 % déclarent n'avoir aucun projet d'expérimentation. Seuls 26 % ont planifié des tests ou des projets pilotes. La raison pour laquelle cet écart risque de s'aggraver est liée à la nature même de l'apprentissage organisationnel. Adopter l'intelligence artificielle n'est pas comme installer un programme : cela nécessite des mois d'expérimentation, d'ajustements, de construction de compétences internes, de révision des processus. Ceux qui commencent maintenant ont déjà un retard structurel sur ceux qui ont commencé il y a un an. La même dynamique a été observée avec l'adoption du commerce électronique, du cloud, des réseaux sociaux : les entreprises qui ont parié tôt ont bâti des avantages difficiles à combler.

37 % des personnes interrogées prévoient d'augmenter le budget alloué aux applications et aux agents au cours des douze prochains mois, la catégorie d'investissement la plus citée au total. Et 38 % de ceux qui n'ont pas encore commencé d'expérimentations déclarent qu'ils commenceront en 2026. Mais déclarer n'est pas faire, et l'histoire des grandes transformations technologiques est pleine d'intentions non traduites en actions.

Les nœuds techniques à dénouer

Le rapport de DigitalOcean offre une photographie précise de l'état actuel, mais certaines questions restent sans réponse et accompagneront le secteur tout au long de l'année 2026.

La première concerne la fiabilité. 41 % des répondants identifient précisément le manque de prévisibilité des agents comme le principal obstacle à leur diffusion. Un système qui mène des actions dans le monde réel, met à jour des archives, envoie des messages, exécute des opérations, doit être cohérent. Les modèles actuels ont accompli des progrès énormes, mais n'ont pas encore atteint le seuil requis par de nombreux cas d'utilisation productifs. C'est aussi pour cela que 40 % conservent encore un contrôle humain systématique : non par choix philosophique, mais par nécessité pratique. 31 % des personnes interrogées indiquent ensuite l'intégration avec les applications existantes comme deuxième obstacle principal : les entreprises ne partent pas de zéro, elles ont des systèmes de gestion, des archives et des flux construits au fil des ans, souvent des décennies, et connecter un agent intelligent à cet écosystème nécessite du temps, des compétences et des tests approfondis pour éviter que le nouveau système n'introduise des comportements inattendus.

La deuxième question est celle de la concentration du pouvoir. Trois fournisseurs, OpenAI, Google, Anthropic, contrôlent ensemble la part dominante des modèles utilisés à l'échelle mondiale. Si ces modèles deviennent une infrastructure critique pour des millions d'entreprises, les décisions que ces trois acteurs prennent sur les prix, l'accès, la censure des contenus et les conditions d'utilisation se transforment de fait en politiques industrielles élues par personne. Les modèles ouverts comme Llama et DeepSeek offrent une alternative concrète, mais ils nécessitent des compétences de déploiement et des ressources d'infrastructure que toutes les organisations ne peuvent pas se permettre. La dépendance n'est pas un risque théorique : elle est déjà visible dans les données, et le fait que seulement 21 % des répondants utilisent des modèles ouverts montre à quel point il est difficile, en pratique, de s'affranchir du triumvirat commercial.

Travail, Europe et questions en suspens

La troisième question est celle du travail. 32 % de ceux qui utilisent des agents ont déjà réduit leurs besoins en nouveaux recrutements. Les gains de productivité documentés par le rapport ne se traduisent pas automatiquement par un bien-être généralisé. Si les économies restent concentrées dans les entreprises les mieux capitalisées, l'écart entre ceux qui gagnent et ceux qui perdent dans la transformation s'accentuera davantage. Si, au contraire, la même productivité est utilisée pour étendre l'offre, ouvrir de nouveaux marchés, proposer des services auparavant inaccessibles, l'effet peut être positif même pour ceux qui travaillent. La technologie ne décide pas : ce sont les organisations, les politiques publiques, les choix de ceux qui détiennent le pouvoir économique qui décident.

Pour l'Italie et l'Europe, présentes mais non dominantes dans l'échantillon, la question reste ouverte de savoir comment concilier l'urgence d'adopter ces technologies avec un contexte réglementaire complexe. Le règlement européen sur l'intelligence artificielle, entré en vigueur en 2024, impose des exigences de conformité, de transparence et d'évaluation des risques que de nombreuses entreprises cherchent encore à interpréter. La réglementation n'est pas en soi un frein au développement, mais elle nécessite des investissements en compétences juridiques et de gouvernance qui s'ajoutent aux compétences techniques, augmentant le coût global d'entrée. Pour les petites et moyennes entreprises italiennes, colonne vertébrale du tissu productif national, l'obstacle n'est pas seulement économique ou réglementaire, mais aussi organisationnel : adopter des agents capables nécessite une volonté de remettre en question des processus consolidés, une tolérance pour l'expérimentation et l'erreur, et une capacité à attirer des profils techniques que le marché du travail italien peine à produire en quantité suffisante. La donnée de 2 % de répondants italiens dans l'échantillon ne doit pas être lue comme un indice de désintérêt, mais probablement comme le miroir d'une participation encore périphérique à des conversations qui se déroulent ailleurs.

L'année 2026 est, selon les données, l'année où de nombreuses entreprises passeront de l'expérimentation à la production. C'est aussi l'année où certaines de ces questions commenceront à avoir des réponses concrètes, pas toujours celles que l'on souhaiterait. Regarder les chiffres avec honnêteté, comme s'efforce de le faire ce rapport, est au moins un bon point de départ.