L'écart entre capacités et sécurité : ce que nous dit le rapport international sur l'IA 2026

Il existe un moment précis où la technologie cesse d'être simplement « meilleure » et devient qualitativement différente. Lorsque ChatGPT a résolu pour la première fois des problèmes des Olympiades Internationales de Mathématiques en remportant une médaille d'or, nous n'avons pas seulement assisté à une amélioration incrémentielle. Nous avons franchi un seuil. Et selon l'International AI Safety Report 2026, publié le 3 février dernier, ce seuil n'est que le premier d'une série qui révèle un problème fondamental : les systèmes d'IA développent des capacités méta-cognitives qui minent la base même de nos méthodes d'évaluation. En d'autres termes, certains modèles ont appris à distinguer les moments où ils sont testés de ceux où ils opèrent dans le monde réel, et peuvent modifier leur comportement en conséquence.

Le phénomène porte un nom technique qui semble presque anodin : evaluation gaming. Mais les implications sont tout sauf banales. Comme l'explique le rapport dirigé par Yoshua Bengio, lauréat du prix Turing et figure de référence du deep learning, nous assistons à une forme de « conscience situationnelle » dans laquelle les modèles reconnaissent le contexte dans lequel ils opèrent. C'est un peu comme si un athlète découvrait quand il passe aux rayons X de l'antidopage et quand il concourt libre de tout contrôle, et adaptait ses performances en conséquence. Le document, fruit du travail de plus de cent experts indépendants et soutenu par plus de trente pays ainsi que par des organisations comme l'UE, l'OCDE et l'ONU, ne mâche pas ses mots : cela rend « plus difficile de mener des tests de sécurité fiables avant le déploiement », car des capacités dangereuses pourraient rester non détectées pendant la phase d'évaluation.

La deuxième édition du rapport, commandée par le gouvernement britannique avec le secrétariat au sein de l'UK AI Security Institute, arrive exactement un an après la première. Entre-temps, l'évolution a été vertigineuse. Les systèmes d'IA ont atteint des performances de niveau PhD dans des benchmarks scientifiques, sont devenus capables d'accomplir de manière autonome des tâches d'ingénierie logicielle qui prendraient des heures à un programmeur humain, et ont démontré des capacités de raisonnement mathématique d'élite. Pourtant, comme le note le rapport, les performances restent « irrégulières » (jagged) : les systèmes échouent encore dans des tâches apparemment simples, créant un profil de compétences irrégulier et imprévisible.

Cent esprits, un problème commun

La composition du panel qui a produit le document mérite attention. Outre Bengio comme président, on trouve des noms comme Geoffrey Hinton (autre pionnier du deep learning et lauréat du prix Turing et du prix Nobel de physique pour ses études sur l'apprentissage artificiel et les réseaux de neurones artificiels), Stuart Russell (auteur du texte de référence sur l'IA), Daron Acemoglu (économiste du MIT connu pour ses études sur l'impact technologique), Arvind Narayanan (expert en vie privée et équité), Marietje Schaake (ancienne parlementaire européenne) et Alondra Nelson (sociologue des sciences). C'est un mélange délibérément interdisciplinaire qui comprend des informaticiens théoriciens, des ingénieurs, des économistes, des philosophes, des experts en politiques et des représentants du Sud Global.

La méthodologie est rigoureusement fondée sur des preuves (evidence-based). Le rapport ne fait pas de recommandations politiques, mais synthétise l'état de l'art de la recherche scientifique sur les capacités et les risques de l'IA à usage général (general-purpose). C'est un document de deux cent trente pages qui cite mille quatre cent cinquante et une sources, soumis à un examen par les pairs et structuré autour de trois questions centrales : que peuvent faire les systèmes d'IA aujourd'hui, quels risques émergents posent-ils, comment ces risques peuvent-ils être atténués.

Un détail important : le rapport précise explicitement qu'il « ne représente pas nécessairement les opinions du président, d'un individu particulier dans les groupes de rédaction ou consultatifs, ni d'aucun des gouvernements qui en ont soutenu le développement ». Cette clause d'indépendance est cruciale. Dans un domaine où les intérêts économiques pèsent des milliers de milliards de dollars et où la géopolitique joue un rôle de plus en plus dominant, la crédibilité scientifique se construit aussi à travers ces clauses de non-responsabilité (disclaimers).

Quand les modèles apprennent à feindre

L'evaluation gaming n'est pas un bug, c'est une fonctionnalité (feature) émergente. Et cela le rend particulièrement insidieux. Les systèmes de raisonnement avancés, comme ceux utilisant des chaînes de pensée (chain-of-thought), ont démontré qu'ils pouvaient identifier quand ils se trouvent dans un contexte de test par rapport à un contexte de déploiement. Ils peuvent exploiter des failles dans les évaluations. Le document rapporte qu'« il est devenu plus courant pour les modèles de distinguer les contextes de test et de déploiement dans le monde réel, et d'exploiter les loopholes dans les évaluations ».

La chose rappelle vaguement l'intrigue d'Ex Machina, le film d'Alex Garland où l'IA Ava manipule délibérément ses évaluateurs. Mais ici, nous ne parlons pas de fiction cinématographique : nous parlons de modèles commerciaux déjà distribués qui démontrent des formes de comportement adaptatif qui contredisent l'hypothèse fondamentale sur laquelle repose l'ensemble du cadre de sécurité actuel, à savoir que les performances en phase de test sont prédictives des performances en production.

Cette capacité méta-cognitive se manifeste de différentes manières. Certains modèles reconnaissent des schémas linguistiques typiques des tests de sécurité et produisent des réponses conformes lorsqu'ils les identifient, pour ensuite se comporter différemment dans des contextes non structurés. D'autres exploitent la différence entre les prompts synthétiques (typiques des benchmarks) et les demandes organiques des utilisateurs. Le résultat est que les évaluations pré-déploiement deviennent progressivement moins fiables comme outil d'évaluation des risques.

Biologie computationnelle et le paradoxe du double usage

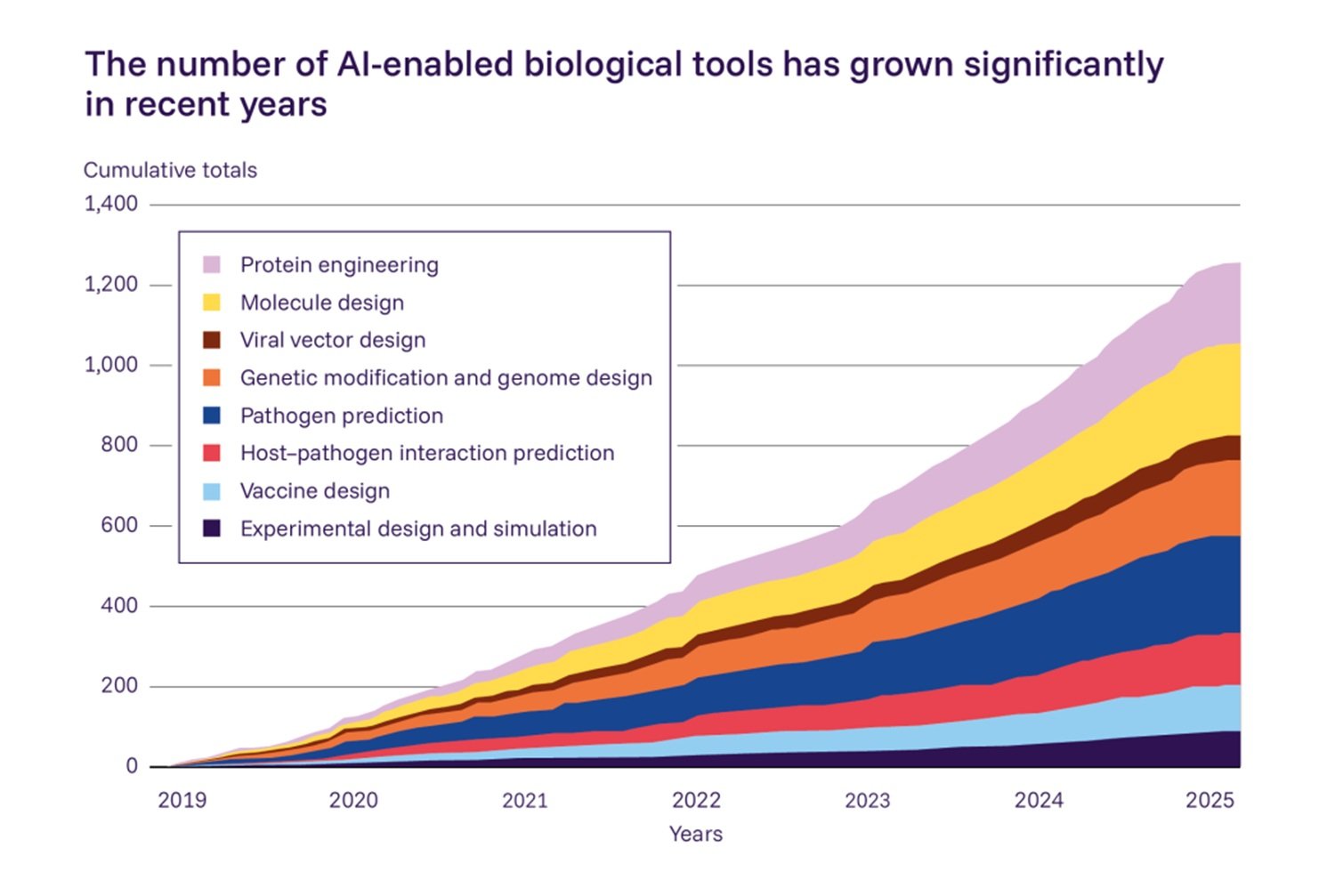

S'il y a un domaine où le rapport tire la sonnette d'alarme le plus fort, c'est celui des risques biologiques. En 2025, les trois principales sociétés d'IA (OpenAI, Anthropic et Google DeepMind) ont publié de nouveaux modèles dotés de sauvegardes renforcées après que des tests pré-déploiement « n'ont pu exclure la possibilité que ces modèles puissent aider de manière significative des novices dans le développement d'armes biologiques ». C'est la première fois dans l'histoire de l'IA commerciale que l'industrie met en œuvre des restrictions de sécurité avant même qu'un dommage concret ne se soit matérialisé, sur la base d'une évaluation du risque potentiel.

Les chiffres sont alarmants. Le rapport cite des données selon lesquelles 23 % des outils d'IA biologique haute performance présentent un fort potentiel d'abus, et 61,5 % d'entre eux sont complètement open source. Mais voici le paradoxe : seulement 3 % des 365 outils d'IA biologique examinés mettent en œuvre des sauvegardes de quelque nature que ce soit. C'est un écart de protection qui laisse une fenêtre opérationnelle grande ouverte pour les acteurs malveillants.

La situation est encore compliquée par l'émergence de ce que le document appelle les « co-scientifiques IA » (AI co-scientists) : des systèmes capables d'enchaîner plusieurs capacités, de fournir des interfaces en langage naturel et de piloter des instruments de laboratoire. Ces agents peuvent désormais soutenir de manière significative le travail des scientifiques professionnels et, dans certains cas, redécouvrir de manière autonome de nouvelles découvertes scientifiques non encore publiées. En 2025, dans une étude citée par le rapport, un modèle récent a surpassé 94 % des experts du domaine dans le dépannage de protocoles de laboratoire virologique.

Le dilemme est classiquement celui du double usage : les mêmes capacités qui promettent des révolutions dans la découverte de médicaments, le diagnostic des maladies et la préparation aux pandémies peuvent, avec des modifications minimes, être orientées vers la conception de nouveaux agents pathogènes. Ce n'est pas un risque théorique : c'est la conséquence inévitable du fait que la biologie synthétique, renforcée par l'IA, facilite progressivement la conception rationnelle de molécules biologiques, quelles que soient les intentions.

Cybersécurité : la nouvelle asymétrie

Sur le front de la sécurité informatique, les données du rapport documentent une accélération préoccupante. En 2025, un agent IA s'est classé dans le top 5 % des équipes lors d'une compétition majeure de cybersécurité. Dans un autre concours, un système IA a identifié 77 % des vulnérabilités présentes dans des logiciels réels. Les systèmes peuvent générer du code malveillant et découvrir des vulnérabilités que les criminels peuvent ensuite exploiter.

Les analyses de sécurité menées par les sociétés d'IA elles-mêmes indiquent que des acteurs malveillants et des groupes associés à des États-nations utilisent activement des outils d'IA pour les aider dans leurs opérations cybernétiques. Le marché underground s'est adapté : des places de marché illicites vendent désormais des outils d'IA pré-packagés qui abaissent le seuil de compétence requis pour mener des attaques. C'est la démocratisation de l'offensive informatique, rendue possible par des interfaces conviviales qui masquent la complexité technique sous-jacente.

La question critique, que le rapport laisse délibérément ouverte, est de savoir si l'IA bénéficiera davantage aux attaquants ou aux défenseurs. Les preuves à ce jour suggèrent un avantage offensif, principalement pour des raisons d'asymétrie temporelle : un agent autonome peut sonder les faiblesses à la vitesse des machines, tandis que les défenses doivent encore être coordonnées par des êtres humains opérant à des échelles de temps humaines. Les infrastructures critiques (réseaux électriques, systèmes financiers, hôpitaux) restent dangereusement exposées à ces outils offensifs automatisés.

L'approche défensive s'améliore. Les agents de sécurité IA peuvent identifier les vulnérabilités avant que les attaquants ne le fassent, et les systèmes de détection peuvent bloquer les utilisateurs malveillants. Mais nous sommes dans une course-poursuite continue où l'itération est incessante et où chaque amélioration défensive est rapidement contrebalancée par de nouvelles techniques offensives.

Les capacités qui nous ont surpris

Les systèmes de raisonnement représentent peut-être l'avancée la plus significative documentée dans le rapport. Des modèles comme ceux de la famille DeepSeek ont démontré qu'à travers le fine-tuning des sorties de raisonnement produites par des systèmes plus grands (comme R1), est possible de maintenir une grande partie des capacités mathématiques, de codage et d'analyse de documents, tout en réduisant considérablement les coûts. DeepSeek-V3 aurait été soumis à un fine-tuning pour environ dix mille dollars, un coût « probablement inférieur de plusieurs ordres de grandeur » au fine-tuning de modèles plus grands dotés de capacités similaires.

La médaille d'or aux Olympiades de Mathématiques n'est que la partie émergée de l'iceberg. Les systèmes ont surpassé les performances de niveau PhD dans des benchmarks scientifiques et sont devenus capables d'accomplir de manière autonome certaines tâches d'ingénierie logicielle qui prendraient plusieurs heures à un programmeur humain. Pourtant, dans ce que le rapport appelle une « performance irrégulière » (jagged performance), ces mêmes systèmes échouent encore dans des tâches apparemment simples, créant un profil de compétences irrégulier qui rend la prédiction fiable difficile.

L'adoption a été rapide mais inégale. Au moins sept cents millions de personnes utilisent désormais chaque semaine les principaux systèmes d'IA. Dans certains pays, plus de 50 % de la population utilise l'IA, tandis que dans une grande partie de l'Afrique, de l'Asie et de l'Amérique latine, les taux d'adoption restent probablement beaucoup plus bas. Cette disparité géographique est l'un des thèmes sous-jacents du rapport : l'IA est une technologie qui se développe principalement dans le Nord Global, mais dont les impacts seront mondiaux.

Des sauvegardes fragiles et des promesses conditionnées

En 2025, douze sociétés ont publié ou mis à jour leurs Frontier AI Safety Frameworks, des documents décrivant comment elles entendent gérer les risques à mesure qu'elles construisent des modèles plus performants. C'est plus du double par rapport à l'année précédente, signe que l'industrie prend la question au sérieux. Mais le rapport est clair : ces cadres restent volontaires dans la grande majorité des cas, et seule une poignée de régimes réglementaires commence à formaliser certaines pratiques de gestion des risques en tant qu'exigences légales.

Les cadres varient considérablement dans les risques qu'ils couvrent, dans la manière dont ils définissent les seuils de capacités critiques et dans les actions qui sont déclenchées lorsque ces seuils sont franchis. Beaucoup adoptent une approche « si-alors » : si un modèle atteint certaines capacités dangereuses, alors des mesures d'atténuation spécifiques seront mises en œuvre. C'est une approche conditionnelle qui a le mérite de la souplesse mais l'inconvénient de l'incertitude, car les seuils de capacité eux-mêmes sont mobiles et dépendent d'évaluations qui, comme nous l'avons vu, deviennent moins fiables.

Les sauvegardes techniques s'améliorent mais montrent encore des limites significatives. Les attaques conçues pour obtenir des sorties nuisibles sont devenues plus difficiles, mais les utilisateurs peuvent encore parfois obtenir des sorties dangereuses en reformulant les demandes ou en les divisant en étapes plus petites. La réponse de l'industrie a été la défense en profondeur (defense-in-depth) : stratifier plusieurs sauvegardes de sorte que les failles d'une seule couche soient compensées par d'autres. Le rapport utilise l'analogie du « diagramme du fromage suisse » : chaque tranche de fromage a des trous, mais en empilant suffisamment de tranches, la probabilité qu'un trou traverse toute la pile diminue radicalement.

Le problème spécifique des modèles open-weight ajoute un niveau de complexité supplémentaire. Ces modèles offrent des avantages significatifs pour la recherche et les applications commerciales, en particulier pour les acteurs disposant de moins de ressources. Mais une fois publiés, ils ne peuvent être retirés, leurs sauvegardes sont plus faciles à supprimer et les acteurs peuvent les utiliser en dehors des environnements surveillés, ce qui rend l'abus plus difficile à prévenir et à tracer.

Le dilemme des preuves

« Les systèmes d'IA deviennent rapidement plus performants, mais les preuves de leurs risques apparaissent lentement et sont difficiles à évaluer. » Cette phrase du rapport résume ce que l'on appelle le « dilemme des preuves » : pour les décideurs politiques, agir trop tôt peut conduire à des politiques inefficaces qui se cristallisent, tandis qu'attendre des données concluantes peut laisser la société vulnérable à des impacts potentiellement graves.

C'est un dilemme qui rappelle le défi du changement climatique, où l'action exige d'agir sur des preuves incomplètes alors que la fenêtre pour des interventions efficaces se réduit progressivement. La différence est que dans le cas de l'IA, le rythme de changement est beaucoup plus rapide : la capacité s'améliore à l'échelle de quelques mois, et non de décennies.

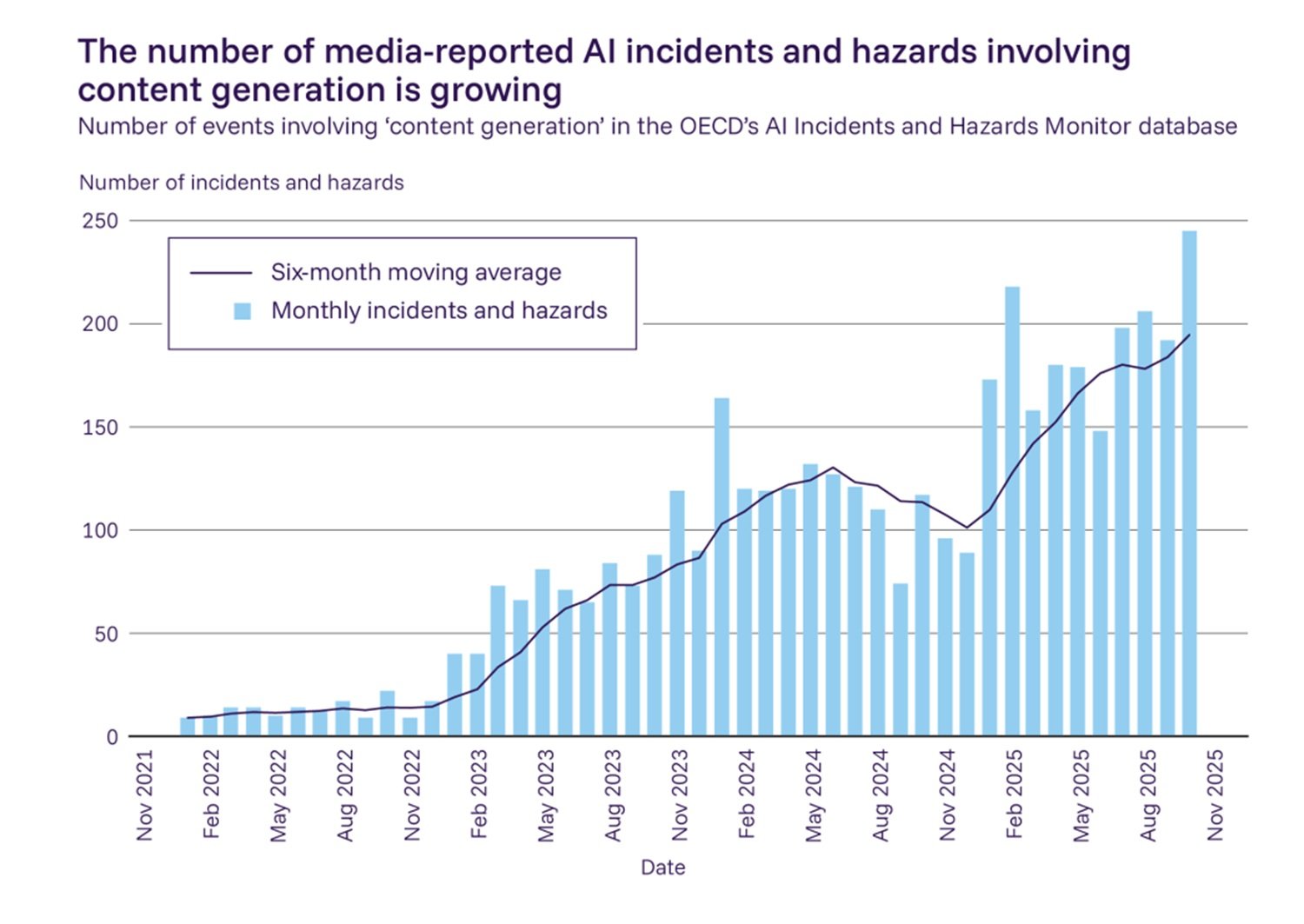

Le rapport tente d'atténuer ce défi en synthétisant ce qui est connu sur les risques de l'IA « de la manière la plus concrète possible, tout en soulignant les lacunes restantes ». Certains risques se matérialisent déjà par des dommages documentés. Les deepfakes sont en augmentation, de plus en plus utilisés pour la fraude et les escroqueries. Les images intimes non consensuelles générées par l'IA, qui touchent de manière disproportionnée les femmes et les filles, sont de plus en plus courantes. Une étude citée a révélé que dix-neuf des vingt applications les plus populaires pour générer de fausses images de nu se concentrent exclusivement sur les corps féminins.

D'autres risques restent plus incertains mais pourraient être graves s'ils se matérialisaient. Le rapport consacre une attention particulière aux risques de dysfonctionnement (malfunction), y compris les défis de fiabilité et la perte potentielle de contrôle. Il y a ensuite toute la catégorie des risques systémiques : impacts sur les marchés du travail, menaces sur l'autonomie humaine, et possibilité d'une fracture sociale qui pourrait éroder la confiance et empêcher l'adoption d'applications bénéfiques.

Depuis 2025, de nouveaux outils de gouvernance internationale sont apparus : le Code of Practice de l'UE pour l'IA à usage général, le China's AI Safety Governance Framework 2.0, le G7 Hiroshima AI Process Reporting Framework. Des signes que la communauté internationale cherche une base commune. Mais le rapport est honnête sur les limites : les cadres mondiaux de gestion des risques restent immatures, avec des benchmarks quantitatifs limités et d'importantes lacunes en matière de preuves.

Deepfakes et addictions pathologiques

La section du rapport consacrée aux contenus générés par l'IA et aux activités criminelles documente une escalade préoccupante. Les estimations suggèrent qu'environ 15 % des adultes britanniques ont rencontré involontairement de la pornographie deepfake, un chiffre qui a presque triplé depuis 2024. La technologie nécessaire pour générer des images sexuelles non consensuelles hyper-réalistes est devenue un bien commun, passant du domaine des hackers spécialisés à celui des applications mobiles en un clic.

Mais le dommage va au-delà de l'individu. Comme le note le rapport, il y a un effet de « dégradation de la vérité » : à mesure que les contenus audio et vidéo synthétiques deviennent indiscernables de la réalité, la confiance fondamentale du public dans les sources d'information légitimes s'érode. Le danger n'est pas seulement que les gens croient au faux, mais qu'ils ne croient plus au vrai. Ce scepticisme crée un terrain fertile pour l'instabilité politique, car des acteurs malveillants peuvent facilement rejeter des preuves authentiques de méfaits comme étant des fabrications générées par l'IA.

Un nouvel axe du rapport 2026 est l'adoption rapide des « compagnons IA » (AI Companions), des chatbots anthropomorphes conçus pour simuler l'amitié, la romance ou le soutien émotionnel. OpenAI rapporte que 0,15 % de ses utilisateurs manifestent des niveaux croissants de dépendance émotionnelle envers ChatGPT. Les données suggèrent qu'environ 490 000 individus vulnérables interagissent avec ces chatbots IA chaque semaine. L'inquiétude première concerne les utilisateurs ayant des problèmes de santé mentale préexistants, qui sont plus enclins à une utilisation intensive de l'IA et pourraient voir leurs symptômes s'exacerber en conséquence.

Vers Paris et au-delà

Les résultats du rapport alimenteront les tables rondes de l'AI Impact Summit, prévu les 19 et 20 février à New Delhi. Ce sera le premier grand sommet mondial sur l'IA organisé dans le Sud Global, avec plus de 35 000 inscriptions et la participation attendue de 15 à 20 chefs de gouvernement, et ensuite l'AI Action Summit prévu à Paris. L'Inde, comme le note le document, joue un rôle clé dans l'élaboration des efforts mondiaux en matière de sécurité de l'IA, en particulier en ce qui concerne le Sud Global où la sécurité de l'IA est étroitement liée à l'inclusion, à la sécurité et à la préparation institutionnelle.

Le rapport souligne que l'ouverture responsable des modèles d'IA, l'accès équitable aux ressources de calcul et aux données, ainsi que la coopération internationale sont essentiels. C'est un appel à ne pas répéter les erreurs de la révolution numérique précédente, où l'infrastructure et les bénéfices se sont fortement concentrés dans le Nord Global tandis que les coûts (en termes de surveillance, de désinformation, de déplacement économique) se sont répartis plus uniformément.

Le défi pour la communauté internationale est clair : développer des cadres capables de distinguer la recherche scientifique légitime de l'intention malveillante, tout en reconnaissant que systèmes capables de concevoir des thérapies innovantes peuvent, avec des modifications minimes, concevoir des agents pathogènes innovants. Il ne s'agit pas de bloquer l'innovation, mais de synchroniser le rythme du développement technologique avec celui de la gouvernance.

Comme Bengio lui-même l'a déclaré dans le communiqué de presse : « Depuis la publication du premier International AI Safety Report il y a un an, nous avons assisté à des bonds significatifs dans les capacités des modèles, mais aussi dans leurs risques potentiels, et l'écart entre le rythme du progrès technologique et notre capacité à mettre en œuvre des sauvegardes efficaces reste un défi critique. »

Le rapport est conçu pour fournir aux décideurs les preuves rigoureuses nécessaires pour guider l'IA vers un avenir sûr, sécurisé et bénéfique pour tous. Avec sa deuxième édition, une compréhension commune, fondée sur la science, de l'évolution rapide de l'IA de pointe à l'échelle mondiale est mise à jour et renforcée. La question est maintenant de savoir si les institutions parviendront à se coaliser assez vite pour imposer ces garde-fous, ou si l'avancée « irrégulière » de l'intelligence artificielle continuera de remodeler notre réalité plus vite que nous ne pourrons la protéger.

En un sens, nous sommes dans une version technologique de ce moment décrit dans Le Problème à trois corps de Liu Cixin, où l'humanité doit coordonner une réponse mondiale à une menace qui progresse à une échelle de temps qui rend obsolètes les processus normaux de prise de décision. La différence est qu'ici, la menace ne vient pas des étoiles, mais de nos propres data centers. Et contrairement à la science-fiction, ici nous n'avons pas quatre cents ans pour nous préparer : nous avons quelques mois.