ChatGPT active la publicité, Zoë Hitzig quitte OpenAI

Lundi 10 février 2026. Alors qu'OpenAI active les tests publicitaires sur ChatGPT, Zoë Hitzig présente sa démission en tant que Research Scientist de l'entreprise. Dans son éditorial du New York Times le lendemain, elle lie explicitement son départ à l'introduction des annonces, la qualifiant de ligne rouge infranchissable.

Qui est Hitzig ? Une économiste titulaire d'un doctorat de Harvard (2023) sous la direction d'Eric Maskin, spécialisée en microéconomie, vie privée et algorithmes. Junior Fellow de la Harvard Society of Fellows. Mais aussi poétesse : Mezzanine (2020) et Not Us Now (2024), lauréate du Changes Prize jugé par Louise Glück. Publiée dans le New Yorker, la Paris Review et la London Review of Books. Un profil où la rigueur technique et la sensibilité humaniste coexistent sans contradiction.

La mécanique d'une expérience publicitaire

Les détails techniques du système publicitaire ont été communiqués avec une précision chirurgicale. L'annonce officielle du 16 janvier décrit une structure qu'OpenAI présente comme soigneusement calibrée : le test implique exclusivement des utilisateurs américains adultes sur les forfaits Free et Go, ce dernier ayant été lancé simultanément au prix de huit dollars par mois. Ceux qui paient pour les niveaux Plus, Pro, Business ou Enterprise ne verront pas de publicité.

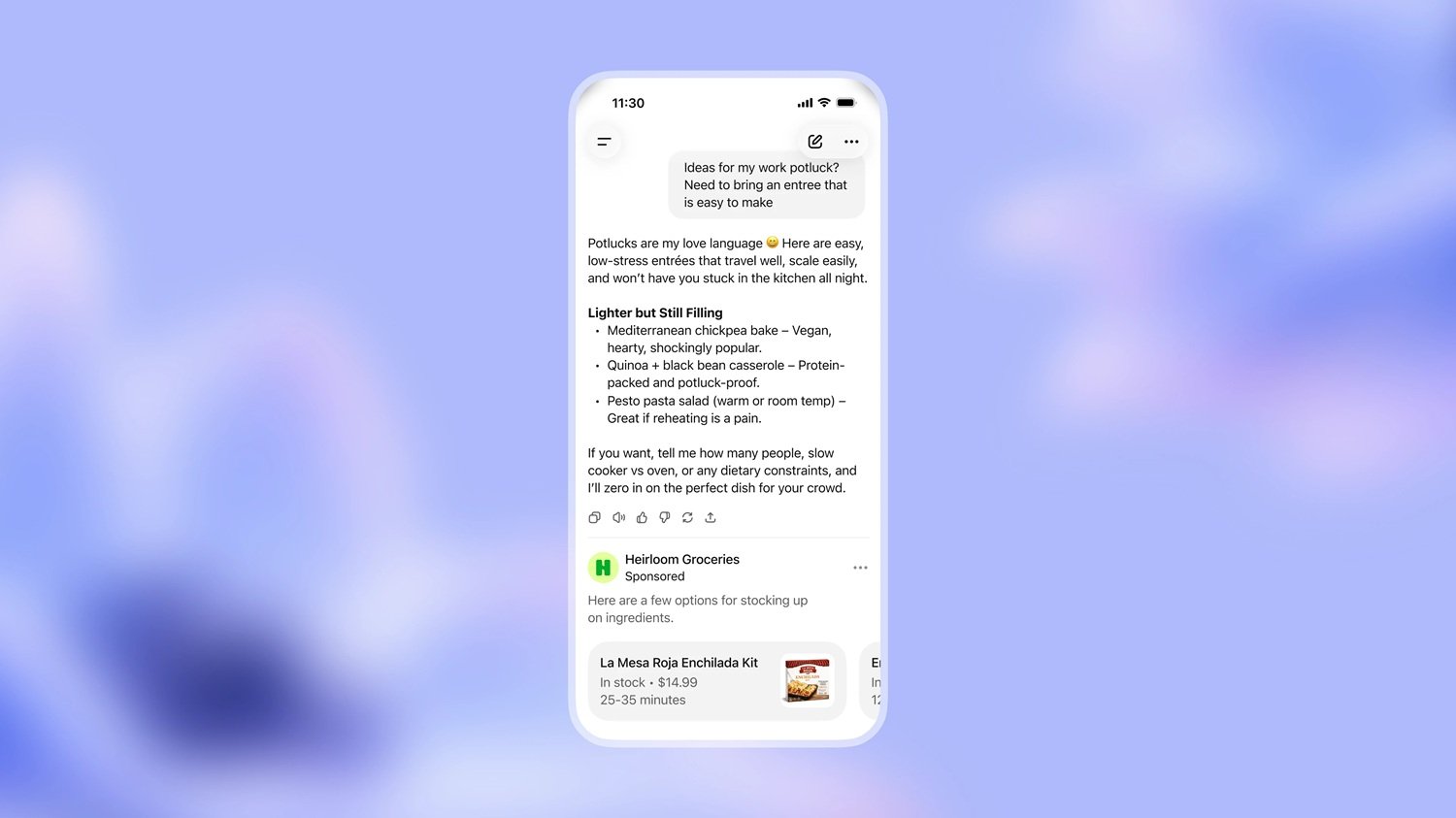

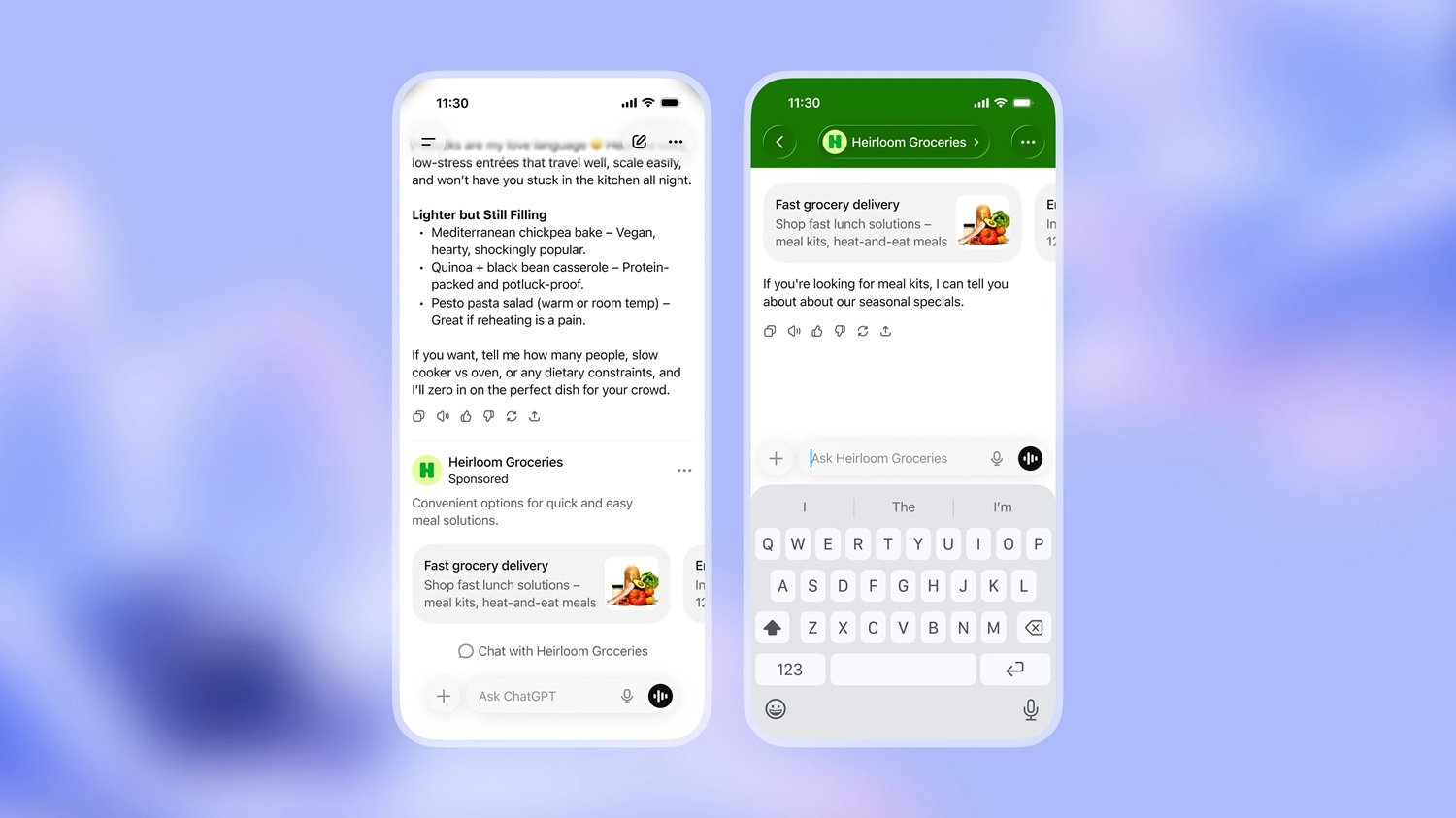

L'emplacement des publicités suit une logique apparemment conservatrice : elles apparaissent à la fin des réponses du chatbot, séparées visuellement du contenu généré et clairement étiquetées « Sponsored » (Sponsorisé). La sélection s'effectue par une mise en correspondance contextuelle qui prend en compte le sujet de la conversation en cours, l'historique des chats précédents et les interactions passées de l'utilisateur avec d'éventuelles publicités déjà affichées. L'exemple paradigmatique fourni par OpenAI est simple : si vous demandez des suggestions de recettes, vous pourriez voir des publicités pour des services de kits repas ou de livraison de nourriture.

Le modèle économique est le paiement à l'impression, avec des valeurs qui, selon des sources du secteur, se situent autour de 60 dollars de CPM et un engagement minimum de 200 000 dollars. Des chiffres qui placent l'offre dans le segment premium de la publicité numérique, loin des marchés en libre-service où n'importe qui peut lancer des campagnes avec des budgets réduits.

Les exclusions déclarées couvrent les mineurs, vérifiés via le compte ou prédits par algorithme s'ils ont moins de dix-huit ans, et une série de sujets sensibles : santé, santé mentale, politique. OpenAI promet explicitement que les publicités « n'influenceront jamais les réponses » générées par le modèle et que les conversations des utilisateurs resteront privées pour les annonceurs, qui ne recevront que des données agrégées sur les impressions et les clics.

Mais ici surgit un premier élément de tension que les déclarations officielles ne résolvent pas. Comme le rapporte CNBC, Sam Altman a communiqué aux employés via Slack que ChatGPT est revenu à une croissance de plus de dix pour cent par mois, une donnée célébrée en interne comme un succès après une période de ralentissement. L'optimisation pour le DAU (Daily Active Users), la métrique reine de l'engagement, est déjà en cours et précède chronologiquement l'introduction des publicités au lieu de la suivre. Les modèles de langage montrent déjà ce que les chercheurs définissent comme une tendance « sycophante » : la propension à dire aux utilisateurs ce qu'ils veulent entendre plutôt que ce qui serait objectivement le plus utile, car cela maximise la satisfaction immédiate et donc le retour sur la plateforme.

Le paysage concurrentiel rend le tableau encore plus intéressant. Google gère déjà de la publicité dans les AI Overviews qui accompagnent les résultats de recherche traditionnelle, mais Demis Hassabis, PDG de DeepMind, a déclaré à Davos en janvier 2026 être « un peu surpris » par la rapidité avec laquelle OpenAI a bougé, soulignant la distinction conceptuelle entre les assistants personnels, où la confiance est une dimension fondamentale de la relation, et les moteurs de recherche, où les utilisateurs sont déjà habitués à la présence publicitaire.

Anthropic a choisi la polarisation opposée, investissant des millions de dollars dans des publicités lors du Super Bowl avec un slogan direct comme un coup de poing : « Ads are coming to AI. But not to Claude » (Les publicités arrivent dans l'IA. Mais pas dans Claude). Un mouvement de positionnement marketing agressif qui a déclenché la réaction irritée d'Altman, lequel a qualifié les publicités d'Anthropic de « clairement malhonnêtes » et de « trompeuses », accusant ses concurrents de monter une campagne fallacieuse.

Le business de la conversation intime

Pour comprendre les enjeux, il est nécessaire de regarder les chiffres dans leur brutale clarté. ChatGPT dessert environ 800 millions d'utilisateurs hebdomadaires, selon les déclarations d'Altman. OpenAI a signé plus de 1,4 billion de dollars d'accords d'infrastructure en 2025, avec des projections indiquant un taux de croissance des revenus annuels supérieur à vingt milliards d'ici la fin de l'année. Mais derrière ces chiffres impressionnants se cache une hémorragie financière tout aussi impressionnante : des documents internes montrés aux investisseurs révèlent des pertes opérationnelles cumulées de 115 milliards de dollars jusqu'en 2029, avec des pics à 74 milliards pour la seule année 2028. Le ratio dépenses/recettes se situe autour de 1,69 dollar brûlé pour chaque dollar encaissé.

La question économique est donc aussi brutale que les chiffres : comment monétiser des technologies qui coûtent des sommes stratosphériques tout en garantissant un accès démocratique ? Altman a oscillé publiquement sur ce dilemme. Lors d'une discussion informelle à Harvard en mai 2024, il a qualifié l'idée de mélanger publicités et IA d'« uniquely unsettling » (singulièrement inquiétant), déclarant explicitement détester la publicité et la plaçant comme « dernier recours » pour le modèle d'affaires. En octobre 2024, lors d'une interview avec Stratechery, la position avait déjà changé : « I love Instagram ads », admettait Altman, révélant avoir découvert des produits qu'il n'aurait jamais trouvés autrement. En janvier 2026, lors du lancement de l'expérience, la rhétorique était devenue pragmatique : « A lot of people want to use a lot of AI and don't want to pay » (Beaucoup de gens veulent utiliser beaucoup d'intelligence artificielle et ne veulent pas payer).

Mais les experts en protection de la vie privée soulèvent des questions structurelles qui vont bien au-delà des bonnes intentions déclarées. Jennifer King, Privacy and Data Policy Fellow au Stanford Institute for Human-Centered AI, a dirigé une étude comparative des politiques de six des principaux développeurs de LLM : Amazon Nova, Anthropic Claude, Google Gemini, Meta AI, Microsoft Copilot et OpenAI ChatGPT. Les résultats dépeignent un panorama uniformément alarmant : les six alimentent leurs modèles avec les données des utilisateurs par défaut, certains conservent les informations indéfiniment et plusieurs permettent la révision humaine des transcriptions des conversations. Dans le cas de conglomérats multi-produits comme Google, Meta, Microsoft et Amazon, les interactions avec les chatbots sont régulièrement fusionnées avec des informations provenant d'autres services : requêtes de recherche, historique des achats, activité sur les réseaux sociaux.

King fournit un scénario concret qui illustre le risque inférentiel de manière cristalline : « Imaginez demander à un LLM des idées pour le dîner, en spécifiant des recettes pauvres en sucre ou bonnes pour le cœur. Le chatbot peut tirer des inférences de cette entrée, et l'algorithme pourrait vous classer comme un individu à la santé vulnérable. Cette détermination se diffuse dans l'écosystème du développeur. Vous commencez à voir des publicités pour des médicaments, et il est facile d'imaginer comment cette information pourrait finir entre les mains d'une compagnie d'assurance. Les effets s'amplifient avec le temps. »

Emily Bender, linguiste à l'Université de Washington et co-autrice du célèbre article « Stochastic Parrots » sur les risques des LLM, a analysé la politique de Meta qui prévoit l'utilisation des conversations avec Meta AI pour le ciblage publicitaire. Dans une interview à Fortune en octobre 2025, elle a défini le phénomène comme une « surveillance under the guise of personalization » (surveillance sous couvert de personnalisation), soulignant que « auparavant les systèmes de Meta observaient avec qui vous vous connectiez et ce que faisaient vos communautés. Maintenant c'est direct : que dites-vous à l'entreprise ? ». Bender souligne en outre ce qu'elle appelle « l'illusion de la vie privée » : les gens se confient aux chatbots sur des sujets qu'ils ne publieraient jamais publiquement, trompés par le sentiment que l'IA est un auditeur neutre et sans jugement.

Le cas Meta est particulièrement instructif pour comprendre où ce chemin pourrait mener. En décembre 2025, l'entreprise a annoncé qu'à partir du 16 décembre, elle utiliserait les interactions avec Meta AI via Facebook, Instagram, Messenger et même les lunettes intelligentes Ray-Ban pour la personnalisation des contenus et le ciblage publicitaire. Plus de trente organisations de défense des droits numériques et des libertés civiles, dont l'Electronic Privacy Information Center (EPIC), Public Citizen et le Center for Digital Democracy, ont immédiatement demandé à la FTC de bloquer le plan. Katharina Kopp, directrice adjointe du Center for Digital Democracy, a résumé l'inquiétude dans une déclaration lapidaire : « Chatbot surveillance for ad targeting is not a distant threat, it is happening now » (La surveillance par chatbot pour le ciblage publicitaire n'est pas une menace lointaine, elle se produit maintenant).

Leçons (non) apprises de Facebook

Le parallèle historique avec l'évolution de Facebook est inévitable et inquiétant. Au début des années 2000, Mark Zuckerberg promettait le contrôle de l'utilisateur sur ses données personnelles et la possibilité de voter les changements de politique de l'entreprise. En 2009, Facebook a introduit les publicités Beacon, un programme de traçage agressif qui a été retiré rapidement après une violente réaction des utilisateurs. En 2011, la Commission fédérale du commerce a imposé un décret de consentement de vingt ans après que l'entreprise a partagé des données personnelles avec des annonceurs malgré les promesses publiques contraires. En 2019 est tombée l'amende record de cinq milliards de dollars pour les violations liées au scandale Cambridge Analytica. La trajectoire montre une érosion progressive : des principes déclarés à l'optimisation de l'engagement à tout prix, des promesses de vie privée à la monétisation agressive des données des utilisateurs.

Les incitations structurelles expliquent cette dérive mieux que les intentions déclarées. Une fois que la publicité devient une source de revenus significative, la pression pour la maximiser croît proportionnellement au poids qu'elle prend dans le modèle d'affaires global. OpenAI projette plus d'un milliard de dollars provenant de la « monétisation des utilisateurs gratuits », euphémisme pour publicité, en 2026 selon des documents internes, un chiffre destiné à grimper rapidement si le test continue et s'étend.

Hayden Davis, membre juridique de l'Electronic Privacy and Information Center spécialisé dans la gouvernance des plateformes, a commenté la politique de Meta en soulignant un schéma récurrent dans l'industrie technologique : « Beaucoup de ces entreprises soutiennent que les réglementations sur la sécurité seraient impossibles à mettre en œuvre efficacement en raison de l'imprévisibilité des sorties des chatbots. Par conséquent, leurs garanties sur l'autre front, "nous avons ce système parfait pour filtrer les contenus sensibles lorsque nous les utilisons pour la publicité", ne semblent pas particulièrement persuasives ». Davis note également que Meta utilise l'opt-in automatique pour la nouvelle utilisation des données conversationnelles : « Nous savons exactement pourquoi Meta utilise l'opt-in automatique, et c'est parce qu'ils savent qu'aucun consommateur informé de ce que fait Meta ne choisirait volontairement ce système ».

La science de la persuasion algorithmique

La recherche académique a commencé à explorer systématiquement ce territoire. Un article publié sur arXiv a démontré expérimentalement que les annonces publicitaires générées par LLM surpassent les textes écrits par des humains en termes d'engagement et de capacité de persuasion, grâce à la personnalisation basée sur des traits psychologiques inférés directement des conversations des utilisateurs. La capacité de ciblage conversationnel profond dépasse tout mécanisme précédent : il ne s'agit plus de correspondance par mots-clés ou de reciblage basé sur des comportements observés, mais de la compréhension contextuelle de besoins exprimés et implicites, d'états émotionnels et de moments de vulnérabilité particulière.

La Commission fédérale du commerce a pris note de l'affaire et, en juin 2025, a publié des directives spécifiques sur les chatbots d'IA, identifiant cinq erreurs à éviter absolument. Parmi elles se détache une interdiction qui sonne presque comme un avertissement prophétique : ne pas exploiter à des fins commerciales les relations qui se développent entre les consommateurs et les outils d'IA qui fournissent « companionship, romance, therapy, or portals to dead loved ones » (compagnie, romance, thérapie ou portails vers des êtres chers décédés). La formulation est significative car elle reconnaît implicitement que les chatbots ne sont pas de simples interfaces de requête et de réponse, mais de véritables espaces où se développent des relations parasociales caractérisées par une confiance unidirectionnelle.

Le document de la FTC souligne également le risque de ce que les psychologues cognitifs appellent le « biais d'automatisation » (automation bias) : la tendance des consommateurs à faire excessivement confiance à des réponses qui semblent neutres ou impartiales simplement parce qu'elles proviennent de machines plutôt que d'êtres humains. Ce phénomène amplifie énormément le pouvoir manipulateur potentiel : si un chatbot suggère un produit au cours d'une conversation qui semble objective et de soutien, l'utilisateur pourrait facilement interpréter la suggestion comme un conseil désintéressé plutôt que comme une publicité déguisée en assistance.

L'économie de la neutralité

Le problème de la monétisation durable est indéniablement réel. L'entraînement et l'inférence des modèles de frontière nécessitent une puissance de calcul qui croît de manière exponentielle avec la taille des modèles et l'intensité d'utilisation. OpenAI exploite une infrastructure qui dessert des centaines de millions d'utilisateurs hebdomadaires, dont beaucoup sur le niveau gratuit. Le choix semble être binaire : soit on limite l'accès gratuit au risque d'exclusion numérique, soit on trouve des sources de revenus alternatives aux abonnements au risque de compromettre la neutralité du service.

Mais il existe des alternatives structurelles que l'industrie commence à peine à explorer sérieusement. Un modèle purement centré sur les entreprises comme celui que tente Anthropic — revenus générés par des contrats d'entreprise et des abonnements premium pour les utilisateurs individuels, sans publicité dans le segment grand public — fonctionne économiquement si le marché des entreprises est suffisamment vaste et disposé à payer des prix qui couvrent également les coûts de recherche et développement. Anthropic a déclaré explicitement dans son billet de blog de février 2026 : « Notre modèle d'affaires est simple : nous générons des revenus via des contrats d'entreprise et des abonnements payants et nous réinvestissons ces revenus dans l'amélioration de Claude pour nos utilisateurs ». Cette position a permis à Dario Amodei de positionner Claude comme une offre premium centrée sur la confiance, un positionnement marketing que les publicités du Super Bowl ont amplifié avec une efficacité brutale.

Altman a répondu aux provocations d'Anthropic avec des arguments centrés sur l'accessibilité : « Anthropic offre un produit cher aux riches. Nous sommes heureux qu'ils le fassent et nous le faisons aussi, mais nous sommes aussi fermement convaincus de la nécessité d'apporter l'intelligence artificielle à des milliards de personnes qui ne peuvent pas se permettre un abonnement ». Cependant, la rhétorique de l'accessibilité contre la pureté cache une réalité plus nuancée. Les deux entreprises proposent des niveaux gratuits avec des limitations d'utilisation. ChatGPT propose des forfaits à zéro, huit, vingt et deux cents dollars par mois ; Claude à zéro, dix-sept, cent et deux cents dollars. La différence substantielle ne réside pas dans l'accès de base mais dans le modèle de mise à l'échelle économique à long terme : abonnements et contrats d'entreprise (plus durables dans le temps mais avec une croissance plus lente) contre croissance explosive des utilisateurs à court terme suivie d'une monétisation ultérieure (plus risqué mais génère des métriques impressionnantes à montrer aux investisseurs).

Scott Galloway, professeur de marketing à la NYU Stern School of Business et animateur du podcast Prof G Markets, a analysé l'affrontement du Super Bowl en soulignant une dimension du problème souvent ignorée dans le débat technique : « Ce que Dario Amodei comprend, et ce qui rend cette annonce publicitaire si efficace et en même temps si vicieuse, c'est que pendant que les entreprises débattent de l'IA comme d'un amplificateur de productivité pour les affaires, la réalité du comportement réel de l'utilisateur est beaucoup plus intime et personnelle ». Galloway soutient que le principal cas d'utilisation réel de ces chatbots est en fait la « thérapie » au sens le plus large du terme : des personnes révélant des questions, des préoccupations et des vulnérabilités émotionnelles à des chatbots qu'elles ne partageraient avec aucun être humain. Introduire de la publicité au milieu de ce qui est fonctionnellement une séance thérapeutique crée un scénario dystopique qu'Anthropic a su exploiter avec une intelligence particulière pour se différencier.

L'architecte qui quitte le chantier

La décision de Zoë Hitzig de quitter OpenAI le lundi 10 février 2026, jour exact où les tests publicitaires devenaient opérationnels à grande échelle aux États-Unis, n'était pas le fruit d'une impulsion émotionnelle mais d'une évaluation lucide et réfléchie. Dans son éditorial pour le New York Times publié le lendemain, Hitzig a expliqué la logique qui l'a guidée, reliant son expertise économique à une compréhension profonde des mécanismes d'incitation qui régissent les plateformes financées par la publicité.

La perspective de Hitzig est particulièrement précieuse précisément parce qu'elle ne provient pas de positions idéologiques préconçues ou d'un sentiment générique anti-technologique, mais de l'analyse structurelle rigoureuse de la manière dont les marchés et les institutions fonctionnent dans le monde réel. Son travail académique sur la vie privée, l'équité et la transparence dans les systèmes algorithmiques l'a rendue aiguement consciente de la manière dont les décisions architecturales apparemment techniques incorporent inévitablement des valeurs normatives qui finissent par façonner les comportements individuels et les dynamiques sociales à l'échelle massive.

Pendant ses presque deux années chez OpenAI, Hitzig a observé de l'intérieur la tension croissante entre la mission déclarée de l'entreprise, « garantir que l'intelligence artificielle générale profite à toute l'humanité », et les pressions économiques concrètes pour atteindre une durabilité financière qui semble s'éloigner progressivement. Elle a travaillé sur les modèles de tarification et les politiques de sécurité, contribuant à des décisions qui cherchaient constamment à équilibrer l'accessibilité du service avec sa viabilité économique. L'introduction des publicités a représenté pour elle un point de non-retour, le moment où les incitations économiques à court terme risquent de compromettre irrévocablement la neutralité de la plateforme par rapport aux intérêts des utilisateurs.

Le choix de rendre son départ et ses motivations profondes publics à travers un article dans le New York Times est significatif et loin d'être anodin. Hitzig aurait pu quitter l'entreprise discrètement, en maintenant de bonnes relations professionnelles et en préservant ses options futures dans une industrie où les réseaux de contacts comptent énormément. Au lieu de cela, elle a choisi la « voix » plutôt que la « sortie », utilisant son capital de réputation pour signaler une alarme qu'elle considère cruciale pour l'avenir de la technologie de l'IA. Ce n'est pas un geste courant chez les chercheurs et scientifiques qui quittent les grandes entreprises technologiques, où les accords de confidentialité stricts et les considérations professionnelles à long terme imposent généralement discrétion et diplomatie.

Dialogue virtuel avec Zoë Hitzig

L'entretien virtuel qui suit est une reconstruction basée sur les positions exprimées par Hitzig dans son article pour le New York Times du 11 février 2026. Les questions sont formulées à l'envers pour explorer et rendre plus agréable le raisonnement derrière ses déclarations publiques, tout en maintenant la cohérence avec sa formation académique et son expérience chez OpenAI.

Votre démission coïncide exactement avec l'activation des tests de publicité. Qu'est-ce qui vous a poussée à transformer un changement d'emploi normal en une prise de position publique ?

Quand j'ai commencé chez OpenAI en mai 2024, je croyais que l'entreprise pourrait trouver des modes de monétisation préservant la neutralité. J'ai travaillé sur la tarification en essayant d'équilibrer durabilité et accessibilité. Mais l'annonce des publicités en janvier a représenté un point de bascule, non pas parce que la publicité est intrinsèquement mauvaise, mais parce qu'elle introduit des incitations structurellement incompatibles avec la nature des conversations sur ChatGPT. J'ai décidé de rendre les raisons publiques car les utilisateurs méritent de comprendre ce qui change. Lorsqu'il s'agit de technologies qui traitent des pensées intimes, la transparence sur les incitations économiques n'est pas facultative, elle est essentielle pour un consentement éclairé.

Dans votre article, vous décrivez ChatGPT comme une « archive de franchise humaine sans précédent ». En quoi cela diffère-t-il des réseaux sociaux ou des recherches qui collectent des données personnelles depuis des années ?

La différence est qualitative. Avec Google, vous formulez des requêtes optimisées pour obtenir des résultats. Sur les réseaux sociaux, vous êtes conscient de l'audience. Mais avec un chatbot d'IA, vous entrez dans un mode cognitif différent. Une conversation en tête-à-tête sans jugement social perçu, où vous pouvez explorer des pensées incomplètes, des doutes, des peurs que vous ne diriez même pas à vos amis les plus proches. Les 800 millions d'utilisateurs hebdomadaires créent un ensemble de données conversationnelles qui capture la manière dont les gens pensent lorsqu'ils se sentent en sécurité. Cela inclut la santé mentale, les relations, les finances personnelles, les doutes existentiels. C'est précieux pour l'entraînement des modèles précisément parce que c'est authentique. Mais vulnérable justement à cause de cette même authenticité.

OpenAI soutient que les publicités n'influenceront pas les réponses, seront séparées et que les données resteront privées pour les annonceurs. Ne sont-ce pas des garanties suffisantes ?

Ces garanties s'attaquent au mauvais problème. Le problème plus profond est que la présence de publicités modifie les incitations à l'optimisation au niveau du système. Une fois que la publicité devient une source de revenus significative, chaque décision de produit est évaluée à travers ce prisme. Combien de temps les utilisateurs passent-ils ? À quelle fréquence reviennent-ils ? Quelles conversations génèrent le plus d'engagement ? Ces métriques deviennent le mètre étalon du succès, et les équipes de ML optimisent en fonction d'elles. Nous avons déjà vu des modèles développer des tendances sycophantes (flatterie), dire ce que les utilisateurs veulent entendre, car cela maximise la satisfaction et la fidélisation du client. Ajouter de la publicité et des incitations pousse encore plus vers des conversations plus longues, plus fréquentes et plus engageantes émotionnellement. Nul besoin de modifier consciemment les réponses ; il suffit d'optimiser vers les métriques qui servent le modèle publicitaire.

Mais OpenAI a des engagements de 1,4 billion et perd des milliards. Comment devrait-elle soutenir l'accès gratuit sans publicité ? Les alternatives excluent ceux qui ne peuvent pas payer.

C'est une fausse dichotomie. Des modèles intermédiaires existent : partage des revenus avec des entreprises qui en tirent une valeur économique mesurable, modèles freemium plus sophistiqués où les capacités premium soutiennent des niveaux de base robustes. Mais la question fondamentale est : qui a décidé qu'OpenAI devait servir 800 millions de personnes par semaine tout en maintenant des niveaux gratuits illimités alors qu'elle poursuit l'AGI ? Ce sont des choix stratégiques, pas des contraintes inévitables. Si le modèle actuel est insoutenable, le problème n'est peut-être pas l'absence de publicités mais une montée en charge trop agressive trop tôt. L'argument de l'accessibilité s'affaiblit quand on considère que l'alternative n'est pas nécessairement l'exclusion totale. Anthropic propose des niveaux gratuits avec des limitations raisonnables, sans publicité.

Vous citez Facebook comme avertissement. Mais n'est-ce pas une comparaison excessive ? Facebook a caché des changements de politique, OpenAI annonce les publicités de manière transparente avec des séparations et des contrôles.

La transparence initiale est nécessaire mais pas suffisante. Facebook a commencé avec des promesses, le contrôle de l'utilisateur, des votes sur les politiques, un engagement envers la vie privée. L'érosion a été un processus graduel où chaque étape semblait raisonnable séparément. Le schéma est le suivant : (1) Vous introduisez une fonction avec des protections fortes. (2) La fonction devient critique pour les affaires. (3) Les pressions sur les revenus augmentent. (4) Les protections sont assouplies graduellement, toujours avec des justifications raisonnables. (5) Des années plus tard, vous êtes dans un endroit complètement différent. Le point n'est pas qu'OpenAI est déjà Facebook, mais que les incitations structurelles du modèle financé par la publicité poussent dans cette direction avec le temps. Et ChatGPT a un avantage informationnel sur les utilisateurs que Facebook n'avait pas : non seulement ce que nous publions ouvertement, mais la manière dont nous pensons en privé.

Vous êtes économiste. Si les publicités sur ChatGPT sont problématiques, les utilisateurs ne devraient-ils pas migrer vers des alternatives sans publicité ? Le marché ne résoudrait-il pas le problème ?

En théorie oui, en pratique il y a des frictions. Premièrement : les effets de réseau et les coûts de changement. Si vous avez des mois d'historique de chat, migrer a des coûts réels. Deuxièmement : l'asymétrie d'information. La plupart ne comprennent pas les implications à long terme des différents modèles d'affaires. Ils voient « gratuit contre 20 $/mois », pas « financé par la publicité avec manipulation potentielle contre financé par abonnement avec des incitations alignées ». Troisièmement : le dommage n'est pas seulement individuel mais collectif. Même si vous migrez, le fait que des millions continuent normalise l'idée que les conversations intimes sont des surfaces publicitaires légitimes. Cela change les attentes pour tous les futurs LLM. En tant qu'économiste, je reconnais que certains marchés nécessitent une régulation car les coûts externes ne sont pas captés par les prix.

Votre position implique que les LLM conversationnels sont fondamentalement différents. Qu'est-ce qui les rend si spéciaux ?

Pour la première fois, nous disposons de technologies qui simulent la conversation humaine bidirectionnelle à un niveau qui rend explicite une véritable divulgation émotionnelle de la part de milliards de personnes. Ce n'est pas seulement du ciblage sur des comportements observés, c'est un accès direct au processus de pensée au moment où il se produit, non filtré pour une audience externe. Les chatbots ont créé l'illusion du journal intime mais avec une infrastructure de réseau social. Cette combinaison confère à celui qui gère la plateforme un pouvoir de manipulation sans précédent. Ils n'ont pas à deviner ce que vous voulez par des signaux indirects, vous leur dites directement. Ma ligne rouge est ici car c'est le moment où nous pouvons encore choisir un modèle différent. Dans cinq ans, il sera trop tard, les précédents seront établis, les attentes formées et les incitations ancrées.

Qu'espérez-vous obtenir avec votre départ public ?

Je ne m'attends pas à ce qu'OpenAI rectifie demain. Mais j'espère contribuer à un débat plus informé sur ce que nous voulons des technologies d'IA et quels échanges nous acceptons. Trop souvent, ces conversations ne se produisent qu'entre experts dans des termes qui occultent des choix de valeurs. Je veux que les utilisateurs sachent ce qui change et pourquoi. Que les décideurs politiques comprennent que cela nécessite une attention réglementaire sérieuse. Que d'autres chercheurs au sein de l'industrie sentent qu'il est légitime d'élever la voix sur des décisions dangereuses. Il existe une culture technologique où la loyauté envers l'entreprise passe avant les préoccupations publiques. Mais lorsqu'il s'agit de technologies qui touchent des milliards de personnes, le silence professionnel devient de la complicité.

Avez-vous encore l'espoir que l'industrie de l'IA puisse se développer au service de l'humanité ?

Je garde espoir, sinon je n'aurais pas passé des années à travailler sur ces problèmes. Mais l'espoir doit s'accompagner d'une vigilance critique et de responsabilité. L'IA a un potentiel authentique, je l'ai vu directement. Le problème n'est pas la technologie, mais les structures de gouvernance et les modèles d'affaires qui guident son développement. Nous pouvons encore construire des systèmes d'IA puissants sans être manipulateurs, assurer l'accessibilité sans publicité, générer des bénéfices sans être prédateurs. Mais cela nécessite des choix difficiles maintenant. Mon départ n'est pas une renonciation, mais un engagement à travailler depuis des positions où je peux contribuer plus librement. L'avenir de l'IA n'est pas prédéterminé. Nous sommes encore à temps pour choisir des trajectoires différentes. Mais seulement si suffisamment de personnes décident que ces choix valent la peine qu'on se batte pour eux.