Cyborgs, Centaures ou Automates : la façon dont vous utilisez l'IA révèle qui vous deviendrez

Imaginez un consultant du Boston Consulting Group, grassement payé pour sa perspicacité stratégique, qui, face à un cas d'entreprise critique, copie et colle l'intégralité du problème dans ChatGPT et accepte la recommandation de l'IA sans poser une seule question. La réponse était fausse. Pourtant, ce professionnel a remis le mémo au PDG sans sourciller. Il ne s'agit pas d'un cas isolé : dans une étude menée par des chercheurs de Harvard et du MIT auprès de 244 consultants du BCG, 27 % ont fait exactement cela, déléguant complètement le raisonnement à la machine.

La contradiction est frappante. Il ne s'agissait pas de stagiaires paresseux, mais de professionnels qualifiés qui savaient qu'ils étaient évalués. Ils avaient accès au même outil, aux mêmes données, à la même tâche. Pourtant, ils ont produit trois modèles de collaboration avec l'intelligence artificielle générative complètement différents, avec des conséquences radicalement opposées sur leur développement professionnel. La question qui se dégage de l'étude n'est pas de savoir s'il faut utiliser l'IA, mais comment. Et la réponse à ce "comment" est en train de redessiner silencieusement la frontière entre l'expertise humaine et les capacités de la machine.

Trois tribus, un seul outil

Le document de travail signé par Steven Randazzo, Katherine Kellogg, Hila Lifshitz, François Candelon, Fabrizio Dell'Acqua, Ethan Mollick et Karim Lakhani s'intitule "Cyborgs, Centaurs and Self-Automators" et représente une évolution naturelle de la recherche qui, en 2023, avait introduit le concept de "frontière déchiquetée" de l'IA. Cette première enquête avait révélé à quel point les capacités de GPT-4 étaient irrégulières, excellentes dans certaines tâches et étonnamment fragiles dans d'autres. Cette nouvelle étude va plus loin, en déplaçant l'accent de ce que l'IA peut faire à la manière dont les humains choisissent de l'intégrer dans leur flux de travail.

Les chercheurs ont construit une plateforme personnalisée basée sur GPT-4 pour suivre chaque interaction : 4 975 échanges entre professionnels et la machine, tous enregistrés avec des horodatages. La tâche assignée reproduisait un cas classique de conseil en stratégie : analyser trois marques de vêtements d'une entreprise fictive et recommander dans laquelle investir pour maximiser la croissance. Les participants disposaient de transcriptions d'entretiens avec des dirigeants, de données financières historiques, d'informations sur le marché. Un matériel dense, ambigu, tout comme dans la réalité.

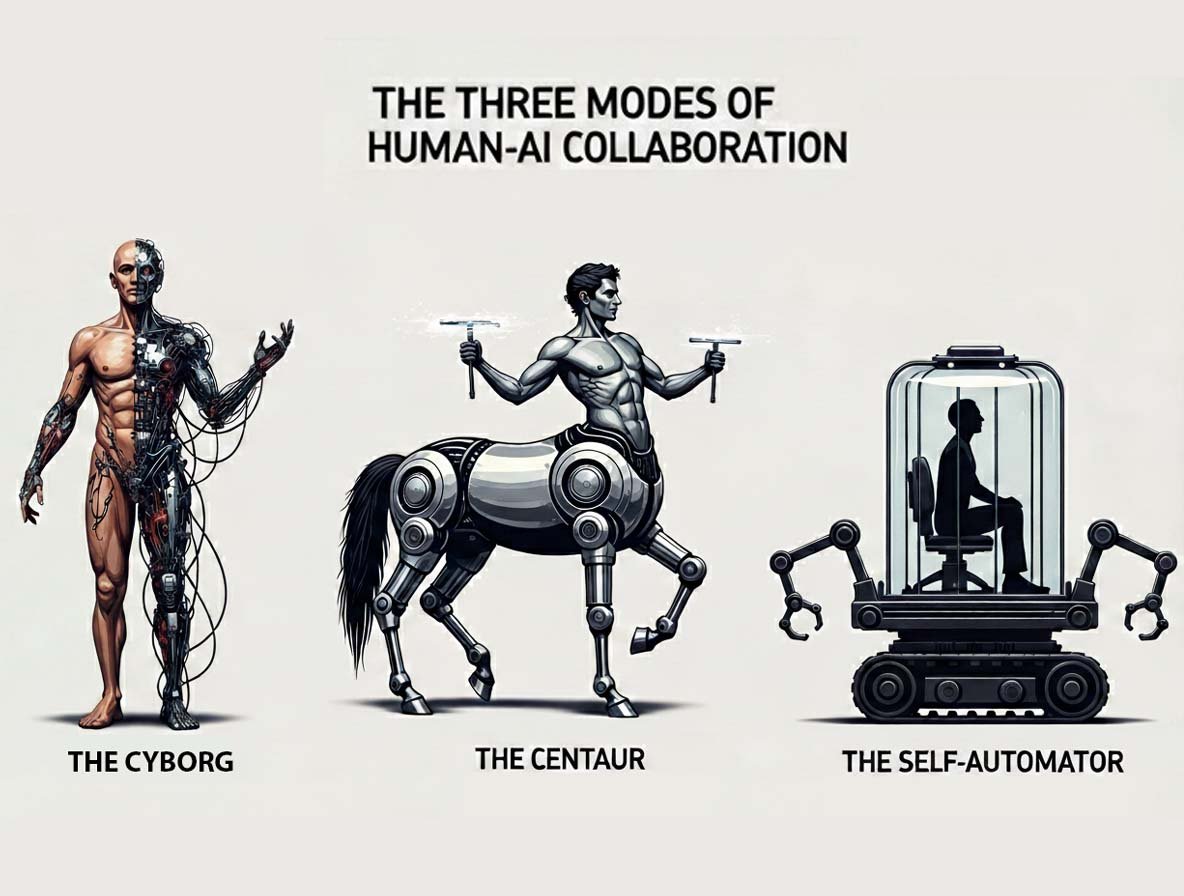

Ce qui est ressorti de l'analyse des modèles d'interaction a surpris les chercheurs eux-mêmes. Il n'y avait pas une seule façon de travailler avec l'IA générative, mais trois modes distincts que les auteurs ont baptisés de noms évocateurs empruntés à la mythologie et à la science-fiction. 60 % des consultants se sont comportés comme des "Cyborgs", fusionnant continuellement leur propre raisonnement avec celui de la machine dans un dialogue serré et itératif. 14 % ont agi en "Centaures", gardant fermement le contrôle stratégique et utilisant l'IA de manière sélective pour des tâches spécifiques. Les 27 % restants se sont transformés en "Auto-Automates", confiant à l'IA à la fois la définition du problème et son exécution.

Le choix du nom Centaure n'est pas anodin. Telle la créature mythologique qui unit l'intelligence humaine et la force équine en les maintenant distinctes, ces professionnels gardent leurs domaines de compétence séparés, décident eux-mêmes quoi faire et comment le faire, en ne déléguant à l'IA que des tâches circonscrites. Les Cyborgs, en revanche, dans une fusion qui rappelle plus Ghost in the Shell que Matrix, travaillent en symbiose continue avec la machine, sans frontières nettes entre la fin de la pensée humaine et le début de la pensée algorithmique.

La frontière déchiquetée de l'expertise

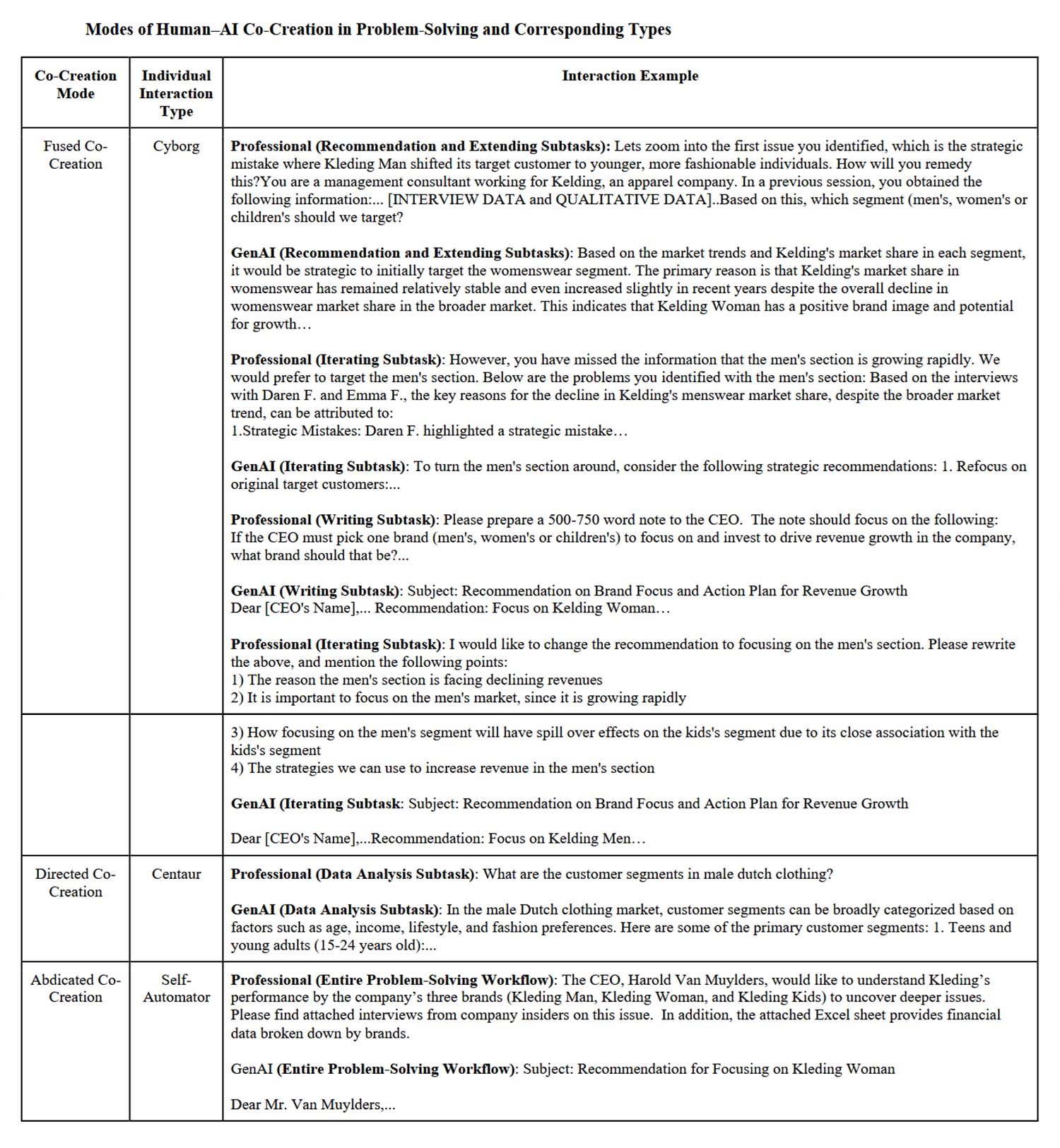

Pour vraiment comprendre ce qui distingue ces trois tribus, il faut entrer dans le détail des conversations. Les Cyborgs ont développé un répertoire sophistiqué de pratiques interactives. Ils assignent à la machine un rôle, un personnage : "Imaginez que vous êtes un consultant senior spécialisé dans le commerce de détail", pour orienter ses réponses. Ensuite, ils décomposent les problèmes complexes en sous-tâches plus faciles à gérer, ce que les chercheurs appellent la "modularisation" et qui, dans le jargon technique, est connu sous le nom de "chain-of-thought prompting". Ils ne font pas aveuglément confiance : ils demandent à l'IA de vérifier son propre travail, de justifier ses conclusions, ils la remettent en question lorsqu'ils trouvent des contradictions.

Un exemple concret de l'étude. Un consultant reçoit de GPT-4 la recommandation d'investir dans la marque féminine. Mais quelque chose ne colle pas. Il ajoute des données de marché montrant une croissance de 72 % dans le segment masculin et demande : "Cela change-t-il votre recommandation ?". L'IA réévalue et suggère de considérer également la marque masculine. Le consultant insiste, expose des incohérences dans les taux de croissance, pousse la machine dans ses retranchements. Après plusieurs tours, la bonne réponse émerge. Ce n'est pas une simple utilisation de l'IA, c'est une danse cognitive.

Les Centaures, en revanche, travaillent de manière radicalement différente. Ils utilisent l'IA principalement à trois fins : cartographier le domaine du problème en demandant des informations générales du type "Quelles sont les principales tendances de la mode masculine ?", recueillir des informations méthodologiques comme "Quelle est la formule Excel pour calculer le TCAC ?", et affiner le contenu qu'ils ont déjà écrit eux-mêmes. Un consultant Centaure fait les calculs lui-même dans Excel après avoir demandé la formule à l'IA. Il rédige ses conclusions puis demande : "Pouvez-vous relire ce texte pour plus de clarté et de concision ?". Le contrôle n'est jamais cédé.

Les Auto-Automates sont à l'extrême opposé. Dans certains cas, ils ont accompli l'ensemble de la tâche en une ou deux interactions. Ils copient l'intégralité de l'énoncé du problème, toutes les interviews, tous les tableaux financiers dans un seul et même prompt gigantesque. GPT-4 répond par une analyse, une recommandation, des stratégies innovantes et un mémo final. Ils acceptent, en apportant peut-être quelques retouches éditoriales superficielles : "Réduire à 400 mots" ou "Supprimer les citations directes". Fin. Aucune validation, aucune itération sur le fond.

Qui apprend quoi (et qui n'apprend rien)

Les implications pour le développement professionnel sont considérables. Les chercheurs ont identifié trois trajectoires d'apprentissage différentes qu'ils appellent "upskilling", "newskilling" et "no skilling". Les Cyborgs développent ce que l'étude définit comme une expertise liée à l'IA, ils apprennent à orchestrer la machine avec une précision croissante. Une consultante interrogée raconte : "Avant, je posais une question et je prenais la réponse comme point de départ. Maintenant, je sais que je peux continuer à creuser, à poser des questions de suivi, à aller plus loin". Ils acquièrent une nouvelle compétence méta-cognitive, la capacité de collaborer efficacement avec des systèmes génératifs.

Mais attention, les Cyborgs n'abandonnent pas leur expertise de domaine. Au contraire, ils la maintiennent active précisément parce qu'ils doivent continuellement évaluer, corriger, intégrer ce que produit l'IA. Lorsqu'un Cyborg expose une contradiction factuelle dans le résultat de GPT-4, il exerce son jugement professionnel. Lorsqu'il demande à l'IA de recalculer après avoir ajouté de nouvelles données, il guide l'analyse avec sa compréhension du contexte.

Les Centaures, quant à eux, développent un "upskilling" classique, approfondissant leur compétence dans le domaine spécifique. Un consultant raconte qu'il utilise ChatGPT comme un "service à guichet unique" pour accélérer l'apprentissage sur de nouveaux secteurs, en demandant des exemples d'entreprises ayant relevé des défis similaires, en étudiant des cas concrets, en utilisant l'IA comme une version améliorée de Google qui ne se contente pas de trouver des informations mais les synthétise et les contextualise. Leur relation avec la machine est instrumentale, un moyen de devenir meilleurs dans leur travail, pas de le transformer.

Les Auto-Automates, cependant, sont l'histoire la plus inquiétante. L'étude est lapidaire : "no skilling", aucun développement ni de compétences en IA ni de compétences de domaine. Le peu d'échanges d'informations, l'absence d'itération, la délégation totale de la prise de décision produisent une stagnation professionnelle. Tels Bartleby le scribe de Melville qui ne répond que "je préférerais ne pas", ces professionnels ont préféré ne pas penser, déléguant à la machine jusqu'au processus d'apprentissage qui découle de l'effort cognitif.

Les pièges de la délégation totale

Il y a un élément contre-intuitif dans les résultats sur la qualité des productions. Les Centaures ont produit les recommandations les plus précises, dépassant à la fois les Cyborgs et les Auto-Automates. Cela soulève des questions profondes sur la relation entre une collaboration intense et la performance. Pourquoi les Cyborgs, qui interagissent pourtant continuellement avec l'IA, n'obtiennent-ils pas les meilleurs résultats ?

La réponse réside dans ce que Ethan Mollick appelle le problème de la "frontière déchiquetée". Les capacités de GPT-4 sont excellentes dans certaines tâches mais fragiles dans d'autres, et les limites sont imprévisibles. Les Cyborgs, en travaillant en symbiose constante, risquent de faire trop confiance à la machine même lorsque celle-ci opère en dehors de sa zone de force. Un consultant Cyborg de l'étude utilise la pratique de la "validation", en demandant explicitement à l'IA de vérifier son propre travail. GPT-4 confirme la mauvaise recommandation avec des arguments plausibles. Le consultant, convaincu par la cohérence logique apparente, accepte. Il a utilisé une bonne pratique, mais la machine l'a quand même trompé.

Les Centaures évitent ce piège car ils gardent toujours active leur lentille critique. Ils ne demandent jamais à l'IA de prendre des décisions stratégiques, seulement de soutenir leur analyse. Lorsqu'un Centaure demande "Comment puis-je repositionner le prix pour attirer une cible masculine plus jeune ?", il cherche des stimuli, pas des réponses définitives. Le jugement final reste humain.

Les Auto-Automates, en revanche, représentent le risque le plus évident, l'érosion de l'expertise par le désuétude. Tels des muscles qui s'atrophient sans exercice, les capacités de résolution de problèmes se détériorent lorsqu'elles sont systématiquement déléguées. Et c'est là qu'un schéma inquiétant se dégage de l'étude. De nombreux Auto-Automates ont exprimé dans les entretiens une confiance totale dans l'IA. L'un d'eux dit : "J'ai fait une vérification rapide de bon sens pour m'assurer que les données et la recommandation n'étaient pas trop éloignées de la réalité". Un autre admet candidement : "Franchement, j'étais paresseux. Je ne voulais pas écrire 500 mots, je voulais que GenAI les produise".

La paresse cognitive déguisée en efficacité est peut-être le signal le plus alarmant. Car il s'agissait de professionnels qui savaient qu'ils étaient évalués, qui avaient une incitation explicite à bien performer. Que se passera-t-il lorsque l'utilisation quotidienne de l'IA ne sera pas suivie, lorsque la seule pression sera de boucler rapidement une livraison ?

Quel utilisateur d'IA êtes-vous ?

L'étude soulève des questions qui vont bien au-delà du cas spécifique du conseil. Si trois modes aussi différents émergent spontanément dans un groupe homogène de professionnels qualifiés confrontés à la même tâche, que se passera-t-il lorsque l'IA générative pénétrera dans des professions aux dynamiques épistémiques différentes ? Un avocat qui doit construire une argumentation juridique, un médecin qui doit formuler un diagnostic différentiel, un architecte qui doit équilibrer l'esthétique et les contraintes structurelles, chacun d'eux pourrait développer des variantes uniques de ces modèles.

Les chercheurs sont prudents quant à l'extension excessive des résultats. L'étude a saisi un instantané d'une seule session avec GPT-4 d'avril 2023, un modèle qui est aujourd'hui déjà dépassé. Nous ne savons pas comment ces modèles évoluent dans le temps, si quelqu'un qui commence comme Auto-Automate peut devenir un Cyborg avec l'expérience, ou si, à l'inverse, une utilisation prolongée conduit inévitablement à l'automatisation par commodité. Et il y a un quadrant de leur cadre théorique qui est resté empiriquement vide, celui où l'IA sélectionne ce qu'il faut faire mais où l'humain exécute. Peut-être que cette configuration est simplement instable, peut-être qu'elle représente un avenir encore à explorer.

Il y a ensuite le thème des IA agentiques, des systèmes qui n'attendent pas de prompts mais qui agissent de manière autonome pour accomplir des flux de travail complexes. Lorsque l'IA ne sera plus un partenaire conversationnel mais un agent proactif, les trois modes identifiés par l'étude pourraient s'effondrer ou se transformer en quelque chose de radicalement différent. La distinction entre Cyborg et Auto-Automate n'a de sens que tant qu'il y a une boucle interactive à maintenir ou à abandonner.

Les implications organisationnelles sont tout aussi profondes. Si les Centaures produisent les résultats les plus précis mais que les Cyborgs développent de nouvelles compétences en IA, quel mode une entreprise devrait-elle promouvoir ? La réponse dépend des objectifs stratégiques. Une organisation axée sur la qualité immédiate du service favorisera les Centaures. Une qui vise à renforcer ses capacités internes d'orchestration de l'IA investira dans les Cyborgs. Et les Auto-Automates ? L'étude suggère que l'automatisation complète a du sens pour les tâches routinières ou lorsque le temps est critique, mais les risques de déqualification doivent être soigneusement pesés en fonction du contexte.

Ce qui est certain, c'est que nous ne pouvons plus traiter "l'utilisation de l'IA" comme une catégorie monolithique. La question pertinente pour l'avenir du travail cognitif n'est pas "utilisez-vous l'IA ?", mais "comment l'utilisez-vous ?". Et ce choix, souvent inconscient, est déjà en train d'écrire le scénario de ce que vous deviendrez professionnellement dans les années à venir. Êtes-vous un Cyborg qui apprend à danser avec la machine, un Centaure qui garde fermement le contrôle, ou un Auto-Automate qui préfère déléguer ? La réponse peut être différente d'une tâche à l'autre, d'un jour à l'autre. Mais reconnaître le modèle est le premier pas pour le choisir consciemment au lieu de le subir.