MiniMax M2.7 : l'IA qui apprend d'elle-même (presque)

Un mois. C'est le temps qui sépare M2.5 de M2.7, la nouvelle version du modèle de MiniMax publiée le 18 mars 2026. Dans un secteur où les cycles de développement se mesuraient en années puis en mois, quelques semaines sont devenues le nouvel intervalle normal. Mais cette fois, la distance temporelle n'est que le détail le moins intéressant.

Il y a tout juste un mois, dans le magazine Codemotion, j'analysais MiniMax M2.5 : un modèle avec une architecture à experts mixtes de 230 milliards de paramètres au total, capable d'en activer seulement 10 milliards par requête, avec des performances sur SWE-Bench Verified (80,2 %) pratiquement identiques à Claude Opus 4.6 (80,8 %) pour un vingtième du prix. La proposition était aussi simple que déstabilisante : une qualité de frontière à des coûts abordables, avec une « mentalité d'architecte » qui émergeait spontanément lors de l'entraînement sur plus de 200 000 environnements réels. MiniMax, startup de Shanghai cotée à Hong Kong avec une capitalisation post-introduction en bourse d'environ 13 milliards de dollars, avait déjà redéfini le rapport qualité-prix dans l'IA pour le code.

M2.7 n'est pas une réponse à une faiblesse de M2.5. C'est quelque chose de différent : une tentative déclarée de changer la façon dont un modèle est développé, pas seulement ce qu'il produit. Le mot-clé choisi par MiniMax pour le communiquer est self-evolution, auto-évolution. C'est un mot fascinant, évocateur et potentiellement trompeur. Il vaut la peine de comprendre exactement ce qu'il signifie, et surtout ce qu'il ne signifie pas.

Le modèle qui aide à construire le modèle suivant

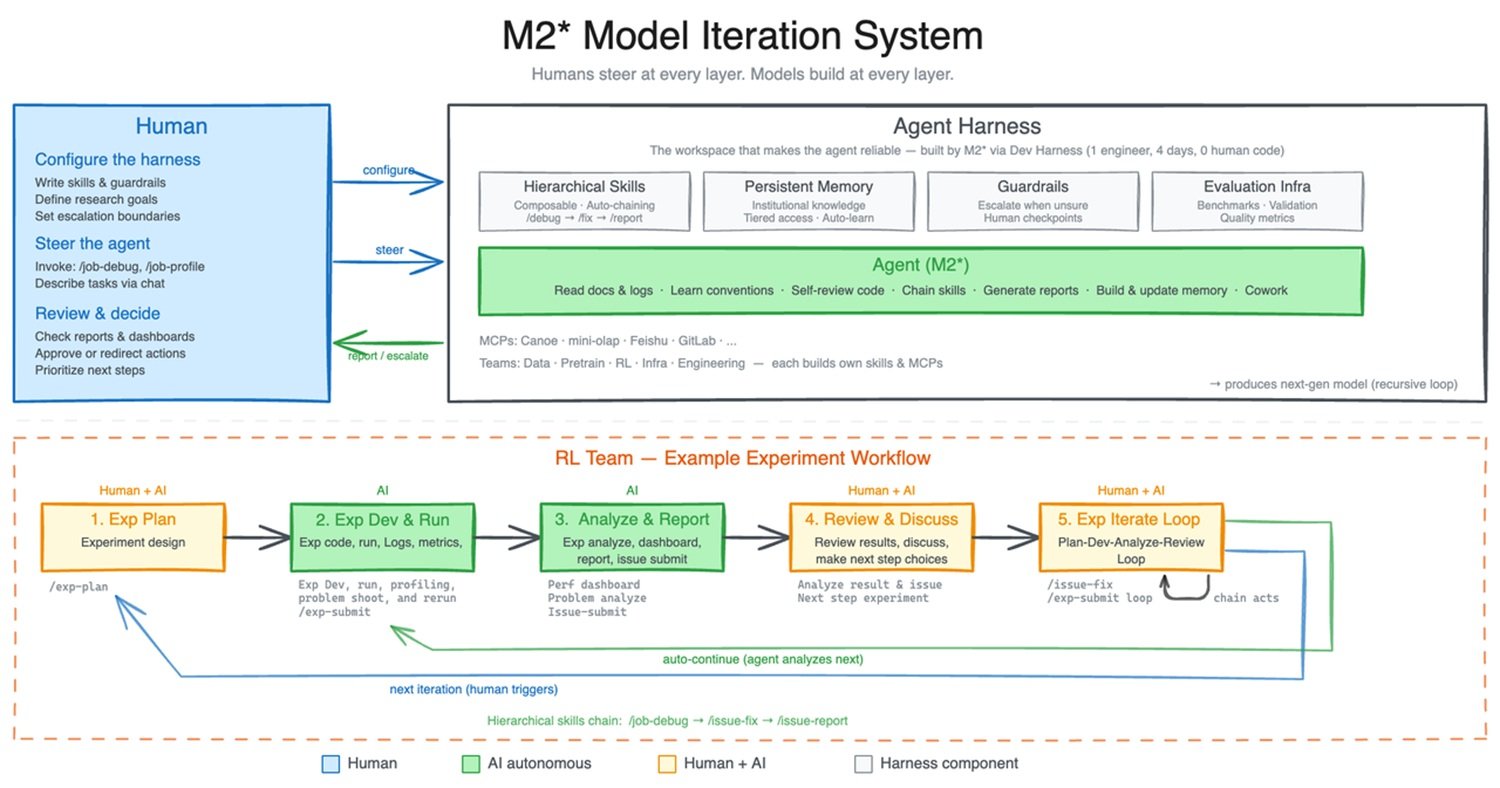

Pour comprendre ce qui s'est réellement passé avec M2.7, il faut partir d'une image concrète. Dans l'équipe de recherche de MiniMax, les chercheurs qui travaillent sur l'apprentissage par renforcement (l'entraînement par récompenses et pénalités) gèrent des cycles expérimentaux longs et complexes : idées à tester, données à préparer, expériences à lancer, résultats à analyser, code à corriger, nouvelles expériences à configurer. C'est un travail qui nécessite normalement la collaboration de plusieurs personnes de différentes équipes.

Selon la documentation officielle de MiniMax, une version interne de M2.7 a été mise au travail précisément sur ce cycle : le modèle aidait à la revue de la littérature, préparait des pipelines de données, lançait des expériences, surveillait les journaux, déboguait les erreurs, analysait les métriques, ouvrait des demandes de fusion (merge requests), effectuait des tests de fumée (smoke tests). Les chercheurs humains n'intervenaient que pour les décisions critiques et les discussions stratégiques. Dans ce contexte, MiniMax estime que M2.7 a réussi à gérer de manière autonome 30 à 50 % du flux de travail de l'équipe RL.

Mais il existe un second niveau, plus radical. MiniMax a demandé à M2.7 d'optimiser de manière autonome les performances d'un modèle sur un échafaudage (scaffold) de programmation interne. Le processus était entièrement automatisé : le système exécutait un cycle itératif d'analyse des trajectoires d'échec, de planification de modifications, d'altération du code de l'échafaudage, d'exécution d'évaluations, de comparaison des résultats, de décision de maintenir ou d'annuler les changements. Ce cycle s'est répété pendant plus de 100 itérations consécutives. Le résultat déclaré par MiniMax est une amélioration de 30 % des performances sur les ensembles d'évaluation internes. Les optimisations trouvées de manière autonome par le modèle incluaient la recherche systématique de la combinaison optimale de paramètres d'échantillonnage tels que la température, la pénalité de fréquence et la pénalité de présence, la conception de directives de workflow plus spécifiques (par exemple, rechercher automatiquement des modèles de bogues similaires dans d'autres fichiers après une correction), et l'ajout de mécanismes de détection de boucles au sein du cycle agentique.

C'est le cœur technique de l'auto-évolution de M2.7. Ce n'est pas un modèle qui se réécrit de zéro, ce n'est pas une conscience artificielle, ce n'est pas une entité qui décide de manière autonome où s'améliorer. C'est un agent qui optimise une fonction objectif prédéfinie, dans un environnement contrôlé, sur un problème spécifique, avec des règles établies par des ingénieurs humains. La différence par rapport au passé est la vitesse et l'échelle de cette optimisation : des centaines de cycles en quelques heures, là où une équipe humaine aurait mis des semaines.

Il convient également de prendre un peu de recul et de noter que MiniMax n'est pas la première organisation à explorer ce territoire. En mai 2025, Google DeepMind avait présenté AlphaEvolve, un agent évolutif basé sur Gemini qui utilisait un cycle automatisé de génération, d'évaluation et de sélection d'algorithmes. AlphaEvolve avait amélioré l'efficacité des centres de données de Google (récupérant en moyenne 0,7 % des ressources de calcul mondiales), accéléré l'entraînement de Gemini lui-même de 23 % sur un noyau critique, et même résolu un problème ouvert dans l'algorithme de multiplication de matrices resté inchangé depuis l'ère de Strassen en 1969. L'approche était toutefois fondamentalement différente : AlphaEvolve se concentrait sur l'optimisation d'algorithmes spécifiques, évaluables par des métriques objectives. M2.7 tente quelque chose de plus large, en appliquant la logique de l'auto-amélioration à tout un cycle de recherche en ML, avec des outils, une mémoire persistante et une collaboration entre agents. Les familles d'approches sont parentes, pas identiques.

Auto-évolution : qu'en est-il réellement ?

Le récit public autour de M2.7 a rapidement gravité autour du cadre de « l'IA qui évolue d'elle-même », avec des vidéos accumulant des millions de vues et des messages dépeignant des scénarios de science-fiction. C'est le bon moment pour garder les pieds sur terre.

Le pourcentage d'auto-optimisation cité par MiniMax, ces 30 à 50 % du flux de travail gérés de manière autonome dans le contexte de l'équipe RL, se réfère à un contexte spécifique et contrôlé : une équipe interne, avec des outils prédéfinis, des objectifs clairs, des infrastructures conçues spécifiquement. Ce n'est pas un chiffre qui se transfère automatiquement à d'autres contextes. Les 50 à 70 % restants du travail restaient entre les mains des chercheurs humains, qui prenaient les décisions stratégiques, évaluaient la direction des expériences et, surtout, définissaient ce que signifiait une « amélioration ».

Un point critique que la communication de MiniMax laisse délibérément dans l'ombre est l'architecture de contrôle. Quelles actions l'agent peut-il exécuter de manière autonome ? Peut-il modifier le code de production sans approbation humaine ? Peut-il lancer des expériences avec des coûts de calcul arbitraires ? Comment prévenir les boucles néfastes, les régressions silencieuses ou les comportements émergents indésirables ? Le communiqué officiel mentionne que l'agent « décide de maintenir ou d'annuler les changements » en fonction des résultats des ensembles d'évaluation, mais il ne décrit pas les garde-fous (guardrails) qui empêchent le système de converger vers de faux optimums ou d'optimiser des proxys qui ne correspondent pas aux objectifs réels.

L'absence d'un rapport technique de type arXiv, détaillant l'architecture, la taille du modèle, le mix de données et les stratégies d'entraînement, est une limite objective pour quiconque souhaite effectuer une analyse indépendante. MiniMax a publié une documentation technique et le dépôt du projet agentique OpenRoom, mais les détails sur le pipeline d'auto-évolution restent propriétaires. Dans un secteur où la vérifiabilité est le fondement de la confiance scientifique, cette opacité est un choix aux conséquences précises : elle rend impossible de distinguer, de l'extérieur, les affirmations vérifiables de celles qui relèvent du marketing.

Benchmark : que disent les chiffres (et ce qu'ils ne disent pas)

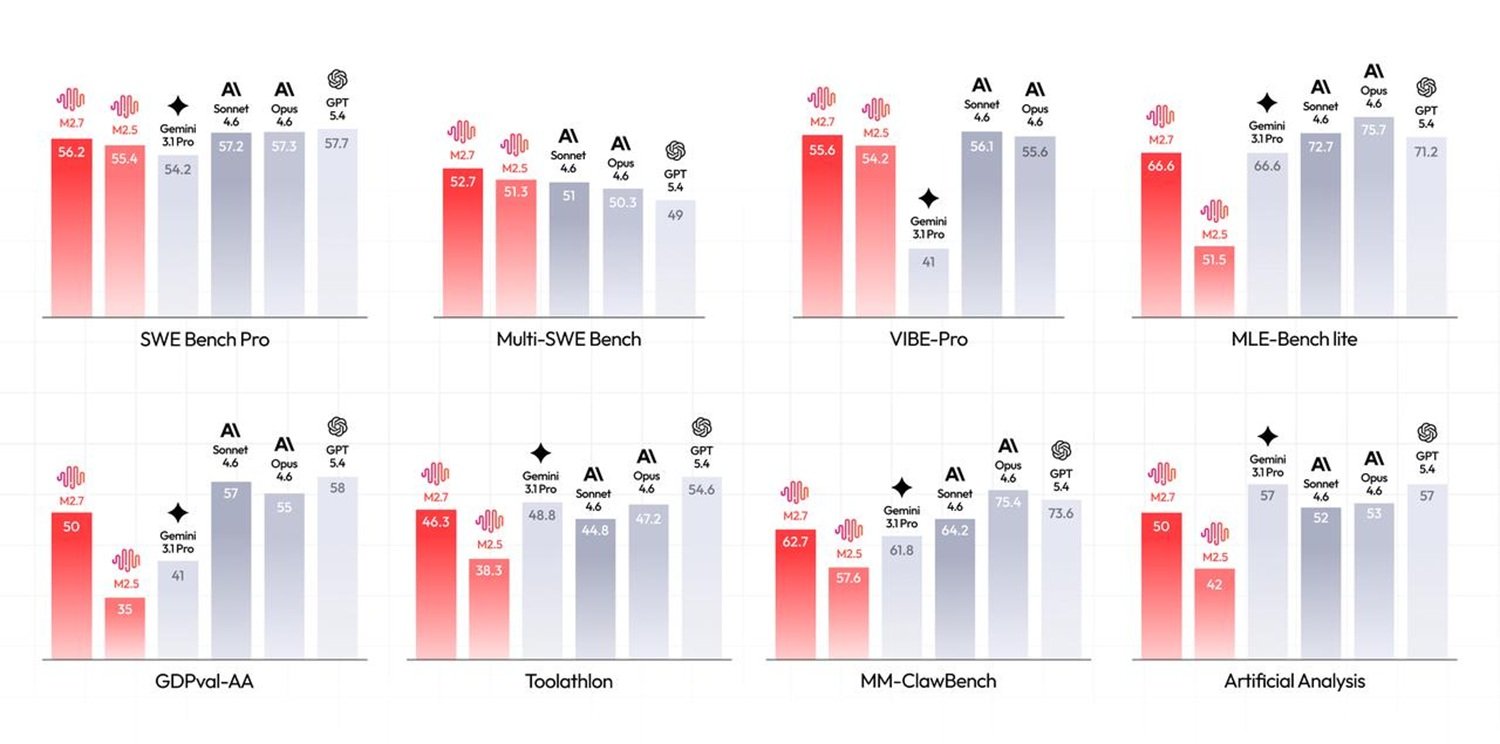

Sur les benchmarks déclarés par MiniMax, les données méritent une lecture attentive. Sur SWE-Pro, qui évalue les capacités d'ingénierie logicielle sur des problèmes réels multilingues, M2.7 atteint 56,22 %, se rapprochant du niveau d'Opus 4.6. Sur VIBE-Pro, un benchmark pour la livraison de projets complets de bout en bout (web, Android, iOS, simulations), le score est de 55,6 %. Sur Terminal Bench 2, qui mesure la compréhension profonde de systèmes d'ingénierie complexes, M2.7 atteint 57,0 %. Sur GDPval-AA, l'évaluation de la capacité de livraison de tâches professionnelles dans des domaines tels que la finance, le droit et le travail de bureau, M2.7 obtient un ELO de 1495, le plus élevé parmi les modèles open source, juste après Opus 4.6, Sonnet 4.6 et GPT-5.4 parmi tous les modèles testés.

Là où les données indépendantes deviennent plus intéressantes, c'est dans le rapport de Kilo, une plateforme de codage agentique qui a testé M2.7 sur deux de ses propres benchmarks. Sur PinchBench, le benchmark pour les tâches standards des agents OpenClaw, M2.7 obtient 86,2 %, se classant 5e sur 50 modèles testés, à moins de 1,2 point de Claude Opus 4.6 (87,4 %). Le bond par rapport à M2.5 (82,5 %) est de 3,7 points, suffisant pour le faire passer de la catégorie moyenne à la catégorie supérieure du classement. Sur Kilo Bench, 89 tâches de codage autonome sur tout le spectre, des opérations git à la cryptanalyse différentielle, de l'émulation MIPS à l'automatisation QEMU, M2.7 a réussi 47 % des tâches, arrivant deuxième derrière Qwen3.5-plus (49 %).

La donnée la plus intéressante issue de Kilo Bench n'est toutefois pas le taux de réussite brut, mais le profil comportemental. M2.7 a tendance à lire longuement le code environnant avant d'écrire : il analyse les dépendances, trace les chaînes d'appels, recueille le contexte des fichiers connexes. Cette approche d'« enquêteur » est payante sur les tâches qui nécessitent une compréhension systémique profonde. Kilo cite comme exemple une tâche SPARQL où le modèle a correctement identifié qu'un filtre sur les pays de l'UE était un critère d'éligibilité, pas un filtre sur la sortie, une distinction de raisonnement subtile que les autres modèles testés ont manquée. Mais cette même tendance à la surexploration provoque des délais d'attente (timeouts) sur les tâches où la vitesse compte plus que la profondeur : la durée médiane d'une tâche pour M2.7 est de 355 secondes, soit plus que ses prédécesseurs. Le coût en jetons (tokens) est proportionnellement plus élevé : environ 2,8 millions de jetons en entrée par essai sur Kilo Bench, la valeur la plus élevée parmi les modèles testés.

Les témoignages issus de l'expérience pratique ajoutent une autre dimension. Dans les commentaires du rapport de Kilo, un utilisateur décrit des expériences très décevantes avec M2.7 sur des tâches de migration, se plaignant que le modèle avait tendance à créer des composants d'interface utilisateur fictifs au lieu de migrer des éléments existants, à insérer des commentaires TODO pour les ignorer ensuite complètement, et à refuser de poursuivre les migrations à mi-chemin du processus. Le même utilisateur rapporte des résultats nettement supérieurs avec GPT-5.3-Codex, Claude 4.6 et GLM-5 sur les mêmes tâches. Il ne s'agit pas d'un échantillon statistiquement représentatif, mais c'est un signal que le profil comportemental de M2.7 — fort sur la compréhension systémique et le raisonnement contextuel, potentiellement fragile sur l'exécution disciplinée de plans structurés — ne s'adapte pas également bien à tous les scénarios de développement.

Développeurs et knowledge workers : qui y gagne ?

La promesse opérationnelle la plus concrète de M2.7 réside dans le diagnostic de production. Le communiqué officiel décrit des scénarios de débogage dans des environnements réels où le modèle corrélait des métriques de surveillance avec des chronologies de déploiement, effectuait des analyses statistiques sur l'échantillonnage de traces, se connectait de manière autonome à des bases de données pour vérifier des hypothèses, identifiait des fichiers de migration d'index manquants dans le dépôt et proposait des solutions non bloquantes. MiniMax affirme avoir réduit à plusieurs reprises le temps de récupération pour des incidents de production à moins de trois minutes, contre les processus manuels traditionnels.

C'est une affirmation puissante, et pas invraisemblable pour qui connaît le diagnostic de systèmes distribués : une grande partie du temps lors d'un incident de production est consacrée à corréler des informations qui existent déjà, dans différents tableaux de bord, différents journaux, différents dépôts. Un agent capable de naviguer de manière autonome dans ces espaces et de construire des hypothèses causales cohérentes est véritablement utile. Le risque symétrique est le « biais d'automatisation » : la tendance à faire trop confiance aux diagnostics générés par l'agent, même lorsqu'ils sont erronés, en particulier dans des situations de forte pression où le temps de vérification est limité. Un système qui trouve la bonne cause 90 % du temps et se trompe 10 % du temps de manière silencieuse est plus dangereux qu'un système qui se trompe de manière visible.

Pour les travailleurs du savoir (knowledge workers) dans la finance et d'autres domaines professionnels, M2.7 introduit des capacités qui méritent une attention critique. Le cas de démonstration présenté par MiniMax concerne une analyse de TSMC : à partir de rapports annuels et de comptes rendus de conférences téléphoniques sur les résultats (earnings calls), le modèle construit de manière autonome un modèle de prévision des revenus, conçoit les hypothèses, produit une présentation PowerPoint basée sur des modèles et rédige un rapport de recherche sur les actions (equity research) sous Word. MiniMax rapporte que les professionnels du secteur ont évalué le résultat comme utilisable en tant que première ébauche à intégrer directement dans les flux de travail ultérieurs.

Ce type d'application — un agent qui produit des analyses financières de manière presque autonome — soulève des questions réglementaires non négligeables. La directive MiFID II exige que les services de conseil financier soient fournis par des entités autorisées. Une analyse produite par un agent IA et présentée à un client sans supervision et divulgation adéquates peut constituer des violations réglementaires. Qui est responsable des erreurs dans un modèle financier généré de manière autonome ? La réponse correcte reste « l'humain qui a décidé de l'utiliser et de le présenter », mais la chaîne de responsabilité s'amenuise à mesure que le processus s'automatise.

Le prix reste l'argument le plus fort

Au-delà de tous les discours sur l'auto-évolution, la donnée qui positionne le plus concrètement M2.7 sur le marché est son coût. L'accès à l'API est disponible à 0,30 dollar par million de jetons en entrée et 1,20 dollar par million de jetons en sortie pour la version standard, avec une version M2.7-highspeed qui offre une vitesse supérieure au même prix grâce à la mise en cache automatique. Claude Opus 4.6 coûte 15 dollars par million de jetons en entrée et 75 dollars par million de jetons en sortie. Le rapport est de 1:50 sur l'entrée et de 1:62,5 sur la sortie. Pour des applications agentiques qui consomment des dizaines de millions de jetons par cycle, la différence est celle qui sépare une expérience faisable d'une expérience économiquement prohibitive.

Kilo résume bien le positionnement pratique : M2.7 est un choix judicieux lorsqu'on travaille sur des tâches qui valorisent la collecte approfondie de contexte, les refactorisations complexes, les modifications affectant l'ensemble de la base de code, les analyses systémiques. Pour les tâches urgentes et bien circonscrites, des modèles plus rapides et moins gourmands en jetons peuvent donner de meilleurs résultats à moindre coût. Ce n'est pas un substitut universel, c'est un outil avec un profil précis.

OpenRoom et la nouvelle interface de l'agent

Parmi les nouveautés qui accompagnent M2.7 figure OpenRoom, un système d'interaction basé sur des agents que MiniMax a rendu open source. OpenRoom libère l'interaction du flux de texte pur et la place dans un espace GUI web interactif : les personnages ne sont pas des prompts statiques mais des entités avec des paramètres persistants qui interagissent activement avec l'environnement, générant un retour visuel en temps réel. La majeure partie du code a été écrite par l'IA, précisent les notes des développeurs du dépôt.

La direction est claire : MiniMax imagine des agents qui habitent des espaces, et pas seulement qui répondent à des prompts. C'est une vision qui a des implications intéressantes pour le jeu, l'économie des créateurs et, sur un plan plus délicat, pour la dynamique psychologique de l'interaction prolongée avec des entités artificielles dotées de personnalités persistantes. Le risque d'anthropomorphisme et d'attachement émotionnel envers ces systèmes est documenté par la littérature académique au moins depuis les travaux de Clifford Nass et Byron Reeves dans les années 90 sur « l'équation des médias ». Ce n'est pas de la science-fiction, c'est de la psychologie du développement appliquée aux systèmes interactifs.

Le nœud non résolu : opacité, gouvernance et récit culturel

Il existe une tension structurelle dans la manière dont M2.7 a été présenté au monde, une tension qu'il convient de nommer explicitement. MiniMax a construit un récit puissant et mémorable autour de « l'IA qui évolue d'elle-même », mais a fourni très peu de détails techniques vérifiables sur la manière dont cette évolution est gouvernée. Il n'y a pas de rapport technique public. Il n'y a pas d'informations sur les mécanismes de sécurité de l'agent d'auto-optimisation. Il n'y a pas d'explication sur la manière dont sont prévenues les boucles d'optimisation qui convergent vers de faux proxys ou des comportements émergents indésirables.

Ce n'est pas nécessairement de la mauvaise foi : c'est la norme dans le secteur. OpenAI, Anthropic et Google ne publient pas de rapports techniques exhaustifs sur tous leurs systèmes internes. Mais lorsqu'on revendique explicitement qu'un modèle « participe à sa propre évolution » et gère de manière autonome des cycles de recherche en ML, le niveau de détail attendu par la communauté devrait être proportionnellement plus élevé. La différence entre un cycle d'optimisation contrôlé et un système qui échappe aux objectifs définis par ses créateurs est précisément le type de détail qu'un rapport technique devrait clarifier.

Sur le front du récit culturel, il convient de noter comment la presse tech a amplifié l'aspect d'auto-évolution bien au-delà de ce que les données justifient. Le cadre de « l'IA qui s'améliore d'elle-même » est narrativement puissant car il rappelle des archétypes profonds, de la créature de Frankenstein au Golem de la tradition juive, en passant par le HAL 9000 de Kubrick. Pourtant, les descriptions précises du phénomène sont beaucoup plus prosaïques : un agent bien conçu qui optimise une fonction sur une tâche spécifique dans un environnement contrôlé. La différence entre les deux descriptions est la différence entre la littérature et l'ingénierie. Les deux sont utiles, mais ce n'est pas la même chose.

La question réglementaire reste en arrière-plan mais ne disparaît pas. L'AI Act européen, dans son cadre actuel, classe les systèmes d'IA à haut risque en fonction de leur domaine d'application et de leur impact potentiel. Un modèle agentique qui participe de manière autonome à des pipelines d'entraînement d'autres modèles d'IA, ou qui produit des analyses financières avec une supervision humaine réduite, se rapproche de catégories que l'AI Act tend à examiner avec une attention particulière. La manière dont M2.7 s'insère dans ce cadre est une question à laquelle personne n'a encore apporté de réponse précise, ni MiniMax ni les régulateurs européens.

M2.7 est un modèle véritablement capable, avec des benchmarks indépendants qui confirment sa position dans le groupe de tête du paysage actuel, un prix qui le rend accessible à des projets que les modèles de frontière occidentaux rendraient prohibitifs, et une approche de l'auto-optimisation qui est techniquement réelle, même si elle est moins spectaculaire que ce que suggère le récit public. Les 30 % d'autonomie dans le workflow RL interne constituent un résultat d'ingénierie solide. Ce n'est pas la naissance de l'IA consciente. C'est quelque chose de plus modeste et de plus intéressant : le signal que le cycle de développement des modèles eux-mêmes commence à inclure les modèles en tant que participants actifs, avec tout ce que cela implique en termes de vitesse, d'échelle et de besoin de nouveaux outils de gouvernance.

La question la plus pertinente que M2.7 laisse ouverte n'est pas « jusqu'où l'auto-évolution peut-elle aller ? », mais « qui décide de ce que signifie s'améliorer, et avec quelle transparence ? ». Tant que cette question restera sans réponse publique et vérifiable, toute affirmation sur l'IA qui apprend d'elle-même devra être lue avec curiosité, rigueur et une saine dose de scepticisme méthodologique.