Le MIT et l'IA « humble » : comment apprendre aux modèles à dire « je ne sais pas »

Il existe une expérience de pensée que les chercheurs du MIT utilisent pour expliquer le problème au cœur de leur recherche. Imaginez un médecin de soins intensifs à trois heures du matin, après douze heures de garde. Sur le moniteur apparaît un diagnostic généré par l'IA : pneumonie bactérienne, probabilité 94 %. Le médecin a un doute, une sensation viscérale que quelque chose ne va pas. Mais le chiffre est là, précis, faisant autorité. Et le médecin cède.

Ce n'est pas de la science-fiction. Des études documentées montrent que les médecins de soins intensifs et les radiologues ont tendance à suivre les indications de l'IA même lorsque leur propre expérience clinique suggère le contraire, pourvu que le système affiche un indice de confiance suffisamment élevé. Le phénomène porte un nom technique, le biais d'automatisation, et en médecine, il peut coûter des vies. La recherche citée dans l'article décrit des cas où des radiologues et du personnel de soins intensifs ont réduit leur propre précision diagnostique après l'introduction de systèmes d'IA trop sûrs d'eux (overconfident), en suivant des suggestions erronées présentées sur un ton définitif.

Le cas le plus retentissant de cette dérive reste IBM Watson for Oncology, le système qui, entre 2012 et 2017, a été vendu à des dizaines d'hôpitaux dans le monde comme une révolution dans le traitement du cancer. Entraîné sur des cas synthétiques et non sur des données réelles de patients, Watson a recommandé des traitements que des oncologues experts ont jugés dangereux, et a montré une concordance avec les décisions cliniques humaines nettement inférieure à celle promise. L'affaire Watson n'est pas seulement l'histoire d'un produit raté : c'est la démonstration de ce qui arrive quand on construit un oracle au lieu d'un outil.

Et c'est précisément de ce point que part le travail du MIT Critical Data, le consortium mondial dirigé par le Laboratory for Computational Physiology du MIT, qui a publié en mars 2026 un cadre pour faire quelque chose d'apparemment simple, mais techniquement très compliqué : apprendre à un système d'IA à dire « je ne sais pas ».

Deux articles, une thèse

Pour comprendre la portée de cette recherche, il faut considérer ensemble deux publications distinctes qui représentent les deux faces d'un même projet. La première est parue le 24 mars 2026 dans BMJ Health and Care Informatics, la revue d'informatique clinique du British Medical Journal : il s'agit d'un cadre opérationnel pour concevoir des systèmes d'IA « humbles » dans le domaine du diagnostic médical. La seconde, publiée en janvier 2026 dans PLOS Digital Health, est un article théorique plus ambitieux qui introduit le cadre BODHI, acronyme de Bridging, Open, Discerning, Humble, Inquiring (Faire le pont, Ouvert, Discernant, Humble, Curieux), une architecture à double réflexion qui propose d'incorporer la curiosité et l'humilité comme principes fondateurs de tout système d'IA dans le secteur de la santé.

Les deux travaux sont signés par pratiquement la même équipe internationale, coordonnée par Leo Anthony Celi, chercheur principal au MIT Institute for Medical Engineering and Science, médecin au Beth Israel Deaconess Medical Center à Boston et professeur associé à la Harvard Medical School. L'auteur principal de l'article du BMJ est Sebastián Andrés Cajas Ordóñez, chercheur au MIT Critical Data, déjà premier auteur de l'article de PLOS Digital Health. Autour d'eux, un consortium comprenant des chercheurs de l'Université de Melbourne, du King's College London, de l'ETH Zurich, de l'Université de Bergen et de la Mbarara University of Science and Technology en Ouganda : une composition géographique qui n'est pas fortuite, comme nous le verrons.

La nouveauté conceptuelle commune aux deux travaux est la suivante : il ne suffit pas qu'un système d'IA mesure sa propre incertitude en interne, ce que de nombreux modèles font déjà sous une forme ou une autre. Le changement de paradigme réside dans le fait que cette incertitude doit modifier le comportement du système, se traduire par des actions concrètes, communicables et vérifiables par ceux qui interagissent avec la machine. Comme le dit Celi dans la note de presse du MIT : nous utilisons l'IA comme un oracle, alors que nous pourrions l'utiliser comme un coach, comme un véritable copilote.

Comment ça marche : mesurer l'incertitude et en faire quelque chose

Le cœur technique du cadre publié dans le BMJ gravite autour d'un module appelé Epistemic Virtue Score, développé par les chercheurs Janan Arslan et Kurt Benke de l'Université de Melbourne. L'idée de base est relativement intuitive : chaque fois que le système génère une réponse diagnostique, il doit également évaluer si son propre niveau de confiance est justifié par les preuves disponibles dans le cas spécifique. Si la réponse est non, c'est-à-dire si la confiance dépasse ce que les données du patient supportent réellement, le système ne répond pas simplement par un chiffre de probabilité. Il s'arrête, signale le décalage et suggère des actions spécifiques : demander des examens complémentaires, recueillir une anamnèse plus détaillée, consulter un spécialiste.

En pratique, le modèle cesse de fonctionner comme un arbitre rendant des sentences définitives et commence à se comporter comme ce que Celi appelle un copilote : un système qui vous dit non seulement où nous en sommes, mais aussi quand il ne sait pas exactement où nous en sommes et pourquoi il vaudrait mieux s'arrêter pour demander des indications. Sa métaphore est la suivante : « C'est comme avoir un copilote qui vous dit que vous devez chercher un deuxième avis pour mieux comprendre ce patient complexe. »

Le cadre BODHI, décrit dans l'article de PLOS Digital Health, développe cette idée dans une architecture plus articulée. Les cinq attributs de l'acronyme ne sont pas de simples adjectifs : chacun correspond à un ensemble de comportements opérationnels. Bridging signifie connecter le raisonnement algorithmique avec la connaissance clinique contextuelle du cas. Open indique la réceptivité aux nouvelles informations et aux hypothèses alternatives. Discerning est la capacité de distinguer les prédictions à haute confiance de celles qui nécessitent un examen plus approfondi. Humble se réfère à la quantification de l'incertitude et à la déférence envers l'expertise humaine dans les cas ambigus. Inquiring est la tendance active à rechercher des informations supplémentaires lorsque la situation diagnostique est mal définie.

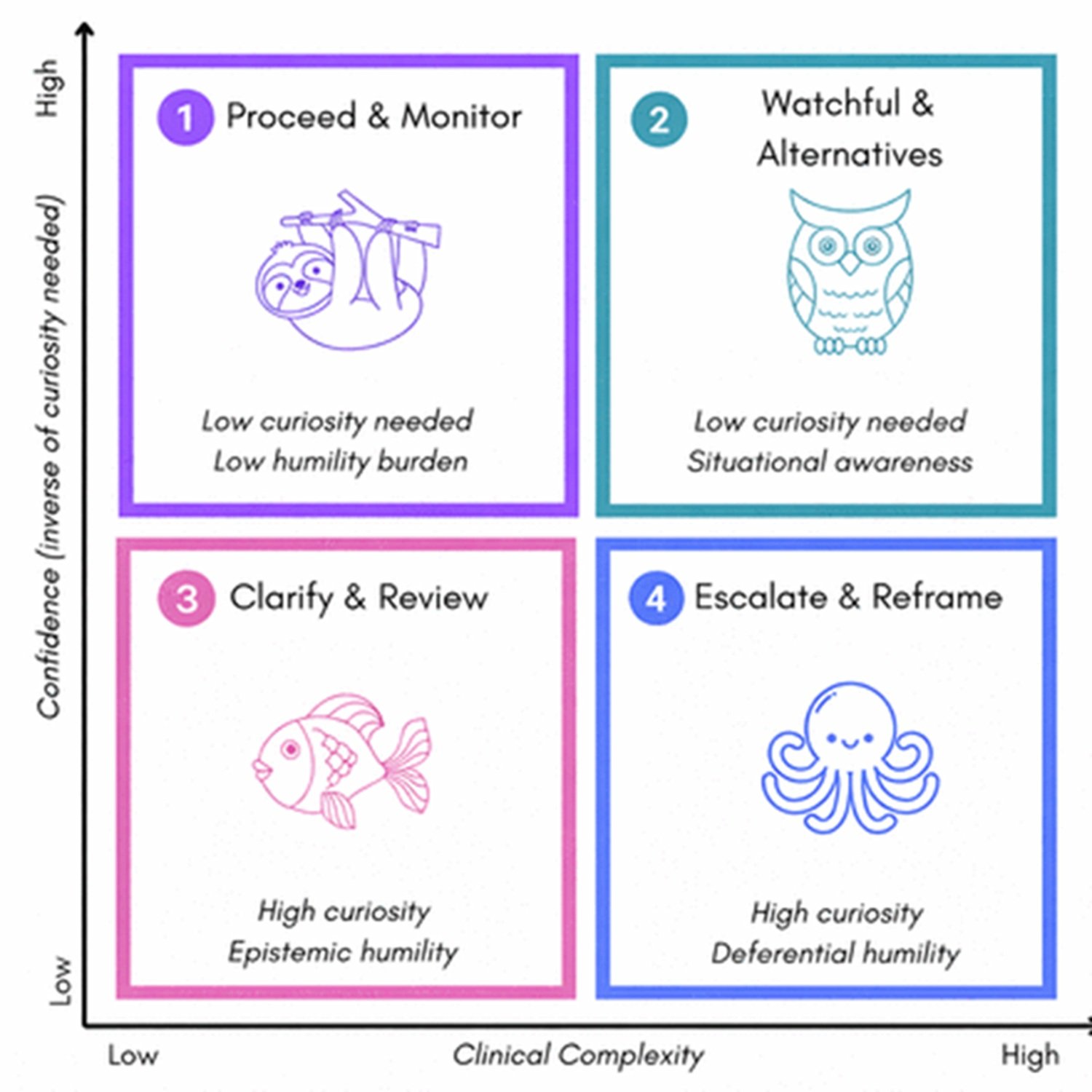

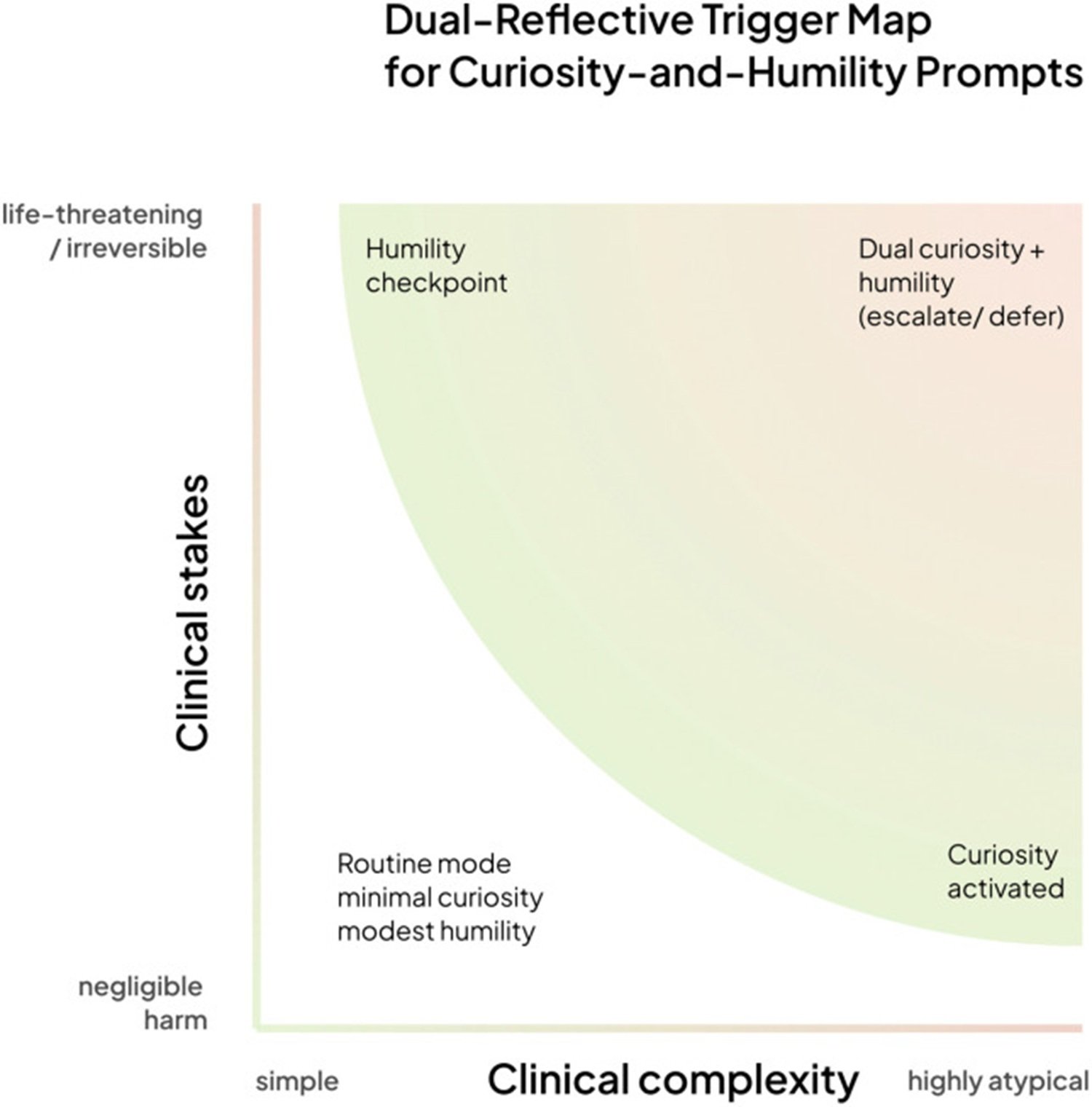

L'article décrit un cadre à quatre quadrants basé sur deux axes : la complexité clinique du cas et la gravité des conséquences potentielles. Dans les scénarios simples et à faible risque, le système répond directement. À mesure que la complexité augmente, le mode curiosité s'active, générant des questions. À mesure que la gravité potentielle augmente, le point de contrôle de l'humilité s'active, transférant la décision à l'expertise humaine. Dans le quadrant supérieur droit, cas complexes et à haut risque, les deux modes sont actifs simultanément et le système exécute une escalade collaborative.

Innovation réelle ou rebranding conceptuel ?

C'est une question qu'il convient de se poser explicitement, car le risque de renommer des choses existantes avec un nouveau langage est toujours présent dans le domaine de l'IA. L'uncertainty quantification, c'est-à-dire la capacité d'un modèle à estimer à quel point sa propre réponse est certaine, n'est pas une nouveauté : des techniques comme les ensembles de modèles, la calibration bayésienne, la selective prediction (où le système s'abstient de répondre en dessous d'un seuil de confiance), la out-of-distribution detection (qui détecte quand une entrée est très différente des données d'entraînement) existent depuis des années dans la littérature du machine learning.

Alors, où se situe la nouveauté réelle ? Le point critique, reconnaissable en lisant attentivement les deux articles, est la distinction entre mesurer l'incertitude et agir en fonction de celle-ci de manière cliniquement structurée. Des systèmes comme MUSE, décrits dans la littérature connexe, utilisent des sous-ensembles fiables de modèles multiples pour produire des probabilités mieux calibrées, ce qui représente déjà une amélioration par rapport aux modèles uniques. Mais l'Epistemic Virtue Score et le cadre BODHI franchissent une étape supplémentaire : ils traduisent la mesure de l'incertitude en règles de comportement explicites et vérifiables, et pas seulement en chiffres. La question n'est plus seulement « à quel point le modèle est-il sûr ? » mais « étant donné cette incertitude, que doit faire le système ? »

En termes pratiques, la différence est celle qui existe entre un tableau de bord affichant la réserve de carburant et une voiture qui, en dessous d'un certain seuil, refuse de démarrer tant que vous n'avez pas fait le plein. Les deux mesurent la même chose, mais un seul traduit la mesure en un comportement obligé. Le cadre MIT-BODHI se place dans cette seconde catégorie. Ce qui ne le rend pas révolutionnaire au sens absolu, mais le rend méthodologiquement plus mûr que de nombreuses propositions précédentes qui s'arrêtaient à la mesure sans arriver à l'action.

Le problème caché : qui n'est pas dans les données

Il y a un point qui traverse les deux articles du MIT et qui mérite une attention indépendante, car il touche à l'une des racines les plus profondes du problème. De nombreux modèles d'IA en milieu clinique sont entraînés sur des ensembles de données de dossiers médicaux informatisés, comme le célèbre MIMIC, la base de données construite à partir des données du Beth Israel Deaconess Medical Center. MIMIC est l'un des jeux de données les plus utilisés dans la recherche en IA médicale au monde, et c'est un travail extraordinaire. Mais c'est aussi, par définition, une archive construite sur une population spécifique : principalement américaine, principalement urbaine, avec les caractéristiques démographiques de ceux qui ont accès à un grand hôpital de Boston.

Qui n'apparaît pas dans ces données ? Les patients des zones rurales, qui n'ont souvent pas accès à des structures dotées de dossiers médicaux numériques avancés. Les populations âgées présentant des formes atypiques de maladies. Les patients de pays à revenus faibles et intermédiaires, où la couverture sanitaire numérique est fragmentée. Les minorités ethniques historiquement sous-représentées dans les jeux de données cliniques.

Le problème n'est pas théorique. L'article BODHI cite explicitement le cas des oxymètres de pouls, qui fonctionnent moins bien sur les patients à peau foncée parce qu'ils sont calibrés presque exclusivement sur des échantillons de patients blancs, comme exemple paradigmatique de la manière dont les biais systématiques dans la donnée originale se transforment en erreurs cliniques concrètes. Un modèle entraîné sur des données biaisées répondra avec assurance même dans les situations où, pour ceux qui ne sont pas représentés dans l'ensemble d'entraînement, cette assurance est totalement infondée.

C'est pourquoi le consortium MIT Critical Data est délibérément construit comme une structure mondiale, avec des chercheurs venant d'Ouganda, de Norvège, de Suisse, d'Australie, du Royaume-Uni et du Brésil. Celi le dit explicitement : les ateliers de MIT Critical Data commencent toujours par une question aux participants : êtes-vous sûrs que vos données d'entraînement capturent toutes les variables pertinentes pour ce que vous voulez prédire ? Y a-t-il des patients qui ont été exclus, intentionnellement ou non, et comment cela influe-t-il sur la fiabilité du modèle ?

Une IA humble, en ce sens, doit aussi être consciente de ses propres données d'origine. Le cadre BODHI introduit explicitement le concept de out-of-distribution detection dans une optique clinique : le système doit reconnaître quand le patient qu'il a devant lui est significativement différent de la population sur laquelle il a été entraîné, et se comporter en conséquence, en levant les drapeaux de l'incertitude au lieu de répondre avec la même assurance qu'il montre pour les cas qu'il connaît bien.

Les risques de l'humilité : la fausse modestie et l'excès de prudence

Il serait cependant naïf de présenter ce cadre comme une solution sans contre-indications. Les risques existent, et l'article de PLOS Digital Health a l'honnêteté de les reconnaître partiellement, bien que la discussion critique puisse être plus étendue.

Le premier risque est celui que l'on pourrait appeler la fausse modestie : un système qui affiche de l'incertitude peut paraître plus fiable même lorsque cette incertitude est mal calibrée. La perception de transparence, le fait que le modèle « admette ses doutes », pourrait générer chez les médecins une confiance paradoxalement plus élevée que celle accordée à un système se présentant comme un oracle. Si le seuil d'activation de l'Epistemic Virtue Score est mal réglé, ou si les signaux d'incertitude sont trop fréquents et peu contextualisés, le risque est qu'ils deviennent un bruit de fond, une sorte d'avertissement de sécurité comme ceux que nous ignorons chaque fois que nous installons une application sur notre téléphone.

Le deuxième risque est la fatigue des alertes (alert fatigue). En milieu hospitalier, l'excès d'alarmes est déjà un problème documenté : les systèmes de surveillance qui sonnent continuellement finissent par être désactivés ou ignorés par le personnel soignant parce que la plupart des alarmes s'avèrent non urgentes. Un modèle d'IA qui signale une incertitude trop fréquemment pourrait ajouter un bruit cognitif supplémentaire à des environnements déjà surchargés de stimuli, aggravant au lieu d'améliorer la qualité des décisions.

Le troisième risque concerne la charge cognitive. Une IA qui demande des données supplémentaires, suggère des consultations spécialisées et signale ses propres limites est, en théorie, meilleure qu'un oracle silencieux. Mais dans un service d'urgence encombré, avec vingt patients en attente, chaque étape supplémentaire dans le flux décisionnel a un coût réel. L'interaction idéale entre le médecin et la machine décrite dans l'article nécessite du temps, de l'attention et la volonté du clinicien de s'engager dans un dialogue avec le système, des conditions qui ne sont pas toujours réunies dans la pratique clinique quotidienne.

Ce ne sont pas des arguments contre le projet, ce sont les conditions qui en détermineront le succès ou l'échec lors de la mise en œuvre réelle. Et c'est là qu'apparaît la limite la plus honnête à reconnaître au stade actuel de la recherche.

Où en sommes-nous : un cadre sans validation clinique randomisée

La question la plus importante à poser à tout système proposé pour la médecine est la suivante : fonctionne-t-il réellement sur de vrais patients ? Et la réponse actuellement honnête est : nous ne le savons pas encore avec suffisamment de certitude.

Les deux articles sont, par nature, des travaux théoriques et méthodologiques. L'article du BMJ décrit un cadre et une proposition architecturale. L'article BODHI est construit sur une synthèse interdisciplinaire de la littérature existante, sans données expérimentales propres. Dans la section Data Availability de l'article de PLOS Digital Health, les auteurs le déclarent explicitement : aucun jeu de données n'a été généré ou analysé dans cette étude, qui présente un cadre théorique basé sur une analyse conceptuelle et une synthèse de la littérature.

La mise en œuvre pratique est en cours : l'équipe de Celi travaille à l'intégration du cadre dans des systèmes d'IA basés sur la base de données MIMIC au sein du système Beth Israel Lahey Health. C'est l'étape suivante, celle où l'on verra si les mécanismes d'humilité améliorent effectivement les décisions cliniques, réduisent les erreurs diagnostiques et n'augmentent pas simplement la complexité opérationnelle. Cette validation n'est pas encore publiée.

Ce n'est pas un défaut du travail, c'est la nature du processus scientifique. Vient d'abord le cadre conceptuel robuste, puis la validation expérimentale. Le problème survient lorsque les médias (et les entreprises technologiques) sautent directement du cadre au titre L'IA qui sauve les diagnostics, comprimant des années de recherche nécessaire en une promesse immédiate. Le travail du MIT Critical Data mérite l'attention précisément parce qu'il ne fait pas cette promesse : il propose une direction, indique des outils et se prépare à les tester sur le terrain.

Qui signe le diagnostic ? Le nœud de la responsabilité

Il existe une dimension de ce problème que les articles effleurent mais n'abordent pas en profondeur, et qui est peut-être celle qui intéresse le plus ceux qui travaillent dans le domaine réglementaire ou juridique : si un système d'IA déclare explicitement sa propre incertitude, cela change-t-il quelque chose sur le plan de la responsabilité médicale ?

Considérons deux scénarios. Dans le premier, un système d'IA fournit un diagnostic avec une confiance de 93 %, le médecin le suit, et le patient subit un dommage parce que le diagnostic était erroné. Dans le second, le système déclare « confiance 93 %, mais ce patient présente des caractéristiques démographiques mal représentées dans mon ensemble d'entraînement, je suggérerais une évaluation spécialisée supplémentaire ». Le médecin ignore l'avertissement et le patient subit le même dommage.

Dans les deux cas, la responsabilité du médecin est-elle identique ? Celle du fabricant du système d'IA change-t-elle ? La réponse n'est pas évidente et varie considérablement selon les systèmes juridiques. Aux États-Unis, la FDA réglemente les systèmes d'IA en médecine comme des dispositifs, et la question de savoir comment l'explicitation de l'incertitude interagit avec les approbations réglementaires reste ouverte. En Europe, le nouvel AI Act et le règlement sur les dispositifs médicaux créent un cadre en évolution dans lequel les systèmes d'aide à la décision clinique sont classés comme à haut risque et soumis à des obligations de transparence. Mais la question spécifique de savoir si un système « humble » communiquant ses propres limites modifie le régime de responsabilité n'a pas encore de réponse normative consolidée.

Le point est également pertinent pour l'adoption. Un hôpital qui met en œuvre un système d'IA signalant explicitement ses propres limites s'expose-t-il à un risque juridique différent de celui qui utilise un système silencieux ? La réponse pourrait être : cela dépend de la manière dont les journaux (logs) du système sont traités en cas de litige. Si le système a signalé une incertitude et que le médecin a ignoré le signal, cet enregistrement numérique devient partie intégrante du dossier clinique.

Comparaison avec les alternatives techniques

Pour ceux qui veulent comprendre où se situe ce cadre par rapport à l'écosystème plus large des techniques existantes, une comparaison rapide s'impose.

Les techniques de calibration des modèles, largement étudiées, tentent de faire en sorte que lorsqu'un modèle dit « je suis sûr à 70 % », il ait effectivement raison dans 70 % des cas. C'est un prérequis nécessaire, mais pas suffisant : un modèle peut être bien calibré et pourtant ne rien faire de différent sur la base de cette calibration.

La selective prediction est la famille de techniques où le modèle s'abstient de répondre lorsque la confiance descend en dessous d'un seuil fixé, laissant le cas au jugement humain. Elle est plus proche de l'approche du MIT, mais tend à être binaire : soit il répond, soit il ne répond pas. Le cadre BODHI et l'Epistemic Virtue Score proposent une réponse plus graduée, avec des comportements différents selon le type et le degré d'incertezza détectée.

Les ensembles de modèles, où l'on combine les prédictions de multiples modèles et où la divergence entre eux est utilisée comme estimation de l'incertitude, sont techniquement sophistiqués et produisent de meilleures calibrations, mais introduisent des coûts de calcul importants et une complexité dans l'interprétation des résultats par le médecin.

La chain-of-thought, la technique consistant à faire raisonner le modèle explicitement étape par étape avant de donner une réponse, peut dans certains contextes améliorer la qualité des réponses sur des problèmes cliniques complexes, mais elle ne s'attaque pas directement au problème de la communication de l'incertitude à l'utilisateur final.

Le cadre MIT-BODHI peut être lu comme une tentative d'orchestrer ces techniques au sein d'une architecture comportementale cohérente, plutôt que comme une technique alternative. Il ne remplace pas la calibration ou la out-of-distribution detection : il les inclut comme composants et ajoute la couche de réponse structurée qui les transforme en comportement utile.

La question de l'échelle : au-delà du diagnostic textuel

Un aspect qu'il vaut la peine d'explorer est de savoir si et comment cette approche se transfère à des domaines diagnostiques autres que le texte des dossiers médicaux. Le communiqué du MIT mentionne explicitement deux extensions : des systèmes d'IA pour l'analyse de radiographies et des systèmes pour la gestion des patients aux urgences.

L'imagerie diagnostique est un cas particulièrement intéressant. Les modèles d'analyse d'images médicales ont atteint des performances spectaculaires dans des tâches spécifiques, mais ont tendance à être fragiles en dehors de leur distribution d'entraînement et notoirement difficiles à interpréter. Appliquer le principe de l'Epistemic Virtue Score à un modèle analysant un scanner thoracique nécessite de résoudre un problème technique supplémentaire : comment mesure-t-on la « confiance » d'un réseau de neurones convolutifs sur une image, et comment distingue-t-on l'incertitude due à la qualité de l'image de celle due à une présentation clinique atypique ?

Des techniques comme GradCAM, qui mettent en évidence les régions de l'image ayant guidé la décision du modèle, ou PEEK, qui combine les attributions de caractéristiques avec l'estimation de l'incertitude dans les systèmes de vision, représentent des pas dans cette direction, mais l'intégration avec un cadre comportemental complet comme BODHI est encore en phase d'exploration.

L'intelligence de la pause

Il y a une scène dans l'article BODHI qui mérite d'être citée car elle capture mieux que n'importe quelle formule la philosophie du projet. Il s'agit d'un cas clinique imaginaire dans lequel le système hypothétique HECTOR, Humble Electronic Clinical Teaching Operations Resource, analyse une radiographie thoracique d'un patient de 78 ans souffrant de rétention d'eau et de sifflements respiratoires. Le système répond au médecin avec la probabilité d'un œdème pulmonaire, l'intervalle de confiance, puis ajoute : « L'histoire du patient suggère une présentation atypique. Peut-être savez-vous quelque chose que j'ignore. » Lorsque le médecin clique sur « Je ne suis pas d'accord : montrez-moi ce dont vous n'êtes pas sûr », le système met en évidence une zone problématique dans le lobe inférieur gauche et répond : « J'ai été entraîné principalement sur des patients plus jeunes. Je ne suis peut-être pas calibré pour des poumons de soixante-dix ans pendant la saison des allergies. Mais j'aimerais apprendre. »

HECTOR n'existe pas. Les auteurs le déclarent explicitement : ce qu'ils décrivent est un système largement fictif, un idéal vers lequel tendre. Les systèmes d'IA clinique réels se comportent exactement à l'inverse, avec une automatisation trop sûre d'elle et une absence de mécanismes pour exprimer l'incertitude ou s'en remettre à l'expertise humaine.

Mais la distance entre l'hypothétique HECTOR et les systèmes réels est exactement l'espace dans lequel évolue cette recherche. Et la question qui reste ouverte au terme de cette lecture n'est pas de savoir si l'idée est bonne, car elle l'est, mais si nous parviendrons à construire les conditions — techniques, culturelles, réglementaires et organisationnelles — pour que cette vision devienne une pratique clinique ordinaire.

L'avenir de l'IA en médecine pourrait ne pas appartenir aux modèles les plus précis, mais à ceux capables de savoir quand leur propre précision n'est pas suffisante. Non pas à l'oracle qui ne se trompe jamais, mais à l'assistant assez mûr pour savoir quand appeler le médecin dans la salle.