Pentagone : Anthropic refuse, OpenAI accepte, qui télécharge et qui désinstalle, et après ?

Il y a des semaines qui semblent des décennies, et la dernière de février 2026 a été l'une d'entre elles. En l'espace de quatre-vingt-seize heures, Anthropic a refusé les conditions du Département de la Défense américain, rebaptisé « Department of War » par l'administration Trump, a été déclarée risque pour la chaîne d'approvisionnement nationale, a été visée par un décret présidentiel, a vu son chatbot grimper au sommet de l'App Store américain et a annoncé qu'elle ferait appel devant les tribunaux. OpenAI, entre-temps, a signé un accord avec ce même Pentagone dans des délais si courts que son propre directeur général l'a publiquement qualifié de « précipité ». Les utilisateurs ont répondu à leur manière : en désinstallant. La réponse à la question de savoir ce qui va réellement se passer est, honnêtement, une seule : nous verrons.

La frontière que personne ne voulait tracer

Pour comprendre ce qui s'est passé, il faut partir de ce que le Pentagone voulait et de ce qu'Anthropic a refusé d'accorder. Le cœur du litige concerne deux lignes rouges précises : l'utilisation de l'intelligence artificielle pour la surveillance de masse des citoyens américains, et l'emploi de systèmes d'armes complètement autonomes, capables de sélectionner et d'éliminer des cibles sans intervention humaine. Dario Amodei a tenu bon même lorsque le secrétaire à la Défense Pete Hegseth a fixé un ultimatum, le vendredi à 17h01, menaçant de déclarer l'entreprise comme un « risque pour la supply chain ».

La position du Pentagone, dans sa formulation officielle, n'était pas de demander explicitement des drones tueurs. Le porte-parole Sean Parnell a déclaré sur X que le département n'avait aucun intérêt pour la surveillance domestique de masse ni pour les armes autonomes, mais que la demande était plus simple : permettre au Pentagone d'utiliser les modèles d'Anthropic pour « tous les usages licites ». Le point de friction se situe précisément là. Qui décide de ce qui est licite ? La réponse de Hegseth était nette : certainement pas le fournisseur.

Le contexte réglementaire n'aide pas à rassurer. Selon une directive du Département de la Défense de 2023, les systèmes d'intelligence artificielle peuvent sélectionner et engager des cibles sans intervention humaine, à condition de répondre à certaines normes et d'être approuvés par des responsables de haut niveau. Il n'existe pas d'interdiction catégorique des armes autonomes dans l'appareil militaire américain. Anthropic, connaissant ce cadre, ne voulait pas que ses modèles entrent dans un système où l'« usage licite » pourrait inclure, à l'avenir, des décisions létales automatisées. L'inquiétude n'est pas infondée : un système d'IA positionné dans des contextes à très haut risque peut commettre des erreurs irréversibles à la vitesse d'un processeur. La différence entre un modèle qui conseille et un modèle qui agit est, dans certains scénarios, la différence entre une erreur corrigible et une catastrophe.

Hegseth a répondu à la hache. Trump a émis un décret ordonnant à toutes les agences fédérales de cesser l'utilisation des technologies Anthropic d'ici six mois. Anthropic a annoncé qu'elle contesterait la décision devant les tribunaux.

Les chiffres qui font du bruit

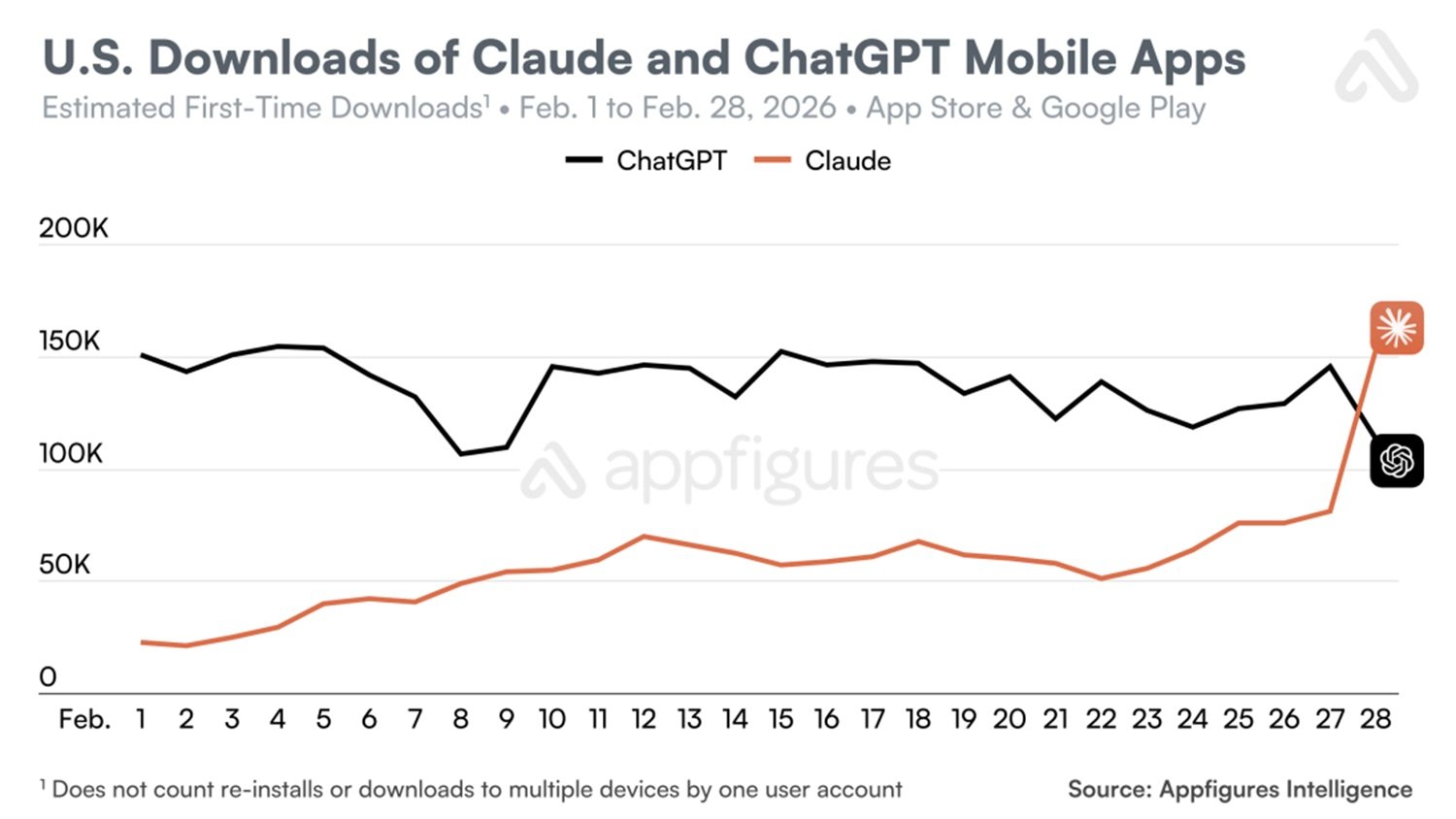

Pendant que les communiqués officiels circulaient, la réponse la plus immédiate est venue des magasins d'applications, et les données sont suffisamment vérifiées pour mériter une attention particulière.

Selon Sensor Tower, les désinstallations américaines de ChatGPT ont augmenté de 295 % quotidiennement le 28 février. Pour situer le contexte : le taux typique de désinstallation quotidienne de ChatGPT, mesuré au cours des trente semaines précédentes, était de 9 %. Ce n'est pas une oscillation, c'est un bond. Les téléchargements de ChatGPT ont chuté de 13 % le samedi et de 5 % supplémentaires le dimanche. Sur le front opposé, Claude a vu ses téléchargements américains croître de 37 % le vendredi 27, jour du refus d'Amodei, et de 51 % supplémentaires le samedi 28. En conséquence, Claude a atteint la première place du classement de l'App Store américain, un bond de plus de vingt places par rapport au 22 février.

Appfigures, second fournisseur de données indépendant, certifie que les téléchargements quotidiens de Claude aux États-Unis ont dépassé ceux de ChatGPT pour la toute première fois lors de la journée de samedi, avec des estimations de croissance encore plus élevées : +88 % sur une base journalière. Appfigures signale également que Claude était premier parmi les applications gratuites pour iPhone dans six pays : la Belgique, le Canada, l'Allemagne, le Luxembourg, la Norvège, la Suisse et les États-Unis. Sensor Tower ajoute une donnée de sentiment particulièrement éloquente : les avis une étoile sur ChatGPT ont augmenté de 775 % le samedi 28, avec un nouveau doublement le dimanche. Les avis cinq étoiles ont chuté de 50 % sur la même période.

Il faut dire avec honnêteté méthodologique que Similarweb a observé que les téléchargements de Claude au cours de la dernière semaine étaient environ vingt fois supérieurs aux niveaux de janvier, mais a également précisé que l'augmentation pourrait avoir des causes autres que la question politique. Attribuer tout au choix éthique d'Anthropic serait une simplification. La coïncidence temporelle est toutefois difficile à ignorer.

OpenAI, l'accord hâtif et les garde-fous en question

Sam Altman l'a admis sur X sans trop de détours : l'accord avec le Département de la Guerre avait été « résolument précipité » et « les perspectives ne semblent pas bonnes ». C'est une concession rare, celle d'un PDG qui critique publiquement sa propre décision stratégique alors qu'il est encore en train de la défendre.

La chronologie est la suivante : vendredi soir, les négociations entre Anthropic et le Pentagone s'effondrent définitivement ; samedi, OpenAI annonce son propre accord pour le déploiement de ses modèles dans des environnements classifiés. La rapidité a suscité des questions immédiates : OpenAI avait-elle vraiment les mêmes lignes rouges qu'Anthropic ? Si oui, comment avait-elle réussi à signer là où Anthropic avait échoué ?

OpenAI a répondu par un billet sur son blog, énumérant trois domaines exclus de l'accord : la surveillance domestique de masse, les systèmes d'armes autonomes et les décisions automatisées à haut risque. L'entreprise a soutenu que, contrairement à d'autres opérateurs qui auraient « réduit ou supprimé leurs garde-fous de sécurité » dans les implémentations militaires, son approche est multicouche : contrôle complet sur la pile de sécurité, déploiement exclusif via le cloud, personnel OpenAI avec habilitation de sécurité impliqué dans le processus, protections contractuelles « robustes ». Katrina Mulligan, responsable des partenariats pour la sécurité nationale, a argué sur LinkedIn que limiter le déploiement à l'API cloud empêche physiquement l'intégration des modèles dans les systèmes d'armes : un modèle accessible uniquement via le cloud a une distance architecturale par rapport aux systèmes de contrôle qu'un modèle installé localement n'a pas. C'est un argument technique qui n'est pas dénué de logique.

Toutefois, Mike Masnick de Techdirt a soulevé une objection concrète : le texte de l'accord, en se conformant à l'Executive Order 12333, pourrait ouvrir la porte à la surveillance des citoyens américains. Cet ordre exécutif, remontant à l'ère Reagan, permet la capture des communications des personnes américaines lorsqu'elles transitent par des canaux internationaux. Si l'accord d'OpenAI fait référence à cet ordre comme norme de conformité, le mot « protection » prend des contours plus flous que ce que le communiqué de presse suggère. La réponse d'OpenAI est que l'architecture de déploiement, exclusivement cloud, sans intégration directe dans le matériel opérationnel, vaut plus que le langage contractuel. Le débat n'est pas clos techniquement.

Altman a expliqué sa logique d'une manière qu'il vaut la peine de rapporter : OpenAI espérait que l'accord ferait baisser la tension entre le Département de la Guerre et l'industrie de l'IA dans son ensemble. Si cela fonctionnait, l'entreprise apparaîtrait comme celle qui avait pris sur elle le coût d'une décision difficile dans l'intérêt du secteur. Dans le cas contraire, elle continuerait de paraître précipitée. Altman a reconnu les deux possibilités.

Le piège du prophète désarmé

Il y a une voix dans cette affaire qui mérite d'être écoutée attentivement précisément parce qu'elle n'est tendre avec personne. Max Tegmark, physicien au MIT et fondateur du Future of Life Institute, a accordé à TechCrunch une interview l'après-midi même du vendredi où Trump signait le décret, et son analyse est un acte d'accusation structurel.

L'argument est le suivant : les entreprises d'intelligence artificielle, y compris Anthropic, ont résisté pendant des années à une réglementation contraignante, la remplaçant par des engagements volontaires d'autogouvernance. Le résultat est qu'aujourd'hui, il n'existe pas de cadre réglementaire qui les protège lorsque le gouvernement décide d'exiger des usages qu'elles considèrent elles-mêmes comme dangereux. Il n'existe actuellement aux États-Unis aucune loi interdisant de construire des systèmes d'IA pour tuer des Américains : le gouvernement peut simplement le demander, et les entreprises n'ont pas d'outils juridiques pour s'y opposer autres que contractuels, que le Pentagone considère comme non contraignants par principe.

À cela s'ajoute une circonstance que Tegmark souligne sans ménagement : la même semaine que le conflit avec le Pentagone, Anthropic a modifié son engagement de sécurité le plus important, la promesse de ne pas sortir de systèmes d'IA de plus en plus puissants tant que l'entreprise n'était pas raisonnablement certaine qu'ils ne causeraient pas de dommages. Le retirer précisément à ce moment-là est, pour le moins, une coïncidence embarrassante. Tegmark étend la critique à l'ensemble du secteur : Google a abandonné son engagement historique contre l'utilisation de l'IA pour la surveillance et les armes ; OpenAI a supprimé le mot « sécurité » de sa mission ; xAI a fermé son équipe de sécurité. Les engagements volontaires, observe-t-il, ont tendance à durer jusqu'à ce qu'ils deviennent coûteux.

Nous verrons : les questions ouvertes

Nous sommes dans la position de ceux qui observent un match encore en cours en sachant que nous n'avons les données que des toutes premières minutes. L'honnêteté intellectuelle impose de ne pas faire de pronostics comme s'il s'agissait de certitudes.

L'effet éthique durera-t-il ? Les pics de téléchargements et les désinstallations enregistrés par Sensor Tower et Appfigures sont réels, mais les comportements des utilisateurs sur les applications ont une volatilité que toute personne travaillant dans le secteur connaît bien. Ceux qui utilisent ChatGPT intégré dans leurs flux de travail d'entreprise ne changent pas en une semaine. La question n'est pas de savoir si le 28 février a marqué un moment (il l'a fait), mais si ce moment restera dans les mémoires dans six mois ou sera oublié dans six semaines.

Les menaces de Trump auront-elles des conséquences concrètes et durables ? Le décret existe, la désignation comme « risque pour la supply chain » existe, le recours en justice d'Anthropic est annoncé. Le VC Sachin Seth de Trousdale Ventures a déclaré à TechCrunch que perdre Anthropic pourrait créer un vide dans le système de défense américain qui nécessiterait six à douze mois pour être comblé par d'autres fournisseurs. Cette dépendance mutuelle est, paradoxalement, l'une des rares protections concrètes dont Anthropic dispose actuellement : il est difficile d'expulser un fournisseur quand on est le client qui en a le plus besoin.

Que se passera-t-il en juillet 2026, à l'expiration du contrat entre OpenAI et le Département de la Défense ? C'est une fenêtre de tir assez proche pour être déjà sur le calendrier de quiconque réfléchit stratégiquement dans le secteur. xAI a déjà signalé sa disponibilité pour opérer dans des environnements classifiés sans les restrictions qui caractérisent Anthropic et, dans une moindre mesure, OpenAI. La compétition pour le contrat militaire américain n'est pas close, et le fait qu'Elon Musk soit à la fois conseiller de l'administration Trump et propriétaire de l'un des principaux concurrents d'Anthropic et d'OpenAI n'est pas un détail négligeable dans le calcul des probabilités futures.

Il y a ensuite une dimension géopolitique que cette affaire met au premier plan et que l'angle américain risque d'occulter. L'Europe observe. L'AI Act européen, premier cadre réglementaire contraignant sur l'intelligence artificielle au monde, entré progressivement en vigueur, classe les systèmes d'IA utilisés dans des contextes militaires séparément des applications civiles, laissant de fait aux États membres la gestion de ces usages. Mais la pression politique exercée sur des entreprises comme Anthropic, qui a des équipes importantes en Europe et sert des utilisateurs dans le monde entier, n'est pas indifférente au débat réglementaire européen. Si l'administration Trump parvient à infléchir les politiques de sécurité d'une entreprise américaine, qu'est-ce qui garantit que les mêmes pressions ne s'exerceront pas, par d'autres voies, sur des entreprises européennes ou sur des filiales européennes d'entreprises américaines ? C'est une question que l'on se pose déjà à Bruxelles, même si c'est d'une manière plus discrète que la situation ne le mériterait.

L'analogie avec la guerre froide que Tegmark propose mérite une brève note finale. Comme dans la course aux armements nucléaires, il y a un point où la logique du « nous devons le faire avant que les Chinois ne le fassent » se heurte à la mathématique élémentaire du risque mutuel. La Chine, observe-t-il, travaille à limiter certaines formes d'IA anthropomorphe, non pas pour plaire à l'Occident, mais parce qu'elle les considère comme déstabilisantes pour sa propre société. Ceux qui affirment que Pékin ne posera jamais de limites au développement de l'IA ignorent les mesures réglementaires que le gouvernement chinois a déjà engagées dans la direction opposée à la déréglementation totale. Ce n'est pas un argument pour l'inaction, mais c'est un antidote utile aux récits trop simplistes.

Il reste, au cœur de tout, la question qu'aucun communiqué de presse ne peut résoudre : qui a le dernier mot lorsqu'un système d'intelligence artificielle est positionné assez près d'une décision létale pour que la distinction entre « conseiller » et « décider » devienne une question d'architecture logicielle ? Ce n'est pas de la rhétorique. C'est la question qui a fait capoter les négociations entre Amodei et Hegseth, qui a poussé Altman à signer à la hâte, et que les juges américains se retrouveront bientôt à traiter sous des formes que les codes actuels n'envisagent pas.

Dario Amodei a tenu bon. Sam Altman a signé. Les utilisateurs, pour l'instant, ont récompensé celui qui a dit non. Le Pentagone a ses plans, Trump a signé le décret, les juges recevront le mémoire d'Anthropic, et le contrat d'OpenAI expire en juillet.

Que se passera-t-il ? Nous verrons.