Rapport AI Index 2026 de Stanford : l'IA accélère, la gouvernance freine

Cinquante-trois pour cent d'adoption mondiale en trois ans, plus rapide qu'Internet et l'ordinateur personnel. Quatre-vingt-huit pour cent des organisations déclarent utiliser l'IA. Un benchmark de programmation, SWE-bench Verified, passé de 60 % à près de 100 % en douze mois. Des investissements privés aux États-Unis s'élevant à 285,9 milliards de dollars, soit vingt-trois fois ceux de la Chine. Un écart de cinquante points de pourcentage entre ce que les experts attendent de l'IA et ce qu'en pense le public. Ces cinq chiffres cadrent le périmètre du 2026 AI Index Report de Stanford HAI : la neuvième édition d'un document qui fait office de miroir impitoyable d'un secteur qui accélère bien plus vite que quiconque ne parvient à le mesurer, le réguler ou l'absorber socialement.

Structuré en huit chapitres — recherche et développement, performance technique, IA responsable, économie, science, médecine, éducation, gouvernance et opinion publique — et alimenté par des données d'Epoch AI, LinkedIn, GitHub, McKinsey et l'OCDE, le rapport s'ouvre sur un postulat qui ressemble presque à un aveu : « Les données ne pointent pas dans une seule direction. Elles révèlent un domaine qui croît plus vite que les systèmes qui l'entourent. » Ce n'est pas de la rhétorique. C'est le fil conducteur de tout le document.

Des chiffres qui ne mentent pas

Avant d'entrer dans les détails, il convient de s'arrêter sur ce que le rapport communique avec le plus de force. L'IA générative a atteint un taux d'adoption de 53 % au sein de la population en moins de trois ans : pour faire de même, l'ordinateur personnel a mis plus d'une décennie. 91,6 % des modèles « notables » en 2025 sont produits par l'industrie privée, contre un seul modèle académique identifié sur toute l'année. L'université, qui a pourtant posé les fondations de ce domaine, est désormais presque hors jeu dans la production des systèmes à la frontière de la connaissance. La valeur économique des outils d'IA générative pour les seuls consommateurs américains a atteint 172 milliards de dollars par an, avec une valeur moyenne par utilisateur ayant triplé en un an, et presque tout est accessible gratuitement : l'un des transferts de valeur technologique les plus asymétriques de l'histoire récente.

La frontière dentelée : où les modèles excellent et où ils échouent encore

Il y a une image dans le rapport qui vaut mille graphiques. Gemini Deep Think de Google a remporté une médaille d'or aux Olympiades Internationales de Mathématiques 2025, en compétition avec les meilleurs lycéens mathématiciens de la planète. Le même modèle, ou des modèles de même niveau, ne lit correctement une horloge analogique que dans 50,1 % des cas. En pratique, guère mieux qu'un pile ou face.

C'est le concept de jagged frontier (frontière dentelée), que le rapport utilise comme clé d'interprétation du moment actuel. Les systèmes d'IA ne sont ni omnipotents ni triviaux : ils sont extraordinairement capables dans certains domaines et étonnamment fragiles dans d'autres, souvent sans qu'une logique intuitive ne guide cette distinction. Les mathématiques olympiques sont une tâche structurée, symbolique, avec des règles précises et vérifiables. Lire une horloge nécessite une perception spatiale et une mise en correspondance visuo-sémantique qui reste ardue pour les modèles actuels.

Où les progrès ont-ils été les plus évidents l'année dernière ? Dans le code : le benchmark SWE-bench Verified, qui mesure la capacité à résoudre des problèmes réels sur des dépôts GitHub, est passé de 60 % à près de 100 % par rapport à la référence humaine en seulement un an. Dans les agents autonomes : sur OSWorld, des tests sur des tâches réelles simulant l'utilisation d'un ordinateur avec système d'exploitation, le taux de réussite a bondi de 12 % à environ 66 %. Dans les benchmarks scientifiques : plusieurs modèles frontier égalent ou dépassent désormais la référence humaine sur des questions de niveau doctorat en physique, chimie et mathématiques.

Où les limites restent-elles en revanche profondes ? Dans la robotique physique : les robots ne réussissent que 12 % des tâches domestiques, bien qu'ils atteignent 89,4 % sur des simulations en environnements contrôlés. Le fossé entre le laboratoire et une cuisine réelle est encore un abîme. Et dans les raisonnements nécessitant un jugement contextuel, du bon sens ou la compréhension des sous-entendus communicationnels : c'est là que les modèles montrent les fissures les plus évidentes, celles qui se prêtent le moins à être mesurées par un benchmark.

La comparaison avec 2025 est éclairante. L'année dernière, le rapport documentait l'arrivée de l'IA comme force grand public. Cette année, il documente ce qui se passe après l'arrivée : saturation des benchmarks (de plus en plus de modèles les réussissent, les rendant moins informatifs), opacité croissante des laboratoires (moins de transparence sur les paramètres, les jeux de données, la puissance de calcul) et divergence entre les capacités déclarées par les développeurs et celles vérifiées par des tests indépendants. C'est la différence entre une première cinématographique et la suite : plus grand, plus cher, mais avec moins de surprises.

USA vs Chine : le dépassement qui n'a pas (encore) eu lieu

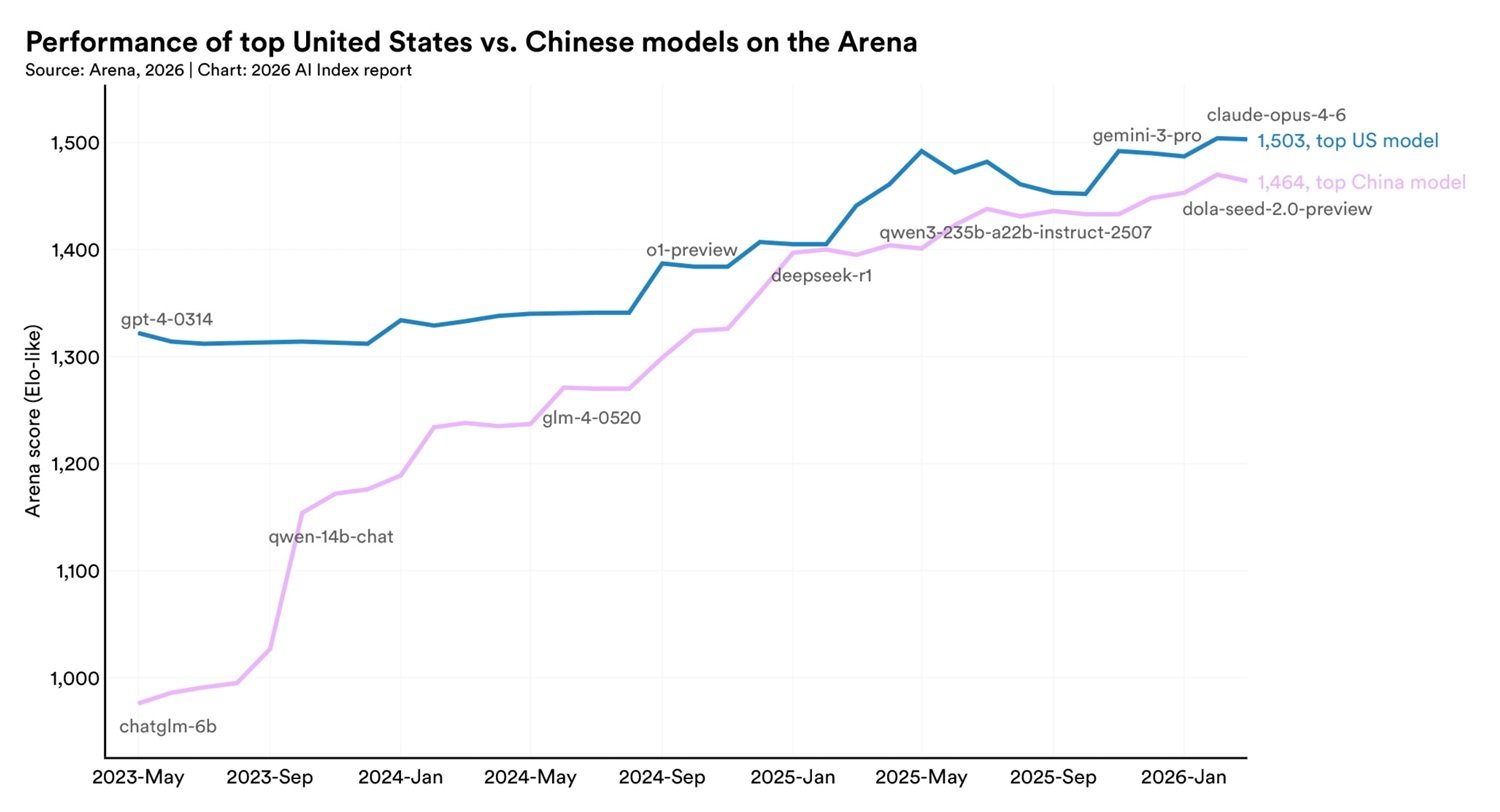

Le chapitre géopolitique du rapport est probablement le plus suivi par les décideurs politiques et industriels. Et les données de 2026 confirment une tendance que ceux qui suivent ce secteur avaient déjà pressentie : l'avantage américain sur les modèles frontier s'est réduit à une distance presque symbolique.

En février 2025, DeepSeek-R1 a brièvement égalé le meilleur modèle américain disponible. En mars 2026, le modèle de pointe d'Anthropic mène le classement avec une marge de 2,7 % sur le meilleur modèle chinois. Dans un domaine où les benchmarks sont mis à jour chaque semaine, 2,7 points de pourcentage ne constituent pas un avantage stratégique : c'est du bruit statistique. Les modèles des deux pays ont échangé la tête du classement plusieurs fois au cours de l'année écoulée.

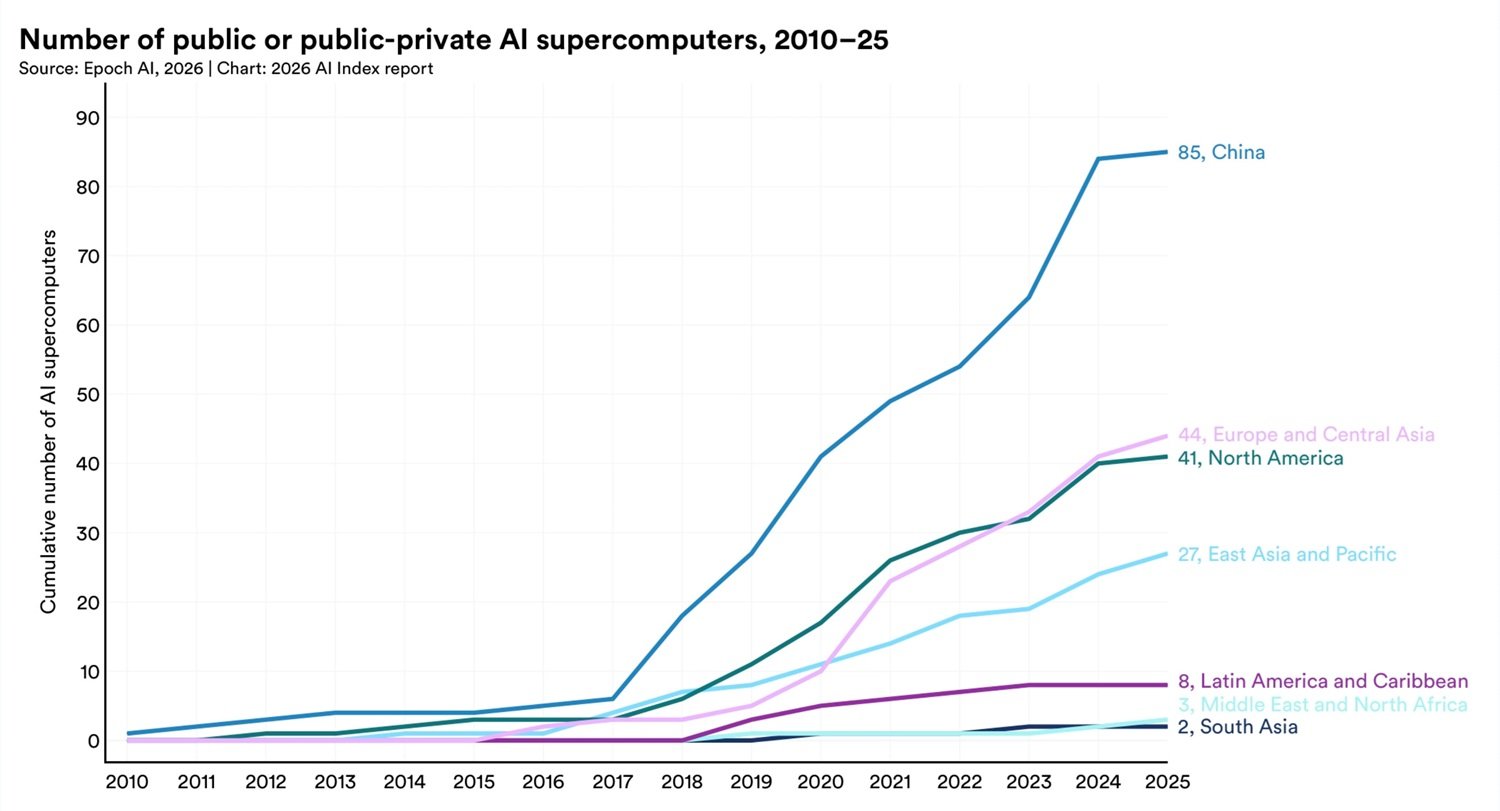

Cette donnée doit être lue parallèlement à la structure plus large de la compétition. Les États-Unis restent en tête pour la production de modèles notables (50 en 2025 contre 30 pour la Chine) et pour les brevets à fort impact. La Chine mène en revanche pour le volume de publications scientifiques, les citations, la production globale de brevets et les installations de robots industriels. Pékin a augmenté sa part des 100 articles d'IA les plus cités au monde, passant de 33 en 2021 à 41 en 2024. La Corée du Sud émerge comme une exception en termes de densité d'innovation : première mondiale pour les brevets d'IA par habitant.

Le tableau est celui d'une compétition technologique transformée en parité armée plutôt qu'en prédominance unilatérale. Quiconque lit ces données à la lumière des blocages d'exportations de puces et de la guerre des semi-conducteurs ne peut s'empêcher de se demander si ces mesures ont produit le résultat escompté. La réponse qui émerge de Stanford est dérangeante : probablement pas.

Sur AITalk, nous avons suivi cette trajectoire de près. L'année dernière, nous documentions les capacités de GLM-5 de Zhipu AI, un modèle chinois qui montrait déjà des performances compétitives sur les benchmarks multimodaux. Dans l'analyse sur la guerre de l'IA entre les USA et la Chine, nous avions souligné comment les restrictions américaines accéléraient paradoxalement l'autonomie technologique chinoise dans le domaine des puces et des modèles. Kimi K2 de Moonshot AI et surtout DeepSeek, avec sa capacité à produire des modèles compétitifs à des coûts drastiquement inférieurs, ont concrétisé cette prévision. Le rapport de Stanford ne fait qu'apporter le sceau quantitatif à une histoire qui était déjà en train de s'écrire.

Un élément que le rapport ajoute à ce scénario est la fuite des talents américains, qui représente peut-être la fissure la plus sous-estimée de la primauté des États-Unis. Le nombre de chercheurs et développeurs en IA s'installant aux États-Unis s'est effondré de 89 % par rapport à 2017, avec une baisse de 80 % sur la seule année dernière. Les États-Unis restent le pays disposant du plus grand stock de talents en IA, mais ils attirent de nouveaux cerveaux au rythme le plus bas de ces dix dernières années. C'est le genre d'indicateur qui n'impacte pas les benchmarks d'aujourd'hui mais qui définit la trajectoire des cinq prochaines années.

L'infrastructure fragile du monde

Derrière chaque réponse générée par un modèle d'IA se cache une chaîne d'approvisionnement matérielle aux proportions énormes et à la fragilité structurelle sous-estimée. Les États-Unis hébergent 5 427 centres de données d'IA, soit plus de dix fois n'importe quel autre pays, et consomment plus d'énergie que n'importe quelle autre région à cette fin. La capacité de traitement mondiale pour l'IA a crû de 3,3 fois par an depuis 2022, atteignant l'équivalent de 17,1 millions de cartes Nvidia H100. Nvidia contrôle plus de 60 % de cette puissance de calcul.

La donnée la plus pertinente géopolitiquement est toutefois une autre. Presque toutes les puces qui alimentent cette infrastructure sont produites par une seule entreprise : TSMC, basée à Taïwan. Le rapport l'affirme sans périphrase : la chaîne d'approvisionnement matérielle mondiale de l'IA dépend d'une seule fonderie sur une île contestée. Il existe peu de comparaisons pour une telle concentration de risque systémique, peut-être la dépendance énergétique européenne au gaz russe avant 2022, mais avec une différence cruciale : il n'existe pas, pour les puces d'IA, de fournisseur alternatif déjà prêt. TSMC a lancé une première expansion en Arizona en 2025, mais la capacité américaine reste une fraction de la capacité taïwanaise.

L'impact environnemental complète le tableau. L'entraînement de Grok 4 a produit environ 72 816 tonnes d'équivalent CO₂. La capacité d'alimentation des centres de données d'IA a atteint 29,6 gigawatts, comparable au pic de consommation de l'État de New York tout entier. Les estimations sur la consommation d'eau de l'inférence de GPT-4o indiquent une utilisation annuelle qui pourrait dépasser les besoins de 12 millions de personnes. L'IA n'est pas une industrie virtuelle : elle a un corps physique, et ce corps croît plus vite que nos infrastructures énergétiques.

Travail, adoption et valeur : qui gagne, qui perd

Le chapitre économie du rapport est le plus attendu par les non-techniciens, et cette année il apporte des données plus granulaires que d'habitude. La productivité dans des secteurs tels que le support client et le développement logiciel a augmenté de 14 % à 26 % dans les contextes où l'IA a été introduite de manière structurée. Les effets ne sont cependant pas uniformes : les gains sont plus marqués pour les tâches routinières et plus faibles, voire négatifs, pour les tâches nécessitant un jugement complexe.

La donnée la plus discutée concerne les jeunes développeurs américains. Dans la tranche des 22-25 ans, l'emploi dans le secteur du logiciel a chuté de près de 20 % en 2024, tandis que le nombre de développeurs seniors continue de croître. Le rapport évite de transformer la corrélation en causalité, mais l'association est difficile à ignorer : les gains de productivité de l'IA se concentrent exactement sur les tâches typiquement confiées aux profils juniors, et l'impact sur l'emploi se matérialise exactement dans cette tranche. C'est comme si l'IA compressait le niveau d'entrée de la profession, effaçant le parcours d'apprentissage qui, pendant des décennies, a transformé les diplômés en développeurs experts.

Le modèle d'adoption présente des caractéristiques géographiques surprenantes. Singapour est à 61 %, les Émirats arabes unis à 54 %, tous deux au-dessus des attentes par rapport au PIB par habitant. Les États-Unis, siège des principaux développeurs d'IA, se classent au 24e rang avec 28,3 % : la proximité avec l'industrie ne suffit pas à générer une adoption généralisée.

Gouvernance, sécurité, transparence : le retard systémique

Le chapitre le plus préoccupant du rapport n'est pas celui sur les capacités techniques, mais celui sur l'IA responsable. Presque tous les principaux laboratoires publient des résultats sur les benchmarks de capacité. Mais la couverture des benchmarks de sécurité, d'équité (fairness) et de gouvernance reste sporadique et hétérogène, rendant toute comparaison systématique impossible. Les incidents documentés liés à l'IA sont passés à 362 en 2025, contre 233 en 2024. Et le rapport signale un problème technique insidieux : améliorer une dimension de l'IA responsable, par exemple la sécurité, peut dégrader une autre dimension, comme la précision.

Sur le plan de la gouvernance, 2025 a vu des mouvements dans des directions opposées. L'IA Act de l'UE a fait entrer en vigueur les premières interdictions. Les États-Unis ont viré vers la déréglementation. Le Japon, la Corée du Sud et l'Italie ont approuvé des lois nationales. Plus de la moitié des nouvelles stratégies nationales adoptées en 2025 provient de pays en voie de développement qui entrent pour la première fois dans le débat normatif. La souveraineté en matière d'IA, soit la capacité à contrôler de manière autonome sa propre infrastructure et ses propres modèles, est devenue le principe organisateur central de nombre de ces stratégies.

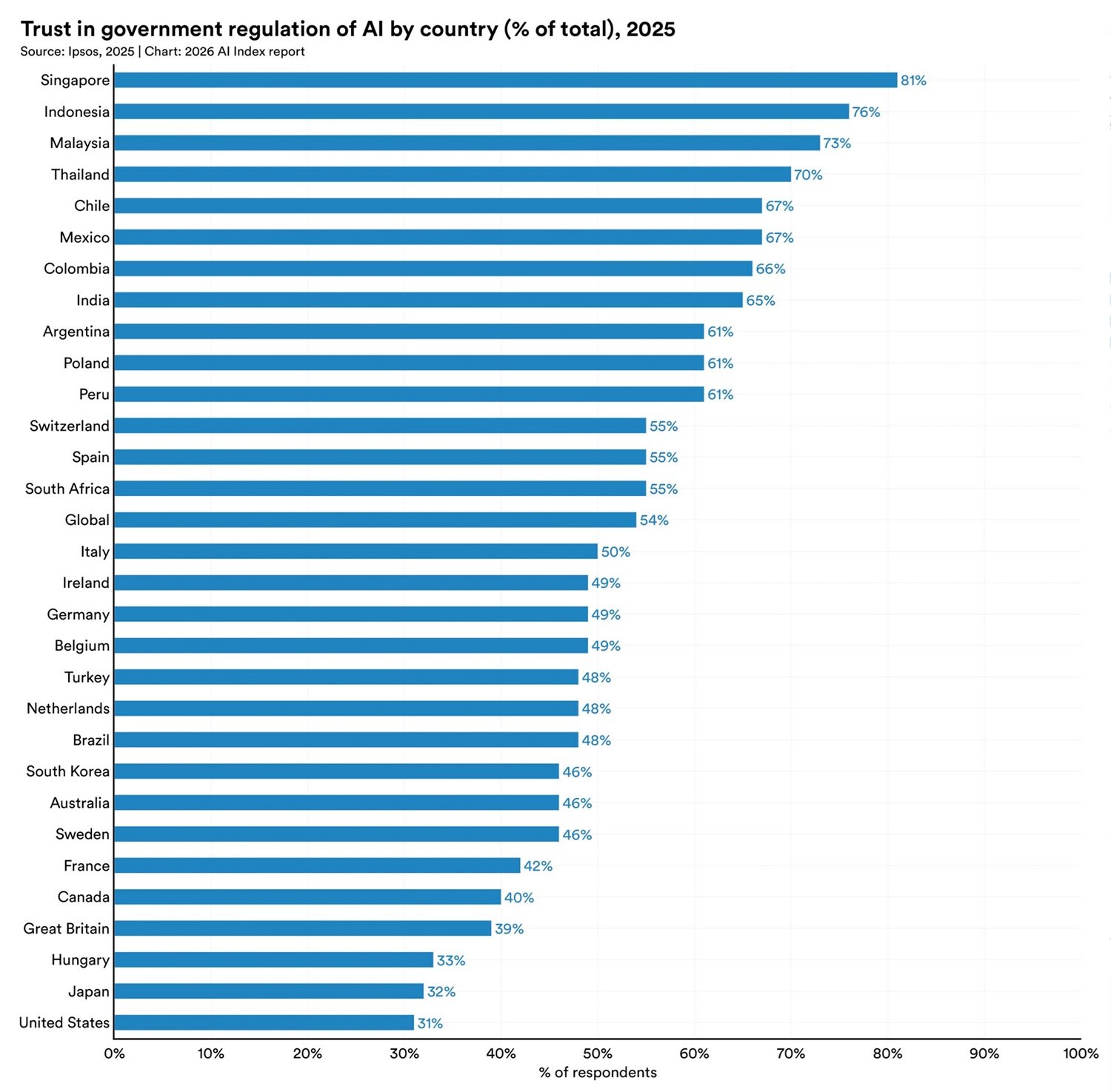

La donnée sur la confiance du public est la plus déroutante de tout le rapport. Parmi les pays inclus dans le sondage, les États-Unis affichent le niveau de confiance le plus bas envers leur propre gouvernement pour la réglementation de l'IA : 31 %. L'Union européenne est jugée plus fiable que les États-Unis ou la Chine. Pour le pays qui héberge OpenAI, Google DeepMind, Anthropic et xAI, c'est un verdict qui en dit long sur le décalage entre capacité industrielle et légitimité réglementaire. L'écart de perspective entre les experts et le public résume tout cela : 73 % des experts attendent un impact positif de l'IA sur leur travail, contre seulement 23 % pour le public. Cinquante points de pourcentage de distance sur l'une des questions centrales de notre temps.

L'IA dans la science, la médecine, l'éducation

Le rapport 2026 introduit pour la première fois deux chapitres distincts sur la science et la médecine. Dans le domaine scientifique, les modèles frontier dépassent en moyenne les chimistes humains sur le benchmark ChemBench, et un modèle génomique de 200 millions de paramètres a battu des systèmes près de deux cents fois plus grands. La loi « plus c'est grand, mieux c'est » se fissure dans les domaines spécialisés. Mais ces mêmes modèles obtiennent des scores inférieurs à 20 % dans la réplication d'expériences astrophysiques : la frontière dentelée s'applique aussi au laboratoire.

En médecine, les outils de documentation automatique, qui génèrent la note clinique à partir de l'entretien patient-médecin, ont connu une adoption significative en 2025, les médecins signalant jusqu'à 83 % de gain de temps dans la rédaction. Le problème réside dans les preuves : une revue de plus de 500 études cliniques a révélé que près de la moitié utilisait des questions d'examen au lieu de données réelles sur les patients, et seulement 5 % se basaient sur des données cliniques authentiques. L'écart entre promesse et preuve est encore large.

Dans l'éducation, plus de 80 % des étudiants utilisent l'IA pour leurs devoirs scolaires, mais seulement la moitié des écoles ont des politiques en vigueur et à peine 6 % des enseignants les jugent claires. Les nouveaux doctorats en IA aux États-Unis et au Canada ont augmenté de 22 % entre 2022 et 2024, mais cette augmentation est allée entièrement vers le milieu académique, et non vers l'industrie. Plus de formation de haut niveau, moins de transfert direct vers le secteur productif : un paradoxe que le rapport enregistre sans le résoudre.

Les questions ouvertes : qui contrôle, qui en profite, qui paie

Le rapport de Stanford ne se conclut pas par des réponses. Il se conclut par des questions, et c'est là sa qualité la plus précieuse dans un secteur où les certitudes se vendent aux prix du marché.

Sur le contrôle : la production de modèles reste concentrée dans un très petit nombre d'organisations privées, et les meilleurs systèmes du monde sont de moins en moins transparents (80 des 95 modèles notables de 2025 ont été publiés sans code d'entraînement). Quiconque n'est pas Google, OpenAI, Anthropic, Alibaba ou DeepSeek opère dans un écosystème qui dépend de décisions qu'il ne contrôle pas. Sur la valeur : l'IA génère une richesse mesurable, mais sa distribution est fortement asymétrique — quelques opérateurs récoltent les revenus, les travailleurs juniors commencent à payer le prix de l'automatisation, les consommateurs reçoivent des outils gratuits assortis de dépendances et de risques encore mal compris. Sur les coûts : l'empreinte environnementale croît sans être tarifée, les rôles juniors disparaissent en même temps que le parcours de formation qui produit les experts de demain, et les coûts de gouvernance s'accumulent silencieusement tandis que les benchmarks de capacité s'envolent.

Chaque technologie transformative redessine les infrastructures, le travail et le pouvoir. Le rapport de Stanford 2026 documente, données à l'appui, que l'IA fait exactement cela, plus vite que nos systèmes de mesure, de régulation et d'adaptation ne parviennent à suivre. La nouvelle n'est pas que l'IA s'améliore. C'est que l'écart entre sa vitesse et notre capacité à la gérer s'élargit à chaque édition du rapport. Et c'est là, pour l'instant, la frontière la plus dentelée de toutes.