TurboQuant : un bit pour redéfinir les limites de l'intelligence artificielle

Fin avril 2025, quatre chercheurs de Google Research et de l'Université de New York publiaient sur arXiv un article au titre sobre : *TurboQuant: Online Vector Quantization with Near-optimal Distortion Rate. Pendant des mois, presque personne n'en a parlé en dehors des cercles académiques. Puis, en mars 2026, Google publie un billet sur son blog officiel annonçant TurboQuant comme une percée dans l'efficacité des modèles linguistiques, suite à son acceptation à l'ICLR 2026. En quarante-huit heures, l'article apparaît dans tous les flux technologiques. Des annonces de compressions plus de cinq fois supérieures sans perte de qualité, des titres enthousiastes partout. Un an de retard, une vague de battage médiatique.*

Il convient de s'arrêter, car cette dynamique — l'article dormant qui explose grâce à la poussée communicationnelle d'un grand laboratoire — raconte quelque chose sur le fonctionnement de l'information dans l'écosystème de l'intelligence artificielle. Il est encore plus utile de comprendre ce que fait réellement TurboQuant, sans surestimer ni balayer la contribution.

Lorsqu'un grand modèle linguistique génère du texte, il ne traite pas chaque mot à partir de zéro à chaque fois. Au lieu de cela, il garde en mémoire une structure appelée KV cache, une archive de paires clé-valeur, qui fonctionne comme un aide-mémoire numérique à haute vitesse. Au fur et à mesure que la conversation avance, le modèle y accumule les vecteurs mathématiques qui codent la signification de tout ce qu'il a déjà lu, pour les consulter instantanément lors du mécanisme d'attention, avec lequel le Transformer décide de ce à quoi il doit prêter attention à chaque instant.

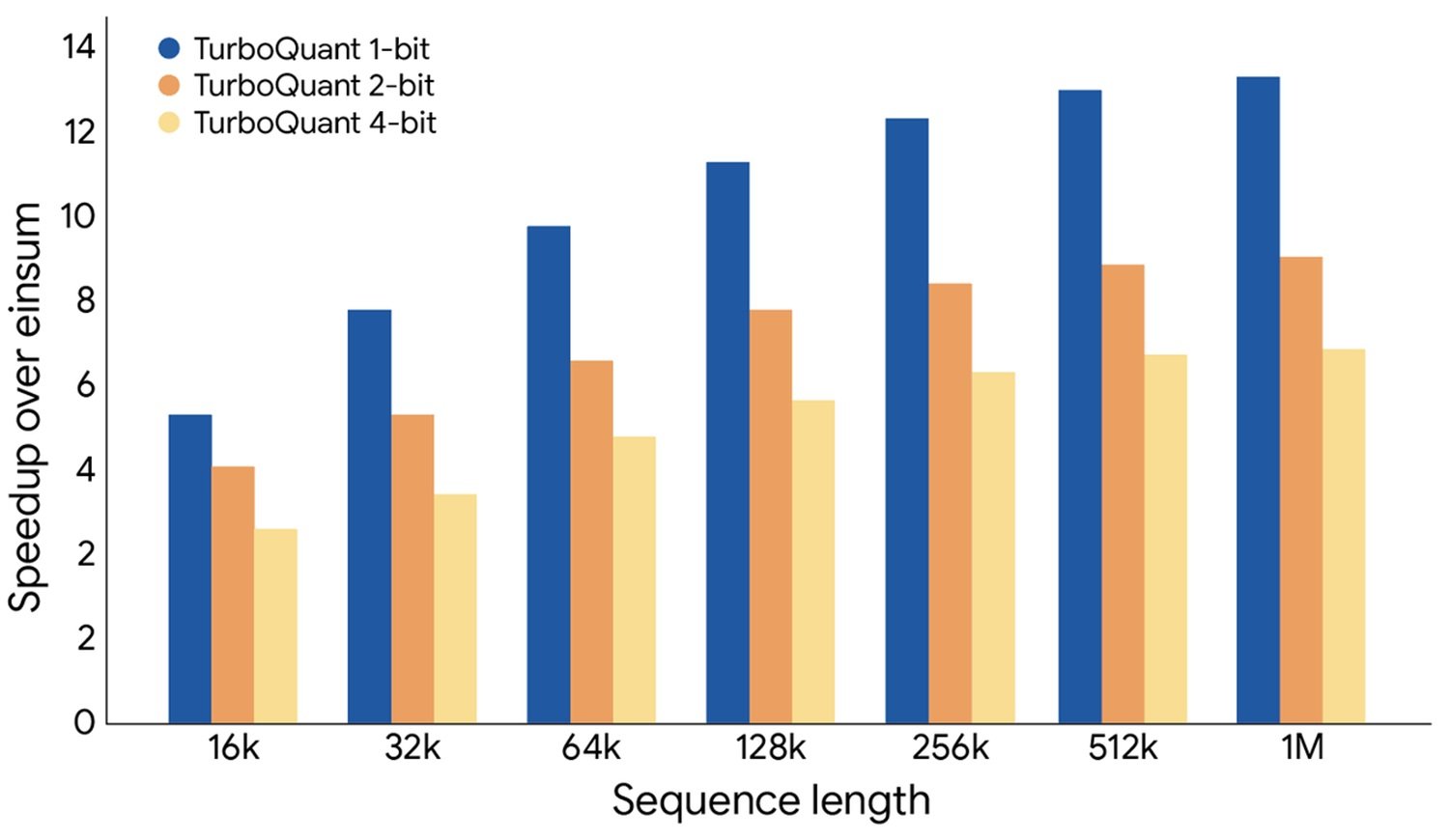

Le problème est que ce cache croît de manière inexorable avec le contexte. Avec des fenêtres de 128 000 ou 250 000 jetons, désormais standard dans les modèles modernes, il peut occuper des dizaines de gigaoctets de mémoire à haute vitesse. Ceux qui utilisent des modèles en local connaissent cette situation paradoxale : assez de RAM pour charger les poids du modèle, mais pas assez dès que l'on essaie de l'utiliser avec un contexte long. C'est comme avoir une grande archive avec des couloirs trop étroits pour y transporter les dossiers.

La réponse évidente est de compresser ces vecteurs, et c'est là qu'intervient la quantification.

Quantifier sans perdre le fil

La quantification est l'un de ces concepts qui semblent obscurs jusqu'à ce que l'on trouve la bonne analogie. Imaginez une règle avec des graduations très fines, capable de mesurer au dixième de millimètre. Vous voulez stocker des milliers de mesures mais vous avez peu de place, alors vous passez à une règle plus grossière avec des encoches tous les demi-centimètres : vous perdez un peu de précision, mais occupez beaucoup moins d'espace. En pratique, les vecteurs KV sont normalement sauvegardés à 16 bits par composante, soit environ 65 000 valeurs distinctes. Les ramener à 4 bits réduit à seulement 16 valeurs possibles, avec une économie de mémoire de quatre fois, mais avec une approximation qui peut dégrader les performances du modèle.

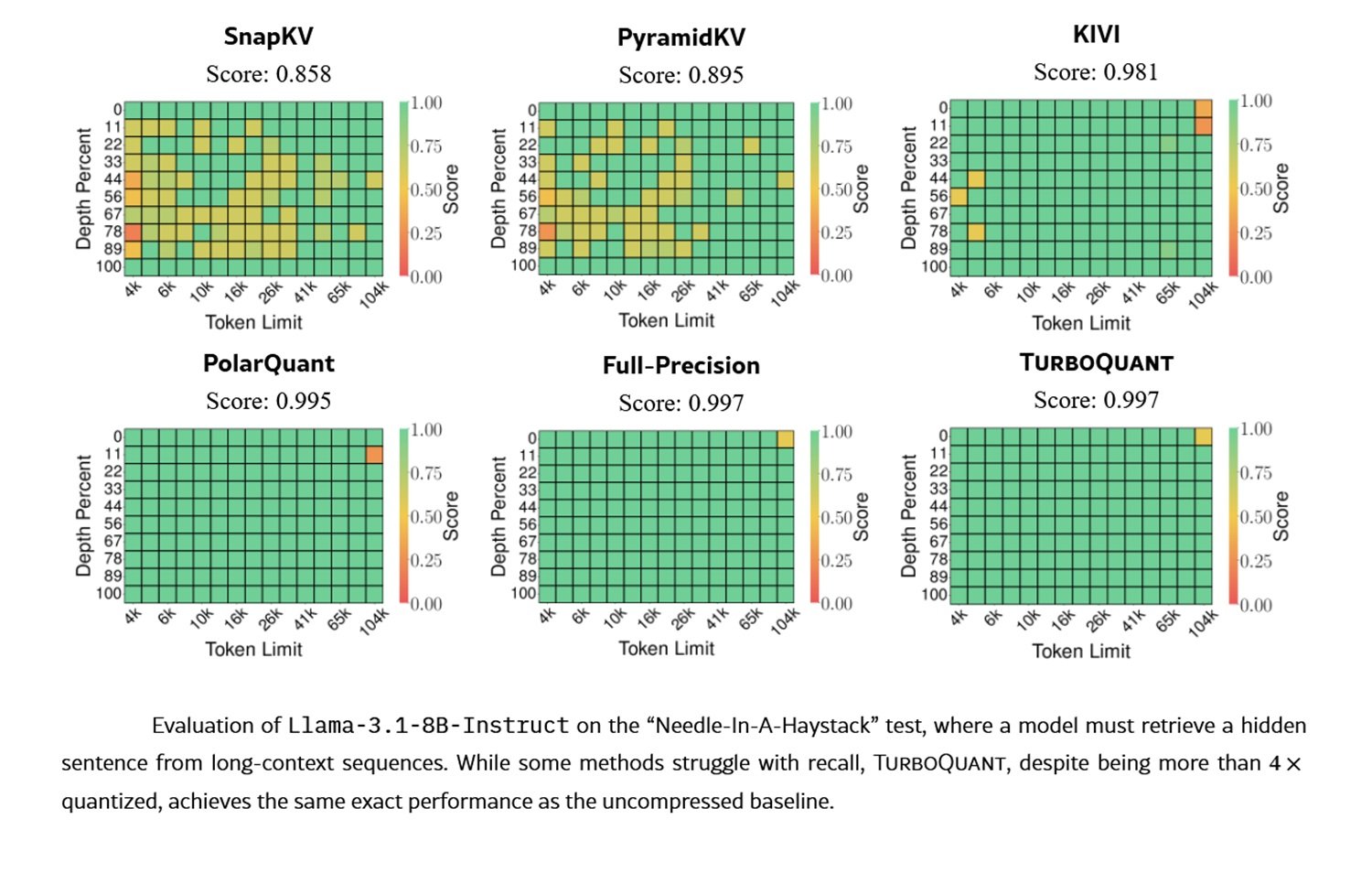

La dégradation n'est pas anodine. Comme l'observe le programmeur et analyste technique Salvatore Sanfilippo dans son analyse approfondie, la quantification du cache KV n'entame pas seulement la capacité à récupérer des détails textuels précis, elle compromet également la qualité de la synthèse sémantique dans les couches suivantes du Transformer, où les jetons deviennent des représentations de plus en plus abstraites. Les benchmarks sur l'« aiguille dans une botte de foin » (needle in a haystack), le test classique où l'on cache une information spécifique dans un texte très long, ne capturent qu'une partie de cette détérioration.

Le territoire a déjà vu passer de nombreux explorateurs. Des techniques comme KIVI ont proposé différentes approches pour la compression du cache KV. Dans le domaine plus général, la product quantization (PQ) est le standard historique : elle divise chaque vecteur en sous-vecteurs, construit un dictionnaire pour chacun, et remplace chaque sous-vecteur par l'indice du centroïde le plus proche. Cela fonctionne bien, mais nécessite une phase d'entraînement hors ligne, inutilisable dans des scénarios comme le cache KV, où les vecteurs arrivent en temps réel.

TurboQuant part d'un objectif plus ambitieux : être data-oblivious, c'est-à-dire fonctionner sans rien savoir de la distribution des données d'entrée, et le faire avec des garanties théoriques solides.

L'astuce de la rotation et le bit résiduel

Le cœur technique de TurboQuant s'explique en deux actes.

Premier acte : la rotation aléatoire. Les vecteurs KV ont un problème structurel gênant : leurs composantes ne sont pas distribuées uniformément. Certaines dimensions contiennent presque toute l'information pertinente, tandis que beaucoup d'autres sont proches de zéro. Appliquer une quantification standard signifie gaspiller des bits précieux sur les dimensions non pertinentes et accumuler des erreurs sur les rares qui comptent vraiment. C'est comme calibrer une balance de précision pour peser des cailloux, perdant ainsi toute la finesse nécessaire pour peser de la poudre d'or.

TurboQuant résout ce problème en appliquant une rotation aléatoire au vecteur avant de le quantifier : le multiplier par une matrice de rotation change les coordonnées sans altérer la longueur du vecteur, tout comme faire pivoter un objet dans l'espace n'en change pas les dimensions. Le résultat est qu'après la rotation, les composantes suivent une distribution statistique connue à l'avance, une distribution Bêta qui, en haute dimension, converge vers une gaussienne, transformant un problème dépendant des données en un problème universel. La distribution originale n'importe plus : on peut précalculer les tables de quantification optimales pour chaque niveau de bits souhaité et les appliquer systématiquement, sans étalonnage au cas par cas. À noter une distinction technique importante : multiplier par n'importe quelle matrice gaussienne aléatoire changerait également la longueur du vecteur, introduisant des distorsions incontrôlables. La rotation maintient la norme L2 invariante, et cette propriété est fondamentale.

Deuxième acte : le bit du résidu. Les quantificateurs optimisés pour minimiser l'erreur quadratique moyenne (MSE) ne garantissent pas des estimations précises des produits scalaires entre vecteurs, et les produits scalaires sont précisément ce que le mécanisme d'attention calcule continuellement. Avoir une bonne reconstruction du vecteur n'implique pas automatiquement de bonnes estimations des produits scalaires.

TurboQuant traite cela avec une seconde étape : après avoir quantifié le vecteur à b−1 bits, il calcule le résidu, la différence entre le vecteur original et le vecteur quantifié, et le traite avec la technique QJL (Quantized Johnson-Lindenstrauss), qui le projette sur une matrice gaussienne aléatoire et n'en conserve que le signe de chaque composante, occupant exactement 1 bit. Ce bit fonctionne comme un correcteur d'erreur : il garantit que l'estimation des produits scalaires est unbiased (sans biais), c'est-à-dire que l'erreur n'est pas systématiquement orientée dans une direction. L'ampleur de l'erreur résiduelle est estimée analytiquement sans être sauvegardée, car la distribution est connue par la construction du quantificateur. Le système utilise au total b bits : b−1 pour la compression principale, 1 pour la correction.

Quelle est la solidité de l'affirmation théorique ?

L'article déclare que TurboQuant est near-optimal, proche de la limite théorique inférieure de distorsion pour n'importe quel quantificateur possible. C'est le genre d'affirmation qui doit être lue avec soin.

Les auteurs démontrent, en utilisant le théorème de codage de Shannon et le principe minimax de Yao, que pour tout quantificateur aléatoire, il existe des entrées pour lesquelles la distorsion MSE est d'au moins 1/4^b. TurboQuant atteint une distorsion au maximum √(3π/2) ≈ 2,7 fois supérieure à cette borne inférieure, et à 1 bit, l'écart descend à environ 1,45. Les résultats sont formellement démontrés.

L'affirmation tient la route, avec deux précisions. Premièrement : « near-optimal » signifie à un facteur constant près de la limite théorique, sans pour autant l'atteindre. La constante 2,7 est petite et en pratique négligeable, mais techniquement l'écart existe. Deuxièmement : la borne inférieure est dérivée pour le pire cas sur des entrées arbitraires. En production, les distributions réelles des vecteurs KV peuvent se comporter différemment.

Une distinction fondamentale, souvent ignorée dans la couverture médiatique, est celle entre l'optimisation pour la MSE et l'optimisation pour la distorsion du produit scalaire. Ce sont deux objectifs différents qui nécessitent des solutions différentes, et TurboQuant s'attaque aux deux avec son approche en deux étapes. Ce n'est pas un détail : cela signifie que la méthode est pensée spécifiquement pour le fonctionnement interne des Transformers, et pas seulement pour compresser des vecteurs au sens générique.

La question RabbitQ : qui a fait quoi en premier

L'article a soulevé un débat pendant la phase de révision, et il serait malhonnête de ne pas l'aborder.

Le nœud du problème : la rotation aléatoire en tant que technique de prétraitement n'a pas été inventée par TurboQuant. Une méthode précédente appelée RabbitQ avait déjà utilisé une transformation similaire, et ses auteurs ont protesté publiquement lors de l'évaluation par les pairs, soutenant que leur contribution avait été ignorée. Leurs remarques ont été prises en compte, mais la caractérisation de RabbitQ dans l'article final a continué d'être jugée inadéquate, les chercheurs revendiquant également pour leur méthode des propriétés d'excellence asymptotique.

Il existe également un travail antérieur des mêmes auteurs de TurboQuant, PolarQuant, qui utilisait une transformation en coordonnées polaires pour obtenir un effet similaire, mais avec un coût computationnel nettement plus élevé, ce qui le rendait inutilisable dans des scénarios en ligne. TurboQuant en est une évolution plus pratique.

Comme l'observe Sanfilippo, l'astuce de la rotation était déjà présente ailleurs, et le fait de ne pas l'avoir explicitement reconnu est la partie la plus problématique de toute l'affaire. La communication publique de Google a survolé ces précédents avec désinvolture, amplifiant l'impression d'une nouveauté plus radicale que ce que l'article lui-même soutient.

Les benchmarks et la valeur réelle de la contribution

L'affirmation d'une « neutralité qualitative absolue à 3,5 bits » est étayée par les données, mais avec des contextes qui méritent attention. Les tests principaux sont menés sur Llama-2-7B, un modèle de 7 milliards de paramètres qui, selon les standards actuels, est considéré comme petit. Sur des modèles plus grands, la quantification agressive tend à se comporter différemment. Sanfilippo souligne un point critique : lorsque les benchmarks montrent que même des méthodes moins sophistiquées obtiennent des scores similaires, cela peut signifier que la tâche est trop simple pour distinguer les différences réelles.

Sur LongBench, la comparaison est plus révélatrice. KIWI à 5 bits obtient des scores comparables à TurboQuant à 3,5 bits sur plusieurs tâches. Cela ne diminue pas le résultat — utiliser moins de bits pour la même qualité est un avantage réel —, mais redimensionne la portée de la « révolution ». L'économie réelle, dans l'évaluation la plus honnête, est de l'ordre d'un bit par rapport à l'état de l'art : pouvoir quantifier à 4 bits avec les mêmes performances qu'une quantification à 5 bits avec d'autres méthodes, soit réduire l'occupation du cache KV de 20 % par rapport aux concurrents. Un avantage solide, pas une discontinuité.

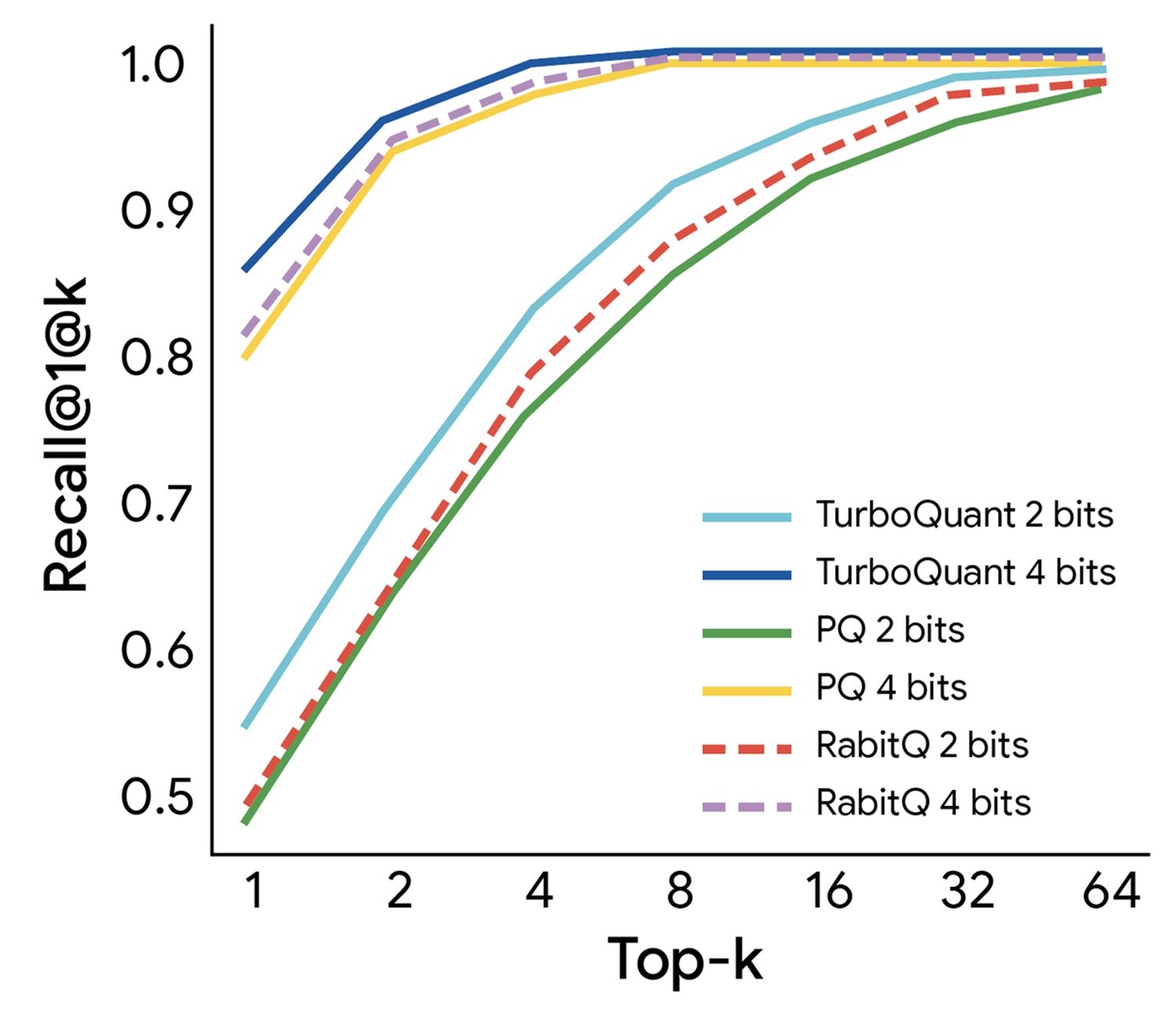

Sur le front de la recherche vectorielle, les résultats sont en revanche plus nettement différenciateurs : l'élimination de la phase d'entraînement hors ligne du dictionnaire (codebook) est un avantage opérationnel concret pour ceux qui construisent des systèmes de recherche (retrieval) sur des données dynamiques.

Questions ouvertes

Après avoir lu l'article, le billet de blog, les critiques des chercheurs de RabbitQ et l'analyse de Sanfilippo, quelques questions fondamentales restent sans réponse satisfaisante.

La première et la plus importante : les résultats sur Llama-2-7B se transposent-ils aux modèles de 70 ou 400 milliards de paramètres, aux architectures mixture-of-experts aujourd'hui dominantes ? La théorie dit que oui, mais cela doit être vérifié empiriquement. Les architectures plus récentes, avec l'attention par requêtes groupées ou les configurations multi-query, où les dimensions des vecteurs KV sont réduites, pourraient répondre différemment à la rotation aléatoire.

La deuxième concerne la comparaison directe avec RabbitQ dans les mêmes conditions. Les polémiques lors de la révision par les pairs suggèrent que la comparaison présentée dans l'article n'était pas tout à fait équitable : RabbitQ testé sur CPU, TurboQuant sur H100. Une comparaison sur un matériel identique, avec les mêmes benchmarks, reste à faire de manière indépendante.

La troisième concerne l'intégration dans les pipelines réels. En production, le cache KV coexiste avec des stratégies d'éviction de jetons, l'attention clairsemée, des systèmes de pagination de la mémoire comme PagedAttention. Un bit gagné par la quantification peut être facilement annulé par une intégration sous-optimale dans ces systèmes composites.

Enfin, la question plus large : la compression du cache KV est-elle vraiment le principal goulot d'étranglement dans l'inférence à long contexte, ou y a-t-il d'autres facteurs — bande passante, latence d'accès, parallélisation de l'attention — qui pèsent davantage ? Économiser un bit est une contribution réelle, mais son impact pratique dépend de l'endroit où se situe la véritable contrainte du système.

TurboQuant est un travail de recherche solide, avec des fondations théoriques robustes et une contribution technique originale dans le second étage QJL. Ce n'est pas la fin de l'histoire de la compression vectorielle, et il n'était pas juste de le présenter comme tel. Mais c'est un pas en avant authentique, du genre qu'il vaut la peine de comprendre, et pas seulement de partager.