Le MIT concrétise la promesse des lunettes à rayons X

Ceux qui étaient adolescents entre la fin des années 70 et le début des années 80 se souviennent bien de cette sensation en feuilletant les dernières pages de *L'Intrepido ou de Lanciostory : au milieu des publicités pour des stylos à bille et des cours de dessin par correspondance, trônait une réclame promettant l'impossible. Des lunettes à rayons X. Des vraies. Pour quelques lires, frais d'envoi compris. La promesse était limpide : portez-les et vous verrez à travers tout. Murs, boîtes, vêtements. La réalité, comme le découvrait amèrement chaque garçon cédant à la tentation, était bien plus prosaïque : un morceau de carton avec un curieux effet optique basé sur la diffraction de la lumière, capable tout au plus de faire paraître sa propre main transparente. Une escroquerie à la Totò, une illusion bon marché.*

Ce rêve, pourtant, n'a jamais vraiment disparu. Il s'est simplement déplacé dans les laboratoires de recherche, où pendant des décennies, ingénieurs et physiciens ont cherché des moyens concrets de voir ce que les yeux humains ne peuvent atteindre. Et le 19 mars 2026, le MIT a publié les résultats d'une recherche qui, sans exagérer, représente l'étape la plus convaincante vers cette promesse trompeuse des années 80 : un système capable de reconstruire des objets cachés et des environnements entiers en utilisant des signaux radio réfléchis, guidé par des modèles d'intelligence artificielle générative. Pas de lunettes en carton cette fois. Deux articles acceptés à la conférence IEEE CVPR, l'un des forums les plus prestigieux au monde dans le domaine de la vision par ordinateur, et un laboratoire qui, depuis plus d'une décennie, accumule des résultats considérés comme impossibles.

Le problème physique qui a tout bloqué pendant vingt ans

Pour comprendre pourquoi cette recherche est pertinente, il faut faire un pas en arrière et aborder une question de physique pure. Les ondes millimétriques, ou mmWave, sont des signaux radio à très haute fréquence, les mêmes que ceux utilisés dans les réseaux Wi-Fi de dernière génération et les radars automobiles. Elles possèdent une propriété très utile : elles traversent relativement facilement des matériaux courants comme le carton, le plastique, le bois et le placoplâtre. Cela les rend, en théorie, parfaites pour « voir » ce qui se trouve de l'autre côté d'une paroi ou caché sous une pile d'objets.

Le problème est ailleurs, et il porte un nom technique précis : la specularité, ou réflexion spéculaire. Lorsqu'une onde millimétrique frappe une surface, elle a tendance à rebondir dans une seule direction, comme la lumière sur un miroir. Cela signifie que le capteur ne parvient à capturer qu'une portion limitée de la surface de l'objet caché : typiquement la partie la plus haute, celle qui réfléchit le signal directement vers le récepteur. Le dessous, les flancs, les surfaces inclinées : tout est invisible. Comme essayer de reconstruire la forme d'une sculpture en la touchant d'un seul doigt, toujours sous le même angle.

Les chercheurs du groupe Signal Kinetics du MIT Media Lab avaient déjà obtenu des résultats significatifs dans ce domaine. À l'été 2025, ils avaient présenté mmNorm, un système capable d'estimer les normales de surface des objets cachés, remportant le Best Paper Runner-up et le Best Poster Award à ACM MobiSys. Mais le problème de la specularité restait un plafond de verre : les reconstructions étaient partielles, précises là où le signal arrivait, aveugles ailleurs. Il fallait quelque chose de qualitativement différent pour le saut suivant.

Wave-Former : quand l'IA apprend à imaginer ce qu'elle ne voit pas

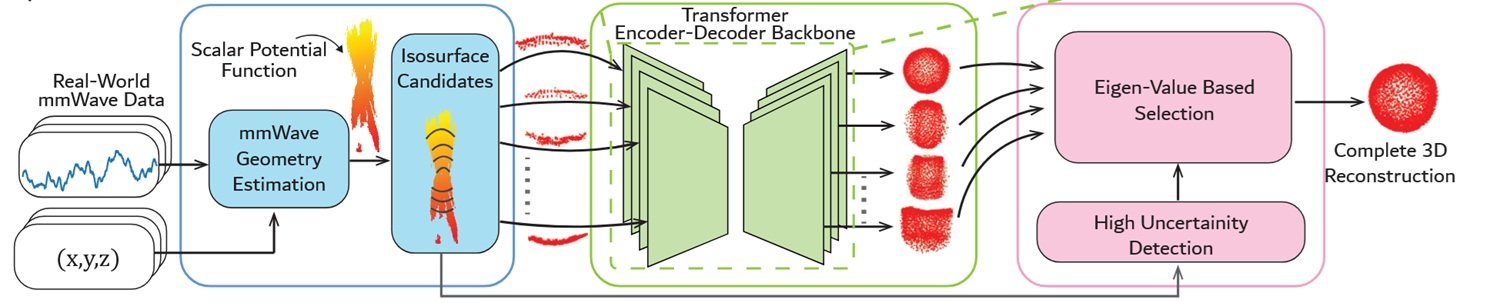

La solution trouvée par l'équipe est, à bien y réfléchir, élégante dans sa logique : si le capteur physique ne peut pas collecter assez de données pour reconstruire toute la forme d'un objet, on entraîne un modèle d'intelligence artificielle générative à imaginer les parties manquantes. Pas une invention arbitraire, mais une inférence guidée par la physique : le système sait comment se comportent les ondes millimétriques, connaît les propriétés de la réflexion spéculaire, et apprend à compléter la forme plausible d'un objet en partant d'une reconstruction partielle.

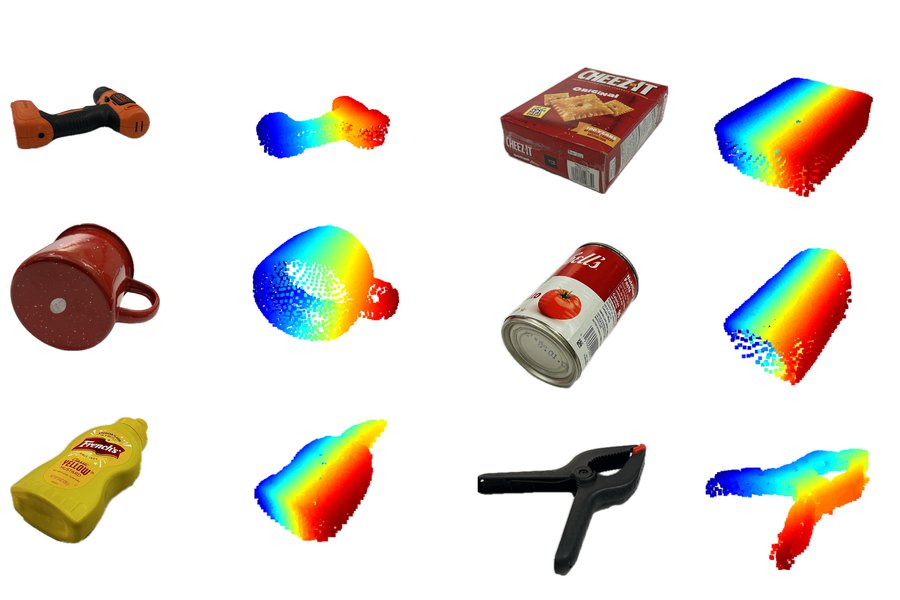

Le système s'appelle Wave-Former et fonctionne en trois phases. D'abord, il construit une reconstruction partielle de l'objet caché à partir des signaux mmWave réfléchis. Ensuite, il transmet cette reconstruction incomplète à un modèle génératif, qui propose ce à quoi pourrait ressembler la forme complète. Enfin, il affine de manière itérative les surfaces jusqu'à obtenir une reconstruction finale cohérente.

Le point le plus intéressant, d'un point de vue technique, est la manière dont l'équipe a résolu le problème de l'entraînement. Les modèles d'intelligence artificielle générative fonctionnent bien lorsqu'ils disposent de grandes quantités de données d'entraînement. GPT, Claude, Llama : tous reposent sur des jeux de données aux dimensions astronomiques. Mais il n'existe pas de jeu de données suffisamment vaste de scans mmWave d'objets cachés, et en construire un ex nihilo aurait nécessité, comme l'explique Maisy Lam, l'une des chercheuses impliquées, littéralement des années de collecte de données. L'équipe a donc adopté une stratégie indirecte : elle a pris les grands jeux de données existants de vision par ordinateur, ceux contenant des millions d'images 3D d'objets communs, et les a transformés pour simuler les propriétés physiques de la réflexion mmWave, y compris la specularité et le bruit caractéristique de ces signaux. Un jeu de données synthétique mais physiquement précis, construit grâce à un processus qui incorpore directement la physique des ondes dans les images d'entraînement.

Les résultats sont solides. Wave-Former a été testé sur environ 70 objets du quotidien — canettes, boîtes, couverts, fruits — cachés derrière ou sous différents matériaux : carton, bois, placoplâtre, plastique, tissu. Par rapport aux méthodes précédentes considérées comme l'état de l'art, le système a obtenu une amélioration de près de 20 % de la précision de la reconstruction, mesurée avec la métrique Chamfer error, qui quantifie l'écart entre la forme reconstruite et la forme réelle.

RISE : les fantômes qui dessinent les pièces

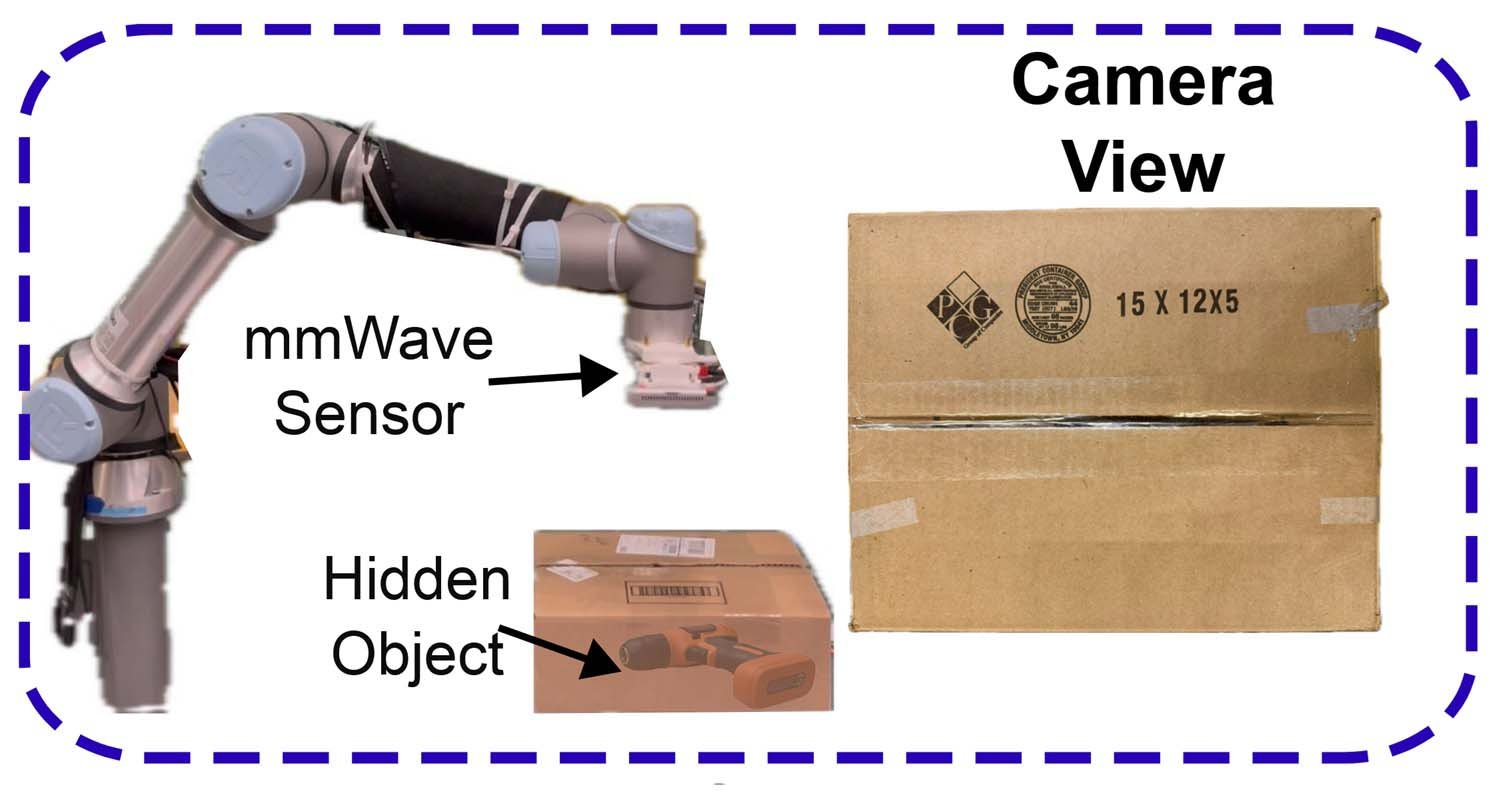

Le second système présenté dans les articles s'appelle RISE, et pousse le concept encore plus loin. Au lieu de reconstruire des objets cachés individuellement, RISE reconstruit des pièces entières, y compris tous les meubles présents, en utilisant un seul radar fixe et sans qu'aucun capteur ne se déplace dans l'environnement.

Le mécanisme qu'il exploite est contre-intuitif. Lorsqu'une personne se déplace dans une pièce, les ondes mmWave émises par le radar ne rebondissent pas seulement sur la personne : certaines ondes réfléchies par la figure humaine rebondissent ensuite sur un mur ou sur un meuble, et seulement après atteignent le capteur. Ces réflexions secondaires, appelées signaux « fantômes » parce qu'elles apparaissent comme des copies décalées de la source originale, sont généralement ignorées ou filtrées comme du bruit. Elles contiennent pourtant des informations précieuses : comme leur position change pendant que la personne se déplace, et comme leur trajectoire dépend de la géométrie de la pièce, en analysant comment elles varient dans le temps, il est possible d'inférer où se trouvent les murs et les meubles.

Le problème est que cette inférence directe produit des reconstructions très grossières et imprécises. C'est là qu'intervient le modèle génératif : comme dans le cas de Wave-Former, le système utilise l'IA pour prendre une carte grossière de l'environnement et l'affiner jusqu'à obtenir une représentation crédible de la pièce. RISE a été validé sur plus de 100 trajectoires humaines enregistrées dans des environnements réels, avec un seul radar statique. L'amélioration par rapport aux méthodes précédentes est encore plus marquée : les reconstructions s'avèrent en moyenne deux fois plus précises que celles obtenues avec les techniques préexistantes.

Le laboratoire de l'impossible et son fondateur

Derrière ces résultats se trouve le Signal Kinetics Group, que Fadel Adib dirige au MIT Media Lab. Adib est un chercheur libano-américain, diplômé de l'Université américaine de Beyrouth avec la moyenne la plus élevée de l'histoire enregistrée numériquement de l'université, puis titulaire d'un master et d'un doctorat au MIT. Sa thèse de doctorat, qui lui a valu l'ACM SIGMOBILE Dissertation Award, portait déjà sur la vision à travers les murs en utilisant le Wi-Fi. De ce travail est née Emerald Innovations, une startup dont les dispositifs sont aujourd'hui utilisés pour le suivi médical à distance de milliers de patients.

Le curriculum d'Adib est le genre de liste qui en devient presque agaçante par sa densité : entre Forbes 30 Under 30, Technology Review's 35 Innovators Under 35, Sloan Research Fellowship, ACM SIGMOBILE Rockstar Award, ACM MobiCom Best Paper Award, ONR Young Investigator Award et NSF CAREER Award, il a également eu le privilège plutôt rare de présenter sa recherche au président Obama lors du premier White House Demo Day en 2015. Le groupe qu'il dirige a produit, au fil des ans, des technologies allant de la navigation sous-marine sans batterie aux écouteurs de réalité augmentée avec vision à rayons X, en passant par la détection des battements cardiaques à travers les murs.

Les deux articles présentés cette semaine ont pour co-auteure principale Laura Dodds, MIT Presidential Fellow et lauréate du prix de la meilleure thèse MEng en EECS au MIT. Le groupe de travail comprend également Maisy Lam, NSF GRFP Fellow, Waleed Akbar, Yibo Cheng, et l'ancien post-doctorant Kaichen Zhou, désormais auteur principal de l'article sur RISE. Le financement provient de la NSF, du MIT Media Lab et d'Amazon.

De l'entrepôt à la salle d'opération : les applications concrètes

Le saut des reconstructions en laboratoire aux applications du monde réel est moins long qu'on ne pourrait l'imaginer. Les chercheurs eux-mêmes citent deux scénarios prioritaires, et dans les deux cas, la logique est implacable.

Dans le contexte de la logistique et des entrepôts automatisés, la capacité de vérifier le contenu d'une boîte fermée sans l'ouvrir constitue une valeur économique directe et mesurable. Aujourd'hui, une part importante des retours dans l'e-commerce est générée par des erreurs d'emballage : mauvais produit, produit manquant, produit endommagé non visible de l'extérieur. Un robot équipé d'un système comme Wave-Former pourrait vérifier le contenu de chaque boîte avant l'expédition, réduisant ainsi drastiquement ces erreurs. Amazon, parmi les financeurs de la recherche, a évidemment un intérêt dans cette direction.

Dans le contexte domestique et de la robotique de service, RISE ouvre une autre possibilité : un robot qui « sait » où se trouvent les meubles et où se trouve la personne dans la pièce, sans avoir besoin de caméras. L'avantage pour la vie privée par rapport aux systèmes basés sur la vidéo est loin d'être négligeable : les signaux mmWave ne capturent pas d'images visuelles des personnes, mais seulement leur position approximative et le profil de l'environnement. Un système d'assistance à domicile pour les personnes âgées qui fonctionne sans enregistrer de vidéo est un produit commercialement et éthiquement bien plus acceptable qu'un système qui installe des caméras dans chaque pièce.

Dans le domaine médical, les perspectives sont encore plus ambitieuses mais aussi plus lointaines pour une application immédiate. La possibilité d'obtenir des images à travers des surfaces opaques avec du matériel relativement bon marché pourrait un jour compléter ou accompagner des techniques d'imagerie comme l'échographie dans des contextes où l'accès à des machines sophistiquées est limité.

Le revers de la médaille : surveillance, vie privée et ceux qui restent derrière

Jusqu'ici, l'histoire du progrès technique dans sa version optimiste. Mais il serait malhonnête de s'arrêter là, car une technologie capable de reconstruire des environnements et des objets à travers les murs soulève des questions dérangeantes qui ne se résolvent pas par la seule bonne volonté des chercheurs.

La distinction entre « détecter la position d'une personne » et « surveiller une personne » est bien plus subtile qu'il n'y paraît. Le système RISE, dans sa forme actuelle, a besoin d'un être humain en mouvement dans la pièce pour fonctionner comme cartographe environnemental. Mais le fait que la position de la personne soit utilisée comme « sonde » pour l'environnement ne signifie pas que cette position n'est pas enregistrée. Un système qui sait où vous êtes dans votre maison, même sans caméras, est déjà un système de surveillance dans la mesure où quelqu'un a accès à ces données.

La confrontation avec le RGPD et l'AI Act européen est inévitable, et les contours ne sont pas encore définis. La réglementation européenne sur la vie privée est construite autour du concept de « donnée personnelle », qui inclut explicitement les informations relatives à la position d'une personne identifiable. Un signal radio qui localise quelqu'un dans son propre domicile entre selon toute vraisemblance dans cette catégorie, ce qui signifie que tout produit commercial basé sur ces principes devra obtenir un consentement éclairé explicite et documenté. L'AI Act, approuvé en 2024, introduit des contraintes supplémentaires sur les systèmes de « remote biometric identification », catégorie dans laquelle ces systèmes pourraient entrer s'ils sont utilisés pour identifier et suivre des personnes dans des espaces publics.

Le risque le plus concret à court terme n'est pas celui d'un gouvernement espionnant les citoyens à travers les murs de leurs maisons — scénario de régime dystopique nécessitant des ressources et des motivations extraordinaires. Le risque le plus immédiat est celui d'une utilisation non autorisée à petite échelle : un propriétaire qui installe un capteur pour surveiller ses locataires, un employeur qui suit les mouvements de ses employés dans les bureaux, un partenaire violent qui veut savoir où se trouve l'autre personne à tout moment. L'histoire des technologies de surveillance enseigne que les utilisations les plus dangereuses ne sont jamais celles imaginées par les chercheurs en phase de développement.

Il y a ensuite une question de distribution du pouvoir technologique qui mérite attention. Les technologies de détection avancée ont tendance à se diffuser d'abord parmi ceux qui ont déjà des ressources : forces de l'ordre, grandes entreprises, États dotés d'une capacité technologique élevée. Si la réglementation ne suit pas le rythme de la diffusion, cela crée une période d'asymétrie informationnelle potentiellement très problématique, où certains acteurs peuvent « voir » sans être vus. L'écart entre les pays dotés d'une forte capacité de régulation, comme l'Union européenne, et les pays où ces protections sont absentes risque de se traduire par une disparité concrète dans les protections auxquelles les citoyens peuvent s'attendre.

Vers le « foundation model » du sans-fil

Les chercheurs du MIT ne s'arrêtent pas aux résultats actuels. Adib a déclaré explicitement que l'objectif à long terme est de construire des modèles fondateurs pour les signaux sans fil, c'est-à-dire ce que GPT, Claude et Gemini représentent pour le langage et les images. Un modèle entraîné sur une variété énorme de signaux radio, capable de comprendre et d'interpréter les réflexions provenant des environnements, des objets et des corps humains avec une généralité et une flexibilité que les systèmes actuels n'ont pas.

Cette perspective est à la fois fascinante et vertigineuse. Les modèles fondateurs pour le langage ont démontré des capacités émergentes, c'est-à-dire des comportements qui n'étaient pas explicitement programmés mais qui ont émergé de l'échelle et de la diversité de l'entraînement. Un modèle analogue pour le domaine du sans-fil pourrait développer des capacités de perception environnementale que nous ne savons même pas imaginer aujourd'hui. Il pourrait aussi, comme les modèles linguistiques, s'avérer difficile à interpréter, à contrôler et à limiter à des usages spécifiques.

Le contexte concurrentiel dans lequel évolue cette recherche est vif. Il existe des approches alternatives basées sur le Wi-Fi CSI (Channel State Information), qui utilise les variations des caractéristiques du canal Wi-Fi pour inférer la présence et le mouvement de personnes, et des radars à travers les murs de type militaire, systèmes beaucoup plus coûteux et intrusifs utilisés par des forces spéciales en contextes opérationnels. La recherche du groupe Adib se distingue par l'accent mis sur du matériel relativement bon marché, des signaux déjà présents dans l'environnement et des techniques de traitement de plus en plus sophistiquées. La startup Cartesian Systems, cofondée par Adib, semble orientée vers l'amener de ces technologies vers des applications commerciales, bien que les détails spécifiques sur le produit ne soient pas encore publics.

Des lunettes à rayons X, enfin

Il y a quelque chose de circulaire, et de vaguement émouvant, dans le fait que la technologie ait mis cinquante ans pour tenir une promesse faite sur papier glacé à un garçon avec 7 200 lires en poche. Les lunettes de L'Intrepido étaient une arnaque, mais elles étaient aussi un symptôme : la perception augmentée, le voir au-delà du visible, est un désir si ancré dans l'imaginaire humain qu'il résiste à toute désillusion.

Wave-Former et RISE ne sont pas des produits commerciaux, ils ne sont pas prêts pour le marché et ils ne sont pas sans limites techniques ni implications éthiques non résolues. Ils sont pourtant quelque chose de plus solide qu'une promesse : ce sont des résultats reproductibles, mesurables, présentés devant la communauté scientifique internationale. Le saut qualitatif introduit par l'intelligence artificielle générative, la capacité de compléter ce que la physique seule ne parvient pas à voir, est authentique.

La question qui reste ouverte n'est pas technique. C'est la question qui accompagne chaque technologie de perception depuis que la surveillance existe : qui a le droit de voir quoi, et avec quelle autorisation ? Le MIT a construit un outil extraordinaire. Il appartient aux législateurs, aux entreprises et aux citoyens de décider dans quel monde l'utiliser. Car cette fois, contrairement aux petites lunettes en carton, cela fonctionne vraiment.