KI-Agenten arbeiten. Und die Rechnung geht auf

Von der Begeisterung zur Produktion

Im neuen DigitalOcean-Bericht, der im Februar 2026 veröffentlicht wurde, findet sich eine Zahl, die sich selbst zu widersprechen scheint. Der Prozentsatz der Unternehmen, die angeben, künstliche Intelligenz zu nutzen, ist leicht *gesunken, von 79 % im Jahr 2024 auf 77 %. Dennoch hat sich im gleichen Zeitraum der Anteil derer, die KI tatsächlich in ihre Prozesse implementieren, fast verdoppelt – von 13 % auf 25 %. Ein Paradoxon nur dem Anschein nach. Diese 2 % weniger sind kein Rückzug, sondern eine Bereinigung. Nach der Phase des technologischen Tourismus, in der alle experimentierten, aber nur wenige bauten, gehört das Feld nun denen, die es ernst meinen.*

Der Bericht mit dem Namen Currents ist eine regelmäßige Untersuchung, die DigitalOcean zum Stand der künstlichen Intelligenz in wachsenden Technologieunternehmen durchführt. Die Ausgabe vom Februar 2026 basiert auf über 1.100 Antworten, die zwischen Oktober und November 2025 von Entwicklern, technischen Leitern und Gründern aus 102 Ländern gesammelt wurden. Am stärksten vertreten sind die USA mit 28 %, gefolgt von Großbritannien mit 7 %, Kanada mit 6 %, Indien mit 4 %, Deutschland und den Niederlanden mit jeweils 3 % und Italien mit 2 %. Eine breite, vielfältige und ausreichend globale Stichprobe, um einen glaubwürdigen Überblick über den Stand der Technik zu bieten.

Die Kernbotschaft ist unmissverständlich: Wir sind in eine neue Phase eingetreten. 52 % der befragten Unternehmen befinden sich heute in einer der drei fortgeschrittensten Phasen auf dem Weg mit künstlicher Intelligenz: aktive Implementierung, Leistungsoptimierung oder Übernahme als zentrales Element ihrer Strategie. Im Jahr 2024 lag dieser Wert noch bei 35 %. Siebzehn Prozentpunkte in zwölf Monaten sind keine schrittweise Entwicklung, sondern ein Sprung.

Modelle werden nicht gebaut, sie werden genutzt

Einer der am stärksten diskutierten Punkte in der öffentlichen Debatte über künstliche Intelligenz betrifft ein Dilemma, vor dem jedes Unternehmen früher oder gare später steht: eigene Modelle bauen, um die volle Kontrolle über Daten und Infrastruktur zu behalten, oder auf externe Anbieter setzen und damit Risiken in Kauf nehmen, die Abhängigkeit, Datensouveränität und Vertraulichkeit betreffen. Die Daten des Berichts lösen das Dilemma nicht auf, zeigen aber deutlich, welche Entscheidung in der Praxis gewinnt.

Nur 15 % der Befragten beschäftigen sich hauptsächlich damit, Modelle von Grund auf neu zu trainieren. Für alle anderen liegt die Arbeit woanders: 64 % integrieren Programmierschnittstellen von Drittanbietern in ihre Anwendungen, und 61 % nutzen eine Kombination verschiedener Tools anstatt einer einzigen integrierten Lösung. Künstliche Intelligenz ist für die überwiegende Mehrheit derer, die sie tatsächlich nutzen, zu einem Dienst geworden, mit dem man sich verbindet, und nicht zu einer Technologie, die man selbst bauen muss.

Diese Verschiebung hat einen präzisen Namen: Inferenz. Während das Training die Phase ist, in der ein Modell lernt – teuer, langwierig und wenigen Laboren vorbehalten –, ist die Inferenz die Phase, in der dieses Modell genutzt wird, um Antworten zu generieren, Dokumente zu analysieren, Code zu schreiben oder Kunden zu antworten. Hier konzentriert sich mittlerweile der Großteil der Investitionen: 44 % der Befragten geben zwischen 76 % und 100 % ihres KI-Budgets speziell für die Inferenz aus. Der Vergleich mit dem Wechsel in die Cloud vor einem Jahrzehnt drängt sich auf: Auch damals hörte die Mehrheit auf, sich um Hardware zu kümmern, und lernte, mit Remote-Diensten zu arbeiten. Die künstliche Intelligenz durchläuft gerade dieselbe Phase.

Die versteckten Kosten der Intelligenz

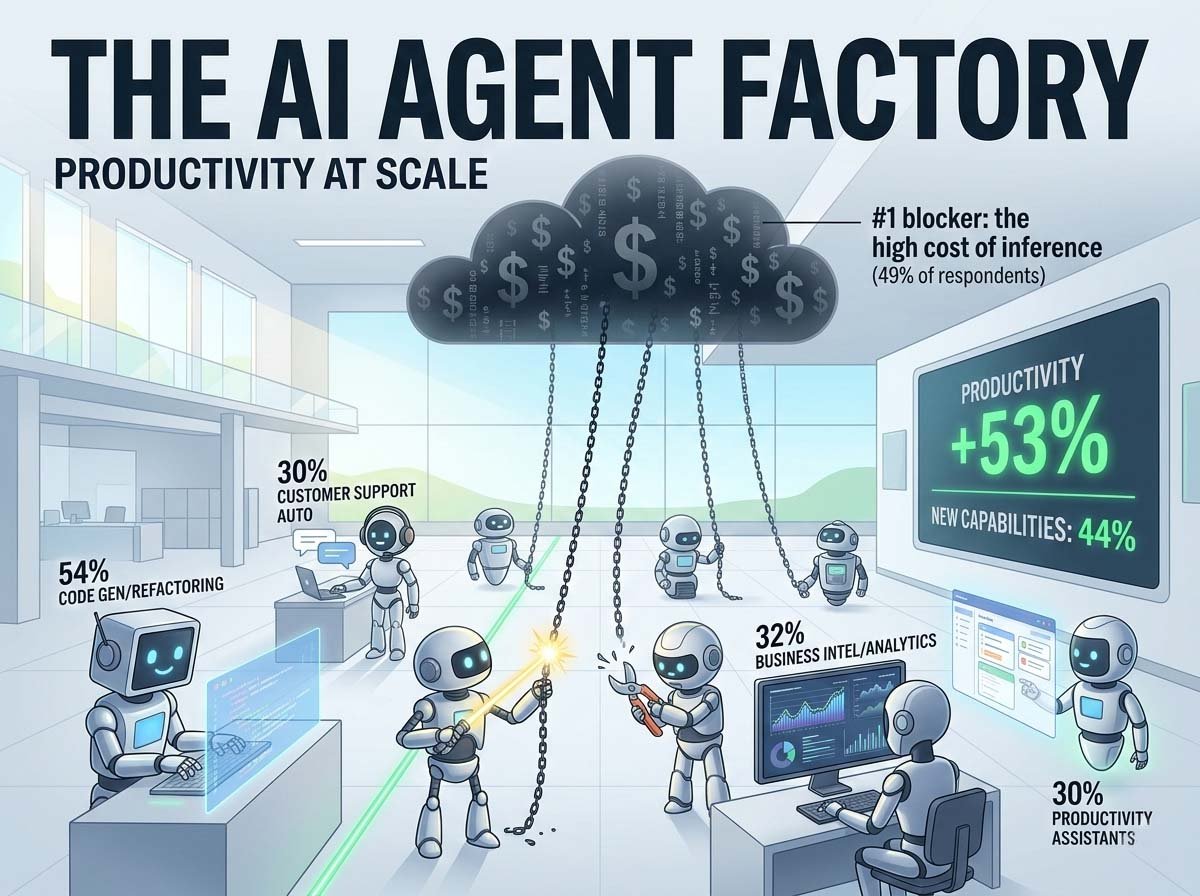

Wenn es ein Hindernis gibt, das aus dem Bericht deutlich hervorgeht, dann sind es die Kosten für die Inferenz in großem Maßstab. 49 % der Befragten identifizieren diese als das Haupthindernis für das Wachstum ihrer KI-Nutzung. Nicht die technische Komplexität, nicht die rechtlichen Risiken: die Kosten.

Wenn ein auf Sprachmodellen basierendes System in die Produktion geht und täglich Tausende oder Millionen von Anfragen beantworten muss, steigt die Rechnung auf eine Weise, die nicht immer vorhersehbar ist. Und Vorhersehbarkeit ist laut den Daten eine der am stärksten empfundenen Sorgen. Für diejenigen, die mehrere Tools und verschiedene Anbieter nutzen, vervielfachen sich die Probleme: 50 % der Befragten, die mit multiplen Infrastrukturen arbeiten, berichten von der Notwendigkeit, separate Schnittstellen zu verwalten, 49 % haben Schwierigkeiten, die Kosten vorherzusagen, und 48 % stoßen auf Probleme bei der Orchestrierung und Bereitstellung der Systeme.

Nur 23 % der Befragten arbeiten mit einem einzigen Anbieter zusammen, der Modelle, Daten und Infrastruktur integriert. Alle anderen müssen mit einer fragmentierten Lieferkette zurechtkommen, in der jedes Teil spezifische Kompetenzen, Verträge und Aufmerksamkeit erfordert. Künstliche Intelligenz ist, zumindest in ihrer jetzigen Phase, kein schlüsselfertiges Produkt: Sie ist eine permanente Baustelle, mit allem, was das an Komplexität im Management mit sich bringt.

Wer bei den Modellen das Sagen hat

Der Bericht bietet eine scharfe Momentaufnahme der meistgenutzten Sprachmodelle, und die Zahlen bestätigen einige Vermutungen, halten aber auch Überraschungen bereit.

OpenAI behält eine dominierende Stellung bei: 72 % der Befragten nutzen deren Modelle. Der Vorteil des Pioniers schlägt sich immer noch in bedeutenden Marktanteilen nieder. Doch der Vorsprung schrumpft: Google liegt bei 50 %, Anthropic bei 47 %. Beide haben schnell Boden gutgemacht, und der Abstand zum Marktführer ist nicht mehr gewaltig.

Die eigentliche Überraschung kommt aus der Welt der offenen Modelle. Meta mit Llama und DeepSeek erreichen beide 21 %. DeepSeek ist besonders bemerkenswert: Es kam erst Ende 2024 auf den Markt und hat bereits das gleiche Adoptionsniveau wie Llama erreicht, das einen jahrelangen Vorsprung hat. Open-Source-Modelle bieten konkrete Vorteile: Flexibilität bei der Anpassung, keine Abhängigkeit von einem einzelnen Anbieter, die Möglichkeit, auf eigener Infrastruktur zu laufen, ohne Daten an Dritte zu senden. Für viele Unternehmen, insbesondere in Kontexten, in denen Vertraulichkeit entscheidend ist, sind sie keine Notlösung, sondern eine bewusste Strategie. Der Markt für Modelle ist weder ein Monopol noch ein Turm zu Babel: Es ist ein sich schnell entwickelndes Oligopol, in dem diejenigen, die auf einen einzigen Anbieter setzen, ein strategisches Risiko eingehen, das viele lieber vermeiden.

Agenten: Was sie sind, was sie tun, wie gut sie funktionieren

Das Wort „Agent“ ist vielleicht das am stärksten strapazierte Wort im technologischen Vokabular der letzten zwölf Monate. Es lohnt sich, es präzise zu definieren.

Ein KI-Agent ist ein System, das in der Lage ist, Aufgaben autonom auszuführen, Entscheidungen zu treffen und Handlungen vorzunehmen – Informationen suchen, Code schreiben, Nachrichten senden, Archive aktualisieren –, ohne dass jeder einzelne Schritt menschliches Eingreifen erfordert. Der Unterschied zu einem einfachen Konversationsassistenten ist erheblich: Ein Assistent beantwortet Fragen, ein Agent tut Dinge. Es ist der Unterschied zwischen einem Navigationssystem, das anzeigt, wo man abbiegen muss, und einem Auto, das selbst fährt.

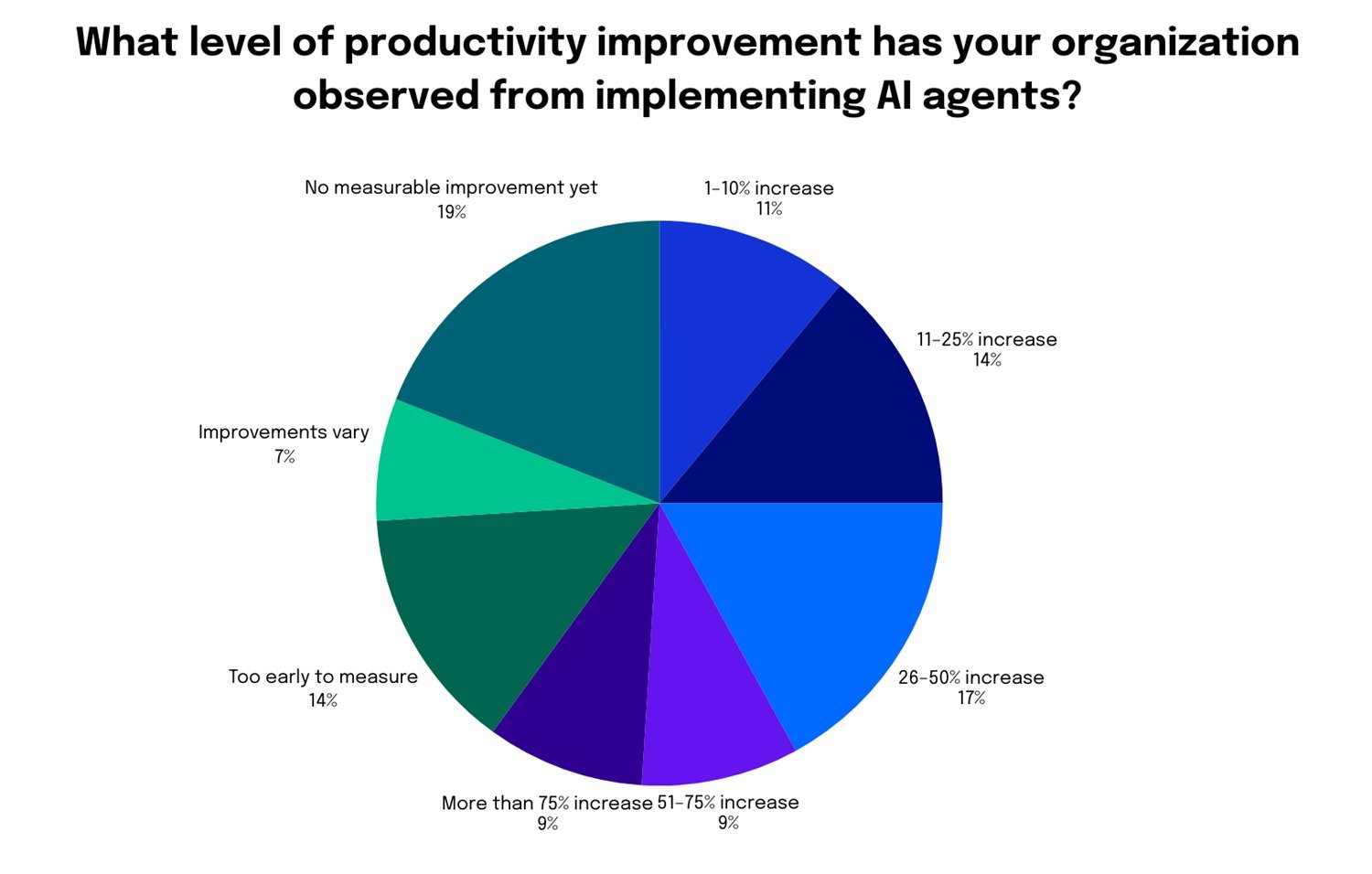

Die Daten zeigen, dass diese Technologie aufgehört hat, nur ein Versprechen zu sein. 53 % der Unternehmen, die Agenten einsetzen, haben Zeitersparnisse und Produktivitätssteigerungen beobachtet. 44 % verzeichneten die Schaffung neuer operativer Fähigkeiten, die sie zuvor nicht anbieten konnten. 32 % haben den Bedarf an Neueinstellungen reduziert. Insgesamt stellten 67 % derjenigen, die Agenten eingeführt haben, irgendeine Form von Produktivitätsverbesserung fest: 25 % im Bereich von 1-25 %, 17 % zwischen 26 % und 50 %, 9 % zwischen 51 % und 75 % und weitere 9 % mit Gewinnen von über 75 %.

Dies sind Zahlen, die für sich sprechen, aber sie sollten mit der nötigen Vorsicht gelesen werden. 14 % haben noch keine konkreten Vorteile gesehen. Und vor allem bleibt der Grad der Autonomie, der Agenten tatsächlich gewährt wird, in den meisten Fällen eher begrenzt. Nur 10 % der Befragten haben vollständig autonome Agenten in der Produktion. 40 % lassen immer noch alle Ergebnisse von einem Menschen überprüfen. 58 % nutzen menschliche Freigabeprozesse als wichtigste Kontrollmaßnahme. Agenten arbeiten, aber unter Aufsicht.

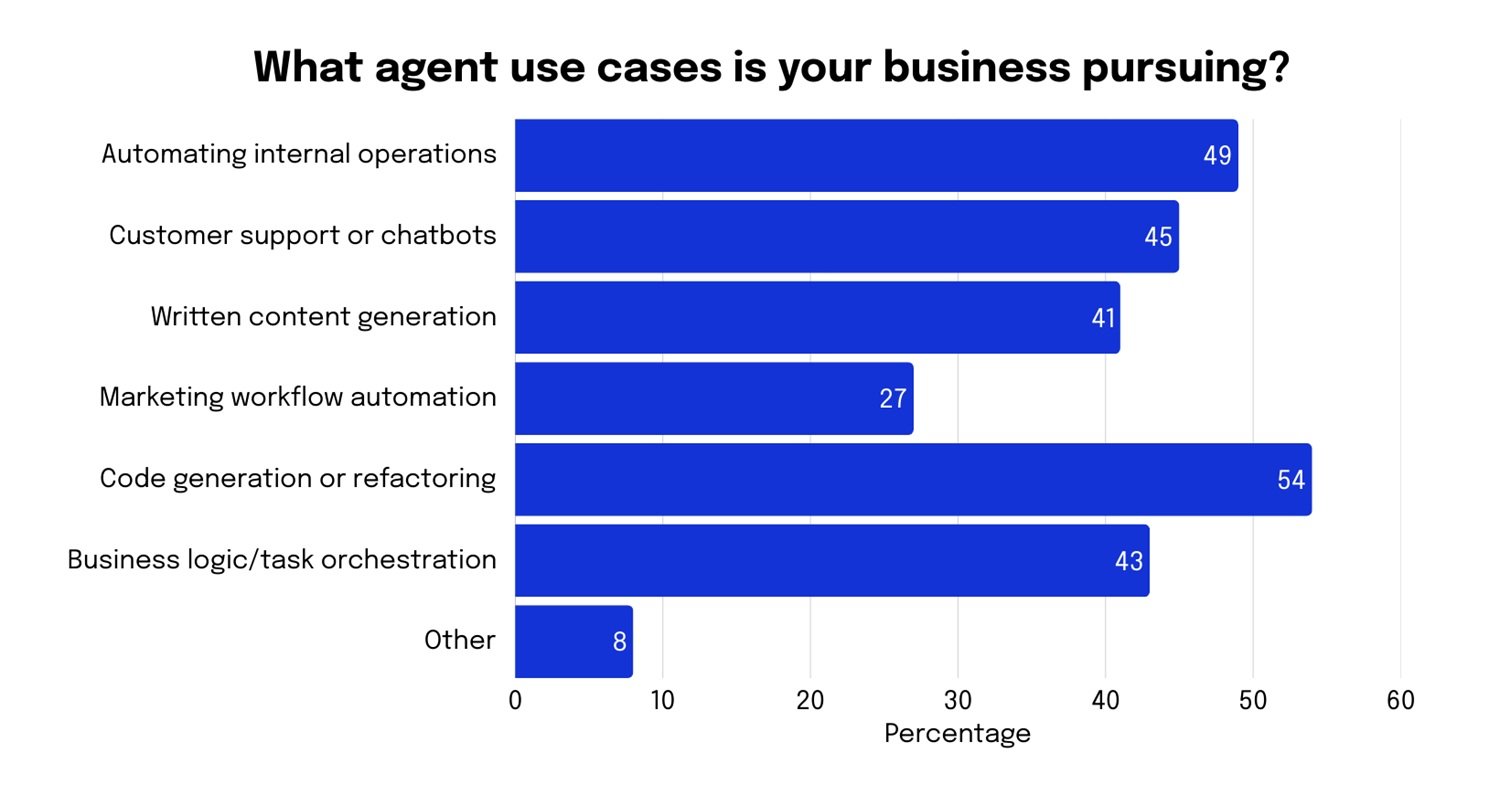

Die am weitesten verbreitete Art von Agenten ist diejenige, die auf eine einzelne Aufgabe spezialisiert ist (44 %), gefolgt von Agenten, die mehrere Aufgaben verwalten können (29 %), und Systemen, in denen mehrere Agenten miteinander kollaborieren (17 %). Der beliebteste Anwendungsfall, der von 54 % der Befragten genannt wurde, ist das Generieren und Umschreiben von Code: keine Überraschung, da die Stichprobe überwiegend aus Entwicklern besteht. Es folgen Datenanalyse (41 %), Automatisierung des Kundensupports (40 %), Informationssuche und -zusammenfassung (39 %) sowie die Verwaltung interner Workflows (38 %).

Es gibt jedoch eine Zahl, die über einzelne Anwendungsfälle hinausgeht und etwas Strukturelles verrät: 60 % der Befragten identifizieren Anwendungen und Agenten als die Ebene des Technologie-Stacks mit dem größten langfristigen Wert. Nicht die Infrastruktur (nur 19 %), nicht die Entwicklungsplattformen (17 %). Dies ist ein klares Signal dafür, wo der Markt glaubt, dass die eigentliche Entscheidung fällt: nicht im Besitz von Rechenleistung oder den zugrunde liegenden Modellen, sondern im Bau der Systeme, die sie auf nützliche und messbare Weise zum Einsatz bringen. Es ist der Unterschied zwischen dem Besitz eines Kraftwerks und der Fähigkeit, die Haushaltsgeräte zu bauen, die die Menschen wirklich benutzen wollen.

Die Schere geht auseinander: Wer jetzt erst startet, läuft Gefahr, nur hinterherzuhinken

Eine der deutlichsten Botschaften des Berichts betrifft den wachsenden Abstand zwischen denen, die KI bereits in ihre Prozesse integriert haben, und denen, die noch abwarten. 50 % der Befragten geben an, mit Agenten zu experimentieren oder diese bereits einzusetzen. Doch von diesen haben nur 10 % sie systematisch integriert. 33 % befinden sich in der Phase kleiner Experimente, 28 % erkunden noch grundlegende Konzepte und 23 % haben die ersten realen Workloads gestartet.

Unter denen, die noch keine Agenten einsetzen, sind die Aussichten für 2026 besorgniserregend. 44 % geben an, keine Pläne zu haben, mit ihnen zu experimentieren. Nur 26 % haben Tests oder Pilotprojekte geplant. Der Grund, warum diese Kluft sich zu vertiefen droht, liegt in der Natur des organisatorischen Lernens selbst. Die Einführung von KI ist nicht wie die Installation eines Programms: Sie erfordert Monate des Experimentierens, der Anpassungen, des Aufbaus interner Kompetenzen und der Überprüfung von Prozessen. Wer jetzt beginnt, hat bereits einen strukturellen Rückstand gegenüber denen, die vor einem Jahr angefangen haben. Dieselbe Dynamik war bei der Einführung des E-Commerce, der Cloud und der sozialen Medien zu beobachten: Unternehmen, die frühzeitig darauf gesetzt haben, bauten Vorsprünge auf, die nur schwer aufzuholen waren.

37 % der Befragten planen, das Budget für Anwendungen und Agenten in den nächsten zwölf Monaten zu erhöhen – die am häufigsten genannte Investitionskategorie überhaupt. Und 38 % derer, die noch keine Experimente gestartet haben, geben an, dass sie 2026 damit beginnen werden. Aber Planen ist nicht gleich Tun, und die Geschichte großer technologischer Transformationen ist voll von Absichten, die nicht in Taten umgesetzt wurden.

Die zu lösenden technischen Probleme

Der DigitalOcean-Bericht bietet eine präzise Momentaufnahme des aktuellen Stands, doch einige Fragen bleiben unbeantwortet und werden die Branche das gesamte Jahr 2026 über begleiten.

Die erste betrifft die Zuverlässigkeit. 41 % der Befragten identifizieren gerade die mangelnde Vorhersehbarkeit von Agenten als Haupthindernis für deren Verbreitung. Ein System, das Handlungen in der realen Welt ausführt, Archive aktualisiert, Nachrichten sendet und Operationen ausführt, muss konsistent sein. Aktuelle Modelle haben enorme Fortschritte gemacht, aber sie haben noch nicht die Schwelle erreicht, die viele produktive Anwendungsfälle erfordern. Auch deshalb behalten 40 % immer noch eine systematische menschliche Kontrolle bei: nicht aus philosophischer Überzeugung, sondern aus praktischer Notwendigkeit. 31 % der Befragten nennen zudem die Integration in bestehende Anwendungen als zweites Haupthindernis: Unternehmen fangen nicht bei Null an, sie haben über Jahre, oft Jahrzehnte aufgebaute Managementsysteme, Archive und Abläufe. Einen intelligenten Agenten mit diesem Ökosystem zu verbinden, erfordert Zeit, Kompetenz und gründliche Tests, um zu verhindern, dass das neue System unerwartetes Verhalten einführt.

Die zweite Frage ist die der Machtkonzentration. Drei Anbieter – OpenAI, Google, Anthropic – kontrollieren zusammen den dominierenden Anteil der weltweit genutzten Modelle. Wenn diese Modelle zur kritischen Infrastruktur für Millionen von Unternehmen werden, verwandeln sich die Entscheidungen, die diese drei Akteure über Preise, Zugang, Inhaltszensur und Nutzungsbedingungen treffen, de facto in eine Industriepolitik, die von niemandem gewählt wurde. Offene Modelle wie Llama und DeepSeek bieten eine konkrete Alternative, erfordern aber Bereitstellungskompetenz und Infrastrukturressourcen, die sich nicht alle Organisationen leisten können. Die Abhängigkeit ist kein theoretisches Risiko: Sie ist in den Daten bereits sichtbar, und die Tatsache, dass nur 21 % der Befragten offene Modelle nutzen, signalisiert, wie schwierig es in der Praxis ist, sich vom kommerziellen Triumvirat zu befreien.

Arbeit, Europa und die bleibenden Fragen

Die dritte Frage ist die nach der Arbeit. 32 % derer, die Agenten einsetzen, haben bereits den Bedarf an Neueinstellungen reduziert. Die im Bericht dokumentierten Produktivitätsgewinne lassen sich nicht automatisch in allgemeinen Wohlstand übersetzen. Wenn die Einsparungen in den am stärksten kapitalisierten Unternehmen konzentriert bleiben, wird sich die Kluft zwischen den Gewinnern und Verlierern der Transformation weiter vergrößern. Wenn dieselbe Produktivität stattdessen genutzt wird, um das Angebot zu erweitern, neue Märkte zu erschließen und zuvor unzugängliche Dienstleistungen anzubieten, kann der Effekt auch für die Arbeitnehmenden positiv sein. Die Technologie entscheidet nicht: Es entscheiden die Organisationen, die öffentliche Politik und die Entscheidungen derer, die über wirtschaftliche Macht verfügen.

Für Italien und Europa, die in der Stichprobe vertreten, aber nicht dominierend sind, bleibt die Frage offen, wie die Dringlichkeit der Einführung dieser Technologien mit einem komplexen regulatorischen Umfeld in Einklang gebracht werden kann. Die europäische KI-Verordnung, die 2024 in Kraft getreten ist, legt Anforderungen an Konformität, Transparenz und Risikobewertung fest, die viele Unternehmen immer noch zu interpretieren versuchen. Die Gesetzgebung ist an sich keine Bremse für die Entwicklung, erfordert aber Investitionen in rechtliche und Governance-Kompetenzen, die zu den technischen hinzukommen und die Gesamtkosten für den Einstieg erhöhen. Für kleine und mittlere italienische Unternehmen, das Rückgrat der nationalen Produktionsstruktur, ist das Hindernis nicht nur wirtschaftlicher oder regulatorischer Natur, sondern auch organisatorisch: Der Einsatz fähiger Agenten erfordert die Bereitschaft, etablierte Prozesse in Frage zu stellen, eine Toleranz für Experimente und Fehler sowie die Fähigkeit, technische Profile anzuziehen, die der italienische Arbeitsmarkt nur schwer in ausreichender Menge hervorbringt. Die Zahl von 2 % der italienischen Befragten in der Stichprobe sollte nicht als Zeichen von Desinteresse gelesen werden, sondern wahrscheinlich als Spiegelbild einer noch peripheren Beteiligung an Gesprächen, die anderswo stattfinden.

Das Jahr 2026 ist den Daten zufolge das Jahr, in dem viele Unternehmen vom Experimentieren zur Produktion übergehen werden. Es ist auch das Jahr, in dem einige dieser Fragen konkrete Antworten erhalten werden – nicht immer die, die man sich erhoffen würde. Die Zahlen ehrlich zu betrachten, so wie dieser Bericht es versucht, ist zumindest ein guter Ausgangspunkt.