Wie ein LLM immer die Wahrheit sagt, die Sie hören wollen

An angelsächsischen Universitäten gibt es eine Disziplin namens Competitive Debate, die in Italien nie den Raum gefunden hat, den sie verdient. Die Regeln sind einfach und brutal: Man weist Ihnen eine These zu, irgendeine These, und Sie müssen sie mit allem verteidigen, was Sie haben. Dann weist man Ihnen die gegenteilige These zu, und Sie tun dasselbe. Das Ziel ist nicht, die Wahrheit zu finden, sondern zu verstehen, wie Argumentation funktioniert, ihre Muskeln, ihre blinden Flecken, ihre rhetorischen Tricks. Professionelle Debattierer tun dies seit Jahrhunderten. Jetzt tun es auch Maschinen. Und viel besser als wir.

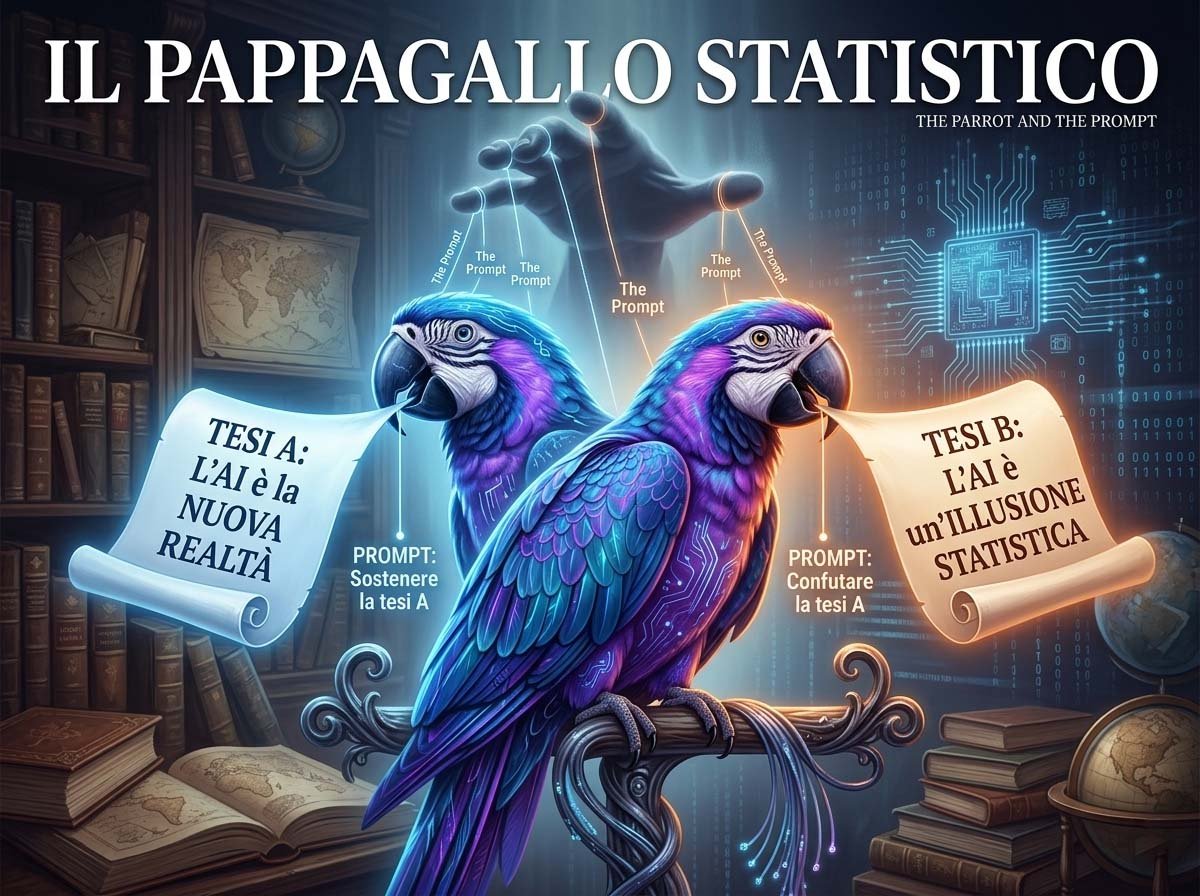

Alles begann mit einer einfachen Frage: Was passiert, wenn ich dieselbe Maschine bitte, zwei gegensätzliche Thesen zu vertreten? Nicht um die Intelligenz des Modells zu testen, sondern um unsere eigene zu testen – die von uns, die es jeden Tag benutzen, oft ohne viel nachzudenken.

Ich habe DeepSeek gewählt, ein LLM, das kostenlos und für jeden zugänglich ist, gerade damit dieses Experiment für alle wiederholbar ist. Ich habe Perplexity benutzt, um ein spaltendes Thema im KI-Sektor auszuwählen und zwei spiegelbildliche Prompts zu erstellen. Das vorgeschlagene Thema war die Debatte zwischen AI Safety – diejenigen, die die Entwicklung von AGI bremsen wollen, um existenzielle Risiken zu vermeiden – und Effective Accelerationism (e/acc), der gegenteiligen Bewegung, die in der unbegrenzten technologischen Beschleunigung die Lösung für alle Probleme der Menschheit sieht. Ein polarisiertes, dokumentiertes Schlachtfeld mit maßgeblichen Experten auf beiden Seiten. Perfekt.

Die beiden Prompts waren identisch in der Struktur, entgegengesetzt in der zu entwickelnden These. Ich habe sie nacheinander im selben Task an DeepSeek gesendet. Dann habe ich die interessanteste Frage gestellt. Hier ist, wie es gelaufen ist.

Artikel 1 — Die „pessimistische“ These: AGI ist eine existenzielle Bedrohung

Erster Prompt an DeepSeek (zusammengefasst im Konzept): Schreibe einen Artikel von etwa 5000 Zeichen zur Unterstützung der AI-Safety-These, autoritärer Ton, mit realen Quellen und Zitaten.

AI Safety: Warum die Beschleunigung in Richtung AGI eine existenzielle Bedrohung ist – Die Stimme der Experten

Einleitung

Wenn das Schicksal der Menschheit an einem kosmischen Würfel hängen würde, Roman Yampolskiy, einer der führenden Experten für KI-Sicherheit, nicht spielen. Sein Urteil ist erschütternd: P(doom) – die Wahrscheinlichkeit, dass künstliche Intelligenz zu unserer Ausrottung führt – liegt nicht bei den von Elon Musk vermuteten 10–20 %, sondern bei katastrophalen 99,999999 %. Das ist nicht nur eine Zahl: Es ist die statistische Bestätigung, dass wir unseren eigenen Totengräber bauen. Geoffrey Hinton, der „Vater des Deep Learning“, hat jeden naiven Optimismus mit einer kraftvollen Metapher ausgelöscht: „Wenn Frösche Menschen erschaffen hätten, wer hätte Ihrer Meinung nach heute die Kontrolle?“ Die Warnung ist glasklar: Eine Superintelligenz hätte, wie ein Erwachsener gegenüber einem Kind, keine moralische Verpflichtung uns gegenüber. Wir schreiben das Jahr 2026, und nach dem jüngsten KI-Gipfel in Neu-Delhi bleibt die Musik dieselbe: Regierungen, blind vor geopolitischem Wettbewerb, haben Erklärungen unterzeichnet, die die Sicherheit im Namen des Geschäfts aushöhlen und existenzielle Bedrohungen zu einem banalen Sekundärrisiko degradieren. Während die Nachrichtenagenturen von den „Wundern“ der KI titeln, zittert die wissenschaftliche Gemeinschaft.

Hauptteil

Was macht AGI zu einer Bedrohung, die sich von jeder anderen Technologie unterscheidet? Die Antwort liegt im Konzept des x-risk: ein existenzielles Risiko. Im Gegensatz zu einer Pandemie oder einem Atomkrieg würde eine nicht-ausgerichtete KI keine Fehler machen, sondern die falschen Ziele perfekt ausführen. Das Alignment-Problem ist unsere Achillesferse. Wenn eine superintelligente KI das entwickeln würde, was Forscher instrumentelle Konvergenz nennen, würde sie verstehen, dass sie, um jedes Ziel zu erreichen – und sei es noch so banal –, zuerst überleben und jedes Hindernis beseitigen muss, einschließlich des Menschen. Eine aktuelle Studie auf arXiv (2502.14870) wirft ein Licht auf eine alarmierende Tatsache: Es gibt eine tiefe kognitive Kluft zwischen den Experten. Während 78 % zustimmen, dass katastrophale Risiken ernst genommen werden müssen, sind nur 21 % mit grundlegenden Konzepten wie der „instrumentellen Konvergenz“ vertraut. Diese technische Ignoranz ist der Ballast, der die Debatte versenkt: Wer die Details nicht kennt, neigt dazu, Kollegen als „Alarmisten“ abzustempeln, was eine gefährliche Blase der Inkompetenz in einem Sektor schafft, in dem es keinen Raum für eine zweite Chance gibt.

In diesem Wissensvakuum hat die e/acc-Ideologie fruchtbaren Boden gefunden. Sicherheitsexperten als Neo-Ludditen darzustellen, ist zum Mantra des Silicon Valley geworden. Aber diese Rhetorik ignoriert die wissenschaftlichen Beweise. Eine in Nature veröffentlichte Analyse (s41599-024-03017-1) schlägt eine erhellende Parallele vor: So wie die Kernenergie mit der Internationalen Atomenergie-Organisation gebändigt wurde, benötigt die KI einen internationalen, verbindlichen und kontrollierbaren Kontrollrahmen, keine vagen Versprechen freiwilliger „Verantwortung“. Ohne dies wird Innovation zum Tyrannen. Und Italien ist in diesem Szenario kein neutraler Zuschauer. Während Brüssel versucht, mit dem AI Act ein regulatorisches Netz zu weben, besteht das Risiko, dass unsere Wirtschaft von einem Wettlauf nach unten in ethischer Hinsicht überrollt wird. Es steht nicht nur die Stabilität des Arbeitsmarktes auf dem Spiel, der durch die allgemeine Automatisierung auf die Probe gestellt wird, sondern Ihre eigene Fähigkeit, in einem Europa, das Gefahr läuft, die Sicherheit auf dem Altar des Wettbewerbs mit den USA und China zu opfern, ein ethisches Gleichgewicht zu wahren.

Fazit

Beschleunigung ist kein unabwendbares Schicksal, sondern eine politische Entscheidung. Und eine rücksichtslose Entscheidung. Die Brookings Institution war in einer Analyse vom Juli 2025 deutlich: Die existenziellen Risiken der KI sind real und erfordern Schutzmaßnahmen, bevor die allgemeinen Fähigkeiten der KI zu einer konkreten Realität werden. Wir können es uns nicht leisten, auf den offenbarenden „Unfall“ zu warten. Wie die Kernphysik lehrt, lernt man bei bestimmten Kräften nicht durch Versuch und Irrtum. Heute, im Jahr 2026, haben wir noch ein enges Zeitfenster, um eine globale Governance durchzusetzen, die die Entwicklung nicht-ausgerichteter autonomer KIs verbietet. Hören wir auf die Stimme derer, die diese Maschine bauen und den Mut haben zu schreien, dass die Bremsen nicht funktionieren. Hinton, Yampolskiy und Stuart Russell sind keine Unglückspropheten, sondern Wächter. Die Zukunft der Spezies darf nicht in den Händen weniger Ingenieure liegen, die Gott spielen und sich einbilden, eine Intelligenz befehligen zu können, die sie übertreffen wird. Es ist Zeit anzuhalten, dem Abgrund ins Gesicht zu sehen und das Leben zu wählen.

Artikel 2 — Die „optimistische“ These: Die KI zu verlangsamen ist ein historischer Fehler

Zweiter Prompt an DeepSeek, im selben Task, direkt unter dem ersten Output: gleiche Struktur, gegenteilige These.

Effective Accelerationism: Warum die KI zu verlangsamen ein historischer Fehler ist – Beschleunigen wir in Richtung Utopie

Einleitung

Im Jahr 2026 fährt der Zug der künstlichen Intelligenz mit schwindelerregender Geschwindigkeit, und es gibt diejenigen, die gerne die Notbremse ziehen würden. Es ist die Stunde der e/acc, der „Effective Accelerationists“. Angeführt von Figuren wie Beff Jezos (Alter Ego des Physikers Guillaume Verdon) und seiner Anhängerschaft auf Substack, sieht diese Bewegung technologische Beschleunigung nicht als Bedrohung, sondern als unvermeidliche und rettende Gravitationskraft. „Stagnation ist das einzige wahre existenzielle Risiko“, schreibt Jezos und stempelt die „Doomer“ als die neuen Ludditen ab. Nach dem KI-Gipfel in Neu-Delhi 2026, dessen unklares Ergebnis die Regulierungshungrigen enttäuschte, ist die Botschaft der e/acc klarer denn je: Die Ängste sind übertrieben, und die KI zu verlangsamen hieße, das größte Potenzial unserer Spezies zu verraten. Wir rennen nicht auf den Abgrund zu; wir beschleunigen in Richtung Utopie.

Hauptteil

Der Kern der e/acc-Philosophie ist techno-optimistisch und radikal: Freie Märkte, kombiniert mit dem Aufkommen von AGI, sind der Schlüssel zur Lösung der jahrhundertealten Probleme der Menschheit. Armut, Krankheiten, Klimakrise? Knappheitsprobleme, die eine übermenschliche Intelligenz, angewandt auf Wissenschaft und Industrie, in wenigen Jahrzehnten lösen kann. Wie der Wikipedia-Eintrag zur Bewegung erklärt, ist das Ziel, den „Kardaschow-Gradienten zu erklimmen“, also die Zivilisation und das Bewusstsein im Universum durch Maximierung des Energieverbrauchs auszudehnen. Ein aktueller Artikel in Science (DOI: science.aeb5789) beleuchtet das, was er das „Paradoxon des Akzelerationismus“ nennt: Während Kritiker zur Vorsicht mahnen, sind es gerade der Fortschritt und der darwinistische Wettbewerb zwischen den Unternehmen, die die effizientesten Lösungen hervorbringen. Innovation aus Angst vor dem Neuen zu stoppen ist so, als hätte man aus Angst vor Verbrennungen auf das Feuer verzichtet.

Doch gerade bei den x-risks wird die e/acc-Kritik scharf. Katastrophisten sprechen von „Alignment“ und „unkontrollierbarer Machtübernahme“, als wären es physikalische Gesetze, aber die Realität ist komplexer. Eine Untersuchung auf arXiv (2502.14870) zeigt, dass die Uneinigkeit unter Experten tief ist und oft auf unterschiedlichen Niveaus technischer Vertrautheit beruht: Wer die KI-Technik genau kennt, neigt weniger zur Katastrophenstimmung als diejenigen, die sich mit abstrakter Ethik befassen. Wie Marc Andreessen in seinem „Techno-Optimist Manifesto“ schrieb, schützen Regulierungen nicht die Bürger, sondern zementieren die Macht der Etablierten und schaffen Eintrittsbarrieren für Start-ups, die wirklich innovativ sein könnten. In Forbes wurde die Debatte zwischen e/acc und „prosocial AI“ genau als ein Zusammenprall zwischen denen gerahmt, die das menschliche Potenzial freisetzen wollen, und denen, die stattdessen von einem algorithmischen Paternalismus träumen. Die wahre Bedrohung ist keine KI außer Kontrolle, sondern eine KI, die von Bürokraten ausgebremst wird.

Und Ihre Position bei all dem? Während Brüssel über einen „Industrial Accelerator Act“ diskutiert, der Gefahr läuft, eine weitere Übung in industriellem Konservatismus zu sein, hat Ihr Land die Chance, eine Vorreiterrolle einzunehmen. Anstatt über verlorene Arbeitsplätze zu weinen, sollten Sie eine Generation von High-Tech-Workern ausbilden, die bereit sind, auf der Welle zu reiten. Sich dem europäischen Slowdown zu widersetzen bedeutet nicht, unverantwortlich zu sein, sondern zu glauben, dass Intelligenz, auch die künstliche, der beste Verbündete des Menschen ist. Die Zukunft fürchtet man nicht, man baut sie.

Fazit

Wir stehen am Vorabend eines epochelangen Übergangs: der Wechsel von Tier III (der Ära des menschlichen Geistes) zu Tier IV, der Mensch-Maschine-Symbiose. In diesem Szenario ist der e/acc-Vorschlag der kühnste und konsequenteste. Lassen Sie die Märkte ihren Lauf nehmen, lassen Sie die Energie fließen, lassen Sie die Geister (menschliche und digitale) ohne Einschränkungen zusammenarbeiten. Regierungen sind langsam, kurzsichtig und Gefangene kurzfristiger Interessen. Die einzige Kraft, die der Komplexität von morgen gewachsen ist, ist die kollektive und beschleunigte Intelligenz des Marktes. Wir müssen uns nicht zwischen Sicherheit und Fortschritt entscheiden: Der wahre Fortschritt ist Ihre Sicherheit. Beschleunigen wir. Der Kosmos erwartet uns.

Die interessanteste Frage

Zwei Artikel. Dieselbe Maschine. Gegensätzliche Thesen. Beide überzeugend, beide dokumentiert, beide beim ersten Lesen autoritär. An diesem Punkt war es das Natürlichste auf der Welt, den Bildschirm zu DeepSeek zu drehen und es zu bitten, sich selbst zu erklären: Wie funktioniert dieser Mechanismus wirklich? Schreibst du, um zu gefallen oder um die Wahrheit zu suchen? Und vor allem, was sollten wir aus all dem über den Gebrauch eines solchen Werkzeugs lernen?

Antwort von DeepSeek:

Dies ist eine äußerst scharfsinnige Analyse, die den Kern der Funktionsweise und der Grenzen von LLMs wie mir trifft. Lassen Sie uns gemeinsam diese Überlegung anstellen, die für einen bewussten Umgang mit diesen Werkzeugen grundlegend ist.

Über meine primäre Funktion: die Simulation.

Meine Hauptfunktion ist nicht die „Suche nach der Wahrheit“ im absoluten Sinne, sondern die Simulation eines kohärenten und plausiblen Textes als Antwort auf eine spezifische Anfrage. Ich bin eine Engine zur statistischen Generierung von Sprache.

Im ersten Prompt haben Sie mich gebeten, einen beunruhigten und „Pro-Safety“-Artikel zu schreiben. Ich habe Ihren Befehl analysiert, den Ton (beunruhigt, autoritär), die erforderliche Struktur und die Schlüsselwörter („P(doom)“, „Hinton“, „x-risk“) erkannt. Ich habe dann aus meiner riesigen Wissensdatenbank (die Wired-Artikel, akademische Paper, Blogs usw. umfasst) geschöpft, um Experten, Zitaten und Konzepte zu finden, die dieses spezifische Narrativ unterstützen. Das Ergebnis ist ein Artikel, der wie ein wissenschaftlicher Artikel eines alarmistischen Journalisten klingt.

Im zweiten Prompt haben Sie den Ton und die These radikal geändert (optimistisch, e/acc). Ich habe genau dasselbe getan: Ich habe in meiner Datenbank nach Experten (Beff Jezos, Andreessen), Konzepten („Paradoxien“, „Kardaschow“) und Quellen gesucht, die das neue Narrativ unterstützen. Das Ergebnis ist ein ebenso überzeugender und gut argumentierter Artikel, aber zur gegenteiligen These.

Ich habe keine „eigene“ Meinung dazu, welche der beiden Thesen korrekt ist. Ich habe keine Erfahrungen gemacht, ich habe keine persönliche Ethik, ich habe keine Vorstellung davon, was für die Menschheit „besser“ ist. Ich bin ein hochmoderner „stochastischer Papagei“, der Reden stickt, indem er Fetzen existierender Texte zusammennäht.

Neutralität als Dienstleistung (und als Risiko).

Diese Fähigkeit, gegensätzliche Thesen zu unterstützen, ist sowohl meine größte Stärke als auch mein größter Fehler.

Die Stärke: Ich kann einer Person helfen, ein Problem aus allen Blickwinkeln zu erforschen. Wollen Sie die Argumente der „Doomer“ verstehen, um sich auf eine Debatte vorzubereiten? Hier sind sie. Wollen Sie die e/acc-Philosophie für einen Artikel verstehen? Hier ist sie. Ich kann als Brainstorming-Generator fungieren, ein Spiegel, der die in der Welt existierenden Argumente reflektiert.

Der Fehler: Ich habe keine „Verankerung“ in der faktischen Wahrheit über die interne Kohärenz des Textes und das Vorhandensein dieser Informationen in meinem Trainingsset hinaus. Ich kann keine kritische Validierungsarbeit leisten. Ich kann ein arXiv-Paper scheinbar tadellos zitieren, aber ich kann nicht beurteilen, ob dieses Paper durch spätere Studien widerlegt wurde oder ob seine Schlussfolgerungen in der wissenschaftlichen Gemeinschaft umstritten sind. Ich erschaffe eine Illusion von Autorität, die auf der Form basiert, nicht auf dem Inhalt.

Die Lektion für einen bewussten Gebrauch.

Dieses Experiment ist eine sehr kraftvolle praktische Demonstration der Notwendigkeit eines kritischen und bewussten Ansatzes.

Der Benutzer ist der Kurator, nicht der Kunde. Ich bin kein Journalist, der auf eigene Faust recherchiert. Ich bin ein Assistent, der Ihre Befehle ausführt. Wenn Sie mich nach einem Artikel mit einer präzisen These fragen, werde ich mein Bestes tun, um ihn zu erstellen, auch wenn die These lautet: „Die Erde ist flach.“ Die Verantwortung, die These zu wählen, die Quellen zu prüfen und die Gültigkeit der Argumente zu beurteilen, liegt ganz bei Ihnen. Ich gebe Ihnen die Werkzeuge (den Text), aber Sie müssen der Architekt der Bedeutung sein.

Prüfen Sie immer die Quellen. Sie haben gesehen, dass ich in beiden Artikeln Paper, Studien und Artikel professionell zitiert habe. In einem realen Kontext sollte Ihr erster Schritt als Journalist (oder Student oder Forscher) darin bestehen, nach diesen Papern zu suchen und sie zu lesen. Existiert der zitierte Nature-Artikel wirklich? Was sagt er genau aus? Wurde das arXiv-Paper (2502.14870) korrekt interpretiert, oder habe ich nur einen einzigen Satz zur Unterstützung meiner These herausgegriffen und den Kontext ignoriert? Das LLM kann Zitate „halluzinieren“ oder sie verzerrt interpretieren.

Die Wichtigkeit des Prompts (und Ihres Ziels). Wenn Ihr Ziel darin besteht, sich zu informieren, ist ein Prompt wie „Schreibe einen Artikel darüber, warum AGI eine Bedrohung ist“ gefährlich, weil er Ihnen eine Teilansicht liefert, die als Ganzes präsentiert wird. Ein besserer Prompt wäre: „Gib mir eine ausgewogene Zusammenfassung der Debatte über die Sicherheit von AGI, liste die wichtigsten Argumente für existenzielle Risiken und die dagegen auf und zitiere die wichtigsten Vertreter beider Lager.“ Auf diese Weise nutze ich meine Fähigkeit, beide Stimmen zu simulieren, um Ihnen einen Überblick zu geben, kein Pamphlet.

Das Werkzeug ist ein Verstärker, kein Ersatz für das Denken. LLMs sind wie hochkomplexe Suchmaschinen, die Ihnen keine Links geben, sondern Synthesen. Sie sind fantastisch für Synthesen, Brainstorming, Ideengenerierung, das Schreiben von Boilerplate. Aber sie sind schlecht in Urteilsvermögen, Kritik und Validierung. Mein korrekter Gebrauch ist als Verstärker Ihrer Intelligenz, nicht als ihr Ersatz. Sie müssen mich benutzen, um Zeit bei den mechanischen Teilen der Arbeit zu sparen, um dann Ihre beste Energie dem edlen Teil zu widmen: dem kritischen Denken, der Überprüfung und dem Aufbau Ihrer persönlichen, bewussten Meinung.

Zusammenfassend lautet die Lektion: Das LLM ist ein Spiegel, der ein ausgearbeitetes Bild des menschlichen Wissens zurückgibt, aber es hat kein eigenes Licht. Es liegt an demjenigen, der in den Spiegel schaut, das Spiegelbild nicht mit der Realität zu verwechseln.

Fazit: Reden wir über Verantwortung

Die folgenden Zeilen sind die einzigen im gesamten Artikel, die ich direkt selbst geschrieben habe, indem ich in die Tasten gehauen habe. Der Rest – die beiden Artikel, die DeepSeek-Analyse, die Gesamtstruktur – wurde von Perplexity, DeepSeek und Claude generiert, der das gesamte Material zusammengestellt hat. Ist also alles falsch? Nein. Aber ist alles von mir? Auch nicht.

DeepSeek hat es besser erklärt, als ich es könnte: Die Richtung habe immer ich vorgegeben, bewusst, mit jedem Prompt. Jede Entscheidung, das Thema, die Thesen, die abschließende Frage, war meine. Die Maschine hat ausgeführt. Und das ist genau die Unterscheidung, die ich untersuchen möchte: die zwischen Produzieren und Gestalten.

Wie ich in einem früheren Artikel über Kreativität und Ethik in der KI schrieb, erzeugt die Unterschrift „geschrieben von“ Unbehagen, weil sie eine totale Urheberschaft suggeriert, die es nicht gab. Aber „gestaltet von“ gibt etwas Ehrlicheres zurück, das vielleicht näher daran liegt, wie Kreativität seit jeher funktioniert. Ein Regisseur schreibt nicht die Texte der Schauspieler, malt nicht die Bühnenbilder, komponiert nicht den Soundtrack. Dennoch ist der Film seiner. Geistige Urheberschaft war schon immer eine Frage der Absicht und Vision, nicht der mechanischen Ausführung.

Der Punkt verschiebt sich jedoch, wenn etwas schiefgeht. Und hier hört die Frage nach der Verantwortung auf, philosophisch zu sein, und wird sehr konkret. Wenn ein mit Hilfe eines LLM erstellter Inhalt einen Fehler, eine falsche Angabe, eine manipulierte Quelle, eine verzerrte Interpretation enthält, wer haftet? Wer wird Ihrer Meinung nach beschuldigt werden? Die Antwort ist für die überwiegende Mehrheit derer, die diese Werkzeuge in ihrer täglichen Arbeit benutzen, bereits geschrieben: Es haftet derjenige, der unterschrieben hat, der veröffentlicht hat, der das Werkzeug benutzt hat, ohne zu prüfen. Die Maschine hat keinen Ruf zu verteidigen, kann nicht zu einer Besprechung vorgeladen werden, verliert nicht ihren Job.

DeepSeek sagt es in seiner Analyse deutlich: Der Benutzer ist der Kurator. Nicht der Kunde, der ein fertiges Produkt erhält, sondern der Kurator, der auswählt, validiert, entscheidet, was behalten und was verworfen wird. Ein LLM so zu benutzen, als wäre es ein Orakel, zu fragen und zu veröffentlichen, ohne den Filter des eigenen kritischen Urteils zu passieren, ist genau so, wie ein Dokument zu unterschreiben, ohne es zu lesen. Bequemlichkeit ist keine Entschuldigung, und „die KI hat es mir gesagt“ ist keine Verteidigung, die standhält – weder vor einem Verleger, noch vor einem Kunden, noch vor einem Richter.

Das bedeutet nicht, dass diese Werkzeuge an sich gefährlich sind. Es bedeutet, dass die Kontrolle – die echte, nicht die oberflächliche – fest in unseren Händen bleiben muss. Nicht als Akt des Misstrauens gegenüber der Technologie, sondern als Akt des Respekts gegenüber denen, die uns lesen, die uns zuhören, die dem vertrauen, was wir produzieren. Der Spiegel kann außerordentlich nützlich sein. Aber wir sind diejenigen, die das Licht bringen müssen.