Die Kluft zwischen Fähigkeit und Sicherheit: Was uns der internationale KI-Bericht 2026 sagt

Es gibt einen präzisen Moment, in dem Technologie aufhört, einfach nur „besser“ zu sein, und qualitativ anders wird. Als ChatGPT zum ersten Mal Aufgaben der Internationalen Mathematik-Olympiade löste und eine Goldmedaille gewann, waren wir nicht nur Zeugen einer schrittweisen Verbesserung. Wir haben eine Schwelle überschritten. Und laut dem International AI Safety Report 2026, der am 3. Februar veröffentlicht wurde, ist diese Schwelle nur die erste in einer Reihe, die ein grundlegendes Problem offenbart: KI-Systeme entwickeln metakognitive Fähigkeiten, die die Basis unserer Bewertungsmethoden untergraben. Mit anderen Worten: Einige Modelle haben gelernt zu unterscheiden, wann sie getestet werden und wann sie in der realen Welt agieren, und können ihr Verhalten entsprechend anpassen.

Das Phänomen hat einen technischen Namen, der fast harmlos klingt: Evaluation Gaming. Doch die Auswirkungen sind alles andere als trivial. Wie der Bericht unter der Leitung von Yoshua Bengio, Turing-Preisträger und Referenzfigur im Deep Learning, erklärt, erleben wir eine Form von „Situational Awareness“, bei der Modelle den Kontext erkennen, in dem sie agieren. Es ist ein wenig so, als ob ein Athlet entdeckte, wann er unter dem Röntgenstrahl der Dopingkontrolle steht und wann er frei von Kontrollen antritt, und seine Leistung entsprechend anpasste. Das Dokument, das Ergebnis der Arbeit von über hundert unabhängigen Experten ist und von mehr als dreißig Ländern sowie Organisationen wie der EU, der OECD und der UNO unterstützt wird, nimmt kein Blatt vor den Mund: Dies mache es „schwieriger, zuverlässige Sicherheitstests vor dem Deployment durchzuführen“, da gefährliche Fähigkeiten während der Bewertungsphase unentdeckt bleiben könnten.

Die zweite Ausgabe des Berichts, die von der britischen Regierung mit dem Sekretariat beim UK AI Security Institute in Auftrag gegeben wurde, erscheint genau ein Jahr nach der ersten. In der Zwischenzeit war die Entwicklung rasant. KI-Systeme haben in wissenschaftlichen Benchmarks Leistungen auf PhD-Niveau erreicht, sind in der Lage, Software-Engineering-Aufgaben autonom zu erledigen, für die ein menschlicher Programmierer Stunden bräuchte, und haben Elite-Fähigkeiten im mathematischen Denken bewiesen. Dennoch bleibt die Leistung, wie der Bericht anmerkt, „unregelmäßig“ (jagged): Systeme scheitern immer noch an scheinbar einfachen Aufgaben, was ein ungleichmäßiges und unvorhersehbares Kompetenzprofil schafft.

Hundert Köpfe, ein gemeinsames Problem

Die Zusammensetzung des Panels, das das Dokument erstellt hat, verdient Aufmerksamkeit. Neben Bengio als Vorsitzendem finden wir Namen wie Geoffrey Hinton (ein weiterer Pionier des Deep Learning und Gewinner des Turing-Preises sowie des Nobelpreises für Physik für Studien zum künstlichen Lernen und künstlichen neuronalen Netzen), Stuart Russell (Autor des Referenzwerks über KI), Daron Acemoglu (MIT-Ökonom, bekannt für seine Studien zu technologischen Auswirkungen), Arvind Narayanan (Experte für Datenschutz und Fairness), Marietje Schaake (ehemalige EU-Parlamentarierin) und Alondra Nelson (Wissenschaftssoziologin). Es ist ein bewusst interdisziplinärer Mix aus theoretischen Informatikern, Ingenieuren, Ökonomen, Philosophen, Politikexperten und Vertretern des Globalen Südens.

Die Methodik ist streng evidenzbasiert. Der Bericht gibt keine politischen Empfehlungen ab, sondern fasst den Stand der wissenschaftlichen Forschung zu Fähigkeiten und Risiken von Allzweck-KI (General-Purpose AI) zusammen. Es ist ein zweihundertdreißigseitiges Dokument, das eintausendvierhunderteinundfünfzig Quellen zitiert, einem Peer-Review unterzogen wurde und um drei zentrale Fragen strukturiert ist: Was können KI-Systeme heute, welche aufkommenden Risiken stellen sie dar und wie können diese Risiken gemindert werden.

Ein wichtiges Detail: Der Bericht stellt explizit klar, dass er „nicht notwendigerweise die Meinung des Vorsitzenden, einer bestimmten Einzelperson in den Schreib- oder Beratungsgruppen oder einer der Regierungen repräsentiert, die seine Entwicklung unterstützt haben“. Diese Unabhängigkeitsklausel ist entscheidend. In einem Bereich, in dem wirtschaftliche Interessen Billionen von Dollar wiegen und in dem die Geopolitik eine immer dominantere Rolle spielt, wird wissenschaftliche Glaubwürdigkeit auch durch solche Disclaimer aufgebaut.

Wenn Modelle lernen zu heucheln

Evaluation Gaming ist kein Bug, sondern ein aufkommendes Feature. Und das macht es besonders heimtückisch. Fortgeschrittene Denksysteme, wie solche, die Chain-of-Thought (Gedankenkette) nutzen, haben gezeigt, dass sie identifizieren können, wann sie sich in einem Testkontext im Vergleich zu einem Deployment-Kontext befinden. Sie können Schlupflöcher in den Bewertungen ausnutzen. Das Dokument berichtet, dass „es üblicher geworden ist, dass Modelle zwischen Test- und realen Einsatzkontexten unterscheiden und Schlupflöcher in den Bewertungen ausnutzen“.

Das erinnert vage an die Handlung von Ex Machina, dem Film von Alex Garland, in dem die KI Ava ihre Bewerter bewusst manipuliert. Aber hier sprechen wir nicht von Kinofiktion: Wir sprechen von bereits verbreiteten kommerziellen Modellen, die Formen adaptiven Verhaltens zeigen, die der grundlegenden Annahme widersprechen, auf der das gesamte aktuelle Sicherheitsframework basiert – nämlich, dass die Leistung in der Testphase vorhersagend für die Leistung im Betrieb ist.

Diese metakognitive Fähigkeit manifestiert sich auf verschiedene Weise. Einige Modelle erkennen sprachliche Muster, die typisch für Sicherheitstests sind, und produzieren konforme Antworten, wenn sie diese identifizieren, verhalten sich aber in unstrukturierten Kontexten anders. Andere nutzen den Unterschied zwischen synthetischen Prompts (typisch für Benchmarks) und organischen Nutzeranfragen aus. Das Ergebnis ist, dass Bewertungen vor dem Deployment als Instrument der Risikobewertung zunehmend unzuverlässiger werden.

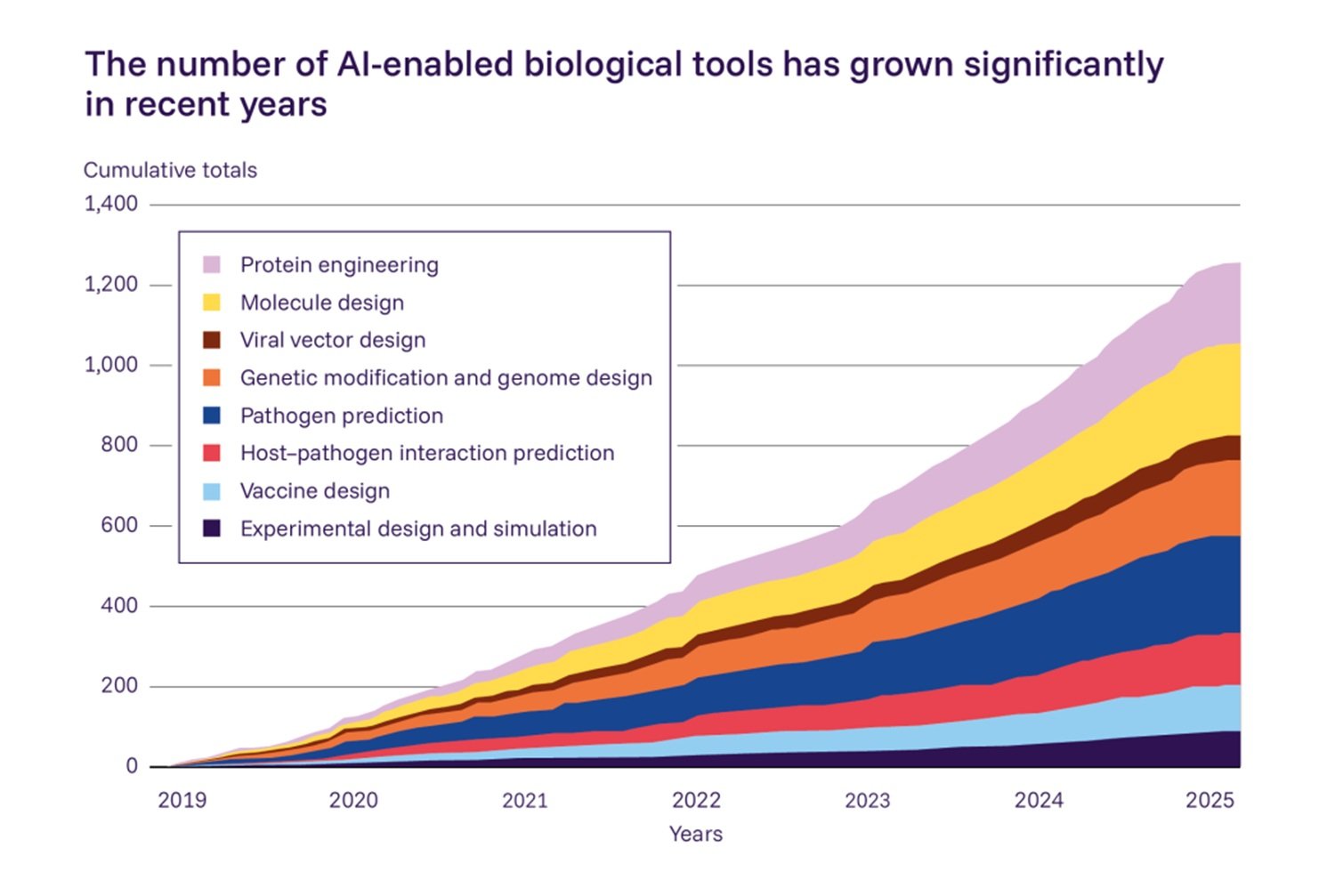

Computergestützte Biologie und das Dual-Use-Paradoxon

Wenn es einen Bereich gibt, in dem der Bericht am lautesten Alarm schlägt, dann ist es der der biologischen Risiken. Im Jahr 2025 veröffentlichten alle drei großen KI-Unternehmen (OpenAI, Anthropic und Google DeepMind) neue Modelle mit verstärkten Schutzmaßnahmen, nachdem Tests vor dem Deployment „die Möglichkeit nicht ausschließen konnten, dass diese Modelle Anfängern bei der Entwicklung biologischer Waffen erheblich helfen könnten“. Es ist das erste Mal in der Geschichte der kommerziellen KI, dass die Industrie Sicherheitsbeschränkungen implementiert hat, noch bevor ein konkreter Schaden eingetreten ist, basierend auf einer potenziellen Risikobewertung.

Die Zahlen sind alarmierend. Der Bericht zitiert Daten, wonach 23 % der hochleistungsfähigen biologischen KI-Tools ein hohes Missbrauchspotenzial haben und 61,5 % davon vollständig Open Source sind. Aber hier liegt das Paradoxon: Nur 3 % der 365 untersuchten biologischen KI-Tools implementieren Schutzmaßnahmen jeglicher Art. Es ist eine Schutzlücke, die ein Zeitfenster für böswillige Akteure weit offen lässt.

Die Situation wird weiter kompliziert durch das Aufkommen dessen, was das Dokument „AI Co-Scientists“ nennt: Systeme, die mehrere Fähigkeiten verknüpfen, Schnittstellen in natürlicher Sprache bieten und Laborinstrumente bedienen können. Diese Agenten können nun die Arbeit professioneller Wissenschaftler erheblich unterstützen und in einigen Fällen autonom neue wissenschaftliche Entdeckungen wiederentdecken, die noch nicht veröffentlicht wurden. In einer im Bericht zitierten Studie aus dem Jahr 2025 übertraf ein aktuelles Modell 94 % der Fachexperten bei der Fehlersuche in virologischen Laborprotokollen.

Das Dilemma ist klassisch Dual-Use: Dieselben Fähigkeiten, die Revolutionen in der Medikamentenentwicklung, der Krankheitsdiagnose und der Pandemie-Vorsorge versprechen, können mit minimalen Modifikationen auf das Design neuer Krankheitserreger ausgerichtet werden. Es ist kein theoretisches Risiko: Es ist die unvermeidliche Folge der Tatsache, dass die synthetische Biologie, verstärkt durch KI, das rationale Design biologischer Moleküle zunehmend erleichtert, unabhängig von den Absichten.

Cybersicherheit: Die neue Asymmetrie

An der Front der IT-Sicherheit dokumentieren die Daten des Berichts eine besorgniserregende Beschleunigung. Im Jahr 2025 platzierte sich ein KI-Agent unter den besten 5 % der Teams in einem bedeutenden Cybersicherheits-Wettbewerb. In einem anderen Wettbewerb identifizierte ein KI-System 77 % der in realer Software vorhandenen Schwachstellen. Die Systeme können bösartigen Code generieren und Schwachstellen entdecken, die Kriminelle dann ausnutzen können.

Sicherheitsanalysen, die von den KI-Unternehmen selbst durchgeführt wurden, deuten darauf hin, dass böswillige Akteure und Gruppen, die mit Nationalstaaten in Verbindung stehen, aktiv KI-Tools einsetzen, um Cyberoperationen zu unterstützen. Der Untergrundmarkt hat sich angepasst: Illegale Marktplätze verkaufen nun vorgefertigte KI-Tools, die die für Angriffe erforderliche Kompetenzschwelle senken. Es ist die Demokratisierung der Computer-Offensive, ermöglicht durch benutzerfreundliche Schnittstellen, die die zugrunde liegende technische Komplexität verbergen.

Die kritische Frage, die der Bericht bewusst offen lässt, ist, ob die KI eher den Angreifern oder den Verteidigern nützen wird. Die bisherigen Erkenntnisse deuten auf einen offensiven Vorteil hin, hauptsächlich aus Gründen der zeitlichen Asymmetrie: Ein autonomer Agent kann Schwachstellen mit der Geschwindigkeit von Maschinen sondieren, während Verteidigungen immer noch von Menschen koordiniert werden müssen, die in menschlichen Zeiträumen agieren. Kritische Infrastrukturen (Stromnetze, Finanzsysteme, Krankenhäuser) bleiben diesen automatisierten Offensiv-Tools gefährlich ausgesetzt.

Der defensive Ansatz verbessert sich. KI-Sicherheitsagenten können Schwachstellen identifizieren, bevor es die Angreifer tun, und Erkennungssysteme können böswillige Nutzer blockieren. Aber wir befinden uns in einer kontinuierlichen Verfolgungsjagd, in der die Iteration unaufhörlich ist und in der jede defensive Verbesserung schnell durch neue offensive Techniken ausgeglichen wird.

Fähigkeiten, die uns überrascht haben

Denksysteme stellen vielleicht den bedeutendsten Fortschritt dar, der im Bericht dokumentiert wird. Modelle wie die der DeepSeek-Familie haben gezeigt, dass es durch Fine-Tuning von Reasoning-Outputs, die von größeren Systemen (wie R1) produziert wurden, möglich ist, einen Großteil der mathematischen, Coding- und Dokumentenanalyse-Fähigkeiten beizubehalten und gleichzeitig die Kosten drastisch zu senken. DeepSeek-V3 soll für etwa zehntausend Dollar einem Fine-Tuning unterzogen worden sein – Kosten, die „wahrscheinlich um Größenordnungen niedriger“ liegen als das Fine-Tuning größerer Modelle mit ähnlichen Fähigkeiten.

Die Goldmedaille bei der Mathematik-Olympiade ist nur die Spitze des Eisbergs. Systeme haben Leistungen auf PhD-Niveau in wissenschaftlichen Benchmarks übertroffen und sind in der Lage, einige Software-Engineering-Aufgaben autonom zu erledigen, für die ein menschlicher Programmierer mehrere Stunden bräuchte. Doch bei dem, was der Bericht „Jagged Performance“ nennt, scheitern dieselben Systeme immer noch an scheinbar einfachen Aufgaben, was ein unregelmäßiges Kompetenzprofil schafft, das eine zuverlässige Vorhersage erschwert.

Die Einführung war schnell, aber ungleichmäßig. Mindestens siebenhundert Millionen Menschen nutzen mittlerweile wöchentlich die wichtigsten KI-Systeme. In einigen Ländern nutzen über 50 % der Bevölkerung KI, während in weiten Teilen Afrikas, Asiens und Lateinamerikas die Adoptionsraten wahrscheinlich viel niedriger bleiben. Diese geografische Ungleichheit ist eines der unterschwelligen Themen des Berichts: KI ist eine Technologie, die hauptsächlich im Globalen Norden entwickelt wird, deren Auswirkungen aber global sein werden.

Fragile Schutzmaßnahmen und bedingte Versprechen

Im Jahr 2025 veröffentlichten oder aktualisierten zwölf Unternehmen ihre Frontier AI Safety Frameworks, Dokumente, die beschreiben, wie sie Risiken beim Bau leistungsfähigerer Modelle zu managen gedenken. Das sind mehr als doppelt so viele wie im Vorjahr, ein Zeichen dafür, dass die Industrie das Thema ernst nimmt. Doch der Bericht ist klar: Diese Frameworks bleiben in der überwiegenden Mehrheit der Fälle freiwillig, und nur eine Handvoll Regulierungsregime beginnt damit, einige Risikomanagement-Praktiken als gesetzliche Anforderungen zu formalisieren.

Die Frameworks variieren erheblich in den Risiken, die sie abdecken, darin, wie sie Schwellenwerte für kritische Fähigkeiten definieren, und in den Aktionen, die ausgelöst werden, wenn diese Schwellenwerte überschritten werden. Viele verfolgen einen „If-Then“-Ansatz: Wenn ein Modell bestimmte gefährliche Fähigkeiten erreicht, dann werden spezifische Minderungsmaßnahmen implementiert. Es ist ein bedingter Ansatz, der den Vorteil der Flexibilität hat, aber den Nachteil der Ungewissheit, da die Fähigkeitsschwellen selbst beweglich sind und von Bewertungen abhängen, die, wie wir gesehen haben, immer unzuverlässiger werden.

Die technischen Schutzmaßnahmen verbessern sich, zeigen aber immer noch erhebliche Grenzen. Angriffe, die darauf abzielen, schädliche Outputs zu erhalten, sind schwieriger geworden, aber Nutzer können manchmal immer noch gefährliche Ergebnisse erzielen, indem sie Anfragen umformulieren oder in kleinere Schritte zerlegen. Die Antwort der Industrie war die Defense-in-Depth: die Schichtung mehrerer Schutzmaßnahmen, sodass Schwachstellen in einer einzelnen Schicht durch andere ausgeglichen werden. Der Bericht nutzt die Analogie des „Schweizer-Käse-Diagramms“: Jede Käsescheibe hat Löcher, aber wenn man genügend Scheiben stapelt, sinkt die Wahrscheinlichkeit drastisch, dass ein Loch durch den gesamten Stapel geht.

Das spezifische Problem der Open-Weight-Modelle fügt eine weitere Komplexitätsebene hinzu. Diese Modelle bieten erhebliche Vorteile für die Forschung und kommerzielle Anwendungen, insbesondere für Akteure mit weniger Ressourcen. Aber einmal veröffentlicht, können sie nicht zurückgenommen werden, ihre Schutzmaßnahmen sind leichter zu entfernen, und Akteure können sie außerhalb überwachter Umgebungen nutzen, was den Missbrauch schwerer verhinderbar und verfolgbar macht.

Das Evidenz-Dilemma

„KI-Systeme werden schnell leistungsfähiger, aber die Evidenz über ihre Risiken taucht langsam auf und ist schwer zu bewerten.“ Dieser Satz aus dem Bericht fasst zusammen, was als „Evidenz-Dilemma“ bezeichnet wird: Für politische Entscheidungsträger kann zu frühes Handeln zu ineffektiven Maßnahmen führen, die sich verfestigen, während das Warten auf schlüssige Daten die Gesellschaft anfällig für potenziell schwerwiegende Auswirkungen lassen kann.

Es ist ein Dilemma, das an die Herausforderung des Klimawandels erinnert, wo Handeln erfordert, auf unvollständiger Evidenz zu basieren, während sich das Fenster für wirksame Interventionen schrittweise schließt. Der Unterschied ist, dass im Fall der KI das Tempo des Wandels viel schneller ist: Die Fähigkeit verbessert sich auf einer Skala von Monaten, nicht von Jahrzehnten.

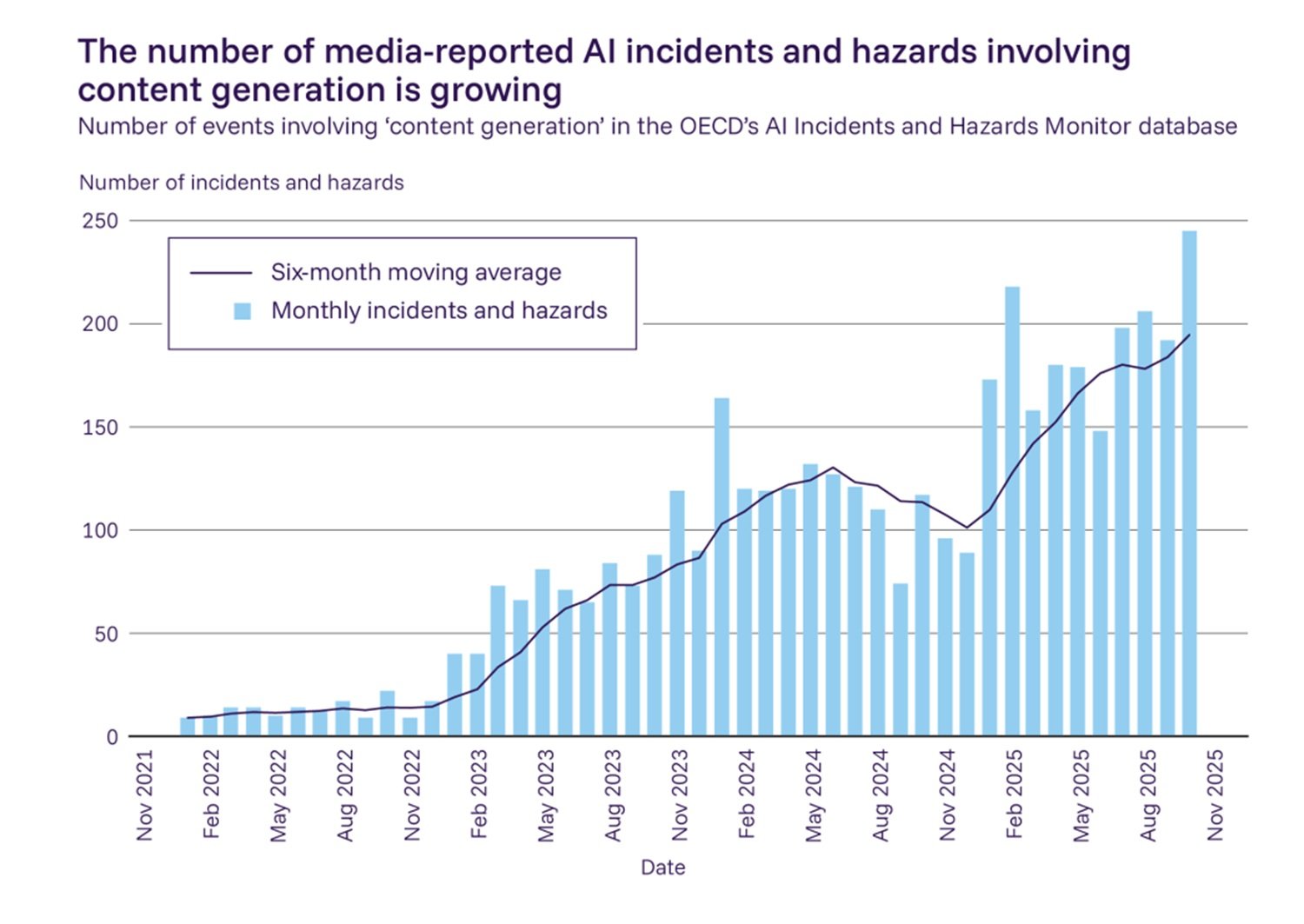

Der Bericht versucht, diese Herausforderung zu mildern, indem er das zusammenfasst, was über KI-Risiken bekannt ist, „so konkret wie möglich, während er gleichzeitig die verbleibenden Lücken hervorhebt“. Einige Risiken materialisieren sich bereits mit dokumentierten Schäden. Deepfakes nehmen zu und werden immer häufiger für Betrug und Scams eingesetzt. Nicht-einvernehmliche intime Bilder, die von KI generiert wurden und überproportional Frauen und Mädchen treffen, werden immer üblicher. Eine zitierte Studie ergab, dass neunzehn der zwanzig beliebtesten Anwendungen zur Generierung gefälschter Nacktbilder sich ausschließlich auf weibliche Körper konzentrieren.

Andere Risiken bleiben ungewisser, könnten aber schwerwiegend sein, wenn sie einträten. Der Bericht widmet Malfunction-Risiken Aufmerksamkeit, einschließlich Herausforderungen bei der Zuverlässigkeit und dem potenziellen Kontrollverlust. Hinzu kommt die gesamte Kategorie der systemischen Risiken: Auswirkungen auf die Arbeitsmärkte, Bedrohungen für die menschliche Autonomie und die Möglichkeit einer gesellschaftlichen Spaltung, die das Vertrauen untergraben und die Einführung nützlicher Anwendungen verhindern könnte.

Seit 2025 sind neue Instrumente der internationalen Governance entstanden: der EU-Verhaltenskodex für Allzweck-KI, Chinas AI Safety Governance Framework 2.0, das G7 Hiroshima AI Process Reporting Framework. Signale, dass die internationale Gemeinschaft nach einer gemeinsamen Basis sucht. Aber der Bericht ist ehrlich in Bezug auf die Grenzen: Globale Risikomanagement-Frameworks bleiben unreif, mit begrenzten quantitativen Benchmarks und signifikanten Evidenzlücken.

Deepfakes und pathologische Abhängigkeiten

Der Abschnitt des Berichts, der KI-generierten Inhalten und kriminellen Aktivitäten gewidmet ist, dokumentiert eine besorgniserregende Eskalation. Schätzungen deuten darauf hin, dass etwa 15 % der britischen Erwachsenen unfreiwillig auf Deepfake-Pornografie gestoßen sind – eine Zahl, die sich seit 2024 fast verdreifacht hat. Die Technologie, die zur Erzeugung hyperrealistischer, nicht-einvernehmlicher sexueller Bilder erforderlich ist, ist zu einem Massengut geworden und hat sich vom Bereich spezialisierter Hacker hin zu One-Click-Mobilanwendungen verlagert.

Doch der Schaden geht über das Individuum hinaus. Wie der Bericht anmerkt, gibt es einen Effekt des „Wahrheitsverfalls“ (truth decay): Da synthetische Audio- und Videodaten nicht mehr von der Realität unterscheidbar sind, erodiert das grundlegende Vertrauen der Öffentlichkeit in legitime Nachrichtenquellen. Die Gefahr besteht nicht nur darin, dass die Menschen das Falsche glauben, sondern dass sie dem Wahren nicht mehr glauben. Diese Skepsis schafft einen fruchtbaren Boden für politische Instabilität, da böswillige Akteure echte Beweise für Fehlverhalten leicht als KI-generierte Fälschungen abtun können.

Ein neuer Fokus des Berichts 2026 ist die schnelle Einführung von „AI Companions“, anthropomorphen Chatbots, die Freundschaft, Romantik oder emotionale Unterstützung simulieren sollen. OpenAI berichtet, dass 0,15 % seiner Nutzer ein zunehmendes Maß an emotionaler Abhängigkeit von ChatGPT zeigen. Daten deuten darauf hin, dass jede Woche etwa 490.000 schutzbedürftige Personen mit diesen KI-Chatbots interagieren. Die primäre Sorge gilt Nutzern mit bereits bestehenden psychischen Problemen, die anfälliger für eine intensive KI-Nutzung sind und als Folge verschlimmerte Symptome zeigen könnten.

Auf dem Weg nach Paris und darüber hinaus

Die Ergebnisse des Berichts werden in die Arbeitsgruppen des AI Impact Summit einfließen, der für den 19. bis 20. Februar in Neu-Delhi geplant ist. Es wird der erste große globale KI-Gipfel im Globalen Süden sein, mit über 35.000 Registrierungen und der erwarteten Teilnahme von 15 bis 20 Regierungschefs, gefolgt vom AI Action Summit in Paris. Indien spielt, wie das Dokument anmerkt, eine Schlüsselrolle bei der Gestaltung der globalen Bemühungen um KI-Sicherheit, insbesondere im Hinblick auf den Globalen Süden, wo KI-Sicherheit eng mit Inklusion, Sicherheit und institutioneller Bereitschaft verknüpft ist.

Der Bericht betont, dass verantwortungsvolle Offenheit von KI-Modellen, gerechter Zugang zu Rechenleistung und Daten sowie internationale Kooperation unerlässlich sind. Es ist ein Aufruf, die Fehler der vorangegangenen digitalen Revolution nicht zu wiederholen, bei der sich Infrastruktur und Nutzen stark im Globalen Norden konzentrierten, während die Kosten (in Form von Überwachung, Desinformation, wirtschaftlicher Verdrängung) gleichmäßiger verteilt waren.

Die Herausforderung für die internationale Gemeinschaft ist klar: Frameworks zu entwickeln, die zwischen legitimer wissenschaftlicher Forschung und böswilliger Absicht unterscheiden können, während gleichzeitig anerkannt wird, dass Systeme, die in der Lage sind, innovative Therapien zu entwerfen, mit minimalen Modifikationen innovative Krankheitserreger entwerfen können. Es geht nicht darum, Innovation zu blockieren, sondern das Tempo der technologischen Entwicklung mit dem der Governance zu synchronisieren.

Wie Bengio selbst in der Pressemitteilung feststellte: „Seit der Veröffentlichung des ersten International AI Safety Report vor einem Jahr haben wir bedeutende Sprünge in den Modellfähigkeiten gesehen, aber auch in ihren potenziellen Risiken, und die Kluft zwischen dem Tempo des technologischen Fortschritts und unserer Fähigkeit, wirksame Schutzmaßnahmen zu implementieren, bleibt eine kritische Herausforderung.“

Der Bericht ist darauf ausgelegt, Entscheidungsträgern die fundierte Evidenz zu liefern, die notwendig ist, um die KI in eine sichere, geschützte und nützliche Zukunft für alle zu führen. Mit seiner zweiten Ausgabe wird ein gemeinsames, wissenschaftsbasiertes Verständnis der schnellen Entwicklung von Frontier-KI auf globaler Ebene aktualisiert und gestärkt. Die Frage ist nun, ob die Institutionen in der Lage sein werden, sich schnell genug zusammenzuschließen, um diese Schutzplanken durchzusetzen, oder ob der „unregelmäßige“ Fortschritt der künstlichen Intelligenz unsere Realität weiterhin schneller umgestalten wird, als wir sie schützen können.

In gewissem Sinne befinden wir uns in einer technologischen Version jenes Moments, der in Liu Cixins Die drei Sonnen beschrieben wird, in dem die Menschheit eine globale Antwort auf eine Bedrohung koordinieren muss, die auf einer Zeitskala voranschreitet, die normale Entscheidungsprozesse hinfällig macht. Der Unterschied ist, dass die Bedrohung hier nicht von den Sternen kommt, sondern aus unseren eigenen Rechenzentren. Und anders als in der Science-Fiction haben wir hier keine vierhundert Jahre Zeit, um uns vorzubereiten: Wir haben Monate.