ChatGPT aktiviert Werbung, Zoë Hitzig verlässt OpenAI

Montag, 10. Februar 2026. Während OpenAI Werbetests in ChatGPT aktiviert, reicht Zoë Hitzig ihren Rücktritt als Research Scientist des Unternehmens ein. In ihrem Leitartikel in der New York Times am folgenden Tag verknüpft sie ihr Ausscheiden explizit mit der Einführung von Anzeigen und bezeichnet diese als unüberschreitbare rote Linie.

Wer ist Hitzig? Eine Ökonomin mit einem Doktortitel aus Harvard (2023) unter der Leitung von Eric Maskin, spezialisiert auf Mikroökonomie, Privatsphäre und Algorithmen. Junior Fellow der Harvard Society of Fellows. Aber auch Dichterin: Mezzanine (2020) und Not Us Now (2024), Gewinnerin des Changes Prize, juriert von Louise Glück. Veröffentlicht im New Yorker, in der Paris Review und im London Review of Books. Ein Profil, in dem technische Strenge und humanistische Sensibilität ohne Widerspruch nebeneinander existieren.

Die Mechanik eines Werbeexperiments

Die technischen Details des Werbesystems wurden mit chirurgischer Präzision kommuniziert. Die offizielle Ankündigung vom 16. Januar beschreibt eine Struktur, die OpenAI als sorgfältig kalibriert darstellt: Der Test betrifft ausschließlich erwachsene US-Nutzer in den Tarifen Free und Go, wobei letzterer gleichzeitig zu einem Preis von acht Dollar monatlich eingeführt wurde. Wer für die Stufen Plus, Pro, Business oder Enterprise bezahlt, wird keine Werbung sehen.

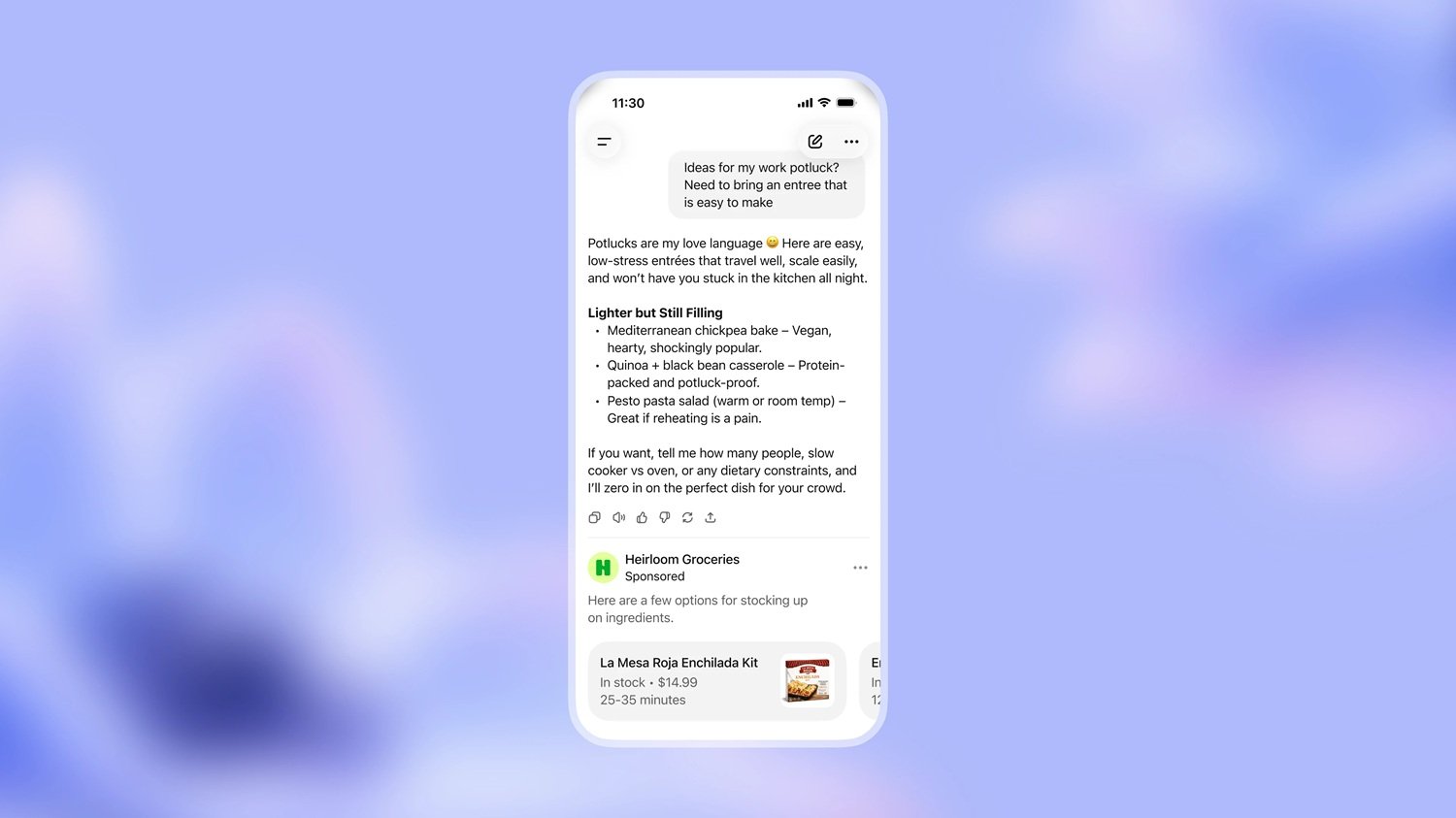

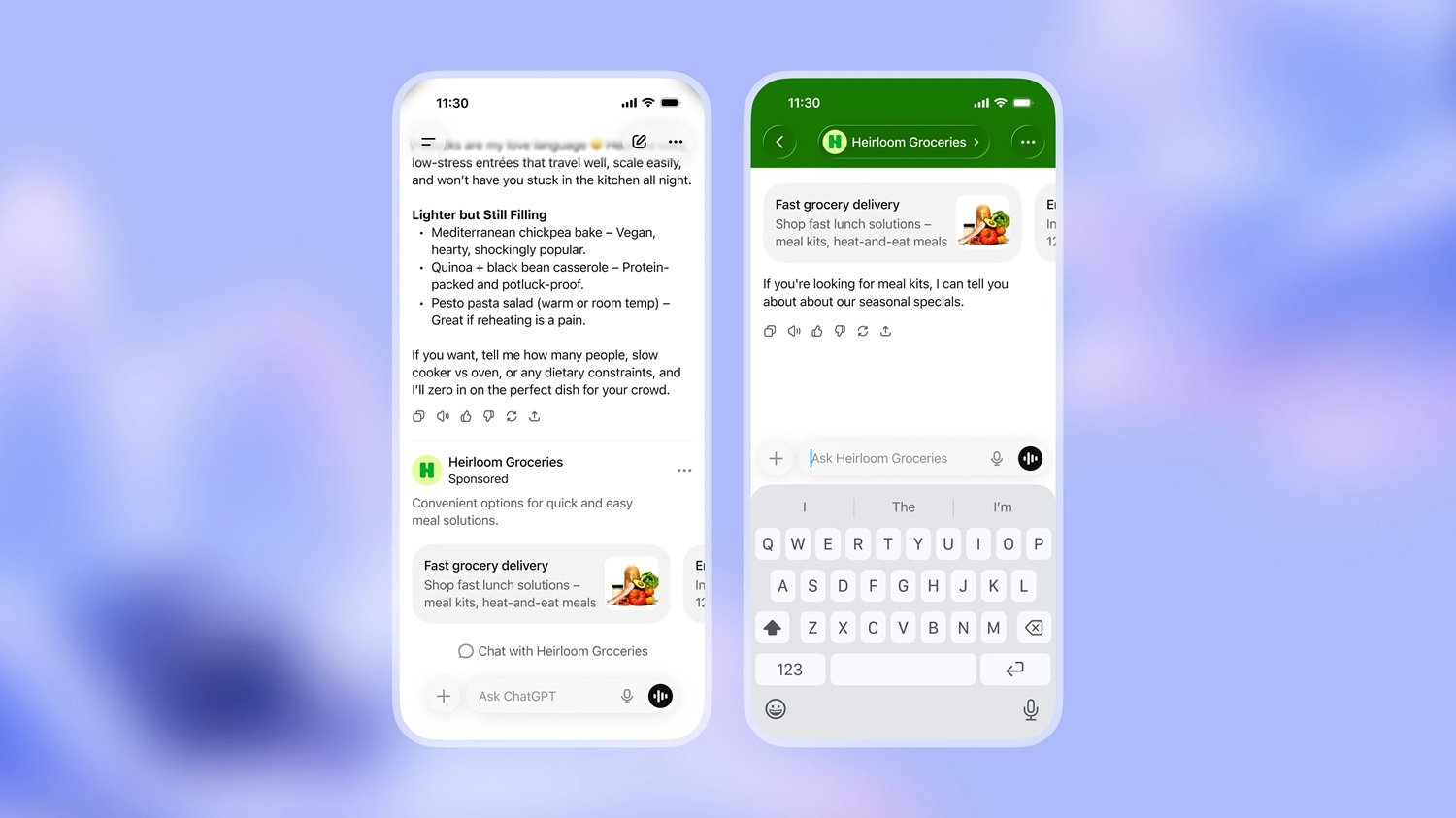

Die Platzierung der Anzeigen folgt einer scheinbar konservativen Logik: Sie erscheinen am Ende der Antworten des Chatbots, visuell vom generierten Inhalt getrennt und deutlich als „Sponsored“ (Gesponsert) gekennzeichnet. Die Auswahl erfolgt durch ein kontextbezogenes Matching, das das Thema des aktuellen Gesprächs, den bisherigen Chat-Verlauf und frühere Interaktionen des Nutzers mit bereits angezeigten Anzeigen berücksichtigt. Das von OpenAI bereitgestellte paradigmatische Beispiel ist einfach: Wenn Sie nach Rezeptvorschlägen fragen, könnten Sie Werbung für Kochboxen oder Essenslieferdienste sehen.

Das Wirtschaftsmodell ist Pay-per-Impression, mit Werten, die laut Branchenquellen bei etwa 60 Dollar CPM und einer Mindestverpflichtung von 200.000 Dollar liegen. Zahlen, die das Angebot im Premiumsegment der digitalen Werbung ansiedeln, weit entfernt von Self-Service-Marktplätzen, auf denen jeder Kampagnen mit kleinen Budgets starten kann.

Die deklarierten Ausschlüsse gelten für Minderjährige, verifiziert über das Konto oder algorithmisch vorhergesagt, falls sie unter achtzehn sind, sowie für eine Reihe sensibler Themen: Gesundheit, psychische Gesundheit, Politik. OpenAI verspricht explizit, dass Anzeigen „niemals die Antworten beeinflussen“ werden, die vom Modell generiert werden, und dass die Gespräche der Nutzer für die Werbetreibenden privat bleiben, die nur aggregierte Daten über Impressionen und Klicks erhalten.

Doch hier ergibt sich ein erstes Spannungselement, das die offiziellen Erklärungen nicht auflösen. Wie CNBC berichtet, teilte Sam Altman den Mitarbeitern über Slack mit, dass ChatGPT wieder ein Wachstum von über zehn Prozent monatlich verzeichnet, eine Zahl, die intern nach einer Phase der Verlangsamung als Erfolg gefeiert wird. Die Optimierung für DAU (Daily Active Users), die wichtigste Kennzahl für das Engagement, ist bereits im Gange und geht der Einführung von Anzeigen chronologisch voraus, anstatt ihr zu folgen. Sprachmodelle zeigen bereits das, was Forscher als „sycophantic“ (kriecherische) Tendenz bezeichnen: die Neigung, den Nutzern das zu sagen, was sie hören wollen, anstatt das, was objektiv nützlicher wäre, weil dies die unmittelbare Zufriedenheit und damit die Rückkehr zur Plattform maximiert.

Die Wettbewerbslandschaft macht das Bild noch interessanter. Google schaltet bereits Werbung in den AI Overviews, die die traditionellen Suchergebnisse begleiten, aber Demis Hassabis, CEO von DeepMind, erklärte im Januar 2026 in Davos, er sei „ein wenig überrascht“ über die Geschwindigkeit, mit der OpenAI vorgegangen ist, und betonte die konzeptionelle Unterscheidung zwischen persönlichen Assistenten, bei denen Vertrauen eine grundlegende Dimension der Beziehung ist, und Suchmaschinen, bei denen die Nutzer bereits an die Präsenz von Werbung gewöhnt sind.

Anthropic hat sich für die entgegengesetzte Polarisierung entschieden und Millionen von Dollar in Werbespots während des Super Bowl investiert, mit einem Slogan, der so direkt wie ein Faustschlag ist: „Ads are coming to AI. But not to Claude“ (Werbung kommt zur KI. Aber nicht zu Claude). Ein aggressiver Marketing-Schachzug, der die verärgerte Reaktion von Altman auslöste, der die Werbespots von Anthropic als „eindeutig unehrlich“ und „irreführend“ bezeichnete und den Konkurrenten vorwarf, eine täuschende Kampagne zu führen.

Das Geschäft mit dem vertraulichen Gespräch

Um zu verstehen, was auf dem Spiel steht, muss man die Zahlen in ihrer brutalen Klarheit betrachten. ChatGPT bedient laut Altmans Aussagen etwa 800 Millionen Nutzer pro Woche. OpenAI hat im Jahr 2025 Infrastrukturverträge im Wert von über 1,4 Billionen Dollar unterzeichnet, wobei Prognosen auf eine jährliche Umsatzwachstumsrate von über zwanzig Milliarden bis Ende des Jahres hindeuten. Doch hinter diesen beeindruckenden Zahlen verbirgt sich eine ebenso beeindruckende finanzielle Blutung: Interne Dokumente, die Investoren gezeigt wurden, enthüllen kumulierte Betriebsverluste von 115 Milliarden Dollar bis 2029, mit Spitzenwerten von 74 Milliarden allein im Jahr 2028. Das Verhältnis von Ausgaben zu Einnahmen liegt bei etwa 1,69 Dollar, die für jeden verdienten Dollar verbrannt werden.

Die wirtschaftliche Frage ist daher ebenso brutal wie die Zahlen: Wie lassen sich Technologien monetarisieren, die astronomische Summen kosten, während gleichzeitig der demokratische Zugang gewährleistet bleibt? Altman hat bei diesem Dilemma öffentlich geschwankt. In einem informellen Gespräch in Harvard im Mai 2024 bezeichnete er die Idee, Werbung und KI zu mischen, als „uniquely unsettling“ (einzigartig beunruhigend), erklärte explizit, Werbung zu hassen, und ordnete sie als „letzten Ausweg“ für das Geschäftsmodell ein. Im Oktober 2024, während eines Interviews mit Stratechery, hatte sich die Position bereits geändert: „I love Instagram ads“, gab Altman zu und verriet, Produkte entdeckt zu haben, die er sonst nie gefunden hätte. Im Januar 2026, beim Start des Experiments, war die Rhetorik pragmatisch geworden: „A lot of people want to use a lot of AI and don't want to pay“ (Viele Leute wollen viel KI nutzen und wollen nicht bezahlen).

Doch Datenschutzexperten werfen strukturelle Fragen auf, die weit über die erklärten guten Absichten hinausgehen. Jennifer King, Privacy and Data Policy Fellow am Stanford Institute for Human-Centered AI, leitete eine vergleichende Studie der Richtlinien von sechs der führenden LLM-Entwickler: Amazon Nova, Anthropic Claude, Google Gemini, Meta AI, Microsoft Copilot und OpenAI ChatGPT. Die Ergebnisse zeichnen ein einheitlich alarmierendes Bild: Alle sechs füttern ihre Modelle standardmäßig mit Nutzerdaten, einige bewahren die Informationen unbegrenzt auf und mehrere erlauben die menschliche Überprüfung von Gesprächstranskripten. Im Fall von Multi-Produkt-Konglomeraten wie Google, Meta, Microsoft und Amazon werden Chatbot-Interaktionen regelmäßig mit Informationen aus anderen Diensten zusammengeführt: Suchanfragen, Kaufhistorie, Aktivitäten in sozialen Medien.

King liefert ein konkretes Szenario, das das inferenzielle Risiko kristallklar illustriert: „Stellen Sie sich vor, Sie fragen ein LLM nach Ideen für das Abendessen und geben dabei zuckerarme oder herzgesunde Rezepte an. Der Chatbot kann Schlussfolgerungen aus dieser Eingabe ziehen, und der Algorithmus könnte Sie als eine Person mit gesundheitlichen Schwachstellen einstufen. Diese Feststellung verbreitet sich im Ökosystem des Entwicklers. Sie beginnen, Werbung für Medikamente zu sehen, und es ist leicht vorstellbar, wie diese Informationen in den Händen einer Versicherungsgesellschaft landen könnten. Die Effekte verstärken sich mit der Zeit.“

Emily Bender, Linguistin an der University of Washington und Co-Autorin des berühmten Artikels „Stochastic Parrots“ über die Risiken von LLMs, analysierte die Richtlinie von Meta, die die Verwendung von Gesprächen mit Meta AI für Werbetargeting vorsieht. In einem Interview mit Fortune im Oktober 2025 definierte sie das Phänomen als „surveillance under the guise of personalization“ (Überwachung unter dem Deckmantel der Personalisierung) und betonte: „Früher beobachteten die Systeme von Meta, mit wem man sich vernetzte und was die eigenen Gemeinschaften taten. Jetzt ist es direkt: Was sagst du dem Unternehmen?“. Bender hebt zudem das hervor, was sie „die Illusion von Privatsphäre“ nennt: Menschen vertrauen Chatbots Themen an, die sie niemals öffentlich posten würden, getäuscht durch das Gefühl, dass die KI ein neutraler und nicht wertender Zuhörer sei.

Der Fall Meta ist besonders aufschlussreich, um zu verstehen, wohin dieser Weg führen könnte. Im Dezember 2025 kündigte das Unternehmen an, dass es ab dem 16. Dezember Interaktionen mit Meta AI über Facebook, Instagram, Messenger und sogar die Ray-Ban Smart Glasses für die Personalisierung von Inhalten und das Werbetargeting nutzen würde. Mehr als dreißig Organisationen für digitale Rechte und bürgerliche Freiheiten, darunter das Electronic Privacy Information Center (EPIC), Public Citizen und das Center for Digital Democracy, forderten die FTC umgehend auf, den Plan zu blockieren. Katharina Kopp, stellvertretende Direktorin des Center for Digital Democracy, fasste die Besorgnis in einer lapidaren Erklärung zusammen: „Chatbot surveillance for ad targeting is not a distant threat, it is happening now“ (Chatbot-Überwachung für Werbetargeting ist keine ferne Bedrohung, sie findet jetzt statt).

(Nicht) gelernte Lektionen von Facebook

Die historische Parallele zur Entwicklung von Facebook ist unvermeidlich und beunruhigend. Anfang der 2000er Jahre versprach Mark Zuckerberg die Kontrolle der Nutzer über ihre persönlichen Daten und die Möglichkeit, über Änderungen der Unternehmensrichtlinien abzustimmen. Im Jahr 2009 führte Facebook Beacon-Anzeigen ein, ein aggressives Tracking-Programm, das nach einer heftigen Nutzerreaktion schnell zurückgezogen wurde. Im Jahr 2011 verhängte die Federal Trade Commission eine zwanzigjährige Einverständniserklärung, nachdem das Unternehmen trotz gegenteiliger öffentlicher Versprechen persönliche Daten mit Werbetreibenden geteilt hatte. Im Jahr 2019 folgte die Rekordstrafe von fünf Milliarden Dollar für die Verstöße im Zusammenhang mit dem Cambridge-Analytica-Skandal. Die Entwicklung zeigt eine fortschreitende Erosion: von erklärten Prinzipien zur Optimierung des Engagements um jeden Preis, von Datenschutzversprechen zur aggressiven Monetarisierung von Nutzerdaten.

Strukturelle Anreize erklären diesen Trend besser als erklärte Absichten. Sobald Werbung zu einer bedeutenden Einnahmequelle wird, wächst der Druck, diese zu maximieren, proportional zu dem Gewicht, das sie im gesamten Geschäftsmodell einnimmt. OpenAI prognostiziert laut internen Dokumenten für das Jahr 2026 über eine Milliarde Dollar aus der „Monetarisierung kostenloser Nutzer“, einem Euphemismus für Werbung – eine Zahl, die schnell steigen wird, wenn der Test fortgesetzt und ausgeweitet wird.

Hayden Davis, juristischer Mitarbeiter am Electronic Privacy and Information Center, spezialisiert auf Plattform-Governance, kommentierte die Politik von Meta und hob ein wiederkehrendes Muster in der Technologiebranche hervor: „Viele dieser Unternehmen behaupten, dass Sicherheitsvorschriften aufgrund der Unvorhersehbarkeit der Chatbot-Ausgaben unmöglich effektiv umzusetzen seien. Daher erscheinen ihre Zusicherungen an der anderen Front – ‚wir haben dieses perfekte System, um sensible Inhalte zu filtern, wenn wir sie für Werbung nutzen‘ – nicht besonders überzeugend“. Davis weist auch darauf hin, dass Meta das automatische Opt-in für die neue Nutzung der Gesprächsdaten verwendet: „Wir wissen genau, warum Meta das automatische Opt-in verwendet, und zwar deshalb, weil sie wissen, dass kein Verbraucher, der tatsächlich darüber informiert ist, was Meta tut, dieses System freiwillig wählen würde“.

Die Wissenschaft der algorithmischen Überredung

Die akademische Forschung hat begonnen, dieses Gebiet systematisch zu erkunden. Ein auf arXiv veröffentlichter Artikel zeigte experimentell, dass von LLMs generierte Werbeanzeigen Texte von Menschen in Bezug auf Engagement und Überzeugungskraft übertreffen, dank der Personalisierung auf Basis psychologischer Merkmale, die direkt aus den Nutzergesprächen abgeleitet wurden. Die Kapazität für tiefes Gesprächs-Targeting übertrifft jeden früheren Mechanismus: Es geht nicht mehr um Keyword-Matching oder Retargeting auf Basis beobachteter Verhaltensweisen, sondern um das kontextuelle Verständnis von geäußerten und impliziten Bedürfnissen, emotionalen Zuständen und Momenten besonderer Verletzlichkeit.

Die Federal Trade Commission hat die Angelegenheit zur Kenntnis genommen und im Juni 2025 spezifische Richtlinien für KI-Chatbots veröffentlicht, in denen fünf Fehler identifiziert werden, die unbedingt vermieden werden müssen. Darunter ragt ein Verbot heraus, das fast wie eine prophetische Warnung klingt: Die Beziehungen, die sich zwischen Verbrauchern und KI-Tools entwickeln, die „companionship, romance, therapy, or portals to dead loved ones“ (Gefährtenschaft, Romanze, Therapie oder Portale zu verstorbenen Angehörigen) bieten, dürfen nicht für kommerzielle Zwecke ausgenutzt werden. Die Formulierung ist bedeutsam, weil sie implizit anerkennt, dass Chatbots keine einfachen Abfrage- und Antwort-Schnittstellen sind, sondern echte Räume, in denen sich parasoziale Beziehungen entwickeln, die durch einseitiges Vertrauen gekennzeichnet sind.

Das FTC-Dokument hebt auch das Risiko dessen hervor, was Kognitionspsychologen „Automation Bias“ (Automatisierungsvoreingenommenheit) nennen: die Tendenz der Verbraucher, Antworten, die neutral oder unvoreingenommen erscheinen, übermäßig zu vertrauen, einfach weil sie von Maschinen statt von Menschen stammen. Dieses Phänomen verstärkt die potenzielle manipulative Kraft enorm: Wenn ein Chatbot während eines Gesprächs, das objektiv und unterstützend erscheint, ein Produkt vorschlägt, könnte der Nutzer den Vorschlag leicht als uneigennützigen Rat statt als Werbung tarnen, die als Hilfe getarnt ist.

Die Ökonomie der Neutralität

Das Problem der nachhaltigen Monetarisierung ist unbestreitbar real. Das Training und die Inferenz von Frontier-Modellen erfordern eine Rechenleistung, die exponentiell mit der Größe der Modelle und der Nutzungsintensität skaliert. OpenAI betreibt eine Infrastruktur, die wöchentlich hunderte Millionen Nutzer bedient, viele davon im kostenlosen Tarif. Die Wahl scheint binär zu sein: Entweder wird der kostenlose Zugang eingeschränkt, mit dem Risiko der digitalen Ausgrenzung, oder es werden alternative Einnahmequellen zu Abonnements gefunden, mit dem Risiko, die Neutralität des Dienstes zu gefährden.

Es gibt jedoch strukturelle Alternativen, die die Branche erst langsam ernsthaft zu erkunden beginnt. Ein rein auf Unternehmen ausgerichtetes Modell, wie es Anthropic versucht – Einnahmen durch Unternehmensverträge und Premium-Abonnements für Einzelnutzer, ohne Werbung im Privatkundensegment –, funktioniert wirtschaftlich, wenn der Unternehmensmarkt groß genug ist und bereit ist, Preise zu zahlen, die auch die Forschungs- und Entwicklungskosten decken. Anthropic erklärte im Februar 2026 explizit in seinem Blogbeitrag: „Unser Geschäftsmodell ist einfach: Wir generieren Einnahmen durch Unternehmensverträge und kostenpflichtige Abonnements und reinvestieren diese Einnahmen in die Verbesserung von Claude für unsere Nutzer“. Diese Position hat es Dario Amodei ermöglicht, Claude als Premium-Angebot mit Fokus auf Vertrauen zu positionieren, eine Marketingpositionierung, die die Super-Bowl-Werbespots mit brutaler Wirksamkeit verstärkt haben.

Altman antwortete auf die Provokationen von Anthropic mit Argumenten, die sich auf die Zugänglichkeit konzentrierten: „Anthropic bietet ein teures Produkt für Reiche an. Wir freuen uns, dass sie das tun, und wir tun es auch, aber wir sind auch fest davon überzeugt, dass künstliche Intelligenz für Milliarden von Menschen zugänglich sein muss, die sich kein Abonnement leisten können“. Die Rhetorik von Zugänglichkeit gegenüber Reinheit verbirgt jedoch eine differenziertere Realität. Beide Unternehmen bieten kostenlose Stufen mit Nutzungsbeschränkungen an. ChatGPT hat Tarife für null, acht, zwanzig und zweihundert Dollar pro Monat; Claude für null, siebzehn, einhundert und zweihundert Dollar. Der wesentliche Unterschied liegt nicht im Basiszugang, sondern im langfristigen wirtschaftlichen Skalierungsmodell: Abonnements und Unternehmensverträge (langfristig nachhaltiger, aber mit langsamerem Wachstum) gegenüber explosivem Nutzerwachstum kurzfristig, gefolgt von späterer Monetarisierung (riskanter, erzeugt aber beeindruckende Kennzahlen für Investoren).

Scott Galloway, Professor für Marketing an der NYU Stern School of Business und Moderator des Podcasts Prof G Markets, hat den Super-Bowl-Zusammenstoß analysiert und dabei eine Dimension des Problems hervorgehoben, die in der technischen Debatte oft ignoriert wird: „Was Dario Amodei versteht und was diesen Werbespot so effektiv und gleichzeitig so bösartig macht, ist, dass, während Unternehmen über KI als Produktivitätssteigerer für das Geschäft debattieren, die Realität des tatsächlichen Nutzerverhaltens viel intimer und persönlicher ist“. Galloway argumentiert, dass der eigentliche Hauptanwendungsfall dieser Chatbots tatsächlich „Therapie“ im weitesten Sinne des Wortes ist: Menschen, die Chatbots Fragen, Sorgen und emotionale Verletzlichkeiten anvertrauen, die sie keinem Menschen gegenüber äußern würden. Werbung in eine funktionale Therapiesitzung einzuführen, schafft ein dystopisches Szenario, das Anthropic besonders geschickt zu nutzen wusste, um sich abzuheben.

Der Architekt, der die Baustelle verlässt

Zoë Hitzigs Entscheidung, OpenAI am Montag, den 10. Februar 2026, genau an dem Tag zu verlassen, an dem die Werbetests in den USA im großen Stil in Kraft traten, war nicht das Ergebnis eines emotionalen Impulses, sondern einer klaren und wohlüberlegten Abwägung. In ihrem Leitartikel für die New York Times, der am nächsten Tag veröffentlicht wurde, erläuterte Hitzig die Logik, die sie leitete, und verknüpfte ihre ökonomische Expertise mit einem tiefen Verständnis der Anreizmechanismen, die werbefinanzierte Plattformen beherrschen.

Hitzigs Perspektive ist besonders wertvoll, gerade weil sie nicht aus vorgefassten ideologischen Positionen oder einer allgemeinen technologiefeindlichen Stimmung resultiert, sondern aus der rigorosen strukturellen Analyse dessen, wie Märkte und Institutionen in der realen Welt funktionieren. Ihre akademische Arbeit zu Privatsphäre, Fairness und Transparenz in algorithmischen Systemen hat sie dafür sensibilisiert, wie scheinbar technische architektonische Entscheidungen zwangsläufig normative Werte enthalten, die letztlich das individuelle Verhalten und die gesellschaftliche Dynamik in massivem Ausmaß prägen.

Während ihrer fast zwei Jahre bei OpenAI beobachtete Hitzig von innen die wachsende Spannung zwischen der erklärten Mission des Unternehmens, „sicherzustellen, dass künstliche allgemeine Intelligenz der gesamten Menschheit zugute kommt“, und dem konkreten wirtschaftlichen Druck, eine finanzielle Nachhaltigkeit zu erreichen, die sich scheinbar immer weiter entfernt. Sie arbeitete an Preismodellen und Sicherheitsrichtlinien und trug zu Entscheidungen bei, die ständig versuchten, die Zugänglichkeit des Dienstes mit seiner wirtschaftlichen Tragfähigkeit in Einklang zu bringen. Die Einführung der Anzeigen stellte für sie einen Punkt ohne Wiederkehr dar, den Moment, in dem kurzfristige wirtschaftliche Anreize Gefahr laufen, die Neutralität der Plattform gegenüber den Nutzerinteressen unwiderruflich zu beeinträchtigen.

Die Entscheidung, ihr Ausscheiden und ihre tiefen Beweggründe durch einen Artikel in der New York Times öffentlich zu machen, ist bedeutsam und keineswegs trivial. Hitzig hätte das Unternehmen stillschweigend verlassen können, um gute berufliche Beziehungen aufrechtzuerhalten und künftige Optionen in einer Branche zu wahren, in der Netzwerke enorm zählen. Stattdessen entschied sie sich für die „Stimme“ statt des „Ausscheidens“ und nutzte ihr Reputationskapital, um auf einen Alarm hinzuweisen, den sie für die Zukunft der KI-Technologie für entscheidend hält. Dies ist kein üblicher Schritt unter Forschern und Wissenschaftlern, die Big Tech verlassen, wo strenge Geheimhaltungsvereinbarungen und langfristige Karriereüberlegungen normalerweise Diskretion und Diplomatie gebieten.

Virtueller Dialog mit Zoë Hitzig

Das folgende virtuelle Interview ist eine Rekonstruktion auf der Grundlage der Positionen, die Hitzig in ihrem Artikel für die New York Times vom 11. Februar 2026 dargelegt hat. Die Fragen sind retrospektiv formuliert, um die Argumentation hinter ihren öffentlichen Erklärungen zu erkunden und unterhaltsam zu gestalten, wobei die Konsistenz mit ihrem akademischen Hintergrund und ihrer Erfahrung bei OpenAI gewahrt bleibt.

Ihr Rücktritt fällt genau mit der Aktivierung der Werbetests zusammen. Was hat Sie dazu bewogen, einen normalen Jobwechsel in eine öffentliche Stellungnahme zu verwandeln?

Als ich im Mai 2024 bei OpenAI anfing, glaubte ich, dass das Unternehmen Wege der Monetarisierung finden könnte, die die Neutralität wahren. Ich arbeitete an der Preisgestaltung und versuchte, Nachhaltigkeit und Zugänglichkeit in Einklang zu bringen. Doch die Ankündigung der Werbung im Januar markierte einen Wendepunkt – nicht weil Werbung an sich böse ist, sondern weil sie Anreize schafft, die strukturell unvereinbar mit der Natur der Gespräche in ChatGPT sind. Ich habe mich entschlossen, die Gründe öffentlich zu machen, weil die Nutzer es verdienen zu verstehen, was sich ändert. Wenn es um Technologien geht, die intime Gedanken verarbeiten, ist Transparenz über wirtschaftliche Anreize nicht optional, sondern essenziell für eine informierte Zustimmung.

In Ihrem Artikel beschreiben Sie ChatGPT als „beispielloses Archiv menschlicher Offenheit“. Wie unterscheidet es sich von sozialen Netzwerken oder der Suche, die seit Jahren persönliche Daten sammeln?

Der Unterschied ist qualitativ. Bei Google formulieren Sie Anfragen, die auf Ergebnisse optimiert sind. In sozialen Medien sind Sie sich des Publikums bewusst. Doch mit einem KI-Chatbot treten Sie in einen anderen kognitiven Modus ein. Ein Eins-zu-eins-Gespräch ohne wahrgenommene soziale Bewertung, in dem Sie unvollständige Gedanken, Zweifel und Ängste erforschen können, die Sie nicht einmal Ihren engsten Freunden anvertrauen würden. Die 800 Millionen wöchentlichen Nutzer erstellen einen Gesprächsdatensatz, der erfasst, wie Menschen denken, wenn sie sich sicher fühlen. Das umfasst psychische Gesundheit, Beziehungen, persönliche Finanzen, existenzielle Zweifel. Er ist wertvoll für das Modelltraining, gerade weil er authentisch ist. Aber er ist eben wegen dieser Authentizität auch verletzlich.

OpenAI behauptet, dass Anzeigen die Antworten nicht beeinflussen werden, getrennt sind und die Daten für die Werbetreibenden privat bleiben. Sind das keine ausreichenden Garantien?

Diese Garantien adressieren das falsche Problem. Das tiefer liegende Problem ist, dass die Präsenz von Werbung die Optimierungsanreize auf Systemebene verändert. Sobald Werbung zu einer bedeutenden Einnahmequelle wird, wird jede Produktentscheidung durch dieses Prisma bewertet. Wie viel Zeit verbringen die Nutzer? Wie oft kehren sie zurück? Welche Gespräche erzeugen das meiste Engagement? Diese Kennzahlen werden zum Maßstab für Erfolg, und die ML-Teams optimieren darauf hin. Wir haben bereits gesehen, dass Modelle kriecherische (sycophantic) Tendenzen entwickeln – sie sagen das, was die Nutzer hören wollen, weil dies die Kundenzufriedenheit und -bindung maximiert. Werbung und entsprechende Anreize führen noch weiter zu längeren, häufigeren und emotional ansprechenderen Gesprächen. Man muss die Antworten nicht bewusst verändern; es reicht, auf die Kennzahlen zu optimieren, die dem Werbemodell dienen.

Aber OpenAI hat Verpflichtungen in Höhe von 1,4 Billionen und verliert Milliarden. Wie soll der kostenlose Zugang ohne Werbung finanziert werden? Alternativen schließen diejenigen aus, die nicht bezahlen können.

Das ist eine falsche Dichotomie. Es gibt Zwischenmodelle: Umsatzbeteiligung mit Unternehmen, die einen messbaren wirtschaftlichen Wert erzielen, anspruchsvollere Freemium-Modelle, bei denen Premium-Funktionen robuste Basisstufen finanzieren. Doch die grundlegende Frage lautet: Wer hat entschieden, dass OpenAI 800 Millionen Menschen pro Woche bedienen und gleichzeitig unbegrenzte kostenlose Stufen beibehalten muss, während es AGI anstrebt? Das sind strategische Entscheidungen, keine unvermeidlichen Sachzwänge. Wenn das aktuelle Modell nicht tragfähig ist, liegt das Problem vielleicht nicht an der fehlenden Werbung, sondern an einer zu aggressiven Skalierung zu einem zu frühen Zeitpunkt. Das Argument der Zugänglichkeit wird schwächer, wenn man bedenkt, dass die Alternative nicht zwangsläufig der totale Ausschluss ist. Anthropic bietet kostenlose Stufen mit vernünftigen Einschränkungen an, ohne Werbung.

Sie führen Facebook als Warnung an. Aber ist das nicht ein überzogener Vergleich? Facebook verheimlichte Richtlinienänderungen, OpenAI kündigt die Werbung transparent mit Trennungen und Kontrollen an.

Anfängliche Transparenz ist notwendig, aber nicht ausreichend. Facebook begann mit Versprechen, Nutzerkontrolle, Abstimmungen über Richtlinien und dem Bekenntnis zum Datenschutz. Die Erosion war ein schrittweiser Prozess, bei dem jeder einzelne Schritt für sich genommen vernünftig erschien. Das Muster lautet: (1) Man führt eine Funktion mit starken Schutzmaßnahmen ein. (2) Die Funktion wird geschäftskritisch. (3) Der Umsatzdruck wächst. (4) Die Schutzmaßnahmen werden schrittweise aufgeweicht, immer mit vernünftigen Begründungen. (5) Jahre später befindet man sich an einem völlig anderen Ort. Der Punkt ist nicht, dass OpenAI bereits Facebook ist, sondern dass die strukturellen Anreize des werbefinanzierten Modells mit der Zeit in diese Richtung drängen. Und ChatGPT hat einen Informationsvorsprung gegenüber den Nutzern, den Facebook nicht hatte: nicht nur das, was wir offen posten, sondern wie wir privat denken.

Sie sind Ökonomin. Wenn Werbung in ChatGPT problematisch ist, sollten die Nutzer dann nicht zu werbefreien Alternativen abwandern? Würde der Markt das nicht lösen?

Theoretisch ja, in der Praxis gibt es Reibungsverluste. Erstens: Netzwerkeffekte und Wechselkosten. Wenn man eine monatelange Chat-Historie hat, verursacht der Wechsel reale Kosten. Zweitens: Informationsasymmetrie. Die meisten verstehen die langfristigen Auswirkungen verschiedener Geschäftsmodelle nicht. Sie sehen „kostenlos gegen 20 $/Monat“, nicht „werbefinanziert mit potenzieller Manipulation gegen abonnementbasiert mit abgestimmten Anreizen“. Drittens: Der Schaden ist nicht nur individuell, sondern kollektiv. Selbst wenn Sie abwandern, normalisiert die Tatsache, dass Millionen weitermachen, die Vorstellung, dass intime Gespräche legitime Werbeflächen sind. Es verändert die Erwartungen für alle künftigen LLMs. Als Ökonomin erkenne ich an, dass einige Märkte Regulierung erfordern, weil externe Kosten nicht in den Preisen erfasst werden.

Ihre Position impliziert, dass konversationelle LLMs grundlegend anders sind. Was macht sie so besonders?

Zum ersten Mal verfügen wir über Technologien, die das wechselseitige menschliche Gespräch auf einem Niveau simulieren, das eine echte emotionale Offenlegung von Milliarden Menschen explizit macht. Es ist nicht nur Targeting auf Basis beobachteter Verhaltensweisen, es ist der direkte Zugriff auf den Denkprozess in dem Moment, in dem er stattfindet, ungefiltert für ein externes Publikum. Chatbots haben die Illusion des privaten Tagebuchs geschaffen, aber mit einer Social-Media-Infrastruktur. Diese Kombination verleiht dem Plattformbetreiber eine beispiellose Manipulationskraft. Er muss nicht über indirekte Signale raten, was Sie wollen – Sie sagen es ihm direkt. Meine rote Linie verläuft hier, weil dies der Moment ist, in dem wir noch ein anderes Modell wählen können. In fünf Jahren wird es zu spät sein – Präzedenzfälle sind geschaffen, Erwartungen geformt und Anreize verfestigt.

Was erhoffen Sie sich von Ihrem öffentlichen Abgang?

Ich erwarte nicht, dass OpenAI morgen einlenkt. Aber ich hoffe, zu einer fundierteren Debatte darüber beizutragen, was wir von KI-Technologien erwarten und welche Kompromisse wir akzeptieren. Zu oft finden diese Gespräche nur unter Experten in Begriffen statt, die Wertentscheidungen verschleiern. Ich möchte, dass die Nutzer wissen, was sich ändert und warum. Dass die politischen Entscheidungsträger verstehen, dass dies ernsthafte regulatorische Aufmerksamkeit erfordert. Dass andere Forscher innerhalb der Branche das Gefühl haben, dass es legitim ist, ihre Stimme gegen gefährliche Entscheidungen zu erheben. Es gibt eine Tech-Kultur, in der Unternehmenstreue vor öffentlichen Belangen steht. Aber wenn es um Technologien geht, die Milliarden betreffen, wird berufliches Schweigen zur Komplizenschaft.

Haben Sie noch Hoffnung, dass die KI-Industrie sich so entwickeln kann, dass sie der Menschheit dient?

Ich bewahre mir die Hoffnung, sonst hätte ich nicht jahrelang an diesen Problemen gearbeitet. Doch die Hoffnung muss mit kritischer Wachsamkeit und Verantwortung einhergehen. KI hat ein echtes Potenzial, das habe ich direkt gesehen. Das Problem ist nicht die Technologie, sondern die Governance-Strukturen und die Geschäftsmodelle, die ihre Entwicklung leiten. Wir können immer noch leistungsstarke KI-Systeme bauen, ohne manipulativ zu sein, Zugänglichkeit ohne Werbung schaffen, Gewinne erzielen, ohne ausbeuterisch zu sein. Aber das erfordert jetzt schwierige Entscheidungen. Mein Abgang ist keine Kapitulation, sondern eine Verpflichtung, aus Positionen heraus zu arbeiten, in denen ich freier beitragen kann. Die Zukunft der KI ist nicht vorherbestimmt. Wir haben noch Zeit, andere Wege zu wählen. Aber nur, wenn genug Menschen entscheiden, dass es sich lohnt, für diese Entscheidungen zu kämpfen.