Der Code, der nicht geschrieben wird: CodeSpeak und die Revolution der Spezifikationen

Es gibt Namen, die in der Welt der Programmierung ein besonderes Gewicht haben. Andrey Breslav ist einer von ihnen. Wenn heute Millionen von Android-Entwicklern Code in Kotlin statt in Java schreiben, ist das zu einem großen Teil sein Verdienst: Breslav ist der Hauptentwickler der Sprache, die JetBrains 2011 auf den Markt brachte und die Google 2017 während der Google I/O, die das mobile Ökosystem für immer veränderte, offiziell als bevorzugte Sprache für Android einführte. Er ist kein Akademiker, der von einem Lehrstuhl aus theoretisiert: Er gehört zu denen, die Werkzeuge gebaut haben, die täglich von Hunderttausenden von Menschen in der realen Welt benutzt werden – mit all den Kompromissen, Produktionsfehlern und dem Druck, den dies mit sich bringt.

Diese Einleitung ist keine Hommage um ihrer selbst willen. Sie dient dem Verständnis dafür, warum sein neues Projekt, CodeSpeak, Aufmerksamkeit weit über die Grenzen der üblichen experimentellen Sprachen-Vorschauen hinaus verdient, die auf GitHub florieren. Wenn Breslav sagt, er wolle die Art und Weise überdenken, wie Menschen im Zeitalter der KI-Agenten mit Code interagieren, dann tut er dies mit dem Hintergrund von jemandem, der diesen Weg bereits einmal gegangen ist und weiß, wo die Fallen lauern. Wie er Gergely Orosz im Podcast des Pragmatic Engineer erzählte, betrifft die tiefste Lektion von Kotlin nicht die Syntax oder das Typsystem, sondern die Interoperabilität: Eine neue Sprache, die nicht friedlich mit dem koexistieren kann, was bereits vorhanden ist, ist dazu verdammt, ein Experiment zu bleiben. Dies ist ein Prinzip, das er direkt auf CodeSpeak übertragen hat.

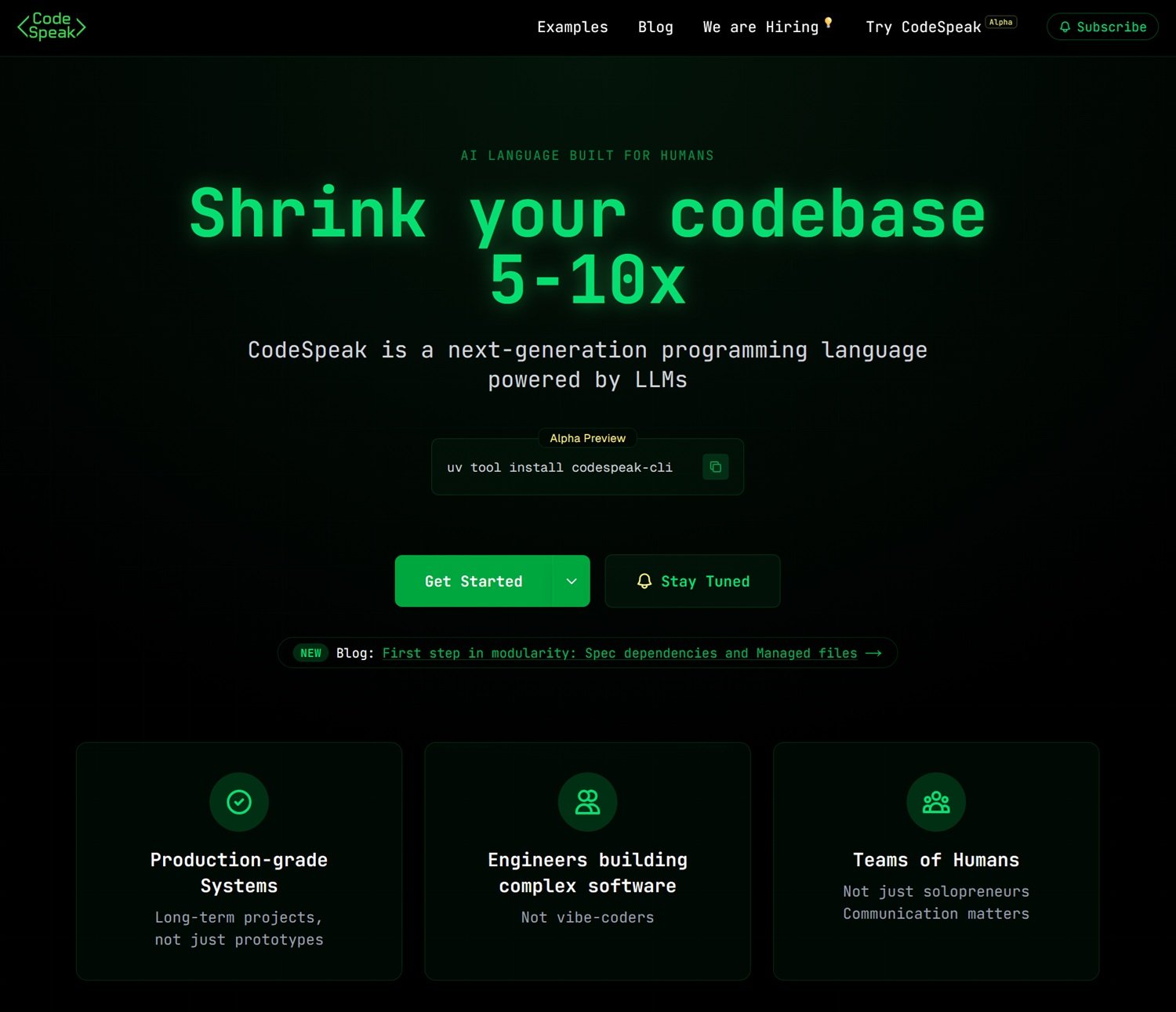

Das Projekt befindet sich in der Alpha Preview, ein Detail, das man während der gesamten Lektüre im Hinterkopf behalten sollte, und ist um eine Idee herum aufgebaut, die, in einem Satz gesagt, fast provokativ klingt: Was wäre, wenn wir aufhören würden, Code zu pflegen, und anfangen würden, Spezifikationen zu pflegen?

Spezifikation, nicht Code: Ein Paradigmenwechsel

Um zu verstehen, was CodeSpeak vorschlägt, muss man zunächst einen Schritt zurücktreten und das Problem betrachten, das es zu lösen versucht. Jeder, der an einem Softwareprojekt mittlerer Komplexität gearbeitet hat, kennt das Gefühl: Der Code wächst. Er wächst, wenn Funktionen hinzugefügt werden, er wächst, wenn Fehler behoben werden, er wächst, wenn neue Entwickler hinzukommen, die die Spezifikationen etwas anders interpretieren als ihre Vorgänger. Mit dem Aufkommen von KI-Agenten, die in Sekundenschnelle Tausende von Zeilen generieren, droht dieses Wachstum unkontrollierbar zu werden. Nicht weil der generierte Code notwendigerweise falsch ist, sondern weil ihn niemand mehr in seiner Gesamtheit im Kopf behalten kann.

Der Boden, auf dem CodeSpeak gedeiht, ist nicht neutral. Im Februar 2025 prägte Andrej Karpathy, Mitbegründer von OpenAI und ehemaliger KI-Direktor von Tesla, den Ausdruck "Vibe Coding", um eine bereits weit verbreitete Praxis zu beschreiben: Einem KI-Agenten Anweisungen in natürlicher Sprache zu geben und den generierten Code zu akzeptieren, ohne ihn wirklich zu lesen, im Vertrauen auf das Gefühl, dass er "funktioniert". Der Original-Post auf X sammelte innerhalb weniger Tage Millionen von Aufrufen, und der Begriff fand bereits im März desselben Jahres Eingang in das Merriam-Webster-Wörterbuch – eine Geschwindigkeit, die Bände darüber spricht, wie real das Phänomen bereits war. CodeSpeak entstand genau als strukturierte Antwort auf diese Entwicklung: Es leugnet nicht, dass LLMs nützlichen Code schreiben können, behauptet aber, dass es Codebasen erzeugt, die niemand mehr wirklich versteht, wenn man den Agenten erlaubt, ohne formale Einschränkungen zu generieren.

CodeSpeak schlägt vor, den Fokus zu verschieben: Anstatt Implementierungscode zu schreiben und zu pflegen, pflegt das Team Spezifikationsdateien – kompakte, für Menschen lesbare Dokumente, die in einem strukturierten Markdown mit eigener Syntax geschrieben sind. Das System kümmert sich dann darum, diese Spezifikationen in funktionierenden Code zu übersetzen, wobei ein Sprachmodell (derzeit Claude von Anthropic, was die Voraussetzung eines API-Schlüssels erklärt) als Generierungs-Engine dient.

Die nützlichste Analogie für diejenigen, die keinen Code schreiben, ist die mit technischen Zeichnungen in der Architektur. Ein Architekt baut das Gebäude nicht Stein für Stein: Er zeichnet die Grundrisse, spezifiziert die Materialien, definiert Proportionen und Lasten. Die Bauarbeiter oder in diesem Fall das LLM kümmern sich um die konkrete Ausführung. Wenn der Architekt die Anordnung eines Raumes ändern will, reißt er nicht ab und baut neu: Er aktualisiert die Pläne, und die Baustelle passt sich an. CodeSpeak funktioniert genau so: Man ändert die Spezifikation, startet codespeak build, und der Code wird entsprechend aktualisiert.

Dieser Ansatz fügt sich in eine breitere Debatte ein, die in der Welt der Softwareentwicklung unter verschiedenen Namen geführt wird: Spec-driven Development, Intent-based Programming oder allgemeiner die Idee, dass die nächste Abstraktionsebene nicht neue Programmiersprachen im herkömmlichen Sinne sind, sondern neue Wege, die Absicht an KI-Agenten zu kommunizieren. Der Unterschied zum einfachen "Prompt Engineering", also dem Geben von Anweisungen an einen Chatbot, besteht darin, dass CodeSpeak Struktur, Versionierung und Testbarkeit einführt. Die Spezifikationen leben in einem Git-Repository, werden wie jedes andere Code-Artefakt verfolgt, und ihre Wirkung wird durch bestehende Test-Suites gemessen. Es ist kein Vibe Coding: Es ist Software Engineering auf einer höheren Abstraktionsebene.

Wie es funktioniert: Von der CLI zum Takeover

Technisch gesehen wird CodeSpeak mit einem einzigen Terminalbefehl installiert, uv tool install codespeak-cli, und erfordert einen Anthropic-API-Schlüssel, den der Benutzer selbst mitbringt (das Modell ist BYOK, Bring Your Own Key). Von dort aus gliedert sich der Arbeitsablauf in drei Hauptmodi, die für verschiedene Szenarien gedacht sind.

Der einfachste Modus ist der von Grund auf neu (Greenfield): Man initialisiert ein CodeSpeak-Projekt, schreibt die Spezifikationen in Markdown-Dateien mit der Endung .cs.md, startet codespeak build, und das System generiert den entsprechenden Python-Code, führt die Tests aus und meldet, ob alles funktioniert. Eine Spezifikation für eine CLI-Anwendung zur Verwaltung von Notizen könnte buchstäblich zehn Zeilen lesbaren Text umfassen und eine funktionierende Anwendung inklusive Befehlen, Speicherverwaltung und Terminaloberfläche erzeugen.

Der interessanteste Modus, und derjenige mit den meisten praktischen Auswirkungen für diejenigen, die an bestehenden Projekten arbeiten, ist der Mixed Mode. CodeSpeak verlangt nicht, den bereits existierenden Code wegzuwerfen: Es kann mit ihm koexistieren. Man initialisiert mit codespeak init --mixed, und von diesem Moment an wird das Projekt hybrid: Einige Teile werden weiterhin von den Entwicklern von Hand geschrieben, andere werden durch Spezifikationen verwaltet. Das LLM "sieht" während der Generierung beide Teile und kann den manuellen Code als Kontext nutzen, um die Spezifikationen korrekt zu implementieren. Es ist ein pragmatischer Kompromiss, der nicht zufällig an die Entscheidung von Kotlin erinnert, vom ersten Tag an volle Interoperabilität mit Java zu gewährleisten.

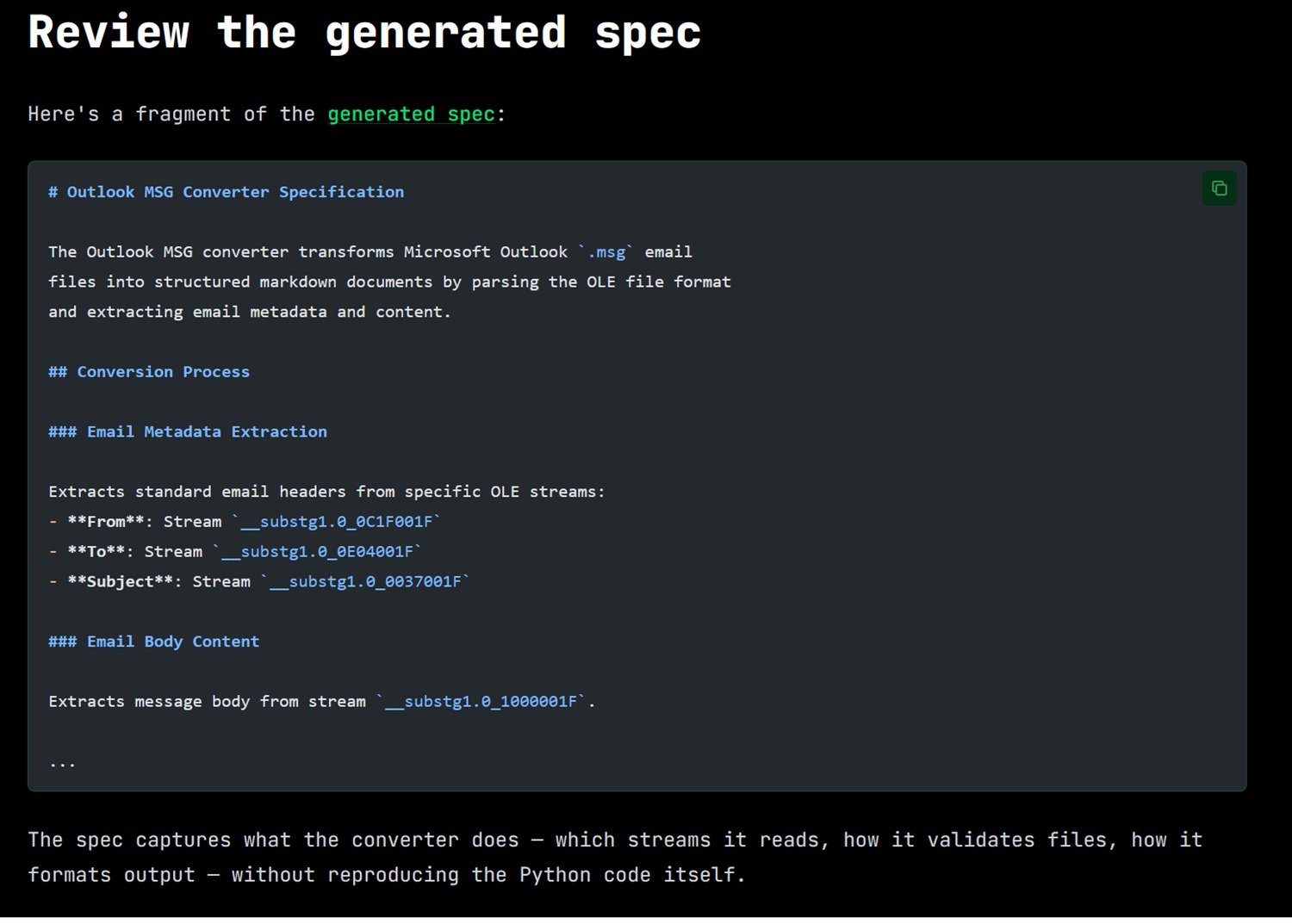

Das dritte Szenario, das kürzlich mit dem Befehl codespeak takeover eingeführt wurde, ist vielleicht das beeindruckendste: Gegeben eine existierende Codedatei – auch Legacy-Code, auch vor Jahren von jemand anderem geschrieben – liest CodeSpeak den Quellcode und extrahiert daraus automatisch eine kompakte Spezifikation. Von diesem Moment an rührt man zum Ändern dieser Komponente den Python-Code (oder eine andere Sprache) nicht mehr an: Man ändert die Spezifikation und startet den Build neu. Im offiziellen Blog-Post, der diese Funktion erläutert, nutzte das Team Microsofts Open-Source-Projekt MarkItDown, einen Dokumenten-zu-Markdown-Konverter, als Versuchskaninchen. Sie nahmen die Datei, die für die Konvertierung von Outlook-.msg-Dateien verantwortlich ist, extrahierten eine Spezifikation von wenigen Dutzend Zeilen und nutzten diese dann, um einen realen, auf GitHub gemeldeten Fehler zu beheben. Und das alles, ohne eine einzige Zeile Python anzurühren. Die Änderung an der Spezifikation – das Hinzufügen der Unterstützung für fehlende Cc-, Bcc-, Datums- und Anhangsfelder – umfasste 23 Zeilen; der daraus resultierende generierte Code umfasste 221 Zeilen. Ein Verhältnis von etwa 10 zu 1.

Modularität: Wenn Spezifikationen zum System werden

Eine Sprache, die nur für kleine Projekte funktioniert, ist ein Laborexperiment. Um zu einem professionellen Werkzeug zu werden, muss sie skalieren. Und hier kommen die Modularitätsfunktionen ins Spiel, die das Team am 9. März 2026 mit der Version 0.3.4 veröffentlicht hat: die Spec Dependencies und die Managed Files.

Die Idee der Spec Dependencies ist analog zu der von Modulen in traditionellem Code: Eine Spezifikation kann erklären, dass sie von einer anderen abhängt, indem sie eine einfache Direktive im Frontmatter der Markdown-Datei verwendet. Wenn die Spezifikation der Befehlszeilenschnittstelle einer Anwendung von der Spezifikation der Datenspeicherschicht abhängt, baut CodeSpeak zuerst die Speicherschicht, dann die Schnittstelle und garantiert so, dass letztere das, was erstere bereitstellt, korrekt nutzen kann. Und wenn nur die Speicher-Spezifikation geändert wird (indem zum Beispiel das Backend mit einer einzigen Textzeile von JSON auf SQLite umgestellt wird), baut CodeSpeak nur diesen Teil neu, ohne den Rest anzurühren.

Managed Files sind hingegen ein Governance-Mechanismus: Jede Spezifikation "weiß", welche Codedateien in ihrer Verantwortung liegen. Wenn CodeSpeak während eines Builds eine Datei ändern muss, die nicht zur aktuellen Spezifikation gehört – zum Beispiel die Datei für die Abhängigkeitskonfiguration des Projekts –, tut es dies, warnt den Entwickler aber explizit. Die gesamte Logik erinnert an die Unterscheidung zwischen Besitz und Zugriff in Zugriffssteuerungssystemen: Jede Spezifikation hat ihre Domäne, und Grenzverletzungen werden gemeldet und nicht stillschweigend toleriert. Für Teams, die an großen und komplexen Codebasen arbeiten, ist dies eine nicht unerhebliche Garantie gegen unerwünschte Nebenwirkungen von Änderungen.

Die Zahlen: Wie stark wird der Code wirklich reduziert?

Die auf der offiziellen Website veröffentlichten Fallstudien sind das am konkretesten überprüfbare Element des gesamten Vorschlags. Das Team nahm vier reale Open-Source-Projekte, keine ad hoc konstruierten Spielzeugbeispiele, und generierte die entsprechenden Spezifikationen für signifikante Teile ihres Codes, wobei sie die Reduzierung der Zeilenanzahl maßen.

Bei yt-dlp, dem bekannten Video-Downloader, schrumpfte die Komponente für die Verwaltung von WebVTT-Untertiteln von 255 Codezeilen auf 38 Spezifikationszeilen – ein Reduktionsfaktor von 6,7. Bei Faker, der Python-Bibliothek zur Generierung von Testdaten, sank der italienische Steuernummer-Generator von 165 auf 21 Zeilen (7,9-fach). Bei BeautifulSoup4, der HTML-Parsing-Bibliothek, ist das Modul zur automatischen Kodierungserkennung der beeindruckendste Fall: 826 Codezeilen wurden auf 141 Spezifikationszeilen reduziert (Faktor 5,9). Und bei MarkItDown, dem bereits erwähnten Konverter von Microsoft, schrumpfte das EML-Modul von 139 auf 14 Zeilen, was einem Faktor von 9,9 entspricht – fast das Zehnfache.

Beeindruckender als die absoluten Zahlen ist jedoch der Wert bei den Tests. In allen vier Fällen bestand die Test-Suite nach der Regenerierung des Codes nicht nur weiterhin, sondern die Anzahl der erfolgreich bestandenen Tests erhöhte sich: 37 hinzugefügte Tests bei yt-dlp, 13 bei Faker, 25 bei BeautifulSoup4, 27 bei MarkItDown. Die Code-Reduzierung ist keine Kosmetik – es geht nicht darum, den Quellcode durch das Entfernen von Kommentaren und Leerzeichen zu komprimieren –, sondern um die Beseitigung konzeptioneller Redundanz, indem man dem LLM die Implementierungsdetails überlässt, die, wie Breslav es nennt, "für Maschinen offensichtlich" sind. Was in der Spezifikation übrig bleibt, ist nur das, was domänenspezifisch ist: Geschäftsregeln, Architekturentscheidungen, Grenzfälle.

Davon abgesehen ist es ehrlich, auf eine methodische Grenze hinzuweisen: Diese Tests wurden vom CodeSpeak-Team selbst an ausgewählten Teilen von Open-Source-Projekten durchgeführt. Es handelt sich nicht um unabhängige Benchmarks auf beliebigen Codebasen. Die Frage, wie sich das System bei besonders komplexem Code mit zirkulären Abhängigkeiten oder einer über viele Dateien verteilten Logik verhält, bleibt vorerst ohne dokumentierte Antwort.

Menschlicher oder weniger menschlich?

Es gibt eine immer wiederkehrende Versuchung, wenn man über KI-Werkzeuge für die Softwareentwicklung spricht, in eine von zwei symmetrischen Fallen zu tappen: Entweder in Triumphalismus ("Die KI wird alles machen, Programmierer sind obsolet") oder in Negationismus ("Es ist nur ein glorifiziertes Autocomplete, nichts Neues unter der Sonne"). CodeSpeak lässt sich in keine dieser beiden Erzählungen einordnen, und das ist wahrscheinlich sein interessantester Zug.

Um zu verstehen, wie es sich im Vergleich zu bestehenden Werkzeugen positioniert, lohnt sich ein direkter Vergleich. GitHub Copilot und seine Pendants wie Cursor, Junie von JetBrains und die Vielzahl der in IDEs integrierten Assistenten arbeiten am Code als primärem Artefakt: Sie schlagen Zeilen vor, vervollständigen Funktionen, generieren manchmal ganze Blöcke. Sie sind außerordentlich nützliche Werkzeuge, aber ihr konzeptionelles Modell ändert sich nicht: Der Entwickler schreibt Code, die KI hilft dabei, Code schneller zu schreiben. Neuere KI-Agenten wie Claude Code oder die "LLM + Tools"-Pipelines, die sich gerade verbreiten, gehen einen Schritt weiter: Sie können durch Dateien navigieren, Befehle ausführen, Pull Requests öffnen. Aber auch in diesem Fall ist das Artefakt, das sie erzeugen und ändern, der Code. Und Code, der von autonomen Agenten generiert wird, die sich selbst modifizieren, ist, wie Breslav im Podcast mit dem Pragmatic Engineer explizit betonte, eine Quelle zunehmender Intransparenz. Wer kontrolliert was, wenn etwas nicht mehr funktioniert?

CodeSpeak beantwortet diese Frage mit einer radikalen Entscheidung: Den generierten Code aus dem Zentrum der menschlichen Aufmerksamkeit zu nehmen und an seine Stelle die Spezifikationen zu setzen. Das LLM ist kein Assistent, der Vorschläge macht, sondern ein Compiler, der ausführt. Der Unterschied ist nicht nur semantisch: Er verändert den Vertrag zwischen Entwickler und Maschine grundlegend. Der Entwickler überprüft nicht den generierten Code Zeile für Zeile (eine Tätigkeit, die bei Ausgaben von Hunderten von Zeilen, die in Sekunden produziert werden, in der Praxis oft illusorisch ist); er überprüft die Spezifikation, die kompakt, lesbar und wie jedes andere Dokument in Git versioniert ist. Der generierte Code ist in dieser Vision ein Zwischenartefakt, vergleichbar mit Java-Bytecode oder dem von einem C-Compiler erzeugten Assembler: Etwas, das man im Prinzip inspizieren kann, das aber im täglichen Gebrauch nicht der Punkt ist, an dem sich das Denken konzentriert.

Dies hat konkrete Auswirkungen auf den Workflow der Teams. In einem reifen CodeSpeak-Projekt denken Produktmanager und Tech-Leads in Form von ausführbaren Spezifikationen – Dokumenten, die beschreiben, was das System tun soll, nicht wie es das tut. Entwickler kümmern sich mehr um die Qualität dieser Spezifikationen und der zugehörigen Tests als um das Detail jeder einzelnen Funktion. Code-Reviews verlagern sich: Anstatt über Variablennamen und Implementierungsentscheidungen zu kommentieren, wird darüber diskutiert, ob die Spezifikation das erwartete Verhalten korrekt erfasst. Es ist ein nicht trivialer konzeptioneller Sprung, vergleichbar mit dem Übergang vom Freihandzeichnen zu parametrischen Designsystemen in der Welt des Designs: Man zeichnet nicht mehr jedes Element einzeln, man definiert die Regeln, die es erzeugen.

Es gibt jedoch eine Frage, die die enthusiastischsten Befürworter gerne übergehen: Ist die Spezifikation wirklich lesbarer und verständlicher als der Code? Für einfache und klar abgegrenzte Funktionen ist die Antwort fast sicher ja. Aber bei komplexer Logik mit subtilen Abhängigkeiten zwischen Komponenten und Verhaltensweisen, die erst aus dem Zusammenspiel vieler Teile entstehen, droht die Spezifikation selbst zu einem dichten und schwer zu pflegenden Dokument zu werden. Man verschiebt das Problem eher, als dass man es löst, und das Risiko besteht darin, dass die aus dem Code entfernte Komplexität in der Spezifikation in weniger strukturierter und daher schwerer nachvollziehbarer Form wieder auftaucht. Es ist die gleiche Kritik, die in den letzten zehn Jahren an Low-Code- und No-Code-Systemen geäußert wurde: Abstraktion beseitigt Komplexität nicht, sie verbirgt sie, und wenn sie wieder zum Vorschein kommt, dann an Stellen, an denen es weniger Werkzeuge gibt, um mit ihr umzugehen.

Lock-in, Risiken und offene Fragen

Ehrlich zu einem Projekt in der Alpha Preview zu sein, bedeutet auch, sich mit dem auseinanderzusetzen, was noch nicht funktioniert oder was vielleicht nie so funktionieren wird wie erhofft. CodeSpeak wirft eine Reihe berechtigter Fragen auf, denen man sich ohne Umschweife stellen sollte.

Das erste Risiko ist das des technologischen Lock-in. Wer CodeSpeak einführt, verlässt sich auf eine proprietäre Sprache, eine spezifische Toolchain und einen LLM-Anbieter (derzeit Anthropic) für die Codegenerierung. Wenn das Projekt morgen die Richtung ändert, das Unternehmen, das es entwickelt, schließt oder das Preismodell der Anthropic-API unerschwinglich wird, was passiert dann mit dem generierten Code? Technisch gesehen existiert der Python-Code (oder eine andere Zielsprache) weiter und ist lesbar – das Produkt der Arbeit geht nicht verloren. Aber man verliert die Fähigkeit, ihn über die Spezifikationen zu pflegen, was bedeutet, dass man wieder am Anfang steht – mit der zusätzlichen Schwierigkeit, an Code zu arbeiten, der nicht von Hand geschrieben wurde und möglicherweise nicht offensichtliche Strukturen aufweist.

Das zweite Risiko betrifft die Mehrdeutigkeit der Spezifikationen. Ein traditioneller Compiler ist deterministisch: Bei gleichem Quellcode erzeugt er immer die gleiche Ausgabe. Ein LLM ist das nicht. Zwei aufeinanderfolgende Builds derselben Spezifikation können funktional äquivalenten, aber strukturell unterschiedlichen Code erzeugen, was das Debugging, die Versionierung und das Verständnis dessen, was sich warum geändert hat, erschwert. Das CodeSpeak-Team hat Tests als Stabilisierungsmechanismus eingeführt (wenn die Tests bestehen, ist der Code per Definition korrekt), aber dies erfordert eine ausreichend vollständige und gut konzipierte Test-Suite. In Projekten, in denen Tests rar oder schlecht geschrieben sind – und das sind viel mehr, als man zugibt –, verliert das System einen seiner wichtigsten Rettungsringe.

Das dritte Risiko ist das des intransparenten Debuggings. Wenn sich der generierte Code nicht so verhält, wie es die Spezifikation beschreibt, wo sucht man dann nach dem Fehler? In der (mehrdeutigen) Spezifikation, im (falsch interpretierenden) Modell, in der (stillschweigend geänderten) API-Version, im (vom LLM nur teilweise gelesenen) Projektkontext? Die Kausalkette verlängert sich und damit auch die Zeit, die benötigt wird, um den Fehler zu isolieren und zu beheben. Das Team nennt dies als einen der prioritären Verbesserungsbereiche in der Roadmap, aber derzeit ist es eine reale Grenze, mit der jeder rechnen muss, der CodeSpeak in der Produktion einsetzen will.

Schließlich gibt es die Frage der Portabilität. CodeSpeak unterstützt heute Python und nur Python. Die Erweiterung auf andere Sprachen steht auf der Roadmap, hat aber noch kein Datum. Für die große Mehrheit der Unternehmensprojekte, die Java, TypeScript, Go oder polyglotte Stacks verwenden, ist dies eine erhebliche Eintrittsbarriere.

Dennoch wäre es unfair, diese Einschränkungen zu nutzen, um das Projekt abzutun. Es sind die normalen Grenzen einer Alpha-Version, keine strukturellen Mängel der Idee. Die interessantere Frage ist nicht "Funktioniert es jetzt perfekt?" – die Antwort ist offensichtlich nein –, sondern "Hält die Idee unter Druck stand?". Und hier ist die Antwort weniger eindeutig und interessanter.

Roadmap und Perspektiven

Die öffentliche Roadmap, die aus den Blog-Posts hervorgeht, ist in ihren Prioritäten recht klar. Das Thema Modularität, das im März 2026 mit den Spec Dependencies und den Managed Files eingeführt wurde, ist die Hauptbaustelle: Spezifikationen komponierbar und wiederverwendbar zu machen, ist die Voraussetzung für die Skalierung auf Projekte realer Größe. codespeak takeover befindet sich in der Phase der Verfeinerung: Das erklärte Ziel ist es, sicherzustellen, dass die aus existierendem Code extrahierte Spezifikation vollständig genug ist, um eine äquivalente Implementierung von Grund auf neu generieren zu können, die alle ursprünglichen Tests besteht. Es gibt noch keine Ankündigungen zur Unterstützung anderer Sprachen außer Python oder zur Integration in CI/CD-Systeme.

Die strategische Grundfrage ist, ob CodeSpeak den Anspruch erheben kann, zu einem De-facto-Standard für das zu werden, was einige bereits "KI-native Programmierung" nennen – den Entwurf von Sprachen und Werkzeugen, die von Anfang an für eine Welt gedacht sind, in der ein Teil der Ausführung an Sprachmodelle delegiert wird –, oder ob es ein Nischenwerkzeug bleiben wird, das von Teams mit extrem hoher Testdisziplin und klar abgegrenzten Anwendungsfällen eingesetzt wird. Die Antwort wird zum Teil von der Qualität der Ausführung abhängen, zum Teil von der Entwicklung der zugrunde liegenden Modelle und zum Teil von Ökosystemfaktoren, die heute schwer vorhersehbar sind.

Breslav hat eine klare Position zum breiteren Kontext. Im Dialog mit dem Pragmatic Engineer erklärte er, dass 2026 das Jahr der Wiedergeburt der integrierten Entwicklungsumgebungen gegenüber Terminal-Werkzeugen sein wird, nicht aus Nostalgie, sondern weil KI-Agenten innerhalb strukturierter Umgebungen, die einen reichen Kontext bieten, besser arbeiten. Dies ist eine Vorhersage, die perfekt mit der Philosophie von CodeSpeak übereinstimmt: Nicht der freie Prompt im Leeren, sondern die menschliche Absicht, die in Strukturen gelenkt wird, die die Maschine zuverlässig interpretieren kann.

Ein Beruf im Wandel

Über all dem schwebt eine Frage, die über technische Überlegungen hinausgeht: Was passiert mit der Arbeit der Entwickler in einer Welt, in der ein Werkzeug wie CodeSpeak gut funktioniert?

Die oberflächliche Antwort, die in den sozialen Medien am häufigsten vorkommt, lautet, dass Programmierer obsolet werden. Breslav weist dies explizit mit einem Satz zurück, den man in seiner Gänze zitieren sollte: "In Zukunft werden es immer noch Ingenieure sein, die komplexe Systeme bauen. Denkt daran: Es ist nicht so, dass wir alle im Nichts verschwinden werden." Das ist kein Zweckoptimismus: Es ist die gleiche Logik, die jeden Abstraktionssprung in der Geschichte der Informatik geleitet hat. Assembler hat die Programmierer nicht verdrängt; C hat die Programmierer nicht verdrängt; Hochsprachen haben die Programmierer nicht verdrängt. Sie haben verändert, was sie tun, indem sie den Schwerpunkt der Arbeit von der Verwaltung mechanischer Details hin zur konzeptionellen Modellierung des Problems verlagert haben.

CodeSpeak verschiebt diesen Schwerpunkt noch weiter, wenn es seine Versprechen hält. Weniger Zeit für das Schreiben von Boilerplate-Code, mehr Zeit für das Nachdenken darüber, was das System tun soll, für das Entwerfen der Tests, die sein Verhalten überprüfen, für das Schreiben von Spezifikationen, die präzise sind, ohne starr zu sein. Das ist eine Arbeit, die eher der eines Software-Architekten als der eines Code-Handwerkers ähnelt. Historisch gesehen hat diese Art des Übergangs mehr Wert geschaffen als zerstört, auch wenn sie Rollen und Kompetenzen auf eine nicht schmerzfreie Weise neu verteilt hat.

Das reale Risiko ist nicht das Verschwinden des Programmierers: Es ist die Konzentration der Möglichkeiten. Wenn die Wartung eines komplexen Systems nur noch ein Zehntel der Codezeilen erfordert, braucht es vielleicht auch weniger Entwickler, um es zu warten. Die Effizienzsteigerung der diszipliniertesten Teams könnte sich, zumindest kurzfristig, in Druck auf den Personalbestand übersetzen. Es ist das klassische Paradoxon der technologischen Produktivität: Sie schafft in der Gesamtheit Reichtum, verteilt ihn aber in der Übergangsphase asymmetrisch.

Für jüngere Entwickler stellt sich zudem die Frage des Lernens. Programmieren zu lernen, indem man Code schreibt – mit all den Fehlern, den um drei Uhr morgens geöffneten Debuggern, dem langsamen Verständnis dafür, wie Speicher oder Networking wirklich funktionieren –, ist ein Bildungsweg, der eine eigene Logik hat. Eine Welt, in der Code aus Spezifikationen generiert wird, droht diese Verstehensschichten zu verbergen. Das ist kein unlösbares Problem – auch Mediziner lernen Anatomie, auch wenn sie Operationen nicht mehr mit bloßen Händen durchführen –, aber es ist eine Frage, die die Branche bewusst angehen muss, anstatt darauf zu hoffen, dass sie sich von selbst löst.

Eine Sprache für Menschen und Maschinen

Um dorthin zurückzukehren, wo wir begonnen haben – zu Breslavs Profil und den Lektionen von Kotlin – gibt es einen roten Faden, der sich durch die gesamte Geschichte von CodeSpeak zieht und den man explizit machen sollte. Kotlin entstand unter anderem aus der Feststellung heraus, dass Java stagnierte: Die Sprache entwickelte sich nicht mit der von den Entwicklern geforderten Geschwindigkeit, und der Markt war bereit für etwas Besseres. CodeSpeak entstand aus einer analogen, aber umgekehrten Feststellung: Bestehende Sprachen entwickeln sich zu langsam im Vergleich zur Geschwindigkeit, mit der KI-Agenten die Art und Weise verändern, wie Code produziert wird. Es geht nicht um eine ergonomischere Sprache für Menschen, sondern um die erste Sprache, die explizit für ein System entwickelt wurde, in dem Menschen und LLMs zusammenarbeiten und jeder den Teil übernimmt, für den er am besten geeignet ist.

Wenn diese Wette aufgeht, könnte CodeSpeak für mehr stehen als nur für ein nützliches Werkzeug: Es könnte das erste Beispiel für eine neue Kategorie sein, die der "KI-nativen" Sprachen, die von Anfang an für eine Welt konzipiert wurden, in der die automatische Codegenerierung keine Ausnahme, sondern die Norm ist. Wenn sie nicht aufgeht – aufgrund technischer Grenzen, mangelnder Akzeptanz oder weil die Entwicklung der Modelle selbst den Ansatz obsolet macht –, wird sie dennoch ein wertvolles Experiment bleiben, das geklärt hat, welches die richtigen Fragen sind, die man stellen muss.

Breslav schließt sein Interview mit einer Einladung, die eher wie eine Herausforderung klingt: "Man sollte nicht blind alles glauben, was man auf Twitter liest: Manche Leute behaupten absurde Dinge. Wenn man sie jedoch richtig einsetzt, können diese Werkzeuge sehr produktiv sein, und es lohnt sich absolut, in sie zu investieren." Es ist der Ton von jemandem, der bereits einen Hype-Zyklus durchlebt hat – den von Kotlin – und weiß, dass zwischen der anfänglichen Begeisterung und dem dauerhaften Nutzen immer eine schwierige Wegstrecke liegt. CodeSpeak steht am Anfang dieser Strecke. Es lohnt sich, es zu verfolgen.