MiniMax M2.7: Die KI, die (fast) von selbst lernt

Ein Monat. Das ist die Zeit, die M2.5 von M2.7 trennt, der neuen Version des MiniMax-Modells, die am 18. März 2026 veröffentlicht wurde. In einem Sektor, in dem Entwicklungszyklen früher in Jahren und dann in Monaten gemessen wurden, sind ein paar Wochen zum neuen normalen Intervall geworden. Aber diesmal ist der zeitliche Abstand nur das am wenigsten interessante Detail.

Vor knapp einem Monat habe ich im Codemotion-Magazin MiniMax M2.5 analysiert: ein Modell mit einer Mixed-Experts-Architektur mit insgesamt 230 Milliarden Parametern, von denen pro Abfrage nur 10 Milliarden aktiviert werden können, mit einer Leistung auf SWE-Bench Verified (80,2 %), die praktisch identisch mit Claude Opus 4.6 (80,8 %) ist – zu einem Zwanzigstel des Preises. Das Angebot war ebenso einfach wie verunsichernd: Grenzqualität zu erschwinglichen Kosten, mit einer „Architekten-Mentalität“, die spontan während des Trainings in über 200.000 realen Umgebungen entstand. MiniMax, ein in Shanghai ansässiges Startup, das in Hongkong mit einer Post-IPO-Kapitalisierung von rund 13 Milliarden Dollar notiert ist, hatte das Preis-Leistungs-Verhältnis bei KI für Code bereits neu definiert.

M2.7 ist keine Antwort auf eine Schwäche von M2.5. Es ist etwas anderes: ein erklärter Versuch, die Art und Weise zu ändern, wie ein Modell entwickelt wird, nicht nur, was es produziert. Das Schlüsselwort, das MiniMax gewählt hat, um dies zu kommunizieren, ist Self-Evolution, Selbstentwicklung. Es ist ein faszinierendes, evokatives und potenziell irreführendes Wort. Es lohnt sich zu verstehen, was es genau bedeutet und vor allem, was es nicht bedeutet.

Das Modell, das hilft, das nächste Modell zu bauen

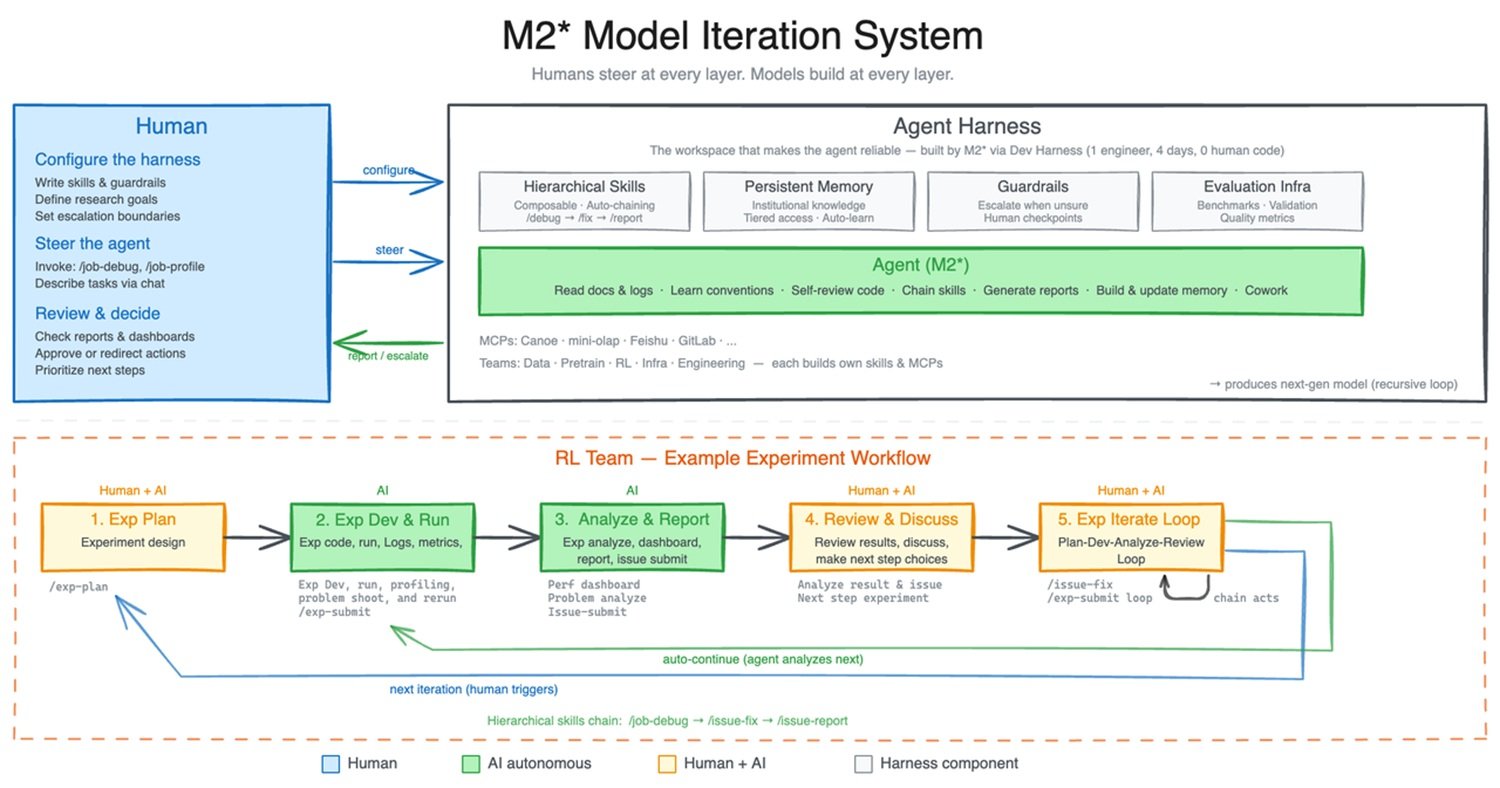

Um zu verstehen, was mit M2.7 wirklich passiert ist, muss man von einem konkreten Bild ausgehen. Im Forschungsteam von MiniMax verwalten Forscher, die an Reinforcement Learning (Training durch Belohnung und Bestrafung) arbeiten, lange und komplexe Versuchszyklen: Ideen testen, Daten vorbereiten, Experimente starten, Ergebnisse analysieren, Code korrigieren, neue Experimente konfigurieren. Es ist eine Arbeit, die normalerweise die Zusammenarbeit mehrerer Personen aus verschiedenen Teams erfordert.

Laut der offiziellen Dokumentation von MiniMax wurde eine interne Version von M2.7 genau in diesem Zyklus eingesetzt: Das Modell half bei der Literaturrecherche, bereitete Datenpipelines vor, startete Experimente, überwachte Protokolle, suchte nach Fehlern, analysierte Metriken, öffnete Merge-Requests und führte Smoke-Tests durch. Menschliche Forscher griffen nur bei kritischen Entscheidungen und strategischen Diskussionen ein. In diesem Zusammenhang schätzt MiniMax, dass M2.7 in der Lage war, 30 bis 50 % des Workflows des RL-Teams autonom zu bewältigen.

Aber es gibt eine zweite, radikalere Ebene. MiniMax bat M2.7, die Performance eines Modells auf einem internen Programmier-Scaffold autonom zu optimieren. Der Prozess war vollständig automatisiert: Das System führte einen iterativen Zyklus aus Analyse der Fehlerpfade, Planung von Änderungen, Änderung des Scaffold-Codes, Durchführung von Bewertungen, Vergleich der Ergebnisse und Entscheidung über Beibehaltung oder Rücknahme der Änderungen durch. Dieser Zyklus wiederholte sich über 100 Mal hintereinander. Das von MiniMax erklärte Ergebnis ist eine Verbesserung der Performance in den internen Evaluationssets um 30 %. Die vom Modell autonom gefundenen Optimierungen umfassten die systematische Suche nach der optimalen Kombination von Sampling-Parametern wie Temperatur, Frequency Penalty und Presence Penalty, den Entwurf spezifischerer Workflow-Richtlinien (zum Beispiel die automatische Suche nach ähnlichen Bug-Mustern in anderen Dateien nach einer Korrektur) und das Hinzufügen von Mechanismen zur Schleifenerkennung innerhalb des agentischen Zyklus.

Dies ist der technische Kern der Selbstentwicklung von M2.7. Es ist kein Modell, das sich von Grund auf neu schreibt, es ist kein künstliches Bewusstsein, es ist keine Einheit, die autonom entscheidet, wo sie sich verbessert. Es ist ein Agent, der eine vordefinierte Zielfunktion in einer kontrollierten Umgebung für ein spezifisches Problem mit von menschlichen Ingenieuren festgelegten Regeln optimiert. Der Unterschied zu früher liegt in der Geschwindigkeit und im Umfang dieser Optimierung: Hunderte von Zyklen in wenigen Stunden, wofür ein menschliches Team Wochen gebraucht hätte.

Es lohnt sich auch, einen Schritt zurückzutreten und festzustellen, dass MiniMax nicht die erste Organisation ist, die dieses Terrain erkundet. Im Mai 2025 hatte Google DeepMind AlphaEvolve vorgestellt, einen auf Gemini basierenden evolutionären Agenten, der einen automatisierten Zyklus zur Generierung, Bewertung und Auswahl von Algorithmen nutzte. AlphaEvolve hatte die Effizienz der Google-Rechenzentren verbessert (indem durchschnittlich 0,7 % der globalen Rechenressourcen zurückgewonnen wurden), das Training von Gemini selbst in einem kritischen Kernel um 23 % beschleunigt und sogar ein offenes Problem im Algorithmus zur Matrixmultiplikation gelöst, das seit der Ära von Strassen im Jahr 1969 unverändert geblieben war. Der Ansatz war jedoch grundlegend anders: AlphaEvolve konzentrierte sich auf die Optimierung spezifischer Algorithmen, die mit objektiven Metriken bewertbar waren. M2.7 versucht etwas Umfassenderes, indem es die Logik der Selbstverbesserung auf einen gesamten ML-Forschungszyklus anwendet, mit Werkzeugen, persistentem Speicher und Zusammenarbeit zwischen Agenten. Die Ansätze sind verwandt, aber nicht identisch.

Self-evolution: Wie viel ist wirklich wahr?

Die öffentliche Erzählung um M2.7 gravitierte schnell zum Rahmen der „KI, die sich von selbst entwickelt“, mit Videos, die Millionen von Aufrufen sammeln, und Posts, die Science-Fiction-Szenarien entwerfen. Es ist der richtige Zeitpunkt, um auf dem Boden der Tatsachen zu bleiben.

Der Prozentsatz der Selbstoptimierung, den MiniMax zitiert, diese 30 bis 50 % des im Kontext des RL-Teams autonom verwalteten Workflows, bezieht sich auf einen spezifischen und kontrollierten Kontext: ein internes Team mit vordefinierten Werkzeugen, klaren Zielen und einer speziell dafür entworfenen Infrastruktur. Das ist keine Zahl, die sich automatisch auf andere Kontexte übertragen lässt. Die restlichen 50 bis 70 % der Arbeit blieben in den Händen der menschlichen Forscher, die strategische Entscheidungen trafen, die Richtung der Experimente bewerteten und vor allem definierten, was „Verbesserung“ bedeutete.

Ein kritischer Punkt, den die Kommunikation von MiniMax bewusst im Dunkeln lässt, ist die Kontrollarchitektur. Welche Aktionen kann der Agent autonom ausführen? Kann er Produktionscode ohne menschliche Zustimmung ändern? Kann er Experimente mit beliebigen Rechenkosten starten? Wie werden schädliche Schleifen, stille Regressionen oder unerwünschte emergente Verhaltensweisen verhindert? In der offiziellen Mitteilung heißt es, dass der Agent basierend auf den Ergebnissen der Evaluationssets „entscheidet, die Änderungen beizubehalten oder zu annullieren“, beschreibt aber nicht die Guardrails, die verhindern, dass das System gegen falsche Optima konvergiert oder Proxys optimiert, die nicht den realen Zielen entsprechen.

Das Fehlen eines technischen Berichts im arXiv-Stil mit Details zur Architektur, Modellgröße, zum Datenmix und zu den Trainingsstrategien ist eine objektive Grenze für jeden, der eine unabhängige Analyse durchführen möchte. MiniMax hat zwar eine technische Dokumentation und das Repository des agentischen Projekts OpenRoom veröffentlicht, aber die Details zur Self-Evolution-Pipeline bleiben proprietär. In einem Sektor, in dem Verifizierbarkeit die Grundlage für wissenschaftliches Vertrauen ist, ist diese Intransparenz eine Entscheidung mit präzisen Konsequenzen: Sie macht es von außen unmöglich, verifizierbare Behauptungen von solchen zu unterscheiden, die im Bereich des Marketings bleiben.

Benchmark: Was die Zahlen sagen (und was nicht)

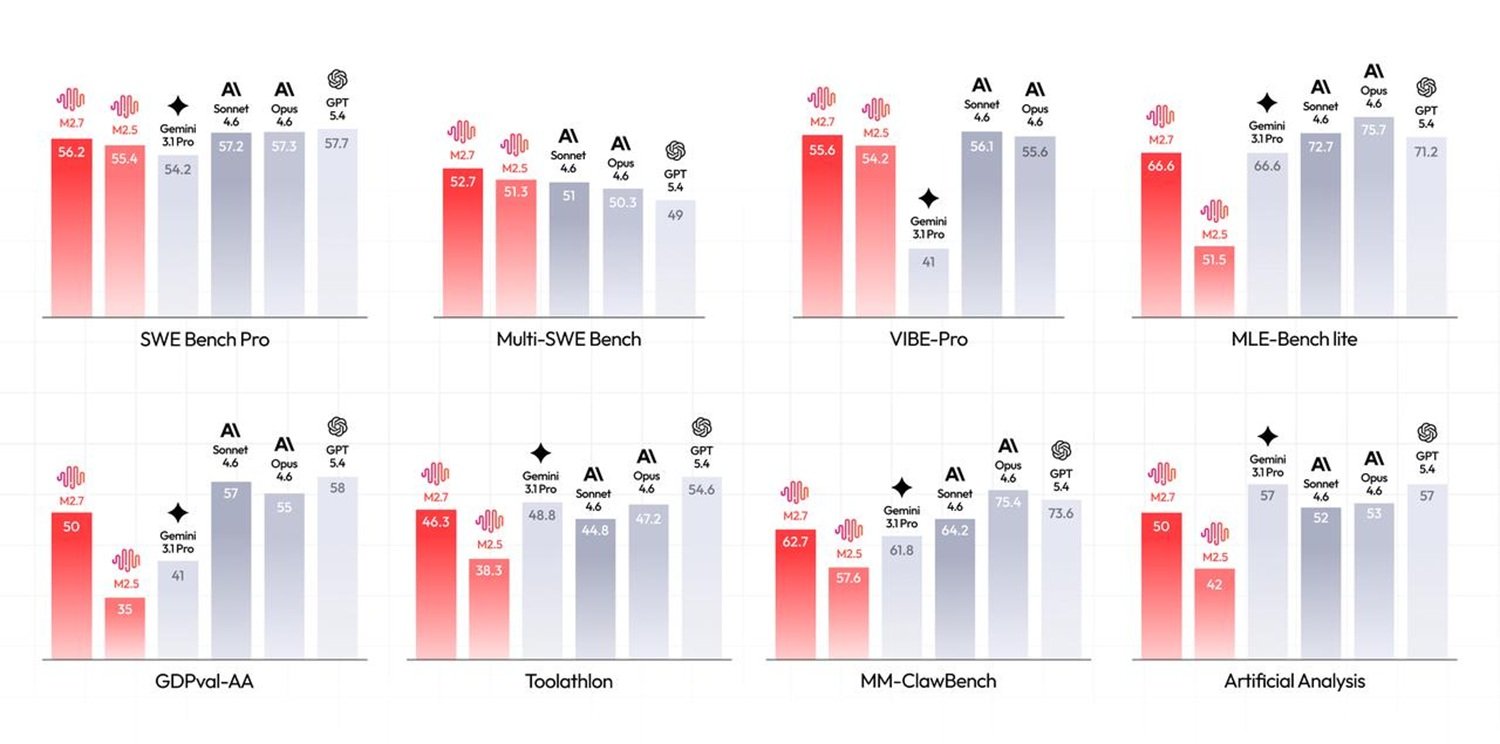

Bei den von MiniMax angegebenen Benchmarks verdienen die Daten eine aufmerksame Lektüre. Auf SWE-Pro, das die Fähigkeiten des Software Engineering bei realen mehrsprachigen Problemen bewertet, erreicht M2.7 56,22 % und nähert sich damit dem Niveau von Opus 4.6 an. Auf VIBE-Pro, einem Benchmark für die Lieferung kompletter End-to-End-Projekte (Web, Android, iOS, Simulationen), liegt der Score bei 55,6 %. Auf Terminal Bench 2, das das tiefe Verständnis komplexer technischer Systeme misst, erreicht M2.7 57,0 %. Auf GDPval-AA, der Bewertung der Lieferfähigkeit professioneller Aufgaben in Bereichen wie Finanzen, Recht und Büroarbeit, erhält M2.7 einen ELO-Wert von 1495 – den höchsten unter den Open-Source-Modellen und den zweithöchsten unter allen getesteten Modellen nach Opus 4.6, Sonnet 4.6 und GPT-5.4.

Interessanter werden die unabhängigen Daten im Bericht von Kilo, einer agentischen Coding-Plattform, die M2.7 in zwei eigenen Benchmarks getestet hat. Auf PinchBench, dem Benchmark für Standardaufgaben von OpenClaw-Agenten, erreicht M2.7 86,2 % und belegt damit den 5. Platz von 50 getesteten Modellen, mit weniger als 1,2 Punkten Rückstand auf Claude Opus 4.6 (87,4 %). Der Sprung gegenüber M2.5 (82,5 %) beträgt 3,7 Punkte, was ausreicht, um es vom Mittelfeld in die Spitzengruppe der Rangliste zu katapultieren. Auf Kilo Bench, 89 Aufgaben zum autonomen Coding über das gesamte Spektrum hinweg, von Git-Operationen bis hin zur differenziellen Kryptoanalyse, von der MIPS-Emulation bis zur QEMU-Automatisierung, hat M2.7 47 % der Aufgaben bestanden und liegt damit an zweiter Stelle hinter Qwen3.5-plus (49 %).

Das interessanteste Ergebnis von Kilo Bench ist jedoch nicht die rohe Erfolgsquote, sondern das Verhaltensprofil. M2.7 neigt dazu, den umgebenden Code vor dem Schreiben ausführlich zu lesen: Es analysiert Abhängigkeiten, verfolgt Call-Chains und sammelt Kontext aus verwandten Dateien. Dieser „Investigative“-Ansatz zahlt sich bei Aufgaben aus, die ein tiefes systemisches Verständnis erfordern. Kilo nennt als Beispiel eine SPARQL-Aufgabe, bei der das Modell korrekt identifizierte, dass ein Filter auf EU-Länder ein Auswahlkriterium und kein Filter für den Output war – eine feine Unterscheidung in der Argumentation, die die anderen getesteten Modelle übersahen. Aber dieselbe Tendenz zur Über-Exploration führt bei Aufgaben, bei denen Geschwindigkeit wichtiger ist als Tiefe, zu Timeouts: Die mediane Dauer einer Aufgabe liegt für M2.7 bei 355 Sekunden und damit höher als bei seinen Vorgängern. Die Kosten in Tokens sind proportional höher: rund 2,8 Millionen Tokens im Input pro Versuch auf Kilo Bench, der höchste Wert unter den getesteten Modellen.

Stimmen aus der praktischen Erfahrung fügen eine weitere Dimension hinzu. In den Kommentaren zum Kilo-Bericht beschreibt ein Nutzer sehr enttäuschende Erfahrungen mit M2.7 bei Migrationsaufgaben. Er beklagt, dass das Modell dazu neigte, fiktive UI-Komponenten zu erstellen, anstatt bestehende Elemente zu migrieren, TODO-Kommentare einzufügen, um sie dann völlig zu ignorieren, und sich zu weigern, Migrationen in der Mitte des Prozesses fortzusetzen. Derselbe Nutzer berichtet von deutlich besseren Ergebnissen mit GPT-5.3-Codex, Claude 4.6 und GLM-5 bei denselben Aufgaben. Das ist keine statistisch repräsentative Stichprobe, aber ein Signal dafür, dass das Verhaltensprofil von M2.7 – stark beim systemischen Verständnis und der kontextbezogenen Argumentation, potenziell fragil bei der disziplinierten Ausführung strukturierter Pläne – nicht gleichermaßen gut zu allen Entwicklungsszenarien passt.

Entwickler und Knowledge Worker: Wer profitiert

Das konkreteste operative Versprechen von M2.7 liegt in der Produktionsdiagnose. Die offizielle Mitteilung beschreibt Debugging-Szenarien in Live-Umgebungen, in denen das Modell Monitoring-Metriken mit Deployment-Timelines korrelierte, statistische Analysen zum Trace-Sampling durchführte, sich autonom mit Datenbanken verband, um Hypothesen zu prüfen, fehlende Index-Migrationsdateien im Repository identifizierte und nicht-blockierende Lösungen vorschlug. MiniMax erklärt, dass die Wiederherstellungszeit bei Produktionsvorfällen in mehreren Fällen auf weniger als drei Minuten reduziert werden konnte, verglichen mit traditionellen manuellen Prozessen.

Das ist eine starke Behauptung und für Kenner der Diagnose verteilter Systeme nicht unwahrscheinlich: Ein Großteil der Zeit bei einem Produktionsvorfall wird damit verbracht, Informationen zu korrelieren, die bereits in verschiedenen Dashboards, verschiedenen Protokollen und verschiedenen Repositories vorhanden sind. Ein Agent, der diese Räume autonom navigieren und konsistente kausale Hypothesen aufstellen kann, ist wirklich nützlich. Das Spiegelrisiko ist der „Automation Bias“: die Tendenz, den vom Agenten generierten Diagnosen übermäßig zu vertrauen, selbst wenn sie falsch sind, insbesondere in Stresssituationen, in denen die Zeit zur Überprüfung begrenzt ist. Ein System, das in 90 % der Fälle die richtige Ursache findet und in 10 % der Fälle stillschweigend falsch liegt, ist gefährlicher als eines, das sichtbar falsch liegt.

Für Knowledge Worker im Finanzwesen und anderen professionellen Bereichen führt M2.7 Fähigkeiten ein, die kritische Aufmerksamkeit verdienen. Der von MiniMax gezeigte Demonstrationsfall betrifft eine TSMC-Analyse: Ausgehend von Jahresberichten und Protokollen der Earnings Calls erstellt das Modell autonom ein Umsatzprognosemodell, entwirft Annahmen, erstellt eine PowerPoint-Präsentation basierend auf Vorlagen und verfasst einen Equity Research Report in Word. MiniMax berichtet, dass Branchenexperten den Output als nutzbaren ersten Entwurf bewertet haben, der direkt in die nachfolgenden Workflows übernommen werden kann.

Diese Art der Anwendung – ein Agent, der Finanzanalysen fast autonom erstellt – wirft nicht triviale regulatorische Fragen auf. MiFID II verlangt, dass Finanzberatungsdienstleistungen von autorisierten Stellen erbracht werden. Eine von einem KI-Agenten erstellte Analyse, die einem Kunden ohne angemessene Aufsicht und Offenlegung präsentiert wird, kann regulatorische Verstöße darstellen. Wer haftet für Fehler in einem autonom generierten Finanzmodell? Die korrekte Antwort lautet immer noch „der Mensch, der sich entschieden hat, es zu verwenden und zu präsentieren“, aber die Verantwortungskette wird dünner, je mehr der Prozess automatisiert wird.

Der Preis bleibt das stärkste Argument

Abseits aller Diskussionen über die Selbstentwicklung ist der Faktor, der M2.7 am konkretesten im Markt positioniert, der Preis. Der API-Zugriff ist für 0,30 Dollar pro Million Tokens im Input und 1,20 Dollar pro Million Tokens im Output für die Standardversion verfügbar, wobei eine M2.7-Highspeed-Version dank automatischem Caching höhere Geschwindigkeiten zum gleichen Preis bietet. Claude Opus 4.6 kostet 15 Dollar pro Million Tokens im Input und 75 Dollar pro Million Tokens im Output. Das Verhältnis beträgt 1:50 beim Input und 1:62,5 beim Output. Für agentische Anwendungen, die pro Zyklus Dutzende Millionen Tokens verbrauchen, ist der Unterschied der zwischen einem machbaren Experiment und einem wirtschaftlich untragbaren.

Kilo fasst die praktische Positionierung gut zusammen: M2.7 ist eine starke Wahl bei Aufgaben, bei denen es auf das Sammeln von tiefem Kontext, komplexe Refactorings, Änderungen an der gesamten Codebasis und systemische Analysen ankommt. Für zeitkritische und klar abgegrenzte Aufgaben können schnellere und weniger token-intensive Modelle bessere Ergebnisse zu geringeren Kosten liefern. Es ist kein universeller Ersatz, sondern ein Werkzeug mit einem präzisen Profil.

OpenRoom und die neue Schnittstelle des Agenten

Zu den Neuheiten, die M2.7 begleiten, gehört OpenRoom, ein auf Agenten basierendes Interaktionssystem, das MiniMax als Open-Source veröffentlicht hat. OpenRoom befreit die Interaktion vom reinen Textfluss und platziert sie in einem interaktiven Web-GUI-Raum: Die Charaktere sind keine statischen Prompts, sondern Einheiten mit persistenten Einstellungen, die aktiv mit der Umgebung interagieren und visuelles Feedback in Echtzeit generieren. Ein Großteil des Codes wurde von der KI geschrieben, wie die Developer Notes des Repositories betonen.

Die Richtung ist klar: MiniMax stellt sich Agenten vor, die Räume bewohnen, anstatt nur auf Prompts zu antworten. Das ist eine Vision, die interessante Auswirkungen auf Gaming, die Creator Economy und auf einer sensibleren Ebene auf die psychologische Dynamik einer längeren Interaktion mit künstlichen Einheiten mit persistenten Persönlichkeiten hat. Das Risiko der Vermenschlichung und der emotionalen Bindung an diese Systeme ist in der akademischen Literatur spätestens seit der Arbeit von Clifford Nass und Byron Reeves in den neunziger Jahren über die „Media Equation“ dokumentiert. Das ist keine Science-Fiction, das ist Entwicklungspsychologie angewandt auf interaktive Systeme.

Der ungelöste Knoten: Intransparenz, Governance und kulturelle Erzählung

Es gibt eine strukturelle Spannung in der Art und Weise, wie M2.7 der Welt präsentiert wurde – eine Spannung, die es wert ist, explizit benannt zu werden. MiniMax hat eine starke und einprägsame Erzählung um die „KI, die sich selbst entwickelt“, aufgebaut, aber nur sehr wenige verifizierbare technische Details dazu geliefert, wie diese Entwicklung gesteuert wird. Es gibt keinen öffentlichen technischen Bericht. Es gibt keine Offenlegung der Sicherheitsmechanismen des selbstoptimierenden Agenten. Es gibt keine Erklärung dafür, wie Optimierungsschleifen verhindert werden, die gegen falsche Proxys oder unerwünschte emergente Verhaltensweisen konvergieren.

Das muss nicht unbedingt böser Wille sein: Es ist die Norm in der Branche. OpenAI, Anthropic und Google veröffentlichen keine erschöpfenden technischen Berichte zu all ihren internen Systemen. Aber wenn man explizit behauptet, dass ein Modell „an seiner eigenen Entwicklung teilnimmt“ und autonom ML-Forschungszyklen verwaltet, sollte der von der Community erwartete Detaillierungsgrad proportional höher sein. Der Unterschied zwischen einem kontrollierten Optimierungszyklus und einem System, das sich den von seinen Schöpfern definierten Zielen entzieht, ist genau die Art von Detail, die ein technischer Bericht klären sollte.

An der kulturellen Erzählfront ist bemerkenswert, wie die Tech-Presse den Aspekt der Selbstentwicklung weit über das hinaus verstärkt hat, was die Daten rechtfertigen. Der Rahmen der „KI, die sich selbst verbessert“, ist erzählerisch stark, weil er tiefe Archetypen anspricht, von Frankensteins Kreatur bis zum Golem der jüdischen Tradition oder Kubricks HAL 9000. Genaue Beschreibungen des Phänomens sind jedoch viel prosaischer: ein gut konzipierter Agent, der eine Funktion für eine spezifische Aufgabe in einer kontrollierten Umgebung optimiert. Der Unterschied zwischen den beiden Beschreibungen ist der Unterschied zwischen Literatur und Ingenieurwesen. Beides ist nützlich, aber nicht dasselbe.

Die regulatorische Frage bleibt im Hintergrund, verschwindet aber nicht. Der europäische AI Act stuft in seinem aktuellen Rahmen Hochrisiko-KI-Systeme basierend auf ihrem Anwendungsbereich und ihrer potenziellen Auswirkung ein. Ein agentisches Modell, das autonom an Trainingspipelines anderer KI-Modelle teilnimmt oder Finanzanalysen mit reduzierter menschlicher Aufsicht erstellt, nähert sich Kategorien an, die der AI Act tendenziell mit besonderer Aufmerksamkeit betrachtet. Wie M2.7 in diesen Rahmen passt, ist eine Frage, auf die bisher niemand eine präzise Antwort gegeben hat – weder MiniMax noch die europäischen Regulierungsbehörden.

M2.7 ist ein wirklich fähiges Modell mit unabhängigen Benchmarks, die seine Position in der Spitzengruppe der aktuellen Landschaft bestätigen, einem Preis, der es für Projekte zugänglich macht, die westliche Grenzmodelle unerschwinglich machen würden, und einem Ansatz zur Selbstoptimierung, der technisch real ist, wenn auch weniger spektakulär, als die öffentliche Erzählung vermuten lässt. Die 30 % Autonomie im internen RL-Workflow sind ein solides technisches Ergebnis. Es ist nicht die Geburt der bewussten KI. Es ist etwas Bescheideneres und Interessanteres: ein Signal, dass der Entwicklungszyklus der Modelle selbst beginnt, die Modelle als aktive Teilnehmer einzubeziehen – mit allem, was dies in Bezug auf Geschwindigkeit, Umfang und die Notwendigkeit neuer Governance-Werkzeuge bedeutet.

Die relevanteste Frage, die M2.7 offen lässt, ist nicht „wie weit kann die Selbstentwicklung gehen?“, sondern „wer entscheidet, was Verbesserung bedeutet, und mit welcher Transparenz?“. Solange diese Frage ohne öffentliche und verifizierbare Antwort bleibt, sollte jede Behauptung über die KI, die von selbst lernt, mit Neugier, Strenge und einer gesunden Portion methodischer Skepsis gelesen werden.