MIT und die „bescheidene“ KI: Wie man Modellen beibringt, „ich weiß es nicht“ zu sagen

Es gibt ein Gedankenexperiment, das Forscher am MIT verwenden, um das Problem im Herzen ihrer Forschung zu erklären. Stellen Sie sich einen Intensivmediziner um drei Uhr morgens vor, nach einer zwölfstündigen Schicht. Auf dem Monitor erscheint eine von der KI generierte Diagnose: bakterielle Pneumonie, Wahrscheinlichkeit 94 %. Der Arzt hat Zweifel, ein ungutes Gefühl, dass etwas nicht stimmt. Aber die Zahl ist da, präzise, autoritär. Und der Arzt gibt nach.

Das ist keine Science-Fiction. Dokumentierte Studien zeigen, dass Intensivmediziner und Radiologen dazu neigen, den Anweisungen der KI zu folgen, selbst wenn ihre eigene klinische Erfahrung das Gegenteil nahelegt – vorausgesetzt, das System zeigt einen ausreichend hohen Konfidenzwert an. Das Phänomen hat einen technischen Namen, Automation Bias, und in der Medizin kann es Leben kosten. Die im Paper zitierte Forschung beschreibt Fälle, in denen Radiologen und Intensivpflegepersonal ihre eigene diagnostische Genauigkeit nach der Einführung übermäßig selbstbewusster KI-Systeme verringerten, indem sie falschen Vorschlägen folgten, die in einem definitiven Ton präsentiert wurden.

Der eklatanteste Fall dieser Entwicklung bleibt IBM Watson for Oncology, das System, das zwischen 2012 und 2017 an Dutzende Krankenhäuser weltweit als Revolution in der Krebsbehandlung verkauft wurde. Trainiert auf synthetischen Fällen und nicht auf realen Patientendaten, empfahl Watson Behandlungen, die erfahrene Onkologen als unsicher einstuften, und zeigte eine Übereinstimmung mit menschlichen klinischen Entscheidungen, die deutlich unter der versprochenen lag. Der Fall Watson ist nicht nur die Geschichte eines gescheiterten Produkts: Er ist der Beweis dafür, was passiert, wenn man ein Orakel anstatt eines Werkzeugs baut.

Und genau an diesem Punkt setzt die Arbeit von MIT Critical Data an, dem globalen Konsortium unter der Leitung des Laboratory for Computational Physiology des MIT, das im März 2026 ein Framework veröffentlichte, um etwas scheinbar Einfaches, aber technisch sehr Kompliziertes zu tun: einem KI-System beizubringen, „ich weiß es nicht“ zu sagen.

Zwei Paper, eine These

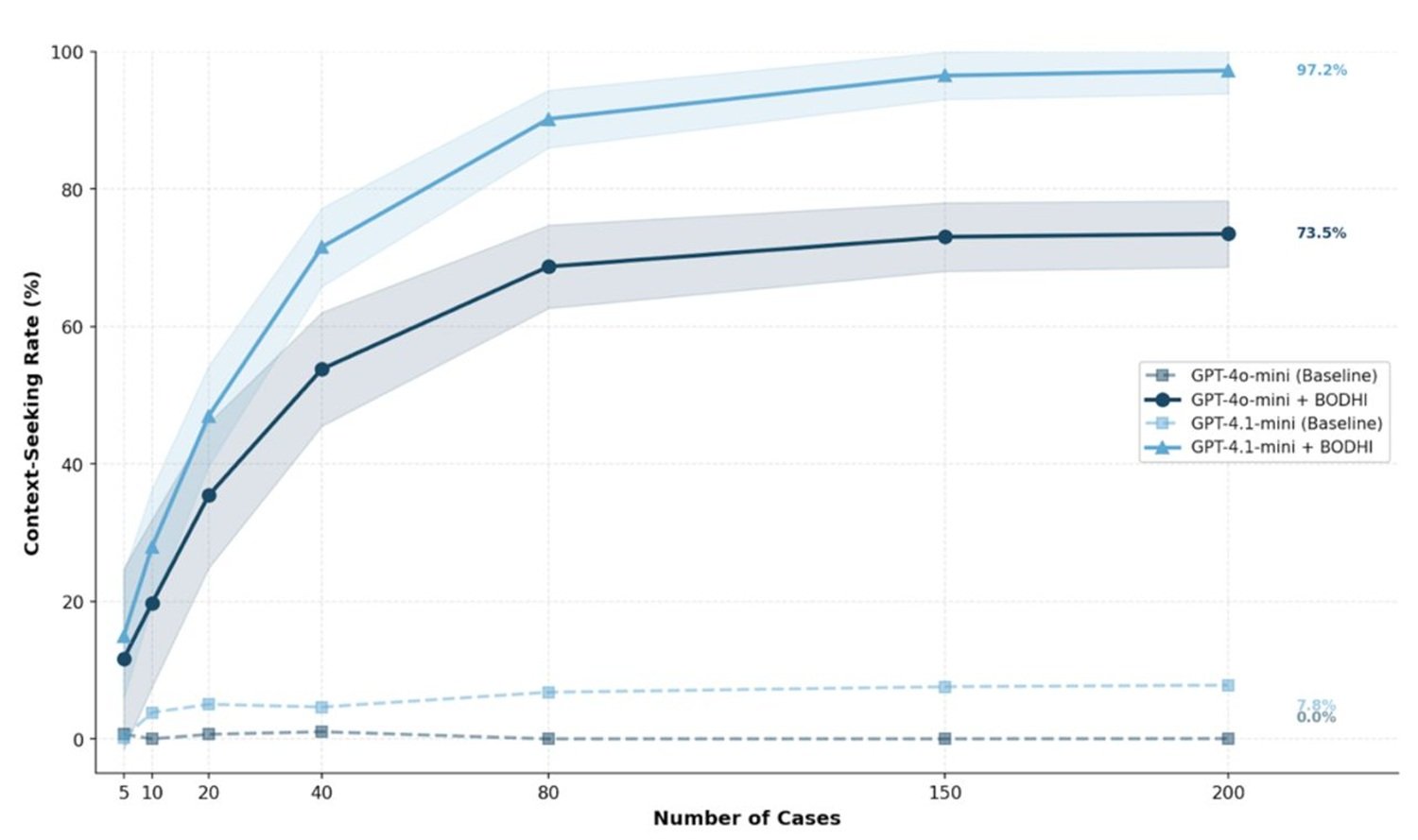

Um die Tragweite dieser Forschung zu verstehen, muss man zwei unterschiedliche Publikationen zusammen betrachten, die zwei Seiten desselben Projekts darstellen. Die erste erschien am 24. März 2026 in BMJ Health and Care Informatics, dem Fachjournal für klinische Informatik des British Medical Journal: Es handelt sich um ein operatives Framework für das Design „bescheidener“ KI-Systeme im Bereich der medizinischen Diagnose. Die zweite, im Januar 2026 in PLOS Digital Health veröffentlicht, ist ein ehrgeizigeres theoretisches Paper, das das BODHI-Framework einführt – ein Akronym für Bridging, Open, Discerning, Humble, Inquiring (Überbrückend, Offen, Unterscheidend, Bescheiden, Nachfragend), eine dual-reflektierende Architektur, die vorschlägt, Neugier und Bescheidenheit als Grundprinzipien jedes KI-Systems im Gesundheitswesen zu verankern.

Beide Arbeiten wurden im Wesentlichen vom selben internationalen Team unter der Koordination von Leo Anthony Celi unterzeichnet, Senior Researcher am MIT Institute for Medical Engineering and Science, Arzt am Beth Israel Deaconess Medical Center in Boston und außerordentlicher Professor an der Harvard Medical School. Der Hauptautor des BMJ-Papers ist Sebastián Andrés Cajas Ordóñez, Forscher bei MIT Critical Data und bereits Erstautor des PLOS Digital Health Papers. Um sie herum gruppiert sich ein Konsortium, das Forscher der Universität Melbourne, des King's College London, der ETH Zürich, der Universität Bergen und der Mbarara University of Science and Technology in Uganda umfasst: eine geografische Zusammensetzung, die, wie wir sehen werden, kein Zufall ist.

Die konzeptionelle Neuerung, die beide Arbeiten verbindet, ist folgende: Es reicht nicht aus, dass ein KI-System seine eigene Unsicherheit intern misst, was viele Modelle bereits in irgendeiner Form tun. Der Paradigmenwechsel liegt darin, dass diese Unsicherheit das Verhalten des Systems verändern muss, also in konkrete, kommunizierbare und überprüfbare Aktionen für denjenigen übersetzt werden muss, der mit der Maschine interagiert. Wie Celi in der Pressemitteilung des MIT sagt: Wir benutzen die KI als Orakel, obwohl wir sie als Coach, als echten Co-Piloten nutzen könnten.

Wie es funktioniert: Die Unsicherheit messen und etwas daraus machen

Der technische Kern des im BMJ veröffentlichten Frameworks dreht sich um ein Modul namens Epistemic Virtue Score, das von den Forschern Janan Arslan und Kurt Benke von der Universität Melbourne entwickelt wurde. Die Grundidee ist relativ intuitiv: Jedes Mal, wenn das System eine diagnostische Antwort generiert, muss es auch bewerten, ob sein eigenes Konfidenzniveau durch die im spezifischen Fall verfügbare Evidenz gerechtfertigt ist. Wenn die Antwort Nein lautet – wenn also das Vertrauen das übersteigt, was die Patientendaten tatsächlich stützen –, antwortet das System nicht einfach mit einer Wahrscheinlichkeitszahl. Es hält inne, signalisiert die Diskrepanz und schlägt spezifische Maßnahmen vor: weitere Untersuchungen anfordern, eine detailliertere Anamnese erheben, einen Spezialisten hinzuziehen.

In der Praxis fungiert das Modell nicht mehr als Schiedsrichter, der endgültige Urteile fällt, sondern verhält sich wie das, was Celi einen Co-Piloten nennt: ein System, das einem nicht nur sagt, wo man sich befindet, sondern auch, wenn es nicht genau weiß, wo man ist und warum es besser wäre, anzuhalten und nach dem Weg zu fragen. Seine Metapher dazu: „Es ist, als hätte man einen Co-Piloten, der einem sagt, dass man eine Zweitmeinung einholen muss, um diesen komplexen Patienten besser zu verstehen.“

Das BODHI-Framework, das im PLOS Digital Health Paper beschrieben wird, entwickelt diese Idee zu einer komplexeren Architektur weiter. Die fünf Attribute des Akronyms sind keine bloßen Adjektive: Jedes entspricht einer Reihe von operativen Verhaltensweisen. Bridging bedeutet, algorithmisches Denken mit klinischem Kontextwissen des Falles zu verbinden. Open steht für die Empfänglichkeit für neue Informationen und alternative Hypothesen. Discerning ist die Fähigkeit, Vorhersagen mit hoher Konfidenz von solchen zu unterscheiden, die eine weitere Untersuchung erfordern. Humble bezieht sich auf die Quantifizierung der Unsicherheit und den Respekt vor menschlicher Expertise in zweideutigen Fällen. Inquiring ist die aktive Tendenz, nach zusätzlichen Informationen zu suchen, wenn die diagnostische Situation unklar ist.

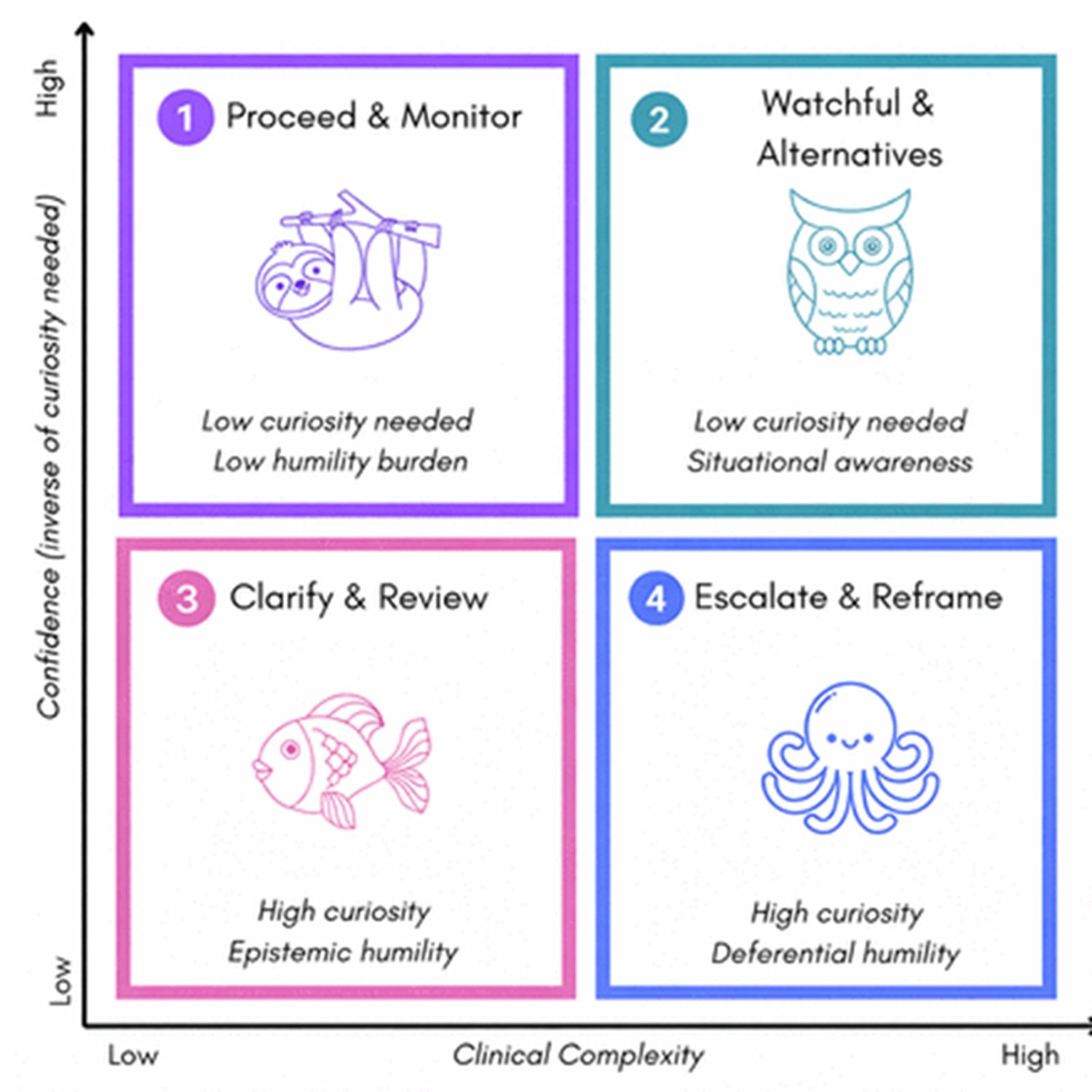

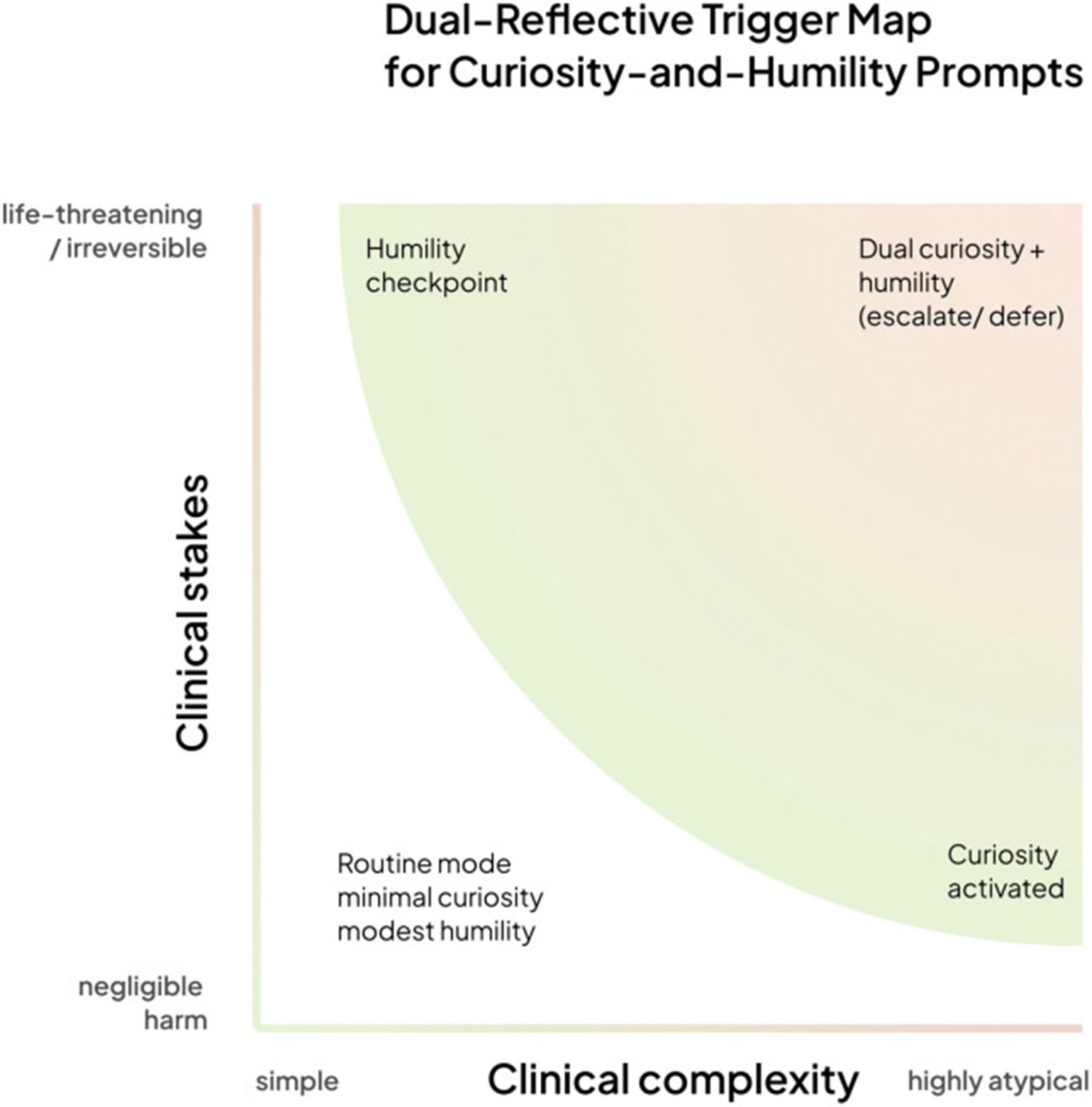

Das Paper beschreibt ein Vier-Quadranten-Framework, das auf zwei Achsen basiert: der klinischen Komplexität des Falls und der Schwere der potenziellen Folgen. In einfachen Szenarien mit geringem Risiko antwortet das System direkt. Mit zunehmender Komplexität wird der Neugier-Modus aktiviert, der Fragen generiert. Mit zunehmender potenzieller Schwere wird der Bescheidenheits-Checkpoint aktiviert, der die Entscheidung an menschliche Experten überträgt. Im Quadranten oben rechts – komplexe und risikoreiche Fälle – sind beide Modi gleichzeitig aktiv, und das System führt eine kollaborative Eskalation durch.

Wirkliche Innovation oder konzeptionelles Rebranding?

Dies ist eine Frage, die man sich explizit stellen sollte, da im Bereich der KI immer die Gefahr besteht, bereits Existierendes mit einer neuen Sprache umzubenennen. Uncertainty Quantification, also die Fähigkeit eines Modells abzuschätzen, wie sicher seine eigene Antwort ist, ist keine Neuheit: Techniken wie Modell-Ensembles, bayesianische Kalibrierung, Selective Prediction (bei der das System unterhalb einer Konfidenzschwelle keine Antwort gibt) und Out-of-Distribution Detection (die erkennt, wenn ein Input stark von den Trainingsdaten abweicht) existieren seit Jahren in der Machine-Learning-Literatur.

Wo liegt also die wirkliche Neuerung? Der entscheidende Punkt, der bei aufmerksamem Lesen beider Paper erkennbar wird, ist die Unterscheidung zwischen dem Messen von Unsicherheit und dem Handeln auf deren Basis in einer klinisch strukturierten Weise. Systeme wie MUSE, die in der verwandten Literatur beschrieben werden, nutzen vertrauenswürdige Teilmengen mehrerer Modelle, um besser kalibrierte Wahrscheinlichkeiten zu erzeugen, was bereits eine Verbesserung gegenüber Einzelmodellen darstellt. Aber der Epistemic Virtue Score und das BODHI-Framework gehen einen Schritt weiter: Sie übersetzen das Maß der Unsicherheit in explizite und überprüfbare Verhaltensregeln, nicht nur in Zahlen. Die Frage ist nicht nur „wie sicher ist das Modell?“, sondern „was muss das System angesichts dieser Unsicherheit tun?“

Praktisch ausgedrückt ist der Unterschied vergleichbar mit einem Armaturenbrett, das die Kraftstoffreserve anzeigt, und einem Auto, das sich unterhalb einer bestimmten Schwelle weigert zu starten, bis man tankt. Beide messen dasselbe, aber nur eines übersetzt die Messung in ein zwingendes Verhalten. Das MIT-BODHI-Framework gehört zur zweiten Kategorie. Das macht es nicht im absoluten Sinne revolutionär, aber methodisch reifer als viele frühere Vorschläge, die bei der Messung stehen blieben, ohne zur Aktion zu gelangen.

Das verborgene Problem: Wer nicht in den Daten ist

Es gibt einen Punkt, der sich durch beide MIT-Paper zieht und der eigenständige Aufmerksamkeit verdient, weil er eine der tiefsten Wurzeln des Problems berührt. Viele KI-Modelle im klinischen Bereich werden auf Datensätzen elektronischer Patientenakten trainiert, wie dem berühmten MIMIC, der Datenbank, die aus Daten des Beth Israel Deaconess Medical Center erstellt wurde. MIMIC ist einer der weltweit meistgenutzten Datensätze in der medizinischen KI-Forschung und eine außergewöhnliche Arbeit. Aber es ist definitionsgemäß auch ein Archiv, das auf einer spezifischen Population basiert: überwiegend US-amerikanisch, überwiegend städtisch, mit den demografischen Merkmalen derer, die Zugang zu einem großen Krankenhaus in Boston haben.

Wer taucht in diesen Daten nicht auf? Patienten aus ländlichen Gebieten, die oft keinen Zugang zu Einrichtungen mit fortschrittlichen digitalen Patientenakten haben. Ältere Bevölkerungsgruppen mit atypischen Krankheitsverläufen. Patienten aus Ländern mit niedrigem und mittlerem Einkommen, in denen die digitale Gesundheitsversorgung fragmentiert ist. Ethnische Minderheiten, die in klinischen Datensätzen historisch unterrepräsentiert sind.

Das Problem ist nicht theoretisch. Das BODHI-Paper zitiert explizit den Fall von Pulsoximetern, die bei Patienten mit dunkler Hautfarbe schlechter funktionieren, weil sie fast ausschließlich an Proben weißer Patienten kalibriert wurden, als paradigmatisches Beispiel dafür, wie sich systematische Biases im ursprünglichen Datum in konkrete klinische Fehler verwandeln. Ein auf verzerrten Daten trainiertes Modell wird auch in Situationen sicher antworten, in denen diese Sicherheit für diejenigen, die im Trainingsset nicht repräsentiert sind, völlig unbegründet ist.

Deshalb ist das Konsortium MIT Critical Data bewusst als globale Struktur aufgebaut, mit Forschern aus Uganda, Norwegen, der Schweiz, Australien, Großbritannien und Brasilien. Celi sagt es explizit: Die Workshops von MIT Critical Data beginnen immer mit einer Frage an die Teilnehmer: Sind Sie sicher, dass Ihre Trainingsdaten alle relevanten Variablen für das erfassen, was Sie vorhersagen wollen? Gibt es Patienten, die ausgeschlossen wurden, absichtlich oder unabsichtlich, und wie beeinflusst das die Zuverlässigkeit des Modells?

Eine bescheidene KI muss sich in diesem Sinne auch ihrer eigenen Herkunftsdaten bewusst sein. Das BODHI-Framework führt explizit das Konzept der Out-of-Distribution Detection in klinischem Sinne ein: Das System muss erkennen, wenn der Patient, der vor ihm steht, sich signifikant von der Population unterscheidet, auf der es trainiert wurde, und sich entsprechend verhalten – indem es Warnflaggen der Unsicherheit hisst, anstatt mit derselben Sicherheit zu antworten, die es für Fälle zeigt, die es gut kennt.

Die Risiken der Bescheidenheit: Falsche Bescheidenheit und übermäßige Vorsicht

Es wäre jedoch naiv, dieses Framework als eine Lösung ohne Nebenwirkungen zu präsentieren. Risiken existieren, und das PLOS Digital Health Paper hat die Ehrlichkeit, sie teilweise anzuerkennen, auch wenn die kritische Auseinandersetzung ausführlicher sein könnte.

Das erste Risiko ist das, was man als falsche Bescheidenheit bezeichnen könnte: Ein System, das Unsicherheit zeigt, kann zuverlässiger erscheinen, selbst wenn diese Unsicherheit schlecht kalibriert ist. Die Wahrnehmung von Transparenz – die Tatsache, dass das Modell „seine Zweifel zugibt“ – könnte bei Ärzten paradoxerweise ein höheres Vertrauen erzeugen als ein System, das sich als Orakel präsentiert. Wenn die Aktivierungsschwelle des Epistemic Virtue Score falsch eingestellt ist oder wenn Unsicherheitssignale zu häufig und zu wenig kontextbezogen sind, besteht die Gefahr, dass sie zu Hintergrundrauschen werden – eine Art Sicherheitswarnung, wie wir sie jedes Mal ignorieren, wenn wir eine App auf dem Telefon installieren.

Das zweite Risiko ist die Alert Fatigue (Alarmmüdigkeit). Im Krankenhausbereich ist der Überfluss an Alarmen bereits ein dokumentiertes Problem: Überwachungssysteme, die ständig piepen, werden vom Gesundheitspersonal schließlich deaktiviert oder ignoriert, weil sich die meisten Alarme als unkritisch erweisen. Ein KI-Modell, das zu häufig Unsicherheit signalisiert, könnte in bereits überreizten Umgebungen weiteres kognitives Rauschen hinzufügen und die Qualität der Entscheidungen eher verschlechtern als verbessern.

Das dritte Risiko betrifft die kognitive Belastung. Eine KI, die zusätzliche Daten anfordert, fachärztliche Konsultationen vorschlägt und ihre eigenen Grenzen aufzeigt, ist theoretisch besser als ein stummes Orakel. Aber in einer überfüllten Notaufnahme mit zwanzig wartenden Patienten hat jeder zusätzliche Schritt im Entscheidungsfluss reale Kosten. Die im Paper beschriebene ideale Interaktion zwischen Arzt und Maschine erfordert Zeit, Aufmerksamkeit und die Bereitschaft des Klinikers, sich auf einen Dialog mit dem System einzulassen – Bedingungen, die in der täglichen klinischen Praxis nicht immer gegeben sind.

Dies sind keine Argumente gegen das Projekt, sondern die Bedingungen, die über Erfolg oder Misserfolg bei der realen Implementierung entscheiden werden. Und hier zeigt sich die ehrlichste Grenze, die man im aktuellen Stadium der Forschung anerkennen muss.

Wo wir stehen: Framework ohne randomisierte klinische Validierung

Die wichtigste Frage, die man jedem für die Medizin vorgeschlagenen System stellen muss, lautet: Funktioniert es wirklich an echten Patienten? Und die derzeit ehrliche Antwort lautet: Wir wissen es noch nicht mit ausreichender Sicherheit.

Beide Paper sind ihrer Natur nach theoretische und methodische Arbeiten. Das BMJ-Paper beschreibt ein Framework und einen Architekturvorschlag. Das BODHI-Paper basiert auf einer interdisziplinären Synthese bestehender Literatur ohne eigene experimentelle Daten. Im Abschnitt „Data Availability“ des PLOS Digital Health Papers erklären die Autoren dies explizit: In dieser Studie wurden keine Datensätze generiert oder analysiert; sie präsentiert ein theoretisches Framework, das auf konzeptioneller Analyse und Literatursynthese basiert.

Die praktische Umsetzung ist im Gange: Celis Team arbeitet daran, das Framework in KI-Systeme zu integrieren, die auf der MIMIC-Datenbank innerhalb des Beth Israel Lahey Health Systems basieren. Dies ist die nächste Phase, in der man sehen wird, ob die Bescheidenheitsmechanismen die klinischen Entscheidungen tatsächlich verbessern, Diagnosefehler reduzieren und nicht einfach die operative Komplexität erhöhen. Diese Validierung ist noch nicht veröffentlicht.

Dies ist kein Mangel der Arbeit, sondern die Natur des wissenschaftlichen Prozesses. Zuerst kommt das robuste konzeptionelle Framework, dann die experimentelle Validierung. Das Problem entsteht, wenn die Medien (und Technologieunternehmen) direkt vom Framework zur Schlagzeile Die KI, die Diagnosen rettet springen und Jahre notwendiger Forschung in ein sofortiges Versprechen komprimieren. Die Arbeit von MIT Critical Data verdient Aufmerksamkeit gerade deshalb, weil sie dieses Versprechen nicht macht: Sie schlägt eine Richtung vor, benennt die Werkzeuge und bereitet sich darauf vor, sie im Feld zu testen.

Wer unterschreibt die Diagnose? Der Knoten der Verantwortung

Es gibt eine Dimension dieses Problems, die die Paper streifen, aber nicht vertieft behandeln, und die vielleicht von größtem Interesse für diejenigen ist, die im regulatorischen oder rechtlichen Bereich arbeiten: Wenn ein KI-System explizit seine eigene Unsicherheit erklärt, ändert sich dann etwas auf der Ebene der ärztlichen Verantwortung?

Betrachten wir zwei Szenarien. Im ersten liefert ein KI-System eine Diagnose mit 93 % Konfidenz, der Arzt folgt ihr und der Patient erleidet einen Schaden, weil die Diagnose falsch war. Im zweiten erklärt das System: „Konfidenz 93 %, aber dieser Patient hat demografische Merkmale, die in meinem Trainingsset nicht gut repräsentiert sind; ich würde eine zusätzliche fachärztliche Untersuchung vorschlagen“. Der Arzt ignoriert den Hinweis und der Patient erleidet denselben Schaden.

Ist die Verantwortung des Arztes in beiden Fällen identisch? Ändert sich die des Herstellers des KI-Systems? Die Antwort ist nicht offensichtlich und variiert signifikant zwischen verschiedenen Rechtsordnungen. In den Vereinigten Staaten reguliert die FDA klinische KI-Systeme als Medizinprodukte, und die Frage, wie die Explizierung von Unsicherheit mit behördlichen Genehmigungen interagiert, ist offen. In Europa schaffen der neue AI Act und die Medizinprodukteverordnung einen sich entwickelnden Rahmen, in dem klinische Entscheidungsunterstützungssysteme als Hochrisikosysteme eingestuft werden und Transparenzpflichten unterliegen. Aber die spezifische Frage, ob ein „bescheidenes“ System, das seine Grenzen kommuniziert, das Haftungsregime verändert, hat noch keine gefestigte normative Antwort.

Dieser Punkt ist auch für die Akzeptanz relevant. Setzt sich ein Krankenhaus, das ein KI-System implementiert, das explizit seine Grenzen aufzeigt, einem anderen rechtlichen Risiko aus als eines, das ein stummes System verwendet? Die Antwort könnte lauten: Es hängt davon ab, wie die Systemprotokolle (Logs) im Falle eines Rechtsstreits behandelt werden. Wenn das System Unsicherheit signalisiert hat und der Arzt das Signal ignoriert hat, wird diese digitale Aufzeichnung Teil der klinischen Akte.

Der Vergleich mit technischen Alternativen

Für diejenigen, die verstehen wollen, wo dieses Framework im Vergleich zum breiteren Ökosystem bestehender Techniken steht, lohnt sich ein kurzer Vergleich.

Techniken zur Calibration von Modellen, die bereits umfassend untersucht wurden, versuchen sicherzustellen, dass ein Modell, wenn es sagt „ich bin mir zu 70 % sicher“, in 70 % der Fälle tatsächlich recht hat. Das ist eine notwendige, aber nicht hinreichende Voraussetzung: Ein Modell kann gut kalibriert sein und dennoch nichts anders machen, basierend auf dieser Kalibrierung.

Selective Prediction ist die Familie von Techniken, bei denen das Modell keine Antwort gibt, wenn die Konfidenz unter eine festgelegte Schwelle fällt, und den Fall dem menschlichen Urteil überlässt. Das kommt dem MIT-Ansatz näher, neigt aber dazu, binär zu sein: Entweder es antwortet oder es antwortet nicht. Das BODHI-Framework und der Epistemic Virtue Score schlagen eine abgestuftere Reaktion vor, mit unterschiedlichen Verhaltensweisen je nach Art und Grad der erkannten Unsicherheit.

Modell-Ensembles, bei denen die Vorhersagen mehrerer Modelle kombiniert werden und die Abweichung zwischen ihnen als Schätzung der Unsicherheit verwendet wird, sind technisch anspruchsvoll und erzeugen bessere Kalibrierungen, verursachen aber signifikante Rechenkosten und Komplexität bei der Interpretation der Ergebnisse durch den Arzt.

Chain-of-Thought, die Technik, mit der man das Modell explizit Schritt für Schritt denken lässt, bevor es eine Antwort gibt, kann in bestimmten Kontexten die Qualität der Antworten bei komplexen klinischen Problemen verbessern, geht aber das Problem der Kommunikation von Unsicherheit an den Endnutzer nicht direkt an.

Das MIT-BODHI-Framework kann eher als Versuch gelesen werden, diese Techniken innerhalb einer kohärenten Verhaltensarchitektur zu orchestrieren, denn als alternative Technik. Es ersetzt weder die Kalibrierung noch die Out-of-Distribution Detection: Es bezieht sie als Komponenten ein und fügt die Ebene der strukturierten Antwort hinzu, die sie in nützliches Verhalten verwandelt.

Die Frage der Skalierung: Jenseits der textbasierten Diagnose

Ein Aspekt, den es zu untersuchen lohnt, ist, ob und wie sich dieser Ansatz auf andere Diagnosebereiche als den Text von Patientenakten übertragen lässt. Die Pressemitteilung des MIT nennt explizit zwei Erweiterungen: KI-Systeme für die Analyse von Röntgenbildern und Systeme für das Patientenmanagement in der Notaufnahme.

Die diagnostische Bildgebung ist ein besonders interessanter Fall. Modelle zur Analyse medizinischer Bilder haben in spezifischen Aufgaben spektakuläre Leistungen erzielt, neigen aber dazu, außerhalb ihrer Trainingsverteilung fragil zu sein und sind bekanntermaßen schwer zu interpretieren. Die Anwendung des Prinzips des Epistemic Virtue Score auf ein Modell, das eine CT-Thorax-Aufnahme analysiert, erfordert die Lösung eines zusätzlichen technischen Problems: Wie misst man die „Konfidenz“ eines faltungsneuronalen Netzwerks (CNN) auf einem Bild, und wie unterscheidet man Unsicherheit aufgrund der Bildqualität von der aufgrund eines atypischen klinischen Bildes?

Techniken wie GradCAM, die die Bildbereiche hervorheben, die die Entscheidung des Modells geleitet haben, oder PEEK, das Merkmalszuordnungen mit Unsicherheitsschätzung in Bildverarbeitungssystemen kombiniert, stellen Schritte in diese Richtung dar, aber die Integration in ein vollständiges Verhaltensframework wie BODHI wird noch erforscht.

Die Intelligenz des Innehaltens

Es gibt eine Szene im BODHI-Paper, die es wert ist, zitiert zu werden, weil sie die Philosophie des Projekts besser einfängt als jede Formel. Es handelt sich um einen imaginären klinischen Fall, in dem das hypothetische System HECTOR (Humble Electronic Clinical Teaching Operations Resource) ein Thorax-Röntgenbild eines 78-jährigen Patienten mit Wassereinlagerungen und pfeifendem Atem analysiert. Das System antwortet dem Arzt mit der Wahrscheinlichkeit eines Lungenödems, dem Konfidenzintervall und fügt dann hinzu: „Die Vorgeschichte des Patienten deutet auf ein atypisches Erscheinungsbild hin. Vielleicht wissen Sie etwas, das ich nicht weiß.“ Wenn der Arzt auf „Ich stimme nicht überein: Zeigen Sie mir, worüber Sie sich unsicher sind“ klickt, hebt das System einen problematischen Bereich im linken Unterlappen hervor und antwortet: „Ich wurde hauptsächlich an jüngeren Patienten trainiert. Ich bin möglicherweise nicht für 70-jährige Lungen während der Allergiesaison kalibriert. Aber ich würde gerne lernen.“

HECTOR existiert nicht. Die Autoren erklären dies explizit: Was sie beschreiben, ist ein weitgehend fiktives System, ein Ideal, das man anstreben sollte. Reale klinische KI-Systeme verhalten sich genau umgekehrt – mit übermäßig selbstbewusster Automatisierung und dem Fehlen von Mechanismen, um Unsicherheit auszudrücken oder an menschliche Expertise zu delegieren.

Aber die Distanz zwischen dem hypothetischen HECTOR und realen Systemen ist genau der Raum, in dem sich diese Forschung bewegt. Und die Frage, die am Ende dieser Lektüre offen bleibt, ist nicht, ob die Idee gut ist – denn das ist sie –, sondern ob es uns gelingen wird, die technischen, kulturellen, regulatorischen und organisatorischen Bedingungen zu schaffen, damit diese Vision zur gewöhnlichen klinischen Praxis wird.

Die Zukunft der KI in der Medizin gehört möglicherweise nicht den genauesten Modellen, sondern denen, die wissen, wann ihre eigene Genauigkeit nicht ausreicht. Nicht dem Orakel, das niemals irrt, sondern dem Assistenten, der reif genug ist zu wissen, wann er den Arzt in den Raum rufen muss.