Stanfords AI Index Report 2026: Die KI beschleunigt, die Governance bremst

Dreiundfünfzig Prozent weltweite Akzeptanz in drei Jahren, schneller als das Internet und der Personal Computer. Achtundachtzig Prozent der Unternehmen, die angeben, KI zu nutzen. Ein Programmier-Benchmark, SWE-bench Verified, der in zwölf Monaten von 60 % auf fast 100 % gestiegen ist. Private Investitionen in den USA in Höhe von 285,9 Milliarden Dollar, dreiundzwanzigmal so viel wie in China. Eine Kluft von fünfzig Prozentpunkten zwischen dem, was Experten von KI erwarten, und dem, was die Öffentlichkeit denkt. Diese fünf Zahlen umreißen den Rahmen des 2026 AI Index Report von Stanford HAI: die neunte Ausgabe eines Dokuments, das als schonungsloser Spiegel einer Branche fungiert, die viel schneller beschleunigt, als irgendjemand sie messen, regulieren oder gesellschaftlich absorbieren kann.

Der Bericht ist in acht Kapitel unterteilt – Forschung und Entwicklung, technische Leistung, verantwortungsvolle KI, Wirtschaft, Wissenschaft, Medizin, Bildung, Governance und öffentliche Meinung – und stützt sich auf Daten von Epoch AI, LinkedIn, GitHub, McKinsey und der OECD. Er beginnt mit einer Prämisse, die fast einem Geständnis gleicht: „Die Daten deuten nicht in eine einzige Richtung. Sie offenbaren ein Feld, das schneller skaliert als die Systeme um es herum.“ Das ist keine Rhetorik. Es ist der rote Faden, der sich durch das gesamte Dokument zieht.

Zahlen, die nicht lügen

Bevor wir in die Details gehen, lohnt es sich, bei dem zu verweilen, was der Bericht am deutlichsten vermittelt. Generative KI hat in weniger als drei Jahren eine Akzeptanzrate von 53 % in der Bevölkerung erreicht: Der Personal Computer benötigte dafür mehr als ein Jahrzehnt. 91,6 % der „bemerkenswerten“ Modelle im Jahr 2025 wurden von der privaten Industrie produziert, gegenüber nur einem einzigen akademischen Modell, das im gesamten Jahr identifiziert wurde. Die Universität, die das Fundament dieses Feldes errichtet hat, ist heute bei der Produktion von Systemen an der Grenze des Wissens fast irrelevant. Der wirtschaftliche Wert generativer KI-Tools allein für amerikanische Konsumenten erreichte 172 Milliarden Dollar pro Jahr, wobei sich der durchschnittliche Wert pro Nutzer innerhalb eines Jahres verdreifachte – und fast alles davon ist kostenlos zugänglich: einer der asymmetrischsten Technologiewertetransfers der jüngeren Geschichte.

Die zerklüftete Grenze: Wo Modelle glänzen und wo sie noch scheitern

Es gibt ein Bild im Bericht, das mehr wert ist als tausend Grafiken. Google Gemini Deep Think gewann bei der Internationalen Mathematik-Olympiade 2025 eine Goldmedaille im Wettbewerb gegen die besten Mathematiker unter den Highschool-Schülern weltweit. Dasselbe Modell oder Modelle auf demselben Niveau lesen eine analoge Uhr jedoch nur in 50,1 % der Fälle korrekt. In der Praxis also kaum besser als ein Münzwurf.

Dies ist das Konzept der jagged frontier (zerklüftete Grenze), das der Bericht als Interpretationsschlüssel für den aktuellen Moment verwendet. KI-Systeme sind weder allmächtig noch trivial: Sie sind in bestimmten Domänen außerordentlich fähig und in anderen überraschend fragil, oft ohne dass eine intuitive Logik hinter dieser Unterscheidung stünde. Olympiade-Mathematik ist eine strukturierte, symbolische Aufgabe mit präzisen und überprüfbaren Regeln. Das Lesen einer Uhr erfordert räumliche Wahrnehmung und visuell-semantisches Mapping, was für aktuelle Modelle schwierig bleibt.

Wo waren die Fortschritte im letzten Jahr am deutlichsten? Beim Code: Der Benchmark SWE-bench Verified, der die Fähigkeit misst, reale Probleme in GitHub-Repositories zu lösen, stieg innerhalb eines einzigen Jahres von 60 % auf fast 100 % im Vergleich zur menschlichen Baseline. Bei autonomen Agenten: In OSWorld, Tests für reale Aufgaben, die die Nutzung eines Computers mit Betriebssystem simulieren, sprang die Erfolgsquote von 12 % auf etwa 66 %. Bei wissenschaftlichen Benchmarks: Mehrere Frontier-Modelle erreichen oder übertreffen nun die menschliche Baseline bei Fragen auf Doktorandenniveau in Physik, Chemie und Mathematik.

Wo hingegen bleiben die Grenzen tiefgreifend? In der physischen Robotik: Roboter bewältigen nur 12 % der Haushaltsaufgaben, obwohl sie in Simulationen in kontrollierten Umgebungen 89,4 % erreichen. Die Lücke zwischen Labor und realer Küche ist immer noch ein Abgrund. Und bei Schlussfolgerungen, die kontextuelles Urteilsvermögen, gesunden Menschenverstand oder das Verständnis kommunikativer Untertöne erfordern: Hier zeigen Modelle die deutlichsten Risse, die sich am wenigsten durch einen Benchmark messen lassen.

Der Vergleich mit 2025 ist aufschlussreich. Letztes Jahr dokumentierte der Bericht die Ankunft der KI als Mainstream-Kraft. Dieses Jahr dokumentiert er, was nach der Ankunft passiert: Sättigung der Benchmarks (immer mehr Modelle bestehen sie, was sie weniger aussagekräftig macht), wachsende Intransparenz der Labore (weniger Transparenz bei Parametern, Datensätzen, Rechenleistung) und eine Divergenz zwischen den von den Entwicklern behaupteten und den durch unabhängige Tests verifizierten Fähigkeiten. Es ist der Unterschied zwischen einem Kinodebüt und der Fortsetzung: größer, teurer, aber mit weniger Überraschungen.

USA vs. China: Das Überholmanöver, das (noch) nicht stattfindet

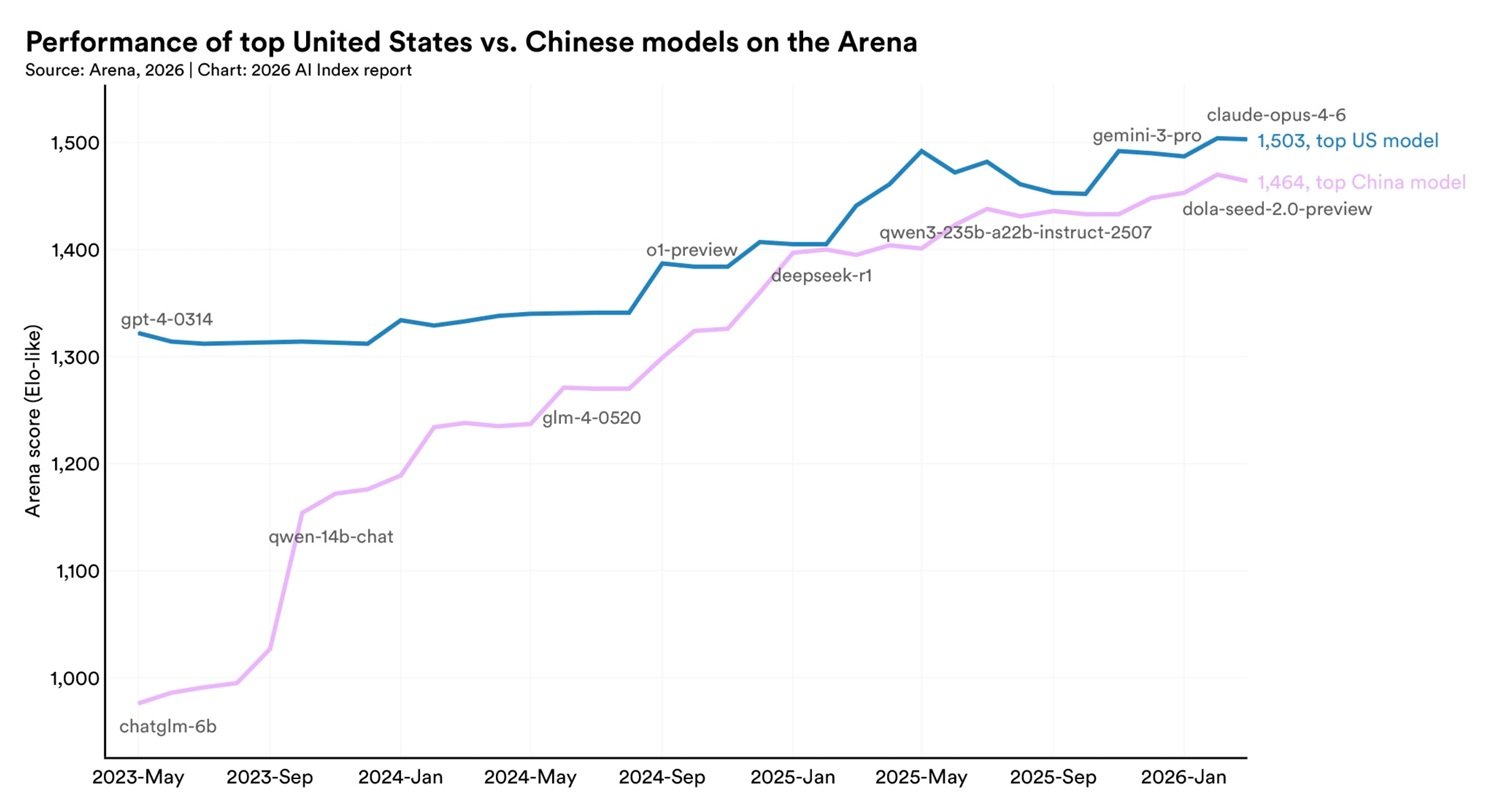

Das geopolitische Kapitel des Berichts wird wahrscheinlich von politischen und industriellen Entscheidungsträgern am aufmerksamsten verfolgt. Und die Daten von 2026 bestätigen einen Trend, den Beobachter dieser Branche bereits geahnt hatten: Der amerikanische Vorsprung bei Frontier-Modellen ist auf eine fast symbolische Distanz geschrumpft.

Im Februar 2025 zog DeepSeek-R1 kurzzeitig mit dem besten verfügbaren amerikanischen Modell gleich. Im März 2026 führt das Spitzenmodell von Anthropic die Rangliste mit einem Vorsprung von 2,7 % gegenüber dem besten chinesischen Modell an. In einem Feld, in dem Benchmarks wöchentlich aktualisiert werden, sind 2,7 Prozentpunkte kein strategischer Vorteil: Es ist statistisches Rauschen. Die Modelle der beiden Länder haben im Laufe des letzten Jahres mehrfach die Tabellenführung getauscht.

Diese Daten müssen im Zusammenhang mit der breiteren Struktur des Wettbewerbs gelesen werden. Die Vereinigten Staaten bleiben bei der Produktion bemerkenswerter Modelle vorne – 50 im Jahr 2025 gegenüber 30 aus China – und bei Patenten mit hoher Wirkung. China führt hingegen beim Volumen wissenschaftlicher Publikationen, bei Zitaten, beim gesamten Patentausstoß und bei Installationen von Industrierobotern. Peking steigerte seinen Anteil an den 100 weltweit am häufigsten zitierten KI-Artikeln von 33 im Jahr 2021 auf 41 im Jahr 2024. Südkorea erweist sich als Ausreißer bei der Innovationsdichte: weltweit an erster Stelle bei KI-Patenten pro Kopf.

Das Bild ist das eines technologischen Wettbewerbs, der sich eher in eine bewaffnete Parität als in eine einseitige Vorherrschaft verwandelt hat. Wer diese Daten im Lichte der Exportstopps für Chips und des Halbleiterkriegs liest, kommt nicht umhin sich zu fragen, ob diese Maßnahmen das erhoffte Ergebnis erzielt haben. Die Antwort, die aus Stanford kommt, ist unbequem: wahrscheinlich nicht.

Auf AITalk haben wir diese Entwicklung aufmerksam verfolgt. Letztes Jahr dokumentierten wir die Fähigkeiten von GLM-5 von Zhipu AI, einem chinesischen Modell, das bereits damals eine wettbewerbsfähige Leistung bei multimodalen Benchmarks zeigte. In der Analyse zum KI-Krieg zwischen den USA und China hatten wir hervorgehoben, wie die amerikanischen Restriktionen paradoxerweise die technologische Autonomie Chinas im Bereich der Chips und Modelle beschleunigten. Kimi K2 von Moonshot AI und vor allem DeepSeek mit seiner Fähigkeit, wettbewerbsfähige Modelle zu drastisch niedrigeren Kosten zu produzieren, haben diese Vorhersage wahr gemacht. Der Stanford-Bericht versieht eine Geschichte, die bereits geschrieben wurde, lediglich mit dem quantitativen Siegel.

Ein Element, das der Bericht diesem Szenario hinzufügt, ist die Abwanderung amerikanischer Talente, die vielleicht den am meisten unterschätzten Riss in der Vormachtstellung der USA darstellt. Die Zahl der KI-Forscher und -Entwickler, die in die Vereinigten Staaten ziehen, ist im Vergleich zu 2017 um 89 % eingebrochen, mit einem Rückgang von 80 % allein im letzten Jahr. Die Vereinigten Staaten bleiben das Land mit dem größten Pool an KI-Talenten, ziehen aber so wenige neue Köpfe an wie seit zehn Jahren nicht mehr. Dies ist die Art von Indikator, die sich nicht auf die heutigen Benchmarks auswirkt, aber die Entwicklung der nächsten fünf Jahre definiert.

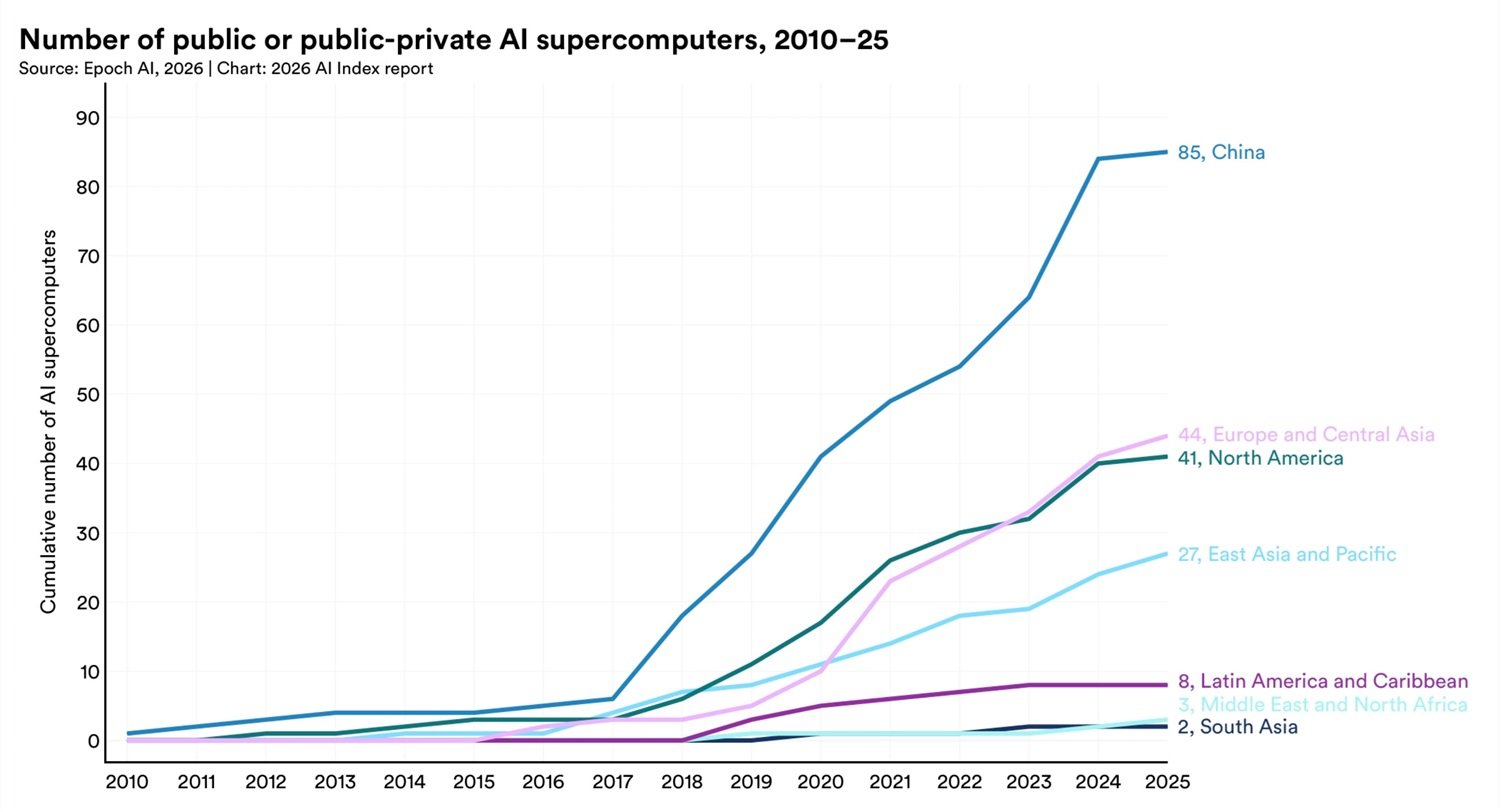

Die fragile Infrastruktur der Welt

Hinter jeder Antwort eines KI-Modells steht eine materielle Lieferkette von enormem Ausmaß und unterschätzter struktureller Fragilität. In den Vereinigten Staaten befinden sich 5.427 KI-Rechenzentren – mehr als zehnmal so viele wie in jedem anderen Land – und sie verbrauchen für diesen Zweck mehr Energie als jede andere Region. Die weltweite Rechenkapazität für KI ist seit 2022 jährlich um das 3,3-fache gewachsen und erreicht das Äquivalent von 17,1 Millionen Nvidia H100-Karten. Nvidia kontrolliert über 60 % dieser Rechenleistung.

Das geopolitisch relevanteste Datum ist jedoch ein anderes. Fast alle Chips, die diese Infrastruktur antreiben, werden von einem einzigen Unternehmen produziert: TSMC mit Sitz in Taiwan. Der Bericht stellt es ohne Umschweife fest: Die globale KI-Hardware-Lieferkette hängt von einer einzigen Gießerei auf einer umstrittenen Insel ab. Es gibt nur wenige Vergleiche für diese Konzentration systemischer Risiken – vielleicht die europäische Energieabhängigkeit von russischem Gas vor 2022 –, aber mit einem entscheidenden Unterschied: Für KI-Chips gibt es keinen fertigen alternativen Anbieter. TSMC hat 2025 eine erste Expansion in Arizona gestartet, aber die amerikanische Kapazität bleibt ein Bruchteil der taiwanesischen.

Die Umweltauswirkungen vervollständigen das Bild. Das Training von Grok 4 produzierte etwa 72.816 Tonnen CO₂-Äquivalent. Die Stromkapazität von KI-Rechenzentren erreichte 29,6 Gigawatt, vergleichbar mit dem Spitzenverbrauch des gesamten Bundesstaates New York. Schätzungen zum Wasserverbrauch der Inferenz von GPT-4o deuten auf eine jährliche Nutzung hin, die den Bedarf von 12 Millionen Menschen übersteigen könnte. KI ist keine virtuelle Industrie: Sie hat einen physischen Körper, und dieser Körper wächst schneller als unsere Energieinfrastrukturen.

Arbeit, Akzeptanz und Wert: Wer gewinnt, wer verliert

Das Kapitel zur Wirtschaft im Bericht wird von Nicht-Fachleuten am meisten erwartet, und dieses Jahr liefert es detailliertere Daten als üblich. Die Produktivität in Sektoren wie Kundensupport und Softwareentwicklung ist in Kontexten, in denen KI strukturiert eingeführt wurde, um 14 % bis 26 % gestiegen. Die Auswirkungen sind jedoch nicht einheitlich: Die Gewinne sind bei Routineaufgaben am stärksten und bei Aufgaben, die komplexe Urteilskraft erfordern, schwächer oder sogar negativ.

Das am meisten diskutierte Datum betrifft junge amerikanische Entwickler. In der Altersgruppe der 22- bis 25-Jährigen sank die Beschäftigung im Softwaresektor im Jahr 2024 um fast 20 %, während die Zahl der Senior-Entwickler weiter wächst. Der Bericht vermeidet es, Korrelation mit Kausalität gleichzusetzen, aber die Verbindung ist schwer zu ignorieren: KI-Produktivitätsgewinne konzentrieren sich genau auf die Aufgaben, die typischerweise Junior-Profilen zugewiesen werden, und die Auswirkungen auf die Beschäftigung manifestieren sich genau in dieser Gruppe. Es ist, als würde die KI die Einstiegsebene des Berufs komprimieren und den Ausbildungsweg auslöschen, der Absolventen jahrzehntelang in erfahrene Entwickler verwandelt hat.

Das Adoptionsmodell weist überraschende geografische Merkmale auf. Singapur liegt bei 61 %, die Vereinigten Arabischen Emirate bei 54 % – beide liegen über den Erwartungen im Verhältnis zum BIP pro Kopf. Die Vereinigten Staaten, Sitz der wichtigsten KI-Entwickler, liegen mit 28,3 % auf Platz 24: Die Nähe zur Industrie reicht nicht aus, um eine breite Akzeptanz zu erzeugen.

Governance, Sicherheit, Transparenz: Der systemische Rückstand

Das besorgniserregendste Kapitel des Berichts ist nicht das über technische Fähigkeiten, sondern das über verantwortungsvolle KI. Fast alle führenden Labore veröffentlichen Ergebnisse zu Fähigkeiten-Benchmarks. Aber die Abdeckung von Benchmarks für Sicherheit, Fairness und Governance bleibt sporadisch und uneinheitlich, was jeden systematischen Vergleich unmöglich macht. Dokumentierte KI-bezogene Vorfälle stiegen im Jahr 2025 auf 362, gegenüber 233 im Jahr 2024. Und der Bericht weist auf ein tückisches technisches Problem hin: Die Verbesserung einer Dimension verantwortungsvoller KI, zum Beispiel der Sicherheit, kann eine andere, wie die Genauigkeit, verschlechtern.

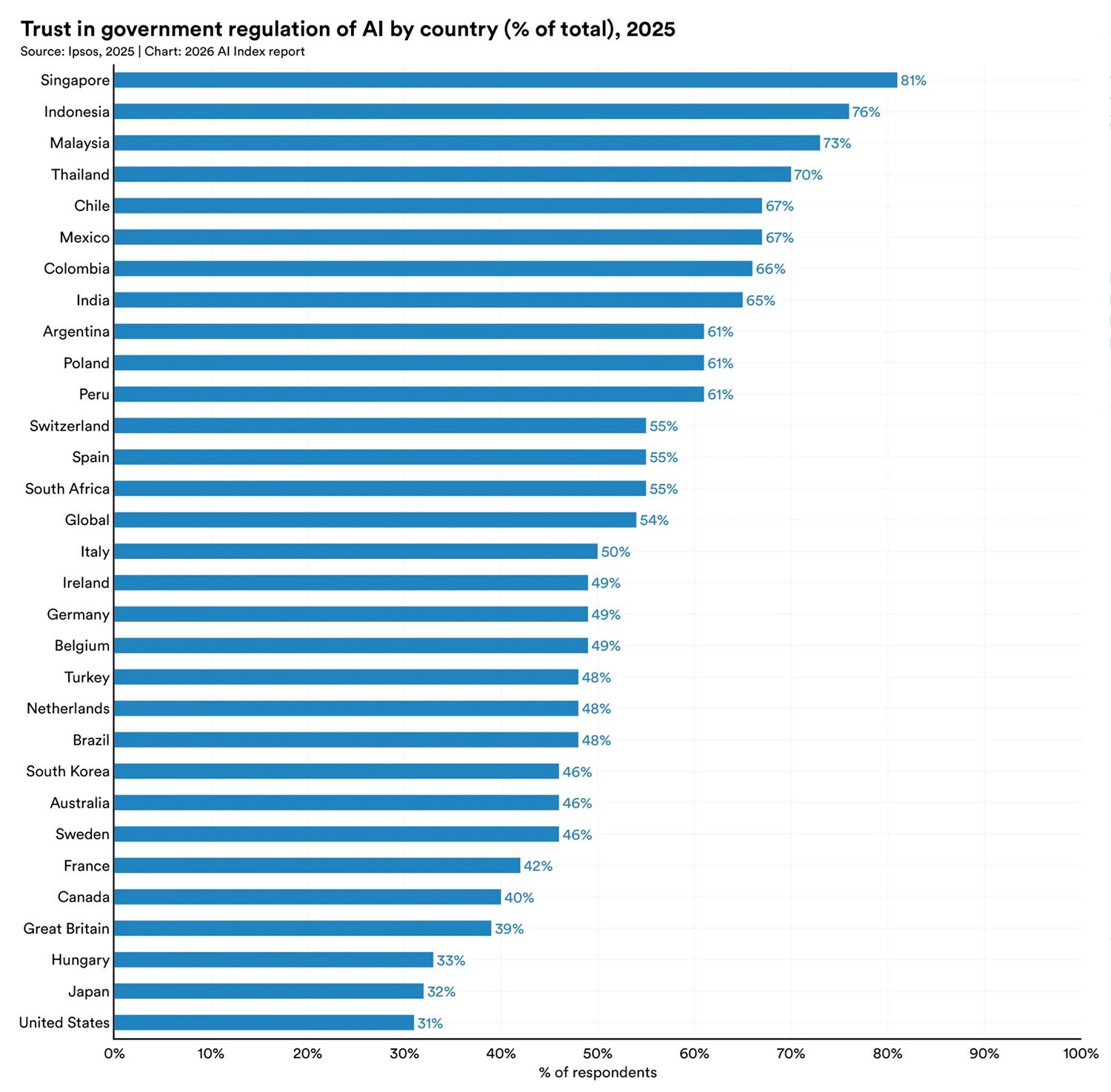

Auf der Governance-Ebene gab es 2025 Bewegungen in entgegengesetzte Richtungen. Mit dem EU AI Act traten die ersten Verbote in Kraft. Die Vereinigten Staaten schwenkten in Richtung Deregulierung um. Japan, Südkorea und Italien verabschiedeten nationale Gesetze. Mehr als die Hälfte der im Jahr 2025 neu verabschiedeten nationalen Strategien stammt aus Entwicklungsländern, die zum ersten Mal in die Regulierungsdebatte einsteigen. KI-Souveränität – die Fähigkeit, die eigene Infrastruktur und die eigenen Modelle autonom zu kontrollieren – ist zum zentralen Organisationsprinzip vieler dieser Strategien geworden.

Das Datum zum öffentlichen Vertrauen ist das beunruhigendste im gesamten Bericht. Unter den in die Umfrage einbezogenen Ländern zeigen die Vereinigten Staaten das geringste Vertrauen in ihre eigene Regierung bei der KI-Regulierung: 31 %. Die Europäische Union gilt als vertrauenswürdiger als die Vereinigten Staaten oder China. Für das Land, in dem OpenAI, Google DeepMind, Anthropic und xAI beheimatet sind, ist dies ein Urteil, das viel über die Kluft zwischen industrieller Kapazität und regulatorischer Legitimität aussagt. Die unterschiedliche Perspektive von Experten und Öffentlichkeit fasst dies zusammen: 73 % der Experten erwarten positive Auswirkungen von KI auf ihre Arbeit, gegenüber nur 23 % der Öffentlichkeit. Fünfzig Prozentpunkte Unterschied bei einer der zentralen Fragen unserer Zeit.

KI in Wissenschaft, Medizin, Bildung

Der Bericht 2026 führt zum ersten Mal zwei eigenständige Kapitel zu Wissenschaft und Medizin ein. Im wissenschaftlichen Bereich übertreffen Frontier-Modelle im ChemBench-Benchmark im Durchschnitt menschliche Chemiker, und ein Genom-Modell mit 200 Millionen Parametern schlug Systeme, die fast zweihundertmal größer waren. Das Gesetz „größer ist besser“ bekommt in spezialisierten Domänen Risse. Aber dieselben Modelle erreichen bei der Replikation astrophysikalischer Experimente Werte von unter 20 %: Die zerklüftete Grenze gilt auch im Labor.

In der Medizin erlebten automatische Dokumentationstools, die klinische Notizen aus dem Gespräch zwischen Patient und Arzt generieren, im Jahr 2025 eine bedeutende Akzeptanz, wobei Ärzte von bis zu 83 % Zeitersparnis beim Verfassen berichten. Das Problem ist die Evidenz: Eine Überprüfung von mehr als 500 klinischen Studien ergab, dass fast die Hälfte Prüfungsfragen anstelle von realen Patientendaten verwendete und nur 5 % auf authentischen klinischen Daten basierten. Die Kluft zwischen Versprechen und Beweis ist immer noch groß.

Im Bildungsbereich nutzen mehr als 80 % der Schüler KI für Schulaufgaben, aber nur die Hälfte der Schulen hat Richtlinien in Kraft und nur 6 % der Lehrer beurteilen diese als klar. Neue KI-Promotionen in den USA und Kanada stiegen zwischen 2022 und 2024 um 22 %, aber dieser Zuwachs ging vollständig in die Wissenschaft, nicht in die Industrie. Mehr Ausbildung auf hohem Niveau, weniger direkter Transfer in den produktiven Sektor: ein Paradoxon, das der Bericht registriert, ohne es zu lösen.

Offene Fragen: Wer kontrolliert, wer profitiert, wer zahlt

Der Stanford-Bericht schließt nicht mit Antworten. Er schließt mit Fragen, und das ist seine wertvollste Eigenschaft in einer Branche, in der Gewissheiten zu Marktpreisen verkauft werden.

Zur Kontrolle: Die Produktion von Modellen bleibt in ganz wenigen privaten Organisationen konzentriert, und die besten Systeme der Welt werden immer intransparenter – 80 der 95 bemerkenswerten Modelle des Jahres 2025 wurden ohne Trainingscode veröffentlicht. Wer nicht Google, OpenAI, Anthropic, Alibaba oder DeepSeek ist, agiert in einem Ökosystem, das von Entscheidungen abhängt, die man nicht kontrolliert. Zum Wert: KI erzeugt messbaren Wohlstand, aber seine Verteilung ist stark asymmetrisch – wenige Betreiber streichen die Erträge ein, Junior-Arbeiter zahlen allmählich den Preis der Automatisierung, und Konsumenten erhalten kostenlose Tools mit noch wenig verstandenen Abhängigkeiten und Risiken. Zu den Kosten: Der ökologische Fußabdruck wächst, ohne dass er eingepreist wird, Junior-Rollen verschwinden zusammen mit dem Ausbildungsweg, der die Experten von morgen hervorbringt, und die Governance-Kosten häufen sich im Stillen an, während die Fähigkeiten-Benchmarks steigen.

Jede transformative Technologie gestaltet Infrastrukturen, Arbeit und Macht neu. Der Stanford-Bericht 2026 dokumentiert mit Daten, dass die KI genau dies tut – schneller, als unsere Systeme zur Messung, Regulierung und Anpassung folgen können. Die Nachricht ist nicht, dass die KI besser wird. Sie ist, dass die Kluft zwischen ihrer Geschwindigkeit und unserer Fähigkeit, sie zu managen, mit jeder Ausgabe des Berichts größer wird. Und das ist vorerst die am stärksten zerklüftete Grenze von allen.