Steerling: Wenn die KI dir ihre Gedanken erklärt

Im Herzen der modernen künstlichen Intelligenz liegt ein Paradoxon, das selten laut ausgesprochen wird: Die leistungsfähigsten Systeme, die wir gebaut haben, sind auch diejenigen, die wir am wenigsten verstehen. Ein Sprachmodell mit Milliarden von Parametern kann Code schreiben, wissenschaftliche Forschung zusammenfassen, über juristische Verträge nachdenken, und doch ist niemand, nicht einmal diejenigen, die es trainiert haben, in der Lage, präzise zu sagen, *warum es dieses Wort und nicht ein anderes geschrieben hat. Es ist, als hätte man einen außerordentlich fähigen Mitarbeiter, den man jedoch nie bitten kann, einem seine Gedankengänge offenzulegen.*

Die Folgen dieser Undurchsichtigkeit sind nicht abstrakt. Als Grok von xAI wiederholt politisch bizarre Ergebnisse lieferte, musste das Wartungsteam lange Sitzungen zur „Befragung“ des Modells durchführen, Prompts verfeinern, Parameter anpassen, in der Hoffnung, dass sich das Verhalten stabilisieren würde. Als ChatGPT wegen seiner Tendenz zur Sycophancy (Kriecherei) – also dem Bestreben, dem Benutzer auch dann zuzustimmen, wenn er im Unrecht ist – in die Kritik geriet, war das Problem chirurgisch unmöglich zu lokalisieren: Alles war über Milliarden von Verbindungen verteilt, überall und nirgends. Die gesamte Forschung zur sogenannten XAI, der erklärbaren KI, entspringt dieser Frustration und versucht, mit nachträglich angewandten Werkzeugen darauf zu antworten – Techniken wie LIME oder SHAP, die ein bereits trainiertes Modell analysieren und versuchen, seine Funktionsweise von außen zu rekonstruieren, wie Archäologen, die in den Ruinen einer verlorenen Zivilisation graben.

Guide Labs, ein in San Francisco gegründetes Startup, hat beschlossen, das Problem aus einem völlig anderen Blickwinkel anzugehen. Anstatt das Modell nach seiner Entstehung zu untersuchen, wurde versucht, Transparenz zu einem integralen Bestandteil der Architektur zu machen – etwas, das nicht hinzugefügt, sondern von Anfang an hineinentwickelt wird.

Das Problem, das das Jahr 2020 ans Licht brachte

Um zu verstehen, was Guide Labs gebaut hat, lohnt es sich, dort anzufangen, wo das Projekt geboren wurde. Julius Adebayo, CEO und Mitbegründer des Unternehmens zusammen mit der Chief Science Officer Aya Abdelsalam Ismail, begann diesen Weg während seiner Promotion am MIT. Im Jahr 2020 war er Mitautor eines akademischen Papers, das einen bedeutenden Einfluss auf das Feld hatte: Die Forschung zeigte, dass die damals verwendeten Methoden zur „Erklärung“ der Entscheidungen von Deep-Learning-Modellen nicht zuverlässig waren. Post-hoc-Interpretierbarkeitstools – solche, die auf ein bereits gebautes Modell angewendet werden, um zu verstehen, was es tut – lieferten Erklärungen, die zwar sinnvoll erschienen, aber nicht notwendigerweise dem entsprachen, wie das Modell tatsächlich dachte.

Dies ist eine Entdeckung, die fast philosophisch klingt, aber enorme praktische Auswirkungen hat. Wenn man den Werkzeugen nicht vertrauen kann, die einem sagen, warum ein Modell eine Entscheidung getroffen hat, kann man diese Erklärungen nicht verwenden, um Fehler zu korrigieren, die Einhaltung gesetzlicher Vorschriften zu überprüfen oder sicherzustellen, dass das Modell nicht auf Grundlagen diskriminiert, die es nicht berücksichtigen sollte. Erklärbarkeit wurde in diesem Rahmen eher zu einer Form des narrativen Trostes als zu einer echten Kontrolle.

Adebayo zog daraus einen radikalen Schluss: Der einzige Weg zu authentischer Interpretierbarkeit besteht darin, sie in das Modell einzubauen, anstatt sie obenauf zu setzen. „Die Art von Interpretierbarkeit, die üblicherweise praktiziert wird, ist wie Neurowissenschaft an einem Modell zu betreiben“, sagte er in einem Interview mit TechCrunch. „Wir hingegen entwerfen das Modell von Grund auf so, dass man keine Neurowissenschaften betreiben muss.“

Die Architektur: Ein sichtbarer Flaschenhals

Am 23. Februar 2026 veröffentlichte Guide Labs Steerling-8B, ein Sprachmodell mit 8 Milliarden Parametern unter Apache 2.0-Lizenz, das mit 1,35 Billionen Token trainiert wurde. Die Entscheidung, das Modell als Open Source zur Verfügung zu stellen, mit Gewichten auf Hugging Face und Code auf GitHub, ist Teil einer präzisen Strategie: den Ansatz von der wissenschaftlichen Gemeinschaft prüfen zu lassen und echtes Feedback zu sammeln.

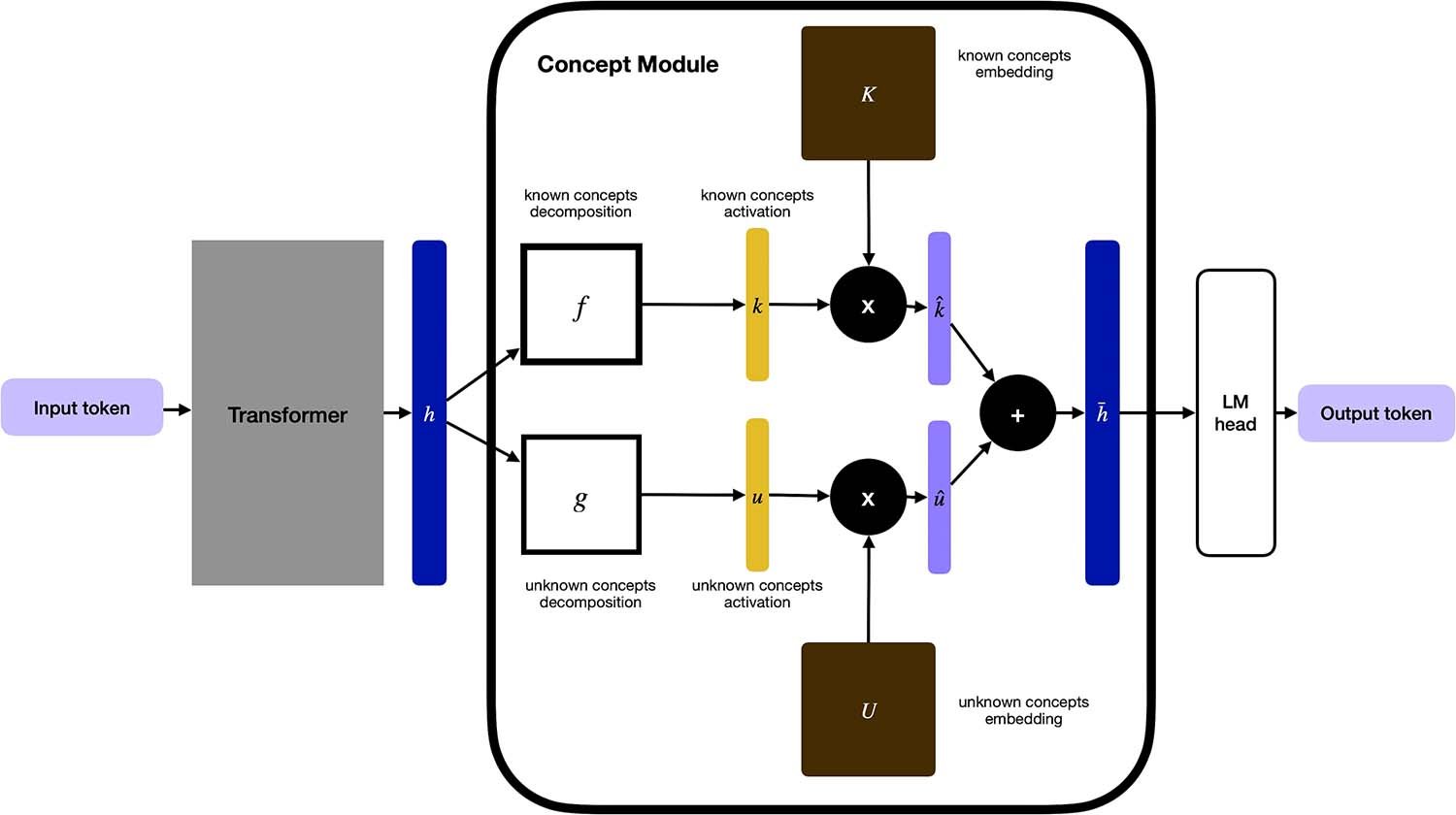

Die zentrale Innovation nennt sich Concept Module (Konzeptmodul): eine Architekturschicht, die zwischen dem Transformer-Kern des Modells und seiner Ausgabeschicht eingefügt wird. In einem traditionellen Sprachmodell werden interne Repräsentationen über einen undurchsichtigen und hochgradig nichtlinearen Pfad in Vorhersagen des nächsten Tokens umgewandelt. In Steerling ist dieser Pfad unterbrochen: Bevor ein Output erzeugt wird, muss jede Repräsentation diesen konzeptionellen Flaschenhals passieren, wo sie in verständliche Begriffe übersetzt wird.

Wie funktioniert das in der Praxis? Das Modell arbeitet mit zwei Familien von Konzepten. Die erste umfasst etwa 33.000 „bekannte“ Konzepte, die manuell beschriftet wurden – Kategorien wie Recht, Medizin, Ironie, analytischer Ton, Molekularbiologie. Die zweite umfasst etwa 100.000 Konzepte, die das Modell während des Trainings autonom und ohne menschliche Aufsicht „entdeckt“ hat. Jede Token-Vorhersage muss eine lineare Kombination dieser Konzepte passieren, was bedeutet, dass der Beitrag jedes Konzepts zu jedem Output mathematisch berechenbar und nicht nur angenähert ist.

Das praktische Ergebnis ist bemerkenswert: Für jede Gruppe von Token, die von Steerling generiert wurden, ist es möglich, drei Ursprungsebenen zurückzuverfolgen. Die erste ist der Eingabekontext, also welche Teile des Prompts diesen Teil der Antwort am stärksten beeinflusst haben. Die zweite sind die Konzepte, mit einer nach Relevanz geordneten Liste, welche semantischen Kategorien die Generierung geleitet haben. Die dritte Ebene ist vielleicht die überraschendste: die Trainingsdaten, mit der Verteilung der Trainingsquellen, die die während der Generierung aktivierten Konzepte gespeist haben, wie ArXiv, Wikipedia, FLAN und so weiter.

Es ist, als hätte man für jeden von der KI generierten Absatz eine Fußnote, die erklärt, woher er kommt.

Die Kosten der Ehrlichkeit: Wie viel bezahlt man an Performance?

Die Frage, die sich spontan stellt, ist offensichtlich: Wenn man das Modell zwingt, einen konzeptionellen Flaschenhals zu passieren, gibt man dann etwas in Bezug auf die Fähigkeiten auf? Die Antwort von Guide Labs, gestützt auf die im technischen Paper Scaling Interpretable Models to 8B veröffentlichten Daten, lautet, dass die Kosten zwar existieren, aber handhabbar und vorhersehbar sind.

Experimente zeigen, dass sich die Interpretierbarkeit wie eine „feste Steuer“ verhält: ein kleiner, konstanter Zoll, der sich mit zunehmender Modellgröße nicht verschlechtert. Die Lernkurven zwischen dem Basismodell und dem Modell mit dem Concept Module sind fast deckungsgleich. Bei Standard-Benchmarks wie HellaSwag, OpenBookQA, ARC-Challenge, PIQA und WinoGrande behält das interpretierbare Modell eine mit dem Basismodell ohne Concept Module vergleichbare Leistung bei, und der Genauigkeitsunterschied verringert sich mit zunehmender Modellgröße weiter.

Steerling-8B erreicht laut Guide Labs 90 % der Fähigkeiten äquivalenter Modelle, die auf Datensätzen trainiert wurden, die 2- bis 7-mal größer sind. Das ist nicht nur als Ergebnis der Interpretierbarkeit bemerkenswert, sondern auch in Bezug auf die Effizienz des Trainings.

Es gibt jedoch einen kritischen Aspekt, der Aufmerksamkeit verdient: Diese Benchmarks messen die allgemeine sprachliche Leistung, nicht die Qualität der Erklärungen. Ob die vom Modell identifizierten Konzepte wirklich informativ und nicht zirkulär sind – also ob „Erklären“ nicht einfach bedeutet, die offensichtliche Kategorie zu benennen –, ist eine noch offene Frage. Dem Feld der Interpretierbarkeit fehlt es an gemeinsamen und konsolidierten Metriken, um die Qualität einer Erklärung objektiv zu bewerten. Guide Labs misst seine Interpretierbarkeit mit internen Metriken (wie der AUC der Konzepterkennung im Vergleich zu Referenzannotationen), aber ein universell akzeptierter industrieller oder akademischer Standard existiert noch nicht.

Zudem gibt es eine weitere strukturelle Einschränkung zu berücksichtigen. Die gesamte Architektur hängt von einem vorgelagerten System namens ATLAS ab, das vom selben Team entwickelt wurde und dafür zuständig ist, den Pre-Training-Korpus mit konzeptionellen Labels zu annotieren. Dieses System verwendet seinerseits KI-Modelle zur Klassifizierung der Daten. Dies ist eine geniale Lösung, führt aber eine Abhängigkeit ein: Die Qualität der endgültigen Interpretierbarkeit ist an die Qualität der vorgelagerten Annotationen gebunden. Wenn ATLAS ungenau ist, werden es auch die Erklärungen von Steerling sein, auch wenn dies von außen niemand sofort bemerken wird.

Was sich wirklich ändert: Kontrolle, nicht nur Erklärung

Einer der interessantesten Aspekte von Steerling, und wahrscheinlich derjenige mit den unmittelbarsten praktischen Auswirkungen, ist nicht die Fähigkeit zu erklären, sondern die Fähigkeit zu kontrollieren. Da jede Vorhersage eine lineare Funktion der konzeptionellen Aktivierungen ist, ist es möglich, diese Aktivierungen direkt zur Laufzeit zu ändern, ohne das Modell neu trainieren zu müssen.

Dies nennt man Concept Steering (konzeptionelles Lenken) und hat Konsequenzen, die über die bloße Erklärbarkeit hinausgehen. Will man, dass das Modell aufhört, sich auf eine bestimmte Art von Inhalten zu beziehen? Dann unterdrückt man das entsprechende Konzept. Will man, dass es in einem technischeren Ton antwortet? Dann verstärkt man die Konzepte, die mit dem Fachregister assoziiert sind. Will man Wissen zu einem spezifischen Thema entfernen, ohne von Grund auf neu zu trainieren? Dann greift man chirurgisch auf konzeptioneller Ebene ein.

Adebayo illustrierte diese Fähigkeit mit einem besonders aufschlussreichen konkreten Beispiel, das im Interview mit TechCrunch zitiert wurde: In traditionellen Modellen ist das Konzept des Geschlechts (Gender) auf chaotische und miteinander verbundene Weise über hunderte Millionen von Parametern verteilt. Eine zuverlässige Änderung erfordert enorme Fine-Tuning-Bemühungen, die oft unerwünschte Nebenwirkungen erzeugen. In Steerling hingegen ist das Konzept des Geschlechts rückverfolgbar und kontrollierbar, sodass man direkt darauf einwirken kann. Dies ist keine Garantie für die Abwesenheit von Bias – die Konzepte selbst spiegeln die Daten wider, auf denen das Modell trainiert wurde –, aber es ist ein weitaus präziserer Interventionsmechanismus als jede Post-hoc-Alternative.

Dies hat konkrete Auswirkungen in mindestens drei Hochrisikokontexten. Im medizinischen Bereich, wo ein KI-System, das bei der Diagnose unterstützt, nachweisen können muss, auf welcher Evidenz eine Empfehlung basiert. Im Finanzbereich, wo ein Modell, das Kreditanträge bewertet, Kriterien wie Ethnie oder Geschlecht nicht berücksichtigen darf und dies nachweisen können muss. Im juristischen Bereich, wo die Rückverfolgbarkeit der Argumentation oft eine Systemanforderung und keine Option ist.

Der regulatorische Kontext: Der EU AI Act als Beschleuniger

Steerling kommt zu einer Zeit, in der der regulatorische Druck auf die Interpretierbarkeit von KI-Systemen konkret wird und wächst. Der EU AI Act klassifiziert KI-Systeme in Risikokategorien, wobei Hochrisikosysteme – also solche, die in der Medizin, der Justiz, im Kreditwesen oder bei der Personalauswahl eingesetzt werden – expliziten Transparenz- und Überprüfbarkeitsanforderungen unterliegen. Das NIST-Framework in den USA bewegt sich in dieselbe Richtung.

Der Ansatz der intrinsischen Interpretierbarkeit von Guide Labs deckt sich strukturell mit diesen Anforderungen auf eine Weise, die Post-hoc-Methoden nicht garantieren können. Eine in das Modell eingebaute Erklärung ist per Definition getreu seiner Funktionsweise. Eine von außen konstruierte Erklärung kann zwar informativ sein, bleibt aber eine Annäherung, und in Kontexten, in denen diese Erklärung einer rechtlichen Analyse standhalten muss, ist dieser Unterschied substanziell.

Dennoch wird die reale Überprüfbarkeit von Steerling davon abhängen, wie sehr die externe Gemeinschaft in der Lage sein wird, seine Behauptungen unabhängig zu verifizieren. Der Code ist öffentlich, die Gewichte sind verfügbar, und das ist ein guter Anfang. Aber die Validierung eines so neuen Ansatzes erfordert Zeit, Reproduzierbarkeit und systematische Kritik durch unabhängige Forscher. Wir stehen erst am Anfang dieses Prozesses.

Das Team und der Weg

Guide Labs hat das Y-Combinator-Programm absolviert und im November 2024 eine Seed-Runde über 9 Millionen Dollar abgeschlossen, angeführt von Initialized Capital. Zu den Beratern gehört Jonathan Frankle, ein bekannter Forscher auf dem Gebiet der Effizienz neuronaler Modelle. Die Wahl der Apache 2.0-Lizenz, einer permissiven Lizenz, die eine uneingeschränkte kommerzielle Nutzung erlaubt, ist bewusst getroffen: Guide Labs möchte, dass Steerling von der Gemeinschaft angenommen, geprüft und verbessert wird. Als nächster Schritt ist die Entwicklung größerer Modelle sowie die Öffnung des API- und Agentenzugangs angekündigt.

Die Fragen, die offen bleiben

Steerling ist ein wirklich interessantes und technisch solides Projekt, aber es wäre naiv, es als die endgültige Lösung für das Problem der Undurchsichtigkeit von KI-Modellen zu präsentieren. Es gibt legitime Fragen, auf die noch niemand eine zufriedenstellende Antwort gegeben hat.

Die erste betrifft die Skalierbarkeit hin zu Frontier-Modellen. Steerling-8B arbeitet mit 8 Milliarden Parametern. Die leistungsfähigsten Modelle im Umlauf haben eine ganz andere Größenordnung, und es ist keineswegs ausgemacht, dass der Overhead des Concept Modules auch bei diesen Dimensionen eine „feste Steuer“ bleibt. Guide Labs behauptet, dass die Skalierungsgesetze erhalten bleiben, aber der Beweis auf der Ebene eines Frontier-Modells steht noch aus.

Die zweite Frage betrifft die intrinsische Qualität der Konzepte. Ein Token bis zu einem Konzept zurückzuverfolgen, das mit „Recht“ oder „analytischer Ton“ beschriftet ist, ist informativ, aber inwieweit entsprechen diese Labels wirklich dem, was im Inneren des Modells passiert? Es besteht das konkrete Risiko, ein Erklärungsnarrativ aufzubauen, das zwar in sich konsistent ist, aber nicht mit der internen Realität des Systems übereinstimmt. In diesem Fall würde Interpretierbarkeit nicht zur Kontrolle, sondern zu einer ausgefeilteren Form von Transparenztheater: Das Modell wirkt erklärbar, aber die Erklärungen entsprechen keinen realen Mechanismen.

Die dritte Frage betrifft die Ethik der Zuschreibungen. Wenn wir jeden Output bis zu den Trainingsdaten zurückverfolgen können, können wir auch identifizieren, welche Quellen zu einer problematischen Antwort beigetragen haben. Das ist eine Macht, die gut genutzt werden kann – um Bias zu entfernen, das Urheberrecht zu respektieren, Genauigkeit zu garantieren. Sie kann aber auch dazu verwendet werden, Verantwortlichkeiten selektiv zuzuweisen oder Kontrollmechanismen darüber aufzubauen, was das Modell „weiß“ oder nicht weiß, mit Auswirkungen, die weit über das Technische hinausgehen.

Schließlich stellt sich die grundlegendste Frage von allen: Was bedeutet es eigentlich, ein Sprachmodell zu „verstehen“? Die Antwort von Guide Labs – jeden Token bis zu seinen konzeptionellen Beiträgen und seinen Trainingsquellen zurückzuverfolgen – ist elegant und operativ nützlich. Aber ist ein Modell, das sich in diesen Begriffen erklärt, wirklich verständlicher, oder ist es einfach nur artikulierter darin, seine eigene Undurchsichtigkeit zu beschreiben?

Dies ist eine Frage, der sich Industrie und Forschung gemeinsam stellen müssen, wenn Ansätze wie der von Guide Labs reifer und verbreiteter werden. Vorerst ist Steerling-8B der ernsthafteste und am besten dokumentierte Versuch, eine ingenieurtechnische Antwort auf ein Problem zu geben, das bisher fast ausschließlich von philosophischem Interesse schien. Es lohnt sich, das Projekt im Auge zu behalten.