Das MIT erfüllt das Versprechen der Röntgenbrille

Wer zwischen Ende der 70er und Anfang der 80er Jahre jung war, erinnert sich gut an jenes Gefühl, das beim Durchblättern der letzten Seiten von *L'Intrepido oder Lanciostory aufkam: Inmitten von Anzeigen für Kugelschreiber und Zeichenfernkurse prangte eine Reklame, die das Unmögliche versprach. Röntgenbrillen. Echte. Für ein paar Lire, inklusive Versand. Das Versprechen war glasklar: Setzen Sie sie auf und Sie werden durch alles hindurchsehen. Wände, Schachteln, Kleidung. Die Realität, wie jeder Junge, der der Versuchung erlag, bitterlich feststellen musste, war weitaus prosaischer: ein Stück Pappe mit einem kuriosen optischen Effekt, der auf Lichtbeugung basierte und höchstens in der Lage war, die eigene Hand transparent erscheinen zu lassen. Ein Betrug à la Totò, eine billige Illusion.*

Jener Traum ist jedoch nie wirklich verschwunden. Er ist lediglich in die Forschungslabore umgezogen, wo Ingenieure und Physiker jahrzehntelang nach konkreten Wegen gesucht haben, um das zu sehen, was menschliche Augen nicht erreichen können. Und am 19. März 2026 veröffentlichte das MIT die Ergebnisse einer Forschungsarbeit, die ohne Übertreibung den überzeugendsten Schritt hin zu jenem Schwindelversprechen der achtziger Jahre darstellt: ein System, das in der Lage ist, verborgene Objekte und ganze Umgebungen mithilfe reflektierter Funksignale zu rekonstruieren, gesteuert durch Modelle der generativen künstlichen Intelligenz. Diesmal keine Pappsichtgeräte. Zwei auf der IEEE CVPR-Konferenz akzeptierte Paper – einem der weltweit maßgeblichsten Foren auf dem Gebiet des Computersehens – und ein Labor, das seit über einem Jahrzehnt Ergebnisse anhäuft, die einst als unmöglich galten.

Das physikalische Problem, das alles zwanzig Jahre lang im Standby hielt

Um zu verstehen, warum diese Forschung relevant ist, muss man einen Schritt zurücktreten und sich einer Frage der ehrlichen Physik stellen. Millimeterwellen oder mmWave sind Funksignale mit sehr hoher Frequenz, dieselben, die in Wi-Fi-Netzwerken der neuesten Generation und in Automobilradaren verwendet werden. Sie haben eine sehr nützliche Eigenschaft: Sie durchdringen relativ leicht gängige Materialien wie Pappe, Kunststoff, Holz und Gipskarton. Dies macht sie theoretisch perfekt, um zu „sehen“, was sich auf der anderen Seite einer Wand befindet oder unter einem Stapel von Gegenständen verborgen ist.

Das Problem ist ein anderes und hat einen präzisen technischen Namen: Specularity, also spiegelnde Reflexion. Wenn eine Millimeterwelle auf eine Oberfläche trifft, neigt sie dazu, nur in eine Richtung abzuprallen, wie Licht auf einem Spiegel. Das bedeutet, dass der Sensor nur einen begrenzten Teil der Oberfläche des verborgenen Objekts erfassen kann: typischerweise den höchsten Teil, der das Signal direkt zum Empfänger zurückwirft. Die Unterseite, die Flanken, die geneigten Flächen: alles unsichtbar. Als würde man versuchen, die Form einer Skulptur zu rekonstruieren, indem man sie mit nur einem Finger berührt, immer aus demselben Winkel.

Die Forscher der Gruppe Signal Kinetics des MIT Media Lab hatten auf diesem Gebiet bereits bedeutende Ergebnisse erzielt. Im Sommer 2025 hatten sie mmNorm vorgestellt, ein System, das in der Lage ist, die Oberflächennormalen verborgener Objekte zu schätzen, und gewannen damit den Best Paper Runner-up und den Best Poster Award auf der ACM MobiSys. Aber das Problem der Specularity blieb eine gläserne Decke: Die Rekonstruktionen waren unvollständig, präzise dort, wo das Signal ankam, blind an anderen Stellen. Es bedurfte etwas qualitativ anderem für den nächsten Sprung.

Wave-Former: Wenn die KI lernt, sich vorzustellen, was sie nicht sieht

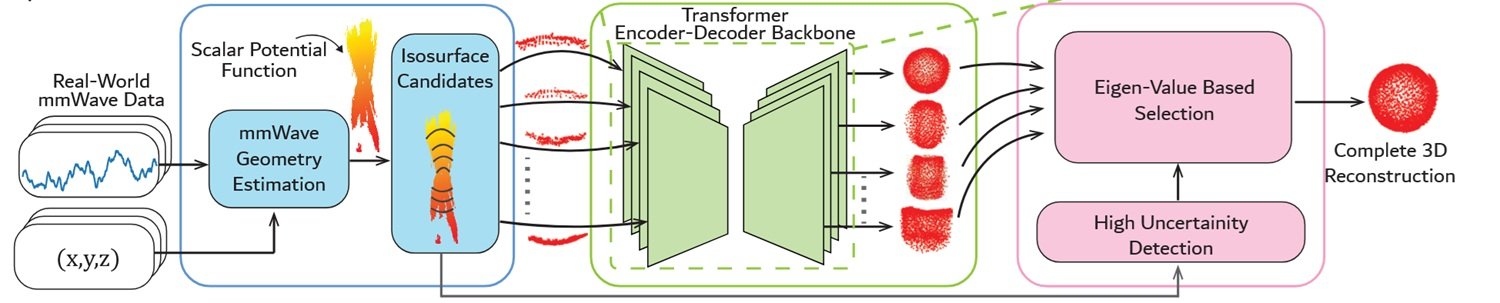

Die Lösung, die das Team gefunden hat, ist bei näherem Hinsehen elegant in ihrer Logik: Wenn der physikalische Sensor nicht genügend Daten sammeln kann, um die gesamte Form eines Objekts zu rekonstruieren, trainiert man ein Modell der generativen künstlichen Intelligenz darauf, die fehlenden Teile zu imaginieren. Keine willkürliche Erfindung, sondern eine physikgeleitete Inferenz: Das System weiß, wie sich Millimeterwellen verhalten, kennt die Eigenschaften der spiegelnden Reflexion und lernt, die plausible Form eines Objekts ausgehend von einer Teilrekonstruktion zu vervollständigen.

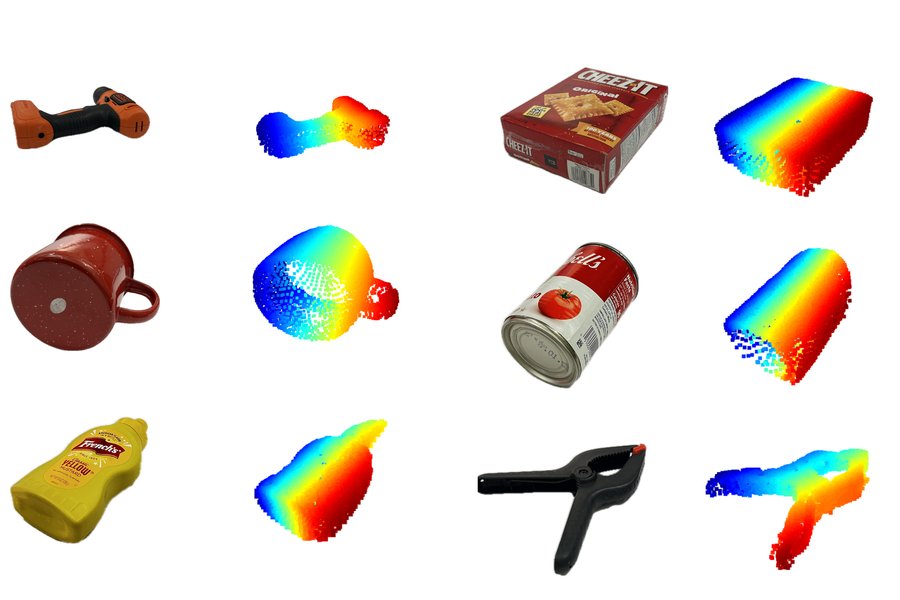

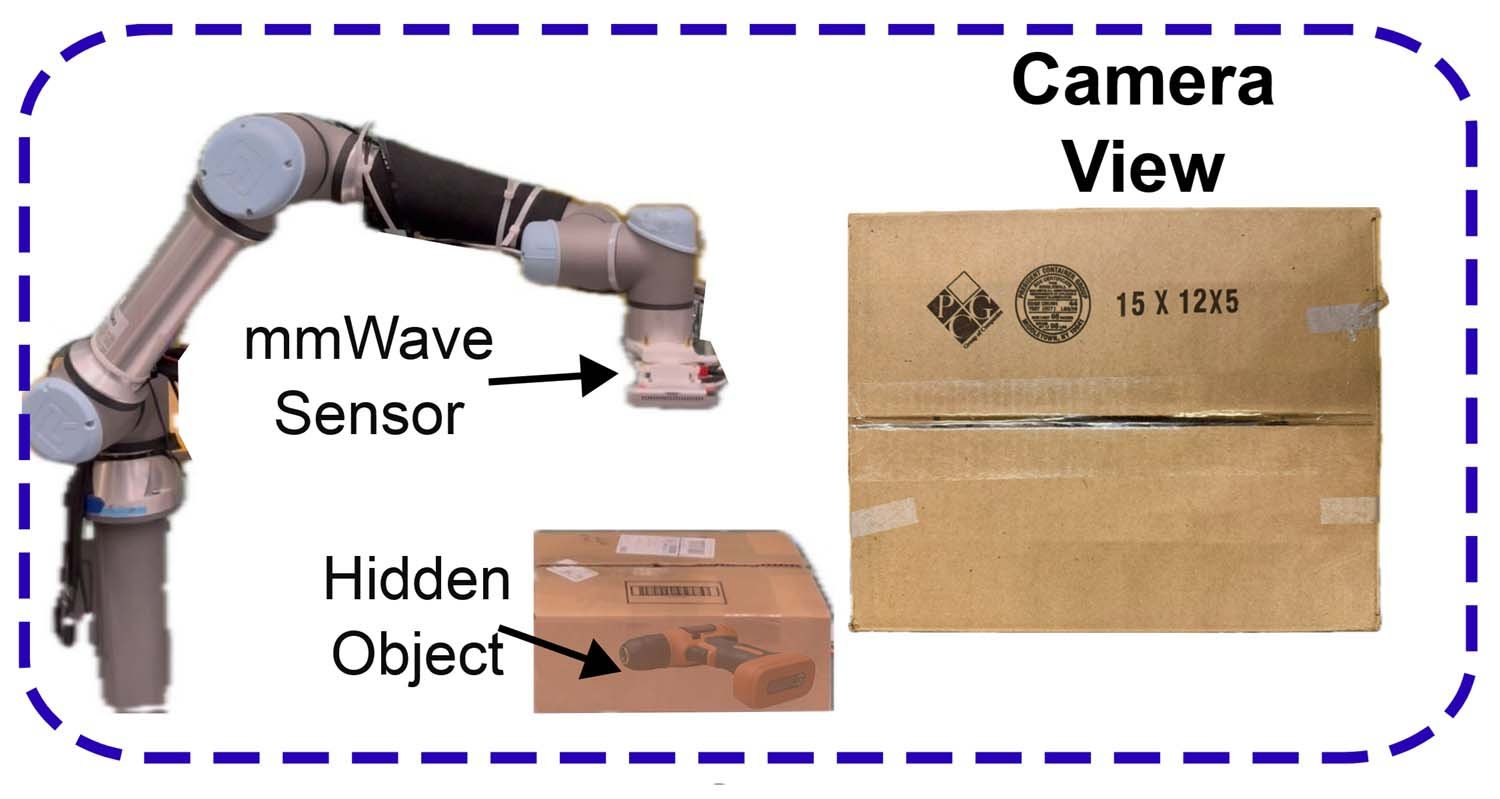

Das System heißt Wave-Former und arbeitet in drei Phasen. Zuerst erstellt es eine Teilrekonstruktion des verborgenen Objekts aus den reflektierten mmWave-Signalen. Dann übergibt es diese unvollständige Rekonstruktion an ein generatives Modell, das vorschlägt, wie die vollständige Form aussehen könnte. Schließlich verfeinert es iterativ die Oberflächen, bis eine kohärente endgültige Rekonstruktion vorliegt.

Der interessanteste Punkt aus technischer Sicht ist, wie das Team das Trainingsproblem gelöst hat. Generative KI-Modelle funktionieren gut, wenn ihnen große Mengen an Trainingsdaten zur Verfügung stehen. GPT, Claude, Llama: Alle basieren auf Datensätzen von astronomischem Ausmaß. Aber es gibt keinen ausreichend großen Datensatz von mmWave-Scans verborgener Objekte, und einen solchen von Grund auf neu zu erstellen, hätte, wie Maisy Lam, eine der beteiligten Forscherinnen, erklärt, buchstäblich Jahre der Datenerfassung erfordert. Das Team wählte daher eine indirekte Strategie: Es nahm die großen existierenden Computer-Vision-Datensätze mit Millionen von 3D-Bildern gängiger Objekte und transformierte sie, um die physikalischen Eigenschaften der mmWave-Reflexion zu simulieren, einschließlich der Specularity und des für diese Signale charakteristischen Rauschens. Ein synthetischer, aber physikalisch korrekter Datensatz, der mit einem Prozess erstellt wurde, der die Wellenphysik direkt in die Trainingsbilder einbezieht.

Die Ergebnisse sind solide. Wave-Former wurde an etwa 70 Alltagsgegenständen getestet – Dosen, Schachteln, Besteck, Früchte –, die hinter oder unter verschiedenen Materialien verborgen waren: Pappe, Holz, Gipskarton, Kunststoff, Stoff. Im Vergleich zu den bisherigen State-of-the-Art-Methoden erzielte das System eine Verbesserung von fast 20 % bei der Genauigkeit der Rekonstruktion, gemessen mit der Chamfer-Error-Metrik, die quantifiziert, wie stark die rekonstruierte Form von der realen abweicht.

RISE: Die Geister, die Räume zeichnen

Das zweite in den Papern vorgestellte System heißt RISE und treibt das Konzept noch weiter. Anstatt einzelne verborgene Objekte zu rekonstruieren, rekonstruiert RISE ganze Räume inklusive aller vorhandenen Möbel unter Verwendung eines einzigen fest installierten Radars und ohne dass sich ein Sensor in der Umgebung bewegt.

Der Mechanismus, den es nutzt, ist kontraintuitiv. Wenn sich eine Person in einem Raum bewegt, prallen die vom Radar ausgesandten mmWave-Wellen nicht nur an der Person ab: Einige von der menschlichen Gestalt reflektierte Wellen prallen anschließend an einer Wand oder einem Möbelstück ab und erreichen erst danach den Sensor. Diese Sekundärreflexionen, die als „Geister-Signale“ bezeichnet werden, weil sie als verschobene Kopien der ursprünglichen Quelle erscheinen, werden normalerweise ignoriert oder als Rauschen herausgefiltert. Sie enthalten jedoch wertvolle Informationen: Da sich ihre Position ändert, während sich die Person bewegt, und da ihr Weg von der Geometrie des Raumes abhängt, ist es durch die Analyse ihrer zeitlichen Veränderung möglich, darauf zu schließen, wo sich die Wände und Möbel befinden.

Das Problem ist, dass diese direkte Inferenz sehr grobe und ungenaue Rekonstruktionen liefert. Hier greift das generative Modell ein: Wie im Fall von Wave-Former nutzt das System die KI, um eine grobe Karte der Umgebung zu nehmen und sie zu verfeinern, bis eine glaubwürdige Darstellung des Raumes entsteht. RISE wurde an über 100 menschlichen Trajektorien validiert, die in realen Umgebungen mit einem einzigen statischen Radar aufgezeichnet wurden. Die Verbesserung gegenüber bisherigen Methoden ist noch deutlicher: Die Rekonstruktionen sind im Durchschnitt doppelt so präzise wie jene, die mit bereits existierenden Techniken erzielbar sind.

Das Labor des Unmöglichen und sein Gründer

Hinter diesen Ergebnissen steht die Signal Kinetics Group, die Fadel Adib am MIT Media Lab leitet. Adib ist ein libanesisch-amerikanischer Forscher, der sein Studium an der Amerikanischen Universität Beirut mit dem höchsten GPA in der digital erfassten Geschichte der Universität abschloss und anschließend seinen Master und Doktortitel am MIT erwarb. In seiner Doktorarbeit, für die er den ACM SIGMOBILE Dissertation Award erhielt, ging es bereits darum, mithilfe von Wi-Fi durch Wände zu sehen. Aus dieser Arbeit entstand Emerald Innovations, ein Startup, dessen Geräte heute zur Fernüberwachung des Gesundheitszustands von Tausenden von Patienten eingesetzt werden.

Adibs Lebenslauf ist jene Art von Liste, die aufgrund ihrer Dichte fast schon störend wirkt: Neben Forbes 30 Under 30, Technology Review's 35 Innovators Under 35, Sloan Research Fellowship, ACM SIGMOBILE Rockstar Award, ACM MobiCom Best Paper Award, ONR Young Investigator Award und NSF CAREER Award hatte er auch das eher seltene Privileg, seine Forschung Präsident Obama während des ersten White House Demo Day im Jahr 2015 vorzustellen. Die von ihm geleitete Gruppe hat im Laufe der Jahre Technologien hervorgebracht, die von batterieloser Unterwassernavigation über Augmented-Reality-Headsets mit Röntgenblick bis hin zur Erfassung von Herzschlägen durch Wände reichen.

Die beiden in dieser Woche vorgestellten Paper haben Laura Dodds als Haupt-Co-Autorin, MIT Presidential Fellow und Trägerin des Preises für die beste MEng-Thesis in EECS am MIT. Zur Arbeitsgruppe gehören auch Maisy Lam, NSF GRFP Fellow, Waleed Akbar, Yibo Cheng sowie der ehemalige Postdoc Kaichen Zhou, der nun Hauptautor des Papers über RISE ist. Die Finanzierung stammt von der NSF, dem MIT Media Lab und Amazon.

Vom Lager bis zum Operationssaal: Die konkreten Anwendungen

Der Sprung von den Laborrekonstruktionen zu Anwendungen in der realen Welt ist kürzer, als man denken könnte. Die Forscher selbst nennen zwei vorrangige Szenarien, und in beiden Fällen ist die Logik zwingend.

Im Kontext der Logistik und automatisierter Lager ist die Fähigkeit, den Inhalt eines geschlossenen Kartons zu überprüfen, ohne ihn zu öffnen, ein direkter und messbarer wirtschaftlicher Wert. Heute wird ein erheblicher Teil der Retouren im E-Commerce durch Verpackungsfehler verursacht: falsches Produkt, fehlendes Produkt, beschädigtes Produkt, das von außen nicht sichtbar ist. Ein Roboter, der mit einem System wie Wave-Former ausgestattet ist, könnte den Inhalt jedes Kartons vor dem Versand überprüfen und so diese Fehler drastisch reduzieren. Amazon, einer der Geldgeber der Forschung, hat offensichtlich ein Interesse in dieser Richtung.

Im häuslichen Kontext und in der Servicerobotik eröffnet RISE eine weitere Möglichkeit: einen Roboter, der „weiß“, wo sich die Möbel und wo sich die Person im Raum befinden, ohne dass Kameras benötigt werden. Der Vorteil für die Privatsphäre gegenüber kamerabasierten Systemen ist alles andere als trivial: mmWave-Signale erfassen keine visuellen Bilder von Personen, sondern nur ihre ungefähre Position und das Profil der Umgebung. Ein häusliches Assistenzsystem für ältere Menschen, das ohne Videoaufzeichnung funktioniert, ist ein kommerziell und ethisch weitaus akzeptableres Produkt als eines, das in jedem Zimmer Kameras installiert.

Im medizinischen Bereich sind die Aussichten noch ehrgeiziger, aber auch weiter von einer unmittelbaren Anwendung entfernt. Die Möglichkeit, Bilder durch undurchsichtige Oberflächen mit relativ kostengünstiger Hardware zu erhalten, könnte eines Tages bildgebende Verfahren wie den Ultraschall in Kontexten ergänzen oder unterstützen, in denen der Zugang zu hochentwickelten Maschinen begrenzt ist.

Die Kehrseite der Medaille: Überwachung, Privatsphäre und wer zurückbleibt

Bis hierhin die Geschichte des technischen Fortschritts in seiner optimistischen Version. Aber es wäre unehrlich, hier aufzuhören, denn eine Technologie, die in der Lage ist, Umgebungen und Objekte durch Wände hindurch zu rekonstruieren, bringt unbequeme Fragen mit sich, die sich nicht allein durch den guten Willen der Forscher lösen lassen.

Die Unterscheidung zwischen „die Position einer Person erfassen“ und „eine Person überwachen“ ist weitaus subtiler, als es scheint. Das RISE-System benötigt in seiner derzeitigen Form einen sich im Raum bewegenden Menschen, um als Umgebungskartierer zu fungieren. Aber die Tatsache, dass die Position der Person als „Sonde“ für die Umgebung verwendet wird, bedeutet nicht, dass diese Position nicht aufgezeichnet wird. Ein System, das weiß, wo Sie sich in Ihrem Haus befinden, auch ohne Kameras, ist bereits ein Überwachungssystem, sofern jemand Zugriff auf diese Daten hat.

Die Auseinandersetzung mit der DSGVO und dem europäischen AI Act ist unvermeidlich, und die Konturen sind noch nicht definiert. Die europäische Datenschutzgesetzgebung ist um das Konzept der „personenbezogenen Daten“ herum aufgebaut, das explizit Informationen über den Standort einer identifizierbaren Person einschließt. Ein Funksignal, das jemanden in seiner eigenen Wohnung lokalisiert, fällt mit hoher Wahrscheinlichkeit in diese Kategorie, was bedeutet, dass jedes kommerzielle Produkt, das auf diesen Prinzipien basiert, eine ausdrückliche und dokumentierte informierte Einwilligung einholen muss. Der 2024 verabschiedete AI Act führt weitere Beschränkungen für Systeme zur „biometrischen Fernidentifizierung“ ein, eine Kategorie, in die diese Systeme fallen könnten, wenn sie zur Identifizierung und Verfolgung von Personen im öffentlichen Raum verwendet werden.

Das konkreteste kurzfristige Risiko ist nicht die Regierung, die Bürger durch die Wände ihrer Häuser ausspioniert – ein Szenario eines dystopischen Regimes, das außergewöhnliche Ressourcen und Motivationen erfordert. Das unmittelbarere Risiko ist die unbefugte Nutzung in kleinerem Maßstab: ein Hausbesitzer, der einen Sensor installiert, um Mieter zu überwachen, ein Arbeitgeber, der die Bewegungen der Mitarbeiter in den Büros verfolgt, ein gewalttätiger Partner, der jederzeit wissen will, wo sich die andere Person befindet. Die Geschichte der Überwachungstechnologie lehrt, dass die gefährlichsten Anwendungen nie die sind, die sich die Forscher in der Entwicklungsphase vorgestellt haben.

Zudem gibt es eine Frage der Verteilung technologischer Macht, die Aufmerksamkeit verdient. Fortgeschrittene Sensortechnologien neigen dazu, sich zuerst bei denjenigen zu verbreiten, die bereits über Ressourcen verfügen: Strafverfolgungsbehörden, Großunternehmen, Staaten mit hoher technologischer Kapazität. Wenn die Regulierung nicht mit der Verbreitung Schritt hält, entsteht eine Phase potenziell sehr problematischer Informationsasymmetrie, in der einige Akteure „sehen“ können, ohne selbst gesehen zu werden. Die Kluft zwischen Ländern mit starker Regulierungskapazität, wie der Europäischen Union, und Ländern, in denen diese Schutzmaßnahmen fehlen, droht sich in einer konkreten Disparität bei den Schutzmaßnahmen niederzuschlagen, die die Bürger erwarten können.

Auf dem Weg zum „Foundation Model“ des Wireless

Die MIT-Forscher bleiben nicht bei den aktuellen Ergebnissen stehen. Adib hat explizit erklärt, dass das langfristige Ziel darin besteht, Foundation Models für Wireless-Signale zu bauen – also das, was GPT, Claude und Gemini für Sprache und Bilder darstellen. Ein Modell, das auf einer enormen Vielfalt von Funksignalen trainiert wurde und in der Lage ist, Reflexionen von Umgebungen, Objekten und menschlichen Körpern mit einer Allgemeingültigkeit und Flexibilität zu verstehen und zu interpretieren, die aktuelle Systeme nicht haben.

Diese Aussicht ist zugleich faszinierend und schwindelerregend. Foundation Models für die Sprache haben emergente Fähigkeiten gezeigt – Verhaltensweisen, die nicht explizit programmiert waren, sondern aus dem Umfang und der Vielfalt des Trainings hervorgegangen sind. Ein analoges Modell für die Wireless-Domäne könnte Wahrnehmungsfähigkeiten für die Umgebung entwickeln, die wir uns heute noch gar nicht vorstellen können. Es könnte sich zudem, wie Sprachmodelle, als schwierig zu interpretieren, zu kontrollieren und auf spezifische Nutzungen zu beschränken erweisen.

Der Wettbewerbskontext, in dem sich diese Forschung bewegt, ist lebhaft. Es gibt alternative Ansätze, die auf Wi-Fi CSI (Channel State Information) basieren und Variationen in den Wi-Fi-Kanaleigenschaften nutzen, um auf die Anwesenheit und Bewegung von Personen zu schließen, sowie militärische Through-Wall-Radare – wesentlich teurere und invasivere Systeme, die von Spezialeinheiten in Einsatzkontexten verwendet werden. Die Forschung der Adib-Gruppe zeichnet sich durch den Fokus auf relativ kostengünstige Hardware, bereits in der Umgebung vorhandene Signale und immer ausgefeiltere Verarbeitungstechniken aus. Das von Adib mitbegründete Startup Cartesian Systems scheint darauf ausgerichtet zu sein, diese Technologien in Richtung kommerzieller Anwendungen zu führen, auch wenn spezifische Details zum Produkt noch nicht öffentlich sind.

Röntgenbrille, endlich

Es hat etwas Zirkuläres und vage Rührendes, dass die Technologie fünfzig Jahre gebraucht hat, um ein Versprechen einzulösen, das auf Hochglanzpapier einem Jungen mit 7.200 Lire in der Tasche gegeben wurde. Die Brillen aus L'Intrepido waren ein Betrug, aber sie waren auch ein Symptom: Die erweiterte Wahrnehmung, das Sehen über das Sichtbare hinaus, ist ein in der menschlichen Vorstellungskraft so tief verwurzelter Wunsch, dass er jeder Desillusionierung widersteht.

Wave-Former und RISE sind keine kommerziellen Produkte, sie sind nicht marktreif und nicht frei von technischen Grenzen und ungelösten ethischen Implikationen. Sie sind jedoch etwas Solideres als ein Versprechen: Sie sind replizierbare, messbare Ergebnisse, die vor der internationalen wissenschaftlichen Gemeinschaft präsentiert wurden. Der durch generative künstliche Intelligenz eingeführte qualitative Sprung, die Fähigkeit zu vervollständigen, was die Physik allein nicht sehen kann, ist echt.

Die Frage, die offen bleibt, ist keine technische. Es ist die Frage, die jede Wahrnehmungstechnologie begleitet, seit es Überwachung gibt: Wer hat das Recht zu sehen, was, und mit welcher Autorisierung? Das MIT hat ein außergewöhnliches Werkzeug gebaut. Es liegt an Gesetzgebern, Unternehmen und Bürgern zu entscheiden, in welcher Welt es eingesetzt werden soll. Denn diesmal funktioniert es, im Gegensatz zu den Pappsichtgeräten, wirklich.