Kimi K2.5 et la longue marche de la Chine dans l'IA : quand l'embargo devient un tremplin

Il y a un moment, dans chaque partie d'échecs de haut niveau, où l'on comprend que le joueur sous pression n'essaie pas de se défendre : il construit une contre-attaque. Quelque chose de similaire se produit dans le grand jeu géopolitique de l'intelligence artificielle, et la sortie de Kimi K2.5 par Moonshot AI n'est pas un énième communiqué de presse à feuilleter distraitement. C'est un autre chapitre d'une histoire qui mérite d'être suivie avec attention, comme dans l'analyse précédente sur Qwen3-TTS et la génération de voix de synthèse, car elle raconte et confirme comment les restrictions matérielles imposées par les États-Unis à la Chine produisent exactement l'effet inverse de celui escompté : au lieu de ralentir l'innovation chinoise, elles l'accélèrent sur des trajectoires imprévues.

Nous en avions déjà parlé en analysant DeepSeek et son architecture MHC, et avant cela avec Kimi K2 Thinking. Aujourd'hui, nous revenons sur le sujet non pas pour suivre le battage médiatique du dernier modèle sorti, mais parce que chaque sortie ajoute une pièce à une mosaïque qui redessine les équilibres mondiaux de l'IA. Et Kimi K2.5, avec ses mille milliards de paramètres organisés dans une architecture de Mélange d'Experts (MoE) profondément optimisée, représente un saut qualitatif qui mérite plus qu'un défilement distrait sur Hacker News.

Une énième sortie qui compte

Commençons par les chiffres, car dans l'IA, les chiffres racontent des histoires. Kimi K2.5 est un monstre d'un billion de paramètres au total, mais grâce à l'architecture MoE, il n'en active que trente-deux milliards pour chaque jeton généré. C'est comme avoir une immense bibliothèque où, au lieu de feuilleter tous les volumes à chaque fois, vous sélectionnez automatiquement les huit étagères les plus pertinentes parmi les trois cent quatre-vingts disponibles, plus une étagère partagée toujours consultée. Cette approche, techniquement définie comme "sparsity", n'est pas nouvelle, mais Moonshot l'a portée à un niveau de raffinement impressionnant.

L'architecture repose sur soixante et une couches, dont une dense, avec un mécanisme d'attention appelé MLA (Multi-Head Latent Attention) qui réduit considérablement les besoins en mémoire pendant l'inférence. La dimension cachée de l'attention est de 7168, tandis que chaque expert MoE travaille avec 2048 dimensions cachées. Le vocabulaire compte 160 000 jetons et le contexte s'étend jusqu'à 256 000 jetons, une fenêtre qui permet de traiter des documents très longs ou des conversations complexes sans perdre le fil.

Mais le vrai bond par rapport à K2 est ailleurs. Moonshot a intégré nativement des capacités multimodales via MoonViT, un encodeur de vision de 400 millions de paramètres qui permet au modèle de "voir" des images et des vidéos non pas comme des modules complémentaires greffés avec difficulté, mais comme une partie organique de sa compréhension du monde. Il a été entraîné sur environ quinze billions de jetons mixtes, visuels et textuels, grâce à un pré-entraînement continu sur la base de Kimi-K2-Base. Résultat : K2.5 ne se contente pas de lire du code, il le génère en regardant des maquettes d'interfaces utilisateur ou en analysant des flux de travail à partir de vidéos.

Salvatore Sanfilippo, l'un des développeurs les plus respectés de la communauté technologique internationale et créateur de Redis, a analysé K2.5 en soulignant précisément cet aspect : "C'est un modèle nativement multimodal, entraîné spécifiquement pour résoudre des problèmes de programmation liés à l'interface utilisateur en agissant comme un agent qui 'voit' la mise en page". Nous ne parlons pas d'une astuce de démonstration, mais d'une capacité de conception qui change la façon dont on peut interagir avec l'IA dans le travail quotidien.

Et il y a un autre élément que Sanfilippo met en évidence comme crucial : la quantification native à quatre bits. K2.5 a été entraîné dès le départ avec des techniques de formation consciente de la quantification (Quantization-Aware Training) qui permettent de le faire tourner avec environ 600-700 Go de RAM. Cela signifie qu'un cluster de Mac Studios ou de serveurs grand public avec des GPU relativement accessibles peut faire tourner un modèle de pointe grâce à l'inférence distribuée. Pas besoin d'un centre de données de méga-corporation. C'est de la démocratisation technologique concrète, pas de la rhétorique.

MoE, Vision et Essaim d'Agents

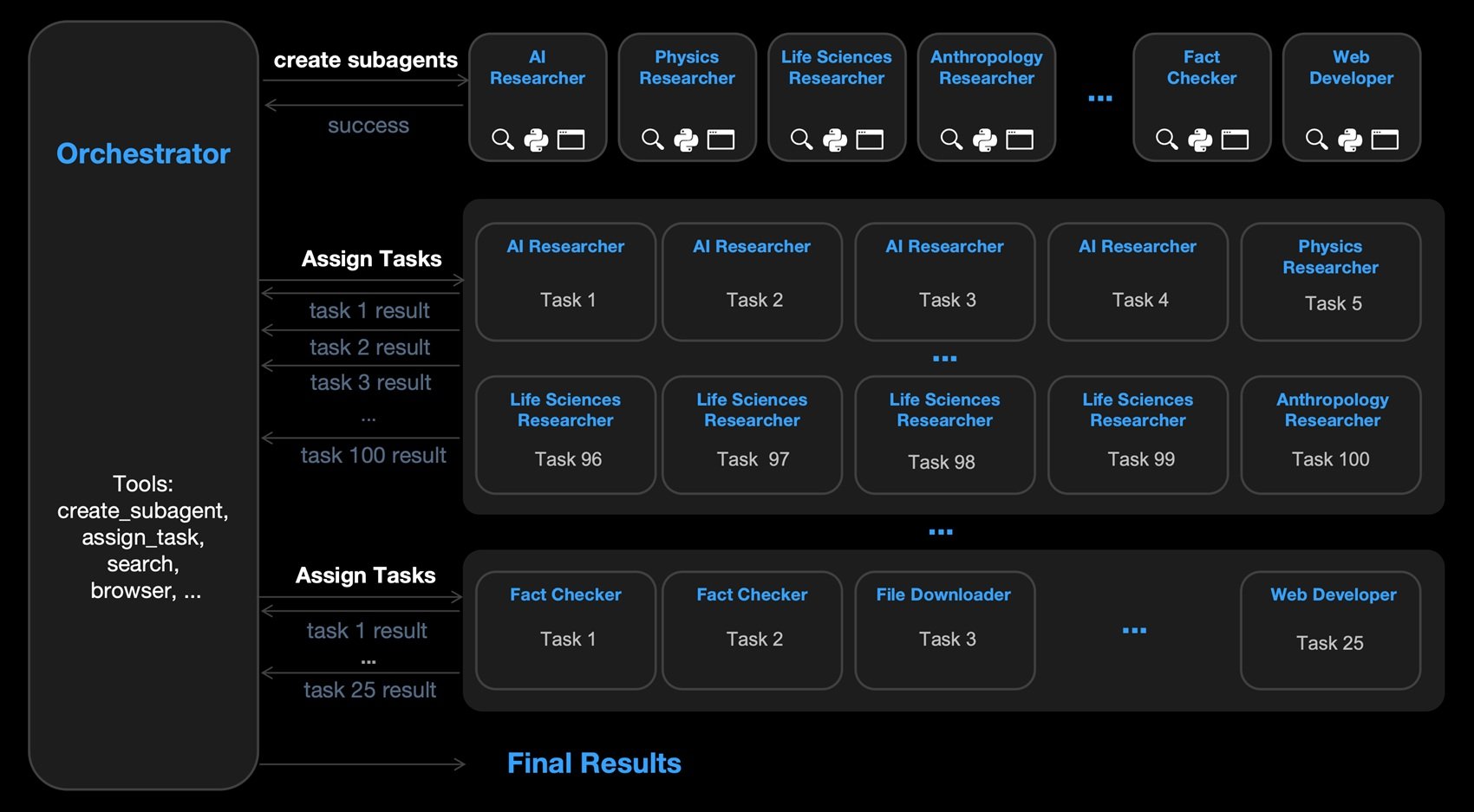

Mais la vraie nouveauté de K2.5 réside dans une fonctionnalité qui semble relever de la science-fiction mais qui est déjà opérationnelle : l'essaim d'agents (agent swarm). Au lieu de faire travailler un seul agent IA sur des tâches complexes, K2.5 peut instancier dynamiquement des essaims de sous-agents spécialisés qui collaborent en parallèle. C'est comme passer d'un artisan solitaire à un atelier de la Renaissance où chaque maître se concentre sur sa partie du travail.

Le mécanisme est basé sur une technique appelée Apprentissage par Renforcement d'Agents en Parallèle (PARL) : le modèle décompose de manière autonome une tâche complexe en sous-objectifs, génère des agents spécialisés pour chacun et coordonne leur exécution. Dans des benchmarks comme BrowseComp et WideSearch, K2.5 en mode essaim surpasse nettement non seulement sa version à agent unique, mais aussi des concurrents comme GPT-5.2 et Claude 4.5 Opus. Sur BrowseComp avec l'essaim actif, il atteint 78,4 % contre 60,6 % en mode standard. Sur WideSearch, il passe de 72,7 % à 79 %.

La configuration prévoit un agent principal qui peut exécuter jusqu'à quinze étapes, tandis que chaque sous-agent peut aller jusqu'à cent étapes. C'est une orchestration computationnelle qui rappelle plus un chef d'orchestre qu'un soliste, et les résultats parlent d'eux-mêmes : sur des tâches nécessitant une recherche web approfondie, une navigation multi-pages ou l'analyse d'ensembles de données complexes, l'approche en essaim débloque des niveaux de performance auparavant inaccessibles.

Ce changement de paradigme, passant de la mise à l'échelle d'un agent unique à une exécution de type essaim, représente peut-être la contribution la plus originale de Moonshot. Alors qu'OpenAI et Anthropic continuent de développer des modèles de plus en plus grands et coûteux, les Chinois explorent des modes de coordination distribuée qui pourraient rendre l'approche monolithique obsolète. C'est la différence entre construire des gratte-ciel toujours plus hauts et concevoir des villes horizontales efficaces.

Benchmarks : performances sur le terrain

Venons-en aux chiffres qui comptent vraiment : comment K2.5 se comporte-t-il face à de vrais problèmes ? Les benchmarks publiés par Moonshot couvrent un spectre impressionnant : raisonnement mathématique, codage, vision multimodale, contextes longs, recherche agentique. Et ici, il faut faire une prémisse inconfortable mais nécessaire.

Comme le souligne encore Sanfilippo, "les benchmarks, ils se les font eux-mêmes" et il faudrait "une entité aseptisée et détachée qui puisse examiner les résultats de manière indépendante". Les producteurs américains sont "complètement autoréférentiels", ils ont tendance à ne comparer les nouveaux modèles qu'à leurs propres versions précédentes en ignorant les concurrents. Les Chinois, au contraire, incluent encore les données des modèles américains dans les tests "pour prouver qu'ils peuvent rivaliser avec eux à l'échelle mondiale". Moonshot ne fait pas exception : il publie des comparaisons directes avec GPT-5.2, Claude 4.5 Opus, Gemini 3 Pro, DeepSeek V3.2.

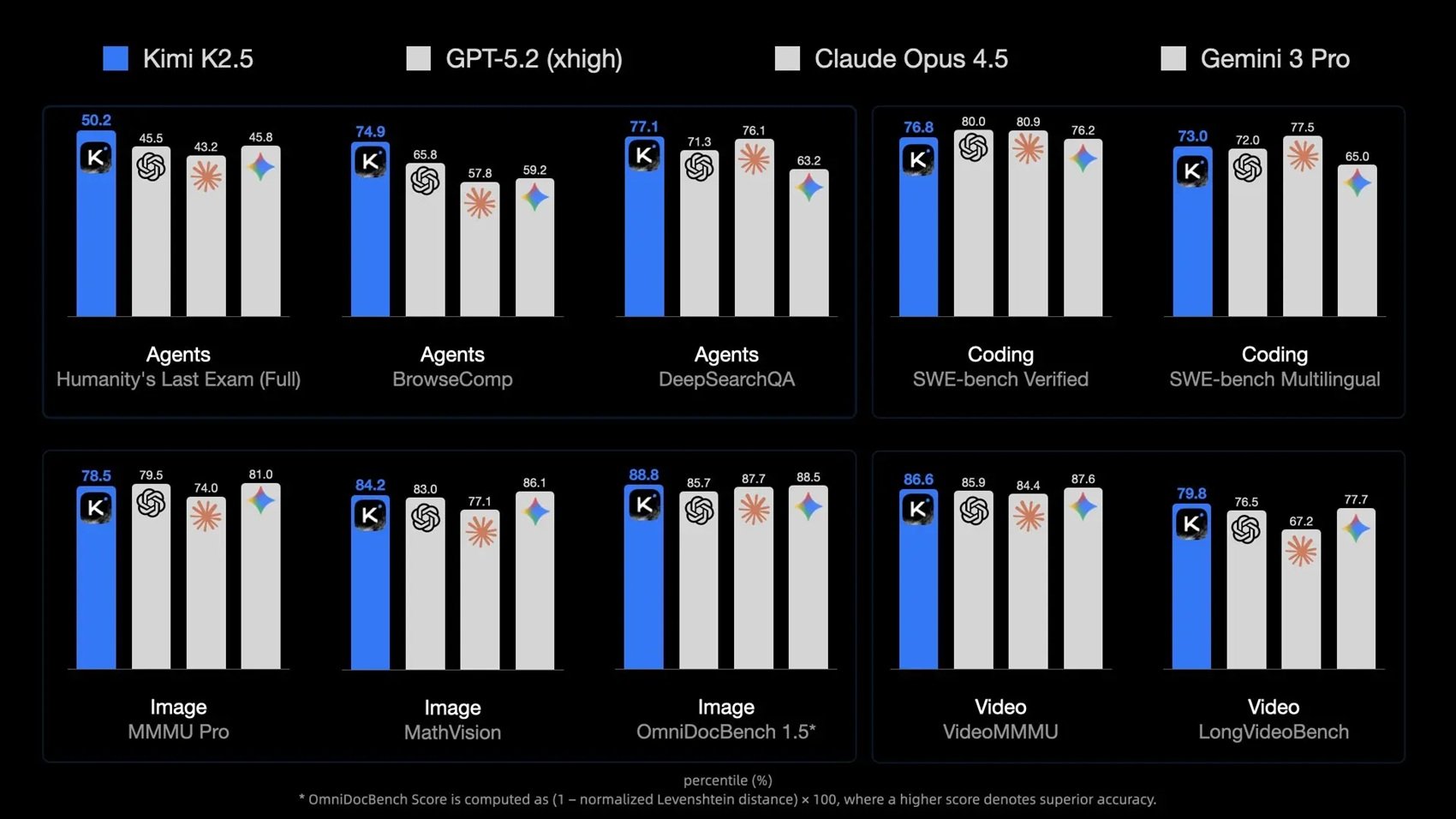

Commençons par le raisonnement. Sur HLE-Full (Humanity's Last Exam), l'un des benchmarks les plus difficiles qui mesure les capacités avancées de résolution de problèmes, K2.5 obtient 30,1 % sans outils et 50,2 % avec outils activés. GPT-5.2 atteint 34,5 % et 45,5 %, Claude 4.5 Opus 30,8 % et 43,2 %. Lorsqu'on ajoute la capacité d'utiliser des outils externes, K2.5 les surpasse tous les deux. Sur AIME 2025, les olympiades de mathématiques américaines, K2.5 obtient 96,1 % en moyenne sur trente-deux exécutions, contre 100 % pour GPT-5.2 mais au-dessus des 92,8 % de Claude.

Sur le front du codage, les résultats sont encore plus intéressants. SWE-Bench Verified, qui teste la capacité à résoudre de vrais bugs de dépôts GitHub, voit K2.5 à 76,8 %, GPT-5.2 à 80 %, Claude à 80,9 %. Un écart minime. Mais sur SWE-Bench Multilingual, K2.5 monte à 73 % contre 72 % pour GPT et 77,5 % pour Claude. Et sur Terminal Bench 2.0, qui mesure l'utilisation autonome du shell, K2.5 atteint 50,8 %, battu par GPT-5.2 (54 %) mais dépassant nettement DeepSeek V3.2 (46,4 %).

La partie visuelle est celle où K2.5 brille vraiment. Sur MMMU-Pro, un benchmark multimodal universitaire, il obtient 78,5 % contre 79,5 % pour GPT et 74 % pour Claude. Sur MathVision, qui demande de résoudre des problèmes de mathématiques à partir d'images, K2.5 atteint 84,2 %, battant GPT (83 %) et Claude (77,1 %). Sur WorldVQA, un benchmark créé par Moonshot lui-même pour tester la connaissance visuelle du monde réel, K2.5 obtient 46,3 % contre un maigre 28 % pour GPT-5.2. Et sur la compréhension vidéo, VideoMMMU voit K2.5 à 86,6 %, VideoMME à 87,4 %, LongVideoBench à 79,8 %.

Sanfilippo, tout en reconnaissant le risque de fuite de données (des ensembles de données qui se retrouvent dans l'entraînement), estime que "les benchmarks de Kimi sont historiquement fiables" et suggère la solution la plus pragmatique : "Le télécharger et le soumettre à dix problèmes inventés sur le moment. Ce n'est qu'en vérifiant personnellement si le modèle résout des problèmes inédits qu'il est possible de comprendre s'il est aussi fort qu'ils le disent". La nature "open-weights" de K2.5 rend cette vérification empirique possible, contrairement aux modèles américains fermés.

Open source contre fermé : une partie géopolitique

Et nous voici au point crucial, celui qui transforme cette sortie de nouvelle technologique en fait géopolitique. Moonshot a publié les poids complets de K2.5 sur Hugging Face avec une licence MIT modifiée, extrêmement permissive. Vous pouvez télécharger le modèle, le modifier, l'utiliser commercialement. La seule contrainte : si vous dépassez vingt millions de dollars de revenus par mois ou cent millions d'utilisateurs actifs, vous devez citer explicitement Moonshot AI. C'est tout.

Comparez cela avec la stratégie américaine. OpenAI a fermé GPT-4, GPT-5 est encore plus verrouillé. Anthropic ne publie que les API de Claude, aucun accès aux poids. Google garde Gemini sous clé. L'approche est ce que certains appellent "l'ouverture stratifiée" : on publie des versions mineures en open source (Llama de Meta, Gemma de Google) mais on garde les modèles de pointe strictement propriétaires. L'objectif est de contrôler l'écosystème, de maintenir l'avantage concurrentiel, de monétiser via des API à forte marge.

La Chine joue une partie différente. DeepSeek a publié les poids de V3, Qwen fait de même, Moonshot avec K2.5 confirme la tendance. Sanfilippo est explicite : "Les modèles chinois sont actuellement la seule garantie pour une future démocratisation de l'intelligence artificielle. Alors que les sociétés américaines ont tendance à fermer leurs modèles les plus forts pour dominer le marché, les Chinois continuent de les publier".

La question est : pourquoi ? Ce n'est pas de la philanthropie. C'est de la stratégie. Publier des modèles "open-weights" crée une dépendance technologique inverse : les développeurs en Afrique, en Amérique du Sud, en Europe de l'Est commencent à construire sur une infrastructure chinoise. Dans trois ans, lorsque ce développeur sera le DSI d'une startup en pleine croissance, sur quelle pile technologique pensez-vous qu'il s'appuiera ? Et lorsque les gouvernements européens, latino-américains, asiatiques devront choisir des infrastructures d'IA nationales, penseront-ils vraiment que se fier entièrement à des API américaines fermées est une bonne idée stratégique ?

Sanfilippo touche ce point sensible : "La possession des poids de Kimi 2.5 est une protection contre d'éventuelles décisions politiques arbitraires, comme un blocage de l'accès à l'IA américaine par les États-Unis. Les dirigeants européens devraient prêter une grande attention à ces développements en tant que défi stratégique". Ce n'est pas de la paranoïa : nous avons vu ce qui s'est passé avec Huawei, avec TikTok, avec les chaînes d'approvisionnement des semi-conducteurs. Pourquoi l'IA serait-elle différente ?

Il y a ensuite une question plus subtile. Sanfilippo défend le concept d'"open-weights" contre les puristes de l'open source : "Avoir les poids et le code d'inférence est suffisant pour la liberté de l'utilisateur, cela permet de continuer l'entraînement ou de créer des systèmes d'inférence indépendants". Il n'est pas nécessaire d'avoir des ensembles de données complets et des pipelines d'entraînement (que personne ne publie jamais vraiment, même pas Meta avec Llama). Il faut pouvoir exécuter, modifier, étendre le modèle. Et c'est ce que permet pleinement K2.5.

La communauté réagit. L'AMA Reddit de l'équipe Kimi a vu des centaines de questions sur le réglage fin, le déploiement local, les optimisations matérielles. Together.ai a déjà intégré K2.5 dans sa plateforme. Des développeurs testent différentes quantifications, créent des adaptateurs pour des frameworks spécifiques, publient des benchmarks indépendants. C'est un écosystème qui s'auto-alimente, exactement comme ce qui s'est passé avec Linux contre Windows dans les années 90.

Matériel refusé, logiciel amélioré

Et nous arrivons ici au paradoxe le plus délicieux de cette histoire. Les restrictions américaines à l'exportation sur les puces avancées devaient paralyser l'IA chinoise. Au lieu de cela, elles l'ont rendue plus résiliente et innovante. C'est comme refuser du carburant de qualité supérieure à une écurie de Formule 1 : ils n'arrêtent pas de courir, ils conçoivent des moteurs plus efficaces.

Depuis 2022, les États-Unis ont progressivement bloqué l'exportation vers la Chine de GPU NVIDIA haut de gamme : d'abord les A100, puis les H100, et récemment même les H200. Les entreprises chinoises ne peuvent accéder qu'à des versions "dégradées" comme les H800 et H20, avec une bande passante mémoire et une interconnexion réduites, ou doivent se fier au matériel national Huawei Ascend encore immature.

La réponse ? Des architectures logicielles qui extraient jusqu'à la dernière goutte de performance de matériel inférieur. DeepSeek a démontré qu'on peut entraîner un modèle compétitif en utilisant principalement des H800. Moonshot avec K2.5 pousse cette philosophie plus loin : un MoE extrêmement optimisé qui n'active que 3,2 % des paramètres totaux pour chaque jeton, une quantification native INT4 qui réduit les besoins en mémoire par quatre, et des techniques de pré-remplissage et de décodage qui, selon la documentation officielle, atteignent une accélération de 4,5x par rapport à des implémentations naïves.

Sanfilippo cadre parfaitement la question : l'architecture MoE de K2.5 est "profondément clairsemée" précisément parce que "pour chaque jeton émis, seuls 32 milliards sont activés, impliquant 8 experts sur un total de 380". Cela signifie un entraînement plus efficace sur des clusters H800/H20 moins puissants, et une inférence accessible même à ceux qui n'ont pas de centres de données de la NASA.

Il y a ensuite un aspect qui mérite attention : Sanfilippo mentionne "l'hypothèse que DeepSeek soit actuellement engagé dans un plan gouvernemental chinois massif pour l'entraînement sur des GPU Huawei", un possible "Projet Manhattan de l'IA" qui expliquerait le ralentissement de leurs publications. Si cela se confirmait, cela signifierait que la Chine vise l'indépendance matérielle complète d'ici quelques années. Et quand cela arrivera, les restrictions américaines à l'exportation deviendront sans objet.

La comparaison historique qui vient à l'esprit est celle avec l'industrie automobile japonaise dans les années 70. Lorsque l'embargo pétrolier a frappé, Toyota et Honda n'ont pas baissé les bras : ils ont conçu des moteurs plus efficaces et ont conquis le marché mondial. Moonshot, DeepSeek, Alibaba font de même avec l'IA. L'embargo sur les puces est en train de créer les Toyota et les Honda de l'intelligence artificielle.

Économies parallèles et marchés émergents

Passons à l'argent, car au final, c'est toujours une question d'argent. Moonshot AI est évaluée à 3,6 milliards de dollars selon les dernières estimations, avec le soutien d'Alibaba et d'autres investisseurs chinois. Cela semble beaucoup, jusqu'à ce qu'on le compare à OpenAI (évaluée à plus de 150 milliards), Anthropic (environ 30 milliards), ou Google et Microsoft qui ont des capitalisations de l'ordre de deux mille milliards.

Sanfilippo note la "forte divergence entre la forme (évaluation financière) et le fond (capacité technique)". Moonshot produit un modèle qui rivalise avec GPT-5 et Claude 4.5, mais vaut un dixième d'Anthropic et un quarantième d'OpenAI. Pourquoi ? Des marchés financiers différents, des écosystèmes de capital-risque différents, mais aussi une monétisation moins agressive.

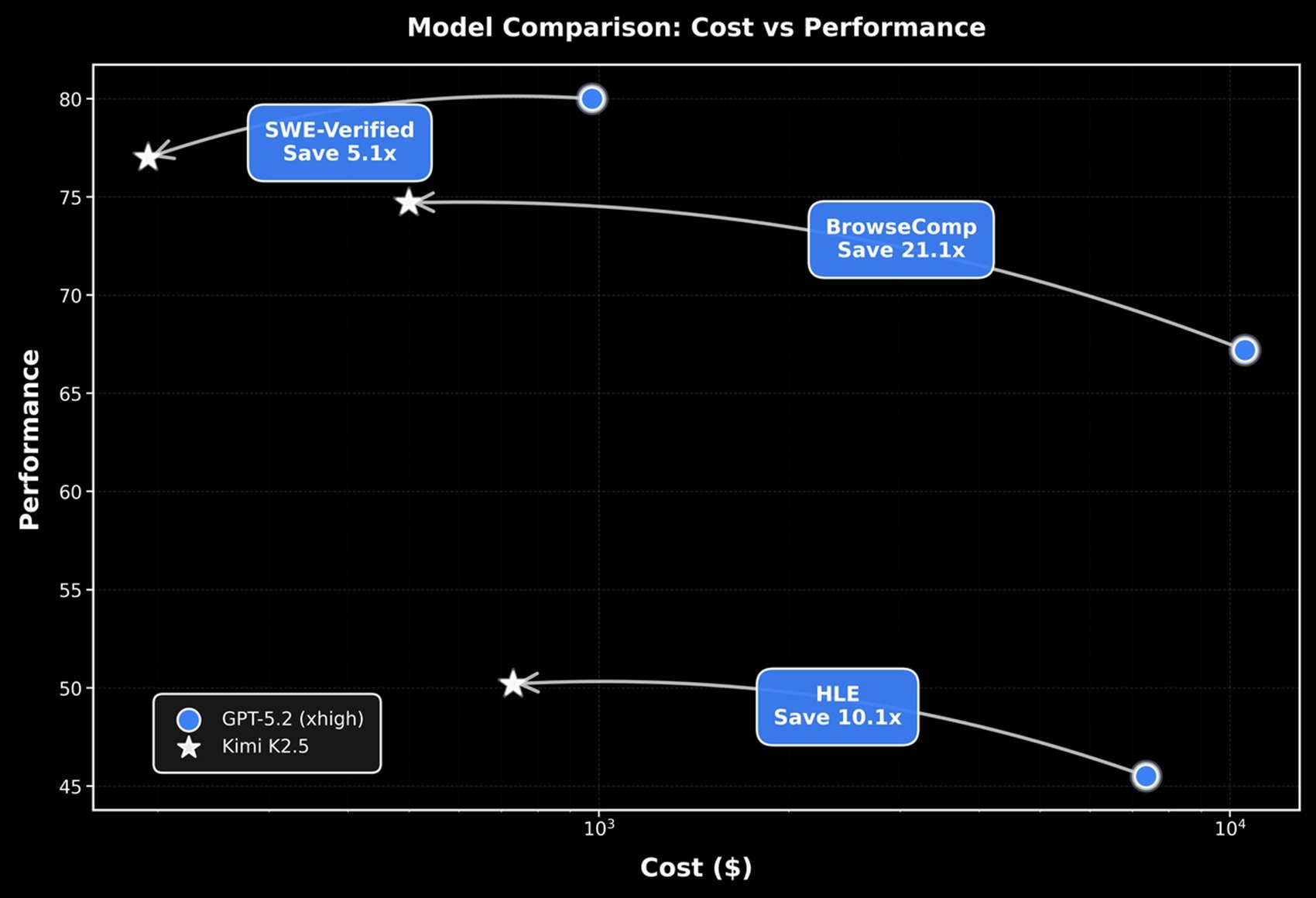

Regardez les prix des API. K2.5 coûte, selon des sources tierces, 0,60 $ par million de jetons en entrée, 2,50 $ en sortie. GPT-5.2 en mode "thinking" se situe à 1,75 $ en entrée et 14 $ en sortie par million de jetons. Claude Opus 4.5 est à 5 $ en entrée et 25 $ en sortie. K2.5 est donc trois fois moins cher que GPT-5.2 et environ huit fois moins cher que Claude Opus 4.5 en entrée, avec des différences encore plus marquées en sortie.

Pour une startup au Vietnam, au Nigeria, en Argentine qui veut intégrer l'IA dans ses produits, le choix est évident. K2.5 ne coûte pas seulement moins cher, mais étant "open-weights", vous pouvez aussi l'héberger localement si vous avez le matériel, éliminant complètement les coûts d'API et la dépendance vis-à-vis des fournisseurs externes. Cela crée des économies parallèles dans l'IA, des écosystèmes qui se développent en dehors du circuit centré sur la Silicon Valley.

L'impact sur les marchés émergents est déjà visible. Des entreprises indiennes construisent des chatbots de service client sur Qwen et DeepSeek. Des startups africaines utilisent K2 pour des applications éducatives locales. En Amérique du Sud, des développeurs affinent des modèles chinois pour des tâches spécifiques en portugais et en espagnol. Ce ne sont pas des marchés glamour qui finissent sur TechCrunch, mais ce sont des volumes qui croissent de manière exponentielle.

Et il y a un effet de réseau pervers (du point de vue américain) : plus les développeurs apprennent à travailler avec des modèles chinois, plus des outils, des frameworks, des intégrations naissent autour de ces modèles, plus il devient coûteux de passer à des alternatives américaines. C'est le "lock-in" à l'envers. Microsoft et Google ont bâti des empires sur ce principe. Ils se trouvent maintenant du mauvais côté de la barricade.

Les chiffres parlent d'eux-mêmes : selon les données d'Andreessen Horowitz et d'OpenRouter, les modèles open source chinois sont passés de 1,2 % de l'utilisation mondiale fin 2024 à près de 30 % en décembre 2025. Le Nikkei rapporte qu'en novembre 2025, les modèles d'IA chinois représentaient environ 15 % de la part de marché mondiale, une croissance verticale par rapport au 1 % de l'année précédente. Une étude de la RAND Corporation souligne qu'en août 2025, les fournisseurs chinois avaient capturé plus de 10 % des utilisateurs dans trente pays et plus de 20 % dans onze pays, principalement en Asie, en Afrique et en Amérique du Sud. Qwen d'Alibaba a dépassé les sept cents millions de téléchargements sur Hugging Face, devenant le système d'IA open source le plus utilisé au monde. Pas assez pour détrôner OpenAI ou Google sur les marchés occidentaux, mais suffisant pour rendre impossible tout monopole mondial.

Questions ouvertes sur l'avenir

Terminons par les questions, car dans l'IA de 2026, les certitudes sont une denrée rare et les questions sont plus utiles que les réponses toutes faites. Première question : l'alignement. Les modèles chinois "open-weights" suivent des directives de sécurité différentes de celles des modèles américains, reflétant inévitablement les valeurs culturelles et politiques du contexte dans lequel ils naissent. Lorsque K2.5 est affiné par une startup nigériane ou argentine, qui garantit que les alignements d'origine persistent ? Qui décide quels garde-fous sont nécessaires et lesquels relèvent de la censure ?

Deuxième question : la feuille de route. Moonshot parle déjà de K3, DeepSeek travaille sur V4, Alibaba continue d'itérer sur Qwen. La vitesse de sortie est impressionnante, mais est-elle durable ? L'entraînement de ces modèles nécessite une énergie monstrueuse et des centres de données énormes. La Chine dispose d'une énergie bon marché (charbon, nucléaire, énergies renouvelables en expansion), de centres de données en construction rapide et d'un vivier de docteurs en informatique plus grand que l'Europe et les États-Unis réunis. Mais peut-elle maintenir ce rythme tout en faisant face à un ralentissement économique et à des tensions géopolitiques croissantes ?

Troisième question : la réglementation. L'Europe a adopté la loi sur l'IA, qui classe les modèles dépassant certains seuils de paramètres et de capacités comme étant à "haut risque", exigeant une conformité stricte. K2.5 dépasse largement ces seuils. Moonshot devra-t-il certifier le modèle pour le marché européen ? Et si c'est le cas, cela signifie-t-il que les modèles "open-weights" auront des versions différentes pour des juridictions différentes, sapant le concept même d'"open" ?

Quatrième question : la sécurité nationale. Si les gouvernements occidentaux commencent à percevoir les modèles chinois comme des vecteurs d'influence stratégique, nous pourrions voir des restrictions à l'utilisation de K2.5, DeepSeek, Qwen dans des secteurs sensibles. Déjà, certaines agences gouvernementales américaines interdisent les logiciels chinois sur les appareils officiels. Étendre cette interdiction aux modèles d'IA serait techniquement complexe mais politiquement plausible. Et à ce moment-là, la bifurcation de l'écosystème mondial de l'IA deviendrait permanente.

Cinquième question : le facteur Huawei. Si la Chine parvient réellement à développer des GPU Ascend compétitifs avec ceux de NVIDIA, la dynamique change totalement. Il ne s'agirait plus d'optimisation logicielle pour contourner les limitations matérielles, mais d'une capacité de bout en bout indépendante. Sanfilippo suppose que DeepSeek travaille déjà sur un entraînement massif avec des puces Huawei, un "Projet Manhattan" gouvernemental. Si c'est vrai, d'ici douze à dix-huit mois, nous pourrions voir des modèles chinois entraînés entièrement sur du matériel national, immunisés contre tout embargo futur.

Enfin : la question de la vérité. Comment vérifions-nous les performances réelles de ces modèles ? Sanfilippo suggère des tests empiriques indépendants, mais qui a les ressources pour le faire systématiquement ? Il faudrait vraiment un CERN de l'IA, un organisme international neutre qui teste les modèles dans des conditions contrôlées et publie des résultats vérifiables. Tant qu'il n'existera pas, nous naviguerons entre des affirmations autoréférentielles et des benchmarks potentiellement "fuités".

Un échec qui vaut la partie

Revenons à l'image initiale, celle de la partie d'échecs. Les États-Unis ont joué le coup de l'embargo technologique en pensant mettre la Chine en échec. La Chine a répondu par une série de contre-coups inattendus : des architectures logicielles plus efficaces, des sorties stratégiques de modèles "open-weights", des écosystèmes de développeurs qui se développent hors du contrôle de la Silicon Valley. Kimi K2.5 est l'un de ces contre-coups, et ce ne sera pas le dernier.

L'évaluation de marché ridicule par rapport aux capacités techniques, selon Sanfilippo, raconte une histoire plus profonde : "Moonshot AI vaut 3,6 milliards de dollars, un chiffre très bas par rapport aux évaluations hors normes d'OpenAI ou d'Anthropic, bien que la qualité du modèle soit comparable". Le marché financier occidental n'a pas encore assimilé que l'IA ne sera pas un monopole américain, qu'il existe des trajectoires alternatives, que le logiciel peut compenser (et a compensé) les limitations matérielles.

La sortie de K2.5 ne termine pas la partie, elle en ouvre de nouvelles phases. Les développeurs du monde entier ont désormais accès à des capacités multimodales avancées, des essaims d'agents, du codage à partir de la vision, sans dépendre des API américaines ou de budgets d'entreprise. Les gouvernements ont des options stratégiques qui n'impliquent pas une soumission technologique à Washington. Les chercheurs peuvent étudier, modifier, étendre un modèle de pointe sans demander d'autorisation ni signer des accords de non-divulgation impossibles.

Les questions ouvertes sont nombreuses, les certitudes rares. Mais une chose est claire : la géographie de l'intelligence artificielle se redessine, et penser que ce redessin peut être arrêté par des contrôles à l'exportation est aussi naïf que de penser qu'un embargo pétrolier aurait arrêté Toyota dans les années 70. L'histoire de la technologie récompense ceux qui innovent sous la contrainte, pas ceux qui protègent leurs rentes de situation.

Moonshot AI, comme son nom l'indique, vise la lune. Il est trop tôt pour dire si elle l'atteindra vraiment. Mais en attendant, pendant que nous regardons, ils construisent des fusées de mieux en mieux avec des matériaux qui ne devraient pas suffire. Et ça, en soi, c'est déjà quelque chose qui mérite d'être suivi.