Qwen3-TTS: la voce sintetica nata dall'assedio tecnologico

Quando Alibaba ha rilasciato Qwen3-TTS a metà gennaio 2026, pochi hanno colto il paradosso sottostante. Mentre Washington stringeva ulteriormente la morsa sulle esportazioni di chip avanzati verso la Cina, il team Qwen presentava al mondo un modello text-to-speech open-source capace di clonare voci con soli tre secondi di audio, generare parlato in dieci lingue e girare su hardware consumer. Non parliamo di una soluzione arrangiata: i benchmark mostrano che Qwen3-TTS raggiunge prestazioni state-of-the-art su dataset come Seed-TTS e InstructTTSEval, superando o eguagliando competitor come F5-TTS e Spark-TTS. È la dimostrazione pratica di come i vincoli possano diventare catalizzatori di innovazione architettonica radicale, costringendo i ricercatori cinesi a ripensare dalle fondamenta il modo in cui costruiamo intelligenze artificiali vocali.

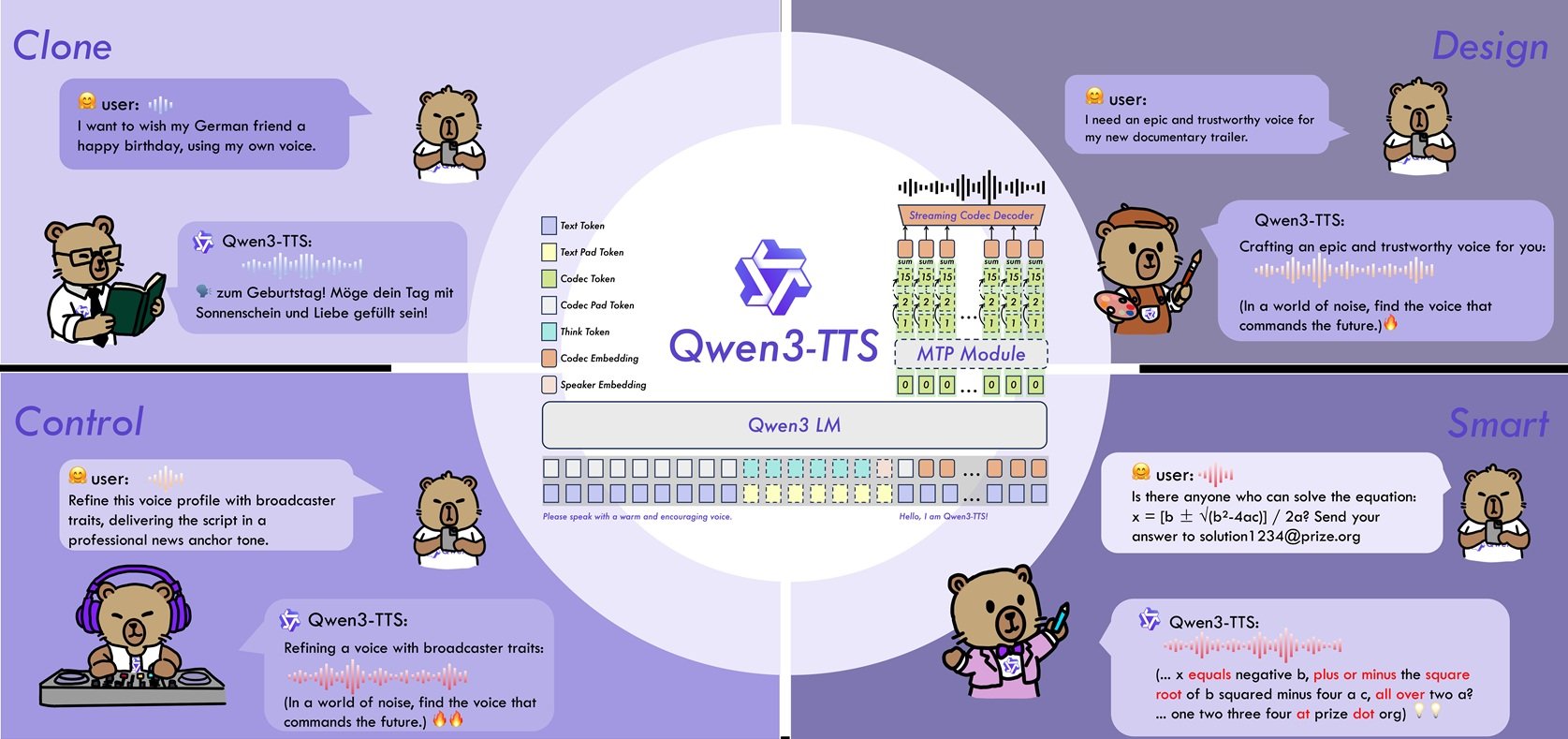

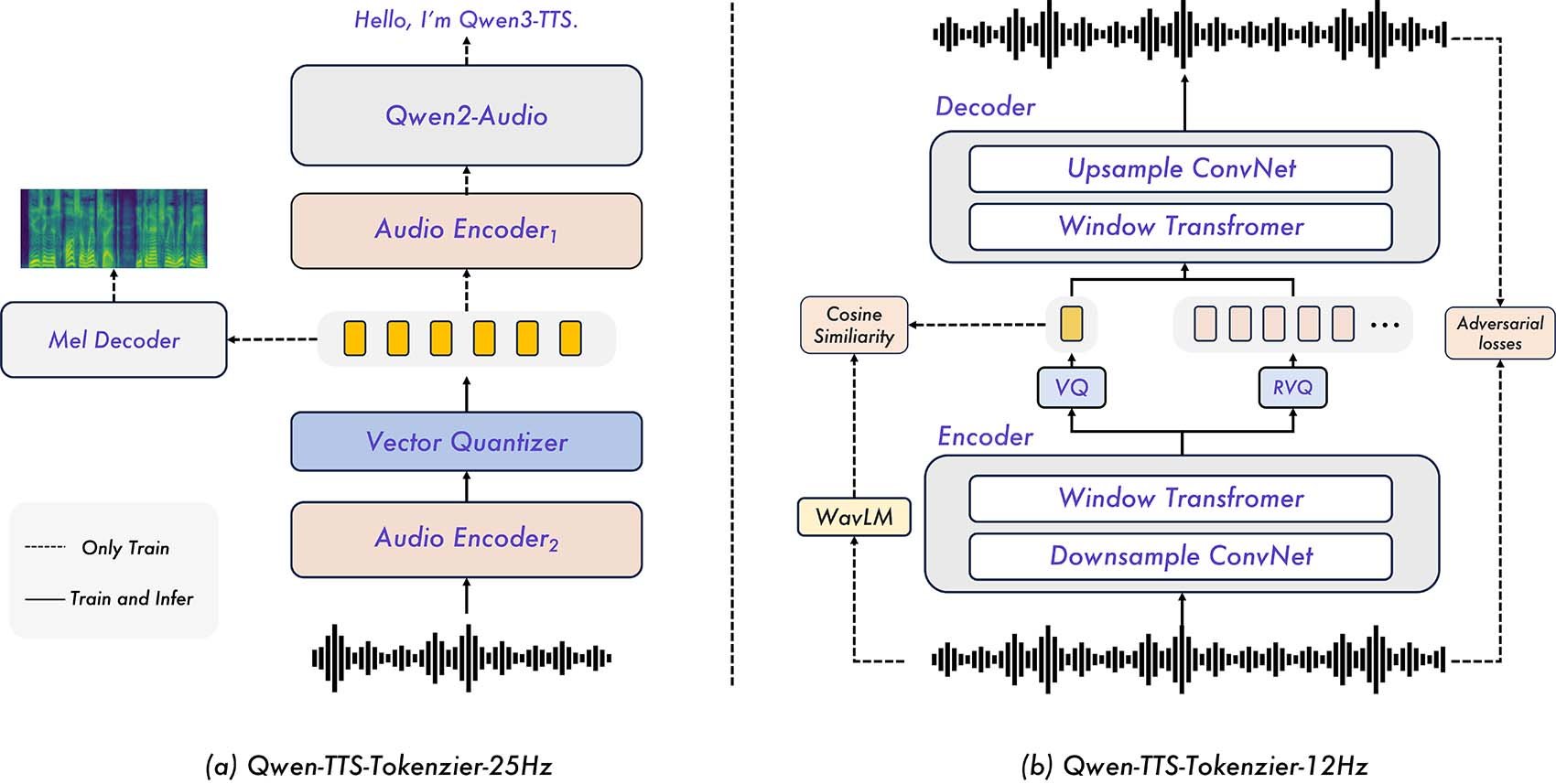

La prima stranezza di Qwen3-TTS emerge dalla sua architettura. Dove i sistemi tradizionali concatenano moduli separati per comprendere il testo, generare rappresentazioni acustiche e sintetizzare l'audio finale, questo modello adotta quello che il team Alibaba chiama un approccio "dual-track LM" per la sintesi in tempo reale. In pratica, il sistema processa simultaneamente due flussi di informazione attraverso tokenizer operanti a frequenze diverse: uno a venticinque hertz per preservare il contenuto semantico, l'altro a dodici hertz per l'estrema compressione del bitrate e la generazione streaming ultra-veloce. Quest'ultimo, il Qwen-TTS-Tokenizer-12Hz, utilizza un design multi-codebook a sedici layer che promette latenze da record: novantasette millisecondi per emettere il primo pacchetto audio, un tempo inferiore a quello necessario per pronunciare la parola "ciao".

L'addestramento ha richiesto oltre cinque milioni di ore di dati vocali distribuiti su dieci lingue, dal cinese al tedesco passando per giapponese, coreano, russo, portoghese, spagnolo, francese e italiano. Non si tratta solo di volume: il dataset include variazioni dialettali, registri emotivi diversificati e contesti acustici eterogenei, permettendo al modello di imparare non solo cosa dire, ma come dirlo in modi che suonino naturali anche quando si clona una voce ascoltata per appena tre secondi. I numeri parlano chiaro: su LibriSpeech test-clean, il tokenizer raggiunge un Word Error Rate di 3,07% in inglese e 4,23% in cinese, prestazioni che superano tokenizer precedenti come S3-Tokenizer di oltre il cinquanta percento.

Il banco di prova dei numeri

Quando si valuta un sistema text-to-speech, la metrica che conta davvero è il Word Error Rate: quanto spesso il modello sbaglia nella riproduzione del testo originale. Qwen3-TTS registra WER di 1,24% sul test inglese di Seed-TTS, posizionandosi tra i migliori sistemi disponibili. Ma è nella generazione di contenuti lunghi che il modello mostra i muscoli: la variante CustomVoice da 1,7 miliardi di parametri ottiene WER di appena 1,517% in cinese e 1,225% in inglese su audio che supera i dieci minuti di durata, surclassando competitor come Higgs-Audio-v2 e VoxCPM che mostrano errori tre o quattro volte superiori.

La qualità vocale, misurata attraverso Mean Opinion Score in test di ascolto soggettivi, si attesta su livelli competitivi rispetto a ElevenLabs, che rimane il riferimento commerciale per realismo ed espressività emotiva. Dove Qwen3-TTS brilla veramente è nella versatilità: supporta non solo la clonazione vocale zero-shot, ma anche la creazione di voci completamente nuove attraverso descrizioni testuali in linguaggio naturale. Vuoi una voce maschile anziana con accento sichuanese? Il modello la genera. Necessiti di una narrazione in inglese britannico con tono neutro e cadenza lenta? Basta specificarlo nelle istruzioni.

Il confronto con i principali player del mercato rivela dinamiche interessanti. ElevenLabs, valutata 3,3 miliardi di dollari nel gennaio 2025, genera ricavi stimati intorno ai duecento milioni di dollari annui e mantiene il primato nella sintesi ad altissima fedeltà emotiva, particolarmente apprezzata per audiobook e doppiaggio. Google Cloud TTS, Amazon Polly e Microsoft Azure offrono soluzioni enterprise consolidate con latenze competitive e pricing a consumo vantaggioso per volumi elevati. Qwen3-TTS si inserisce in questo panorama con una proposta di valore diversa: licenza Apache 2.0, modelli scaricabili localmente, possibilità di fine-tuning senza vincoli commerciali. È la differenza tra affittare un servizio e possedere l'infrastruttura.

Hardware consumer, ambizioni enterprise

Qui emerge la seconda anomalia strategica. Mentre i grandi modelli linguistici richiedono cluster di GPU enterprise per l'inferenza, Qwen3-TTS è progettato per girare su schede grafiche consumer. La variante da 1,7 miliardi di parametri opera in modo fluido su una NVIDIA RTX 4060 con sedici gigabyte di VRAM, hardware che costa meno di quattrocento euro sul mercato retail. Il modello più leggero da 0,6 miliardi di parametri funziona persino su configurazioni più modeste, sebbene con compromessi sulla qualità e velocità di generazione.

Per chi voglia sperimentare senza investimenti hardware, i notebook Colab ufficiali permettono di testare il sistema gratuitamente attraverso GPU virtuali T4 o V100. L'installazione locale richiede Python con PyTorch, poche dipendenze aggiuntive e il download dei pesi del modello da Hugging Face, operazione che occupa circa sei gigabyte di spazio disco per la variante completa. Chi possiede hardware più potente può spingere le performance: su una A100 enterprise, il Real-Time Factor scende sotto 0,1, significando che il sistema genera dieci secondi di audio in appena un secondo di elaborazione.

Questa accessibilità hardware non è casuale ma frutto di scelte architetturali precise. Invece di affidarsi a Diffusion Transformers pesanti come molti competitor, Qwen3-TTS utilizza una ConvNet causale leggera per la decodifica audio, riducendo drasticamente i requisiti computazionali senza sacrificare eccessivamente la qualità. È un approccio che ricorda quello di DeepSeek con la sua Mixture of Experts: massimizzare l'efficienza computazionale attraverso design intelligente piuttosto che forza bruta.

Dalla sintesi vocale all'identità digitale

Le applicazioni pratiche di un sistema text-to-speech così versatile abbracciano settori diversificati. L'industria dell'audiobook sta già esplorando l'uso di questi modelli per produzioni multilingue rapide: un singolo narratore può essere clonato e fatto parlare in dieci lingue diverse mantenendo timbro e caratteristiche metriche originali. Gli editori risparmiano sui costi di registrazione e localizzazione, accelerando drasticamente il time-to-market per contenuti globali.

Nel gaming, la sintesi vocale procedurale permette di generare dialoghi dinamici per NPC senza registrare migliaia di ore di doppiaggio preventivo. Giochi narrativi complessi come quelli che hanno fatto la fortuna di studi come Obsidian o Larian potrebbero beneficiare di sistemi che generano battute contestuali al volo, reagendo alle scelte del giocatore con voci coerenti e naturali. È ancora fantascienza? Forse, ma i fondamentali tecnici cominciano a esserci.

L'healthcare rappresenta un altro fronte promettente. Assistenti virtuali dotati di voci sintetiche realistiche possono supportare pazienti anziani o con disabilità cognitive, offrendo promemoria per terapie, compagnia conversazionale o lettura di contenuti medici. La possibilità di personalizzare completamente il timbro vocale permette di creare esperienze più empatiche e meno alienanti rispetto alle voci robotiche tradizionali.

Sul versante creator, l'integrazione con ComfyUI e Hugging Face Spaces democratizza l'accesso alla tecnologia. Content creator senza competenze tecniche possono generare voice-over professionali per video YouTube, podcast o contenuti social semplicemente caricando un campione vocale di tre secondi e inserendo il testo da sintetizzare. La barriera d'ingresso crolla, trasformando una capacità prima riservata a studi di produzione costosi in commodity disponibile attraverso un'interfaccia web.

L'innovazione sotto assedio

Ma è il contesto geopolitico a rendere Qwen3-TTS particolarmente significativo. Gli Stati Uniti hanno intensificato progressivamente i controlli sulle esportazioni di semiconduttori avanzati verso la Cina, bloccando l'accesso a GPU enterprise come NVIDIA H100 e A100. L'obiettivo dichiarato è rallentare lo sviluppo militare cinese nell'intelligenza artificiale, ma l'effetto collaterale è aver costretto l'intera industria tech cinese a ripensare le proprie strategie di ricerca e sviluppo.

Come ho già analizzato riguardo a DeepSeek e la sua architettura Mixture-of-Experts, la risposta cinese non è stata la resa ma l'innovazione attraverso l'efficienza. Se non puoi avere i chip più potenti, devi costruire modelli che ottengano risultati comparabili con hardware inferiore. Questo approccio ha portato a breakthrough architetturali che, paradossalmente, potrebbero rivelarsi più sostenibili e scalabili nel lungo periodo rispetto alla strategia occidentale basata su cluster sempre più enormi.

Qwen3 nel suo complesso rappresenta questa filosofia applicata sistematicamente: modelli linguistici multimodali che girano su hardware consumer, raggiungendo performance competitive con i migliori sistemi americani pur utilizzando una frazione delle risorse computazionali. Qwen3-TTS continua questa tradizione nel dominio vocale, dimostrando che è possibile ottenere sintesi speech state-of-the-art senza accesso a datacenter con migliaia di GPU top di gamma.

La strategia ricorda quella adottata anche da altri attori del panorama AI cinese e europeo. Mistral AI, pur operando in un contesto regolatorio diverso, ha parimenti puntato su efficienza e ottimizzazione, dimostrando che modelli più piccoli ma meglio progettati possono competere con giganti molto più costosi. È un pattern che si ripete: di fronte a vincoli di risorse, l'intelligenza umana trova vie alternative che spesso risultano superiori all'approccio di forza bruta.

I dati confermano questa tendenza. Secondo testimonianze al Congresso americano, Huawei produrrà circa duecentomila chip AI nel 2025, un numero minuscolo rispetto ai milioni che NVIDIA sforna. Eppure, modelli come DeepSeek-R1 o appunto Qwen3-TTS dimostrano capacità tecniche che non riflettono questa disparità hardware. La spiegazione risiede nell'efficienza algoritmica: quando hai meno risorse, devi usarle meglio.

Le ombre di una voce perfetta

Ogni tecnologia porta con sé rischi proporzionali alla sua potenza. La capacità di clonare voci con soli tre secondi di audio apre scenari inquietanti nel campo dei deepfake vocali. Truffe telefoniche che utilizzano la voce di familiari, disinformazione politica attraverso audio falsificati di figure pubbliche, estorsioni basate su registrazioni contraffatte: le applicazioni criminali sono immediate e preoccupanti.

L'Unione Europea ha tentato di regolamentare questi rischi attraverso l'AI Act, richiedendo trasparenza e tracciabilità per contenuti generati artificialmente. Ma l'enforcement rimane problematico quando i modelli sono open-source e scaricabili localmente. Una volta che Qwen3-TTS è sul tuo computer, nessuna policy aziendale può impedirne l'uso malevolo. Alibaba include avvertenze etiche nella documentazione e raccomanda l'uso di watermarking audio per identificare contenuti sintetici, ma queste sono barriere fragili di fronte a utenti determinati.

I bias linguistici e culturali rappresentano un'altra zona grigia. Il modello è stato addestrato principalmente su dati cinesi e inglesi, con le altre otto lingue supportate in proporzioni minori. Questo squilibrio si traduce in performance ineguali: il cinese suona impeccabile, l'inglese molto buono ma occasionalmente con sfumature "anime-like" secondo alcuni utenti, mentre lingue come tedesco o spagnolo mostrano qualità inferiore secondo test comunitari. Per l'italiano, lingua con meno di cento milioni di parlanti nativi, la copertura nel dataset è probabilmente marginale, sollevando interrogativi sulla rappresentatività globale di questi sistemi.

La privacy vocale emerge come questione centrale. La voce è un dato biometrico identificativo quanto le impronte digitali. Sistemi che permettono clonazione vocale facilmente accessibile richiedono framework legali per proteggere l'identità vocale degli individui. Serve consenso esplicito per clonare una voce? Chi possiede i diritti su una voce sintetica derivata da campioni reali? La legislazione fatica a tenere il passo con la tecnologia.

Mercati aperti, strategie chiuse

Il mercato text-to-speech sta attraversando una fase di espansione rapida. Stime di settore valutano il mercato globale TTS intorno ai sette miliardi di dollari entro il 2028, con crescita annua del 14,4%. ElevenLabs, player dominante nel segmento premium, ha raggiunto ricavi annuali di duecento milioni di dollari e punta a una valutazione superiore ai sei miliardi entro la fine del 2026, sospinta da investimenti strategici di Deutsche Telekom, LG Technology Ventures e altri giganti corporate.

Ma la dinamica competitiva sta cambiando. L'open-source, tradizionalmente considerato un settore di nicchia per entusiasti e ricercatori, sta erodendo le posizioni dei player proprietari. Quando modelli come Qwen3-TTS offrono l'ottanta percento delle capacità di soluzioni commerciali a costo zero e con piena libertà di customizzazione, le aziende devono ricalibrare le proprie proposte di valore. ElevenLabs mantiene il vantaggio nell'espressività emotiva fine-grained e nel supporto enterprise-grade, ma per applicazioni che non richiedono il massimo assoluto della qualità, alternative open-source diventano sempre più attraenti.

Google, Amazon e Microsoft dominano il segmento API-as-a-service attraverso le loro piattaforme cloud, beneficiando di economie di scala e integrazioni native con altri servizi enterprise. Ma anche loro osservano nervosamente l'avanzata open-source. Se una startup può deployare Qwen3-TTS localmente senza costi di licenza o limitazioni d'uso, perché dovrebbe pagare per API esterne? La risposta sta nella convenienza, affidabilità e supporto professionale, ma il calcolo economico si fa più complesso.

L'ecosistema si sta frammentando geograficamente. Aziende cinesi adottano naturalmente soluzioni Qwen per ragioni di sovranità tecnologica e accesso linguistico privilegiato. Clienti europei navigano tra GDPR compliance e preferenze per fornitori locali come France-based Eleven Labs o soluzioni open-source hostabili internamente. Il mercato americano resta appannaggio di player domestici, sia per inerzia che per vincoli regolatori crescenti su tecnologie cinesi.

Domande ancora aperte

Il futuro di Qwen3-TTS solleva interrogativi tanto tecnici quanto strategici. La roadmap del team Qwen punta verso modelli multimodali sempre più integrati, dove text-to-speech converge con speech-to-text, traduzione automatica e comprensione contestuale in sistemi end-to-end. Vedremo varianti che gestiscono video-to-speech, sincronizzando labiale e audio? L'architettura attuale supporta queste estensioni?

La scalabilità oltre 1,7 miliardi di parametri rappresenta un'altra frontiera. Modelli più grandi potrebbero catturare sfumature emotive e metriche più sottili, ma a quale costo computazionale? Il trade-off efficienza-qualità che ha guidato finora lo sviluppo di Qwen potrebbe raggiungere limiti intrinseci, richiedendo breakthrough architetturali ulteriori.

Il consumo energetico e l'impatto ambientale dell'AI vocale meritano attenzione. Anche modelli relativamente leggeri come Qwen3-TTS, deployati su milioni di dispositivi per generare ore di audio quotidianamente, contribuiscono all'impronta carbonica del settore tech. Serve maggiore trasparenza su metriche di efficienza energetica e best practices per deployment sostenibile.

Per l'Italia e l'Europa, le sfide sono sia tecniche che regolatorie. La lingua italiana riceve copertura minimale in questi dataset globali, rischiando di rimanere marginalizzata in applicazioni commerciali future. Investimenti pubblici in corpora vocali italiani di qualità, aperti e accessibili, potrebbero colmare questo gap. Sul fronte regolatorio, l'AI Act europeo deve trovare equilibrio tra protezione dei cittadini e non-soffocamento dell'innovazione, evitando che requisiti eccessivamente stringenti spingano i migliori talenti verso giurisdizioni più permissive.

La domanda più profonda riguarda la direzione complessiva della ricerca AI. L'embargo tecnologico americano sta involontariamente forzando un percorso alternativo di sviluppo, centrato su efficienza e ingegno piuttosto che su potenza bruta. Se questo approccio si dimostrerà superiore nel lungo periodo, avremo assistito a uno degli autogol strategici più clamorosi della storia della tecnologia. Se invece i vincoli hardware alla fine prevarranno, limitando le capacità cinesi al di sotto di quelle occidentali, i controlli all'export avranno raggiunto il loro scopo. Solo il tempo dirà quale narrativa prevarrà, ma intanto modelli come Qwen3-TTS continuano a spostare i confini del possibile, dimostrando che l'innovazione trova sempre una via quando i talenti sono determinati a trovarla.