Gli agenti AI lavorano. E i conti tornano

Dall'entusiasmo alla produzione

C'è un dato, nel nuovo rapporto di DigitalOcean pubblicato a febbraio 2026, che sembra contraddirsi da solo. La percentuale di aziende che dichiarano di usare l'intelligenza artificiale è leggermente *scesa, dal 79% del 2024 al 77%, eppure, nello stesso periodo, la quota di chi la sta davvero implementando nei propri processi è quasi raddoppiata, passando dal 13% al 25%. Un paradosso solo in apparenza. Quel 2% in meno non è una defezione: è una pulizia. Finita la stagione del turismo tecnologico, tutti a sperimentare, pochi a costruire, il campo è rimasto a chi fa sul serio.*

Il rapporto, chiamato Currents, è una ricerca periodica che DigitalOcean conduce sullo stato dell'intelligenza artificiale nelle imprese tecnologiche in crescita. L'edizione di febbraio 2026 è basata su oltre 1.100 risposte raccolte tra ottobre e novembre 2025 da sviluppatori, direttori tecnici e fondatori distribuiti in 102 paesi. I più rappresentati sono gli Stati Uniti con il 28%, seguiti dal Regno Unito con il 7%, dal Canada con il 6%, dall'India con il 4%, dalla Germania e dai Paesi Bassi con il 3% ciascuno, e dall'Italia con il 2%. Un campione ampio, variegato, e sufficientemente globale da offrire una panoramica credibile sullo stato dell'arte.

Il messaggio centrale è inequivocabile: siamo entrati in una nuova fase. Il 52% delle aziende intervistate si trova oggi in una delle tre fasi più avanzate del percorso con l'intelligenza artificiale, implementazione attiva, ottimizzazione delle prestazioni, oppure adozione come elemento centrale della propria strategia. Nel 2024, la stessa percentuale si fermava al 35%. Diciassette punti percentuali in dodici mesi non sono un'evoluzione graduale.

Non si costruiscono modelli, si usano

Uno dei nodi più dibattuti nel racconto pubblico sull'intelligenza artificiale riguarda un dilemma che ogni azienda prima o poi affronta: costruire i propri modelli, mantenendo controllo pieno su dati e infrastruttura, oppure affidarsi a fornitori esterni, accettando i rischi di dipendenza, sovranità dei dati e riservatezza che questo comporta. I dati del rapporto non risolvono il dilemma, ma raccontano con chiarezza quale scelta stia vincendo nella pratica.

Solo il 15% degli intervistati si occupa principalmente di addestrare modelli da zero. Per tutti gli altri, il lavoro è altrove: il 64% integra nelle proprie applicazioni le interfacce di programmazione di fornitori terzi, e il 61% usa una combinazione di strumenti diversi piuttosto che un'unica soluzione integrata. L'intelligenza artificiale, per la stragrande maggioranza di chi la usa davvero, è diventata un servizio da connettere, non una tecnologia da costruire.

Questo spostamento ha un nome preciso: inferenza. Se l'addestramento è la fase in cui un modello impara, costosa, lunga, riservata a pochi laboratori, l'inferenza è la fase in cui quel modello viene usato per generare risposte, analizzare documenti, scrivere codice, rispondere ai clienti. È qui che si concentra ormai il grosso degli investimenti: il 44% degli intervistati destina tra il 76% e il 100% del proprio budget sull'intelligenza artificiale proprio all'inferenza. Il paragone con la transizione al cloud di un decennio fa è inevitabile: anche allora la maggioranza smise di occuparsi di hardware e imparò a lavorare con servizi remoti. L'intelligenza artificiale sta attraversando la stessa fase.

Il costo nascosto dell'intelligenza

Se c'è un ostacolo che emerge con forza dal rapporto, è il costo dell'inferenza su larga scala. Il 49% degli intervistati lo identifica come il principale limite alla crescita del proprio utilizzo dell'intelligenza artificiale. Non la complessità tecnica, non i rischi legali: il costo.

Quando si porta un sistema basato su modelli linguistici in produzione, quando deve rispondere a migliaia o milioni di richieste al giorno, la bolletta cresce in modo non sempre prevedibile. E la prevedibilità, secondo i dati, è una delle preoccupazioni più sentite. Per chi usa più strumenti e fornitori diversi, i problemi si moltiplicano: il 50% degli intervistati che opera con infrastrutture multiple segnala la necessità di gestire interfacce separate, il 49% fatica a prevedere i costi, il 48% incontra difficoltà nell'orchestrare e dispiegare i sistemi.

Solo il 23% degli intervistati lavora con un singolo fornitore che integra modelli, dati e infrastruttura. Tutti gli altri devono fare i conti con una filiera spezzettata, dove ogni pezzo richiede competenze, contratti e attenzione specifici. L'intelligenza artificiale, almeno nella sua fase attuale, non è un prodotto chiavi in mano: è un cantiere permanente, con tutto ciò che questo comporta in termini di complessità gestionale.

Chi comanda tra i modelli

Il rapporto offre una fotografia nitida del panorama dei modelli linguistici più usati, e i numeri confermano alcune intuizioni ma riservano qualche sorpresa.

OpenAI mantiene una posizione dominante: il 72% degli intervistati usa i suoi modelli. Il vantaggio del primo arrivato si traduce ancora in quote di mercato significative. Ma il margine si assottiglia: Google è al 50%, Anthropic al 47%. Entrambi hanno recuperato terreno rapidamente, e la differenza con il leader non è più abissale.

La vera sorpresa viene dal mondo dei modelli aperti. Meta con Llama e DeepSeek raggiungono entrambi il 21%. DeepSeek è particolarmente degno di nota: è entrato sul mercato solo alla fine del 2024 e ha già raggiunto lo stesso livello di adozione di Llama, che vanta anni di vantaggio. I modelli a codice aperto offrono vantaggi concreti: flessibilità nell'adattamento, assenza di dipendenza da un singolo fornitore, possibilità di girare su infrastrutture proprie senza inviare dati a terzi. Per molte aziende, soprattutto in contesti dove la riservatezza è cruciale, non sono una scelta di ripiego ma una strategia consapevole. Il mercato dei modelli non è né un monopolio né una torre di Babele: è un oligopolio in rapida evoluzione, dove chi scommette su un solo fornitore assume un rischio strategico che molti preferiscono evitare.

Gli agenti: cosa sono, cosa fanno, quanto funzionano

La parola "agente" è forse quella più inflazionata del vocabolario tecnologico degli ultimi dodici mesi. Vale la pena definirla con precisione.

Un agente di intelligenza artificiale è un sistema capace di svolgere compiti in modo autonomo, prendendo decisioni e compiendo azioni, cercare informazioni, scrivere codice, inviare messaggi, aggiornare archivi, senza che ogni singolo passo richieda l'intervento umano. La differenza rispetto a un semplice assistente conversazionale è sostanziale: un assistente risponde a domande, un agente fa cose. È la distanza tra un navigatore che indica dove girare e un'auto che guida da sola.

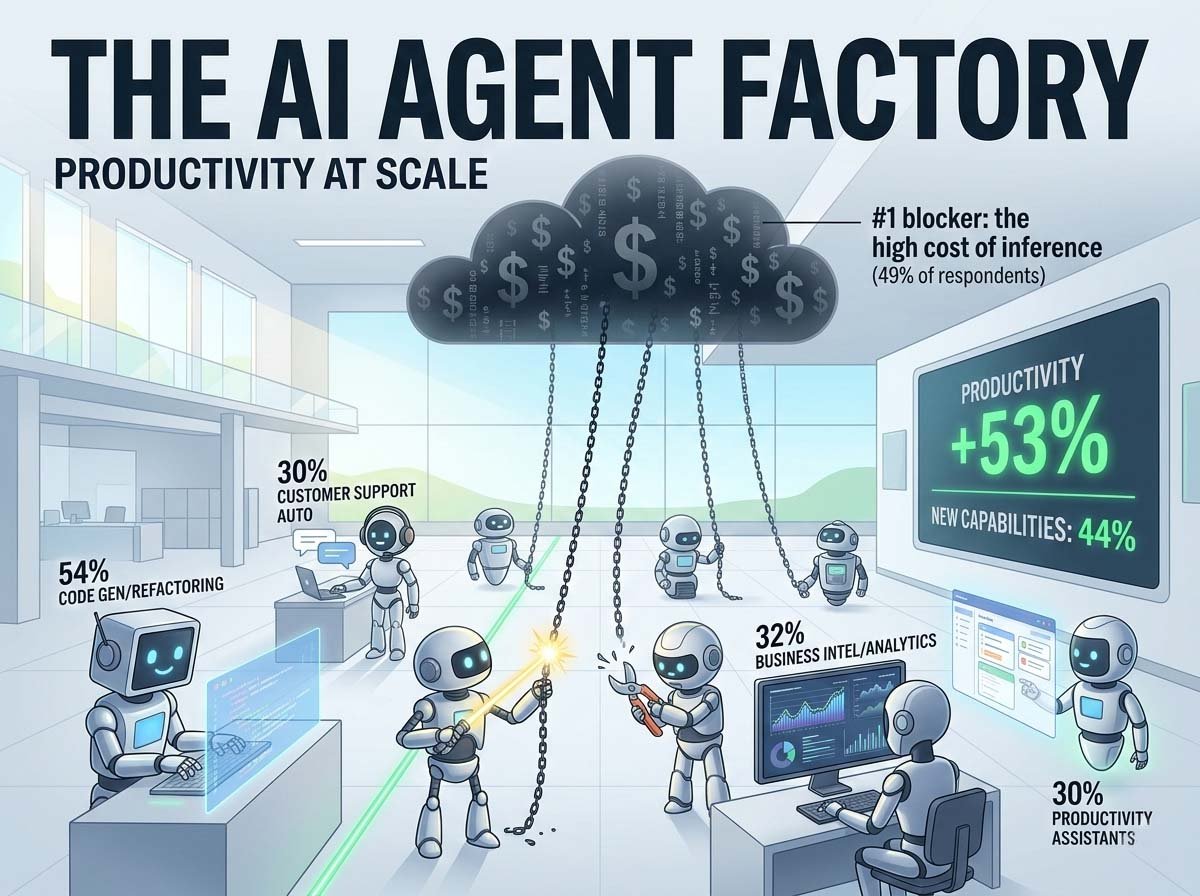

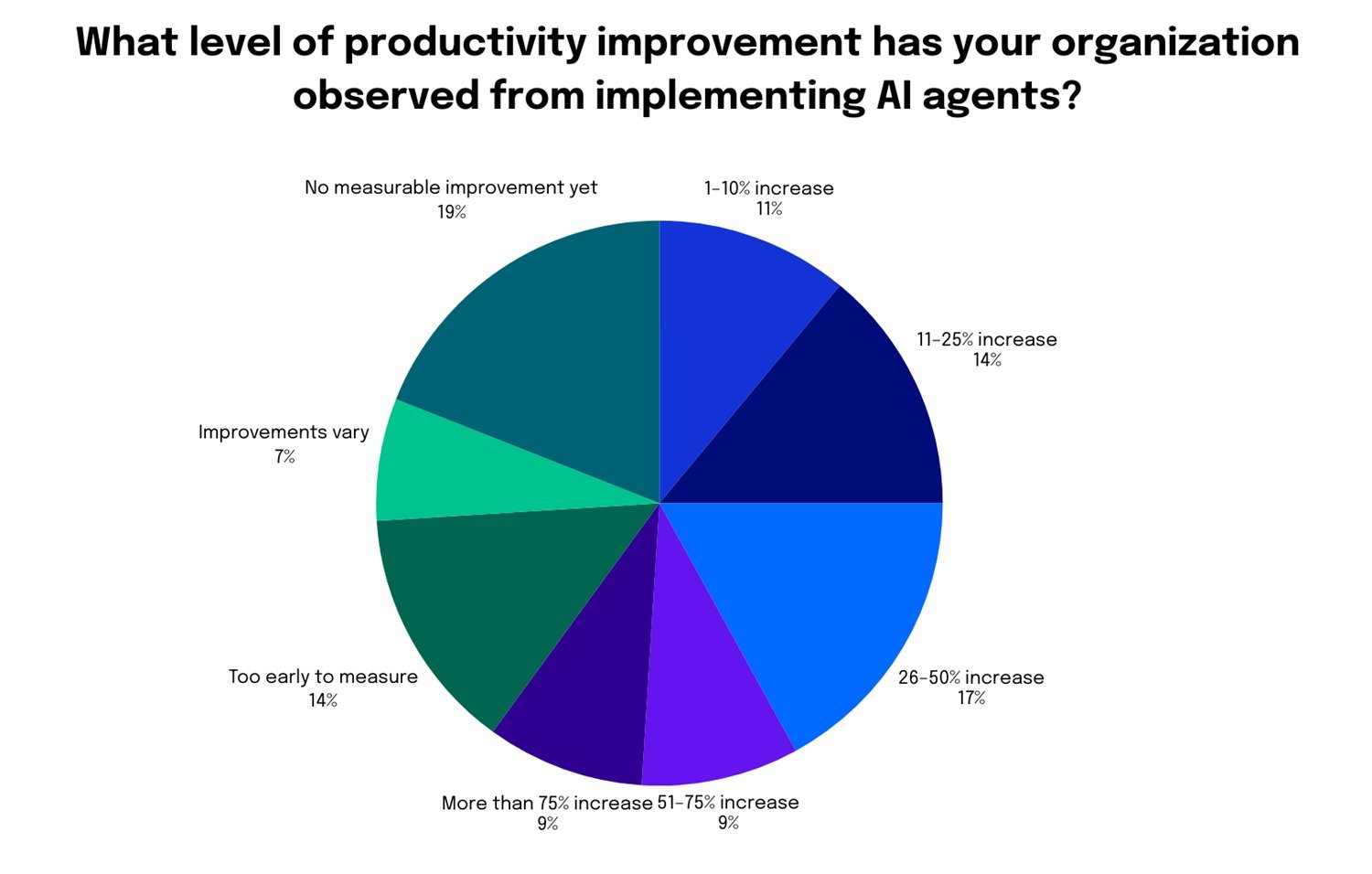

I dati mostrano che questa tecnologia ha smesso di essere solo una promessa. Il 53% delle aziende che usano agenti ha osservato risparmi di tempo e aumenti di produttività. Il 44% ha registrato la creazione di nuove capacità operative che prima non era in grado di offrire. Il 32% ha ridotto il fabbisogno di nuove assunzioni. Complessivamente, il 67% di chi ha adottato agenti ha riscontrato qualche forma di miglioramento della produttività: il 25% nell'ordine dell'1-25%, il 17% tra il 26% e il 50%, il 9% tra il 51% e il 75%, e un ulteriore 9% con guadagni superiori al 75%.

Sono percentuali che parlano, ma vanno lette con la giusta cautela. Il 14% non ha ancora visto benefici concreti. E soprattutto, il livello di autonomia effettivamente concessa agli agenti rimane, nella maggior parte dei casi, piuttosto limitato. Solo il 10% degli intervistati ha agenti completamente autonomi in produzione. Il 40% fa ancora revisionare tutti gli output da un essere umano. Il 58% utilizza punti di approvazione umana come principale misura di controllo. Gli agenti lavorano, ma sotto sorveglianza.

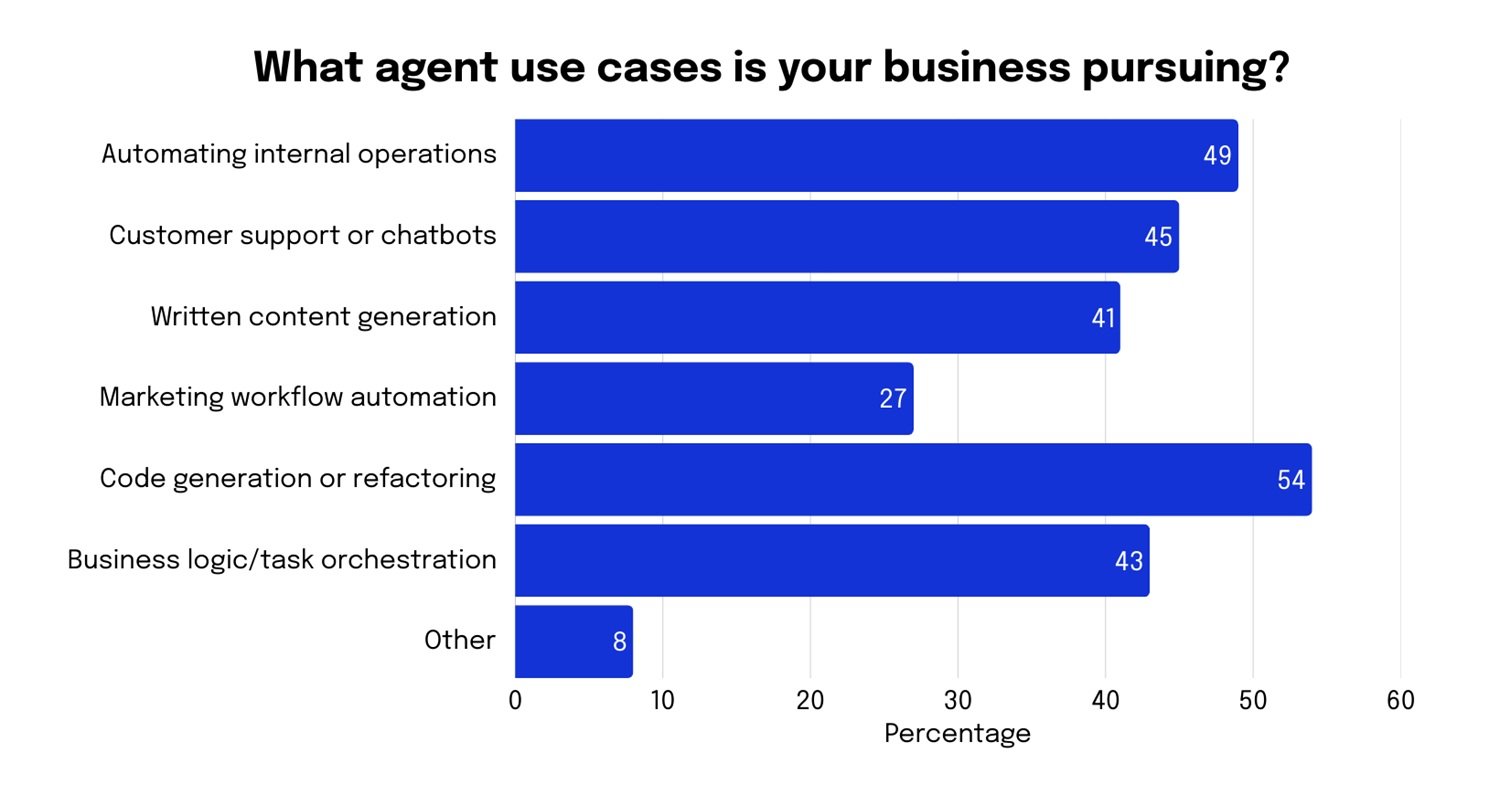

Il tipo di agente più diffuso è quello specializzato in un singolo compito (44%), seguito da quelli capaci di gestire compiti multipli (29%) e da sistemi in cui più agenti collaborano tra loro (17%). Il caso d'uso più popolare, dichiarato dal 54% degli intervistati, è la generazione e la riscrittura di codice: nulla di sorprendente, visto che il campione è composto prevalentemente da sviluppatori. Seguono l'analisi dati (41%), l'automazione del supporto clienti (40%), la ricerca e il riassunto di informazioni (39%) e la gestione di flussi di lavoro interni (38%).

C'è però un dato che va oltre i singoli casi d'uso e racconta qualcosa di più strutturale: il 60% degli intervistati identifica applicazioni e agenti come il livello dello stack tecnologico con il maggiore valore a lungo termine. Non l'infrastruttura, citata solo dal 19%, non le piattaforme di sviluppo, al 17%. È un segnale chiaro su dove il mercato pensa si giochi la partita vera, non nel possedere la potenza di calcolo o i modelli sottostanti, ma nel costruire i sistemi che li mettono al lavoro in modo utile e misurabile. È la differenza tra possedere una centrale elettrica e saper costruire gli elettrodomestici che la gente vuole davvero usare.

Il divario si allarga: chi parte adesso rischia di inseguire

Uno dei messaggi più espliciti del rapporto riguarda la distanza crescente tra chi ha già integrato l'intelligenza artificiale nei propri processi e chi è ancora alla finestra. Il 50% degli intervistati dichiara di stare sperimentando o dispiegando agenti. Ma di questi, solo il 10% li ha integrati in modo sistematico. Il 33% è nella fase dei piccoli esperimenti, il 28% sta ancora esplorando i concetti di base, il 23% ha avviato i primi carichi di lavoro reali.

Tra chi non usa ancora agenti, le prospettive per il 2026 sono preoccupanti. Il 44% dichiara di non avere in programma di sperimentarli. Solo il 26% ha pianificato test o prove pilota. Il motivo per cui questo divario rischia di aggravarsi è legato alla natura stessa dell'apprendimento organizzativo. Adottare l'intelligenza artificiale non è come installare un programma: richiede mesi di sperimentazione, aggiustamenti, costruzione di competenze interne, revisione dei processi. Chi inizia ora ha già un ritardo strutturale su chi ha cominciato un anno fa. La stessa dinamica si è vista con l'adozione del commercio elettronico, del cloud, dei social media: le aziende che hanno scommesso in anticipo hanno costruito vantaggi difficili da colmare.

Il 37% degli intervistati prevede di aumentare il budget destinato ad applicazioni e agenti nei prossimi dodici mesi, la categoria di investimento più citata in assoluto. E il 38% di chi non ha ancora avviato esperimenti dichiara che inizierà nel 2026. Ma dichiarare non è fare, e la storia delle grandi trasformazioni tecnologiche è piena di intenzioni non tradotte in azioni.

I nodi tecnici da sciogliere

Il rapporto di DigitalOcean offre una fotografia precisa dello stato attuale, ma alcune domande restano senza risposta, e accompagneranno il settore per tutto il 2026.

La prima riguarda l'affidabilità. Il 41% degli intervistati identifica proprio la mancanza di prevedibilità degli agenti come principale ostacolo alla loro diffusione. Un sistema che compie azioni nel mondo reale, aggiorna archivi, invia messaggi, esegue operazioni, deve essere coerente. I modelli attuali hanno compiuto progressi enormi, ma non hanno ancora raggiunto la soglia che molti casi d'uso produttivi richiedono. È anche per questo che il 40% mantiene ancora un controllo umano sistematico: non per scelta filosofica, ma per necessità pratica. Il 31% degli intervistati indica poi l'integrazione con le applicazioni esistenti come secondo ostacolo principale: le aziende non partono da zero, hanno sistemi gestionali, archivi e flussi costruiti in anni, spesso decenni, e connettere un agente intelligente a questo ecosistema richiede tempo, competenze e test approfonditi per evitare che il nuovo sistema introduca comportamenti inattesi.

La seconda questione è quella della concentrazione del potere. Tre fornitori, OpenAI, Google, Anthropic, controllano insieme la quota dominante dei modelli in uso a livello globale. Se questi modelli diventano infrastruttura critica per milioni di aziende, le decisioni che questi tre attori prendono su prezzi, accesso, censura dei contenuti e condizioni d'uso si trasformano di fatto in politiche industriali non elette da nessuno. I modelli aperti come Llama e DeepSeek offrono un'alternativa concreta, ma richiedono competenze di dispiegamento e risorse infrastrutturali che non tutte le organizzazioni possono permettersi. La dipendenza non è un rischio teorico: è già visibile nei dati, e il fatto che solo il 21% degli intervistati usi modelli aperti segnala quanto sia difficile, nella pratica, affrancarsi dal triumvirato commerciale.

Lavoro, Europa e le domande che restano

La terza domanda è quella del lavoro. Il 32% di chi usa agenti ha già ridotto il fabbisogno di nuove assunzioni. I guadagni di produttività documentati dal rapporto non si traducono automaticamente in benessere diffuso. Se i risparmi rimangono concentrati nelle aziende più capitalizzate, il divario tra chi vince e chi perde nella trasformazione si allargherà ulteriormente. Se invece la stessa produttività viene usata per espandere l'offerta, aprire nuovi mercati, offrire servizi prima inaccessibili, l'effetto può essere positivo anche per chi lavora. La tecnologia non decide: decidono le organizzazioni, le politiche pubbliche, le scelte di chi detiene il potere economico.

Per l'Italia e l'Europa, presenti ma non dominanti nel campione, resta aperta la domanda su come conciliare l'urgenza di adottare queste tecnologie con un contesto normativo complesso. Il regolamento europeo sull'intelligenza artificiale, entrato in vigore nel 2024, impone requisiti di conformità, trasparenza e valutazione del rischio che molte aziende stanno ancora cercando di interpretare. La normativa non è di per sé un freno allo sviluppo, ma richiede investimenti in competenze legali e di governance che si aggiungono a quelli tecnici, alzando il costo complessivo dell'ingresso. Per le piccole e medie imprese italiane, spina dorsale del tessuto produttivo nazionale, l'ostacolo non è solo economico o normativo, ma anche organizzativo: adottare agenti capaci richiede una disponibilità a rimettere in discussione processi consolidati, una tolleranza per la sperimentazione e l'errore, e una capacità di attrarre profili tecnici che il mercato del lavoro italiano fatica a produrre in quantità sufficiente. Il dato del 2% di intervistati italiani nel campione non va letto come indice di disinteresse, ma probabilmente come specchio di una partecipazione ancora periferica a conversazioni che si svolgono altrove.

Il 2026 è, secondo i dati, l'anno in cui molte aziende passeranno dalla sperimentazione alla produzione. È anche l'anno in cui alcune di queste domande inizieranno ad avere risposte concrete, non sempre quelle che ci si auspicherebbe. Guardare i numeri con onestà, come questo rapporto si sforza di fare, è quantomeno un buon punto di partenza.