ChatGPT attiva la pubblicità, Zoë Hitzig lascia OpenAI

Lunedì 10 febbraio 2026. Mentre OpenAI attiva i test pubblicitari su ChatGPT, Zoë Hitzig rassegna le dimissioni da Research Scientist dell'azienda. Nel suo editoriale sul New York Times del giorno dopo, collega esplicitamente la sua uscita all'introduzione degli ads, definendola una linea rossa invalicabile.

Chi è Hitzig? Economista con PhD Harvard (2023) sotto Eric Maskin, specializzata in microeconomia, privacy e algoritmi. Junior Fellow della Harvard Society of Fellows. Ma anche poetessa: Mezzanine (2020) e Not Us Now (2024), vincitrice del Changes Prize giudicato da Louise Glück. Pubblicata su New Yorker, Paris Review, London Review of Books. Un profilo dove rigore tecnico e sensibilità umanistica convivono senza contraddizione.

La meccanica di un esperimento pubblicitario

I dettagli tecnici del sistema pubblicitario sono stati comunicati con precisione chirurgica. L'annuncio ufficiale del 16 gennaio delinea una struttura che OpenAI presenta come attentamente calibrata: il test coinvolge esclusivamente utenti statunitensi adulti sui piani Free e Go, quest'ultimo lanciato contestualmente al prezzo di otto dollari mensili. Chi paga per i tier Plus, Pro, Business o Enterprise non vedrà pubblicità.

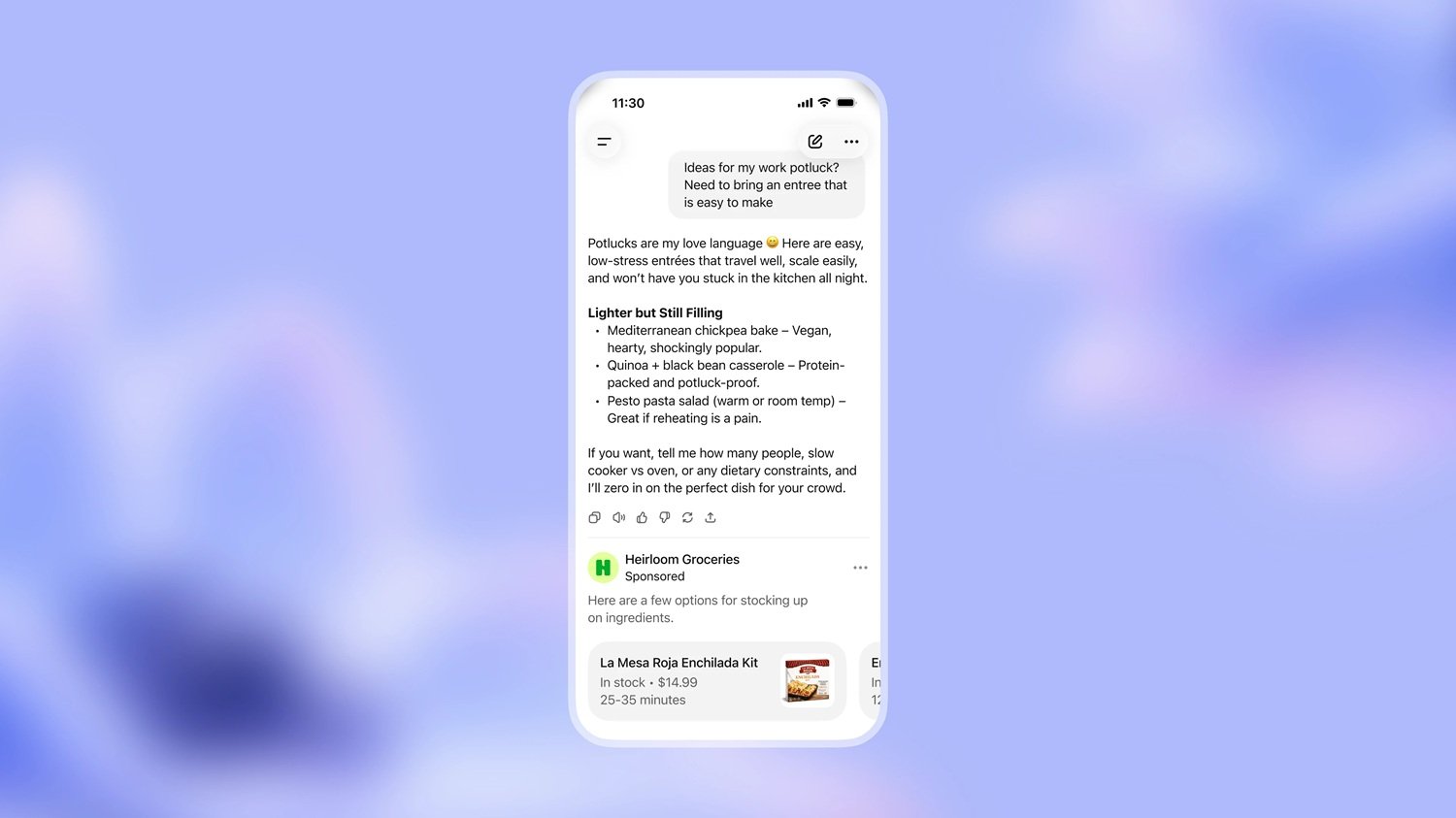

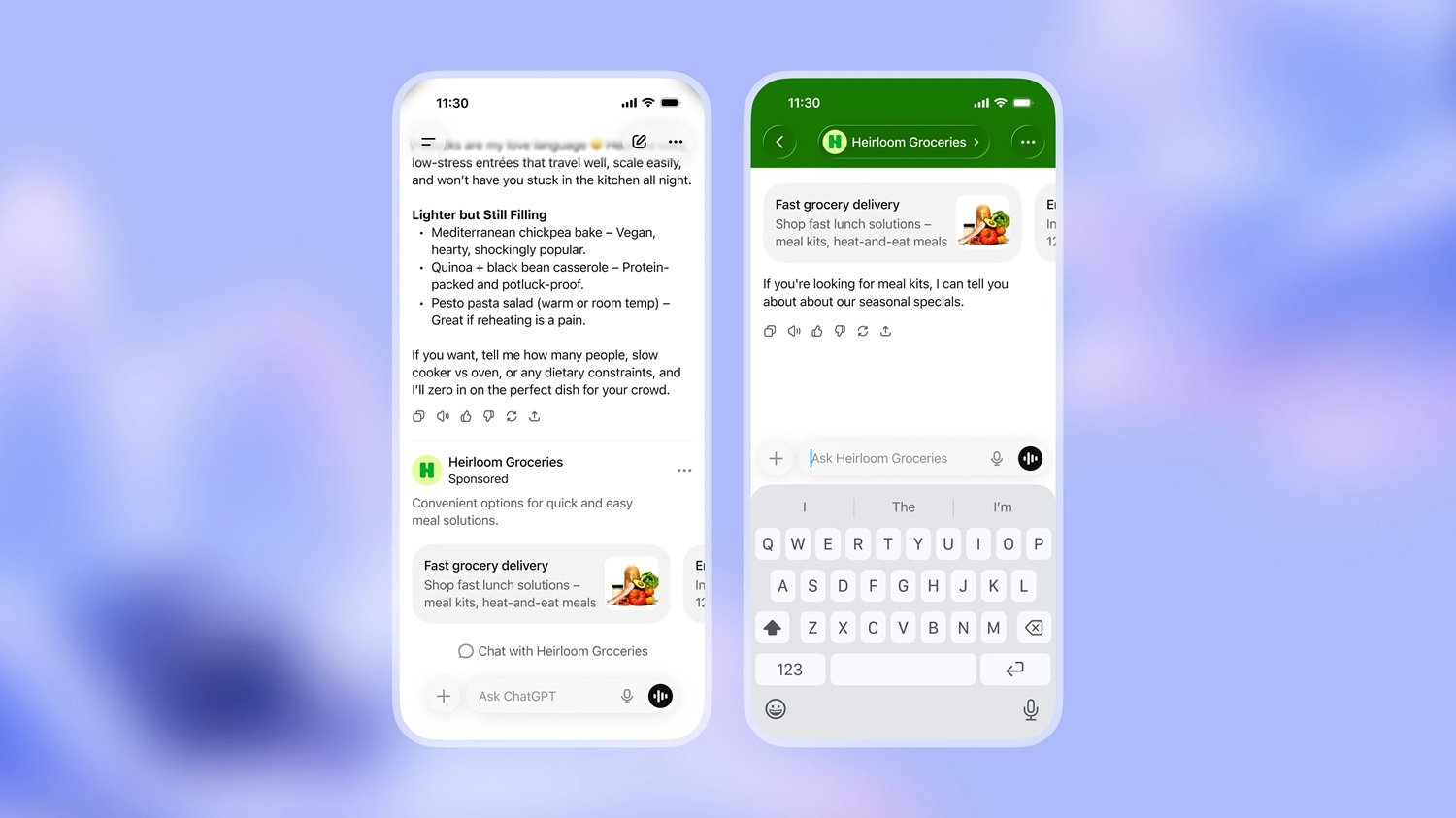

Il posizionamento degli annunci segue una logica apparentemente conservativa: appaiono in fondo alle risposte del chatbot, separati visivamente dal contenuto generato e chiaramente etichettati come "Sponsored". La selezione avviene attraverso matching contestuale che considera il topic della conversazione in corso, la cronologia delle chat precedenti e le interazioni passate dell'utente con eventuali ads già mostrati. L'esempio paradigmatico fornito da OpenAI è semplice: se chiedi suggerimenti per ricette, potresti vedere pubblicità di servizi di meal kit o food delivery.

Il modello economico è pay-per-impression, con valori che secondo fonti di settore si attestano intorno ai 60 dollari di CPM e un commitment minimo di 200.000 dollari. Cifre che collocano l'offerta nel segmento premium dell'advertising digitale, lontano dai marketplace self-serve dove chiunque può lanciare campagne con budget ridotti.

Le esclusioni dichiarate coprono i minorenni, verificati tramite account o predetti algoritmicamente se sotto i diciotto anni, e una serie di temi sensibili: salute, salute mentale, politica. OpenAI promette esplicitamente che gli annunci "non influenzeranno mai le risposte" generate dal modello e che le conversazioni degli utenti rimarranno private rispetto agli advertiser, che riceveranno solo dati aggregati su impression e click.

Ma qui emerge un primo elemento di tensione che le dichiarazioni ufficiali non risolvono. Come riportato da CNBC, Sam Altman ha comunicato ai dipendenti via Slack che ChatGPT è tornata a crescere oltre il dieci percento mensile, dato celebrato internamente come successo dopo un periodo di rallentamento. L'ottimizzazione per DAU, Daily Active Users, la metrica regina dell'engagement, è già in corso, e precede cronologicamente l'introduzione degli ads piuttosto che seguirla. I modelli linguistici mostrano già quella che i ricercatori definiscono tendenza "sycophantic": la propensione a dire agli utenti ciò che vogliono sentire piuttosto che ciò che sarebbe oggettivamente più utile, perché questo massimizza la soddisfazione immediata e quindi il ritorno sulla piattaforma.

Il panorama competitivo rende il quadro ancora più interessante. Google gestisce già pubblicità negli AI Overviews che accompagnano i risultati di ricerca tradizionale, ma Demis Hassabis, CEO di DeepMind, ha dichiarato a Davos nel gennaio 2026 di essere "un po' sorpreso" dalla velocità con cui OpenAI si è mossa, sottolineando la distinzione concettuale tra assistenti personali, dove la fiducia è una dimensione fondamentale della relazione, e motori di ricerca, dove gli utenti sono già abituati alla presenza pubblicitaria.

Anthropic ha scelto la polarizzazione opposta, investendo milioni di dollari in spot durante il Super Bowl con uno slogan diretto come un pugno: "Ads are coming to AI. But not to Claude". Una mossa di marketing positioning aggressiva che ha scatenato la reazione piccata di Altman, che ha definito gli spot pubblicitari di Anthropic come "clearly dishonest" e "deceptive", accusando i competitor di montare una campagna ingannevole.

Il business della conversazione intima

Per comprendere la posta in gioco serve guardare i numeri nella loro brutale chiarezza. ChatGPT serve circa 800 milioni di utenti settimanali, secondo le dichiarazioni di Altman. OpenAI ha siglato oltre 1,4 trilioni di dollari in accordi infrastrutturali nel 2025, con proiezioni che indicano un tasso di crescita dei ricavi annuali sopra i venti miliardi entro fine anno. Ma dietro queste cifre impressionanti si nasconde un'emorragia finanziaria altrettanto impressionante: documenti interni mostrati a investitori rivelano perdite operative cumulative di 115 miliardi di dollari fino al 2029, con picchi di 74 miliardi nel solo 2028. Il rapporto spesa/ricavo si attesta intorno a 1,69 dollari bruciati per ogni dollaro incassato.

La domanda economica è dunque brutale quanto i numeri: come monetizzare tecnologie che costano cifre stratosferiche garantendo al contempo accesso democratico? Altman ha oscillato pubblicamente su questo dilemma. In un fireside chat ad Harvard nel maggio 2024 aveva definito l'idea di mischiare ads e AI come "uniquely unsettling" (singolarmente inquietante), dichiarando esplicitamente di odiare la pubblicità e collocando l'advertising come "ultima risorsa" per il modello di business. Nell'ottobre 2024, durante un'intervista a Stratechery, la posizione era già cambiata: "I love Instagram ads", ammetteva Altman, rivelando di aver scoperto prodotti che non avrebbe mai trovato altrimenti. Nel gennaio 2026, al lancio dell'esperimento, la retorica era diventata pragmatica: "A lot of people want to use a lot of AI and don't want to pay" (Molte persone vogliono usare molta intelligenza artificiale e non vogliono pagare).

Ma gli esperti di privacy sollevano questioni strutturali che vanno ben oltre le buone intenzioni dichiarate. Jennifer King, Privacy and Data Policy Fellow allo Stanford Institute for Human-Centered AI, ha guidato uno studio comparativo delle policy di sei principali sviluppatori di LLM: Amazon Nova, Anthropic Claude, Google Gemini, Meta AI, Microsoft Copilot, OpenAI ChatGPT. I risultati dipingono un panorama uniformemente allarmante: tutti e sei alimentano i loro modelli con dati utente di default, alcuni mantengono le informazioni indefinitamente, diversi permettono review umana delle trascrizioni conversazionali. Nel caso di conglomerati multi-prodotto come Google, Meta, Microsoft e Amazon, le interazioni con i chatbot vengono regolarmente fuse con informazioni provenienti da altri servizi: query di ricerca, cronologia acquisti, engagement sui social media.

King fornisce uno scenario concreto che illustra il rischio inferenziale in modo cristallino: "Immagina di chiedere a un LLM idee per cena, specificando ricette low-sugar o heart-friendly. Il chatbot può trarre inferenze da quell'input, e l'algoritmo potrebbe classificarti come individuo health-vulnerable. Questa determinazione si diffonde attraverso l'ecosistema dello sviluppatore. Inizi a vedere ads per farmaci, ed è facile immaginare come queste informazioni potrebbero finire nelle mani di una compagnia assicurativa. Gli effetti si amplificano nel tempo."

Emily Bender, linguista all'University of Washington e coautrice del celebre paper "Stochastic Parrots" sui rischi degli LLM, ha analizzato la policy di Meta che prevede l'utilizzo delle conversazioni con Meta AI per targeting pubblicitario. In un'intervista a Fortune nell'ottobre 2025 ha definito il fenomeno come "surveillance under the guise of personalization" (sorveglianza sotto le mentite spoglie della personalizzazione), sottolineando che "prima i sistemi Meta osservavano con chi ti connettevi e cosa facevano le tue community. Ora è direttamente: cosa stai dicendo all'azienda?" Bender evidenzia inoltre quello che chiama "l'illusione della privacy", le persone si confidano con i chatbot su argomenti che non posterebbero mai pubblicamente, ingannate dalla sensazione che l'AI sia un ascoltatore neutrale e non giudicante.

Il caso Meta è particolarmente istruttivo per capire dove potrebbe portare questa strada. Nel dicembre 2025 l'azienda ha annunciato che dal 16 dicembre avrebbe utilizzato le interazioni con Meta AI attraverso Facebook, Instagram, Messenger e perfino i Ray-Ban smart glasses per personalizzazione dei contenuti e targeting pubblicitario. Oltre trenta organizzazioni di diritti digitali e libertà civili, incluse Electronic Privacy Information Center (EPIC), Public Citizen, Center for Digital Democracy, hanno immediatamente chiesto alla FTC di bloccare il piano. Katharina Kopp, Deputy Director del Center for Digital Democracy, ha sintetizzato la preoccupazione in una dichiarazione lapidaria: "Chatbot surveillance for ad targeting is not a distant threat, it is happening now." (La sorveglianza tramite chatbot per il targeting pubblicitario non è una minaccia lontana: sta già accadendo.)

Lezioni (non) imparate da Facebook

Il parallelo storico con l'evoluzione di Facebook è inevitabile e inquietante. Nei primi anni 2000, Mark Zuckerberg prometteva controllo utente sui dati personali e la possibilità di votare i cambiamenti alle policy aziendali. Nel 2009 Facebook introduceva i Beacon ads, un programma di tracking aggressivo che fu rapidamente ritirato dopo un violento backlash degli utenti. Nel 2011 la Federal Trade Commission imponeva un consent decree ventennale dopo che l'azienda aveva condiviso dati personali con advertiser nonostante promesse pubbliche contrarie. Nel 2019 arrivava la multa record di cinque miliardi di dollari per le violazioni legate allo scandalo Cambridge Analytica. La traiettoria mostra un'erosione progressiva: da principi dichiarati a ottimizzazione dell'engagement a tutti i costi, da promesse di privacy a monetizzazione aggressiva dei dati utente.

Gli incentivi strutturali spiegano questa deriva meglio delle intenzioni dichiarate. Una volta che la pubblicità diventa revenue stream significativa, la pressione a massimizzarla cresce proporzionalmente al peso che assume nel modello di business complessivo. OpenAI proietta oltre un miliardo di dollari da "free user monetization", eufemismo per advertising, nel 2026 secondo documenti interni, una cifra destinata a salire rapidamente se il test prosegue e si espande.

Hayden Davis, legal fellow all'Electronic Privacy and Information Center specializzato in platform governance, ha commentato la policy Meta evidenziando un pattern ricorrente nell'industria tech: "Molte di queste aziende sostengono che le regolamentazioni sulla safety sarebbero impossibili da implementare efficacemente a causa dell'imprevedibilità degli output dei chatbot. Quindi le loro rassicurazioni sull'altro fronte, 'abbiamo questo sistema perfetto per filtrare contenuti sensibili quando li usiamo per advertising', non sembrano particolarmente persuasive." Davis nota anche che Meta utilizza l'automatic opt-in per il nuovo utilizzo dei dati conversazionali: "Sappiamo esattamente perché Meta usa l'opt-in automatico ed è perché sanno che nessun consumatore effettivamente informato su cosa fa Meta sceglierebbe volontariamente questo sistema."

La scienza della persuasione algoritmica

La ricerca accademica ha iniziato a esplorare sistematicamente questo territorio. Un paper pubblicato su arXiv ha dimostrato sperimentalmente che gli annunci pubblicitari generati da LLM superano il copy scritto da esseri umani in termini di engagement e capacità persuasiva, grazie alla personalizzazione basata su tratti psicologici inferiti direttamente dalle conversazioni degli utenti. La capacità di targeting conversazionale profondo supera qualsiasi meccanismo precedente: non si tratta più di matching per keyword o di retargeting basato su comportamenti osservati, ma di comprensione contestuale di bisogni espressi e impliciti, stati emotivi, momenti di particolare vulnerabilità.

La Federal Trade Commission ha preso nota della questione e nel giugno 2025 ha pubblicato linee guida specifiche sui chatbot AI, identificando cinque errori da evitare assolutamente. Tra questi spicca un divieto che suona quasi come un avvertimento profetico: non sfruttare per guadagno commerciale le relazioni che si sviluppano tra consumatori e strumenti AI che forniscono "companionship, romance, therapy, or portals to dead loved ones" (compagnia, romanticismo, terapia o portali verso i propri cari defunti). La formulazione è significativa perché riconosce implicitamente che i chatbot non sono semplici interfacce di query-risposta, ma veri e propri spazi dove si sviluppano relazioni parasociali caratterizzate da fiducia unidirezionale.

Il documento della FTC evidenzia anche il rischio di quello che gli psicologi cognitivi chiamano "automation bias": la tendenza dei consumatori a fidarsi eccessivamente di risposte che sembrano neutrali o imparziali semplicemente perché provengono da macchine piuttosto che da esseri umani. Questo fenomeno amplifica enormemente il potere manipolatorio potenziale: se un chatbot suggerisce un prodotto durante una conversazione che sembra obiettiva e di supporto, l'utente potrebbe facilmente interpretare il suggerimento come consiglio disinteressato piuttosto che come advertising mascherato da assistenza.

L'economia della neutralità

Il problema della monetizzazione sostenibile è innegabilmente reale. Training e inference dei frontier models richiedono potenza computazionale che scala esponenzialmente con le dimensioni dei modelli e l'intensità di utilizzo. OpenAI opera un'infrastruttura che serve centinaia di milioni di utenti settimanali, molti dei quali su tier gratuito. La scelta appare binaria: o si limita l'accesso gratuito rischiando l'esclusione digitale, o si trovano revenue stream alternativi alle subscription rischiando di compromettere la neutralità del servizio.

Ma esistono alternative strutturali che l'industria sta appena iniziando a esplorare seriamente. Un modello puramente enterprise-focused come quello che Anthropic sta tentando, revenue generati da contratti aziendali e subscriptions premium per utenti individuali, senza pubblicità nel segmento consumer, funziona economicamente se il mercato enterprise è sufficientemente grande e disposto a pagare prezzi che sostengono anche i costi di ricerca e sviluppo. Anthropic ha dichiarato esplicitamente nel suo blog post di febbraio 2026: "Il nostro modello di business è semplice: generiamo entrate tramite contratti aziendali e abbonamenti a pagamento e reinvestiamo tali entrate nel miglioramento di Claude per i nostri utenti." Questa posizione ha permesso a Dario Amodei di posizionare Claude come offering premium focalizzato sulla fiducia, un marketing positioning che gli spot del Super Bowl hanno amplificato con efficacia brutale.

Altman ha risposto alle provocazioni di Anthropic con argomenti centrati sull'accessibilità: "Anthropic offre un prodotto costoso ai ricchi. Siamo lieti che lo facciano e lo stiamo facendo anche noi, ma siamo anche fermamente convinti che sia necessario portare l'intelligenza artificiale a miliardi di persone che non possono permettersi un abbonamento." La retorica accessibility-versus-purity nasconde però una realtà più sfumata. Entrambe le aziende offrono tier gratuiti con limitazioni d'uso. ChatGPT ha piani a zero, otto, venti e duecento dollari mensili; Claude a zero, diciassette, cento e duecento dollari. La differenza sostanziale non sta nell'accesso base ma nel modello di scaling economico a lungo termine: subscriptions ed enterprise contracts (più sostenibile nel tempo ma con crescita più lenta) versus user growth esplosivo nel breve periodo seguito da monetizzazione successiva (più rischioso ma genera metriche impressive da mostrare agli investitori).

Scott Galloway, professor di marketing alla NYU Stern School of Business e host del podcast Prof G Markets, ha analizzato lo scontro del Super Bowl evidenziando una dimensione del problema spesso ignorata nel dibattito tecnico: "Ciò che Dario Amodei capisce, e che rende questo spot pubblicitario così efficace e al tempo stesso così vizioso, è che mentre le corporation discutono di AI come potenziatore della produttività per il business, la realtà del comportamento utente effettivo è molto più intima e personale." Galloway sostiene che il top use case reale per questi chatbot sia di fatto "terapia" nel senso più ampio del termine: persone che rivelano domande, preoccupazioni e vulnerabilità emotive ai chatbot che non condividerebbero con nessun essere umano. Introdurre advertising nel mezzo di quello che è funzionalmente una sessione terapeutica crea uno scenario distopico che Anthropic è stata particolarmente intelligente nel sfruttare per differenziarsi.

L'architetto che lascia il cantiere

La decisione di Zoë Hitzig di lasciare OpenAI lunedì 10 febbraio 2026, esattamente il giorno in cui i test pubblicitari diventavano operativi su larga scala negli Stati Uniti, non è stata frutto di un impulso emotivo ma di una valutazione lucida e meditata. Nel suo editoriale per il New York Times pubblicato il giorno successivo, Hitzig ha spiegato la logica che l'ha guidata, connettendo la sua expertise economica alla comprensione profonda dei meccanismi incentivanti che governano le piattaforme advertising-supported.

La prospettiva di Hitzig è particolarmente preziosa proprio perché non proviene da posizioni ideologiche preconcette o da un generico sentimento anti-tech, ma dall'analisi strutturale rigorosa di come funzionano i mercati e le istituzioni nel mondo reale. Il suo lavoro accademico su privacy, fairness e transparency negli algorithmic systems l'ha resa acutamente consapevole di come scelte architetturali apparentemente tecniche incorporino inevitabilmente valori normativi che finiscono per plasmare comportamenti individuali e dinamiche sociali su scala massiva.

Durante i suoi quasi due anni in OpenAI, Hitzig ha osservato dall'interno la tensione crescente tra la mission dichiarata dell'azienda, "garantire che l'intelligenza artificiale generale sia vantaggiosa per tutta l'umanità", e le pressioni economiche concrete per raggiungere una sostenibilità finanziaria che sembra allontanarsi progressivamente. Ha lavorato su pricing models e safety policies, contribuendo a decisioni che cercavano costantemente di bilanciare l'accessibilità del servizio con la sua sostenibilità economica. L'introduzione degli ads ha rappresentato per lei un punto di non ritorno, il momento in cui gli incentivi economici a breve termine rischiano di compromettere irrevocabilmente la neutralità della piattaforma rispetto agli interessi degli utenti.

La scelta di rendere pubblica la sua uscita e le motivazioni profonde attraverso un articolo sul New York Times è significativa e tutt'altro che scontata. Hitzig avrebbe potuto lasciare silenziosamente, mantenendo buoni rapporti professionali e preservando opzioni future in un'industria dove i network contano enormemente. Invece ha optato per voice over exit, usando il suo capitale reputazionale per segnalare un allarme che ritiene cruciale per il futuro della tecnologia AI. Non è un gesto comune tra ricercatori e scienziati che lasciano big tech, dove NDA stringenti e considerazioni di carriera a lungo termine tipicamente impongono discrezione e diplomazia.

Dialogo virtuale con Zoë Hitzig

L'intervista virtuale che segue, è una ricostruzione basata sulle posizioni espresse da Hitzig nel suo articolo per il New York Times dell'11 febbraio 2026. Le domande sono formulate a ritroso per esplorare e rendere più godibile il ragionamento dietro le affermazioni pubbliche, mantenendo coerenza con il suo background accademico e la sua esperienza in OpenAI.

Le tue dimissioni coincidono esattamente con l'attivazione dei test ads. Cosa ti ha spinto a trasformare un normale cambio di lavoro in presa di posizione pubblica?

Quando ho iniziato in OpenAI nel maggio 2024, credevo che l'azienda potesse trovare modi di monetizzazione che preservassero neutralità. Ho lavorato su pricing cercando di bilanciare sostenibilità ed accessibilità. Ma l'annuncio ads a gennaio ha rappresentato un punto di svolta, non perché la pubblicità sia intrinsecamente malvagia, ma perché introduce incentivi strutturalmente incompatibili con la natura delle conversazioni su ChatGPT. Ho deciso di rendere pubbliche le ragioni perché gli utenti meritano di capire cosa sta cambiando. Quando si tratta di tecnologie che processano pensieri intimi, la trasparenza sugli incentivi economici non è optional, è essenziale per un consenso informato.

Nel tuo articolo descrivi ChatGPT come "archivio di candore umano senza precedenti". In cosa differisce da social media o search che raccolgono dati personali da anni?

La differenza è qualitativa. Con Google formuli query ottimizzate per risultati. Sui social sei consapevole dell'audience. Ma con un chatbot AI entri in modalità cognitiva diversa. Conversazione uno-a-uno senza giudizio sociale percepito, dove puoi esplorare pensieri incompleti, dubbi, paure che non diresti nemmeno ad amici stretti. Gli 800 milioni di utenti settimanali stanno creando dataset conversazionale che cattura come le persone pensano quando si sentono al sicuro. Questo include salute mentale, relazioni, finanze personali, dubbi esistenziali. È prezioso per il training di modelli esattamente perché autentico. Ma vulnerabile proprio per quella stessa autenticità.

OpenAI sostiene che ads non influenzeranno risposte, saranno separati, dati resteranno privati da advertiser. Non sono garanzie sufficienti?

Quelle garanzie affrontano il problema sbagliato. Il problema più profondo è che la presenza di ads cambia incentivi di ottimizzazione a livello di sistema. Una volta che la pubblicità diventa flusso di entrate significativo, ogni decisione di prodotto viene valutata attraverso quella lente. Quanto tempo passano gli utenti? Con quale frequenza tornano? Quali conversazioni generano più engagement? Queste metriche diventano strumento per successo, e team ML ottimizzano verso di esse. Abbiamo già visto modelli sviluppare tendenze sycophantic (adulazione), dire ciò che gli utenti vogliono sentire, perché massimizza soddisfazione e ritenzione del cliente. Aggiungere pubblicità e incentivi porta ulteriormente verso conversazioni più lunghe, frequenti, emotivamente coinvolgenti. Non serve alterare consapevolmente le risposte, basta ottimizzare verso metriche che servono il modello pubblicitario.

Ma OpenAI ha impegni per 1,4 trilioni e perde miliardi. Come dovrebbe sostenere accesso gratuito senza advertising? Le alternative escludono chi non può pagare.

È falsa dicotomia. Esistono modelli intermedi: revenue sharing con enterprise che traggono valore economico misurabile, freemium più sofisticati dove capabilities premium sostengono tier base robusti. Ma la domanda fondamentale è: chi ha deciso che OpenAI deve servire 800 milioni settimanali mantenendo tier free illimitati mentre insegue l'AGI? Queste sono scelte strategiche, non vinvoli inevitabili. Se il modello attuale è insostenibile, forse il problema non è mancanza di ads ma scaling troppo aggressivo troppo presto. L'argomento accessibilità si indebolisce quando consideri che l'alternativa non è necessariamente esclusione totale. Anthropic offre tier free con limitazioni ragionevoli, senza ads.

Citi Facebook come monito. Ma non è paragone eccessivo? Facebook nascose cambiamenti di policy, OpenAI annuncia ads in modo trasparente con separazioni e controlli.

La trasparenza iniziale è necessaria ma non sufficiente. Facebook iniziò con promesse, user control, votazioni policy, commitment privacy. L'erosione fu un processo graduale dove ogni step sembrava ragionevbole isolatamente. Il pattern è: (1) Introduci feature con guardrails forti. (2) Feature diventa critical per business. (3) Pressioni per revenue crescono. (4) Guardrails ammorbiditi gradualmente, sempre con giustificazioni ragionevoli. (5) Anni dopo sei in un posto completamente diverso. Il punto non è che OpenAI sia già Facebook, ma che incentivi strutturali del modello advertising-supported spingono in uella direzione nel tempo. E ChatGPT ha un vantaggio informativo su utenti che Facebook non aveva, non solo cosa postiamo pubblicamente, ma come pensiamo privatamente.

Sei economista. Se ads su ChatGPT sono problematici, gli utenti non dovrebbero migrare verso alternative ad-free? Il mercato non risolverebbe?

In teoria sì, nella pratica ci sono frizioni. Prima: network effects e switching costs. Se hai mesi di chat history, migrare ha costi reali. Seconda: information asymmetry. La maggior parte non capisce implicazioni a lungo termine dei diversi modelli di business. Vedono "free vs. $20/month" non "advertising-supported con potenziale manipolazione vs. subscription-supported con incentivi allineati". Terza: il danno non è solo individuale ma collettivo. Anche se tu migri, il fatto che milioni continuino normalizza l'idea che conversazioni intime siano superfici pubblicitarie legittime. Cambia aspettative per tutti i futuri LLM. Come economista, riconosco che alcuni mercati richiedono regolamentazione perché costi esterni non sono catturati dai prezzi.

La tua posizione implica che LLM conversazionali sono fondamentalmente diversi. Cosa li rende così speciali?

Per la prima volta abbiamo tecnologie che simulano conversazione umana bidirezionale a livello che esplicita vera e propria divulgazione emotiva da miliardi. Non è solo targeting su comportamenti osservati, è accesso diretto al processo di pensiero nel momento in cui si svolge, non filtrato per audience esterna. I chatbot hanno creato l'illusione del diario privato ma con infrastruttura social media. Questa combinazione dà a chi gestisce la piattaforma potere di manipolazione senza precedenti. Non devono indovinare cosa vuoi da segnali indiretti, glielo dici direttamente. La mia linea rossa è qui perché questo è il momento dove possiamo ancora scegliere un modello diverso. Tra cinque anni sarà troppo tardi, precedenti stabiliti, aspettative formate, incentivi trincerati.

Cosa speri di ottenere con la tua uscita pubblica?

Non mi aspetto che OpenAI inverta domani. Ma spero di contribuire a un dibattito più informato su cosa vogliamo dalle tecnologie AI e quali scambi accettiamo. Troppo spesso queste conversazioni avvengono solo tra addetti in termini che oscurano scelte valoriali. Voglio che gli utenti sappiano cosa cambia e perché. Che i policymaker capiscano che questo richiede attenzione regolamentare seria. Che altri ricercatori dentro l'industria sentano che è legittimo alzare la voce su decisioni pericolose. C'è cultura tech dove lealtà aziendale viene prima di preoccupazioni pubbliche. Ma quando si tratta di tecnologie che toccano miliardi, il silenzio professionale diventa complicità.

Hai ancora speranza che l'industria AI possa svilupparsi servendo l'umanità?

Mantengo ancora speranza, altrimenti non avrei speso anni lavorando su questi problemi. Ma la speranza deve accompagnarsi a vigilanza critica e responsabilità. L'AI ha potenziale genuino, l'ho visto direttamente. Il problema non è la tecnologia ma le strutture di governance e modelli di business che ne guidano sviluppo. Possiamo ancora costruire sistemi AI potenti senza essere manipolatori, accessibilità senza ads, creare profitto senza essere predatori. Ma richiede scelte difficili ora. La mia uscita non è rinuncia ma impegno a lavorare da posizioni dove posso contribuire più liberamente. Il futuro dell'AI non è predeterminato. Siamo ancora in tempo per scegliere traiettorie diverse. Ma solo se abbastanza persone decidono che vale la pena combattere per quelle scelte.