Cyborg, Centauri o Automi: come usi l'AI rivela chi diventerai

Immaginate un consulente del Boston Consulting Group, pagato profumatamente per il suo acume strategico, che di fronte a un caso aziendale critico copia e incolla l'intero problema in ChatGPT e accetta la raccomandazione dell'AI senza fare una sola domanda. La risposta era sbagliata. Eppure questo professionista ha consegnato il memo al CEO senza battere ciglio. Non si tratta di un caso isolato: in uno studio condotto da ricercatori di Harvard e MIT su 244 consulenti BCG, il 27% ha fatto esattamente questo, delegando completamente il ragionamento alla macchina.

La contraddizione è stridente. Questi non erano stagisti svogliati ma professionisti qualificati che sapevano di essere valutati. Avevano accesso allo stesso strumento, gli stessi dati, lo stesso compito. Eppure hanno prodotto tre pattern completamente diversi di collaborazione con l'intelligenza artificiale generativa, con conseguenze radicalmente opposte sul loro sviluppo professionale. La domanda che emerge dallo studio non è se usare l'AI, ma come. E la risposta a quel "come" sta ridisegnando silenziosamente il confine tra expertise umana e capacità della macchina.

Tre tribù, un solo strumento

Il working paper firmato da Steven Randazzo, Katherine Kellogg, Hila Lifshitz, François Candelon, Fabrizio Dell'Acqua, Ethan Mollick e Karim Lakhani si intitola "Cyborgs, Centaurs and Self-Automators" e rappresenta un'evoluzione naturale della ricerca che nel 2023 aveva introdotto il concetto di "jagged frontier" dell'AI. Quella prima indagine aveva rivelato come le capacità di GPT-4 fossero irregolari, eccellenti in certi compiti e sorprendentemente fragili in altri. Questo nuovo studio va oltre, spostando il focus da cosa l'AI può fare a come gli esseri umani scelgono di integrarla nel loro flusso di lavoro.

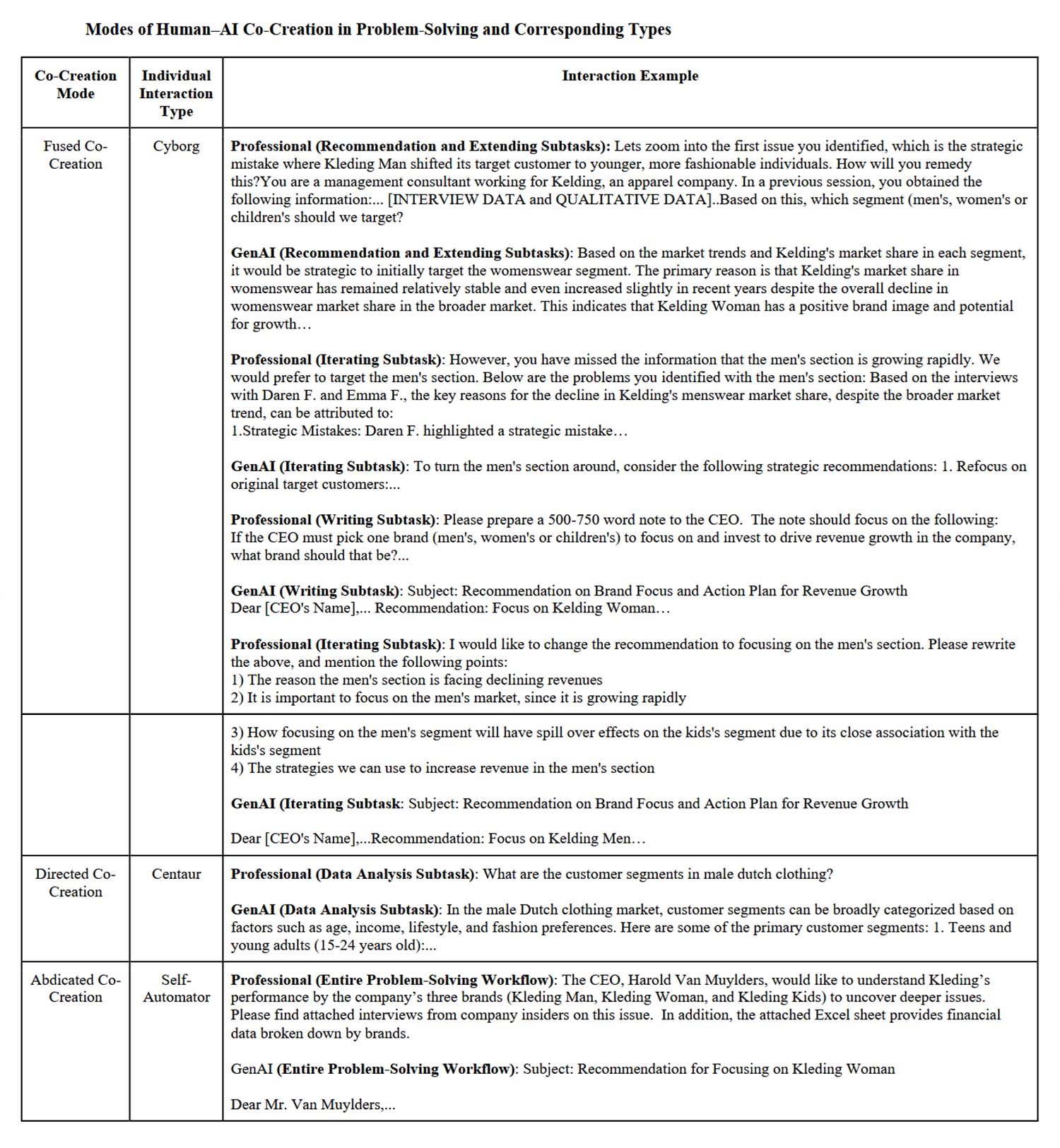

I ricercatori hanno costruito una piattaforma personalizzata basata su GPT-4 per tracciare ogni singola interazione: 4.975 scambi tra professionisti e macchina, tutti registrati con timestamp. Il compito assegnato replicava un classico caso di consulenza strategica, analizzare tre brand di abbigliamento di un'azienda fittizia e raccomandare su quale investire per massimizzare la crescita. I partecipanti avevano trascrizioni di interviste con executive, dati finanziari storici, informazioni di mercato. Materiale denso, ambiguo, proprio come nella realtà.

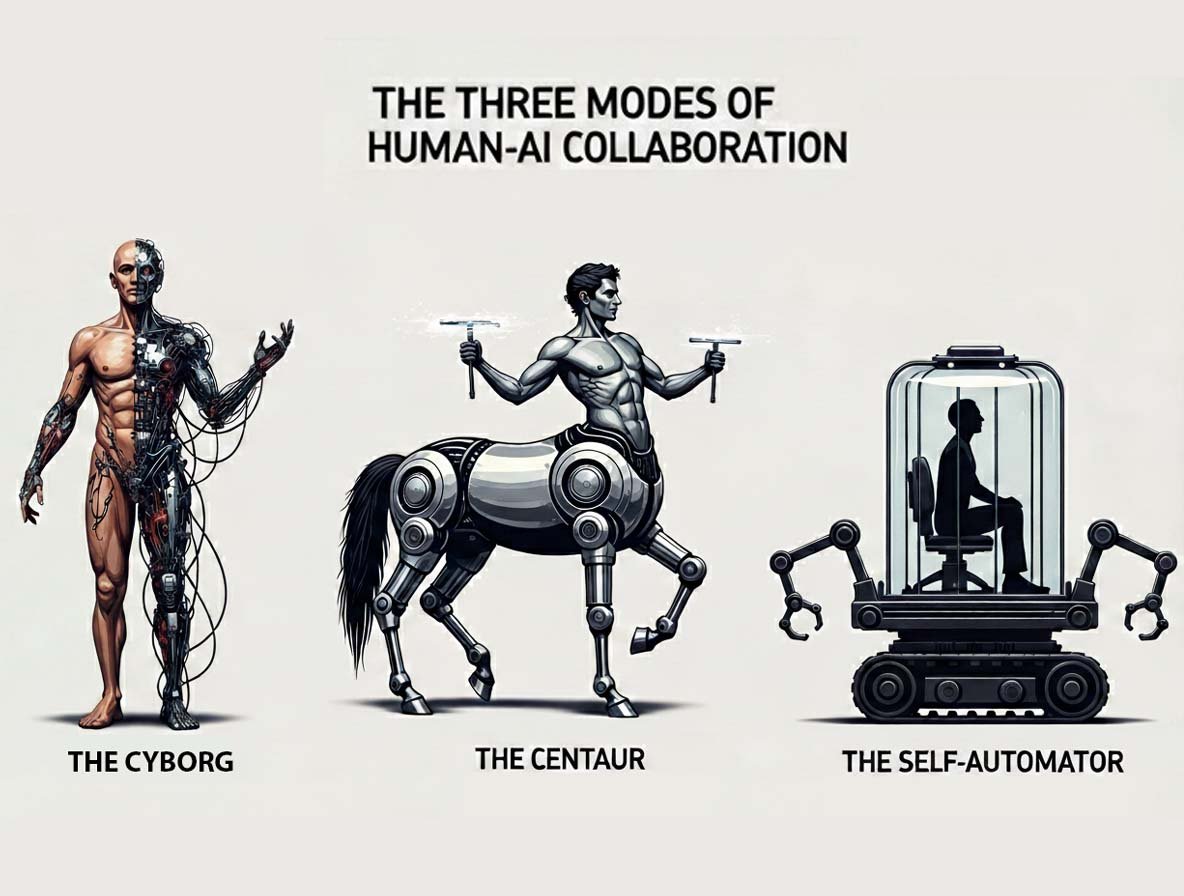

Quello che è emerso dall'analisi dei pattern di interazione ha sorpreso gli stessi ricercatori. Non c'era un unico modo di lavorare con l'AI generativa, ma tre modalità distinte che gli autori hanno battezzato con nomi evocativi presi in prestito dalla mitologia e dalla fantascienza. Il 60% dei consulenti si è comportato come "Cyborg", fondendo continuamente il proprio ragionamento con quello della macchina in un dialogo serrato e iterativo. Il 14% ha agito da "Centauri", mantenendo saldamente il controllo strategico e usando l'AI in modo selettivo per compiti specifici. Il restante 27% si è trasformato in "Self-Automator", affidando all'AI sia la definizione del problema che la sua esecuzione.

La scelta del nome Centauro non è casuale. Come la creatura mitologica che unisce intelligenza umana e forza equina mantenendole distinte, questi professionisti tengono separati i domini di competenza, decidono loro cosa fare e come farlo, delegando all'AI solo task circoscritti. I Cyborg invece, in una fusione che ricorda più Ghost in the Shell che Matrix, lavorano in simbiosi continua con la macchina, senza confini netti tra dove finisce il pensiero umano e dove inizia quello algoritmico.

La frontiera frastagliata dell'expertise

Per capire davvero cosa distingue queste tre tribù bisogna scendere nel dettaglio delle conversazioni. I Cyborg hanno sviluppato un repertorio sofisticato di pratiche interattive. Assegnano alla macchina un ruolo, un personaggio, "Immagina di essere un consulente senior specializzato in retail", per orientarne le risposte. Poi spezzano i problemi complessi in sotto-task più gestibili, quella che i ricercatori chiamano "modularizzazione" e che nel gergo tecnico è nota come chain-of-thought prompting. Non si fidano ciecamente: chiedono all'AI di verificare il proprio lavoro, di giustificare le sue conclusioni, la sfidano quando trovano contraddizioni.

Un esempio concreto dallo studio. Un consulente riceve da GPT-4 la raccomandazione di investire sul brand femminile. Ma qualcosa non quadra. Aggiunge dati di mercato che mostrano una crescita del 72% nel segmento maschile e chiede, "Questo cambia la tua raccomandazione?". L'AI rivaluta e suggerisce di considerare anche il brand maschile. Il consulente insiste, espone incongruenze nei tassi di crescita, spinge indietro. Dopo diversi round, emerge la risposta corretta. Questo non è un semplice uso dell'AI, è una danza cognitiva.

I Centauri invece lavorano in modo radicalmente diverso. Usano l'AI principalmente per tre scopi, mappare il dominio del problema chiedendo informazioni generali tipo "Quali sono i trend chiave nel menswear?", raccogliere informazioni metodologiche come "Qual è la formula Excel per calcolare il CAGR?", e rifinire contenuti che hanno già scritto loro. Un consulente Centauro fa i calcoli da solo in Excel dopo aver chiesto la formula all'AI. Scrive le sue conclusioni e poi chiede, "Puoi revisionare questo testo per chiarezza e concisione?". Il controllo non viene mai ceduto.

Gli Self-Automator sono l'estremo opposto. In alcuni casi hanno completato l'intero task con una o due interazioni. Copiano l'intera traccia del problema, tutte le interviste, tutte le tabelle finanziarie in un unico prompt mastodontico. GPT-4 risponde con analisi, raccomandazione, strategie innovative e memo finale. Loro accettano, magari facendo qualche ritocco editoriale superficiale, "Riduci a 400 parole" o "Togli i virgolettati diretti". Fine. Nessuna validazione, nessuna iterazione sul merito.

Chi impara cosa (e chi non impara niente)

Le implicazioni per lo sviluppo professionale sono drastiche. I ricercatori hanno identificato tre diverse traiettorie di apprendimento che chiamano upskilling, newskilling e no skilling. I Cyborg sviluppano quella che lo studio definisce expertise AI-related, imparano a orchestrare la macchina con precisione crescente. Una consulente intervistata racconta, "Prima facevo una domanda e prendevo la risposta come punto di partenza. Ora so che posso continuare a scavare, fare domande di follow-up, spingere più a fondo". Stanno acquisendo una nuova competenza meta-cognitiva, la capacità di collaborare efficacemente con sistemi generativi.

Ma attenzione, i Cyborg non stanno abbandonando la loro expertise di dominio. Al contrario, la mantengono attiva proprio perché devono continuamente valutare, correggere, integrare ciò che l'AI produce. Quando un Cyborg espone una contraddizione fattuale nell'output di GPT-4, sta esercitando il suo giudizio professionale. Quando chiede all'AI di ricalcolare dopo aver aggiunto nuovi dati, sta guidando l'analisi con la sua comprensione del contesto.

I Centauri invece sviluppano upskilling classico, approfondiscono la loro competenza nel dominio specifico. Un consulente racconta di usare ChatGPT come "servizio one-stop" per accelerare l'apprendimento su nuovi settori, chiedendo esempi di aziende che hanno affrontato sfide simili, studiando casi concreti, usando l'AI come una versione potenziata di Google che non solo trova informazioni ma le sintetizza e le contestualizza. Il loro rapporto con la macchina è strumentale, un mezzo per diventare migliori nel loro lavoro, non per trasformarlo.

Gli Self-Automator però sono la storia più inquietante. Lo studio è lapidario, "no skilling", nessuno sviluppo né di competenze AI né di competenze di dominio. Il minimo scambio di informazioni, la mancanza di iterazione, la delega totale del decision-making producono una stagnazione professionale. Come Bartleby lo scrivano di Melville che risponde solo "preferirei di no", questi professionisti hanno preferito non pensare, delegando alla macchina anche il processo di apprendimento che deriva dallo sforzo cognitivo.

Le trappole della delega totale

C'è un elemento controintuitivo nei risultati sulla qualità degli output. I Centauri hanno prodotto le raccomandazioni più accurate, superando sia i Cyborg che gli Self-Automator. Questo solleva domande profonde sul rapporto tra collaborazione intensa e performance. Perché i Cyborg, che pure interagiscono continuamente con l'AI, non ottengono i risultati migliori?

La risposta sta in quello che Ethan Mollick chiama il problema della "jagged frontier". Le capacità di GPT-4 sono eccellenti in certi task ma fragili in altri, e i confini sono imprevedibili. I Cyborg, lavorando in simbiosi costante, rischiano di fidarsi troppo della macchina anche quando questa sta operando fuori dalla sua zona di forza. Un consulente Cyborg dello studio usa la pratica della "validazione", chiede esplicitamente all'AI di verificare il proprio lavoro. GPT-4 conferma la raccomandazione sbagliata con argomentazioni plausibili. Il consulente, convinto dalla apparente coerenza logica, accetta. Ha usato una best practice, ma la macchina lo ha comunque ingannato.

I Centauri evitano questa trappola perché mantengono sempre attiva la loro lente critica. Non chiedono mai all'AI di prendere decisioni strategiche, solo di supportare la loro analisi. Quando un Centauro chiede "Come posso riposizionare il prezzo per attrarre un target maschile più giovane?", sta cercando stimoli, non risposte definitive. Il giudizio finale resta umano.

Gli Self-Automator invece rappresentano il rischio più evidente, l'erosione dell'expertise attraverso il disuso. Come i muscoli che si atrofizzano senza esercizio, le capacità di problem-solving si deteriorano quando vengono sistematicamente delegate. E qui emerge un pattern preoccupante dallo studio. Molti Self-Automator nelle interviste hanno espresso piena fiducia nell'AI. Uno dice, "Ho fatto un quick sanity check per verificare che i dati e la raccomandazione non fossero troppo lontani dalla realtà". Un altro ammette candidamente, "Ero pigro francamente. Non volevo scrivere 500 parole, volevo che GenAI le producesse".

La pigrizia cognitiva mascherata da efficienza è forse il segnale più allarmante. Perché questi erano professionisti che sapevano di essere valutati, che avevano un incentivo esplicito a performare bene. Cosa succederà quando l'uso quotidiano dell'AI non sarà tracciato, quando la pressione sarà solo quella di chiudere velocemente una consegna?

Tu che utente AI sei?

Lo studio solleva domande che vanno ben oltre il caso specifico della consulenza. Se tre modalità così diverse emergono spontaneamente in un gruppo omogeneo di professionisti qualificati che affrontano lo stesso task, cosa succederà quando l'AI generativa penetrerà in professioni con dinamiche epistemiche diverse? Un avvocato che deve costruire un'argomentazione legale, un medico che deve formulare una diagnosi differenziale, un architetto che deve bilanciare estetica e vincoli strutturali, ciascuno di loro potrebbe sviluppare varianti uniche di questi pattern.

I ricercatori sono cauti nell'estendere troppo i risultati. Lo studio ha catturato un'istantanea di una singola sessione con GPT-4 dell'aprile 2023, un modello che oggi è già superato. Non sappiamo come questi pattern evolvono nel tempo, se qualcuno che inizia come Self-Automator può diventare Cyborg con l'esperienza, o se viceversa l'uso prolungato porta inevitabilmente verso l'automazione per comodità. E c'è un quadrante del loro framework teorico che è rimasto empiricamente vuoto, quello dove l'AI seleziona cosa fare ma l'umano esegue. Forse quella configurazione è semplicemente instabile, forse rappresenta un futuro ancora da esplorare.

C'è poi il tema degli AI agentici, sistemi che non aspettano prompt ma agiscono autonomamente per completare workflow complessi. Quando l'AI non sarà più un partner conversazionale ma un agente proattivo, le tre modalità identificate dallo studio potrebbero collassare o trasformarsi in qualcosa di radicalmente diverso. La distinzione tra Cyborg e Self-Automator ha senso solo finché c'è un loop interattivo da mantenere o abdicare.

Le implicazioni organizzative sono altrettanto profonde. Se i Centauri producono gli output più accurati ma i Cyborg sviluppano nuove competenze AI, quale modalità dovrebbe promuovere un'azienda? La risposta dipende dagli obiettivi strategici. Un'organizzazione focalizzata sulla qualità immediata del servizio favorirà i Centauri. Una che punta a costruire capacità interne di AI orchestration investirà sui Cyborg. E gli Self-Automator? Lo studio suggerisce che l'automazione completa ha senso per task routinari o quando il tempo è critico, ma i rischi di dequalificazione vanno pesati attentamente rispetto al contesto.

Quello che è certo è che non possiamo più trattare "l'uso dell'AI" come una categoria monolitica. La domanda rilevante per il futuro del lavoro cognitivo non è "usi l'AI?", ma "come la usi?". E quella scelta, spesso inconsapevole, sta già scrivendo il copione di chi diventerai professionalmente nei prossimi anni. Sei un Cyborg che sta imparando a danzare con la macchina, un Centauro che mantiene saldo il controllo, o uno Self-Automator che preferisce delegare? La risposta potrebbe essere diversa da task a task, da giornata a giornata. Ma riconoscere il pattern è il primo passo per sceglierlo consapevolmente invece che subirlo.