Mistral Devstral 2 e il sogno sovranista dell'Europa nell'AI

Il nove dicembre 2025, mentre il mondo dell'intelligenza artificiale guardava alla sfida tra Stati Uniti e Cina, Mistral AI ha giocato la sua carta: Devstral 2, un modello da 123 miliardi di parametri pensato per il coding enterprise. Non è solo l'ennesimo rilascio di un large language model, ma il tentativo più ambizioso dell'Europa di dimostrare che la partita globale dell'AI non è ancora chiusa. Mentre Washington mette sul piatto i giganteschi budget di OpenAI e Mountain View, e mentre Pechino risponde con l'offensive di Kimi K2 e DeepSeek, la startup francese fondata da ex ricercatori di Google DeepMind e Meta prova a costruire una terza via: modelli potenti ma compatti, open-weight ma commercialmente sostenibili, europei per DNA ma globali nelle ambizioni.

La domanda è se questo approccio possa davvero funzionare o se rappresenti l'ennesimo pio desiderio di un continente che rischia di restare spettatore nella rivoluzione tecnologica più importante del secolo. Devstral 2 arriva in un momento particolare: l'Europa ha regole chiare con l'AI Act, ha finanziamenti consistenti attraverso Horizon Europe e French Tech, ha talento tecnico di primissimo livello. Ma continua a dipendere strutturalmente dall'hardware NVIDIA per l'addestramento e l'inferenza, vede i suoi migliori cervelli emigrare verso Silicon Valley, e fatica a creare campioni che possano competere con i bilanci miliardari dei giganti americani. Mistral, valutata 11,7 miliardi di euro dopo il round Series C guidato da ASML, è diventata il simbolo di questa contraddizione: tecnicamente brillante, finanziariamente solida per gli standard europei, ma microscopica se confrontata con i suoi avversari oltreoceano.

Numeri da code whisperer

Partiamo dai dati tecnici, perché è da lì che si misurano le ambizioni. Devstral 2 è un dense transformer da 123 miliardi di parametri con una context window di 256mila token, una dimensione che permette di elaborare intere codebase senza perdere il filo del discorso. L'architettura dense, a differenza dei mixture-of-experts che dividono il carico computazionale tra sottoreti specializzate, attiva tutti i parametri per ogni richiesta. Una scelta che sacrifica l'efficienza computazionale per massimizzare la coerenza nelle risposte, particolarmente critica quando si lavora su progetti software complessi dove ogni pezzo di codice deve dialogare con il resto.

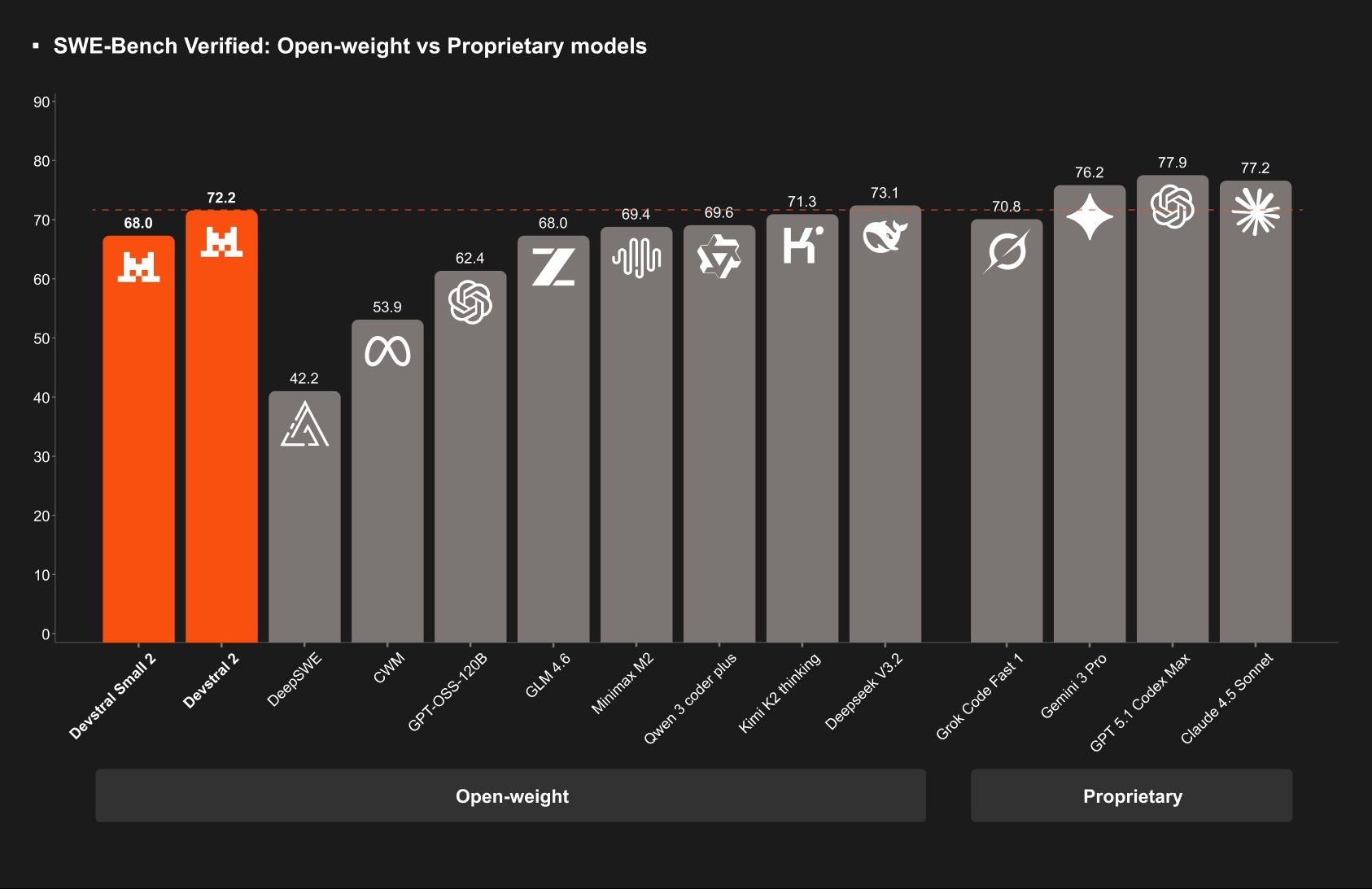

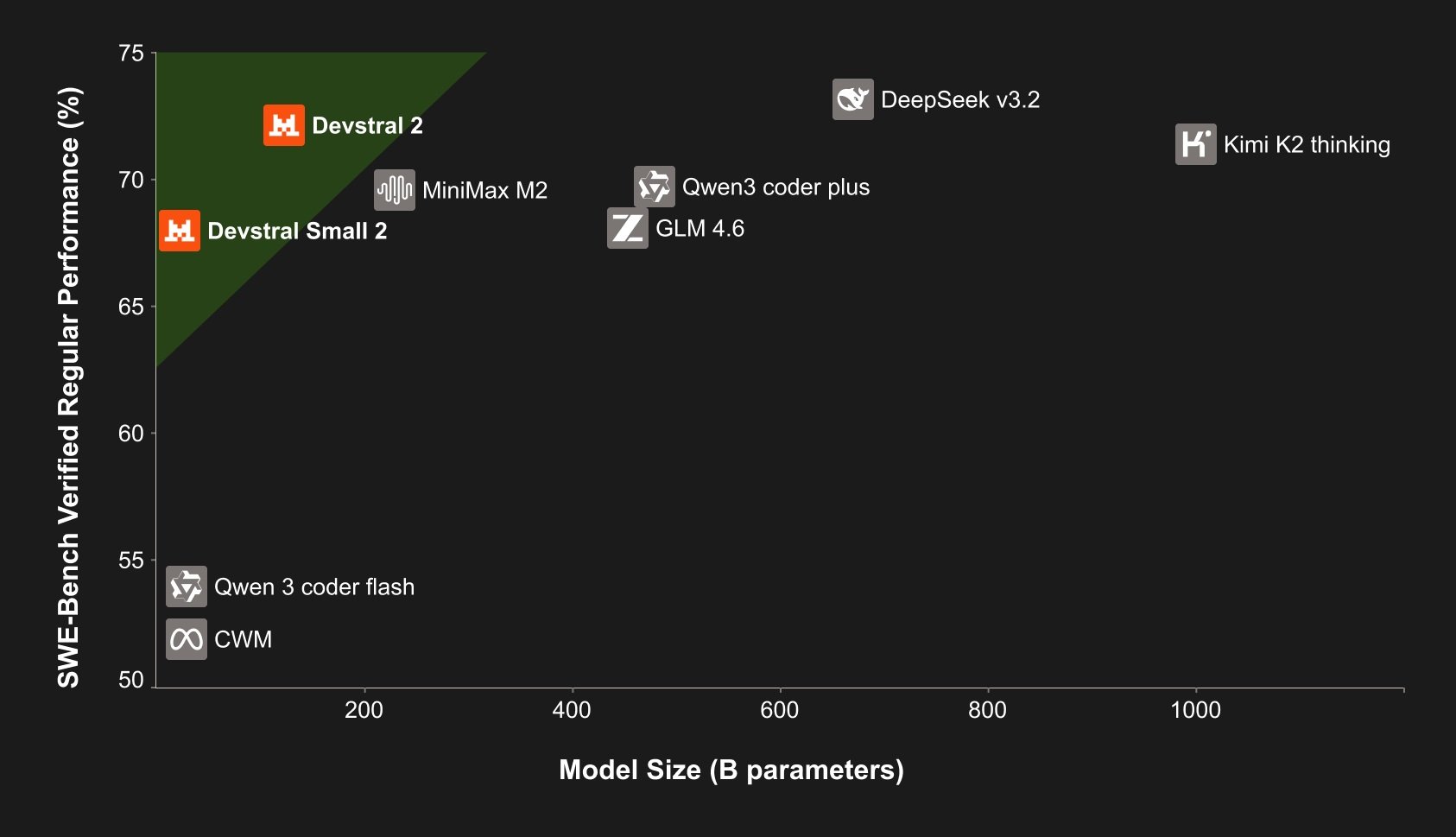

Il benchmark chiave per i coding models è SWE-bench Verified, un test che misura la capacità di risolvere issue reali estratte da repository GitHub. Devstral 2 raggiunge il 72,2%, un risultato che lo posiziona come migliore modello open-weight disponibile. Per contestualizzare: DeepSeek V3.2, il campione cinese da 671 miliardi di parametri, tocca il 73,1%, mentre Kimi K2 Thinking, con i suoi 1000 miliardi di parametri distribuiti in architettura mixture-of-experts, arriva al 71,3%. Devstral 2 è cinque volte più piccolo di DeepSeek e otto volte più compatto di Kimi K2, eppure li tallona da vicino o addirittura li supera. È come vedere una Lotus Elise tenere il passo di una Ferrari Enzo nei curvoni: conta il rapporto peso-potenza, non solo i cavalli sotto il cofano.

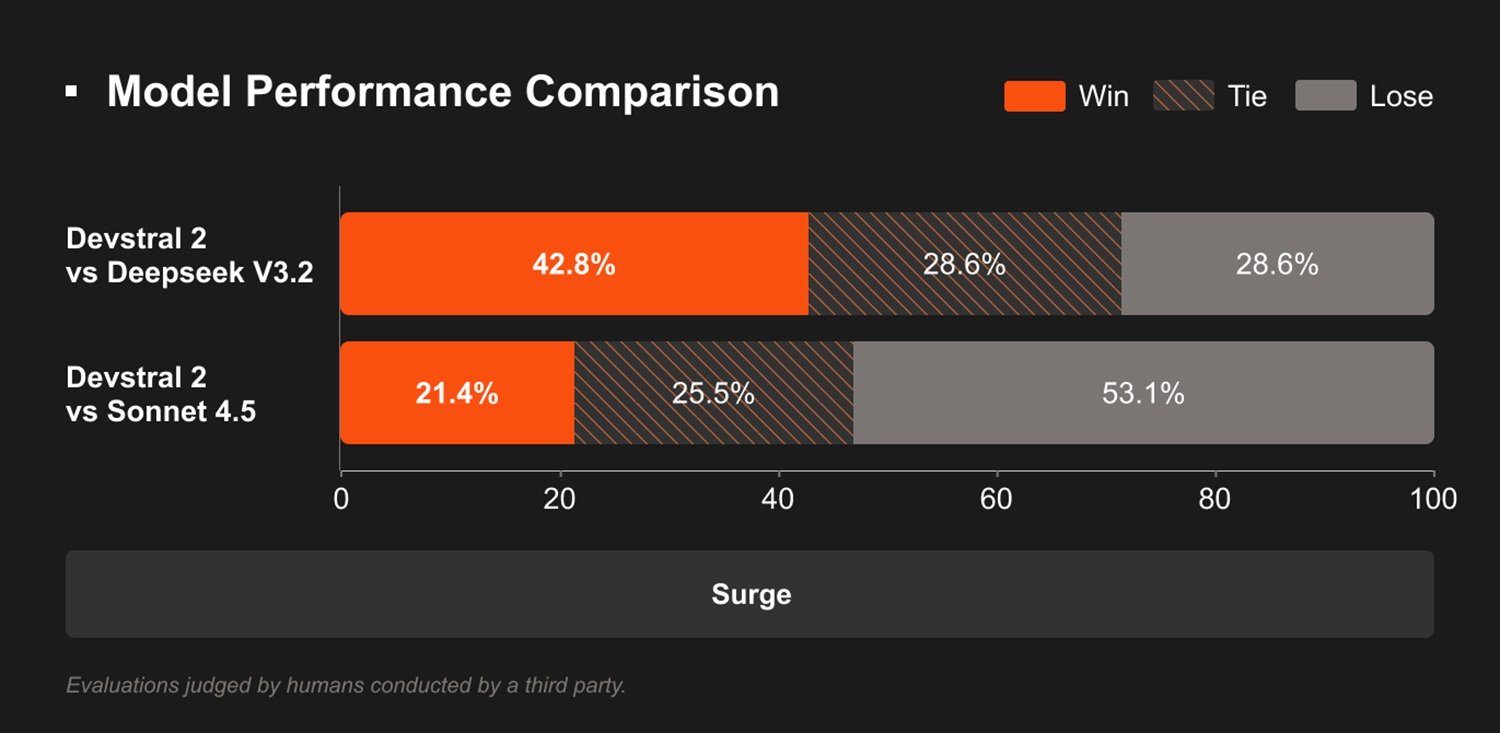

Ma c'è un gap da riconoscere onestamente: Claude Sonnet 4.5 di Anthropic raggiunge il 77,2% su SWE-bench Verified, mentre i sistemi più avanzati di OpenAI (GPT 5.1 Codex Max) toccano il 77,9%. La distanza tra Devstral 2 e i campioni proprietari americani esiste e non è marginale. Mistral stessa lo ammette nelle valutazioni umane comparative condotte attraverso Cline, dove Devstral 2 batte DeepSeek V3.2 con un 42,8% di preferenza contro il 28,6%, ma perde nettamente contro Claude Sonnet 4.5. L'Europa può produrre modelli competitivi, ma la frontiera assoluta resta, per ora, appannaggio dei closed-source americani.

Accanto al flagship, Mistral rilascia anche Devstral Small 2, un modello da 24 miliardi di parametri che raggiunge il 68% su SWE-bench Verified. L'interesse qui non è tanto nelle performance assolute, quanto nella deployabilità: Small 2 gira su una singola GPU consumer di fascia alta, rendendo l'AI coding accessibile anche a sviluppatori e piccole aziende che non possono permettersi cluster di H100. È lo stesso principio che ha reso Linux un successo: portare capacità enterprise su hardware commodity. Su benchmark più standard come HumanEval e LiveCodeBench, Devstral 2 si comporta in linea con i competitor di dimensioni simili, confermando che la vera innovazione non sta nell'inventare nuove architetture miracolose, ma nell'ottimizzare l'addestramento per estrarre il massimo da modelli più compatti.

Completano l'ecosistema Mistral Vibe CLI, un agente da riga di comando che trasforma Devstral in un coding assistant interattivo. Vibe può esplorare codebase, modificare file multipli, eseguire comandi shell e gestire Git, il tutto orchestrato attraverso conversazioni in linguaggio naturale. Non è la prima CLI agent al mondo, strumenti come Cline, Cursor e Kilo Code esistevano già, ma è la prima costruita specificamente per un modello open-weight europeo, con particolare attenzione alla privacy e alla possibilità di deployment on-premise (in sede). In un continente ossessionato dal GDPR, poter far girare un coding assistant sui propri server senza inviare una riga di codice ai cloud americani ha un valore che va oltre le metriche tecniche.

Open ma non troppo

Sul fronte licenze, Mistral gioca una partita ibrida che rivela molto della sua strategia. Devstral Small 2 è rilasciato sotto licenza Apache 2.0, lo standard di fatto dell'open source enterprise: permetti qualsiasi uso, anche commerciale, chiedi solo di mantenere le attribuzioni. È la stessa licenza di React, Kubernetes, TensorFlow. Devstral 2 invece usa una modified MIT license con un cap di revenue: se la tua azienda fattura più di 20 milioni di dollari al mese, devi negoziare una licenza commerciale con Mistral. È una mossa che cerca di bilanciare l'accessibilità per startup e ricercatori con la necessità di monetizzare i deployment enterprise.

Il pricing via API segue logiche simili: gratuito inizialmente, poi 0,40 dollari per milione di token in input e 2 dollari in output per Devstral 2, scendendo a 0,10 e 0,30 dollari per Small 2. Confrontato con Claude Sonnet 4.5 (3 e 15 dollari rispettivamente), Mistral costa circa un settimo. L'azienda francese dichiara che Devstral 2 è "fino a 7 volte più cost-efficient di Claude Sonnet per task reali", uno slogan che ha senso considerando non solo il prezzo per token ma anche la compattezza del modello, che richiede meno passaggi per completare operazioni complesse.

Questa strategia ibrida, alcuni modelli Apache 2.0, altri con restrizioni commerciali, pricing aggressivo ma non gratis per sempre, ricorda l'approccio di aziende come Red Hat negli anni Duemila: open source dove possibile, monetizzazione sul supporto enterprise e sulle funzionalità avanzate. È un modello che ha funzionato nel software tradizionale, ma nell'AI la partita è più complessa: i costi di addestramento sono ordini di grandezza superiori a quelli di sviluppo software, e i competitor proprietari possono permettersi di vendere in perdita per anni grazie ai bottini di guerra di big tech.

L'accessibilità dei pesi del modello su Hugging Face e la compatibilità con framework standard come vLLM e Transformers democratizzano l'accesso, ma sollevano anche domande sulla sostenibilità: se chiunque può scaricare i pesi e fare inferenza in locale, come si finanziano i cicli di addestramento successivi? Mistral conta sul fatto che la maggior parte delle aziende preferiranno pagare per API gestite piuttosto che gestire l'infrastruttura internamente, seguendo la stessa logica per cui molte aziende usano AWS invece di costruire datacenter propri. Ma è una scommessa, non una certezza.

La via europea secondo Floridi

Per capire dove si inserisce Mistral nel dibattito più ampio sulla sovranità tecnologica europea, vale la pena tornare alle riflessioni di Luciano Floridi, filosofo dell'informazione che insegna tra Yale, Bologna e Oxford, dove ha diretto per anni il Digital Ethics Lab. Floridi, che ha contribuito alle linee guida etiche della Commissione Europea per l'AI e oggi presiede la Fondazione Leonardo, ha elaborato negli ultimi anni una visione particolare del ruolo che l'Europa potrebbe giocare nella corsa all'intelligenza artificiale.

La sua tesi parte da una constatazione scomoda: l'Europa sta subendo la spartizione del mercato AI tra Stati Uniti e Cina, riducendosi a spettatrice di una partita giocata altrove. Ma secondo Floridi esiste un'alternativa concreta, che passa dall'open source abbinato alla forza normativa europea. Il continente potrebbe trasformare quello che viene percepito come un ostacolo, la regolamentazione stringente incarnata dall'AI Act, in un valore differenziante sul mercato globale. Un bollino europeo di sicurezza normativa, compliance sulla protezione dati, trasparenza sul copyright, tutto questo non come reazione difensiva ma come promozione attiva del made in Europe tecnologico.

La visione di Floridi contempla una dimensione open-source europea che potrebbe configurarsi come quarto polo globale, distinto da Stati Uniti, Cina e dal resto del mondo. Non si tratta di competere frontalmente con i budget americani o con la scala industriale cinese, ma di offrire qualcosa che né Washington né Pechino possono replicare facilmente: sistemi AI open, garantiti da un framework legislativo solido, con costi competitivi proprio perché open-source. È meglio dei cinesi perché incorpora regole etiche e di sicurezza per design, meglio degli americani perché è open-source invece che chiuso e proprietario.

L'idea è che esista un universo di paesi e aziende che potrebbero preferire un sistema open-source europeo, garantito dalla legislazione UE, rispetto a un closed system americano che costa cifre proibitive e solleva domande sulla gestione dei dati. Floridi suggerisce di trasformare il momento normativo da freno potenziale a valore aggiunto: se chi acquista intelligenza artificiale europea sa che è costruita in un contesto che offre garanzie ulteriori oltre a un prodotto a costi super competitivi, allora la regolamentazione diventa un asset competitivo invece che un handicap.

Questa visione, per quanto affascinante intellettualmente, si scontra con alcune realtà dure. La prima: l'hardware. Tutti i modelli di Mistral, Devstral 2 incluso, sono addestrati su GPU NVIDIA, probabilmente H100 o A100, tutte progettate in California e fabbricate (nella migliore delle ipotesi) a Taiwan. L'Europa non ha un equivalente di NVIDIA, e i tentativi di creare chip AI sovrani, come il progetto ASML-backed di Mistral stesso, sono ancora nelle fasi iniziali. Senza controllo dello stack hardware, la sovranità tecnologica resta parziale.

La seconda realtà: il talento. Mistral è stata fondata da ricercatori che si sono formati e hanno lavorato in aziende americane (DeepMind, Meta). Il flusso di cervelli continua a essere prevalentemente verso ovest, con stipendi e opportunità che l'Europa fatica a replicare. La terza: la scala. Anche considerando il brillante round Series C da 1,7 miliardi di euro guidato da ASML, Mistral ha raccolto circa 2,8 miliardi totali dalla fondazione. OpenAI ha raccolto oltre 14 miliardi, Anthropic circa 10 miliardi. La disparità di risorse si traduce in disparità di capacità di addestramento, che alla lunga pesa più dell'ingegnosità algoritmica.

Eppure, l'approccio Mistral ha dei meriti innegabili. L'azienda ha dimostrato che è possibile costruire modelli competitivi con una frazione delle risorse dei competitor americani, sfruttando architetture più efficienti e dataset più curati. Ha mostrato che l'open-weight non è incompatibile con un business model sostenibile, almeno in teoria. E ha creato un ecosistema di sviluppatori che non dipende da piattaforme americane: Vibe CLI, i pesi su Hugging Face, l'integrazione con vLLM, tutto questo crea alternative concrete ai workflow dominati da GitHub Copilot, ChatGPT o Claude.

Il punto cruciale sollevato da Floridi riguarda proprio questa possibilità di costruire un'alleanza tra regolamentazione intelligente e innovazione open-source. Se l'AI Act venisse implementato non come lista di divieti ma come framework che certifica la bontà dei sistemi AI, trasparenza, equità, privacy by design, allora le aziende europee avrebbero un vantaggio competitivo verso tutti quei mercati che guardano con sospetto ai sistemi americani (per questioni di privacy e monopolio) o cinesi (per questioni geopolitiche). Sud America, Africa, parte dell'Asia, perfino segmenti del mercato americano più sensibili alla privacy potrebbero preferire un'alternativa europea certificata.

Mistral sta tentando esattamente questo: costruire sistemi AI competitivi tecnicamente, open dove possibile, allineati con le normative europee per design. Devstral 2 non raccoglie dati di addestramento senza consenso, non viene distribuito per usi militari secondo le licenze, rispetta i principi di trasparenza dell'AI Act. Sono vincoli che gli altri non hanno o non rispettano, ma che potrebbero diventare motivi di vendita in un mercato sempre più attento alle questioni etiche.

Il paradosso del campione locale

C'è però un paradosso di fondo che nessuna narrazione entusiastica può nascondere completamente. Mistral AI, con la sua valutazione di 11,7 miliardi di euro e i suoi circa 500 dipendenti, è il più grande unicorno AI europeo. Ma nel contesto globale rimane una startup di medie dimensioni. OpenAI è valutata oltre 150 miliardi di dollari e impiega migliaia di persone. Anthropic viaggia sui 18 miliardi di valutazione. Google DeepMind ha risorse essenzialmente illimitate. Anche i competitor cinesi come DeepSeek operano con il backing implicito o esplicito dello stato cinese, che considera l'AI una questione di sicurezza nazionale.

La geografia del talento AI racconta una storia simile. I tre fondatori di Mistral, Arthur Mensch, Guillaume Lample, Timothée Lacroix, si sono formati ed hanno acquisito esperienza critica rispettivamente in Google DeepMind e Meta AI Research. Il modello è simile a quello di Anthropic, fondata da ex OpenAI, o di Cohere, fondata da ex Google Brain. I migliori laboratori di ricerca restano concentrati in California, e anche quando nascono eccellenze europee come DeepMind (britannica) o Mistral (francese), finiscono per essere acquisite (DeepMind da Google) o fortemente influenzate da investitori americani (Mistral ha tra gli investitori Andreessen Horowitz, General Catalyst, Lightspeed, NVIDIA).

Sul fronte dei clienti enterprise, Mistral ha ottenuto contratti significativi: il ministero della Difesa francese, BNP Paribas, Orange, CMA-CGM per 100 milioni di euro in cinque anni. Sono vittorie importanti che dimostrano l'appetibilità del prodotto. Ma se si guarda alla scala, Microsoft e OpenAI hanno accordi con praticamente tutte le Fortune 500, Google Cloud integra i propri modelli in decine di migliaia di aziende, AWS offre Bedrock con modelli di Anthropic. Il mercato enterprise globale è già largamente presidiato dai giganti americani, e scalzarli richiede non solo prodotti migliori ma ecosistemi completi: tool di sviluppo, integrazioni, supporto, ecosistema di partner.

La dipendenza da NVIDIA è forse l'aspetto più stridente. Il round Series C guidato da ASML, produttore olandese di macchine per la litografia EUV (extreme ultraviolet) essenziali per fabbricare chip avanzati, segnala la volontà di costruire una catena di approvvigionamento più europea. Ma ASML stessa dipende da componenti americani e giapponesi, e in ogni caso il percorso per produrre GPU AI competitive con NVIDIA richiede anni se non decenni. Nel frattempo, ogni modello Mistral si allena su silicio americano, creando una dipendenza strutturale che nessuna narrazione sovranista può davvero aggirare.

C'è poi la questione dei dataset. I modelli AI si nutrono di dati, e la maggior parte dei dati di qualità, codice open-source su GitHub, contenuti web, conversazioni, è prodotta in ecosistemi dominati da piattaforme americane. GitHub è di Microsoft, Reddit ha accordi di licensing con OpenAI, Stack Overflow ha venduto i dati della sua community. L'Europa produce contenuti di qualità, ma non controlla le piattaforme dove questi contenuti vengono aggregati e strutturati. Anche qui, la sovranità tecnologica si rivela parziale.

Eppure, nonostante tutti questi paradossi e limiti strutturali, l'esperimento Mistral resta significativo. Dimostra che è possibile costruire tecnologia AI di frontiera fuori dalla Silicon Valley, che l'open-source può coesistere con modelli di business sostenibili, che esistono talenti e capitali europei disposti a scommettere su questa sfida. Devstral 2, con le sue performance competitive e i suoi 123 miliardi di parametri concentrati in un package efficiente, è la prova più tangibile che l'Europa può giocare questa partita.

La domanda aperta è se possa vincerla. O se, più realisticamente, possa ritagliarsi uno spazio sufficientemente grande da garantire che il futuro dell'AI non sia un duopolio Stati Uniti-Cina. La via europea immaginata da Floridi, regolamentazione come asset, open-source come differenziatore, è una scommessa intellettualmente coerente. Ma le scommesse, per definizione, possono essere vinte o perse. E in questo momento, con le risorse schierate sul tavolo, il tavolo stesso resta dominato da giocatori che parlano inglese e mandarino.

Nel frattempo, per gli sviluppatori europei e per le aziende che vogliono alternative ai sistemi proprietari americani, Devstral 2 rappresenta un'opzione concreta. Un modello open-weight che puoi far girare sui tuoi server, ispezionare, modificare, integrare nei tuoi workflow senza dipendere da API controllate da altre aziende. Non è la soluzione definitiva al problema della sovranità tecnologica, ma è un passo nella direzione giusta. In un settore che corre alla velocità della luce, anche un passo può fare la differenza tra rimanere nella corsa o venire definitivamente staccati dal gruppo di testa.

La sfida per Mistral nei prossimi anni sarà doppia: continuare a produrre modelli che tengano il passo con i progressi di OpenAI, Anthropic e DeepSeek, e contemporaneamente costruire un ecosistema europeo abbastanza forte da non venire assorbito o marginalizzato dai giganti globali. Devstral 2 è un buon inizio, ma è solo l'inizio. Il resto della storia lo scriveranno i prossimi rilasci, le prossime partnership, e soprattutto la capacità dell'Europa di trasformare la visione di Floridi, regolamentazione illuminata più innovazione open-source, da concetto filosofico a realtà industriale. In una partita dove ogni mossa conta, e dove il tempo a disposizione potrebbe essere meno di quanto pensiamo.