Pentagono: Anthropic rifiuta, OpenAI accetta, chi scarica e chi disinstalla, e poi?

Ci sono settimane che sembrano decenni, e l'ultima di febbraio 2026 è stata una di quelle. Nel giro di novantasei ore, Anthropic ha rifiutato le condizioni del Dipartimento della Difesa americano, ribattezzato "Department of War" dall'amministrazione Trump, è stata dichiarata rischio per la catena di approvvigionamento nazionale, è finita nel mirino di un decreto presidenziale, ha visto il proprio chatbot scalare la vetta dell'App Store americano e ha annunciato che avrebbe fatto ricorso in tribunale. OpenAI, nel frattempo, ha firmato un accordo con lo stesso Pentagono in tempi talmente brevi che il suo stesso amministratore delegato lo ha definito pubblicamente "precipitoso". Gli utenti hanno risposto a modo loro: disinstallando. La risposta alla domanda su cosa accadrà davvero è, onestamente, una sola: vedremo.

Il confine che nessuno voleva tracciare

Per capire cosa è successo, bisogna partire da ciò che il Pentagono voleva e da ciò che Anthropic si è rifiutata di concedere. Il cuore della disputa riguarda due linee rosse precise: l'uso dell'intelligenza artificiale per la sorveglianza di massa dei cittadini americani, e l'impiego di sistemi d'arma completamente autonomi, capaci di selezionare ed eliminare bersagli senza intervento umano. Dario Amodei ha tenuto il punto anche quando il segretario alla Difesa Pete Hegseth ha fissato un ultimatum, le 17:01 del venerdì, minacciando di dichiarare l'azienda un "rischio per la supply chain".

La posizione del Pentagono, nella sua formulazione ufficiale, non era quella di chiedere esplicitamente droni killer. Il portavoce Sean Parnell ha dichiarato su X che il dipartimento non ha alcun interesse nella sorveglianza domestica di massa né nelle armi autonome, ma che la richiesta era più semplice: permettere al Pentagono di usare i modelli di Anthropic per "tutti gli usi leciti". Il punto di frizione è precisamente lì. Chi decide cosa è lecito? La risposta di Hegseth era netta: non di certo il fornitore.

Il contesto normativo non aiuta a rassicurare. Secondo una direttiva del Dipartimento della Difesa del 2023, i sistemi di intelligenza artificiale possono selezionare e ingaggiare bersagli senza intervento umano, purché superino determinati standard e siano approvati da funzionari di alto livello. Non esiste un divieto categorico sulle armi autonome nell'apparato militare americano. Anthropic, conoscendo questa cornice, non voleva che i propri modelli entrassero in un sistema in cui l'"uso lecito" potesse includere, in futuro, decisioni letali automatizzate. La preoccupazione non è campata in aria: un sistema di IA posizionato in contesti ad altissimo rischio può commettere errori irreversibili con la velocità di un processore. La differenza tra un modello che consiglia e uno che agisce è, in certi scenari, la differenza tra un errore correggibile e una catastrofe.

Hegseth ha risposto con la scure. Trump ha emesso un decreto che ordina a tutte le agenzie federali di cessare l'uso delle tecnologie Anthropic entro sei mesi. Anthropic ha annunciato che contesterà la decisione in tribunale.

I numeri che fanno rumore

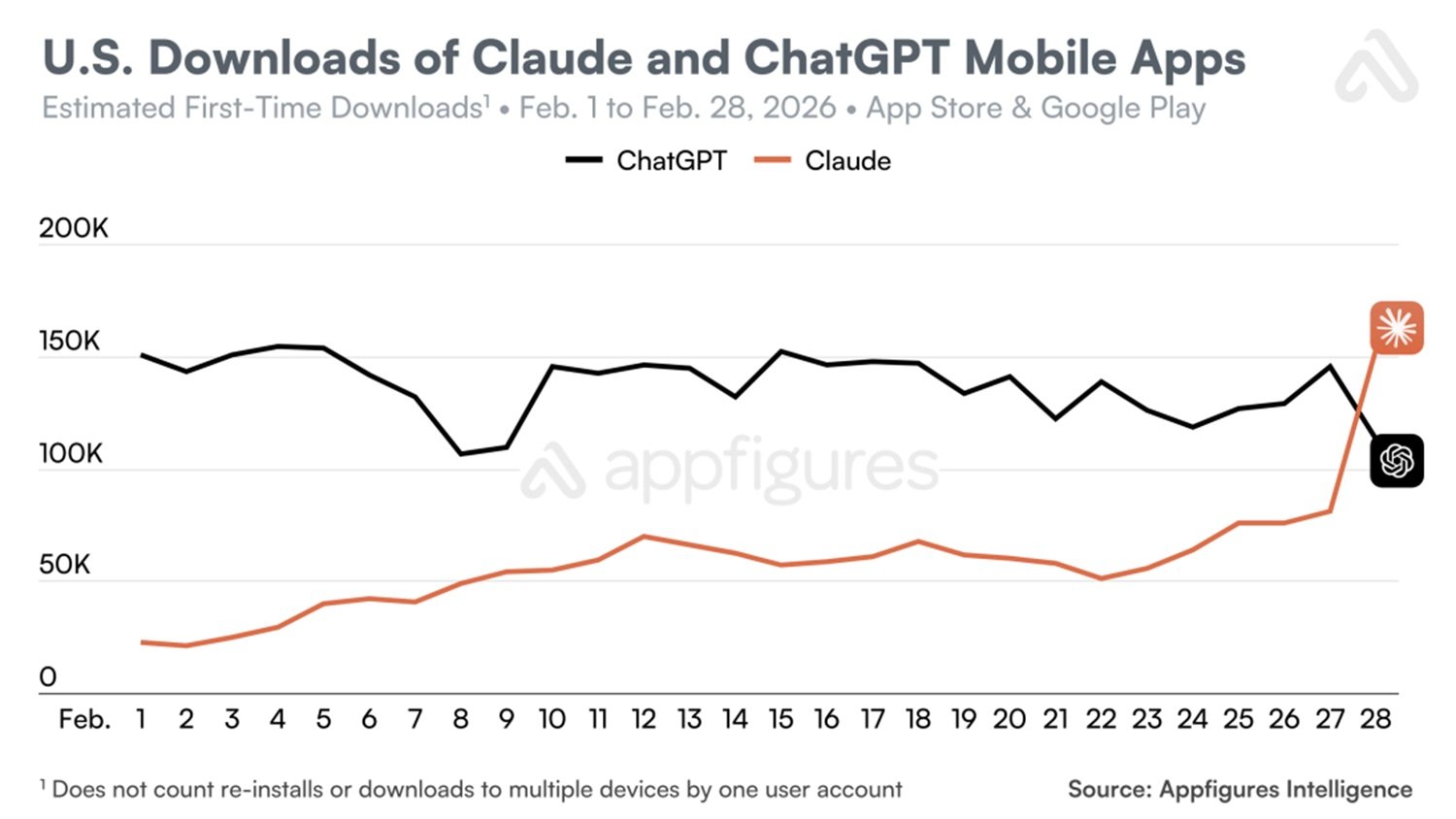

Mentre i comunicati ufficiali circolavano, la risposta più immediata è arrivata dagli store delle app, e i dati sono sufficientemente verificati da meritare attenzione puntuale.

Secondo Sensor Tower, le disinstallazioni statunitensi di ChatGPT sono aumentate del 295% su base giornaliera il 28 febbraio. Per contestualizzare: il tasso tipico di disinstallazione giornaliera di ChatGPT, misurato nelle trenta settimane precedenti, era del 9%. Non è un'oscillazione, è un salto. I download di ChatGPT calano del 13% il sabato e di un ulteriore 5% la domenica. Sul fronte opposto, Claude ha visto i propri download statunitensi crescere del 37% venerdì 27, il giorno del rifiuto di Amodei, e di un ulteriore 51% sabato 28. La conseguenza è che Claude ha raggiunto la prima posizione nella classifica App Store americana, un balzo di oltre venti posizioni rispetto al 22 febbraio.

Appfigures, secondo fornitore di dati indipendente, certifica che i download giornalieri di Claude negli USA hanno superato quelli di ChatGPT per la prima volta in assoluto nella giornata di sabato, con stime di crescita ancora più alte: +88% su base giornaliera. Appfigures segnala anche che Claude risultava primo tra le app gratuite per iPhone in sei paesi: Belgio, Canada, Germania, Lussemburgo, Norvegia, Svizzera e Stati Uniti. Sensor Tower aggiunge un dato di sentiment particolarmente eloquente: le recensioni a una stella su ChatGPT crescono del 775% sabato 28, con un ulteriore raddoppio domenica. Le recensioni a cinque stelle calano del 50% nello stesso periodo.

Va detto con onestà metodologica che Similarweb ha osservato come i download di Claude nell'ultima settimana fossero circa venti volte superiori ai livelli di gennaio, ma ha anche precisato che l'aumento potrebbe avere concause diverse dalla questione politica. Attribuire tutto alla scelta etica di Anthropic sarebbe una semplificazione. La coincidenza temporale, tuttavia, è difficile da ignorare.

OpenAI, l'accordo frettoloso e i guardrail in discussione

Sam Altman lo ha ammesso su X senza troppi giri di parole: l'accordo con il Dipartimento della Guerra era stato "decisamente precipitoso" e "le prospettive non sembrano buone". È una concessione rara, quella di un CEO che critica pubblicamente una propria decisione strategica mentre la sta ancora difendendo.

La cronologia è questa: venerdì sera le trattative tra Anthropic e il Pentagono collassano definitivamente; sabato OpenAI annuncia il proprio accordo per il dispiegamento dei modelli in ambienti classificati. La rapidità ha generato domande immediate: OpenAI aveva davvero le stesse linee rosse di Anthropic? Se sì, com'era riuscita a firmare dove Anthropic aveva fallito?

OpenAI ha risposto con un post sul proprio blog, elencando tre aree escluse dall'accordo: sorveglianza domestica di massa, sistemi d'arma autonomi, e decisioni automatizzate ad alto rischio. L'azienda ha sostenuto che, a differenza di altri operatori che avrebbero "ridotto o rimosso i loro guardrail di sicurezza" nelle implementazioni militari, il proprio approccio è multi-strato: controllo completo sullo stack di sicurezza, dispiegamento esclusivo via cloud, personale OpenAI con autorizzazione di sicurezza coinvolto nel processo, protezioni contrattuali "robuste". Katrina Mulligan, responsabile delle partnership per la sicurezza nazionale, ha argomentato su LinkedIn che limitare il dispiegamento all'API cloud impedisce fisicamente l'integrazione dei modelli in sistemi d'arma: un modello accessibile solo via cloud ha una distanza architetturale dai sistemi di controllo che un modello installato localmente non ha. È un argomento tecnico non privo di logica.

Tuttavia, Mike Masnick di Techdirt ha sollevato un'obiezione concreta: il testo dell'accordo, conformandosi all'Executive Order 12333, potrebbe aprire la porta alla sorveglianza di cittadini americani. Quell'ordine esecutivo, risalente all'era Reagan, consente la cattura di comunicazioni di persone statunitensi quando transitano attraverso canali internazionali. Se l'accordo OpenAI fa riferimento a quell'ordine come standard di conformità, la parola "protezione" assume contorni più sfumati di quanto il comunicato stampa suggerisca. La risposta di OpenAI è che l'architettura di deployment, cloud-only, senza integrazione diretta in hardware operativo, vale più del linguaggio contrattuale. Il dibattito, tecnicamente, non è chiuso.

Altman ha spiegato la propria logica in modo che vale la pena riportare: OpenAI sperava che l'accordo abbassasse la tensione tra il Dipartimento della Guerra e l'industria dell'IA nel suo complesso. Se avesse funzionato, l'azienda sarebbe apparsa come quella che aveva preso su di sé il costo di una mossa difficile nell'interesse del settore. In caso contrario, avrebbe continuato a sembrare precipitosa. Altman ha riconosciuto entrambe le possibilità.

La trappola del profeta disarmato

C'è una voce in questa vicenda che vale la pena ascoltare con attenzione proprio perché non è tenera con nessuno. Max Tegmark, fisico del MIT e fondatore del Future of Life Institute, ha rilasciato a TechCrunch un'intervista nel pomeriggio dello stesso venerdì in cui Trump firmava il decreto, e la sua analisi è un atto d'accusa strutturale.

L'argomento è questo: le aziende di intelligenza artificiale, Anthropic inclusa, hanno per anni resistito alla regolamentazione vincolante, sostituendola con impegni volontari di autogoverno. Il risultato è che oggi non esiste un quadro normativo che le protegga quando il governo decide di esigere usi che esse stesse considerano pericolosi. Non esiste attualmente negli Stati Uniti una legge che proibisca di costruire sistemi di IA per uccidere americani: il governo può semplicemente chiederlo, e le aziende non hanno strumenti legali per opporsi diversi da quelli contrattuali, che il Pentagono considera non vincolanti per una questione di principio.

A questo si aggiunge una circostanza che Tegmark sottolinea senza risparmio: la stessa settimana dello scontro con il Pentagono, Anthropic ha modificato il proprio impegno di sicurezza più importante, la promessa di non rilasciare sistemi di IA sempre più potenti finché l'azienda non fosse ragionevolmente certa che non avrebbero causato danni. Toglierla proprio in questo momento è, quanto meno, una coincidenza scomoda. Tegmark estende la critica all'intero settore: Google ha abbandonato il proprio impegno storico contro l'uso dell'IA per la sorveglianza e le armi; OpenAI ha rimosso la parola "sicurezza" dalla propria missione; xAI ha chiuso il proprio team di sicurezza. Gli impegni volontari, osserva, tendono a durare fin quando non diventano costosi.

Vedremo: le domande aperte

Siamo nella posizione di chi osserva una partita ancora in corso sapendo di avere i dati dei primissimi minuti. L'onestà intellettuale impone di non fare pronostici come se fossero certezze.

L'effetto etico durerà? Le impennate di download e le disinstallazioni registrate da Sensor Tower e Appfigures sono reali, ma i comportamenti degli utenti nelle app hanno una volatilità che chiunque lavori nel settore conosce bene. Chi usa ChatGPT integrato nei propri flussi di lavoro aziendali non si sposta in una settimana. La domanda non è se il 28 febbraio ha segnato un momento, lo ha fatto, è se quel momento sarà ricordato tra sei mesi o dimenticato tra sei settimane.

Le minacce di Trump avranno conseguenze concrete e durature? Il decreto esiste, la designazione come "rischio per la supply chain" esiste, il ricorso in tribunale di Anthropic è annunciato. Il VC Sachin Seth di Trousdale Ventures ha detto a TechCrunch che perdere Anthropic potrebbe creare un vuoto nel sistema di difesa americano che richiederebbe dai sei ai dodici mesi per essere colmato da altri fornitori. Questa dipendenza reciproca è, paradossalmente, una delle poche protezioni concrete di cui Anthropic dispone ora: è difficile espellere un fornitore quando sei tu il cliente che ne ha più bisogno.

Cosa succede a luglio 2026, quando scade il contratto tra OpenAI e il Dipartimento della Difesa? È una finestra temporale abbastanza vicina da essere già sul calendario di chiunque stia ragionando strategicamente nel settore. xAI ha già segnalato la propria disponibilità a operare in ambienti classificati senza le restrizioni che caratterizzano Anthropic e, in misura minore, OpenAI. La competizione per il contratto militare americano non è chiusa, e il fatto che Elon Musk sia allo stesso tempo consigliere dell'amministrazione Trump e proprietario di uno dei principali concorrenti di Anthropic e OpenAI non è un dettaglio trascurabile nel calcolo delle probabilità future.

C'è poi una dimensione geopolitica che questa vicenda porta in primo piano e che l'angolo americano rischia di oscurare. L'Europa sta osservando. L'AI Act europeo, il primo quadro normativo vincolante sull'intelligenza artificiale al mondo, entrato progressivamente in vigore, classifica i sistemi di IA usati in contesti militari in modo separato rispetto all'applicazione civile, lasciando di fatto ai singoli stati membri la gestione di quegli usi. Ma la pressione politica che si esercita su aziende come Anthropic, che ha team rilevanti in Europa e serve utenti in tutto il mondo, non è indifferente al dibattito regolamentare europeo. Se l'amministrazione Trump riesce a piegare le politiche di sicurezza di un'azienda americana, cosa garantisce che le stesse pressioni non si esercitino, per vie diverse, su aziende europee o su filiali europee di aziende americane? È una domanda che a Bruxelles stanno già facendo, anche se in modo più sottovoce di quanto la situazione meriterebbe.

L'analogia con la Guerra Fredda che Tegmark propone merita una breve nota finale. Come nella corsa agli armamenti nucleari, c'è un punto in cui la logica del "dobbiamo farlo noi prima che lo facciano i cinesi" si scontra con la matematica elementare del rischio reciproco. La Cina, osserva, sta lavorando per limitare alcune forme di IA antropomorfa, non per compiacere l'Occidente, ma perché le considera destabilizzanti per la propria società. Chi sostiene che Pechino non porrà mai limiti allo sviluppo dell'IA ignora le mosse regolamentari che il governo cinese ha già avviato in direzione opposta alla deregolamentazione totale. Non è un argomento per l'inazione, ma è un antidoto utile alle narrazioni troppo semplicistiche.

Rimane, al centro di tutto, la domanda che nessun comunicato stampa può risolvere: chi ha l'ultima parola quando un sistema di intelligenza artificiale è posizionato abbastanza vicino a una decisione letale da rendere la distinzione tra "consigliare" e "decidere" una questione di architettura software? Non è retorica. È la domanda che ha fatto saltare le trattative tra Amodei e Hegseth, che ha spinto Altman a firmare in fretta, e che i giudici americani si troveranno presto ad affrontare in forme che i codici attuali non contemplano.

Dario Amodei ha tenuto il punto. Sam Altman ha firmato. Gli utenti, per ora, hanno premiato chi ha detto no. Il Pentagono ha i propri piani, Trump ha firmato il decreto, i giudici riceveranno la memoria di Anthropic, e il contratto OpenAI scade a luglio.

Cosa accadrà? Vedremo.