Kimi K2.5 und Chinas langer Marsch in der KI: Wenn das Embargo zum Sprungbrett wird

In jeder hochkarätigen Schachpartie gibt es einen Moment, in dem man erkennt, dass der unter Druck stehende Spieler nicht versucht, sich zu verteidigen: Er baut einen Gegenzug auf. Etwas Ähnliches geschieht im großen geopolitischen Spiel der künstlichen Intelligenz, und die Veröffentlichung von Kimi K2.5 durch Moonshot AI ist nicht nur eine weitere Pressemitteilung, die man zerstreut überfliegt. Es ist ein weiteres Kapitel in einer Geschichte, die es wert ist, aufmerksam verfolgt zu werden, wie in der vorherigen Analyse zu Qwen3-TTS und der synthetischen Stimmgenerierung, denn sie erzählt und bestätigt, wie die von den Vereinigten Staaten gegen China verhängten Hardware-Beschränkungen genau den gegenteiligen Effekt von dem erzeugen, was erhofft wurde: Anstatt die chinesische Innovation zu verlangsamen, beschleunigen sie sie auf unvorhergesehenen Bahnen.

Wir hatten bereits darüber gesprochen, als wir DeepSeek und seine MHC-Architektur analysierten, und davor mit Kimi K2 Thinking. Heute kehren wir zu dem Thema zurück, nicht um dem Hype des neuesten Modells nachzujagen, sondern weil jede Veröffentlichung ein weiteres Teil zu einem Mosaik hinzufügt, das die globalen Gleichgewichte der KI neu gestaltet. Und Kimi K2.5, mit seinen einer Billion Parametern, die in einer tief optimierten Mixture-of-Experts-Architektur organisiert sind, stellt einen qualitativen Sprung dar, der mehr als ein abgelenktes Scrollen auf Hacker News verdient.

Eine weitere Veröffentlichung, die zählt

Beginnen wir mit den Zahlen, denn in der KI erzählen Zahlen Geschichten. Kimi K2.5 ist ein Monster mit insgesamt einer Billion Parametern, aber dank der MoE-Architektur aktiviert es nur zweiunddreißig Milliarden für jedes generierte Token. Es ist, als hätte man eine riesige Bibliothek, in der man, anstatt jedes Mal alle Bände durchzublättern, automatisch die acht relevantesten Regale aus den dreihundertachtzig verfügbaren auswählt, plus ein gemeinsam genutztes Regal, das immer konsultiert wird. Dieser Ansatz, technisch als "Sparsity" bezeichnet, ist nicht neu, aber Moonshot hat ihn auf ein beeindruckendes Niveau der Verfeinerung gebracht.

Die Architektur basiert auf einundsechzig Schichten, von denen eine dicht ist, mit einem Aufmerksamkeitsmechanismus namens MLA (Multi-Head Latent Attention), der die Speicheranforderungen während der Inferenz drastisch reduziert. Die verborgene Dimension der Aufmerksamkeit beträgt 7168, während jeder MoE-Experte mit 2048 verborgenen Dimensionen arbeitet. Das Vokabular umfasst 160.000 Token und der Kontext erstreckt sich auf bis zu 256.000 Token, ein Fenster, das die Verarbeitung sehr langer Dokumente oder komplexer Gespräche ermöglicht, ohne den Faden zu verlieren.

Aber der wahre Sprung im Vergleich zu K2 liegt woanders. Moonshot hat nativ multimodale Fähigkeiten durch MoonViT integriert, einen 400-Millionen-Parameter-Visions-Encoder, der es dem Modell ermöglicht, Bilder und Videos nicht als mühsam aufgepfropfte Add-ons zu "sehen", sondern als organischen Teil seines Weltverständnisses. Es wurde auf etwa fünfzehn Billionen gemischten, visuellen und textuellen Token durch kontinuierliches Vortraining auf Basis von Kimi-K2-Base trainiert. Ergebnis: K2.5 liest nicht nur Code, es generiert ihn, indem es sich UI-Mockups ansieht oder Workflows aus Videos analysiert.

Salvatore Sanfilippo, einer der angesehensten Entwickler der internationalen Tech-Community und Schöpfer von Redis, analysierte K2.5 und betonte genau diesen Aspekt: "Es ist ein nativ multimodales Modell, das speziell darauf trainiert wurde, Programmierprobleme im Zusammenhang mit der Benutzeroberfläche zu lösen, indem es als Agent agiert, der das Layout 'sieht'". Wir sprechen hier nicht von einem Demo-Trick, sondern von einer Designfähigkeit, die die Art und Weise verändert, wie man bei der täglichen Arbeit mit KI interagieren kann.

Und es gibt noch ein weiteres Element, das Sanfilippo als entscheidend hervorhebt: die native Vier-Bit-Quantisierung. K2.5 wurde von Anfang an mit Quantization-Aware-Training-Techniken trainiert, die es ermöglichen, es mit etwa 600-700 GB RAM zu betreiben. Das bedeutet, dass ein Cluster von Mac Studios oder Consumer-Servern mit relativ zugänglichen GPUs ein Spitzenmodell durch verteilte Inferenz ausführen kann. Man braucht kein Rechenzentrum eines Megakonzerns. Das ist konkrete technologische Demokratisierung, keine Rhetorik.

MoE, Vision und Agent Swarm

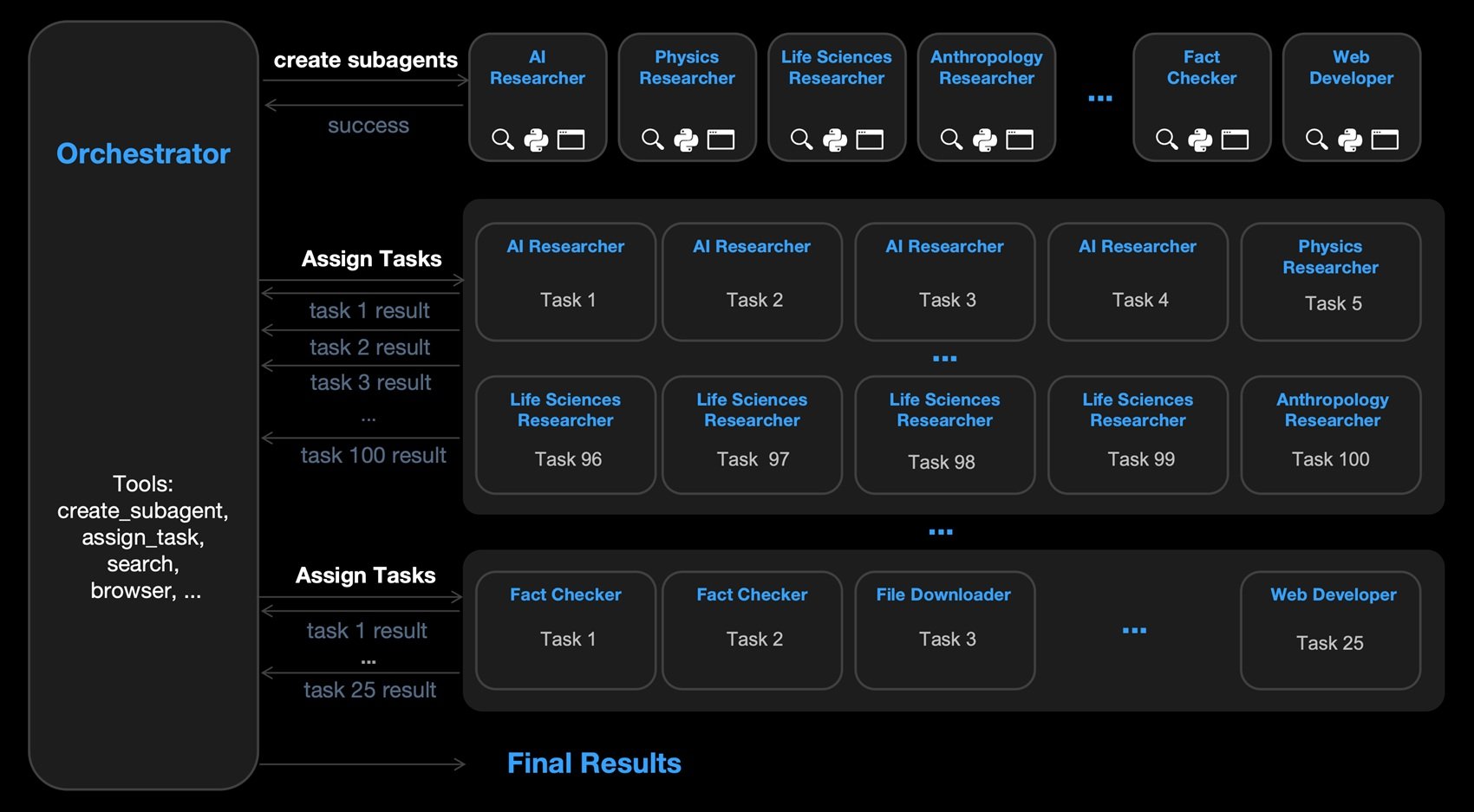

Aber die wahre Neuheit von K2.5 liegt in einer Funktion, die wie Science-Fiction klingt, aber bereits einsatzbereit ist: der Agenten-Schwarm. Anstatt einen einzelnen KI-Agenten an komplexen Aufgaben arbeiten zu lassen, kann K2.5 dynamisch Schwärme von spezialisierten Sub-Agenten instanziieren, die parallel zusammenarbeiten. Das ist wie der Übergang von einem einsamen Handwerker zu einer Renaissance-Werkstatt, in der sich jeder Meister auf seinen Teil der Arbeit konzentriert.

Der Mechanismus basiert auf einer Technik namens Parallel-Agent Reinforcement Learning (PARL): Das Modell zerlegt eine komplexe Aufgabe autonom in Teilziele, generiert für jedes spezialisierte Agenten und koordiniert deren Ausführung. In Benchmarks wie BrowseComp und WideSearch übertrifft K2.5 im Schwarm-Modus nicht nur seine Single-Agent-Version deutlich, sondern auch Konkurrenten wie GPT-5.2 und Claude 4.5 Opus. Bei BrowseComp mit aktivem Schwarm erreicht es 78,4 % gegenüber 60,6 % im Standardmodus. Bei WideSearch steigt es von 72,7 % auf 79 %.

Die Konfiguration sieht einen Hauptagenten vor, der bis zu fünfzehn Schritte ausführen kann, während jeder Sub-Agent bis zu hundert Schritte ausführen kann. Das ist eine computergestützte Orchestrierung, die mehr an einen Orchesterdirigenten als an einen Solisten erinnert, und die Ergebnisse sprechen für sich: Bei Aufgaben, die eine tiefgehende Websuche, eine mehrseitige Navigation oder die Analyse komplexer Datensätze erfordern, erschließt der Schwarm-Ansatz bisher unzugängliche Leistungsniveaus.

Dieser Paradigmenwechsel von der Skalierung einzelner Agenten zur schwarmähnlichen Ausführung stellt vielleicht den originellsten Beitrag von Moonshot dar. Während OpenAI und Anthropic weiterhin immer größere und teurere Modelle skalieren, erforschen die Chinesen verteilte Koordinationsmethoden, die den monolithischen Ansatz obsolet machen könnten. Das ist der Unterschied zwischen dem Bau immer höherer Wolkenkratzer und dem Entwurf effizienter horizontaler Städte.

Benchmarks: Leistung im Praxistest

Kommen wir zu den Zahlen, die wirklich zählen: Wie verhält sich K2.5, wenn es mit echten Problemen konfrontiert wird? Die von Moonshot veröffentlichten Benchmarks decken ein beeindruckendes Spektrum ab: mathematisches Denken, Codierung, multimodale Vision, lange Kontexte, agentenbasierte Suche. Und hier muss eine unbequeme, aber notwendige Prämisse gemacht werden.

Wie Sanfilippo noch einmal betont, "machen sie die Benchmarks selbst" und es bedürfe "einer unvoreingenommenen und unabhängigen Instanz, die die Ergebnisse unabhängig prüfen kann". Die amerikanischen Hersteller sind "völlig selbstreferenziell", neigen dazu, neue Modelle nur mit ihren eigenen früheren Versionen zu vergleichen und die Konkurrenz zu ignorieren. Die Chinesen hingegen beziehen die Daten amerikanischer Modelle immer noch in die Tests ein, "um zu beweisen, dass sie auf globaler Ebene mit ihnen konkurrieren können". Moonshot ist keine Ausnahme: Es veröffentlicht direkte Vergleiche mit GPT-5.2, Claude 4.5 Opus, Gemini 3 Pro, DeepSeek V3.2.

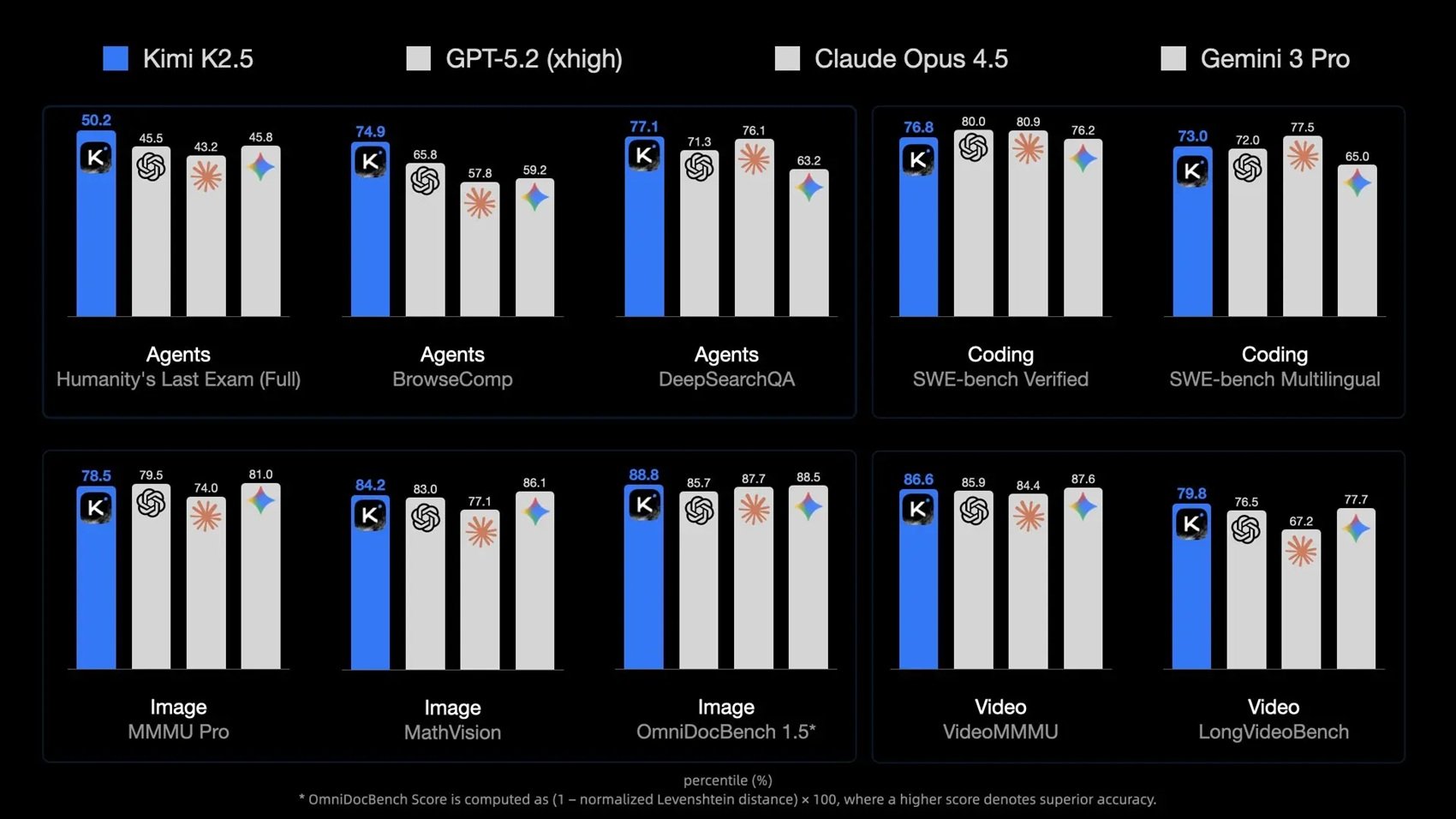

Beginnen wir mit dem logischen Denken. Bei HLE-Full (Humanity's Last Exam), einem der härtesten Benchmarks, der fortgeschrittene Problemlösungsfähigkeiten misst, erreicht K2.5 30,1 % ohne Werkzeuge und 50,2 % mit aktivierten Werkzeugen. GPT-5.2 erreicht 34,5 % und 45,5 %, Claude 4.5 Opus 30,8 % und 43,2 %. Wenn man die Fähigkeit hinzufügt, externe Werkzeuge zu verwenden, übertrifft K2.5 beide. Bei AIME 2025, den amerikanischen Mathematik-Olympiaden, erreicht K2.5 im Durchschnitt von zweiunddreißig Durchläufen 96,1 %, im Vergleich zu 100 % bei GPT-5.2, aber über den 92,8 % von Claude.

Im Bereich Coding sind die Ergebnisse noch interessanter. Bei SWE-Bench Verified, das die Fähigkeit testet, echte Fehler aus GitHub-Repositories zu beheben, liegt K2.5 bei 76,8 %, GPT-5.2 bei 80 %, Claude bei 80,9 %. Ein minimaler Abstand. Aber bei SWE-Bench Multilingual steigt K2.5 auf 73 % im Vergleich zu 72 % bei GPT und 77,5 % bei Claude. Und bei Terminal Bench 2.0, das die autonome Nutzung der Shell misst, erreicht K2.5 50,8 % und unterliegt GPT-5.2 (54 %), übertrifft aber DeepSeek V3.2 (46,4 %) deutlich.

Der visuelle Teil ist, wo K2.5 wirklich glänzt. Bei MMMU-Pro, einem multimodalen Universitäts-Benchmark, erreicht es 78,5 % gegenüber 79,5 % bei GPT und 74 % bei Claude. Bei MathVision, das die Lösung mathematischer Probleme aus Bildern erfordert, erreicht K2.5 84,2 % und schlägt damit GPT (83 %) und Claude (77,1 %). Bei WorldVQA, einem von Moonshot selbst erstellten Benchmark zum Testen des visuellen Wissens über die reale Welt, erreicht K2.5 46,3 % gegenüber den mageren 28 % von GPT-5.2. Und beim Videoverständnis liegt K2.5 bei VideoMMMU bei 86,6 %, bei VideoMME bei 87,4 % und bei LongVideoBench bei 79,8 %.

Sanfilippo hält "die Benchmarks von Kimi für historisch zuverlässig", obwohl er das Risiko von Datenlecks (Datensätze, die im Training landen) anerkennt, und schlägt die pragmatischste Lösung vor: "Laden Sie es herunter und stellen Sie ihm zehn spontan erfundene Probleme. Nur indem man persönlich überprüft, ob das Modell neue Probleme löst, kann man verstehen, ob es so stark ist, wie sie sagen." Die Open-Weights-Natur von K2.5 macht diese empirische Überprüfung möglich, im Gegensatz zu den geschlossenen amerikanischen Modellen.

Open Source gegen Closed: ein geopolitisches Spiel

Und hier kommen wir zum entscheidenden Punkt, der diese Veröffentlichung von einer Tech-Nachricht zu einem geopolitischen Ereignis macht. Moonshot hat die vollständigen Gewichte von K2.5 auf Hugging Face mit einer modifizierten MIT-Lizenz veröffentlicht, die äußerst freizügig ist. Man kann das Modell herunterladen, modifizieren, kommerziell nutzen. Die einzige Einschränkung: Wenn man zwanzig Millionen Dollar pro Monat Umsatz oder hundert Millionen aktive Nutzer überschreitet, muss man Moonshot AI explizit erwähnen. Das ist alles.

Vergleichen Sie dies mit der amerikanischen Strategie. OpenAI hat GPT-4 geschlossen, GPT-5 ist noch stärker abgeschottet. Anthropic veröffentlicht nur APIs für Claude, keinen Zugang zu den Gewichten. Google hält Gemini unter Verschluss. Der Ansatz ist das, was manche als "stratifizierte Offenheit" bezeichnen: Man veröffentlicht kleinere Open-Source-Versionen (Llama von Meta, Gemma von Google), behält aber die Spitzenmodelle streng proprietär. Das Ziel ist es, das Ökosystem zu kontrollieren, den Wettbewerbsvorteil zu wahren und durch APIs mit hohen Margen zu monetarisieren.

China spielt ein anderes Spiel. DeepSeek hat die Gewichte von V3 veröffentlicht, Qwen tut dasselbe, Moonshot bestätigt mit K2.5 den Trend. Sanfilippo ist deutlich: "Chinesische Modelle sind derzeit die einzige Garantie für eine zukünftige Demokratisierung der künstlichen Intelligenz. Während amerikanische Unternehmen dazu neigen, ihre stärksten Modelle zu schließen, um den Markt zu beherrschen, veröffentlichen die Chinesen sie weiterhin."

Die Frage ist: Warum? Es ist keine Philanthropie. Es ist Strategie. Die Veröffentlichung von Open-Weights-Modellen schafft eine umgekehrte technologische Abhängigkeit: Entwickler in Afrika, Südamerika, Osteuropa beginnen, auf chinesischer Infrastruktur aufzubauen. Wenn dieser Entwickler in drei Jahren CTO eines gewachsenen Startups ist, auf welchen Stack wird er sich Ihrer Meinung nach verlassen? Und wenn europäische, lateinamerikanische, asiatische Regierungen nationale KI-Infrastrukturen wählen müssen, werden sie wirklich denken, dass es eine gute strategische Idee ist, sich vollständig auf geschlossene amerikanische APIs zu verlassen?

Sanfilippo trifft diesen Nerv: "Der Besitz der Kimi 2.5-Gewichte ist ein Schutz vor möglichen willkürlichen politischen Entscheidungen, wie einer Blockade des Zugangs zu amerikanischer KI durch die Vereinigten Staaten. Die europäischen Regierenden sollten diesen Entwicklungen als strategischer Herausforderung große Aufmerksamkeit schenken." Das ist keine Paranoia: Wir haben gesehen, was mit Huawei, mit TikTok, mit den Lieferketten für Halbleiter passiert ist. Warum sollte es bei der KI anders sein?

Dann gibt es noch eine subtilere Frage. Sanfilippo verteidigt das Konzept der Open-Weights gegen Open-Source-Puristen: "Die Gewichte und der Inferenzcode reichen für die Freiheit des Nutzers aus, sie ermöglichen die Fortsetzung des Trainings oder die Erstellung unabhängiger Inferenzsysteme." Man braucht keine vollständigen Datensätze und Trainingspipelines (die niemand wirklich veröffentlicht, nicht einmal Meta mit Llama). Man muss in der Lage sein, das Modell auszuführen, zu modifizieren und zu erweitern. Und das ermöglicht K2.5 in vollem Umfang.

Die Community reagiert. Das Reddit-AMA des Kimi-Teams verzeichnete Hunderte von Fragen zu Feinabstimmung, lokaler Bereitstellung und Hardware-Optimierungen. Together.ai hat K2.5 bereits in seine Plattform integriert. Entwickler testen verschiedene Quantisierungen, erstellen Adapter für spezifische Frameworks und veröffentlichen unabhängige Benchmarks. Es ist ein sich selbst erhaltendes Ökosystem, genau wie bei Linux gegen Windows in den neunziger Jahren.

Hardware verweigert, Software gestärkt

Und hier kommen wir zum köstlichsten Paradoxon dieser Geschichte. Die US-Exportbeschränkungen für fortschrittliche Chips sollten die chinesische KI lahmlegen. Stattdessen haben sie sie widerstandsfähiger und innovativer gemacht. Das ist, als würde man einem Formel-1-Team Premium-Kraftstoff verweigern: Sie hören nicht auf zu fahren, sie entwickeln effizientere Motoren.

Seit 2022 haben die Vereinigten Staaten den Export von High-End-NVIDIA-GPUs nach China schrittweise blockiert: zuerst A100, dann H100, kürzlich sogar H200. Chinesische Unternehmen können nur auf "abgespeckte" Versionen wie H800 und H20 mit reduzierter Speicherbandbreite und Interkonnektivität zugreifen oder müssen sich auf die noch unausgereifte nationale Hardware von Huawei Ascend verlassen.

Die Antwort? Software-Architekturen, die aus minderwertiger Hardware das letzte Quäntchen Leistung herausquetschen. DeepSeek hat gezeigt, dass man ein wettbewerbsfähiges Modell hauptsächlich mit H800s trainieren kann. Moonshot geht mit K2.5 noch einen Schritt weiter: ein extrem optimiertes MoE, das nur 3,2 % der Gesamtparameter für jedes Token aktiviert, eine native INT4-Quantisierung, die den Speicherbedarf um das Vierfache reduziert, und Prefill- und Dekodierungstechniken, die laut der offiziellen Dokumentation eine 4,5-fache Beschleunigung gegenüber naiven Implementierungen erreichen.

Sanfilippo bringt es perfekt auf den Punkt: Die MoE-Architektur von K2.5 ist "tiefgreifend spärlich", gerade weil "für jedes ausgegebene Token nur 32 Milliarden aktiviert werden, wobei 8 von insgesamt 380 Experten beteiligt sind". Das bedeutet ein effizienteres Training auf weniger leistungsstarken H800/H20-Clustern und eine Inferenz, die auch für diejenigen zugänglich ist, die keine Rechenzentren auf NASA-Niveau haben.

Es gibt noch einen weiteren Aspekt, der Beachtung verdient: Sanfilippo erwähnt "die Hypothese, dass DeepSeek derzeit in einen massiven chinesischen Regierungsplan für das Training auf Huawei-GPUs involviert ist", ein mögliches "KI-Manhattan-Projekt", das die Verlangsamung ihrer öffentlichen Veröffentlichungen erklären würde. Sollte sich dies bestätigen, würde es bedeuten, dass China innerhalb weniger Jahre auf eine vollständige Hardware-Unabhängigkeit zusteuert. Und wenn das passiert, werden die US-Exportbeschränkungen irrelevant.

Der historische Vergleich, der einem in den Sinn kommt, ist der mit der japanischen Automobilindustrie in den 1970er Jahren. Als das Ölembargo zuschlug, gaben Toyota und Honda nicht auf: Sie entwickelten effizientere Motoren und eroberten den Weltmarkt. Moonshot, DeepSeek und Alibaba tun dasselbe mit der KI. Das Chip-Embargo schafft die Toyotas und Hondas der künstlichen Intelligenz.

Parallelwirtschaften und aufstrebende Märkte

Kommen wir zum Geld, denn am Ende geht es immer ums Geld. Moonshot AI wird nach neuesten Schätzungen mit 3,6 Milliarden Dollar bewertet, mit Unterstützung von Alibaba und anderen chinesischen Investoren. Das scheint viel, bis man es mit OpenAI (bewertet mit über 150 Milliarden), Anthropic (etwa 30 Milliarden) oder Google und Microsoft vergleicht, deren Marktkapitalisierungen im Bereich von zwei Billionen Dollar liegen.

Sanfilippo bemerkt die "starke Diskrepanz zwischen Form (finanzielle Bewertung) und Substanz (technische Fähigkeit)". Moonshot produziert ein Modell, das mit GPT-5 und Claude 4.5 konkurriert, aber nur ein Zehntel von Anthropic und ein Vierzigstel von OpenAI wert ist. Warum? Unterschiedliche Finanzmärkte, unterschiedliche VC-Ökosysteme, aber auch eine weniger aggressive Monetarisierung.

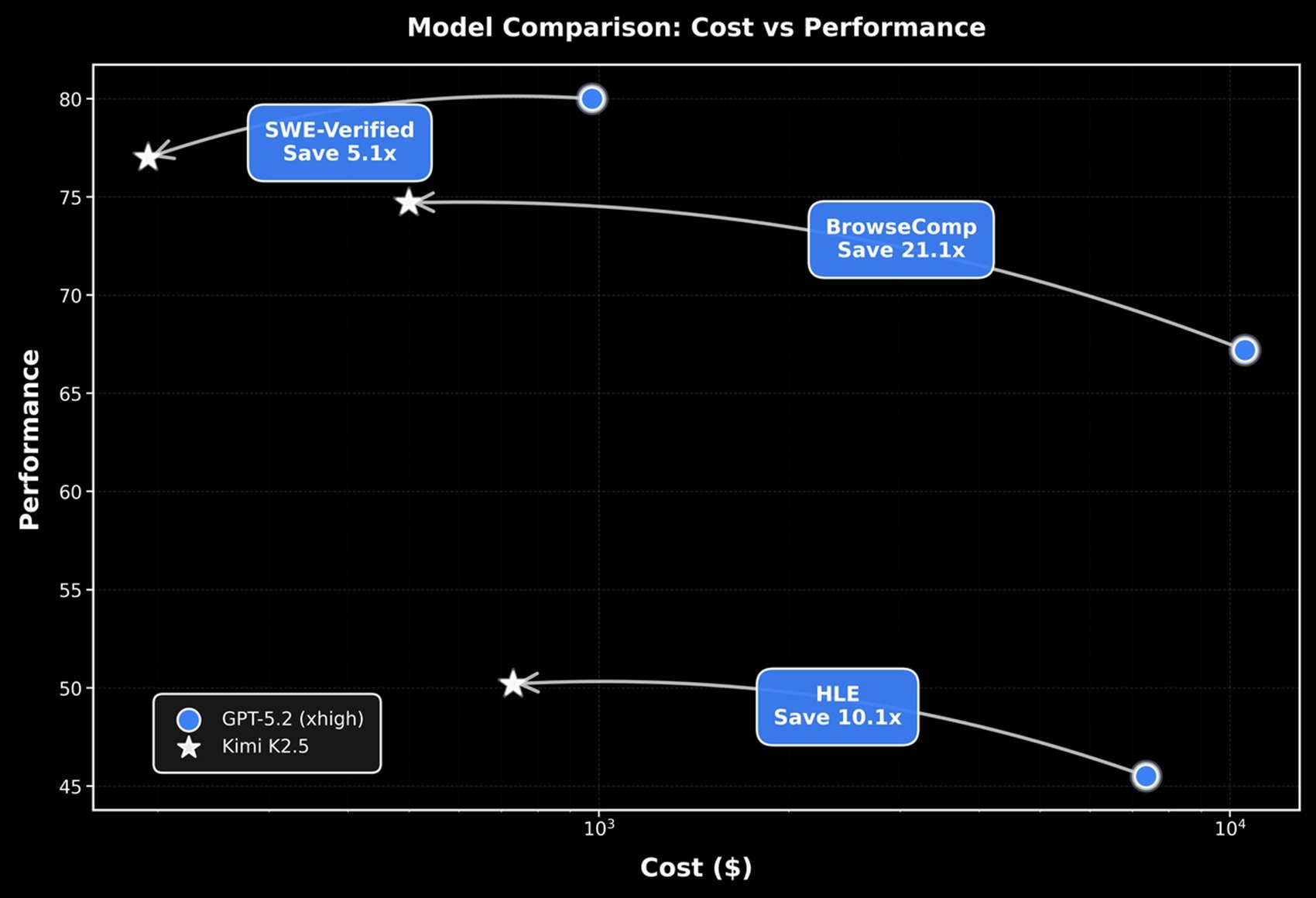

Schauen Sie sich die API-Preise an. K2.5 kostet laut Drittanbieterquellen 0,60 $ pro Million Eingabe-Token, 2,50 $ für die Ausgabe. GPT-5.2 im Denkmodus liegt bei 1,75 $ für die Eingabe und 14 $ für die Ausgabe pro Million Token. Claude Opus 4.5 liegt bei 5 $ für die Eingabe und 25 $ für die Ausgabe. K2.5 ist also bei der Eingabe dreimal billiger als GPT-5.2 und etwa achtmal billiger als Claude Opus 4.5, mit noch ausgeprägteren Unterschieden bei der Ausgabe.

Für ein Startup in Vietnam, Nigeria oder Argentinien, das KI in seine Produkte integrieren möchte, ist die Wahl klar. K2.5 kostet nicht nur weniger, sondern da es Open-Weights ist, kann man es auch lokal hosten, wenn man die Hardware hat, wodurch die API-Kosten und die Abhängigkeit von externen Anbietern vollständig entfallen. Dies schafft Parallelwirtschaften in der KI, Ökosysteme, die außerhalb des Silicon-Valley-zentrierten Kreislaufs wachsen.

Die Auswirkungen auf die aufstrebenden Märkte sind bereits sichtbar. Indische Unternehmen bauen Kundenservice-Chatbots auf Qwen und DeepSeek. Afrikanische Startups nutzen K2 für lokale Bildungsanwendungen. In Südamerika optimieren Entwickler chinesische Modelle für spezifische Aufgaben in Portugiesisch und Spanisch. Das sind keine glamourösen Märkte, die auf TechCrunch landen, aber es sind Volumina, die exponentiell wachsen.

Und es gibt einen perversen Netzwerkeffekt (aus amerikanischer Sicht): Je mehr Entwickler lernen, mit chinesischen Modellen zu arbeiten, desto mehr Werkzeuge, Frameworks und Integrationen entstehen um diese Modelle herum, und desto teurer wird der Wechsel zu amerikanischen Alternativen. Das ist Lock-in im Umkehrschluss. Microsoft und Google haben auf diesem Prinzip Imperien aufgebaut. Jetzt stehen sie auf der falschen Seite der Barrikade.

Die Zahlen sprechen für sich: Laut Daten von Andreessen Horowitz und OpenRouter sind chinesische Open-Source-Modelle von 1,2 % der weltweiten Nutzung Ende 2024 auf fast 30 % bis Dezember 2025 gestiegen. Nikkei berichtet, dass chinesische KI-Modelle im November 2025 etwa 15 % des globalen Marktanteils ausmachten, ein vertikales Wachstum von 1 % im Vorjahr. Eine Studie der RAND Corporation zeigt, dass chinesische Anbieter im August 2025 in dreißig Ländern über 10 % der Nutzer und in elf Ländern über 20 % der Nutzer erobert hatten, hauptsächlich in Asien, Afrika und Südamerika. Qwen von Alibaba hat über siebenhundert Millionen Downloads auf Hugging Face überschritten und ist damit das meistgenutzte Open-Source-KI-System der Welt. Nicht genug, um OpenAI oder Google in westlichen Märkten zu verdrängen, aber genug, um ein globales Monopol unmöglich zu machen.

Offene Fragen zur Zukunft

Schließen wir mit den Fragen, denn in der KI des Jahres 2026 sind Gewissheiten Mangelware und Fragen nützlicher als vorgefertigte Antworten. Erstes Thema: die Ausrichtung. Chinesische Open-Weights-Modelle folgen anderen Sicherheitsrichtlinien als amerikanische, sie spiegeln unweigerlich die kulturellen und politischen Werte des Kontexts wider, in dem sie entstehen. Wenn K2.5 von einem nigerianischen oder argentinischen Startup feinabgestimmt wird, wer garantiert, dass die ursprünglichen Ausrichtungen bestehen bleiben? Wer entscheidet, welche Leitplanken notwendig sind und welche Zensur darstellen?

Zweites Thema: die Roadmap. Moonshot spricht bereits von K3, DeepSeek arbeitet an V4, Alibaba iteriert weiter an Qwen. Die Veröffentlichungsgeschwindigkeit ist beeindruckend, aber ist sie nachhaltig? Das Training dieser Modelle erfordert monströse Energiemengen und riesige Rechenzentren. China verfügt über billige Energie (Kohle, Kernkraft, expandierende Erneuerbare), schnell gebaute Rechenzentren und einen Pool von Doktoranden in Informatik, der größer ist als der von Europa und den USA zusammen. Aber kann es dieses Tempo beibehalten, während es mit einer wirtschaftlichen Verlangsamung und wachsenden geopolitischen Spannungen konfrontiert ist?

Drittes Thema: Regulierung. Europa hat das KI-Gesetz verabschiedet, das Modelle über bestimmten Schwellenwerten für Parameter und Fähigkeiten als "hohes Risiko" einstuft und eine strenge Einhaltung vorschreibt. K2.5 überschreitet diese Schwellenwerte bei weitem. Muss Moonshot das Modell für den europäischen Markt zertifizieren lassen? Und wenn ja, bedeutet das, dass Open-Weights-Modelle unterschiedliche Versionen für unterschiedliche Rechtsordnungen haben werden, was das Konzept des "Offenen" selbst untergräbt?

Viertes Thema: nationale Sicherheit. Wenn westliche Regierungen beginnen, chinesische Modelle als Vektoren strategischen Einflusses wahrzunehmen, könnten wir Einschränkungen bei der Nutzung von K2.5, DeepSeek und Qwen in sensiblen Sektoren sehen. Bereits jetzt verbieten einige US-Regierungsbehörden chinesische Software auf offiziellen Geräten. Diese Verbot auf KI-Modelle auszudehnen, wäre technisch komplex, aber politisch plausibel. Und an diesem Punkt wird die Spaltung des globalen KI-Ökosystems dauerhaft.

Fünftes Thema: der Faktor Huawei. Wenn es China wirklich gelingt, Ascend-GPUs zu entwickeln, die mit denen von NVIDIA konkurrenzfähig sind, ändern sich die Dynamiken vollständig. Nicht mehr Software-Optimierung zur Umgehung von Hardware-Beschränkungen, sondern unabhängige End-to-End-Fähigkeit. Sanfilippo spekuliert, dass DeepSeek bereits an einem massiven Training mit Huawei-Chips arbeitet, einem staatlichen "Manhattan-Projekt". Wenn das stimmt, könnten wir in zwölf bis achtzehn Monaten chinesische Modelle sehen, die vollständig auf nationaler Hardware trainiert wurden und vor jedem zukünftigen Embargo immun sind.

Schließlich: die Frage der Wahrheit. Wie überprüfen wir die tatsächliche Leistung dieser Modelle? Sanfilippo schlägt unabhängige empirische Tests vor, aber wer hat die Ressourcen, dies systematisch zu tun? Es braucht wirklich ein CERN der KI, eine neutrale internationale Einrichtung, die Modelle unter kontrollierten Bedingungen testet und überprüfbare Ergebnisse veröffentlicht. Solange es das nicht gibt, navigieren wir zwischen selbstreferenziellen Behauptungen und potenziell durchgesickerten Benchmarks.

Ein Schachmatt, das das Spiel wert ist

Kehren wir zum Anfangsbild zurück, dem der Schachpartie. Die Vereinigten Staaten zogen mit dem Technologie-Embargo und dachten, sie würden China in Schach setzen. China antwortete mit einer Reihe unerwarteter Gegenzüge: effizientere Software-Architekturen, strategische Open-Weights-Veröffentlichungen, Entwickler-Ökosysteme, die außerhalb der Kontrolle des Silicon Valley wachsen. Kimi K2.5 ist einer dieser Gegenzüge, und es wird nicht der letzte sein.

Die lächerliche Marktbewertung im Vergleich zu den technischen Fähigkeiten erzählt laut Sanfilippo eine tiefere Geschichte: "Moonshot AI ist 3,6 Milliarden Dollar wert, eine sehr niedrige Zahl im Vergleich zu den überzogenen Bewertungen von OpenAI oder Anthropic, obwohl die Qualität des Modells vergleichbar ist." Der westliche Finanzmarkt hat noch nicht verarbeitet, dass die KI kein amerikanisches Monopol sein wird, dass es alternative Wege gibt, dass Software Hardware-Beschränkungen kompensieren kann (und hat).

Die Veröffentlichung von K2.5 beendet das Spiel nicht, sie eröffnet neue Phasen. Globale Entwickler haben jetzt Zugang zu fortschrittlichen multimodalen Fähigkeiten, Agenten-Schwärmen, vision-basiertem Coding, ohne von amerikanischen APIs oder Unternehmensbudgets abhängig zu sein. Regierungen haben strategische Optionen, die keine technologische Unterwerfung unter Washington bedeuten. Forscher können ein Spitzenmodell studieren, modifizieren und erweitern, ohne um Erlaubnis zu fragen oder unmögliche NDAs zu unterzeichnen.

Die offenen Fragen sind viele, die Gewissheiten wenige. Aber eines ist klar: Die Geographie der künstlichen Intelligenz wird neu gezeichnet, und zu denken, dass diese Neugestaltung mit Exportkontrollen gestoppt werden kann, ist so naiv wie zu denken, dass ein Ölembargo Toyota in den siebziger Jahren aufgehalten hätte. Die Technologiegeschichte belohnt diejenigen, die unter Zwang innovieren, nicht diejenigen, die ihre Pfründe schützen.

Moonshot AI, wie der Name schon sagt, zielt auf den Mond. Ob es wirklich dort ankommt, ist noch zu früh zu sagen. Aber in der Zwischenzeit, während wir zusehen, bauen sie immer bessere Raketen mit Materialien, die nicht ausreichen sollten. Und das allein ist schon etwas, das es wert ist, verfolgt zu werden.